- Python基于深度学习的动物图片识别技术的研究与实现

Java老徐

Python毕业设计python深度学习开发语言深度学习的动物图片识别技术Python动物图片识别技术

博主介绍:✌程序员徐师兄、7年大厂程序员经历。全网粉丝12w+、csdn博客专家、掘金/华为云/阿里云/InfoQ等平台优质作者、专注于Java技术领域和毕业项目实战✌文末获取源码联系精彩专栏推荐订阅不然下次找不到哟2022-2024年最全的计算机软件毕业设计选题大全:1000个热门选题推荐✅Java项目精品实战案例《100套》Java微信小程序项目实战《100套》感兴趣的可以先收藏起来,还有大家

- 【深度学习与大模型基础】第7章-特征分解与奇异值分解

lynn-66

深度学习与大模型基础算法机器学习人工智能

一、特征分解特征分解(EigenDecomposition)是线性代数中的一种重要方法,广泛应用于计算机行业的多个领域,如机器学习、图像处理和数据分析等。特征分解将一个方阵分解为特征值和特征向量的形式,帮助我们理解矩阵的结构和性质。1.特征分解的定义对于一个n×n的方阵A,如果存在一个非零向量v和一个标量λ,使得:则称λ为矩阵A的特征值,v为对应的特征向量。特征分解将矩阵A分解为:其中:Q是由特征

- 【论文阅读】实时全能分割模型

万里守约

论文阅读论文阅读图像分割图像处理计算机视觉

文章目录导言1、论文简介2、论文主要方法3、论文针对的问题4、论文创新点总结导言在最近的计算机视觉领域,针对实时多任务分割的需求日益增长,特别是在交互式分割、全景分割和视频实例分割等多种应用场景中。为了解决这些挑战,本文介绍了一种新方法——RMP-SAM(Real-TimeMulti-PurposeSegmentAnything),旨在实现实时的多功能分割。RMP-SAM结合了动态卷积与高效的模型

- 震惊! “深度学习”都在学习什么

扉间798

深度学习学习人工智能

常见的机器学习分类算法俗话说三个臭皮匠胜过诸葛亮这里面集成学习就是将单一的算法弱弱结合算法融合用投票给特征值加权重AdaBoost集成学习算法通过迭代训练一系列弱分类器,给予分类错误样本更高权重,使得后续弱分类器更关注这些样本,然后将这些弱分类器线性组合成强分类器,提高整体分类性能。(一)投票机制投票是一种直观且常用的算法融合策略。在多分类问题中,假设有多个分类器对同一数据进行分类判断。每个分类器

- 深度学习 | pytorch + torchvision + python 版本对应及环境安装

zfgfdgbhs

深度学习pythonpytorch

目录一、版本对应二、安装命令(pip)1.版本(1)v2.5.1~v2.0.0(2)v1.13.1~v1.11.0(3)v1.10.1~v1.7.02.安装全过程(1)选择版本(2)安装结果参考文章一、版本对应下表来自pytorch的github官方文档:pytorch/vision:Datasets,TransformsandModelsspecifictoComputerVisionpytor

- 一文讲清楚深度学习和机器学习

平凡而伟大.

机器学习人工智能深度学习机器学习人工智能

目录1.定义机器学习(MachineLearning,ML)深度学习(DeepLearning,DL)2.工作原理机器学习深度学习3.应用场景机器学习深度学习4.主要区别5.为什么选择深度学习?6.总结深度学习和机器学习是人工智能(AI)领域中两个密切相关但有所区别的概念。要清楚地解释它们之间的关系,我们可以从定义、工作原理、应用场景以及两者的主要区别等方面进行探讨。1.定义机器学习(Machin

- DeepSeek:智能搜索与分析的新纪元

XRC2231

学习

在人工智能浪潮席卷全球的今天,DeepSeek如同一颗璀璨的新星,以其独特的魅力和强大的功能,在AI领域脱颖而出。DeepSeek,这一基于深度学习和数据挖掘技术的智能搜索与分析系统,不仅重新定义了搜索引擎的边界,更以其卓越的性能和广泛的应用场景,为全球用户带来了前所未有的智能体验。本文将从DeepSeek的定义、特点、应用场景、优势等方面进行全面而深入的介绍,带您领略这一新兴技术的独特魅力。一、

- 大模型学习终极指南:从新手到专家的必经之路,全网最详尽解析,你敢挑战吗?

大模型入门教程

学习人工智能AI大模型大模型学习大模型教程AI大模型

随着人工智能技术的飞速发展,大模型(Large-ScaleModels)已经成为推动自然语言处理(NLP)、计算机视觉(CV)等领域进步的关键因素。本文将为您详细介绍从零开始学习大模型直至成为专家的全过程,包括所需掌握的知识点、学习资源以及实践建议等。无论您是初学者还是有一定基础的专业人士,都能从中获得有价值的指导。一、基础知识准备在开始学习大模型之前,需要先掌握一些基础知识,这些知识将为后续的学

- AI模型技术演进与行业应用图谱

智能计算研究中心

其他

内容概要当前AI模型技术正经历从基础架构到行业落地的系统性革新。主流深度学习框架如TensorFlow和PyTorch持续优化动态计算图与分布式训练能力,而MXNet凭借高效的异构计算支持在边缘场景崭露头角。与此同时,模型压缩技术通过量化和知识蒸馏将参数量降低60%-80%,联邦学习则通过加密梯度交换实现多机构数据协同训练。在应用层面,医疗诊断模型通过迁移学习在CT影像分类任务中达到98.2%的准

- AI大模型训练教程

Small踢倒coffee_氕氘氚

python自学经验分享笔记

1.引言随着人工智能技术的快速发展,大模型(如GPT-3、BERT等)在自然语言处理、计算机视觉等领域取得了显著的成果。训练一个大模型需要大量的计算资源、数据和专业知识。本教程将带你了解如何从零开始训练一个AI大模型。2.准备工作2.1硬件要求GPU:推荐使用NVIDIA的高性能GPU,如A100、V100等。内存:至少64GBRAM。存储:SSD存储,至少1TB。#2.2软件环境操作系统:Lin

- 使用Jupyter Notebook进行深度学习编程 - 深度学习教程

shandianfk_com

ChatGPTAIjupyter深度学习ide

大家好,今天我们要聊聊如何使用JupyterNotebook进行深度学习编程。深度学习是人工智能领域中的一项重要技术,通过模仿人脑神经网络的方式进行学习和分析。JupyterNotebook作为一个强大的工具,可以帮助我们轻松地进行深度学习编程,尤其适合初学者和研究人员。本文将带领大家一步步了解如何在JupyterNotebook中开展深度学习项目。一、什么是JupyterNotebook?Jup

- Opencv之计算机视觉一

闭月之泪舞

计算机视觉计算机视觉opencvpython

一、环境准备使用opencv库来实现简单的计算机视觉。需要安装两个库:opencv-python和opencv-contrib-python,版本可以自行选择,注意不同版本的opencv中的某些函数名和用法可能不同pipinstallopencv-python==3.4.18.65-ihttps://pypi.tuna.tsinghua.edu.cn/simplepipinstallopencv-

- 计算机视觉总结

Trank-Lw

计算机视觉深度学习人工智能

以下是针对上述问题的详细解答,并结合代码示例进行说明:1.改进YOLOv5人脸检测模块,复杂光照场景准确率从98.2%提升至99.5%优化具体过程:光照补偿:在数据预处理阶段,采用自适应光照补偿算法,对图像进行实时增强,以减少光照变化对人脸检测的影响。数据增强:在训练数据中增加复杂光照场景下的样本,如强光、弱光、背光等,通过数据增强提高模型对不同光照条件的适应性。模型调整:对YOLOv5模型的网络

- 深度学习 Deep Learning 第8章 深度学习优化

odoo中国

AI编程人工智能深度学习人工智能优化

深度学习第8章深度学习的优化章节概述本章深入探讨了深度学习中的优化技术,旨在解决模型训练过程中面临的各种挑战。优化是深度学习的核心环节,直接关系到模型的训练效率和最终性能。本章首先介绍了优化在深度学习中的特殊性,然后详细讨论了多种优化算法,包括随机梯度下降(SGD)、动量法、Nesterov动量法、AdaGrad、RMSProp和Adam等。此外,还探讨了参数初始化策略、自适应学习率方法以及二阶优

- 景联文科技提供高质量文本标注服务,驱动AI技术发展

景联文科技

科技人工智能

文本标注是指在原始文本数据上添加标签的过程,这些标签可以用来指示特定的实体、关系、事件等信息,以帮助计算机理解和处理这些数据。文本标注是自然语言处理(NLP)领域的一个重要环节,它通过为文本的不同部分提供具体的含义和上下文信息,增强机器学习和深度学习模型对文本内容的理解能力。标注类型情感分析情感极性:确定文本表达的情感倾向,如正面、负面或中立。强度评估:衡量情感的强烈程度,从轻微到极端不等。命名实

- 景联文科技:以高质量数据标注推动人工智能领域创新与发展

景联文科技

科技人工智能数据标注

在当今这个由数据驱动的时代,高质量的数据标注对于推动机器学习、自然语言处理(NLP)、计算机视觉等领域的发展具有不可替代的重要性。数据标注过程涉及对原始数据进行加工,通过标注特定对象的特征来生成能够被机器学习模型识别和使用的编码格式,从而使数据更具有意义和可解读性。数据标注的主要类型包括:图像标注:指在图片中标识出目标物体的位置、形状或类别等信息,如自动驾驶技术中的行人、车辆及交通标志的识别。文本

- 深度学习篇---对角矩阵&矩阵的秩&奇异矩阵

Ronin-Lotus

程序代码篇深度学习篇深度学习矩阵人工智能线性代数

文章目录前言一、对角矩阵(DiagonalMatrix)1.1定义1.2特性行列式运算简化1.3应用领域深度学习信号处理量子力学经济学二、矩阵的秩(RankofaMatrix)2.1定义2.2特性满秩降秩影响2.3应用领域深度学习图像压缩推荐系统控制理论三、奇异矩阵(SingularMatrix)3.1定义3.2特性秩不足行列式为零3.3应用领域深度学习正则化损失函数结构工程统计学数值计算四、跨领

- DeepSeek、Grok 与 ChatGPT 三巨头:技术架构与应用场景的全方位解析

云策量化

Deepseekchatgptdeepseekgrok

前言在当今人工智能领域,DeepSeek、Grok和ChatGPT作为语言模型的三巨头,各自凭借独特的技术架构和广泛的应用场景,在自然语言处理领域占据着重要地位。本文将对这三款模型的技术架构和应用场景进行全方位解析,以期为读者提供深入的了解和有价值的参考。一、技术架构(一)DeepSeekDeepSeek是由DeepSeek团队开发的一款大型语言模型,其技术架构基于深度学习中的Transforme

- OpenCV 4.2.0与扩展模块安装与应用指南

土城三富

本文还有配套的精品资源,点击获取简介:OpenCV4.2.0是一个先进的计算机视觉库,包含了图像处理、计算机视觉和机器学习算法。本压缩包包含OpenCV核心库和扩展模块(opencv_contrib),版本均为4.2.0。该版本引入了性能增强、API优化以及对深度学习框架和硬件加速技术的更新支持。扩展模块提供了额外的实验性算法和功能,有助于研究和开发新算法。指南详细介绍了如何安装和配置这些库,并提

- OpenCV ML 模块使用指南

ice_junjun

OpenCVopencv人工智能计算机视觉

一、模块概述OpenCV的ML模块提供了丰富的机器学习算法,可用于解决各种计算机视觉和数据分析问题。本指南将详细介绍该模块中主要的机器学习算法,包括支持向量机(SVM)、K均值聚类(K-Means)和神经网络(ANN),并结合图像分类和聚类分析这两个典型应用场景进行代码实现与解释。二、主要函数及类详解(一)支持向量机(SVM):cv.ml.SVM_create()功能支持向量机(SVM)是一种强大

- 介于YOLOv5的裂缝识别系统

程序员~小强

YOLO

介于YOLOv5的裂缝识别系统在现代工业中,裂缝监测是的保障设施安全的重要环节。我们公司的新项目——基于YOLOv5的裂缝识别系统,将为您提供高效、精准的解决方案,助力各类工程项目的质量管理。系统优势我们的裂缝识别系统借助YOLOv5进行深度学习,经过精心训练,拥有强大的图像识别能力。只需简单的步骤,您就能将复杂的裂缝检测转化为轻松的操作,让分析变得更加简单、高效。核心功能图片上传与场景选择用户可

- 使用Dall-E生成图像:文本到图像的魔力

shuoac

计算机视觉人工智能python

使用Dall-E生成图像:文本到图像的魔力技术背景介绍Dall-E是OpenAI开发的一个强大的文本到图像生成模型,它能够根据自然语言描述创造出全新的数字图像。这一技术基于深度学习的方法,使得创意与AI图像生成的结合更具可能性。本文将介绍如何调用Dall-EAPI来生成图像,从而使开发者能够将这一技术应用到自己的项目中。核心原理解析Dall-E利用大型语言模型(LLM)从用户提供的文本描述中提取详

- 【深度学习|地学应用】滑坡灾害早期隐患的概念、特征及识别方法,同时解释其与人工边坡、滑坡易发性之间的联系与区别。

985小水博一枚呀

深度学习人工智能

【深度学习|地学应用】滑坡灾害早期隐患的概念、特征及识别方法,同时解释其与人工边坡、滑坡易发性之间的联系与区别。【深度学习|地学应用】滑坡灾害早期隐患的概念、特征及识别方法,同时解释其与人工边坡、滑坡易发性之间的联系与区别。文章目录【深度学习|地学应用】滑坡灾害早期隐患的概念、特征及识别方法,同时解释其与人工边坡、滑坡易发性之间的联系与区别。1.滑坡灾害早期隐患的概念与特征概念主要特征2.通过光学

- 给普通人看的深度学习说明书:用快递系统理解AI如何思考

嵌入式Jerry

PythonAI人工智能深度学习

第一章:理解AI的思维方式(快递版)1.1快递分拣站的故事假设你管理一个快递分拣站:传统方法:手动制定规则(比如根据邮编分拣)机器学习:观察老员工的分拣记录,总结规律深度学习:搭建自动分拣流水线,自主发现隐藏规则1.2神经网络就像智能分拣机传送带(输入层):接收包裹信息(图片像素/文字等)#就像扫描快递单input_data=[0.2,0.7,0.1]#归一化后的特征数据分拣工人(隐藏层):每个工

- 解析大模型归一化:提升训练稳定性和性能的关键技术

秋声studio

口语化解析深度学习人工智能大模型归一化

引言在深度学习领域,特别是在处理大型神经网络模型时,归一化(Normalization)是一项至关重要的技术。它可以提高模型的训练稳定性和性能,在加速收敛方面发挥了重要作用。本文将深入探讨大模型归一化的原理、常见方法及其应用场景,并结合实际案例和代码示例进行说明。一、归一化的作用与理论基础归一化的主要目的是为了提高模型的训练稳定性和性能。具体来说,归一化有以下几个关键作用:提高训练稳定性:在神经网

- 深入解析深度学习中的过拟合与欠拟合诊断、解决与工程实践

古月居GYH

深度学习人工智能

一、引言:模型泛化能力的核心挑战在深度学习模型开发中,欠拟合与过拟合是影响泛化能力的两个核心矛盾。据GoogleBrain研究统计,工业级深度学习项目中有63%的失败案例与这两个问题直接相关。本文将从基础概念到工程实践,系统解析其本质特征、诊断方法及解决方案,并辅以可复现的代码案例。二、核心概念与通熟易懂解释简单而言,欠拟合是指模型不能在训练集上获得足够低的误差。换句换说,就是模型复杂度低,模型在

- CBNet--一种新的目标检测的复合骨干网体系结构

weixin_45963617

深度学习系列

一、Introduction一般来说,在一个典型的基于CNN的目标检测器中,使用主干网络来提取检测对象的基本特征,该网络通常是为图像分类任务而设计的,并在ImageNet上预训练。毫无疑问,更强大的主干网可以带来更好的检测性能。尽管最先进的基于深度的大骨干网络的探测器取得了很好的结果,但仍有很大改进空间。此外,通过设计一个新的更强大的主干网络并在ImageNet上预训练来获取好的检测性能是十分昂贵

- 初始OpenCV

指尖下的技术

OpenCVopencv人工智能计算机视觉

OpenCV是一个功能强大、应用广泛的计算机视觉库,它为开发人员提供了丰富的工具和算法,可以帮助他们快速构建各种视觉应用。随着计算机视觉技术的不断发展,OpenCV也将会继续发挥重要的作用。OpenCV提供了大量的计算机视觉算法和图像处理工具,广泛应用于图像和视频的处理、分析以及机器学习领域。所以学习人计算机视觉或者图像处理方面的知识,OpenCV是一个要重点学习的工具库。首先介绍一下OpenCV

- 如何使用YOLOv8在AI-TOD数据集上进行遥感目标检测,从安装依赖项、准备数据集、配置YOLOv8、训练和评估模型以及构建GUI应用程序展示检测

计算机C9硕士_算法工程师

人工智能YOLO目标检测遥感

如何使用YOLOv8在AI-TOD数据集上进行遥感目标检测,从安装依赖项、准备数据集、配置YOLOv8、训练和评估模型以及构建GUI应用程序展示检测文章目录1.安装依赖2.数据准备3.配置YOLOv83.1加载预训练模型或自定义模型4.训练模型5.评估模型6.构建GUI应用程序(可选)以下文字及代码仅供参考。遥感目标检测,AI-TOD数据集aitod,训练集11214张,测试集集14018,验证集

- Umi-OCR 实践教程:离线、免费、高效的图像文字识别工具

几道之旅

人工智能智能体及数字员工ocr人工智能

一、工具简介Umi-OCR是一款开源、免费且支持离线运行的OCR(光学字符识别)工具,适用于Windows和Linux系统。它基于深度学习技术,能够高效提取图像中的文字,支持多语言识别、批量处理、截屏识别等功能,尤其适合对隐私敏感或网络受限的场景。核心亮点:离线运行:无需联网,保护隐私。多引擎支持:提供Paddle(高性能)和Rapid(低配兼容)两种引擎。批量处理:支持图片、PDF、电子书等多格

- springmvc 下 freemarker页面枚举的遍历输出

杨白白

enumfreemarker

spring mvc freemarker 中遍历枚举

1枚举类型有一个本地方法叫values(),这个方法可以直接返回枚举数组。所以可以利用这个遍历。

enum

public enum BooleanEnum {

TRUE(Boolean.TRUE, "是"), FALSE(Boolean.FALSE, "否");

- 实习简要总结

byalias

工作

来白虹不知不觉中已经一个多月了,因为项目还在需求分析及项目架构阶段,自己在这段

时间都是在学习相关技术知识,现在对这段时间的工作及学习情况做一个总结:

(1)工作技能方面

大体分为两个阶段,Java Web 基础阶段和Java EE阶段

1)Java Web阶段

在这个阶段,自己主要着重学习了 JSP, Servlet, JDBC, MySQL,这些知识的核心点都过

了一遍,也

- Quartz——DateIntervalTrigger触发器

eksliang

quartz

转载请出自出处:http://eksliang.iteye.com/blog/2208559 一.概述

simpleTrigger 内部实现机制是通过计算间隔时间来计算下次的执行时间,这就导致他有不适合调度的定时任务。例如我们想每天的 1:00AM 执行任务,如果使用 SimpleTrigger,间隔时间就是一天。注意这里就会有一个问题,即当有 misfired 的任务并且恢复执行时,该执行时间

- Unix快捷键

18289753290

unixUnix;快捷键;

复制,删除,粘贴:

dd:删除光标所在的行 &nbs

- 获取Android设备屏幕的相关参数

酷的飞上天空

android

包含屏幕的分辨率 以及 屏幕宽度的最大dp 高度最大dp

TextView text = (TextView)findViewById(R.id.text);

DisplayMetrics dm = new DisplayMetrics();

text.append("getResources().ge

- 要做物联网?先保护好你的数据

蓝儿唯美

数据

根据Beecham Research的说法,那些在行业中希望利用物联网的关键领域需要提供更好的安全性。

在Beecham的物联网安全威胁图谱上,展示了那些可能产生内外部攻击并且需要通过快速发展的物联网行业加以解决的关键领域。

Beecham Research的技术主管Jon Howes说:“之所以我们目前还没有看到与物联网相关的严重安全事件,是因为目前还没有在大型客户和企业应用中进行部署,也就

- Java取模(求余)运算

随便小屋

java

整数之间的取模求余运算很好求,但几乎没有遇到过对负数进行取模求余,直接看下面代码:

/**

*

* @author Logic

*

*/

public class Test {

public static void main(String[] args) {

// TODO A

- SQL注入介绍

aijuans

sql注入

二、SQL注入范例

这里我们根据用户登录页面

<form action="" > 用户名:<input type="text" name="username"><br/> 密 码:<input type="password" name="passwor

- 优雅代码风格

aoyouzi

代码

总结了几点关于优雅代码风格的描述:

代码简单:不隐藏设计者的意图,抽象干净利落,控制语句直截了当。

接口清晰:类型接口表现力直白,字面表达含义,API 相互呼应以增强可测试性。

依赖项少:依赖关系越少越好,依赖少证明内聚程度高,低耦合利于自动测试,便于重构。

没有重复:重复代码意味着某些概念或想法没有在代码中良好的体现,及时重构消除重复。

战术分层:代码分层清晰,隔离明确,

- 布尔数组

百合不是茶

java布尔数组

androi中提到了布尔数组;

布尔数组默认的是false, 并且只会打印false或者是true

布尔数组的例子; 根据字符数组创建布尔数组

char[] c = {'p','u','b','l','i','c'};

//根据字符数组的长度创建布尔数组的个数

boolean[] b = new bool

- web.xml之welcome-file-list、error-page

bijian1013

javaweb.xmlservleterror-page

welcome-file-list

1.定义:

<welcome-file-list>

<welcome-file>login.jsp</welcome>

</welcome-file-list>

2.作用:用来指定WEB应用首页名称。

error-page1.定义:

<error-page&g

- richfaces 4 fileUpload组件删除上传的文件

sunjing

clearRichfaces 4fileupload

页面代码

<h:form id="fileForm"> <rich:

- 技术文章备忘

bit1129

技术文章

Zookeeper

http://wenku.baidu.com/view/bab171ffaef8941ea76e05b8.html

http://wenku.baidu.com/link?url=8thAIwFTnPh2KL2b0p1V7XSgmF9ZEFgw4V_MkIpA9j8BX2rDQMPgK5l3wcs9oBTxeekOnm5P3BK8c6K2DWynq9nfUCkRlTt9uV

- org.hibernate.hql.ast.QuerySyntaxException: unexpected token: on near line 1解决方案

白糖_

Hibernate

文章摘自:http://blog.csdn.net/yangwawa19870921/article/details/7553181

在编写HQL时,可能会出现这种代码:

select a.name,b.age from TableA a left join TableB b on a.id=b.id

如果这是HQL,那么这段代码就是错误的,因为HQL不支持

- sqlserver按照字段内容进行排序

bozch

按照内容排序

在做项目的时候,遇到了这样的一个需求:

从数据库中取出的数据集,首先要将某个数据或者多个数据按照地段内容放到前面显示,例如:从学生表中取出姓李的放到数据集的前面;

select * fro

- 编程珠玑-第一章-位图排序

bylijinnan

java编程珠玑

import java.io.BufferedWriter;

import java.io.File;

import java.io.FileWriter;

import java.io.IOException;

import java.io.Writer;

import java.util.Random;

public class BitMapSearch {

- Java关于==和equals

chenbowen00

java

关于==和equals概念其实很简单,一个是比较内存地址是否相同,一个比较的是值内容是否相同。虽然理解上不难,但是有时存在一些理解误区,如下情况:

1、

String a = "aaa";

a=="aaa";

==> true

2、

new String("aaa")==new String("aaa

- [IT与资本]软件行业需对外界投资热情保持警惕

comsci

it

我还是那个看法,软件行业需要增强内生动力,尽量依靠自有资金和营业收入来进行经营,避免在资本市场上经受各种不同类型的风险,为企业自主研发核心技术和产品提供稳定,温和的外部环境...

如果我们在自己尚未掌握核心技术之前,企图依靠上市来筹集资金,然后使劲往某个领域砸钱,然

- oracle 数据块结构

daizj

oracle块数据块块结构行目录

oracle 数据块是数据库存储的最小单位,一般为操作系统块的N倍。其结构为:

块头--〉空行--〉数据,其实际为纵行结构。

块的标准大小由初始化参数DB_BLOCK_SIZE指定。具有标准大小的块称为标准块(Standard Block)。块的大小和标准块的大小不同的块叫非标准块(Nonstandard Block)。同一数据库中,Oracle9i及以上版本支持同一数据库中同时使用标

- github上一些觉得对自己工作有用的项目收集

dengkane

github

github上一些觉得对自己工作有用的项目收集

技能类

markdown语法中文说明

回到顶部

全文检索

elasticsearch

bigdesk elasticsearch管理插件

回到顶部

nosql

mapdb 支持亿级别map, list, 支持事务. 可考虑做为缓存使用

C

- 初二上学期难记单词二

dcj3sjt126com

englishword

dangerous 危险的

panda 熊猫

lion 狮子

elephant 象

monkey 猴子

tiger 老虎

deer 鹿

snake 蛇

rabbit 兔子

duck 鸭

horse 马

forest 森林

fall 跌倒;落下

climb 爬;攀登

finish 完成;结束

cinema 电影院;电影

seafood 海鲜;海产食品

bank 银行

- 8、mysql外键(FOREIGN KEY)的简单使用

dcj3sjt126com

mysql

一、基本概念

1、MySQL中“键”和“索引”的定义相同,所以外键和主键一样也是索引的一种。不同的是MySQL会自动为所有表的主键进行索引,但是外键字段必须由用户进行明确的索引。用于外键关系的字段必须在所有的参照表中进行明确地索引,InnoDB不能自动地创建索引。

2、外键可以是一对一的,一个表的记录只能与另一个表的一条记录连接,或者是一对多的,一个表的记录与另一个表的多条记录连接。

3、如

- java循环标签 Foreach

shuizhaosi888

标签java循环foreach

1. 简单的for循环

public static void main(String[] args) {

for (int i = 1, y = i + 10; i < 5 && y < 12; i++, y = i * 2) {

System.err.println("i=" + i + " y="

- Spring Security(05)——异常信息本地化

234390216

exceptionSpring Security异常信息本地化

异常信息本地化

Spring Security支持将展现给终端用户看的异常信息本地化,这些信息包括认证失败、访问被拒绝等。而对于展现给开发者看的异常信息和日志信息(如配置错误)则是不能够进行本地化的,它们是以英文硬编码在Spring Security的代码中的。在Spring-Security-core-x

- DUBBO架构服务端告警Failed to send message Response

javamingtingzhao

架构DUBBO

废话不多说,警告日志如下,不知道有哪位遇到过,此异常在服务端抛出(服务器启动第一次运行会有这个警告),后续运行没问题,找了好久真心不知道哪里错了。

WARN 2015-07-18 22:31:15,272 com.alibaba.dubbo.remoting.transport.dispatcher.ChannelEventRunnable.run(84)

- JS中Date对象中几个用法

leeqq

JavaScriptDate最后一天

近来工作中遇到这样的两个需求

1. 给个Date对象,找出该时间所在月的第一天和最后一天

2. 给个Date对象,找出该时间所在周的第一天和最后一天

需求1中的找月第一天很简单,我记得api中有setDate方法可以使用

使用setDate方法前,先看看getDate

var date = new Date();

console.log(date);

// Sat J

- MFC中使用ado技术操作数据库

你不认识的休道人

sqlmfc

1.在stdafx.h中导入ado动态链接库

#import"C:\Program Files\Common Files\System\ado\msado15.dll" no_namespace rename("EOF","end")2.在CTestApp文件的InitInstance()函数中domodal之前写::CoIniti

- Android Studio加速

rensanning

android studio

Android Studio慢、吃内存!启动时后会立即通过Gradle来sync & build工程。

(1)设置Android Studio

a) 禁用插件

File -> Settings... Plugins 去掉一些没有用的插件。

比如:Git Integration、GitHub、Google Cloud Testing、Google Cloud

- 各数据库的批量Update操作

tomcat_oracle

javaoraclesqlmysqlsqlite

MyBatis的update元素的用法与insert元素基本相同,因此本篇不打算重复了。本篇仅记录批量update操作的

sql语句,懂得SQL语句,那么MyBatis部分的操作就简单了。 注意:下列批量更新语句都是作为一个事务整体执行,要不全部成功,要不全部回滚。

MSSQL的SQL语句

WITH R AS(

SELECT 'John' as name, 18 as

- html禁止清除input文本输入缓存

xp9802

input

多数浏览器默认会缓存input的值,只有使用ctl+F5强制刷新的才可以清除缓存记录。如果不想让浏览器缓存input的值,有2种方法:

方法一: 在不想使用缓存的input中添加 autocomplete="off"; eg: <input type="text" autocomplete="off" name

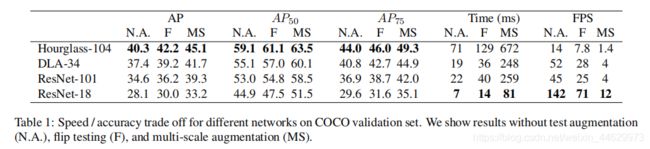

对一个bbox进行说明,对于bbox的center,我们认为是

对一个bbox进行说明,对于bbox的center,我们认为是 这样就找到了真实的图像中的center,然后再图像中使用二阶高斯分布,center为中心点,概率值为1,如果有多个目标在某个点的概率值重叠,选取较大的值作为概率值,对于预测corner,我们得到了经BackBone提取的热力图,这一步我们将heatmap中的峰值像素点找出,具体的方法是判断是否一个点大于或者等于他周围的八个点,就找到了预测center,可以带入高斯公式得到概率值。接下来便是计算损失函数

这样就找到了真实的图像中的center,然后再图像中使用二阶高斯分布,center为中心点,概率值为1,如果有多个目标在某个点的概率值重叠,选取较大的值作为概率值,对于预测corner,我们得到了经BackBone提取的热力图,这一步我们将heatmap中的峰值像素点找出,具体的方法是判断是否一个点大于或者等于他周围的八个点,就找到了预测center,可以带入高斯公式得到概率值。接下来便是计算损失函数

![]() 不为1时,随着

不为1时,随着![]() )的减小,损失也越大。

)的减小,损失也越大。

![]() 是真实的bbox左上、右下点的坐标,为了得到预测的bbox的尺寸,用L1 loss训练Lsize

是真实的bbox左上、右下点的坐标,为了得到预测的bbox的尺寸,用L1 loss训练Lsize

![]() 为预测的尺寸,

为预测的尺寸, Sk为真实尺寸。

Sk为真实尺寸。 (λsize=0.1,λoff=1)

(λsize=0.1,λoff=1) 每个坐标的第一个值是预测到的center,第二个值是offset,第一个值加第二个值就是center,第三个值就是画出了bbox的大小和位置。

每个坐标的第一个值是预测到的center,第二个值是offset,第一个值加第二个值就是center,第三个值就是画出了bbox的大小和位置。