第二章 不确定性推理方法

第二章 不确定性推理方法

- 2.1 不确定性推理的基本概念

-

- 2.1.1 不确定性推理中的基本问题

- 2.1.2 概率方法

- 2.2 可信度方法

-

- 2.2.1 可信度概念

- 2.2.2 C-F模型

- 2.3 证据理论

-

- 2.3.1 概率分配函数

- 2.3.2 信任函数

- 2.3.3 似然函数

- 2.3.4 信任函数与似然函数的关系

- 2.3.5 概率分配函数的正交和

- 练习

2.1 不确定性推理的基本概念

推理:从已知事实(证据)出发,通过运用相关知识逐步推出结论或者证明某个假设成立或不成立的思维过程。

不确定性推理:从不确定性的初始证据出发,通过运用不确定性的知识,最终推出具有一定程度的不确定性但却是合理或者近乎合理的结论的思维过程。

2.1.1 不确定性推理中的基本问题

知识不确定性:如果有现场指纹则可能犯罪事实;如果有威胁则可能犯罪事实。。。

证据不确定性:现场指纹,威胁书信等的真实性。进而进行证据不确定性组合。

结论:各项证据均产生嫌疑人是罪犯的结论,结论不确定性合成。得最终概率。

2.1.2 概率方法

- 经典概率方法

产生式规则:

IF E THEN Hi ,i=1,2,...,n E:前提条件,Hi:结论 P(Hi|E):在证据E出现的条件下,结论Hi成立的确定性程度。

复合条件:

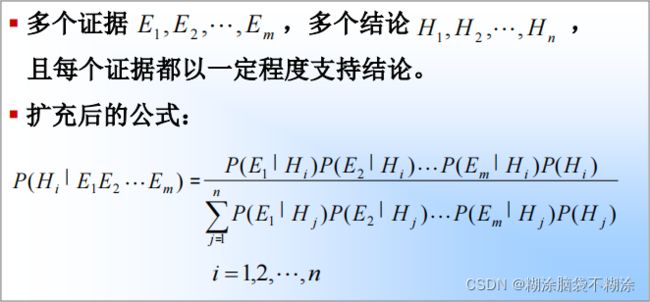

E=Ei AND E2 AND … AND Em P(Hi| E1,E2,…,Em):在证据E1,E2,…,Em出现时结论的确定程度。

- 逆概率方法

逆概率方法的基本思想:

▪ Bayes定理:逆概率 P(E|Hi)–>原概率P(Hi|E)

例如:

E: 咳嗽,Hi:支气管炎,

条件概率 :统计咳嗽的人中有多少是患支气管炎的。

逆概率 :统计患支气管炎的人中有多少人是咳嗽的。

单个证据的情况

▪ 产生式规则:IF E THEN Hi ,i=1,2,…,n

Bayes公式: P ( H i ∣ E ) = P ( E ∣ H i ) P ( H i ) ∑ j = 1 n P ( E ∣ H j ) P ( H j ) i = 1 , 2 , . . . , n P(H_i|E)=\frac{P(E|H_i)P(H_i)}{\sum_{j=1}^{n}{P(E|H_j)P(Hj)} }{\;\;\;\;\;\;\;\;\;\;\;\;i=1,2,...,n} P(Hi∣E)=∑j=1nP(E∣Hj)P(Hj)P(E∣Hi)P(Hi)i=1,2,...,n

例1 H1 , H2 , H3:结论,E:证据

已知:P (H1 ) 0.3, P (H2 )= 0.4, P(H3 ) 0.5,

P(E |H1) = 0.5, P(E |H2 ) = 0.3, P(E |H3 ) = 0.4,

求:P(H1∣E), P(H2∣E), P(H3∣E)。

2.2 可信度方法

2.2.1 可信度概念

可信度:根据经验对一个事物或现象为真的相信程度。

C-F模型:基于可信度表示的不确定性推理的基本方法。

2.2.2 C-F模型

主要包括以下内容:

- 知识不确定性的表示

- 证据不确定性的表示

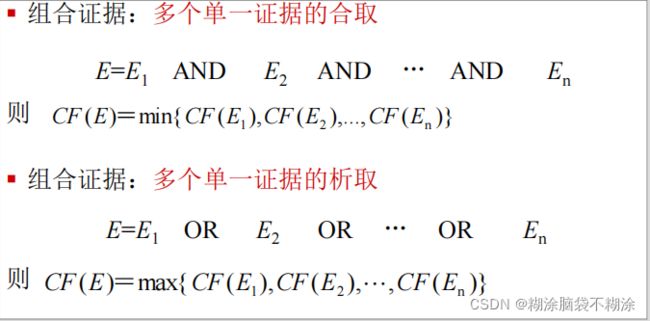

- 组合证据不确定性的算法:多个证据的组合

- 不确定性的传递算法: 如何用证据的不确定性去更新结论的不确定性和 如何在推理中把证据的不确定性传递给最终结论

- 结论不确定性的合成:多个不同知识推出同一结论,且不确定性程度不同

- 知识不确定性的表示

▪ CF(H,E)的取值范围: [-1,1]。

▪ 若由于相应证据的出现增加结论 H 为真的可信度, 则CF(H,E)> 0,证据的出现越是支持 H 为真,就使CF(H,E) 的值越大。

▪ 反之,CF(H,E)< 0,证据的出现越是支持 H 为 假,CF(H,E)的值就越小。

▪ 若证据的出现与否与 H 无关,则 CF(H,E)= 0。

- 证据不确定性的表示

CF(E)=0.6: E的可信度为0.6

▪ 证据E的可信度取值范围:[-1,1] 。

▪ 对于初始证据,若所有观察S能肯定它为真,则CF(E)= 1。

▪ 若肯定它为假,则 CF(E) = –1。

▪ 若以某种程度为真,则 0 < CF(E) < 1。

▪ 若以某种程度为假,则 -1 < CF(E) < 0 。

▪ 若未获得任何相关的观察,则 CF(E) = 0。

▪ 静态强度CF(H,E):知识的强度,即当 E 所对应的证据为真时对 H 的影响程度。

▪ 动态强度 CF(E):证据 E 当前的不确定性程度。

- 组合证据不确定性的算法

2.3 证据理论

用概率分配函数和信任函数度量不确定性,似然函数

处理不知道引起的不确定性,用概率分配函数的正交

和进行证据组合。

2.3.1 概率分配函数

设 D 是变量 x 所有可能取值的集合,且 D 中的元素是

互斥的,在任一时刻 x 都取且只能取 D 中的某一个元素为值,则称 D 为 x 的样本空间。

在证据理论中,D 的任何一个子集 A 都对应于一个关于

x 的命题,称该命题为“ x 的值是在 A 中”。

设 x :所看到的颜色,D={红,黄,蓝},

则 A={红}:“ x 是红色”;

A={红,蓝}:“x 或者是红色,或者是蓝色”。

设D为样本空间,领域内的命题都用D的子集表示, 则 概 率 分 配 函 数 ( basic probability assignment

function)课本上的定义如下:

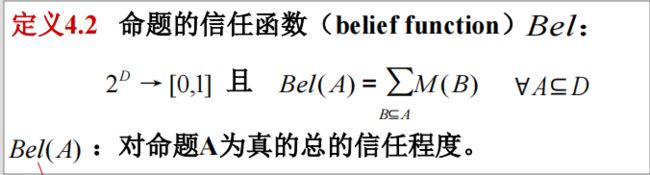

2.3.2 信任函数

2.3.3 似然函数

似然函数(plansibility function):不可驳斥函数或上限函数。

2.3.4 信任函数与似然函数的关系

2.3.5 概率分配函数的正交和

书上的定义:

如果k≠0 ,则正交和 M也是一个概率分配函数;

如果k=0 ,则不存在正交和 M,即没有可能存在概

率函数,称 与 矛盾。

练习

- 设有如下一组知识:

r1:IF E1 THEN H (0.9)

r2:IF E2 THEN H (0.6)

r3:IF E3 THEN H (-0.5)

r4:IF E4 AND ( E5 OR E6) THEN E1 (0.8)

已 知 : CF(E2)=0.8 , CF(E3)=0.6 , CF(E4)=0.5 ,

CF(E5)=0.6, CF(E6)=0.8 ,求:CF(H)=?

解:由r4得到:CF(E1)=0.8×max{0, CF(E4 AND (E5 OR E6))} = 0.8×max{0,min{CF(E4), CF(E5 OR E6)}} =0.8×max{0,min{CF(E4),max{CF(E5),CF(E6)}}}=0.8×max{0,min{CF(E4),max{0.6,0.8}}} =0.8×max{0,min{0.5, 0.8}} =0.8×max{0, 0.5} = 0.4

由r1得到CF1(H)=CF(H,E1)×max{0,CF(E1)}=0.9×max{0, 0.4} = 0.36

由r2得到:CF2(H)=CF(H,E2)×max{0,CF(E2)} =0.6×max{0, 0.8} = 0.48

由 r3 得 到 : CF3(H)=CF(H, E3)×max{0, CF(E3)} =- 0.5×max{0, 0.6} = -0.3

根据结论不精确性合成算法,CF1(H)和CF2(H)同号,有:…

CF12(H)和CF3(H)异号,有:…即综合可信度为CF(H)=0.53

- 设有规则:

(1)如果 流鼻涕 则 感冒但非过敏性鼻炎(0.9)或 过敏性鼻炎但非感冒(0.1)。

(2)如果 眼发炎 则 感冒但非过敏性鼻炎(0.8)或 过敏性鼻炎但非感冒(0.05)。

有事实:(1)小王流鼻涕(0.9)。M1

(2)小王发眼炎(0.4)。M2

问:小王患的什么病?

解:

取样本空间:D = {h1 ,h2 ,h3}

h1表示“感冒但非过敏性鼻炎”,

h2表示“过敏性鼻炎但非感冒”,

h3表示“同时得了两种病”。

取下面的基本概率分配函数:

M1({h1}) = 0.90.9 = 0.81

M1({h2}) = 0.9 0.1 = 0.09

M1({h1 ,h2 ,h3}) = 1− M1({h1}) − M1({h2}) = 1− 0.81− 0.09 = 0.1

M2({h1}) = 0.40.8 = 0.32

M2({h2}) = 0.4 0.05 = 0.02

M2({h1 ,h2 ,h3}) = 1− M2({h1}) − M2({h2}) = 1− 0.32 − 0.02 = 0.66

将两个概率分配函数组合:

K = 1/{1−[M1({h1})M2({h2}) + M1({h2})M 2({h1})]}

= 1/{1−[0.81* 0.02 + 0.0 9* 0.32]}

= 1/{1− 0.045} = 1/ 0.955

= 1.05

M ({h1}) = K[M1({h1})M2({h1}) + M1({h1})M2({h1 ,h2 ,h3} + M1({h1 ,h2 ,h3})M2({h1})]

= 1.0 5* 0.8258

= 0.8 7

M ({h2}) = K[M1({h2})M2({h2}) + M1({h2})M2({h1 ,h2 ,h3}+ M1({h1 ,h2 ,h3})M2({h2})]

= 1.05* 0.0632

= 0.066

M({h1,h2 ,h3}) =1− M ({h1}) − M ({h2})

=1− 0.87 − 0.066

= 0.064

信任函数:

Bel({h1}) = M ({h1}) = 0.87

Bel({h2}) = M ({h2}) = 0.066

似然函数:

Pl({h1}) =1− Bel(┐{h1}) =1− Bel({h2 ,h3})=1−[M ({h2}+ M ({h3}) =1−[0.066+ 0] = 0.934

Pl({h2}) =1− Bel(┐{h2}) =1− Bel({h1,h3})=1−[M ({h1}+ M ({h3}) =1−[0.87+ 0] = 0.13

结论:小王可能是感冒了。