【笔记】HDR 成像技术学习(二)

从技术上来说,单帧HDR要比多帧HDR简单不少,在早期设备处理能力不足的时候,速度快,没拖影,性能要求低的单帧HDR反而要更有优势。到了HDR+时代,单帧HDR渐渐不敌多帧合成HDR。技术的迭代就是这么残酷。这些技术曾经短暂地在部分手机上应用过,但是很快因为效果不佳也退出了市场。

数次尝试结果都很一般,硬件 HDR 的出路在何方呢?针对这一问题,主流厂商也给出了自己的答案。

一、行交织 HDR

多帧异曝光的问题主要出现在应对运动物体无力,容易被手抖影响,而多帧同曝光的画质虽然上限很高,但代价也很大,有没有一种比较折衷的办法,既能较好地应对运动物体,又能较好地节约宝贵的计算资源和电力呢?

答案就是行交织 HDR。

要想理解行交织 HDR,我们要先了解 CMOS 的工作原理,现代手机里应用的都是滚动快门(Rolling Shutter),也就是说它的读取不是所有像素同时读出,而是从上到下一行一行读取。

在传统的多帧 HDR 里,每一帧都需要在上一帧完成读取后才能进行。CMOS 会先进行一次长曝光,然后从上到下完整读取出整个画面的数据,然后再开始中曝光,从上到下读一遍,最后以同样的方式完成短曝光。换言之两帧之间的时间间隔是曝光时间 + 传感器完整完成读取一帧的时间,在第一行像素被读出后,它需要等待其它行的像素被读取完才能开始中曝光。

如果我们能让 CMOS 的每一行像素完成读取后,立即开始下一次曝光,就可以省下等待其它像素完成读取的时间。我们让 CMOS 完成长曝光后,读取完第一行的同时,第一行像素几乎立即开始中曝光,而无需等待其它行的像素读取完成,而在这个时候,其它行也在进行着读取 - 下一次曝光的工作,每一行不同的曝光和读取交替进行,就像纺织里互相穿插的纱线一样,我们就把它称作行交织技术。两帧之间的读取间隔被缩短,物体运动带来的伪像得以显著改善。

以两曝光为例,sensor每行会以长短曝光两次先后输出,从readout角度来看,就是长曝光帧line与短曝光帧 line interleaving 依次输出:

当然,各个厂商提出的方案 有一些不同,Sony的称为DOL-HDR(Digital overlap),OV的称为staggered HDR,下面分别介绍。

1、DOL-HDR

索尼支持‘准同时’输出多帧不同曝光时间的图像。ISP收到多帧图像后可以做图像融合,生成HDR图像。

Sony在推出DOL的时候,宣传DOL是‘准同时’输出长短曝光。既然是‘准同时’,那就还不是同时,所以也会有一些典型时域多帧HDR的图像质量问题,同时DOL也有一些特有的IQ(image quality)问题——HDR Transition Artefacts。

从DOL hdr的noise profile可以看出来,如下图,在HDR拼接处,可以看到SNR的显著变化,叫做snr drop,当SNR drop大的时候,就会出现明显的edge,如上图所示。

曝光比越小,SNR drop就越小, 可以想见,如果曝光比为1,也就没有snr drop了。反之,曝光比越大,动态范围越大,snr drop也越大。

2、staggered HDR

与Sony不同的是最多支持4:1曝光输出,即long,medium,short,veryshort。而OV最多支持3:1输出,即long,medium,short。

所以如果相同的exposure ratio的话,合成后的HDR图像sony可以达到更大的动态范围。

合成的方法都是一样的,把先输出的曝光行存入line buffer,然后做frame stitch,形成HDR输出。

OV 支持4种输出方式:

支持输出3帧12bit :L+M+S

把Long 和 Medium 曝光的图像在sensor上完成stitch,成为16bit融合后的linear图像,再加上原始的short曝光图像(12bit)。

把long曝光和medium曝光融合后companded成12bit的图像,再加上原始的short曝光图像(12bit)。

两帧12bit原始图像,可以是long + short, 或是medium + short。

相比Sony 的DOL-HDR, OV的输出方式比较灵活配置以适应传输带宽的限制。

小结:采用行交织HDR方式时,每帧的间隔从时域HDR的曝光时间+读出时间减少为仅曝光时间。但由于相邻两行的时间间隔由先前仅读取一次短曝光变为读取一次短曝光和几次长曝光,因此行交织HDR的读出时间会翻倍(倍数取决于每行进行了几次曝光),果冻效应会加剧。

在白天,也就是短曝光时间很短时,可以看到每帧的曝光间隔几乎可以忽略不记,但仍然不能算是同步的,物体也会位移,并且光线不足时效果也会不尽如人意。

综合来讲,行交织HDR是目前普通消费领域最好的HDR合成方式之一。

二、Dual Gain

随着图像传感器的像素数越来越高, 单像素尺寸变得越来越小,现在的亿像素sensor pixel pitch已经到了0.8um。Pixel size变小所带来的full well capacity 与SNR 性能的变差,也很大地影响了sensor的动态范围,所以手机sensor厂需要采用新的技术手段解决改善这个问题。

我们都知道CMOS图像传感器本质上是光电转换和模数转换两部分连接的一个器件。如果这两步转换都工作在一个确定倍数增益的状态下,输入多少光子与输出多少亮度之间应该是一一对应的。但是实际上有摄影知识的人都知道并不是这样,ISO在数码相机当中都是可以设置的,也就意味着“可变增益”——固定的光子数量下,输出的亮度可以不一致。当然了,这个不一致并不是完全没有代价的。

一个典型的CMOS感光元件(内置ADC),其输出图像的过程可以概括为以下几步:

1. 光电二极管吸收能量并被激发,产生电子。

2. 电子进入电荷阱。

3. 断开光电管连接,电荷阱(本质上是电容)两端会有一个电压。

4. 这个电压信号太弱,需要一次模拟放大,一般使用程控电压放大器(PGA)。

5. 放大后的信号进入模数转换。

很明显在传统的CMOS技术当中,可以改变增益值(输出亮度和输入亮度比值)的步骤是4和5——或者这么说,改变4的增益倍数就相当于你在机身上设置ISO(模拟增益),改变5的增益倍数(数字增益)就是等效于使用扩展ISO或者后期在ACR里拉亮度。

其次,在传感器技术当中经常提到一个性能参数叫满阱容量(Full-Well Capacity,FWC),在数字图像当中也会使用一个概念叫白点(White Level)。实际上对于一部相机和它输出的图像而言这两个值应该是一一对应的——满阱就意味着过曝,过曝输出的图像就是纯白。所以阱容(3当中这个电容的容量)也是会影响ISO的。

因此,我们可以根据通过调整Gain来获得不同曝光值(不同ISO下)的图片,从而完成HDR。改变增益的位置不同,涉及的技术也不同,现在流行的主要是:双原生ISO技术(Dual Gain Amplifier) 和 双转换增益技术(Dual Conversion Gain,DCG)。下面分别进行介绍。

1、Dual Gain Amplifier

Dual Gain Amplifier技术其实是在电路中提供了两条电路,连接增益大小不同的PGA。事实上,更准确地讲,该技术应称为双电路增益。 由于改变模拟增益相当于调整了ISO,因此,也被称为双原生ISO技术。

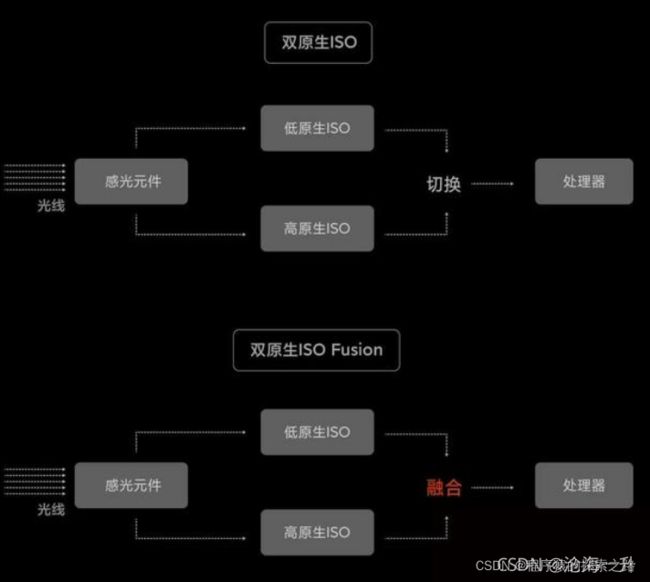

值得一提的是,在小米10至尊纪念版相机主摄里,小米和豪威提出了"双原生ISO Fusion技术",与双原生ISO技术比较如下:

具体技术原理有待查询资料。

2、Dual Conversion Gain

我们通过调整阱容来获得不同增益的曝光值时,采用的就是双转换增益技术:像素有两个不同的FWC。在小FWC时,本底噪声小,对应较高的增益;在大FWC时,本底噪声大,对应较低的增益。这样减小了噪声的占比,即提高了信噪比。

由于需要改变阱容,实际上这一技术的实现在于特殊地像素结构:

使用的方案,在FD节点和CFD电荷阱之间增加了一个Dual Gain Switch。在High conversion gain 的模式下,DCG保持断开,这样FD电容等于小电容FD,所以conversion gain大。当工作low conversion gain模式下,DCG保持连接,FD电容等于大电容,相应的CG就小。

三、Dual Gain+行交织 HDR

OV在前面的基础上,在小米10 至尊纪念版采用的主摄 OV48C上实现了现了支持同时读出的dual gain,能同时读出一个更亮的和一个更暗的图片。基于此,利用这一技术搭配行交织 HDR,得到了一种更强的实现:

在第一帧里,我们使用同样的曝光时间,同时读出高增益(High Conversion Gain,HCG)和低增益(Low Conversion Gain,LCG)两帧画面,实现长曝光和中曝光的效果,然后再补充一个短曝光即可,如果光比不是太大,放弃短曝光换取更短的迟滞也是可以的。

这种增强版行交织 HDR 长曝光与中曝光之间完全没有时间差,可以进一步改善对运动物体的拍摄效果。