机器学习之学习曲线绘制Python-skleran

学习曲线作用:

学习曲线是什么?简单来说,就是用学习曲线(learning curve)来判断模型状态:过拟合还是欠拟合。

学习曲线定义:

学习曲线是根据不同训练集大小,模型在训练集和验证集上的得分变化曲线。

学习曲线通俗解释:

也就是以样本数为横坐标,训练和交叉验证集上的得分(如准确率)为纵坐标。learning curve可以帮助我们判断模型现在所处的状态:过拟合(overfiting / high variance) or 欠拟合。

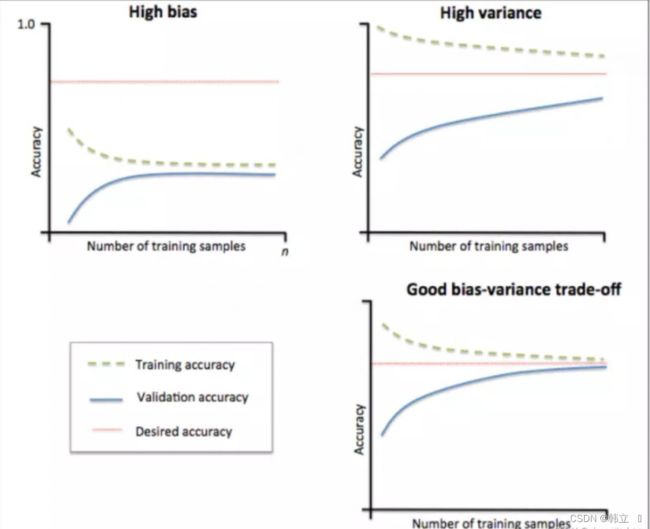

模型欠拟合、过拟合、 时对应的学习曲线如下图所示:

对上图的解释:

(1)左上角的图中训练集和验证集上的曲线能够收敛。在训练集合验证集上准确率相差不大,却都很差。这说明模拟对已知数据和未知都不能进行准确的预测,属于高偏差(欠拟合)。这种情况模型很可能是欠拟合。可以针对欠拟合采取对应的措施。

欠拟合措施:我们可以增加模型参数(特征),比如,构建更多的特征,减小正则项。采用更复杂的模型。此时通过增加数据量是不起作用的。(为什么?)

(2)右上角的图中模型在训练集上和验证集上的准确率差距很大。说明模型能够很好的拟合已知数据,但是泛化能力很差,属于高方差(过拟合)。模拟很可能过拟合,要采取过拟合对应的措施。

过拟合措施:我们可以增大训练集,降低模型复杂度,增大正则项,或者通过特征选择减少特征数,即做一下feature selection,挑出较好的feature的subset来做training

(3)理想情况是找到偏差和方差都很小的情况,即收敛且误差较小。如右角的图(完美)

Python代码(sklearn库):

train_sizes, train_scores, test_scores = learning_curve(estimator, X, y, cv=cv, n_jobs=n_jobs, train_sizes=[0.1,0.25,0.5,0.75,1])

print(train_sizes)

print(train_scores)

print(test_scores)

train_scores_mean = np.mean(train_scores, axis=1)

train_scores_std = np.std(train_scores, axis=1)

test_scores_mean = np.mean(test_scores, axis=1)

test_scores_std = np.std(test_scores, axis=1)[ 143 359 718 1077 1437]

[[0.93006993 0.94405594 0.95104895 0.87412587 0.95804196]

[0.8718663 0.90529248 0.91643454 0.88022284 0.90807799]

[0.8718663 0.86908078 0.90807799 0.88857939 0.8816156 ]

[0.86258124 0.88857939 0.89415042 0.87093779 0.87743733]

[0.8559499 0.86986778 0.87543493 0.86499652 0.85247042]]

[[0.79722222 0.73611111 0.68888889 0.76388889 0.74444444]

[0.81944444 0.86111111 0.83611111 0.83055556 0.825 ]

[0.82777778 0.86666667 0.84722222 0.85555556 0.85 ]

[0.83611111 0.89444444 0.85277778 0.85277778 0.84444444]

[0.825 0.89444444 0.85 0.86111111 0.86944444]]learning_curve函数中参数解释:

estimator表示我们所使用的的估计器 X输入的feature y : 输入的target CV: 做训练集切割成训练集和验证集的时候的折数,cv=5就是5折交叉验证。 train_sizes: 随着训练集的增大,选择在10%,25%,50%,75%,100%的训练集大小上进行采样。比如(CV= 5)10%的意思是先在训练集上选取10%的数据进行五折交叉验证。返回值解释:

train_sizes:为列表。对应10%,25%,50%,75%,100%的数据量。比如训练集为100,则10%的返回量为10. train_scores:如上为numpy数组,第一行五个数据为抽取原始训练集10%的数据做的五折交叉验证的训练集指标。,第二行五个数据为抽取原始训练集25%的数据做的五折交叉验证的训练集指标。等等。 test_scores:如上为numpy数组,第一行五个数据为抽取原始训练集10%的数据做的五折交叉验证的验证集指标。,第二行五个数据为抽取原始训练集25%的数据做的五折交叉验证的验证集指标。等等。

完整代码如下:

import numpy as np

import matplotlib.pyplot as plt

from sklearn.model_selection import learning_curve

from sklearn.model_selection import ShuffleSplit

from sklearn.naive_bayes import GaussianNB

from sklearn.datasets import load_digits

def plot_learning_curve(estimator, title, X, y, ylim=None, cv=None, n_jobs=None):

'''

绘制出模型的学习曲线

'''

plt.title(title)

if ylim is not None:

plt.ylim(*ylim)

train_sizes, train_scores, test_scores = learning_curve(estimator, X, y, cv=cv, n_jobs=n_jobs, train_sizes=[0.1,0.25,0.5,0.75,1])

train_scores_mean = np.mean(train_scores, axis=1)

train_scores_std = np.std(train_scores, axis=1)

test_scores_mean = np.mean(test_scores, axis=1)

test_scores_std = np.std(test_scores, axis=1)

plt.fill_between(train_sizes, train_scores_mean - train_scores_std, train_scores_mean + train_scores_std, alpha=0.1,

color="r", ) # 把模型准确性的平均值的上下标准差的空间里用颜色填充

plt.fill_between(train_sizes, test_scores_mean - test_scores_std, test_scores_mean + test_scores_std, alpha=0.1,

color="g", ) # 把模型准确性的平均值的上下标准差的空间里用颜色填充

plt.plot(train_sizes, train_scores_mean, "o-", color="r", label="Training score")

plt.plot(train_sizes, test_scores_mean, "o-", color="g", label="Cross-validation score")

plt.legend(loc="best")

return plt

# 加载数据集

X, y = load_digits(return_X_y=True)

cv1 = ShuffleSplit(n_splits=5, test_size=0.2, random_state=0) # 数据集分成5份,每份中测试集比例为0.2

estimator1 = GaussianNB()

title1 = "(Naive Bayes)"

plt.subplot(121)

plot_learning_curve(estimator1, title1, X, y, ylim=(0.7, 1.01), cv=cv1, n_jobs=4)

plt.show()

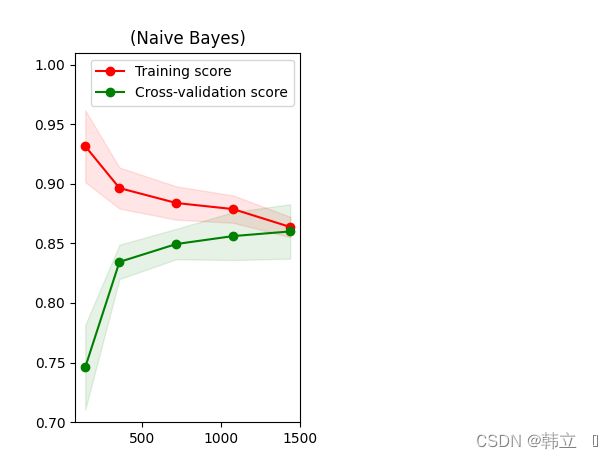

由图可得:随着样本数抽取增加模型有着过拟合向刚刚好过渡