67——Stepwise Feature Fusion: Local Guides Global

[1] Wang J , Huang Q , Tang F , et al. Stepwise Feature Fusion: Local Guides Global[J]. MICCI, 2022.

由于结肠息肉大小不一,形态特征复杂,息肉与黏膜边界不清,准确分割息肉仍具有一定的挑战性。该模型针对可能无法处理未见的结肠镜检查数据。为了解决这个问题,提出了一种新的最先进的医学图像分割模型,SSFormer,它使用金字塔变压器编码器来提高模型的泛化能力。

具体地说,我们提出的渐进局部解码器可以适应金字塔变压器骨干,强调局部特征和限制注意分散。

由于CNN模型采用自顶向下建模的方法,加之息肉的形态变化多端,而息肉图像结构相对简单,这类模型缺乏泛化能力,难以进行不可见的处理。Transforemer具有比CNN和Multilayer Perceptron-like结构[13]更强的泛化能力。

为了实现高泛化和精确的息肉自动分割,提出了一种新型的最先进(SOTA)医学图像分割模型SSFormer,该模型使用金字塔变压器编码器,具有良好的泛化和多尺度特征处理能力。在我们的模型中,基于多级特征聚合结构的渐进局部解码器(PLD)作为解码器。多阶段特征聚合结构可以使不同深度和表达能力的特征相互引导,我们认为可以解决注意力分散和局部特征低估的问题,提高细节处理能力。

创新点:1)在息肉分割任务中引入了金字塔变压器结构,提高了神经网络的泛化能力;2)提出了一种适用于变压器特征金字塔的新的PLD译码器,该译码器可以平滑和有效地强调变压器中的局部特征,提高神经网络对细节信息的处理能力;3)我们提出的SSFormer改进了ETIS基准、CVC-ClinicDB基准和Kvasir的SOTA性能。提高了一些指标。

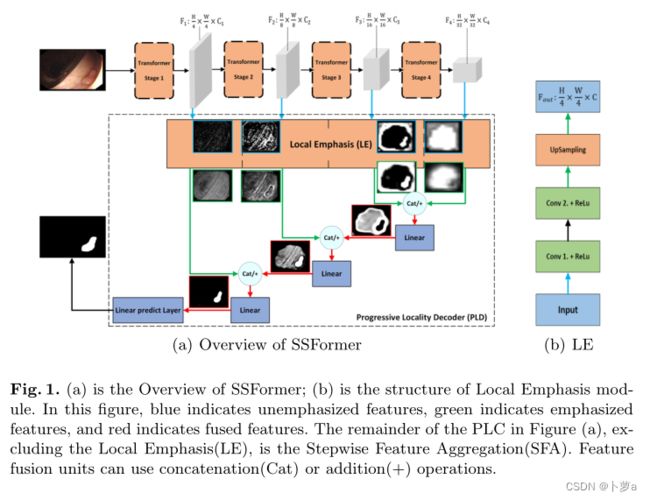

(a)是SSFormer概述;(b)是本地强调模块的结构。在该图中,蓝色表示未强调的特征,绿色表示强调的特征,红色表示融合的特征。图(a)中PLC的其余部分(不包括本地强调(LE))是逐步特性聚合(SFA)。特征融合单元可以使用拼接(Cat)或相加(+)操作。progressive locality decoder PLD渐进局部解码器

为了使我们的模型有足够的泛化能力和多尺度特征处理能力来进行polyp分割,我们使用基于金字塔结构的Transformer而不是CNN作为编码器。为此,我们采用PVTv2[9]和Segformer的编码器设计来构造编码器。它们都使用卷积运算来取代传统Transformer的PE运算,具有空间信息的一致性、优良的性能和稳定性。

逐步聚合局部和全局特性(PLD)

图1(a)显示PLD由本地强调(LE)模块和逐步特征聚合(SFA)模块组成。实验部分比较了PLD与其他现有的解码器与各种编码器,可以生成特征金字塔。比较了几种典型的变压器多级特征聚合解码器在最终预测前的注意分布。如图2(a)所示,PLD融合多段特征后,预测头可以准确聚焦关键目标。此外,我们的PLD可用于其他金字塔变压器编码器,可以提高模型的精度。

Local Emphasis当地的重点

在Transformer中,图像中的每个patch都会混合所有其他patch的信息,即使它们的相关性不高。经过大量的自我注意操作后,特征流会收敛,进一步加剧注意分散[16]。我们设计LE模块来重新对焦注意并强调关键的局部特征。在图1(b)中,该模块由卷积算子、激活函数和双线性上采样层组成。我们利用卷积算子固定的接受域混合每个patch的相邻patch的特征,从而增加相邻patch与中心patch的关联权值,从而强调每个patch的局部特征。

由于来自不同深度的特征流的特征类型不同,我们在特征金字塔中不为不同层次的特征流共享卷积权值。从图1(a)的特征图可以看出,LE可以有效地清除杂乱的噪声,强调关键的局部特征。在图2(b)中,特征流经过LE后,无序的注意力与轮廓、边界等关键细节一起被重新凝聚。

逐步聚合特性Stepwise Feature Aggregation (SFA)

Transformer中剩余连接相互作用的信息量比CNN模型更显著。这种现象可以理解为Transformer中不同深度的特征之间的相关性较弱,不同深度的层之间需要大量的信息交互才能相互引导。因此,我们认为,深度差异较大的不同阶段特征在Transformer中直接并行聚集可能会产生信息缺口。

SFA从上到下逐级融合特征金字塔中不同层次的特征。从特征流的变化来看,可以认为浅层的局部特征逐渐融合为较深层的全局特征。这种特征融合方法可以使融合后的高维特征与低维特征之间的信息差距更小。如图2(c)所示,局部特征逐渐引导模型关注SFA中的关键区域。在图1(a)中,SFA由特征融合单元、线性融合层和线性预测层组成。从图1(a)(红色边框图像)中融合结构的特征图可以看出,SFA有效地将局部特征融合到高维特征中,并引导特征流进入关键区域。

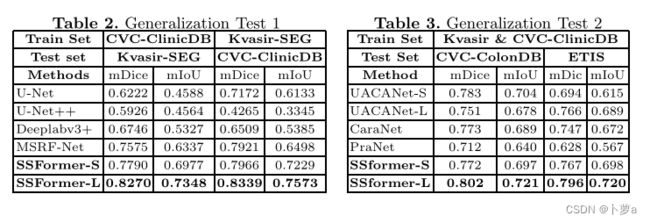

分别在Kavsir-SEG[19]和CVCClinicDB[22]基准数据集上对SSFormer进行测试。

从Kavsir和CVC-ClinicDB基准数据集中随机抽取1450张图像构建训练集(为了公平评估,我们使用与UACANet和PraNet相同的训练集),然后在CVC-ColonDB[21]和ETIS[20]基准数据集上测试该训练集训练的模型。这个检验可以证明我们的模型在不可见数据集上具有准确的预测和泛化能力。