【笔记】keras & tensorflow 中的Dense参数

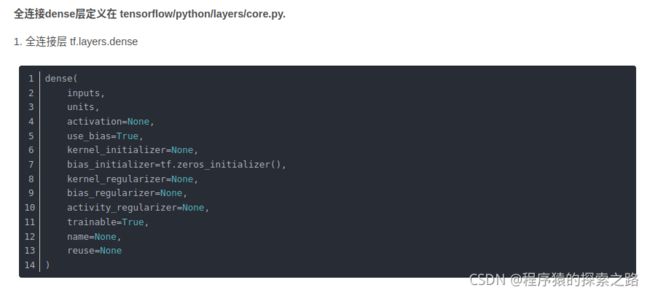

keras:

tensorflow:

dense1 = tf.layers.dense(inputs=pool3, units=1024, activation=tf.nn.relu,kernel_regularizer=tf.contrib.layers.l2_regularizer(0.003))

附文keras:

Dense的参数:

keras.layers.Dense(units, activation=None, use_bias=True, kernel_initializer='glorot_uniform', bias_initializer='zeros', kernel_regularizer=None, bias_regularizer=None, activity_regularizer=None, kernel_constraint=None, bias_constraint=None)

Dense layer 就是常提到和用到的全连接层 。Dense 实现的操作为:output = activation(dot(input, kernel) + bias) 其中 activation 是按逐个元素计算的激活函数,kernel 是由网络层创建的权值矩阵,以及 bias 是其创建的偏置向量 (只在 use_bias=True 时才有用)。

注意: 如果该层的输入的秩大于2,那么它首先被展平然后 再计算与 kernel 的点乘。

查看参数

units: 正整数,输出空间维度。

activation: 激活函数 (详见 activations)。 若不指定,则不使用激活函数 (即,「线性」激活: a(x) = x)。

use_bias: 布尔值,该层是否使用偏置向量。

kernel_initializer: kernel 权值矩阵的初始化器 (详见 initializers)。

bias_initializer: 偏置向量的初始化器 (see initializers).

kernel_regularizer: 运用到 kernel 权值矩阵的正则化函数 (详见 regularizer)。

bias_regularizer: 运用到偏置向的的正则化函数 (详见 regularizer)。

activity_regularizer: 运用到层的输出的正则化函数 (它的 "activation")。 (详见 regularizer)。

kernel_constraint: 运用到 kernel 权值矩阵的约束函数 (详见 constraints)。

bias_constraint: 运用到偏置向量的约束函数 (详见 constraints)。输入尺寸

nD 张量,尺寸: (batch_size, …, input_dim)。 最常见的情况是一个尺寸为 (batch_size, input_dim) 的 2D 输入。

输出尺寸

nD 张量,尺寸: (batch_size, …, units)。 例如,对于尺寸为 (batch_size, input_dim) 的 2D 输入, 输出的尺寸为 (batch_size, units)。

示例:

# 作为 Sequential 模型的第一层,需要指定输入维度。可以为 input_shape=(16,) 或者 input_dim=16,这两者是等价的。

model = Sequential()

model.add(Dense(32, input_shape=(16,)))

# 现在模型就会以尺寸为 (*, 16) 的数组作为输入,

# 其输出数组的尺寸为 (*, 32)

# 在第一层之后,就不再需要指定输入的尺寸了:

model.add(Dense(32))

用法完整示例

示例一: 最小网络

仅有一个参数

import keras

from keras.layers import Dense

model = keras.models.Sequential()

model.add(Dense(1, use_bias=False, input_shape=(1,), name='Dense_ly')) # 仅有的1个权重在这里

model.compile(loss='mse', optimizer='adam')

# end

model.summary() # 简单查看网络结构

# 画图查看网络结构

from IPython.display import SVG

from keras.utils.vis_utils import model_to_dot

display(SVG(model_to_dot(model,show_shapes=True).create(prog='dot', format='svg')))

# 创建数据begin

import numpy as np

data_input = np.random.normal(size=1000000).reshape(-1,1) # 训练数据

data_label = -(data_input) # 数据标签

# end

print('模型随机权重分配为:%s\n' % (model.layers[0].get_weights())) # 检查随机初始化的权重大小

model.fit(data_input, data_label) # 对创建的数据用创建的网络进行训练

print('模型进行预测:%s\n' % (model.predict(np.array([2.5])))) # 利用训练好的模型进行预测

print('训练完成后权重分配为:%s\n' % (model.layers[0].get_weights())) # 再次查看训练好的模型中的权重值

示例一运行结果

示例二:多维度数据

多维数据训练,此处为2个变量

import keras

from keras.layers import Dense

model = keras.models.Sequential()

model.add(Dense(1, use_bias=False, input_shape=(2,), name='Dense_ly')) # 仅有的1个权重在这里

model.compile(loss='mse', optimizer='adam')

# end

model.summary() # 简单查看网络结构

# 画图查看网络结构

from IPython.display import SVG

from keras.utils.vis_utils import model_to_dot

display(SVG(model_to_dot(model,show_shapes=True).create(prog='dot', format='svg')))

# 创建数据begin

import numpy as np

data_input = np.random.normal(size=1000000).reshape(-1,2) # 训练数据

data_label = -(data_input[:,1]) # 数据标签。 PS:注意,这里变了。这里预测的标签仅仅是后一个维度的数据哦!

# end

print('模型随机权重分配为:%s\n' % (model.layers[0].get_weights())) # 检查随机初始化的权重大小

model.fit(data_input, data_label) # 对创建的数据用创建的网络进行训练

print('模型进行预测:%s\n' % (model.predict(np.array([[2.5, 13.5]])))) # 利用训练好的模型进行预测。 PS:注意,这里变了

print('训练完成后权重分配为:%s\n' % (model.layers[0].get_weights())) # 再次查看训练好的模型中的权重值示例二

示例三:特殊情况,待讨论

这个参数是一个二位矩阵,先留待查看研习

import keras

from keras.layers import Dense

model = keras.models.Sequential()

model.add(Dense(2, use_bias=False, input_shape=(2,), name='Dense_ly')) # 仅有的1个权重在这里

model.compile(loss='mse', optimizer='adam')

# end

model.summary() # 简单查看网络结构

# 画图查看网络结构

from IPython.display import SVG

from keras.utils.vis_utils import model_to_dot

display(SVG(model_to_dot(model,show_shapes=True).create(prog='dot', format='svg')))

# 创建数据begin

import numpy as np

data_input = np.random.normal(size=1000000).reshape(-1,2) # 训练数据

data_label = -(data_input) # 数据标签。 PS:注意,这里变了

# end

print('模型随机权重分配为:%s\n' % (model.layers[0].get_weights())) # 检查随机初始化的权重大小

model.fit(data_input, data_label) # 对创建的数据用创建的网络进行训练

print('模型进行预测:%s\n' % (model.predict(np.array([[2.5, 13.5]])))) # 利用训练好的模型进行预测。 PS:注意,这里变了

print('训练完成后权重分配为:%s\n' % (model.layers[0].get_weights())) # 再次查看训练好的模型中的权重值