【论文阅读】Conversational Memory Networkfor Emotion Recognition in Dyadic Dialogue Videos

论文题目:Conversational Memory Network for Emotion Recognition in Dyadic Dialogue Videos

论文链接:https://aclanthology.org/N18-1193/

论文代码:conv-emotion/CMN at master · declare-lab/conv-emotion · GitHub

前言

自从Web 2.0出现以来,对话视频已经通过电影、网络研讨会和视频聊天等平台在互联网上扩散开来。来自这些资源的情感检测可以惠及众多领域,如咨询,公共意见挖掘,财务预测,以及智能系统,如智能家庭和聊天机器人等。

但之前的工作忽略了两个影响对话情绪的两个主要因素

1、说话人的自我影响,即情绪惯性,也就是说一个人这句话的情绪会被前几句话所影响;

2、第二个是说话者之间的情绪影响。即另一个人在说话者的情感状态中扮演影响者的角色。相反,说话者也倾向于反映对方的情绪。

下面这个例子验证了上述两个因素。A(妻子)离开B(丈夫)去做一项工作。最初,A和B都被自己的情感惯性所驱动,表现为伤心。最后,可以看到情绪的影响,虽然B很伤心,但对A的愤怒声明反应为愤怒。

上下文无关系统只是根据对话中的当前话语来识别情绪,而目前最先进的基于上下文的模型,也没有对上下文进行长期总结,这样会导致模型偏差。

基于上诉问题的影响,作者提出来了一个对话记忆网络(CMN),CMN能够充分利用对话历史的上下文信息,该框架采用多模态方法,包括音频、视觉和文本特征,以及有门控的循环单元,将每个说话者过去的话语模型化为记忆。然后,这些记忆通过基于注意力的跳跃来合并,以捕获说话人之间的依赖关系。

Methods

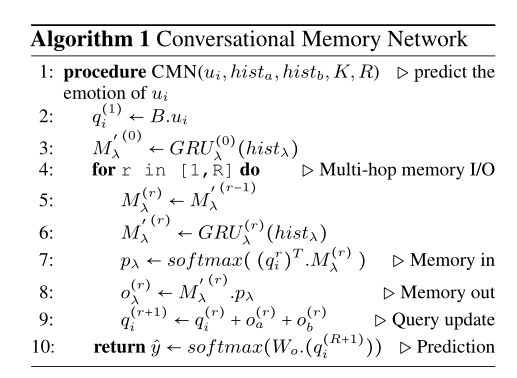

CMN首先为视频中的所有话语提取多模态特征(音频、视觉和文本)。为了检测特定话语的情感,比如![]() ,它通过在上下文窗口中收集以前的话语来收集它的历史。为两位讲话者创建了不同的历史。然后,这些历史记录被建模成使用门控循环单元(gru)的记忆细胞。

,它通过在上下文窗口中收集以前的话语来收集它的历史。为两位讲话者创建了不同的历史。然后,这些历史记录被建模成使用门控循环单元(gru)的记忆细胞。

然后,CMN读取说话人的记忆,并对其使用注意机制,以找到最有用的历史话语分类![]() 。然后,这些记忆通过注意力分数加权的加法操作与

。然后,这些记忆通过注意力分数加权的加法操作与![]() 合并。这是为了模拟说话者之间的影响和动态。整个循环重复了多个跳跃,最后,这个合并的表达被用来对其情感类别进行分类。

合并。这是为了模拟说话者之间的影响和动态。整个循环重复了多个跳跃,最后,这个合并的表达被用来对其情感类别进行分类。

下面详细地介绍一下CMN模型

多模态特征提取融合

文本特征提取:作者使用CNN从文本中提取特征,经过卷积层、最大池化层和一个包含100个神经元的全连接层,输出一个100维的文本特征向量![]() 。

。

音频特征提取:作者使用开源软件openSMILE来提取包括响度、Mel-spectra、MFCC、基音等在内的6373个特征,然后使用全连接神经网络层将音频向量的维数降到100,输出音频特征向量![]() 。

。

视频特征提取:作者使用3D-CNN从视频中的每一帧提取面部表情和视觉环境的相关特征,3D-CNN能够提取跨帧的时空特征,因此对微笑或邹眉等情绪的识别效果更好。提取特征后输入到一个有100个神经元的全连接层,最后输出一个100维的视频特征向量![]() 。

。

特征融合:本文的重心并不在多模态特征融合上,因此作者仅使用了特征级融合,将三个模态的特征向量进行简单的连接,生成![]() ,u是一个300维的向量。

,u是一个300维的向量。

CMN模型

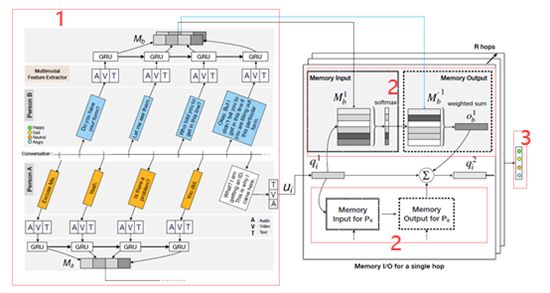

CMN模型如图所示,作者大致将模型分为历史记忆的表现机制(1)、注意机制(2)以及分类器(3)三个部分。

首先对每个模态进行特征提取、特征融合之后生成相应的多模态特征向量,每个历史对话由GRU建模到记忆单元之中,对两个历史记录执行相同但独立的计算,然后将每个话语的GRU的内部状态![]() 构成M的第t个记忆单元。其中

构成M的第t个记忆单元。其中![]() 可以通过下面公式求得:

可以通过下面公式求得:

具体原理可参考GRU简介_筱筱思的博客-CSDN博客_gru

在注意力机制中,首先生成注意向量![]() ,

, ,其中

,其中![]() 是由当前要识别的话语

是由当前要识别的话语![]() 与投影矩阵B进行内积操作得到的。使用注意向量

与投影矩阵B进行内积操作得到的。使用注意向量![]() 和新内存

和新内存![]() ' 的加权和生成一个输出表示

' 的加权和生成一个输出表示![]() 。

。

输出表示![]() 包含了历史信息结果。 使用注意力机制,可以让模型更快的过滤出与话语

包含了历史信息结果。 使用注意力机制,可以让模型更快的过滤出与话语![]() 相关的内容。

相关的内容。

在分类器这个部分,主要是将对话双方的历史信息结果加上要预测的那个句子的表示,再进行softmax,得到最后的预测结果。

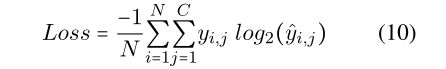

损失采用类别交叉熵

式中,N为话语总数,C为情绪类别数量,![]() 是训练集中第i个话语的one-hot向量,

是训练集中第i个话语的one-hot向量,![]() 是其属于类j的预测概率。

是其属于类j的预测概率。

为了精细化记忆表现,作者在记忆单元上使用了R跳,也就是R层,具体操作如下,也就是上一轮的输出作为下一轮的输入,

实验结果

作者在IEMOCAP数据集上进行验证,对比的基线有SVM-ensemble、bc-LSTM、Memn2n、

CMNSelf(只对说话者自身的历史信息进行建模)

CMNNA(没有注意机制)

实验结果如下,我们可以知道,CMN较于其他baseline都有着不小的优势,与CMNself相对存在的优势可以说明对说话者之间的情绪影响进行建模,是能够加强对话情感分析的性能的,而与CMNNA相比存在的优势可以说明注意机制在记忆单元优化中起着至关重要的作用。

总结

这篇论文通过研究对话历史上下文信息以及对话者之间的相互影响,提出来了一个深度神经框架,也取得了较好的成绩。尤其是使用了注意力机制,也表明了注意机制在从话语历史中过滤相关语境信息的重要性,从而为开发更高效、更类似人类的对话系统铺平了道路。