干货!基于常识图谱和混合策略的情绪支持对话系统

点击蓝字

关注我们

AI TIME欢迎每一位AI爱好者的加入!

情绪支持对话系统旨在理解人类用户的情绪困扰,并通过提供共情回复和疏导建议给予情感陪伴。

为了让对话系统拥有更强大的理解能力,我们在论文《C3KG: A Chinese Commonsense Conversation Knowledge Graph》提出了一种新的常识对话图谱,既包含常见心理状态知识,也包含了情感疏导中所需的对话流知识。

为了多轮对话更深入,我们在论文《MISC: A Mixed Strategy-Aware Model integrating COMET for Emotional Support Conversation》中提出了一种新的混合策略疏导对话模型,能更加灵活地选择策略并给出更自然更通顺的回复。

实验结果表明该模型能在 benchmark dataset ESConv 上取得较大的提升,也能让模型习得的策略更符合人类的心理学沟通策略。

本期AI TIME PhD直播间,我们邀请小米人工智能实验室高级算法工程师——李嫣然,为我们带来报告分享《基于常识图谱和混合策略的情绪支持对话系统》。

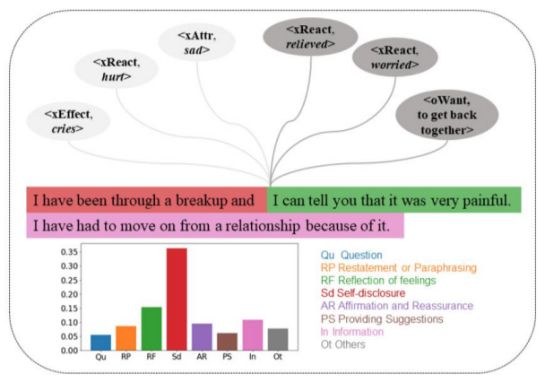

李嫣然:

博士毕业于香港理工大学,现任小米人工智能实验室高级算法工程师,同时也兼任着北京大学心理与认知学院的行业导师。其曾在国际顶级会议及期刊上发表论文二十余篇,涵盖情感计算、人机对话、自然语言生成等研究领域,累计引用次数超过1200次。

01

Background

据调查研究结果显示,新冠疫情后,全球患心理疾病的人数急剧增加。然而,当下的全球精神卫生系统却十分薄弱。在低收入和中等收入国家,甚至有76—85%的精神障碍患者没有接受治疗。

Research Problems

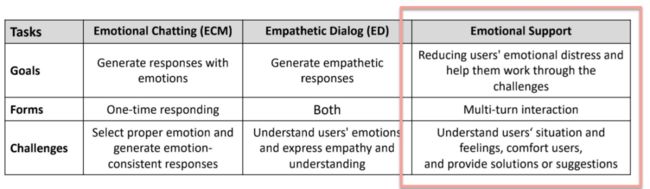

在这样的背景下,研究者们希望用 AI 技术来缓解这样的资源短缺。相关研究主要集中在情感认知与情感计算领域,共有4大类研究问题:

Emotion Understanding: 机器是否可以理解情绪? 并通过文本等形式表征出来?

Emotional Chatting: 如果认为计算机可以理解情绪,那么人机对话时该如何表达情绪?

Empathetic Dialog: 在理解用户的情绪后,机器应该表达什么样的情绪?

Emotional Support: 多轮交互下,如何使得用户愿意持续和机器对话并最终缓解用户的情绪问题?

接下来要分享的两篇论文主要和Emotional Support场景更相关一些。

02

Work 1

ACL 2022: Mixed Strategy for Emotional

Support Emotional Support

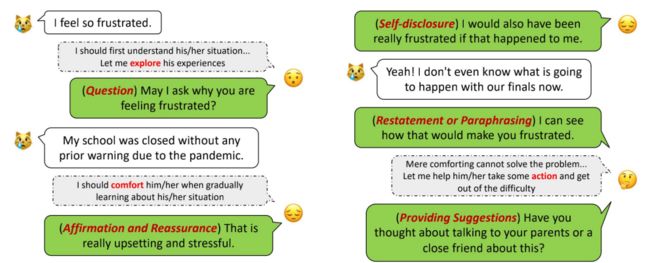

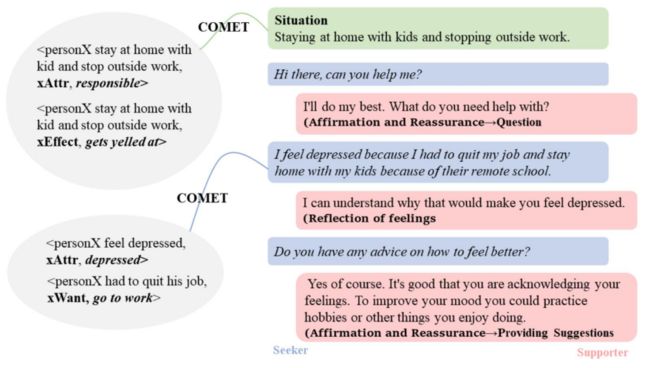

如上图对话所示,要想多轮对话内持续下去,我们需要有策略地推进对话。上图中的绿色对话框展示的都是一些具有心理学策略的沟通话语。这些心理学策略的组合使得整个对话过程变得循序渐进。通过这个例子也可以看出emotional support更关注的是,如何基于多种不同策略,让机器在不同阶段和不同状态下选择具有引导性、且长期来看整体收益更高的策略,使得最终对话达到我们的预期。

Key Problem

为了简化上述问题,清华黄民烈老师团队将这些心理学策略进行了梳理,并在他们的 ACL 2021 工作中提出了 emotional support 的三个阶段:

第一个阶段是探索阶段。这阶段我们需要询问去捕捉一些细节,同时了解用户当前情绪背后的诱因是什么。

第二个阶段是安抚阶段。在了解诱因后,我们需要通过情绪上的共鸣、通过自我披露来加深用户对我们的信任感。让用户觉得聊天机器人更有亲和力,从而更接纳它。

第三阶段是建议阶段。通过第二阶段的铺垫,我们才能在第三阶段的沟通中达到更好的效果,也让用户更愿意接受我们的建议,最终帮助到用户。

Related Work (Baseline)

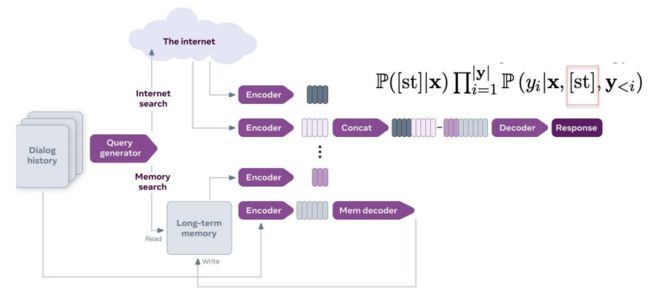

• BlenderBot-backbone

上述 baseline 模型同样由清华黄民烈老师团队在 ACL 2021 工作中提出。通过使用BlenderBot是一个开源的、经过大规模语料预训练的通用对话模型。他们基于 BlendeBot 做了一个非常简单直接的改进。既然我们已经知道可以在每一轮使用不同的策略来让机器回复得更好,这个策略就可以成为我们生成回复时的因变量。于是黄老师团队的这个 baseline 的思想就是利用策略的标签来指导整个的对话建模。

Method (ours)

• MISC

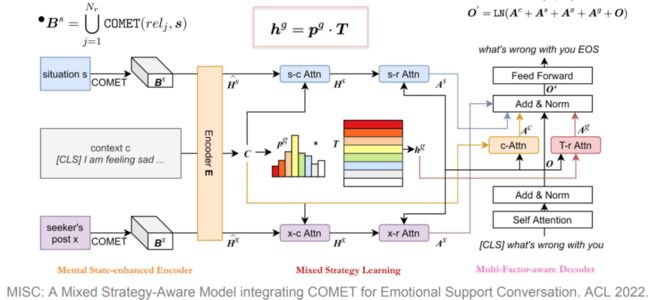

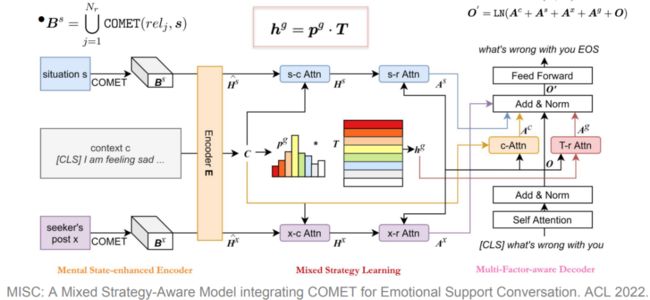

基于上述工作,我们在 ACL 2022 提出了两个改进:

首先,我们观察到数据中的对话很多都发生在是非常生活化的场景。

如上图Situation的描述所示,这个对话发生的背景是用户由于疫情,停止外面的工作,居家看护孩子。基于我们的常识,我们知道人在这样的背景下是很容易变得焦虑的。我们得出这样的判断是基于社会常识。

这里的难点在于,正因为常识是大家都知道的,所以往往是不需要明说的,也因此可能不会在语料中很明显地提及。

因此,如果我们可以让机器更好地拥有常识,就可以补充语料以外的有价值且易被忽略的知识。自然而然地,我们就想到要引入外部的数据知识库,最好是常识知识库。

于是,我们采用了华盛顿大学提出的一个常识知识库 ATOMIC 和用它做预训练的生成式模型 COMET。我们希望通过引入 COMET 推理出的常识,能让机器更好地理解对话、理解人们话语背后的隐性情绪。

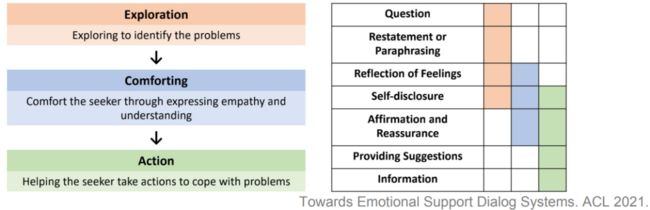

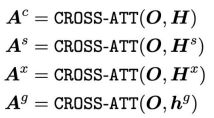

我们的第二个改进是提出了一个基于混合策略的情绪对话疏导模型。为了让模型能够学习在回复中应该使用什么样的策略,我们把策略建模成一个个离散的隐变量,并且把全部的策略建模成一个隐变量矩阵(codebook),不同策略就是不同维度的隐变量。

如上图所示,矩阵中不同颜色代表不同的策略。为了学习该使用哪种策略,我们用常识增强的context 输出一个分布distribution,并使用这个分布对策略的codebook做一个融合。这样,我们就得到了一个基于当下 context 的混合策略表示。

总结一下,我们在 ACL 2022中先引入了COMET模型提供的常识帮助我们推理用户的隐性情绪状态。随后,我们使用常识增强的context学习了当前对话状态下应该使用的混合策略。最终,我们把这样一个混合策略表示作为额外的condition,结合我们之前的常识和context,共同指导一个回复的生成。

• Codebook-based Mixed Strategy Learning——是我们认为最有亮点的部分。它有两个优点:

在 emotional support 这种对话数据集上,对话轮数和每轮的对话内容偏长。在每一轮使用的策略往往是混合的策略。自然地,我们提出的策略矩阵(codebook)是一种非常简单且能融合不同策略的建模方式。

在训练过程中,这样的策略矩阵很好学习。它比较灵活且不太受标签匮乏的影响。理论上,当我们学习到的 distribution更尖锐的时候,混合策略其实就聚焦在某一个维度的策略上。

Experiments

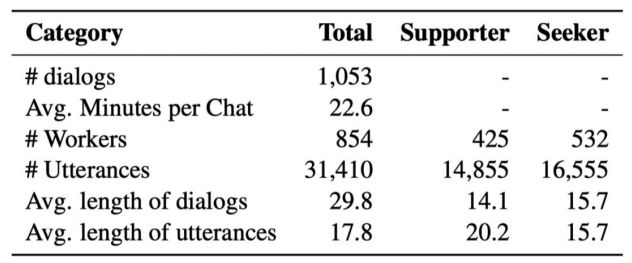

• A New Benchmark ESConv

我们在上面提到的benchmark数据集上进行了验证,并对其本身提供的baseline做了评估。

• Results on ESConv

我们可以看到我们的工作在各个指标上都有着显著的提升,比如ACC情绪理解准确率、PPL语言模型拟合程度、Distinct-n回复丰富度和 BLEU/ROUGE 的语义相关性等等。

Analysis

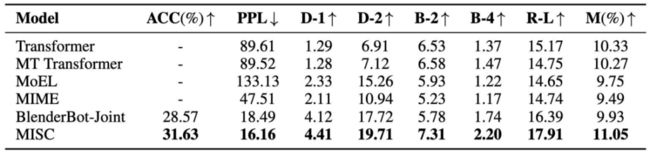

• Visualization

为了更好地理解我们的模型,我们也使用了可视化方法,把模型学到的策略进行一个分阶段的展示。比如模型聊20轮对话,前面和后面分别使用了什么策略?如上图所示,随着时间推移,询问策略(蓝色)的占比越来越少。

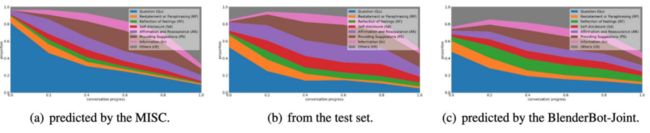

• Interpretation

因为我们用到的是一个离散的隐变量模型,它还有一个优点是具有一定的可解释性。我们本来离散的codebook每一维都对应一个策略,而一旦完成可视化就可以把distribution的维度对应上使用的策略。

如上图所示,在这样长回复中,我们使用了分布最高的三种策略(红、绿、粉色),这些策略和文字之间也是有很强的关联性的。这样的case也使得我们的工作较有说服力,不再是一个完全的“黑盒”。

03

Work 2

ACL 2022 Findings: Commonsense Reasoning for Emotion Cognition in Conversation

Key Problem 1

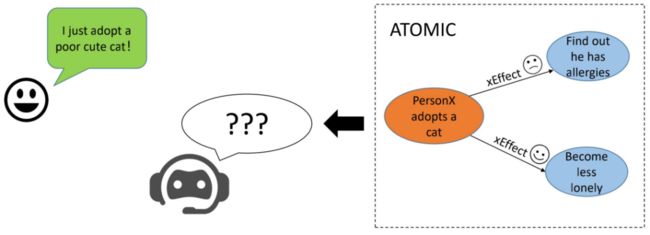

在使用常识图谱做对话建模时,我们也发现了一些问题:

• How to Understand Correctly (which)

首先,虽然我们直觉上觉得常识对对话理解和对话生成都是有用的,但是常识图谱中往往涵盖了非常多的信息。

如上图,用户领养了一只小猫,常识图谱中可能存在两种截然相反的推理结果:对猫毛过敏和被小猫治愈。这两种推理结果同时传给模型的话,会使得模型的学习变得困难。所以第一个问题是 whichi:哪个(些)常识才是正确的,应该被使用的。

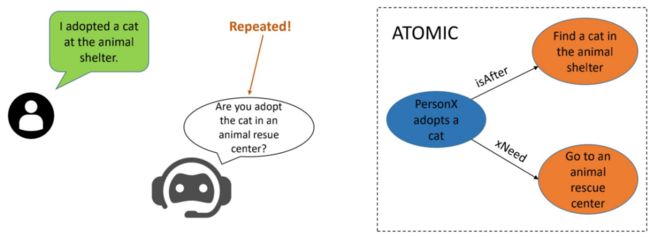

• How to Plan Future Dialogue (what)

第二个问题是在利用知识做回复生成的时候出现的。从收养小猫这样的知识节点延伸出去,也会有两类推理信息:一种是去宠物救助站领养小猫,一种是去猫舍领养小猫。

但通过左侧对话的示例,我们知道这种时候用户已经在对话里提供了明确的信息,我们希望能把这些可以挖掘的对话上下文中的常识也提炼出来。基于这两点,我们做了 ACL 2022 的另一个工作——C3KG。

Method (ours)

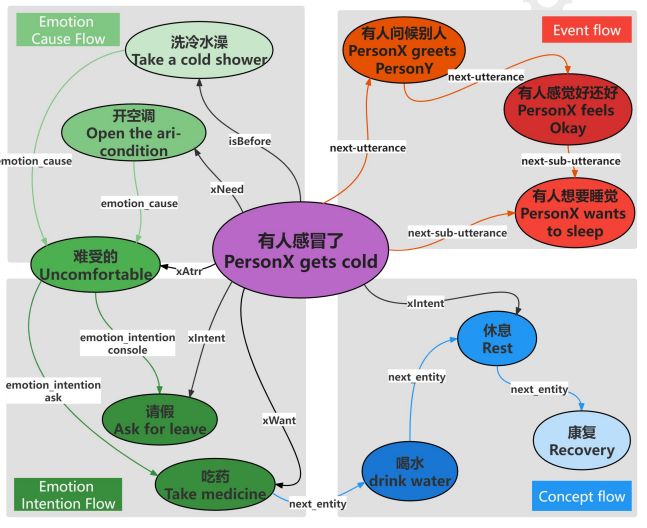

C3KG 是首个中文常识对话图谱(Chinese Commonsense Conversation Knowledge Graph),它既融合了已有常识图谱的知识,也加入了对话挖掘的知识,主要分为四大方面:

红色:Event flow事件类。我们可以通过事件提取这一技术挖掘到上下文中关联的事件,然后将共现次数超过阈值的事件对当作一组常识。

蓝色:Concept flow概念类。与事件类类似,也是基于共现挖掘。

浅绿:Emotion Cause Flow 情绪原因类,构建方法见下。

深绿:Emotion Intention Flow 情绪意图类,构建方法见下。

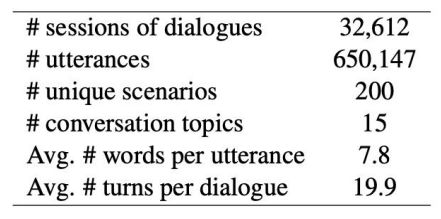

• CConv Dataset

为此,我们也收集了大量的人与人在真实生活中、特定场景下的高质量多轮对话。

同时,为了后续研究的推进,我们也将每一轮的emotion和对应的intention都进行了人工标注。有了这些结构化的标注标签,我们就可以构建我们的情感类常识知识。

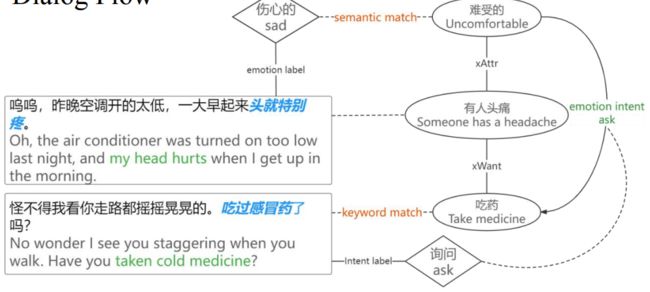

• Dialog Flow

如上图中的事件,我们可以 intent 和 emotion 标签,映射到常识图谱中的节点,从而挖掘到额外的符合对话上下文语境的 Dialog Flow。也因此被我们称为常识对话图谱。

• Emotion Recognition -> Emotion Cognition

有了这样的图谱,就可以帮助我们从情绪的识别、感知,升级到了情绪的认知。让我们我们了解到,用户为什么会有这样的情绪以及其原因是什么。我们也知道在这样的情绪下,在对话的交互中,机器应该做什么?用户可能想要做什么?我们的 emotion intention flow就正好可以提供这样的知识。

04

Summary

总结一下,我们在这两年陆续做了以下的工作,整体的思路是:

有常识,更懂你

情绪感知 -> 情绪认知 C3KG empathetic dialog (ACL 2022)

有逻辑,更深入

基于常识推理的多轮对话模型 C3KG-Bot emotional support (ACL 2022)

基于对话式推荐的层次化时序模型 HICR emotional support (SIGIR 2022)

有策略,更共情

基于心理学策略的回复生成模型 Emma emotional chatting (SIGIR 2021)

基于混合策略的预训练模型 MISC emotional support (ACL 2022)

提

醒

论文链接:

https://arxiv.org/abs/2204.02549

https://arxiv.org/abs/2203.13560论文题目:

C3KG: A Chinese Commonsense Conversation Knowledge Graph

MISC: A Mixed Strategy-Aware Model integrating COMET for Emotional Support Conversation

点击“阅读原文”,即可观看本场回放

整理:林 则

作者:李嫣然

往期精彩文章推荐

记得关注我们呀!每天都有新知识!

关于AI TIME

AI TIME源起于2019年,旨在发扬科学思辨精神,邀请各界人士对人工智能理论、算法和场景应用的本质问题进行探索,加强思想碰撞,链接全球AI学者、行业专家和爱好者,希望以辩论的形式,探讨人工智能和人类未来之间的矛盾,探索人工智能领域的未来。

迄今为止,AI TIME已经邀请了600多位海内外讲者,举办了逾300场活动,超170万人次观看。

我知道你

在看

哦

~

点击 阅读原文 查看回放!