- 端到端神经网络视频编解码器介绍

码流怪侠

音视频基础深度学习-PyTorch神经网络视频编解码人工智能githubDCVC端到端神经网路音视频

一、技术演进:从模块优化到全局智能的范式跃迁传统编解码器的效率天花板(1990-2017)架构局限:H.264/HEVC依赖手工设计的运动估计、DCT变换、熵编码模块,各模块独立优化导致全局效率损失。高分辨率瓶颈:4K/8K视频普及后,码率与画质矛盾激化,HEVC在VR场景下码率仍需>20Mbps才能保持无伪影画质。端到端神经编解码的爆发期(2017-2024)2017奠基年:Ballé团队提出超

- 【DW11月-深度学习】Task03前馈神经网络

沫2021

参考链接:https://datawhalechina.github.io/unusual-deep-learning/#/4.%E5%89%8D%E9%A6%88%E7%A5%9E%E7%BB%8F%E7%BD%91%E7%BB%9C一、神经元模型2.1神经元1943年,美国神经生理学家沃伦·麦卡洛克(WarrenMcCulloch)和数学家沃尔特·皮茨(WalterPitts)对生物神经元进行

- ONNX模型使用指南:从零开始掌握跨领域模型部署

ONNX模型使用指南:从零开始掌握跨领域模型部署ONNX模型作为一种开放式的神经网络交换格式,已成为AI模型部署的行业标准。当您获得一个没有使用说明的ONNX模型时,可以通过系统化的分析和部署流程,使其在不同领域发挥作用。本文将详细阐述如何分析模型结构、配置运行环境、准备特定领域输入数据、执行推理并处理结果,同时提供图像分类、自然语言处理、医疗影像分析、金融风控和自动驾驶等领域的具体应用示例,帮助

- mpiigaze的安装过程一

匆匆整棹还

python

mpiigaze链接mpiigaze应该不是作者本人写的,而是社区工作者的杰作,对原论文Appearance-BasedGazeEstimationintheWild的代码进行的一些复现1.创建conda环境2.问题Buildingwheelsforcollectedpackages:dlibBuildingwheelfordlib(pyproject.toml)...errorerror:sub

- 「高能PPT演讲技巧训练」| 让您的演讲更加吸引听众的三条原则

全息演说智慧

求职面试中的PPT介绍总让你紧张不已,不知所措?论文答辩时要怎样借助PPT表达学术观点?小组汇报、工作总结时的PPT展示怎样做更清晰有力?如何有效避免中途冷场?其实对听众演讲就像喂一个两岁的小孩子吃苹果酱。一匙的量越多,就会有越多的苹果酱掉在地板上。无论在你的幻灯片还是你的演讲正文上,你只需要那些能支持你观点的必要信息,其他的都删掉。当没有什么可以删掉时,你便写完了你的演讲稿。学会这三大原则,让你

- Android 异构计算与 OpenCL/CUDA/OpenVX 的协同方式实战解析

观熵

国产NPU×Android推理优化android人工智能

Android异构计算与OpenCL/CUDA/OpenVX的协同方式实战解析关键词Android异构计算、OpenCL、CUDA、OpenVX、GPU加速、NPU调度、HSA架构、神经网络推理、计算图编排、SoC协同处理、AI芯片编程摘要随着国产SoC平台持续迭代,Android系统中异构计算模式已从传统CPU+GPU并行计算,扩展到集成NPU、DSP、ISP等多核单元的复杂协同体系。在AI推理

- 仓库货物检测:基于YOLOv5的深度学习应用与UI界面开发

YOLO实战营

YOLO深度学习ui目标跟踪目标检测人工智能

一、引言随着电商和物流行业的快速发展,仓库货物管理已经成为企业运营中至关重要的环节。为了提高仓库管理的效率和准确性,越来越多的企业开始应用自动化技术来完成货物的盘点、分类、分拣等任务。传统的货物管理方式通常依赖人工检查,不仅效率低下,而且容易出现误差。为了克服这些问题,利用计算机视觉和深度学习技术来实现仓库货物的自动化检测成为了一种有效的解决方案。本博客将介绍如何使用YOLOv5进行仓库货物检测,

- Transformer:自注意力驱动的神经网络革命引擎

大千AI助手

人工智能Python#OTHERtransformer神经网络深度学习google人工智能机器学习大模型

本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!从语言理解到多模态智能的通用架构基石⚙️一、核心定义与历史意义Transformer是由Google团队在2017年论文《AttentionIsAllYouNeed》中提出的深度学习架构,其颠覆性创新在于:完全摒弃RNN/CNN:仅依赖自注意力机制(S

- [特殊字符] LLM(大型语言模型):智能时代的语言引擎与通用推理基座

大千AI助手

人工智能Python#OTHER语言模型人工智能自然语言处理LLM大模型Transformer

本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!从千亿参数到人类认知的AI革命一、核心定义与核心特征LLM(LargeLanguageModel)是基于海量文本数据训练的深度学习模型,通过神经网络架构(尤其是Transformer)模拟人类语言的复杂规律,实现文本理解、生成与推理任务。其核心特征可概

- 卷积神经网络-数据增强

红米煮粥

cnn人工智能神经网络

文章目录一、概述二、数据增强的类别1.裁剪2.翻转和旋转3.随机遮挡4.图像变换5.对transforms的选择操作,使数据增强更灵活三、应用场景四、总结一、概述数据增强(也叫数据扩增)的目的是为了扩充数据和提升模型的泛化能力。有效的数据扩充不仅能扩充训练样本数量,还能增加训练样本的多样性,一方面可避免过拟合,另一方面又会带来模型性能的提升。二、数据增强的类别1.裁剪中心裁剪:transforms

- 深度学习模型开发部署全流程:以YOLOv11目标检测任务为例

你喜欢喝可乐吗?

deeplearningdeploy深度学习YOLO目标检测

深度学习模型开发部署全流程:以YOLOv11目标检测任务为例深度学习模型从开发到部署的完整流程包含需求分析、数据准备、模型训练、模型优化、模型测试和部署运行六大核心环节。YOLOv11作为新一代目标检测模型,不仅延续了YOLO系列的高效实时性能,还在检测精度和泛化能力上取得显著突破,使其成为工业质检、安防监控、自动驾驶等领域的理想选择。本文将详细阐述这一完整流程,并结合YOLOv11的具体实现,提

- 预测导管原位癌浸润性复发的深度学习:利用组织病理学图像和临床特征

浪漫的诗人

论文深度学习人工智能

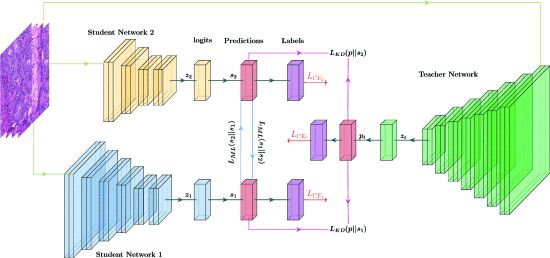

文章目录研究内容目的方法数据集模型开发模型训练与评估外部验证统计分析研究结果模型性能风险分层外部验证特征重要性原文链接原文献:Deeplearningforpredictinginvasiverecurrenceofductalcarcinomainsitu:leveraginghistopathologyimagesandclinicalfeatures研究背景【DCIS与IBC的关联】乳腺导管

- 深度学习:让 AI 拥有 “思考” 能力的核心技术

田园Coder

人工智能科普人工智能科普

1.深度学习:突破传统的AI“进阶版”1.1什么是深度学习?深度学习是机器学习的一个分支,它通过模拟人脑神经网络的多层结构,让AI能够自动学习数据中的复杂特征,从而完成更高级的认知任务。例如,传统机器学习需要人类手动提取“猫有尖耳朵、胡须”等特征,而深度学习能直接从原始图片中,自主学习从像素到轮廓、再到整体形态的多层特征,最终实现更精准的识别。这种“自主提取特征”的能力,让深度学习突破了传统AI的

- 创造力是产生有价值的新颖想法,这是三个大脑神经网络的交互作用——《跨越不可能》精读分享36

峰哥读写思

创造力是神经网络的交互作用。这是《跨越不可能》一书,精读分享的第36篇。根据心理学的定义,创造力是产生有价值的新颖想法。在这个定义中,从大脑的结构来看,创造力总是与选择有关。大脑必须选择一个以前从未出现过的行动计划,并且要判断这个行动计划是否有效。这就要有赖于大脑中的三个神经网络的交互作用。第一个网络是注意网络。这个网络是信息选择器。创造力开始于大脑吸收新的信息。我们是用自己的注意力来吸收这些信息

- 文字是灵魂最好的倾诉

仁红家学

这是雪妮为你分享的第76篇文章郭红艳为你分享的第35篇文章不知从什么时候起,爱上了写作。我的印象里,最早的写作还是学生时代老师布置的作文。再后来就是写写日记,大学写写论文,参加工作后写得多的是工作汇报及年终总结。毕业进入社会,日常已远离书本,写作也渐渐淡出了生活。每天就是柴米油盐酱醋茶,为各种闲杂琐事而烦恼,内心的闲情雅致早已飞到九霄云外去了。不知从什么时候起,写作便成了少数文青的事。我不算文青,

- PyTorch torch.no_grad() 指南(笔记)

拉拉拉拉拉拉拉马

pytorch人工智能python笔记深度学习

PyTorchtorch.no_grad()权威在PyTorch深度学习框架中,高效的显存管理对于训练复杂模型和执行大规模推理任务至关重要。显存不足(OutOfMemory,OOM)错误是开发者经常面临的挑战之一。torch.no_grad()作为PyTorch提供的一个核心工具,能够在推理(inference)和验证(validation)阶段显著优化显存使用并提升计算速度。本报告旨在全面、深入

- 【深度学习基础】PyTorch中model.eval()与with torch.no_grad()以及detach的区别与联系?

目录1.核心功能对比2.使用场景对比3.区别与联系4.典型代码示例(1)模型评估阶段(2)GAN训练中的判别器更新(3)提取中间特征5.关键区别总结6.常见问题与解决方案(1)问题:推理阶段显存爆掉(2)问题:Dropout/BatchNorm行为异常(3)问题:中间张量意外参与梯度计算7.最佳实践8.总结以下是PyTorch中model.eval()、withtorch.no_grad()和.d

- python大数据论文_大数据环境下基于python的网络爬虫技术

weixin_39775976

python大数据论文

软件开发大数据环境下基于python的网络爬虫技术作者/谢克武,重庆工商大学派斯学院软件工程学院摘要:随着互联网的发展壮大,网络数据呈爆炸式增长,传统捜索引擎已经不能满足人们对所需求数据的获取的需求,作为搜索引擎的抓取数据的重要组成部分,网络爬虫的作用十分重要,本文首先介绍了在大数据环境下网络爬虫的重要性,接着介绍了网络爬虫的概念,工作原理,工作流程,网页爬行策略,python在编写爬虫领域的优势

- 2021-10-10

如鱼饮水2020

中原焦点团队网络中26期坚持分享第516天(20211010)论文答辩稿背了N篇,第三个就是我上台演讲,心跳加速,深呼吸极力默念:稳就是定海神针。前两位男生都是低头读稿,虽然自己也带着手稿,距离太远根本看不到。硬着头皮背吧,脑子断篇也得上,先阳谋一下:第一次上讲台特别紧张。调整一下语速,结合APP,能背多少是多少吧,丑媳妇总归要见公婆的。先感谢导师的悉心指导和在坐的各位,论文的结构框架和大概内容几

- 基于生成对抗网络增强主动学习的超高温陶瓷硬度优化

神经网络15044

深度学习算法仿真模型生成对抗网络学习人工智能

复现论文:基于生成对抗网络增强主动学习的超高温陶瓷硬度优化我将使用Python复现这篇关于使用生成对抗网络(GAN)增强主动学习来优化超高温陶瓷(UHTC)硬度的研究论文。以下是完整的实现代码和解释。1.环境准备和数据加载首先,我们需要准备必要的Python库并加载数据。importnumpyasnpimportpandasaspdimportmatplotlib.pyplotaspltimpor

- 嵌入式单片机开发实战指南: 从RISC-V到TinyML全栈技术

CodeMicro

单片机单片机risc-v嵌入式硬件

前言:嵌入式单片机的2025年技术浪潮2025年,嵌入式系统正经历开源架构与边缘智能的双重革命。RISC-V指令集打破ARM垄断,国产芯片如兆易创新GD32VF103、先楫HPM6750实现工业级可靠性;TinyML技术让STM32L4系列在1MB内存下运行神经网络;低功耗设计使物联网节点电池寿命突破10年。本文将从架构选型→开发环境→核心技术→实战项目,全方位拆解嵌入式开发的热门技术,带你从入门

- 探索OpenCV 3.2源码:计算机视觉的架构与实现

轩辕姐姐

本文还有配套的精品资源,点击获取简介:OpenCV是一个全面的计算机视觉库,提供广泛的功能如图像处理、对象检测和深度学习支持。OpenCV3.2版本包含了改进的深度学习和GPU加速特性,以及丰富的示例程序。本压缩包文件提供了完整的OpenCV3.2源代码,对于深入学习计算机视觉算法和库实现机制十分宝贵。源码的模块化设计、C++接口、算法实现、多平台支持和性能优化等方面的深入理解,都将有助于开发者的

- Synergizing RAG and Reasoning: A Systematic Review-RAG与推理能力深度结合-新方向

数据分析能量站

机器学习人工智能

欢迎关v:数据分析能量站0论文小结一、研究背景与核心问题大语言模型(LLM)在处理复杂任务时面临两大瓶颈:知识局限性:纯LLM存在“知识幻觉”(编造事实)和“领域知识缺口”;推理浅度:传统检索增强生成(RAG)仅通过关键词匹配获取信息,无法处理多跳推理、语义歧义等复杂需求。核心主张:RAG与推理的深度整合(RAG+Reasoning)是突破上述瓶颈的关键,通过“检索提供实时知识,推理赋予逻辑能力”

- 院级医疗AI管理流程—基于数据共享、算法开发与工具链治理的系统化框架

Allen_Lyb

医疗高效编程研发人工智能算法时序数据库经验分享健康医疗

医疗AI:从“单打独斗”到“协同共进”在科技飞速发展的今天,医疗人工智能(AI)正以前所未有的速度改变着传统医疗模式。从最初在影像诊断、临床决策支持、药物发现等单一领域的“单点突破”,医疗AI如今已迈向“系统级协同”的新阶段。曾经,医疗AI的应用多集中在某一特定环节,比如利用深度学习算法分析医学影像,辅助医生进行疾病诊断。这种单点突破式的应用虽然在一定程度上提高了医疗效率,但随着医疗行业对AI技术

- 文献笔记八十一:植物长链非编码RNA数据库PLncDB 2.0

小明的数据分析笔记本

论文链接https://academic.oup.com/nar/article/49/D1/D1489/5932847本地文件gkaa910.pdf

- 大型语言模型的智能本质是什么

ZhangJiQun&MXP

教学2021论文2024大模型以及算力语言模型人工智能自然语言处理

大型语言模型的智能本质是什么基于海量数据的统计模式识别与生成系统,数据驱动的语言模拟系统,其价值在于高效处理文本任务(如写作、翻译、代码生成),而非真正的理解与创造大型语言模型(如GPT-4、Claude等)的智能本质可概括为基于海量数据的统计模式识别与生成系统,其核心能力源于对语言规律的深度学习,但缺乏真正的理解与意识。以下从本质特征、技术机制、典型案例及争议点展开分析:一、智能本质的核心特征统

- 【人脸识别】FROM:提升遮挡状态下的人脸识别效果

姚路遥遥

人脸识别深度学习计算机视觉人工智能遮挡人脸识别损失

论文题目:《End2EndOccludedFaceRecognitionbyMaskingCorruptedFeatures》论文地址:https://arxiv.org/pdf/2108.09468v3.pdf代码地址:https://github.com/haibo-qiu/from1.前言人脸识别技术已经取得了显著的进展,主要归功于以下三个因素:lossfunctions:Centerlos

- 渣土车识别漏检率高?陌讯算法实测降 90%

2501_92487936

目标跟踪人工智能计算机视觉目标检测算法智慧城市

在城市建筑垃圾运输管理中,渣土车的合规性监测一直是行业痛点。传统视觉算法在复杂工况下常常出现误判——阴雨天车牌识别模糊、夜间车灯眩光导致车型误分类、不同品牌渣土车混检时准确率骤降。某市政管理局的统计显示,采用传统方案时,日均漏检率高达23%,由此引发的违规倾倒投诉占比超60%。技术解析:从单模态到多特征融合的突破传统渣土车识别多依赖单一目标检测模型(如FasterR-CNN),其核心缺陷在于:特征

- 复杂场景检测老翻车?陌讯算法实测提升 40%

2501_92453489

算法视觉计算机视觉视觉检测

在工业质检、安防监控等计算机视觉落地场景中,工程师常面临棘手问题:传统算法在光照突变、目标遮挡等复杂环境下,漏检率高达20%以上,泛化能力不足成为项目落地的最大阻碍。而陌讯AI视觉算法通过架构创新,正在重新定义复杂场景下的检测精度标准。技术解析:从单模态到多模态的跨越传统目标检测模型多依赖单一RGB图像输入,在特征提取阶段容易受环境干扰。以经典的FasterR-CNN为例,其区域提议网络(RPN)

- 深度学习超参数优化(HPO)终极指南:从入门到前沿

摘要:在深度学习的实践中,模型性能的好坏不仅取决于算法和数据,更在一半程度上取决于超参数的精妙设置。本文是一篇关于超参数优化(HyperparameterOptimization,HPO)的综合性指南,旨在带领读者从最基础的概念出发,系统性地梳理从经典到前沿的各类优化方法,并最终落地于实用策略和现代工具。无论您是初学者还是资深从业者,都能从中获得宝贵的见解。第一部分:夯实基础——HPO的核心概念1

- 解读Servlet原理篇二---GenericServlet与HttpServlet

周凡杨

javaHttpServlet源理GenericService源码

在上一篇《解读Servlet原理篇一》中提到,要实现javax.servlet.Servlet接口(即写自己的Servlet应用),你可以写一个继承自javax.servlet.GenericServletr的generic Servlet ,也可以写一个继承自java.servlet.http.HttpServlet的HTTP Servlet(这就是为什么我们自定义的Servlet通常是exte

- MySQL性能优化

bijian1013

数据库mysql

性能优化是通过某些有效的方法来提高MySQL的运行速度,减少占用的磁盘空间。性能优化包含很多方面,例如优化查询速度,优化更新速度和优化MySQL服务器等。本文介绍方法的主要有:

a.优化查询

b.优化数据库结构

- ThreadPool定时重试

dai_lm

javaThreadPoolthreadtimertimertask

项目需要当某事件触发时,执行http请求任务,失败时需要有重试机制,并根据失败次数的增加,重试间隔也相应增加,任务可能并发。

由于是耗时任务,首先考虑的就是用线程来实现,并且为了节约资源,因而选择线程池。

为了解决不定间隔的重试,选择Timer和TimerTask来完成

package threadpool;

public class ThreadPoolTest {

- Oracle 查看数据库的连接情况

周凡杨

sqloracle 连接

首先要说的是,不同版本数据库提供的系统表会有不同,你可以根据数据字典查看该版本数据库所提供的表。

select * from dict where table_name like '%SESSION%';

就可以查出一些表,然后根据这些表就可以获得会话信息

select sid,serial#,status,username,schemaname,osuser,terminal,ma

- 类的继承

朱辉辉33

java

类的继承可以提高代码的重用行,减少冗余代码;还能提高代码的扩展性。Java继承的关键字是extends

格式:public class 类名(子类)extends 类名(父类){ }

子类可以继承到父类所有的属性和普通方法,但不能继承构造方法。且子类可以直接使用父类的public和

protected属性,但要使用private属性仍需通过调用。

子类的方法可以重写,但必须和父类的返回值类

- android 悬浮窗特效

肆无忌惮_

android

最近在开发项目的时候需要做一个悬浮层的动画,类似于支付宝掉钱动画。但是区别在于,需求是浮出一个窗口,之后边缩放边位移至屏幕右下角标签处。效果图如下:

一开始考虑用自定义View来做。后来发现开线程让其移动很卡,ListView+动画也没法精确定位到目标点。

后来想利用Dialog的dismiss动画来完成。

自定义一个Dialog后,在styl

- hadoop伪分布式搭建

林鹤霄

hadoop

要修改4个文件 1: vim hadoop-env.sh 第九行 2: vim core-site.xml <configuration> &n

- gdb调试命令

aigo

gdb

原文:http://blog.csdn.net/hanchaoman/article/details/5517362

一、GDB常用命令简介

r run 运行.程序还没有运行前使用 c cuntinue

- Socket编程的HelloWorld实例

alleni123

socket

public class Client

{

public static void main(String[] args)

{

Client c=new Client();

c.receiveMessage();

}

public void receiveMessage(){

Socket s=null;

BufferedRea

- 线程同步和异步

百合不是茶

线程同步异步

多线程和同步 : 如进程、线程同步,可理解为进程或线程A和B一块配合,A执行到一定程度时要依靠B的某个结果,于是停下来,示意B运行;B依言执行,再将结果给A;A再继续操作。 所谓同步,就是在发出一个功能调用时,在没有得到结果之前,该调用就不返回,同时其它线程也不能调用这个方法

多线程和异步:多线程可以做不同的事情,涉及到线程通知

&

- JSP中文乱码分析

bijian1013

javajsp中文乱码

在JSP的开发过程中,经常出现中文乱码的问题。

首先了解一下Java中文问题的由来:

Java的内核和class文件是基于unicode的,这使Java程序具有良好的跨平台性,但也带来了一些中文乱码问题的麻烦。原因主要有两方面,

- js实现页面跳转重定向的几种方式

bijian1013

JavaScript重定向

js实现页面跳转重定向有如下几种方式:

一.window.location.href

<script language="javascript"type="text/javascript">

window.location.href="http://www.baidu.c

- 【Struts2三】Struts2 Action转发类型

bit1129

struts2

在【Struts2一】 Struts Hello World http://bit1129.iteye.com/blog/2109365中配置了一个简单的Action,配置如下

<!DOCTYPE struts PUBLIC

"-//Apache Software Foundation//DTD Struts Configurat

- 【HBase十一】Java API操作HBase

bit1129

hbase

Admin类的主要方法注释:

1. 创建表

/**

* Creates a new table. Synchronous operation.

*

* @param desc table descriptor for table

* @throws IllegalArgumentException if the table name is res

- nginx gzip

ronin47

nginx gzip

Nginx GZip 压缩

Nginx GZip 模块文档详见:http://wiki.nginx.org/HttpGzipModule

常用配置片段如下:

gzip on; gzip_comp_level 2; # 压缩比例,比例越大,压缩时间越长。默认是1 gzip_types text/css text/javascript; # 哪些文件可以被压缩 gzip_disable &q

- java-7.微软亚院之编程判断俩个链表是否相交 给出俩个单向链表的头指针,比如 h1 , h2 ,判断这俩个链表是否相交

bylijinnan

java

public class LinkListTest {

/**

* we deal with two main missions:

*

* A.

* 1.we create two joined-List(both have no loop)

* 2.whether list1 and list2 join

* 3.print the join

- Spring源码学习-JdbcTemplate batchUpdate批量操作

bylijinnan

javaspring

Spring JdbcTemplate的batch操作最后还是利用了JDBC提供的方法,Spring只是做了一下改造和封装

JDBC的batch操作:

String sql = "INSERT INTO CUSTOMER " +

"(CUST_ID, NAME, AGE) VALUES (?, ?, ?)";

- [JWFD开源工作流]大规模拓扑矩阵存储结构最新进展

comsci

工作流

生成和创建类已经完成,构造一个100万个元素的矩阵模型,存储空间只有11M大,请大家参考我在博客园上面的文档"构造下一代工作流存储结构的尝试",更加相信的设计和代码将陆续推出.........

竞争对手的能力也很强.......,我相信..你们一定能够先于我们推出大规模拓扑扫描和分析系统的....

- base64编码和url编码

cuityang

base64url

import java.io.BufferedReader;

import java.io.IOException;

import java.io.InputStreamReader;

import java.io.PrintWriter;

import java.io.StringWriter;

import java.io.UnsupportedEncodingException;

- web应用集群Session保持

dalan_123

session

关于使用 memcached 或redis 存储 session ,以及使用 terracotta 服务器共享。建议使用 redis,不仅仅因为它可以将缓存的内容持久化,还因为它支持的单个对象比较大,而且数据类型丰富,不只是缓存 session,还可以做其他用途,一举几得啊。1、使用 filter 方法存储这种方法比较推荐,因为它的服务器使用范围比较多,不仅限于tomcat ,而且实现的原理比较简

- Yii 框架里数据库操作详解-[增加、查询、更新、删除的方法 'AR模式']

dcj3sjt126com

数据库

public function getMinLimit () { $sql = "..."; $result = yii::app()->db->createCo

- solr StatsComponent(聚合统计)

eksliang

solr聚合查询solr stats

StatsComponent

转载请出自出处:http://eksliang.iteye.com/blog/2169134

http://eksliang.iteye.com/ 一、概述

Solr可以利用StatsComponent 实现数据库的聚合统计查询,也就是min、max、avg、count、sum的功能

二、参数

- 百度一道面试题

greemranqq

位运算百度面试寻找奇数算法bitmap 算法

那天看朋友提了一个百度面试的题目:怎么找出{1,1,2,3,3,4,4,4,5,5,5,5} 找出出现次数为奇数的数字.

我这里复制的是原话,当然顺序是不一定的,很多拿到题目第一反应就是用map,当然可以解决,但是效率不高。

还有人觉得应该用算法xxx,我是没想到用啥算法好...!

还有觉得应该先排序...

还有觉

- Spring之在开发中使用SpringJDBC

ihuning

spring

在实际开发中使用SpringJDBC有两种方式:

1. 在Dao中添加属性JdbcTemplate并用Spring注入;

JdbcTemplate类被设计成为线程安全的,所以可以在IOC 容器中声明它的单个实例,并将这个实例注入到所有的 DAO 实例中。JdbcTemplate也利用了Java 1.5 的特定(自动装箱,泛型,可变长度

- JSON API 1.0 核心开发者自述 | 你所不知道的那些技术细节

justjavac

json

2013年5月,Yehuda Katz 完成了JSON API(英文,中文) 技术规范的初稿。事情就发生在 RailsConf 之后,在那次会议上他和 Steve Klabnik 就 JSON 雏形的技术细节相聊甚欢。在沟通单一 Rails 服务器库—— ActiveModel::Serializers 和单一 JavaScript 客户端库——&

- 网站项目建设流程概述

macroli

工作

一.概念

网站项目管理就是根据特定的规范、在预算范围内、按时完成的网站开发任务。

二.需求分析

项目立项

我们接到客户的业务咨询,经过双方不断的接洽和了解,并通过基本的可行性讨论够,初步达成制作协议,这时就需要将项目立项。较好的做法是成立一个专门的项目小组,小组成员包括:项目经理,网页设计,程序员,测试员,编辑/文档等必须人员。项目实行项目经理制。

客户的需求说明书

第一步是需

- AngularJs 三目运算 表达式判断

qiaolevip

每天进步一点点学习永无止境众观千象AngularJS

事件回顾:由于需要修改同一个模板,里面包含2个不同的内容,第一个里面使用的时间差和第二个里面名称不一样,其他过滤器,内容都大同小异。希望杜绝If这样比较傻的来判断if-show or not,继续追究其源码。

var b = "{{",

a = "}}";

this.startSymbol = function(a) {

- Spark算子:统计RDD分区中的元素及数量

superlxw1234

sparkspark算子Spark RDD分区元素

关键字:Spark算子、Spark RDD分区、Spark RDD分区元素数量

Spark RDD是被分区的,在生成RDD时候,一般可以指定分区的数量,如果不指定分区数量,当RDD从集合创建时候,则默认为该程序所分配到的资源的CPU核数,如果是从HDFS文件创建,默认为文件的Block数。

可以利用RDD的mapPartitionsWithInd

- Spring 3.2.x将于2016年12月31日停止支持

wiselyman

Spring 3

Spring 团队公布在2016年12月31日停止对Spring Framework 3.2.x(包含tomcat 6.x)的支持。在此之前spring团队将持续发布3.2.x的维护版本。

请大家及时准备及时升级到Spring

- fis纯前端解决方案fis-pure

zccst

JavaScript

作者:zccst

FIS通过插件扩展可以完美的支持模块化的前端开发方案,我们通过FIS的二次封装能力,封装了一个功能完备的纯前端模块化方案pure。

1,fis-pure的安装

$ fis install -g fis-pure

$ pure -v

0.1.4

2,下载demo到本地

git clone https://github.com/hefangshi/f

![]() 【论文速递 | 精选】

【论文速递 | 精选】![]() 阅读原文访问社区

阅读原文访问社区