- PyTorch 在 Python 自然语言处理中的运用

Python编程之道

Python编程之道pythonpytorch自然语言处理ai

PyTorch在Python自然语言处理中的运用关键词:PyTorch,Python,自然语言处理,深度学习,文本分类,情感分析摘要:本文全面探讨了PyTorch在Python自然语言处理(NLP)领域的运用。首先介绍了相关背景知识,包括目的范围、预期读者等内容。接着详细阐述了核心概念,如词嵌入、循环神经网络等,并给出了相应的原理示意图和流程图。深入讲解了核心算法原理,结合Python代码进行详细

- 企业内网系统:从传统开发到智能赋能的进化之路

飞算JavaAI开发助手

科技人工智能大数据java

在当今数字化浪潮中,企业内网系统作为支撑日常运营的核心基础设施,其开发效率与质量直接关系到企业的竞争力。传统开发模式下,程序员需要手动完成需求分析、架构设计、代码编写、测试调试等全流程工作,不仅耗时费力,还容易因人为疏忽导致质量隐患。而随着人工智能技术的突破性进展,以飞算JavaAI为代表的智能开发工具正在重塑企业内网系统的开发范式,为程序员提供从设计到落地的全链路智能支持。一、传统企业内网系统开

- 内网环境部署Deepseek+Dify,构建企业私有化AI应用

我是鲁阿姨

0.简介#公司为生产安全和保密,内部的服务器不可连接外部网络,为了可以在内网环境下部署,采用的方案为ollama(Docker)+Dify(DockerCompose),方便内网环境下迁移和备份,下文将介绍部署的全部过程。1.镜像拉取#镜像拉取为准备工作,因服务器在内网环境,需要先在可以连接外网的电脑上拉取相关镜像或文件。由于公司笔记本的Windows系统屏蔽了MicrosoftStore,导致D

- Java基础学习笔记2

qichi333

学习笔记javaeclipse

今天是Java基础学习第二天,加油!!!下面是我今天记的一些笔记。(有点懒惰了,爬虫今天没学,因为赖床了(bushi),但我会勤奋起来的^_^,一定一定!明天不能偷懒了天!!)一、运算符例子:inta=10;intb=20;intc=a+b;其中,“+”是运算符,且是算术运算符;“a+b”是表达式,且是算术表达式。1.算术运算符例1:publicclassdemo3{publicstaticvoi

- 颠覆人机交互!多模态 AI Agents 大模型如何用 5 大模式开启智能新时代?

注:此文章内容均节选自充电了么创始人,CEO兼CTO陈敬雷老师的新书《GPT多模态大模型与AIAgent智能体》(跟我一起学人工智能)【陈敬雷编著】【清华大学出版社】GPT多模态大模型与AIAgent智能体书籍本章配套视频课程【陈敬雷】文章目录GPT多模态大模型与AIAgent智能体系列七颠覆人机交互!多模态AIAgents大模型如何用5大模式开启智能新时代?一、从“单一感知”到“多模态融合”:A

- 四、Actor-Critic Methods

沈夢昂志

DRL深度强化学习python深度学习

由于在看DRL论文中,很多公式都很难理解。因此最近在学习DRL的基本内容。再此说明,非常推荐B站“王树森老师的DRL强化学习”本文的图表及内容,都是基于王老师课程的后自行理解整理出的内容。目录A.书接上回1、Reinforce算法B.State-ValueFunctionC.PolicyNetWork(Actor)D.ActionValueNetwork(Critic)E.TraintheNeur

- 实操 SpringBoot+MCP!

清风孤客

springboot后端java人工智能

引言随着人工智能的飞速发展,大语言模型(LLM)正在革命性地重塑用户与软件的交互范式。想象一下这样的场景:用户无需钻研复杂的API文档或者在繁琐的表单间来回切换,只需通过自然语言直接与系统对话——“帮我查找所有2023年出版的图书”、“创建一个新用户叫张三,邮箱是

[email protected]”。这种直观、流畅的交互方式不仅能显著降低新用户的学习曲线,更能大幅削减B端系统的培训成本和实施

- 如何学习智能体搭建

如何学习智能体搭建前言随着人工智能的发展,智能体(Agent)成为自动化、交互式应用和自主决策系统中的核心角色。本书将从零基础出发,系统讲解智能体的基本原理、常见框架、实战搭建与进阶技巧,帮助你快速上手并应用于实际项目。目录智能体基础认知智能体的核心组成主流智能体开发框架本地智能体与云端智能体选型智能体的任务自动化与插件集成智能体的知识检索与上下文管理智能体的多模态扩展智能体安全与可控性智能体实战

- 板凳-------Mysql cookbook学习 (十一--------4)

唐宇迪机器学习实战课程笔记https://blog.csdn.net/weixin_54338498/article/details/128818007?spm=1001.2101.3001.6650.1&utm_medium=distribute.pc_relevant.none-task-blog-2%7Edefault%7EBlogCommendFromBaidu%7ECtr-1-12881

- 04_JavaWeb回顾笔记

skping-go

javajavaweb

JavaWeb回顾笔记[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Wh1nKopi-1605668744709)(F:\资料\Java\笔记\笔记\assets\javaweb阶段知识体系.png)]Day01HTML1.1HTML简介HTML:HyperTextMarkupLanguage,超文本标记/标签语言。超文本:超出了普通文本的能力标记:标签W3C(Wo

- 神经网络初步学习3——数据与损失

X Y O

神经网络学习人工智能

一、传统机器学习与神经网络前言:该部分需要一定的机器学习与数学基础(很浅的基础),如果有不理解的地方可以自行查阅。(1)区别这里不妨以图像识别为例子:(1)在传统的机器学习视角中:我们需要人工手动去设置并提取我们的特征量,例如常见的SIFT、SURF和HOG等,随后需要我们选择合适的分类器(例如:SVM、KNN等分类器),接着把我们的参数训练出来。(2)而在神经网络的视角中:我们只需要把图片喂给它

- 【计算机网络】第三章:数据链路层(上)

iFulling

计算机网络笔记计算机网络网络网络协议笔记

本篇笔记课程来源:王道计算机考研计算机网络接下节:【计算机网络】第三章:数据链路层(下)【计算机网络】第三章:数据链路层(上)一、数据链路层的功能1.基本概念2.功能总览二、组帧(封装成帧)1.主要实现2.字符计数法3.字节填充法4.零比特填充法5.违规编码法三、差错控制1.主要实现2.检错编码Ⅰ.奇偶校验码Ⅱ.循环冗余校验码3.纠错编码Ⅰ.海明校验码四、流量控制、可靠传输1.相关机制Ⅰ.滑动窗口

- C练题笔记之:Leetcode-393. UTF-8 编码验证

月团子

c语言leetcode算法

题目:给定一个表示数据的整数数组data,返回它是否为有效的UTF-8编码。UTF-8中的一个字符可能的长度为1到4字节,遵循以下的规则:对于1字节的字符,字节的第一位设为0,后面7位为这个符号的unicode码。对于n字节的字符(n>1),第一个字节的前n位都设为1,第n+1位设为0,后面字节的前两位一律设为10。剩下的没有提及的二进制位,全部为这个符号的unicode码。这是UTF-8编码的工

- [特殊字符] AlphaGo:“神之一手”背后的智能革命与人机博弈新纪元

大千AI助手

人工智能Python#OTHER人工智能算法数据挖掘机器学习alphagogoogle围棋

从围棋棋盘到科学前沿的通用人工智能范式突破本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!一、核心定义与历史意义AlphaGo是由谷歌DeepMind团队开发的围棋人工智能程序,其里程碑意义在于:首破人类围棋壁垒:2016年以4:1击败世界冠军李世石九段,成为首个在完整对局中战胜人类顶尖棋手的AI。

- 量化价值投资中的深度学习技术:TensorFlow实战

量化价值投资中的深度学习技术:TensorFlow实战关键词:量化价值投资,深度学习,TensorFlow,股票预测,因子模型,LSTM神经网络,量化策略摘要:本文将带你走进"量化价值投资"与"深度学习"的交叉地带,用小学生都能听懂的语言解释复杂概念,再通过手把手的TensorFlow实战案例,教你如何用AI技术挖掘股票市场中的价值宝藏。我们会从传统价值投资的痛点出发,揭示深度学习如何像"超级分析

- 【人工智能】Spring AI Alibaba,一个面向 Java 开发者的开源框架,它旨在简化将人工智能(AI)功能集成到应用程序中的过程。

本本本添哥

A-AIGC人工智能大模型人工智能javaspring

一、SpringAIAlibaba介绍SpringAIAlibaba是一个面向Java开发者的开源框架,它旨在简化将人工智能(AI)功能集成到应用程序中的过程。该项目基于SpringAI构建,并且是阿里云通义系列模型及服务在JavaAI应用开发领域的最佳实践。SpringAIAlibaba的目标是为开发者提供一套高层次的AIAPI抽象以及与云原生基础设施的深度集成方案,从而帮助他们快速构建智能应用

- 模型融合与人机协同:构建人机共生的智能未来

AI天才研究院

AgenticAI实战计算AI人工智能与大数据计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

1.背景介绍在科技日新月异的今天,人工智能(AI)已经成为了我们生活中不可或缺的一部分。从智能手机,到自动驾驶汽车,再到医疗诊断,AI的应用已经渗透到了我们生活的方方面面。然而,尽管AI的发展已经取得了显著的成就,但是我们仍然面临着一个重大的挑战:如何让AI系统更好地理解和适应人类的需求,以实现人机共生的智能未来。为了解决这个问题,越来越多的研究者开始探索模型融合和人机协同的方法。2.核心概念与联

- vLLM 优化与调优:提升模型性能的关键策略

强哥之神

人工智能深度学习计算机视觉deepseek智能体vllm

在当今人工智能领域,大语言模型(LLM)的应用日益广泛,而优化和调优这些模型的性能成为了至关重要的任务。vLLM作为一种高效的推理引擎,提供了多种策略来提升模型的性能。本文将深入探讨vLLMV1的优化与调优策略,帮助读者更好地理解和应用这些技术。抢占式调度(Preemption)由于Transformer架构的自回归特性,有时键值缓存(KVcache)空间不足以处理所有批量请求。在这种情况下,vL

- 爬虫小结

Crescent_P

python小项目python数据分析

python爬虫小组作业上周布置了python的小组作业,每一组要求爬取老师指定的信息,本组抽到的题目如下:从中国银行网址:http://www.boc.cn/sourcedb/whpj/获取主要外汇(美元、欧元、英镑、加拿大元、澳大利亚元、日元、韩元、新台币、澳门元和港币)的牌价信息,计算出它们的每天平均价。要求把今年5月份每天平均价格保存到Excel文件中,每种外汇的数据保存在一个工作表中,并

- Spring Data Neo4j 与后端人工智能算法的数据交互

AI大模型应用实战

springneo4j人工智能ai

SpringDataNeo4j与后端人工智能算法的数据交互关键词:SpringDataNeo4j、图数据库、人工智能算法、数据交互、知识图谱、图神经网络、数据集成摘要:本文深入探讨了如何利用SpringDataNeo4j框架实现后端人工智能算法与图数据库的高效数据交互。文章首先介绍了图数据库和人工智能算法的基本概念,然后详细解析了SpringDataNeo4j的核心架构和原理。接着,通过实际代码示

- ResNet:深度卷积神经网络的里程碑

心想事“程”

小知识点cnn人工智能神经网络

一、引言在深度学习的发展历程中,深度卷积神经网络(CNN)不断演进,旨在提升对图像等数据的特征提取与分类能力。然而,随着网络层数的增加,传统CNN面临着梯度消失、梯度爆炸以及退化等棘手问题,训练变得愈发困难。2015年,由微软研究院提出的ResNet(ResidualNetworks,残差网络)横空出世,它以独特的残差学习思想,成功攻克了这些难题,在ImageNet竞赛中大放异彩,开创了深度神经网

- 视觉算法之卷积神经网络

清风AI

深度学习算法详解及代码复现计算机视觉cnn神经网络深度学习python课程设计毕业设计

定义与特点卷积神经网络(ConvolutionalNeuralNetwork,CNN)是一种专为处理具有网格结构的数据而设计的深度学习模型。其独特的结构和功能使其在图像处理、语音识别等领域展现出卓越的性能:CNN的核心设计理念源于对生物视觉系统的模仿。通过模拟大脑皮层中视网膜和视觉皮层的层次化结构,CNN能够有效地捕捉图像中的局部特征并逐步抽象为高层语义信息。这种设计使得CNN特别擅长处理图像和音

- 卷积神经网络架构的演进:从AlexNet到EfficientNet

t0_54manong

大数据与人工智能cnn架构人工智能个人开发

在过去的8.5年里,深度学习取得了飞速的进步。回溯到2012年,AlexNet在ImageNet上的Top-1准确率仅为63.3%,而如今,借助EfficientNet架构和师生训练法,我们已经能达到超过90%的准确率。本文将聚焦于卷积神经网络(CNN)架构的演变,深入探究其背后的基本原理。一些关键术语在深入了解各种架构之前,我们需要明确几个关键术语。更宽的网络意味着卷积层中有更多的特征图(滤波器

- 【AI大模型】深入解析预训练:大模型时代的核心引擎

我爱一条柴ya

学习AI记录深度学习人工智能aipythonAI编程算法

预训练已成为现代人工智能,尤其是自然语言处理和计算机视觉领域的基石技术。它彻底改变了模型开发范式,催生了BERT、GPT等革命性模型。本文将系统阐述预训练的核心概念、原理、方法、应用及挑战。一、预训练的本质:为何需要它?核心问题:数据标注的瓶颈监督学习依赖海量高质量标注数据,获取成本极高(时间、金钱、专业知识)。对于复杂任务(如理解语义、生成文本),标注难度呈指数级上升。标注数据稀缺导致模型泛化能

- 广州曼顿2P数字微断:保护电力设备的安全守护者

mdkk678

安全

在现代社会,电力设备的安全运行对各行各业至关重要。然而,电力系统中存在各种电压波动、过载和短路等问题,可能对设备造成损害。为了保护电力设备免受这些问题的影响,广州曼顿推出了2P数字微断器。本文将介绍这一创新产品的特点和优势,以及它对电力设备的保护作用。广州曼顿科技有限公司专注用户侧智慧数字电气产品研制,以及智慧电能服务大数据云平台建设。基于人工智能技术,大幅提升人触电时的生命安全保障,以及电气火灾

- Python通关秘籍之基础教程(一)

Smile丶Life丶

Python通关指南:从零基础到高手之路python开发语言后端

引言在编程的世界里,Python就像一位温和而强大的导师,它以简洁优雅的语法和强大的功能吸引着无数初学者和专业人士。无论你是想开发网站、分析数据、构建人工智能,还是仅仅想学习编程思维,Python都是你的理想选择。Python的魅力在于它的易读性和广泛的应用场景。它的代码就像英语句子一样自然,即使是完全没有编程经验的人也能快速上手。同时,Python拥有庞大的生态系统,从Web开发(Django、

- 多模态大模型发展全景:从架构创新到应用突破

陈敬雷-充电了么-CEO兼CTO

python大模型多模态大模型AIGC机器学习深度学习DeepSeek

注:此文章内容均节选自充电了么创始人,CEO兼CTO陈敬雷老师的新书《GPT多模态大模型与AIAgent智能体》(跟我一起学人工智能)【陈敬雷编著】【清华大学出版社】《GPT多模态大模型与AIAgent智能体》新出书籍配套视频【陈敬雷】推荐算法系统实战全系列精品课【陈敬雷】文章目录GPT多模态大模型系列四多模态大模型发展全景:从架构创新到应用突破更多技术内容总结GPT多模态大模型系列四多模态大模型

- 一文搞懂 Cursor 内部工作原理~

zz_jesse

介绍了Cursor,一个结合了AI技术的代码编辑器,它通过深度学习和语义索引的方式,提升了开发者的工作效率。Cursor通过与VSCode相似的界面和功能,以及自己的AI特性,实现了代码的智能化编辑和错误检查。译文从这开始~~你可能已经看到新闻:OpenAI正以高达30亿美元的价格收购Windsurf!与此同时,Cursor的母公司Anysphere也正在以90亿美元估值融资9亿美元!这对于代码生

- 开源人工神经网络库(OpenANN)

deepdata_cn

人工智能神经网络

OpenANN(OpenANN,OpenArtificialNeuralNetworkLibrary)是一个开源的人工神经网络库,基于C++编写,依赖Eigen3库进行高效的矩阵运算,使用CMake进行项目构建,支持多种神经网络架构,包括前馈神经网络、卷积神经网络和循环神经网络等,适用于图像识别、自然语言处理、时间序列预测等多种场景。提供数据预处理、模型保存和加载、超参数优化等功能。支持GPU加速

- 如何创建Python工程目录

九月恒心

Pythonpython自动测试

如何创建一个简单但是比较规范的python工程目录,本文是学习了LearnPythontheHardWay相关内容后做的一些笔记。安装python第三方包1.pipfromhttp://pypi.python.org/pypi/pip用于安装python第三方包的工具2.distributefromhttp://pypi.python.org/pypi/distribute已被弃用,是SetupT

- Java实现的简单双向Map,支持重复Value

superlxw1234

java双向map

关键字:Java双向Map、DualHashBidiMap

有个需求,需要根据即时修改Map结构中的Value值,比如,将Map中所有value=V1的记录改成value=V2,key保持不变。

数据量比较大,遍历Map性能太差,这就需要根据Value先找到Key,然后去修改。

即:既要根据Key找Value,又要根据Value

- PL/SQL触发器基础及例子

百合不是茶

oracle数据库触发器PL/SQL编程

触发器的简介;

触发器的定义就是说某个条件成立的时候,触发器里面所定义的语句就会被自动的执行。因此触发器不需要人为的去调用,也不能调用。触发器和过程函数类似 过程函数必须要调用,

一个表中最多只能有12个触发器类型的,触发器和过程函数相似 触发器不需要调用直接执行,

触发时间:指明触发器何时执行,该值可取:

before:表示在数据库动作之前触发

- [时空与探索]穿越时空的一些问题

comsci

问题

我们还没有进行过任何数学形式上的证明,仅仅是一个猜想.....

这个猜想就是; 任何有质量的物体(哪怕只有一微克)都不可能穿越时空,该物体强行穿越时空的时候,物体的质量会与时空粒子产生反应,物体会变成暗物质,也就是说,任何物体穿越时空会变成暗物质..(暗物质就我的理

- easy ui datagrid上移下移一行

商人shang

js上移下移easyuidatagrid

/**

* 向上移动一行

*

* @param dg

* @param row

*/

function moveupRow(dg, row) {

var datagrid = $(dg);

var index = datagrid.datagrid("getRowIndex", row);

if (isFirstRow(dg, row)) {

- Java反射

oloz

反射

本人菜鸟,今天恰好有时间,写写博客,总结复习一下java反射方面的知识,欢迎大家探讨交流学习指教

首先看看java中的Class

package demo;

public class ClassTest {

/*先了解java中的Class*/

public static void main(String[] args) {

//任何一个类都

- springMVC 使用JSR-303 Validation验证

杨白白

springmvc

JSR-303是一个数据验证的规范,但是spring并没有对其进行实现,Hibernate Validator是实现了这一规范的,通过此这个实现来讲SpringMVC对JSR-303的支持。

JSR-303的校验是基于注解的,首先要把这些注解标记在需要验证的实体类的属性上或是其对应的get方法上。

登录需要验证类

public class Login {

@NotEmpty

- log4j

香水浓

log4j

log4j.rootCategory=DEBUG, STDOUT, DAILYFILE, HTML, DATABASE

#log4j.rootCategory=DEBUG, STDOUT, DAILYFILE, ROLLINGFILE, HTML

#console

log4j.appender.STDOUT=org.apache.log4j.ConsoleAppender

log4

- 使用ajax和history.pushState无刷新改变页面URL

agevs

jquery框架Ajaxhtml5chrome

表现

如果你使用chrome或者firefox等浏览器访问本博客、github.com、plus.google.com等网站时,细心的你会发现页面之间的点击是通过ajax异步请求的,同时页面的URL发生了了改变。并且能够很好的支持浏览器前进和后退。

是什么有这么强大的功能呢?

HTML5里引用了新的API,history.pushState和history.replaceState,就是通过

- centos中文乱码

AILIKES

centosOSssh

一、CentOS系统访问 g.cn ,发现中文乱码。

于是用以前的方式:yum -y install fonts-chinese

CentOS系统安装后,还是不能显示中文字体。我使用 gedit 编辑源码,其中文注释也为乱码。

后来,终于找到以下方法可以解决,需要两个中文支持的包:

fonts-chinese-3.02-12.

- 触发器

baalwolf

触发器

触发器(trigger):监视某种情况,并触发某种操作。

触发器创建语法四要素:1.监视地点(table) 2.监视事件(insert/update/delete) 3.触发时间(after/before) 4.触发事件(insert/update/delete)

语法:

create trigger triggerName

after/before

- JS正则表达式的i m g

bijian1013

JavaScript正则表达式

g:表示全局(global)模式,即模式将被应用于所有字符串,而非在发现第一个匹配项时立即停止。 i:表示不区分大小写(case-insensitive)模式,即在确定匹配项时忽略模式与字符串的大小写。 m:表示

- HTML5模式和Hashbang模式

bijian1013

JavaScriptAngularJSHashbang模式HTML5模式

我们可以用$locationProvider来配置$location服务(可以采用注入的方式,就像AngularJS中其他所有东西一样)。这里provider的两个参数很有意思,介绍如下。

html5Mode

一个布尔值,标识$location服务是否运行在HTML5模式下。

ha

- [Maven学习笔记六]Maven生命周期

bit1129

maven

从mvn test的输出开始说起

当我们在user-core中执行mvn test时,执行的输出如下:

/software/devsoftware/jdk1.7.0_55/bin/java -Dmaven.home=/software/devsoftware/apache-maven-3.2.1 -Dclassworlds.conf=/software/devs

- 【Hadoop七】基于Yarn的Hadoop Map Reduce容错

bit1129

hadoop

运行于Yarn的Map Reduce作业,可能发生失败的点包括

Task Failure

Application Master Failure

Node Manager Failure

Resource Manager Failure

1. Task Failure

任务执行过程中产生的异常和JVM的意外终止会汇报给Application Master。僵死的任务也会被A

- 记一次数据推送的异常解决端口解决

ronin47

记一次数据推送的异常解决

需求:从db获取数据然后推送到B

程序开发完成,上jboss,刚开始报了很多错,逐一解决,可最后显示连接不到数据库。机房的同事说可以ping 通。

自已画了个图,逐一排除,把linux 防火墙 和 setenforce 设置最低。

service iptables stop

- 巧用视错觉-UI更有趣

brotherlamp

UIui视频ui教程ui自学ui资料

我们每个人在生活中都曾感受过视错觉(optical illusion)的魅力。

视错觉现象是双眼跟我们开的一个玩笑,而我们往往还心甘情愿地接受我们看到的假象。其实不止如此,视觉错现象的背后还有一个重要的科学原理——格式塔原理。

格式塔原理解释了人们如何以视觉方式感觉物体,以及图像的结构,视角,大小等要素是如何影响我们的视觉的。

在下面这篇文章中,我们首先会简单介绍一下格式塔原理中的基本概念,

- 线段树-poj1177-N个矩形求边长(离散化+扫描线)

bylijinnan

数据结构算法线段树

package com.ljn.base;

import java.util.Arrays;

import java.util.Comparator;

import java.util.Set;

import java.util.TreeSet;

/**

* POJ 1177 (线段树+离散化+扫描线),题目链接为http://poj.org/problem?id=1177

- HTTP协议详解

chicony

http协议

引言

- Scala设计模式

chenchao051

设计模式scala

Scala设计模式

我的话: 在国外网站上看到一篇文章,里面详细描述了很多设计模式,并且用Java及Scala两种语言描述,清晰的让我们看到各种常规的设计模式,在Scala中是如何在语言特性层面直接支持的。基于文章很nice,我利用今天的空闲时间将其翻译,希望大家能一起学习,讨论。翻译

- 安装mysql

daizj

mysql安装

安装mysql

(1)删除linux上已经安装的mysql相关库信息。rpm -e xxxxxxx --nodeps (强制删除)

执行命令rpm -qa |grep mysql 检查是否删除干净

(2)执行命令 rpm -i MySQL-server-5.5.31-2.el

- HTTP状态码大全

dcj3sjt126com

http状态码

完整的 HTTP 1.1规范说明书来自于RFC 2616,你可以在http://www.talentdigger.cn/home/link.php?url=d3d3LnJmYy1lZGl0b3Iub3JnLw%3D%3D在线查阅。HTTP 1.1的状态码被标记为新特性,因为许多浏览器只支持 HTTP 1.0。你应只把状态码发送给支持 HTTP 1.1的客户端,支持协议版本可以通过调用request

- asihttprequest上传图片

dcj3sjt126com

ASIHTTPRequest

NSURL *url =@"yourURL";

ASIFormDataRequest*currentRequest =[ASIFormDataRequest requestWithURL:url];

[currentRequest setPostFormat:ASIMultipartFormDataPostFormat];[currentRequest se

- C语言中,关键字static的作用

e200702084

C++cC#

在C语言中,关键字static有三个明显的作用:

1)在函数体,局部的static变量。生存期为程序的整个生命周期,(它存活多长时间);作用域却在函数体内(它在什么地方能被访问(空间))。

一个被声明为静态的变量在这一函数被调用过程中维持其值不变。因为它分配在静态存储区,函数调用结束后并不释放单元,但是在其它的作用域的无法访问。当再次调用这个函数时,这个局部的静态变量还存活,而且用在它的访

- win7/8使用curl

geeksun

win7

1. WIN7/8下要使用curl,需要下载curl-7.20.0-win64-ssl-sspi.zip和Win64OpenSSL_Light-1_0_2d.exe。 下载地址:

http://curl.haxx.se/download.html 请选择不带SSL的版本,否则还需要安装SSL的支持包 2. 可以给Windows增加c

- Creating a Shared Repository; Users Sharing The Repository

hongtoushizi

git

转载自:

http://www.gitguys.com/topics/creating-a-shared-repository-users-sharing-the-repository/ Commands discussed in this section:

git init –bare

git clone

git remote

git pull

git p

- Java实现字符串反转的8种或9种方法

Josh_Persistence

异或反转递归反转二分交换反转java字符串反转栈反转

注:对于第7种使用异或的方式来实现字符串的反转,如果不太看得明白的,可以参照另一篇博客:

http://josh-persistence.iteye.com/blog/2205768

/**

*

*/

package com.wsheng.aggregator.algorithm.string;

import java.util.Stack;

/**

- 代码实现任意容量倒水问题

home198979

PHP算法倒水

形象化设计模式实战 HELLO!架构 redis命令源码解析

倒水问题:有两个杯子,一个A升,一个B升,水有无限多,现要求利用这两杯子装C

- Druid datasource

zhb8015

druid

推荐大家使用数据库连接池 DruidDataSource. http://code.alibabatech.com/wiki/display/Druid/DruidDataSource DruidDataSource经过阿里巴巴数百个应用一年多生产环境运行验证,稳定可靠。 它最重要的特点是:监控、扩展和性能。 下载和Maven配置看这里: http

- 两种启动监听器ApplicationListener和ServletContextListener

spjich

javaspring框架

引言:有时候需要在项目初始化的时候进行一系列工作,比如初始化一个线程池,初始化配置文件,初始化缓存等等,这时候就需要用到启动监听器,下面分别介绍一下两种常用的项目启动监听器

ServletContextListener

特点: 依赖于sevlet容器,需要配置web.xml

使用方法:

public class StartListener implements

- JavaScript Rounding Methods of the Math object

何不笑

JavaScriptMath

The next group of methods has to do with rounding decimal values into integers. Three methods — Math.ceil(), Math.floor(), and Math.round() — handle rounding in differen

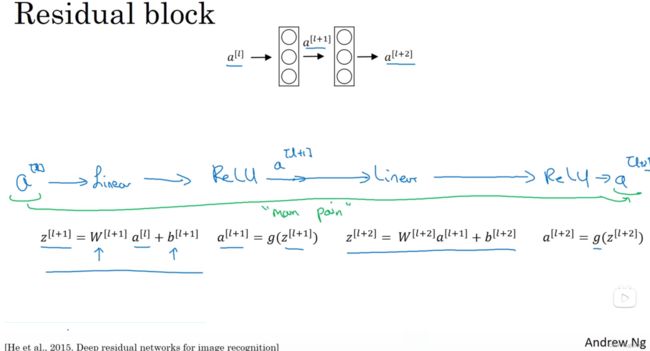

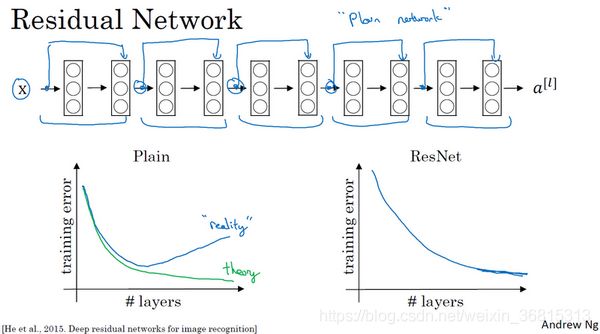

![]() 层进行激活,得到

层进行激活,得到![]() ,再次进行激活,两层之后得到

,再次进行激活,两层之后得到![]() 。所以计算过程是从

。所以计算过程是从![]() 开始,然后首先进行线性激活,根据这个公式:

开始,然后首先进行线性激活,根据这个公式:![]() ,通过

,通过![]() 算出

算出![]() ,即

,即![]() 乘以权重矩阵,再加上偏差因子。然后通过ReLU非线性激活函数得到

乘以权重矩阵,再加上偏差因子。然后通过ReLU非线性激活函数得到![]() ,通过等式

,通过等式 ![]() 计算得出。然后在下一层,接着再次进行线性激活,依据等式

计算得出。然后在下一层,接着再次进行线性激活,依据等式![]() ,最后根据这个等式再次进行ReLu非线性激活,即

,最后根据这个等式再次进行ReLu非线性激活,即![]() ,这里的

,这里的 ![]() 指的是ReLU非线性函数,得到的结果就是

指的是ReLU非线性函数,得到的结果就是 ![]() 。换句话说,信息流从

。换句话说,信息流从 ![]() 到

到 ![]() 需要经过以上所有步骤,即这组网络层的主路径。

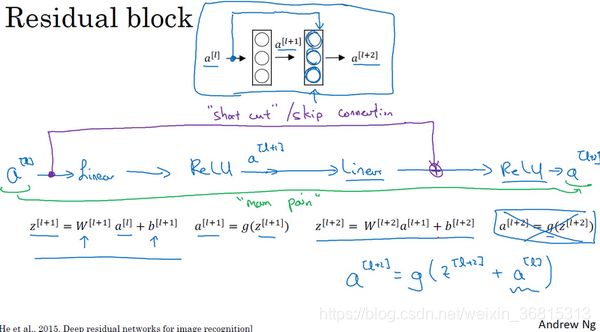

需要经过以上所有步骤,即这组网络层的主路径。![]() 直接向后,拷贝到神经网络的深层,在应用一些非线性处理,比如在ReLU非线性激活函数前加上

直接向后,拷贝到神经网络的深层,在应用一些非线性处理,比如在ReLU非线性激活函数前加上![]() 。我们把它叫做一条捷径short cut 。

。我们把它叫做一条捷径short cut 。![]() 的信息直接到达神经网络的深层,不再沿着主路径传递,这就意味着最后这个等式

的信息直接到达神经网络的深层,不再沿着主路径传递,这就意味着最后这个等式 ![]() 去掉了,取而代之的是另一个ReLU非线性函数:仍然对

去掉了,取而代之的是另一个ReLU非线性函数:仍然对 ![]() 进行

进行 ![]() 函数处理,但这次要加上

函数处理,但这次要加上 ![]() ,即:

,即:![]() ,也就是加上的这个

,也就是加上的这个![]() 产生了一个残差块。

产生了一个残差块。![]() 插入的时机是在线性激活之后,ReLU激活之前。有时它不叫“捷径”,你还会听到另一个术语“跳跃连接”,就是指

插入的时机是在线性激活之后,ReLU激活之前。有时它不叫“捷径”,你还会听到另一个术语“跳跃连接”,就是指 ![]() 跳过一层或者好几层,从而将信息传递到神经网络的更深层。

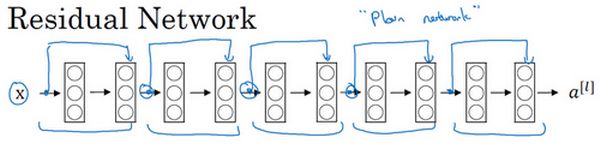

跳过一层或者好几层,从而将信息传递到神经网络的更深层。![]() 的激活,或者这些中间层的激活输出能够到达网络的更深层。这种方式确实有助于解决梯度消失和梯度爆炸问题,让我们在训练更深网络的同时,不会看到性能倒退的现象,又能保证良好的性能。尽管可能在某一点达到“平原”阶段。这时候再加层也不会有帮助。也许从另外一个角度来看,随着网络越来深,网络连接会变得臃肿,但是ResNet确实在训练深度网络方面非常有效。

的激活,或者这些中间层的激活输出能够到达网络的更深层。这种方式确实有助于解决梯度消失和梯度爆炸问题,让我们在训练更深网络的同时,不会看到性能倒退的现象,又能保证良好的性能。尽管可能在某一点达到“平原”阶段。这时候再加层也不会有帮助。也许从另外一个角度来看,随着网络越来深,网络连接会变得臃肿,但是ResNet确实在训练深度网络方面非常有效。