Pytorch基本数据操作(Tensor的运算)【深度学习从0到1】

Pytorch基础数据操作

在深度学习中,我们经常会需要处理许多数据,本节阿远学长将讲述如何对内存中的数据进行操作。

在PyTorch中,我们主要通过torch.Tensor对数据进行存储和变换操作,使用过numpy库的我们就可以发现,tensor和numpy里的多维数组十分相似。但是由于tensor提供GPU计算和自动求梯度等功能从而更适合深度学习。

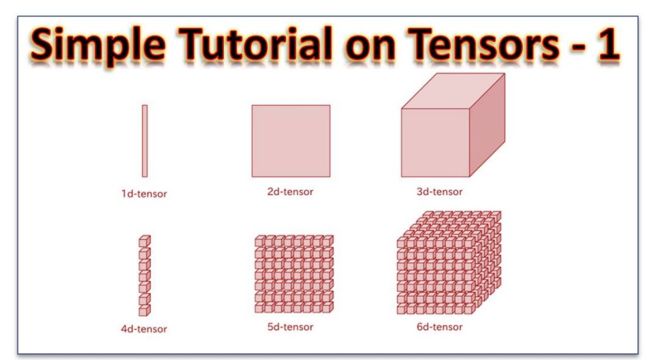

"tensor"我们通常译为“张量”,张量可以看作多维数组,标量可以看作为0维张量,向量可以看作为1维张量,矩阵可以看作为2维张量。

创建Tensor

对于tensor的创建,首先我们要导入PyTorch

import pytorch

然后我们创建一个5 × \times × 3未初始化的Tensor:

x=torch.empty(5,6)

print(x)

输出为:

tensor([[4.9592e-39, 4.2246e-39, 1.0286e-38],

[1.0653e-38, 1.0194e-38, 8.4490e-39],

[1.0469e-38, 9.3674e-39, 9.9184e-39],

[8.7245e-39, 9.2755e-39, 8.9082e-39],

[9.9184e-39, 8.4490e-39, 9.6429e-39]])

创建一个随机初始化的5 × \times × 3的Tensor:

x=torch.rand(5,3)

print(x)

输出为:

tensor([[0.0674, 0.7582, 0.2703],

[0.0939, 0.9115, 0.5989],

[0.9999, 0.7047, 0.2251],

[0.8123, 0.6745, 0.1700],

[0.6609, 0.3971, 0.1377]])

创建一个5 × \times × 3的long型(64位整型)全0的Tensor:

x=torch.zeros(5,3,dtype=torch.long)

print(x)

输出为:

tensor([[0, 0, 0],

[0, 0, 0],

[0, 0, 0],

[0, 0, 0],

[0, 0, 0]])

如果我们想直接通过我们自己的数据创建tensor也是可以的:

x=torch.tensor([[1,6.5,6],

[6,22,1.333]])

print(x)

输出为:

tensor([[ 1.0000, 6.5000, 6.0000],

[ 6.0000, 22.0000, 1.3330]])

还可以通过我们已经创建好的tensor来创建,此方法会默认重用输入tensor的一些属性,例如数据类型,除非我们重新自定义数据类型。

x = x.new_ones(5, 3, dtype=torch.float64) # 返回的tensor默认具有相同的torch.dtype和torch.device

print(x)

x = torch.randn_like(x, dtype=torch.float) # 指定新的数据类型

print(x)

输出为:

tensor([[1., 1., 1.],

[1., 1., 1.],

[1., 1., 1.],

[1., 1., 1.],

[1., 1., 1.]], dtype=torch.float64)

tensor([[ 0.5700, -0.3750, 0.2913],

[-1.4587, -0.7925, -0.9140],

[ 1.0216, -1.1163, 1.6131],

[-1.4749, -0.3656, -0.1739],

[-0.5065, -2.0397, -0.0671]])

还有很多函数可以创建

tensor,官方文档中给出了非常详细的方案。

创建顺序的张量torch.arange():

返回大小为: ⌈ end-start step ⌉ \left\lceil\frac{\text { end-start }}{\text { step }}\right\rceil ⌈ step end-start ⌉的一维张量,其值介于区间 [ s t a r t , e n d ] [ start , end ] [start,end] ,以 step \text{step} step为步长等间隔取值。

torch.arange(1, 2.5, 0.5)

输出为:

tensor([1.0000, 1.5000, 2.0000])

获取tensor的信息

我们可以通过shape 或者 size() 来获取 Tensor 的形状

print(x.size())

print(x.shape)

输出为:

torch.Size([5, 3])

torch.Size([5, 3])

我们都可以在这些创建方法中,指定数据类型dtype和存放设备device,例如:

x_gpu = torch.tensor([[4.0, 1.0], [5.0, 3.0], [2.0, 1.0]], device='cuda')

Tensor的算数操作

在PyTorch中,同一种操作可能有很多种方法,下面用加法作为例子:

加法形式1

y = torch.rand(5, 3)

print(x + y)

加法形式2

print(torch.add(x, y))

若需指定输出:

result = torch.empty(5, 3)

torch.add(x, y, out=result)

print(result)

加法形式3

#将x加给y

y.add_(x)

print(y)

输出均为:

tensor([[ 0.7972, 0.2499, 0.6560],

[-0.5310, -0.4533, -0.1851],

[ 1.8219, -0.2076, 1.8410],

[-1.2647, -0.1520, -0.0296],

[ 0.2785, -1.6134, 0.5936]])

Tensor的索引操作

我们使用过NumPy的可以知道,NumPy可以通过索引来访问数组,同样地,我们可以在Tensor中实现相关操作。

y = x[0, :]

y += 1

print(y)

print(x[0, :]) # 源tensor也被改了

输出为:

tensor([1.5700, 0.6250, 1.2913])

tensor([1.5700, 0.6250, 1.2913])

需要注意的是:索引出来的结果与

原数据共享内存,也即修改⼀个,另⼀个会跟着修改。

对于一些高级选择函数,我们都可以从官方文档中查询其用法,例如:

返回张量中非0元素的下标torch.nonzero()

print(torch.nonzero(x))

输出为:

tensor([[0, 0],

[0, 1],

[0, 2],

[1, 0],

[1, 1],

[1, 2],

[2, 0],

[2, 1],

[2, 2],

[3, 0],

[3, 1],

[3, 2],

[4, 0],

[4, 1],

[4, 2]])

改变Tensor的形状

我们可以通过 view() 来改变 Tensor 的形状,相当于NumPy里resize()的功能

m=torch.tensor([-0.3623,-0.6115,0.7283,0.4699,2.3261,0.1599])

result1=m.view(3,2)

n=torch.tensor([[-0.3623,-0.6115],[0.7283,0.4699],[2.3261,0.1599]])

result2=n.view(2,-1)#-1所指的维度可以根据其他维度的值推出来

print(result1)

print(result2)

输出为:

tensor([[-0.3623, -0.6115],

[ 0.7283, 0.4699],

[ 2.3261, 0.1599]])

tensor([[-0.3623, -0.6115, 0.7283],

[ 0.4699, 2.3261, 0.1599]])

注意 view() 返回的新tensor与源tensor共享内存(其实是同⼀个tensor),也即更改其中的⼀个,另外⼀个也会跟着改变。

所以如果我们想返回⼀个真正新的副本(即不共享内存)该怎么办呢?

PyTorch还提供了⼀

个reshape()可以改变形状,但是此函数并不能保证返回的是其拷⻉,所以不推荐使⽤。推荐先

⽤clone()创造⼀个副本然后再使⽤view()。使⽤clone()还有⼀个好处是会被记录在计算图中,即梯度回传到副本时也会传到源Tensor。

m1 = result1.clone().view(6)

result1 -= 1

print(result1)

print(m1)

输出为:

tensor([[-0.3623, -0.6115],

[ 0.7283, 0.4699],

[ 2.3261, 0.1599]])

tensor([0.6377, 0.3885, 1.7283, 1.4699, 3.3261, 1.1599])

还有一个可以将标量Tensor转换成Python number的函数item()。

x = torch.randn(1)

print(x)

print(x.item())

输出为:

tensor([0.6064])

0.6063807010650635

PyTorch中的Tensor⽀持超过⼀百种操作,包括转置、索引、切⽚、数学运算、线性代数、随机数等等,我们都可以从官⽅⽂档参考。

https://pytorch.org/docs/stable/tensors.html