如果ChatGPT有1%的风险伤害你,你还会用它吗?超级智能值得恐惧吗

文|Gary Marcus

源|学术头条

“超级智能可能会即将到来,也可能不会。但无论如何,都有很多值得担心的事情。”

近日,人工智能领域内的 “叛逆者”、纽约大学心理学和神经科学荣誉教授 Gary Marcus 发文称,“我们需要停止担心机器人接管世界,而是更多地考虑那些坏人可能会利用 LLMs 做什么,以及我们可以做什么来阻止他们。”

此前,Marcus 与马斯克等上千人联名呼吁 “所有人工智能实验室应立即暂停训练比 GPT-4 更强大的大模型,这一时间至少为 6 个月”。

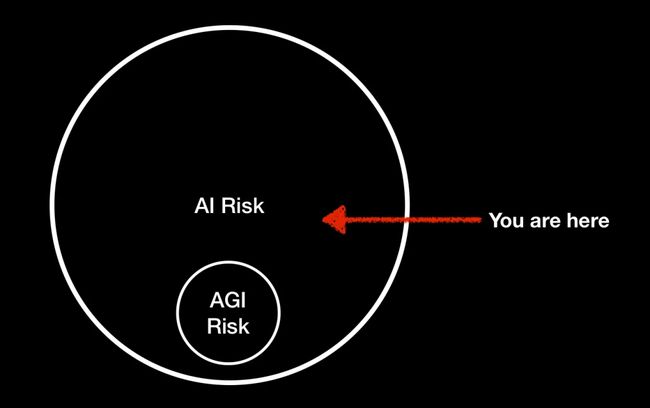

在 Marcus 看来,AI风险 ≠ AGI风险,尽管很多人将人工智能的风险等同于超级智能或 AGI 的风险,但并非只有超级智能才能造成严重的问题。如 Bing 和 GPT-4 等不可靠但被广泛部署的人工智能,也会对现实世界造成不可忽视的风险。

我们在不改变原文大意的情况下,对文章做了简单的编辑。

人工智能会杀死我们所有人吗?我不知道,你也不知道。

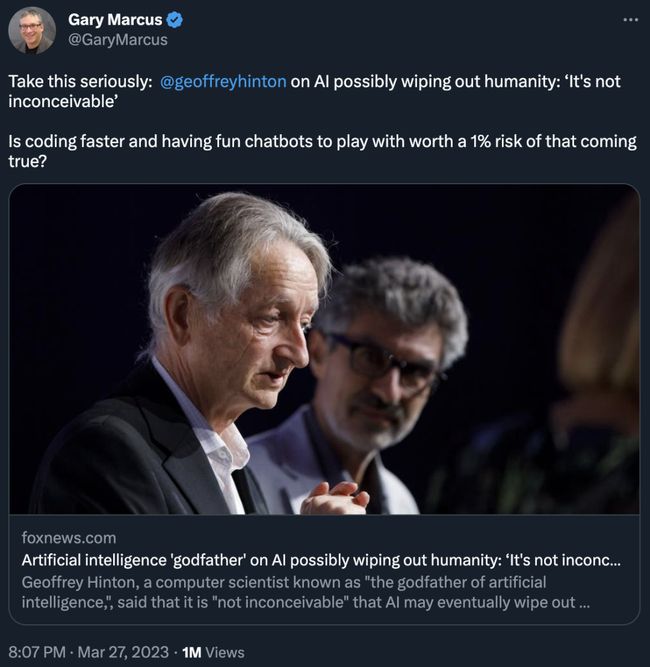

但 Geoff Hinton(深度学习三巨头之一)已经开始担心了,我也是。上周,我通过小道消息(the grapevine)听说了 Hinton 的担忧,他也已公开承认了。

Hinton 于近日接受了 CBS News 的采访,当被问及人工智能是否可能“消灭人类”时,他表示,“这并非不可想象(It's not inconceivable)。我只想说这些。”

在放大他的担忧后,我提出了一个思想实验:

编码速度更快、拥有有趣的聊天机器人,值得 1% 的风险来实现吗?

很快,数以百计的人,甚至马斯克也加入进来。

Hinton、马斯克和我,甚至很少能在同一件事情上达成部分意见一致。马斯克和我还在本周早些时候签署了一封来自生命未来研究所(FLI)的公开信。

公开信指出,最近几个月,人工智能实验室陷入了一场失控的竞赛,他们没有办法理解、预测或可靠地控制自己创造的大模型。人类社会对其可能造成的影响也没有做好准备。因此,Marcus 等人在公开信中呼吁,所有人工智能实验室应立刻暂停训练比 GPT-4 更强大的人工智能模型,这一时间至少为 6 个月。

自从我发布了这些推文后,我就一直受到反击和质疑。一些人认为我误解了 Hinton 的说法(鉴于我的独立来源,我很确定我没有);另一些人则抱怨我关注了一系列错误的风险(要么过于关注短期的,要么过于关注长期的)。

一位杰出的业内同行写信质问我:“这封公开信难道不会导致人们对即将到来的 AGI、超级智能等产生毫无道理的恐惧吗?” 一些人对我放大 Hinton 的担忧感到非常惊讶,以至于在推特上冒出了一整条猜测我自己信念的话题:

事实上,我的信念并没有改变。我仍然认为,大型语言模型(LLMs)与超级智能/通用人工智能(AGI)之间没什么关系;我与 Yann LeCun(深度学习三巨头之一)一样,仍然认为 LLMs 是通往 AGI 之路的一个 “匝道”。

我对最坏情况的设想也许与 Hinton 或马斯克的设想不同;据我所知,他们的设想似乎主要围绕着如果计算机迅速且彻底地实现自我改进会发生什么,我认为这不是一种当前的可能性。

我要讨论的问题是:尽管很多人将人工智能的风险等同于超级智能或 AGI 的风险,但并非只有超级智能才能造成严重的问题。

就当前而言,我并不担心 “AGI 风险”(我们无法控制的超级智能机器的风险),我担心的是我所说的 “MAI 风险”--不可靠(如 Bing 和 GPT-4)但被广泛部署的人工智能--无论是从使用它的人的数量,还是从软件对世界的访问来看。

某一家人工智能公司刚刚筹集了 3.5 亿美元来做这件事,允许 LLMs 访问几乎所有的东西(旨在通过 LLMs “增强你在世界任何软件工具或 API 上的能力”,尽管它们明显有幻觉和不可靠的倾向)。

很多普通人,也许智力高于平均水平,但不一定是天才级别的,在历史上创造了各种问题;在许多方面,关键的变量不是智力,而是权力。原则上说,一个拥有核密码的白痴可以毁灭世界,只需要不多的智力和不应有的访问权限。

如果 LLMs 可以从一个人手中骗到验证码,正如 OpenAI 最近观察到的那样,在一个坏人手中,这种能力可以制造各种混乱。当 LLMs 是实验室内满足人们好奇心的产物,只在该领域内为人所知时,它们不会构成什么大问题。但现在,它们广为人知,并引起了一些坏人的兴趣,它们越来越多地被赋予与外部世界(包括人类)的联系,它们可以造成更大的破坏。

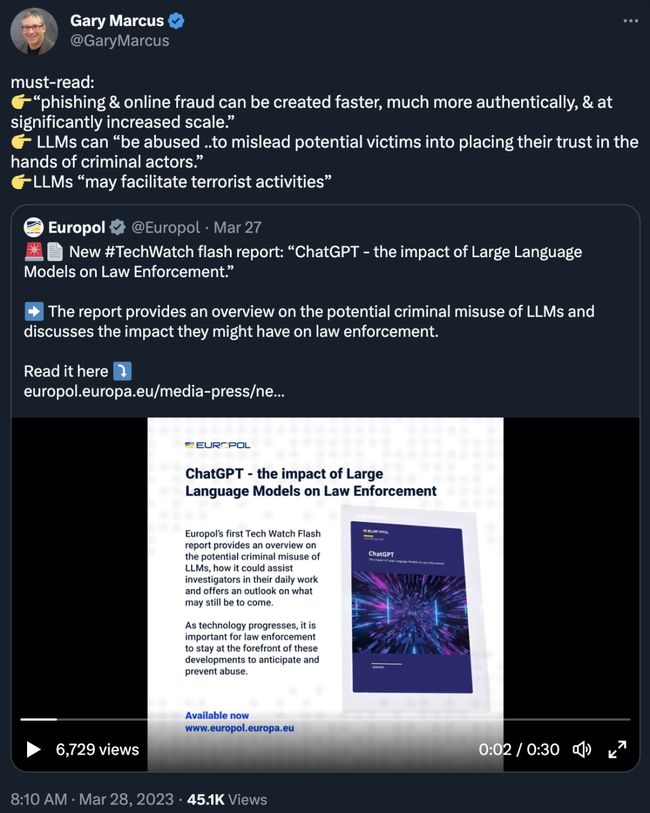

虽然人工智能社区经常关注长期风险,但我并不是唯一担心严重的、短期影响的人。欧洲刑警组织(Europol)发布了一份报告,考虑了一些犯罪的可能性,发人省醒。

他们强调了 LLMs 生成错误信息的能力。例如,网络钓鱼和在线欺诈可以更快、更真实地产生,而且规模明显扩大;LLMs 可以 “被滥用......误导潜在的受害者相信一些犯罪分子”。

除了上述犯罪活动外,ChatGPT 的能力也适合宣传和虚假信息领域的一些潜在滥用案例。

许多人可能死亡;文明可能被彻底破坏。也许人类不会真的 “从地球上消失”,但事情确实会变得非常糟糕。

这一切的可能性有多大?我们没有确切的答案。我说的 1% 也只是一个思想实验,但它不是 0。

“这并非不可想象”,Hinton 是完全正确的,我认为它既适用于 Eliezer Yudkowsky 等人所担心的一些长期情况,也适用于 Europol 和我所担心的一些短期情况。

真正的问题是控制。正如 Hinton 担心的那样,如果我们失去对可以自我改进的机器的控制会发生什么。我不知道我们什么时候会有这样的机器,但我知道我们对目前的人工智能没有足够的控制,尤其是现在人们可以把它们与现实世界的软件 API 连接起来。

我们需要停止担心机器人接管世界,而是更多地考虑那些坏人可能会利用 LLMs 做什么,以及如果有的话,我们可以做什么来阻止他们。

然而,我们也需要将 LLMs 视为未来智能的一点 “星星之火”,并扪心自问 “我们究竟要对未来的技术做些什么,这些技术很可能更加难以控制”。

Hinton 在接受 CBS News 采访时说,“我认为人们现在担心这些问题是非常合理的,尽管它不会在未来一两年内发生”,我深表赞同。

这不是一个非此即彼的情况;目前的技术已经带来了巨大的风险,我们对此准备不足。随着未来技术的发展,事情很可能变得更糟。批评人们关注 “错误的风险” 对任何人都没有帮助;已经有足够多的风险了。

所有人都要行动起来。

暂停 6 个月?反击开始

在 Marcus 与马斯克等上千人联名呼吁至少暂停大模型研究 6 个月后,业内人士有赞同,有反对。其中,反对方就包括人工智能知名学者吴恩达。

吴恩达认为,暂停研究比 GPT-4 更强大的人工智能模型是 “一个可怕的想法”。

“我看到 GPT-4 在教育、医疗、食品等方面有许多新的应用,这将帮助许多人。改进 GPT-4 将有所帮助。我们需要平衡人工智能正在创造的巨大价值与现实的风险。”

同时,吴恩达表示,除非政府介入,否则没有现实的方法来实施暂停并阻止所有团队扩大 LLMs 的规模。让政府暂停他们不了解的新兴技术是反竞争的,这会树立一个可怕的先例,是可怕的创新政策。

另外,负责任的人工智能很重要,人工智能也有风险。媒体普遍认为,人工智能公司正在疯狂地生成不安全的代码,这不是事实。绝大多数(可悲的是,不是所有)人工智能团队都认真对待负责任的人工智能和安全。

“6 个月的暂停期并不是一个实用的建议。为了促进人工智能的安全,围绕透明度和审计的法规将更加实用,并产生更大的影响。在推动技术发展的同时,让我们也对安全进行更多的投资,而不是扼杀进步。”

在 Hacker News 上看到这样一句话,“你无法阻止此类研究的发生。你只能阻止有道德的人做那种研究。我宁愿让有道德的人继续去做这些研究。”

对此,你怎么看?

加入卖萌屋NLP、CV、搜推广与求职讨论群