- 大数据小白系列——YARN(1)

weixin_44386638

大数据大数据人工智能机器学习数据挖掘数据分析

这是大数据小白系列,YARN的第一篇,准确的说是介绍YARN的“前身”,即MapReduce第一版(下称MRv1)中的资源管理系统。之前准备忽略这部分的内容,毕竟MRv1已经过时了,但为方便后续介绍YARN,这里还是(并不深入地)讲一讲。Q:为什么需要一个资源管理系统?A:在一个具有成百上千节点的集群上(这很常见),资源管理十分重要,一个好的资源管理系统可以充分发挥各节点的能力,避免一些节点忙碌,

- TaskManager的JVM OOM退出配置

艾丽丝的爱情

jvm大数据

在大数据领域中,TaskManager是执行并行任务的关键组件之一。它负责管理任务的执行和资源分配。在处理大规模数据时,内存管理是一个重要的考虑因素。当TaskManager的Java虚拟机(JVM)遇到内存不足的情况时,可以通过配置相应的参数来控制其行为。本文将介绍如何配置TaskManager的JVM,以便在OOM(内存溢出)发生时退出。OOM(OutofMemory)是指在程序运行过程中,J

- JVM垃圾回收器的原理和调优详解!

喵手

零基础学Javajvm

全文目录:开篇语前言摘要概述垃圾回收器分类及原理1.Serial垃圾回收器2.Parallel垃圾回收器3.CMS垃圾回收器4.G1垃圾回收器源码解析示例代码使用案例分享案例1:Web服务的GC调优案例2:大数据任务的GC优化应用场景案例垃圾回收调优策略优缺点分析优点缺点核心类方法介绍测试用例小结总结文末开篇语哈喽,各位小伙伴们,你们好呀,我是喵手。运营社区:C站/掘金/腾讯云/阿里云/华为云/5

- EmEditort v24.5.3世界上最快的文本编辑器

jiamianAA

经验分享电脑

下载:https://pan.quark.cn/s/16d827576a06EmEditor–支持大文件和Unicode的最佳Windows文本编辑器。号称世界上最快的文本编辑器!EmEditor是一款快速,轻巧,可扩展,使用方便的Windows代码编辑器。支持宏,Unicode,代码段插件,还能处理大数据以及CSV文件,无需Excel,堪称最强CSV编辑器。软件自带简体中文,支持32位和64位版

- Crawl4AI:用几行代码打造强大的网页爬虫

海豹工匠

爬虫

Crawl4AI:用几行代码打造强大的网页爬虫在人工智能和大数据时代,数据的获取和处理变得尤为重要。尤其是在大型语言模型(LLM)的研究和应用中,如何高效地抓取和整理网络数据成为了一个关键的挑战。为了解决这一问题,一个名为Crawl4AI的开源网页爬虫工具应运而生,它专为LLM优化,提供了一种简单易用且功能强大的数据抓取解决方案。什么是Crawl4AI?Crawl4AI是一个基于LLM的开源网页爬

- 大数据技术之MapReduce

wespten

HadoopHiveSpark大数据安全大数据mapreducehadoop

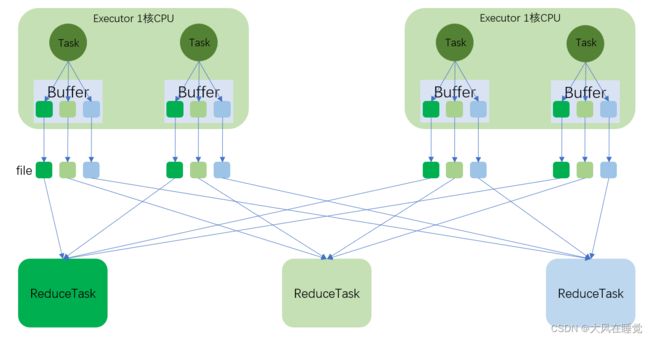

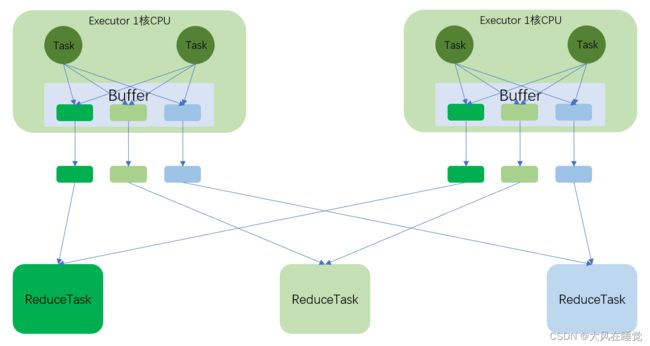

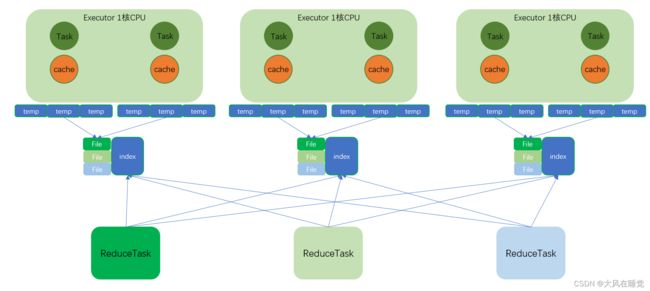

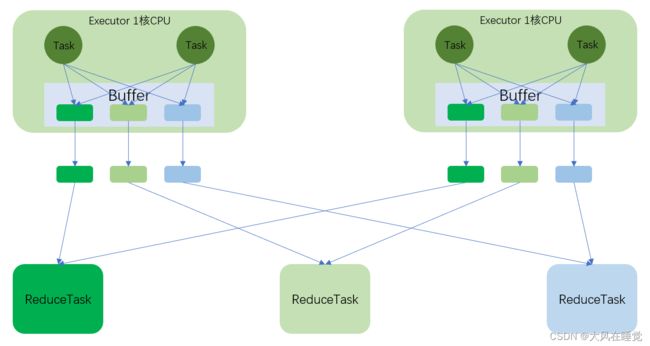

一、MapReduce概述1、MapReduce简介MapReduce是一个分布式运算程序的编程框架,是基于Hadoop的数据分析计算的核心框架。MapReduce处理过程分为两个阶段:Map和Reduce。Map负责把一个任务分解成多个任务,Reduce负责把分解后多任务处理的结果汇总。2、MapReduce优缺点MapReduce优点:MapReduce易于编程:它简单的实现一些接口,就可以完

- 非凸科技荣登脉脉2024“年度职得去雇主”榜单

招聘

近日,2024脉脉MAX年度职场力量盛典暨年度“职得去”公司颁奖典礼在深圳举行,非凸科技受邀出席盛会并荣登脉脉2024“年度职得去雇主”榜单。本届评选依据脉脉独有的“雇主指数”以及专家评审意见综合评选而出,综合考量了企业在脉脉社区广场、同事圈、行业圈等多个频道口碑,并基于职场大数据训练的专属大模型,客观反映企业在职场人心中的口碑。非凸科技获此殊荣,也意味着在发展前景、工作氛围、薪酬福利等方面极具竞

- 2024第五届全球数字经济产业大会:前沿技术引领未来

javascript

随着数字化浪潮的不断推进,全球数字经济产业大会已成为展示最新技术成果和探讨未来发展趋势的重要平台。2024年8月,第五届全球数字经济产业大会在深圳会展中心盛大召开,汇聚了全球顶尖的科技企业和行业领袖,共同探讨和展示数字经济领域的最新技术成果与发展趋势。云计算与大数据云计算和大数据技术作为数字经济的基石,一直是大会的焦点。本届大会上,众多企业展示了他们在云计算平台的创新和大数据应用方面的最新进展。通

- anaconda中pyspark_自学大数据——9 Anaconda安装与使用pyspark

步六孤陆

首先从Anaconda官网上下载Anaconda。一、解压安装包sudobashAnaconda3-2020.07-Linux-x86_64.shchown-Rhadoop:hadoop/opt/anaconda/vi/etc/profileexportANACONDA_HOME=/opt/anacondaexportPATH=$PATH:$ANACONDA_HOME/bin:source/etc

- PySpark数据处理过程简析

AI天才研究院

Python实战自然语言处理人工智能语言模型编程实践开发语言架构设计

作者:禅与计算机程序设计艺术1.简介PySpark是ApacheSpark的PythonAPI,可以用Python进行分布式数据处理,它在内存中利用了ApacheHadoopYARN资源调度框架对数据进行并行处理。PySpark可以直接使用Hadoop文件系统、HDFS来存储数据,也可以通过S3、GCS、ADLS等云存储平台保存数据。因此,在不同的数据源之间移动数据时,只需要复制一次数据就可以完成

- 2022-02-09大数据学习日志——PySpark——Spark快速入门&Standalone集群

王络不稳定

sparkbigdata大数据

第一部分Spark快速入门01_Spark快速入门【Anaconda软件安装】[掌握]使用Python编写Spark代码,首先需要安装Python语言包,此时安装Anaconda科学数据分析包。Anaconda指的是一个开源的Python发行版本,其包含了conda、Python等180多个科学包及其依赖项。Anaconda是跨平台的,有Windows、MacOS、Linux版本。#下载地址:ht

- PySpark

rainyrainbow

大数据hadoop

1.PySpark的搭建https://blog.csdn.net/qq_36330643/article/details/78429109PySpark是Spark为Python开发者提供的API,位于$SPARK_HOME/bin目录,其依赖于Py4J。在Pycharm中配置使用spark1.在Pycharm中新建python项目,解释器使用的是python3.4File=>Settings切

- spark2如何集成到cdh里

蘑菇丁

经验hadoop大数据+机器学习+oracle

最近做性能测试需要spark2测试下和spark1.6性能有多大差别,官方文档里写着可以集成,但是自己怎么搞都不行,折磨了3天的时间,目前终于把spark2集成到集群里了我安装的是最新版本的下载spark2安装包wgethttp://archive.cloudera.com/beta/spark2/parcels/latest/SPARK2-2.0.0.cloudera.beta2-1.cdh5.

- 大数据之Spark运行流程

「已注销」

Spark大数据sparkhadoop

文章目录前言(一)SparkOnYarn集群的Client模式运行流程(二)SparkOnYarn集群的Cluster模式运行流程总结前言上篇文章有讨论到SparkOnYarn的两种部署模式,如果有不清楚的地方,可以再看看,附上对应文章的链接:Spark的部署模式,本篇文章主要讨论SparkOnYarn两种部署模式的运行流程。(一)SparkOnYarn集群的Client模式运行流程该模式的Dri

- R语言学习笔记6-数据框

Colin♛

r语言学习笔记开发语言信息可视化

R语言学习笔记6-数据框数据框(DataFrame)介绍数据框用途创建数据框从矩阵创建数据框索引和切片添加和修改列数据框的预处理数据框的排序数据框的筛选处理缺失值应用函数处理数据重塑数据框使用dplyr进行数据框的管道操作数据框的时间序列操作大数据框的处理数据框的绘图数据框的文本处理数据框的连接与关联按行或列连接数据框按键值关联数据框数据框的条件处理与逻辑操作条件筛选逻辑操作数据框的汇总与统计分析

- xgboost-spark-scala

maokunnn

DMxgboostsparkscala

今天学习写scala,拿xgboost试一下~先记一下xgboost调参要点:7.xgboost中比较重要的参数介绍(1)objective[default=reg:linear]定义学习任务及相应的学习目标,可选的目标函数如下:“reg:linear”–线性回归。“reg:logistic”–逻辑回归。“binary:logistic”–二分类的逻辑回归问题,输出为概率。“binary:logi

- 华为OD机试C卷-- 精准核酸检测(Java & JS & Python & C)

飞码创造者

华为OD机试题库华为odc语言javajavascriptpython

获取题库不需要订阅专栏,可直接私信我进入CSDN领军人物top1博主的华为OD交流圈观看完整题库、最新面试实况、考试报告等内容以及大佬一对一答疑。题目描述为了达到新冠疫情精准防控的需要,为了避免全员核酸检测带来的浪费,需要精准圈定可能被感染的人群。现在根据传染病流调以及大数据分析,得到了每个人之间在时间、空间上是否存在轨迹交叉。现在给定一组确诊人员编号(X1,X2,X3,…,Xn),在所有人当中,

- matlab大数据计算技巧(持续更新中)

tina_lulu_21

matlabmatlabstring存储

在matlab中,当数据比较大时,运算起来就困难了,有时候还会outofmemory(例如4000*4000的矩阵,要算矩阵乘法都比较吃力)。此文会记录我学到的一些解决办法:1.将数据的存储类型从double转换成single在matlab中double数据类型占8个字节,single类型占4个字节。把数据类型从double类型转换成single类型可以节省一半的空间。单精度浮点数single的取

- Matlab:读取和处理大数据表格文本文件

追逐程序梦想者

matlab大数据开发语言

Matlab:读取和处理大数据表格文本文件在实际的数据分析应用中,往往需要处理海量数据。针对大型数据文件,Matlab提供了快速高效的读取和处理工具,可以便捷地完成数据处理任务。本文将介绍如何使用Matlab读取和处理大型表格文本文件。第一步:读取数据文件Matlab内置了readtable函数,可以便捷地读取各种格式的表格数据文件。对于大型数据文件,我们可以采取分块读取的方式,提高运行效率。下面

- 赛事 Q&A × 培训预告:2024 年(第 17 届)中国大学生计算机设计大赛大数据主题赛正式开赛!

ModelWhale

中国大学生计算机设计大赛大数据人工智能编程竞赛

中国大学生计算机设计大赛(下简称“大赛”)是由教育部认证、我国面向高校本科生最早的赛事之一,自2008年开赛起,至今已是第十七届。大赛属于全国普通高校大学生竞赛排行榜榜单赛事,始终贯彻“以赛促学、以赛促教、以赛促创”,为国家培养全面发展的创新型、复合型、应用型人才。大赛下设不同领域的十一个大类,和鲸科技自2021年起,连续四年作为大数据应用大类中大数据主题赛的协办方倾力配合大赛组委会与各承办单位,

- 大数据StarRocks(六) :Catalog_starroccks支持oracle外部表了吗(1)

2401_84181975

程序员大数据oracle数据库

StarRocks自2.3版本起支持Catalog(数据目录)功能,实现在一套系统内同时维护内、外部数据,方便您轻松访问并查询存储在各类外部源的数据。1.基本概念内部数据:指保存在StarRocks中的数据。外部数据:指保存在外部数据源(如ApacheHive™、ApacheIceberg、ApacheHudi、DeltaLake、JDBC)中的数据。2.Catalog当前StarRocks提供两

- 基于SpringBoot+Vue码头船只货柜管理系统

qq_469603589

Java项目实战信息管理类项目springbootvue.js后端

作者简介:Java领域优质创作者、CSDN博客专家、CSDN内容合伙人、掘金特邀作者、阿里云博客专家、51CTO特邀作者、多年架构师设计经验、多年校企合作经验,被多个学校常年聘为校外企业导师,指导学生毕业设计并参与学生毕业答辩指导,有较为丰富的相关经验。期待与各位高校教师、企业讲师以及同行交流合作主要内容:Java项目、Python项目、前端项目、PHP、ASP.NET、人工智能与大数据、单片机开

- 推荐开源项目:WeDataSphere - 智慧数据服务平台

劳泉文Luna

推荐开源项目:WeDataSphere-智慧数据服务平台去发现同类优质开源项目:https://gitcode.com/是一款由微众银行金融科技团队开发的开源大数据处理和应用框架,旨在简化数据分析流程,提高数据驱动决策的效率。该项目将复杂的数据集成、治理、分析和应用任务封装为模块化服务,让用户可以更加专注于业务逻辑,而非底层数据处理的技术细节。技术解析模块化设计:WeDataSphere提供了一套

- Java 大视界 -- Java 大数据中的隐私增强技术全景解析(64)

青云交

大数据新视界Java大视界java

亲爱的朋友们,热烈欢迎来到青云交的博客!能与诸位在此相逢,我倍感荣幸。在这飞速更迭的时代,我们都渴望一方心灵净土,而我的博客正是这样温暖的所在。这里为你呈上趣味与实用兼具的知识,也期待你毫无保留地分享独特见解,愿我们于此携手成长,共赴新程!一、欢迎加入【福利社群】点击快速加入:青云交灵犀技韵交响盛汇福利社群点击快速加入2:2024CSDN博客之星创作交流营(NEW)二、本博客的精华专栏:大数据新视

- 使用Pyecharts绘制地理图表

前端设计家

信息可视化python数据分析Python

Pyecharts是一个基于Python的强大数据可视化库,它提供了丰富的图表类型和交互功能。其中,Pyecharts能够轻松绘制地理图表,帮助我们展示地理数据的分布和变化趋势。本文将介绍如何使用Pyecharts在Python中绘制地理图表,并提供相应的源代码示例。首先,我们需要安装Pyecharts库。可以使用pip命令进行安装,如下所示:pipinstallpyecharts安装完成后,我们

- 大数据平台建设整体架构设计方案

AI天才研究院

ChatGPTAI大模型企业级应用开发实战大数据AI人工智能大厂Offer收割机面试题简历程序员读书硅基计算碳基计算认知计算生物计算深度学习神经网络大数据AIGCAGILLMJavaPython架构设计Agent程序员实现财富自由

《大数据平台建设整体架构设计方案》关键词:大数据平台、分布式存储、分布式计算、数据仓库、数据湖、数据安全、数据质量管理、数据治理、数据挖掘、机器学习、图计算、自然语言处理、Hadoop、Spark、Flink、项目规划、运维管理、最佳实践。摘要:本文将深入探讨大数据平台建设整体架构设计方案,从概述与核心概念、技术栈、建设实践、运维管理以及经验展望等多个方面进行详细阐述。通过梳理大数据平台的核心组成

- 企业信息化5:后勤管理系统

mosquito_lover1

制造业企业全业务流程信息化pythonflask开源

前言:随着企业各业务板块在信息化的浪潮中积极转型升级,后勤板块往往成为了一个企业信息化的短板,后勤业务大数据无法融入企业信息化数据湖,进而影响企业整体运营的效率和质量。后勤运营信息化管理对于企业后勤管理的提升、成本控制、信息管理和业务水平的提升都将起到积极促进作用。业务需求:后勤管理系统业务需求报告1.项目概述1.1项目背景随着企业规模的不断扩大,传统的后勤管理方式已无法满足现代企业的管理需求。为

- 大数据Lambda架构

奋进学堂

系统架构设计师考试架构

Lambda架构介绍Lambda是用于同时处理离线和实时数据,可容错、可扩展的分布式系统架构。有批处理层、加速层、服务层。同时以流计算和批处理计算合并视图。Lambda架构的批处理层采用不可变存储模型,不断地往主数据集后追加新的数据。Lambda架构优缺点<

- Lambda架构

leveretz

大数据lambda

原文地址:https://www.cnblogs.com/xiaodf/p/11642555.html首先我们来看一个典型的互联网大数据平台的架构,如下图所示:在这张架构图中,大数据平台里面向用户的在线业务处理组件用褐色标示出来,这部分是属于互联网在线应用的部分,其他蓝色的部分属于大数据相关组件,使用开源大数据产品或者自己开发相关大数据组件。你可以看到,大数据平台由上到下,可分为三个部分:数据采集

- ES聚合分析原理与代码实例讲解

AI大模型应用之禅

AI大模型与大数据计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

ES聚合分析原理与代码实例讲解作者:禅与计算机程序设计艺术/ZenandtheArtofComputerProgramming1.背景介绍1.1问题的由来随着大数据时代的到来,企业级应用需要处理的数据量呈爆炸式增长。如何从海量数据中快速、高效地提取有价值的信息,成为了数据分析和处理领域的重要课题。Elasticsearch(简称ES)作为一种高性能、可扩展的全文搜索引擎,在处理海量数据、进行高效数

- Hadoop(一)

朱辉辉33

hadooplinux

今天在诺基亚第一天开始培训大数据,因为之前没接触过Linux,所以这次一起学了,任务量还是蛮大的。

首先下载安装了Xshell软件,然后公司给了账号密码连接上了河南郑州那边的服务器,接下来开始按照给的资料学习,全英文的,头也不讲解,说锻炼我们的学习能力,然后就开始跌跌撞撞的自学。这里写部分已经运行成功的代码吧.

在hdfs下,运行hadoop fs -mkdir /u

- maven An error occurred while filtering resources

blackproof

maven报错

转:http://stackoverflow.com/questions/18145774/eclipse-an-error-occurred-while-filtering-resources

maven报错:

maven An error occurred while filtering resources

Maven -> Update Proje

- jdk常用故障排查命令

daysinsun

jvm

linux下常见定位命令:

1、jps 输出Java进程

-q 只输出进程ID的名称,省略主类的名称;

-m 输出进程启动时传递给main函数的参数;

&nb

- java 位移运算与乘法运算

周凡杨

java位移运算乘法

对于 JAVA 编程中,适当的采用位移运算,会减少代码的运行时间,提高项目的运行效率。这个可以从一道面试题说起:

问题:

用最有效率的方法算出2 乘以8 等於几?”

答案:2 << 3

由此就引发了我的思考,为什么位移运算会比乘法运算更快呢?其实简单的想想,计算机的内存是用由 0 和 1 组成的二

- java中的枚举(enmu)

g21121

java

从jdk1.5开始,java增加了enum(枚举)这个类型,但是大家在平时运用中还是比较少用到枚举的,而且很多人和我一样对枚举一知半解,下面就跟大家一起学习下enmu枚举。先看一个最简单的枚举类型,一个返回类型的枚举:

public enum ResultType {

/**

* 成功

*/

SUCCESS,

/**

* 失败

*/

FAIL,

- MQ初级学习

510888780

activemq

1.下载ActiveMQ

去官方网站下载:http://activemq.apache.org/

2.运行ActiveMQ

解压缩apache-activemq-5.9.0-bin.zip到C盘,然后双击apache-activemq-5.9.0-\bin\activemq-admin.bat运行ActiveMQ程序。

启动ActiveMQ以后,登陆:http://localhos

- Spring_Transactional_Propagation

布衣凌宇

springtransactional

//事务传播属性

@Transactional(propagation=Propagation.REQUIRED)//如果有事务,那么加入事务,没有的话新创建一个

@Transactional(propagation=Propagation.NOT_SUPPORTED)//这个方法不开启事务

@Transactional(propagation=Propagation.REQUIREDS_N

- 我的spring学习笔记12-idref与ref的区别

aijuans

spring

idref用来将容器内其他bean的id传给<constructor-arg>/<property>元素,同时提供错误验证功能。例如:

<bean id ="theTargetBean" class="..." />

<bean id ="theClientBean" class=&quo

- Jqplot之折线图

antlove

jsjqueryWebtimeseriesjqplot

timeseriesChart.html

<script type="text/javascript" src="jslib/jquery.min.js"></script>

<script type="text/javascript" src="jslib/excanvas.min.js&

- JDBC中事务处理应用

百合不是茶

javaJDBC编程事务控制语句

解释事务的概念; 事务控制是sql语句中的核心之一;事务控制的作用就是保证数据的正常执行与异常之后可以恢复

事务常用命令:

Commit提交

- [转]ConcurrentHashMap Collections.synchronizedMap和Hashtable讨论

bijian1013

java多线程线程安全HashMap

在Java类库中出现的第一个关联的集合类是Hashtable,它是JDK1.0的一部分。 Hashtable提供了一种易于使用的、线程安全的、关联的map功能,这当然也是方便的。然而,线程安全性是凭代价换来的――Hashtable的所有方法都是同步的。此时,无竞争的同步会导致可观的性能代价。Hashtable的后继者HashMap是作为JDK1.2中的集合框架的一部分出现的,它通过提供一个不同步的

- ng-if与ng-show、ng-hide指令的区别和注意事项

bijian1013

JavaScriptAngularJS

angularJS中的ng-show、ng-hide、ng-if指令都可以用来控制dom元素的显示或隐藏。ng-show和ng-hide根据所给表达式的值来显示或隐藏HTML元素。当赋值给ng-show指令的值为false时元素会被隐藏,值为true时元素会显示。ng-hide功能类似,使用方式相反。元素的显示或

- 【持久化框架MyBatis3七】MyBatis3定义typeHandler

bit1129

TypeHandler

什么是typeHandler?

typeHandler用于将某个类型的数据映射到表的某一列上,以完成MyBatis列跟某个属性的映射

内置typeHandler

MyBatis内置了很多typeHandler,这写typeHandler通过org.apache.ibatis.type.TypeHandlerRegistry进行注册,比如对于日期型数据的typeHandler,

- 上传下载文件rz,sz命令

bitcarter

linux命令rz

刚开始使用rz上传和sz下载命令:

因为我们是通过secureCRT终端工具进行使用的所以会有上传下载这样的需求:

我遇到的问题:

sz下载A文件10M左右,没有问题

但是将这个文件A再传到另一天服务器上时就出现传不上去,甚至出现乱码,死掉现象,具体问题

解决方法:

上传命令改为;rz -ybe

下载命令改为:sz -be filename

如果还是有问题:

那就是文

- 通过ngx-lua来统计nginx上的虚拟主机性能数据

ronin47

ngx-lua 统计 解禁ip

介绍

以前我们为nginx做统计,都是通过对日志的分析来完成.比较麻烦,现在基于ngx_lua插件,开发了实时统计站点状态的脚本,解放生产力.项目主页: https://github.com/skyeydemon/ngx-lua-stats 功能

支持分不同虚拟主机统计, 同一个虚拟主机下可以分不同的location统计.

可以统计与query-times request-time

- java-68-把数组排成最小的数。一个正整数数组,将它们连接起来排成一个数,输出能排出的所有数字中最小的。例如输入数组{32, 321},则输出32132

bylijinnan

java

import java.util.Arrays;

import java.util.Comparator;

public class MinNumFromIntArray {

/**

* Q68输入一个正整数数组,将它们连接起来排成一个数,输出能排出的所有数字中最小的一个。

* 例如输入数组{32, 321},则输出这两个能排成的最小数字32132。请给出解决问题

- Oracle基本操作

ccii

Oracle SQL总结Oracle SQL语法Oracle基本操作Oracle SQL

一、表操作

1. 常用数据类型

NUMBER(p,s):可变长度的数字。p表示整数加小数的最大位数,s为最大小数位数。支持最大精度为38位

NVARCHAR2(size):变长字符串,最大长度为4000字节(以字符数为单位)

VARCHAR2(size):变长字符串,最大长度为4000字节(以字节数为单位)

CHAR(size):定长字符串,最大长度为2000字节,最小为1字节,默认

- [强人工智能]实现强人工智能的路线图

comsci

人工智能

1:创建一个用于记录拓扑网络连接的矩阵数据表

2:自动构造或者人工复制一个包含10万个连接(1000*1000)的流程图

3:将这个流程图导入到矩阵数据表中

4:在矩阵的每个有意义的节点中嵌入一段简单的

- 给Tomcat,Apache配置gzip压缩(HTTP压缩)功能

cwqcwqmax9

apache

背景:

HTTP 压缩可以大大提高浏览网站的速度,它的原理是,在客户端请求网页后,从服务器端将网页文件压缩,再下载到客户端,由客户端的浏览器负责解压缩并浏览。相对于普通的浏览过程HTML ,CSS,Javascript , Text ,它可以节省40%左右的流量。更为重要的是,它可以对动态生成的,包括CGI、PHP , JSP , ASP , Servlet,SHTML等输出的网页也能进行压缩,

- SpringMVC and Struts2

dashuaifu

struts2springMVC

SpringMVC VS Struts2

1:

spring3开发效率高于struts

2:

spring3 mvc可以认为已经100%零配置

3:

struts2是类级别的拦截, 一个类对应一个request上下文,

springmvc是方法级别的拦截,一个方法对应一个request上下文,而方法同时又跟一个url对应

所以说从架构本身上 spring3 mvc就容易实现r

- windows常用命令行命令

dcj3sjt126com

windowscmdcommand

在windows系统中,点击开始-运行,可以直接输入命令行,快速打开一些原本需要多次点击图标才能打开的界面,如常用的输入cmd打开dos命令行,输入taskmgr打开任务管理器。此处列出了网上搜集到的一些常用命令。winver 检查windows版本 wmimgmt.msc 打开windows管理体系结构(wmi) wupdmgr windows更新程序 wscrip

- 再看知名应用背后的第三方开源项目

dcj3sjt126com

ios

知名应用程序的设计和技术一直都是开发者需要学习的,同样这些应用所使用的开源框架也是不可忽视的一部分。此前《

iOS第三方开源库的吐槽和备忘》中作者ibireme列举了国内多款知名应用所使用的开源框架,并对其中一些框架进行了分析,同样国外开发者

@iOSCowboy也在博客中给我们列出了国外多款知名应用使用的开源框架。另外txx's blog中详细介绍了

Facebook Paper使用的第三

- Objective-c单例模式的正确写法

jsntghf

单例iosiPhone

一般情况下,可能我们写的单例模式是这样的:

#import <Foundation/Foundation.h>

@interface Downloader : NSObject

+ (instancetype)sharedDownloader;

@end

#import "Downloader.h"

@implementation

- jquery easyui datagrid 加载成功,选中某一行

hae

jqueryeasyuidatagrid数据加载

1.首先你需要设置datagrid的onLoadSuccess

$(

'#dg'

).datagrid({onLoadSuccess :

function

(data){

$(

'#dg'

).datagrid(

'selectRow'

,3);

}});

2.onL

- jQuery用户数字打分评价效果

ini

JavaScripthtmljqueryWebcss

效果体验:http://hovertree.com/texiao/jquery/5.htmHTML文件代码:

<!DOCTYPE html>

<html xmlns="http://www.w3.org/1999/xhtml">

<head>

<title>jQuery用户数字打分评分代码 - HoverTree</

- mybatis的paramType

kerryg

DAOsql

MyBatis传多个参数:

1、采用#{0},#{1}获得参数:

Dao层函数方法:

public User selectUser(String name,String area);

对应的Mapper.xml

<select id="selectUser" result

- centos 7安装mysql5.5

MrLee23

centos

首先centos7 已经不支持mysql,因为收费了你懂得,所以内部集成了mariadb,而安装mysql的话会和mariadb的文件冲突,所以需要先卸载掉mariadb,以下为卸载mariadb,安装mysql的步骤。

#列出所有被安装的rpm package rpm -qa | grep mariadb

#卸载

rpm -e mariadb-libs-5.

- 利用thrift来实现消息群发

qifeifei

thrift

Thrift项目一般用来做内部项目接偶用的,还有能跨不同语言的功能,非常方便,一般前端系统和后台server线上都是3个节点,然后前端通过获取client来访问后台server,那么如果是多太server,就是有一个负载均衡的方法,然后最后访问其中一个节点。那么换个思路,能不能发送给所有节点的server呢,如果能就

- 实现一个sizeof获取Java对象大小

teasp

javaHotSpot内存对象大小sizeof

由于Java的设计者不想让程序员管理和了解内存的使用,我们想要知道一个对象在内存中的大小变得比较困难了。本文提供了可以获取对象的大小的方法,但是由于各个虚拟机在内存使用上可能存在不同,因此该方法不能在各虚拟机上都适用,而是仅在hotspot 32位虚拟机上,或者其它内存管理方式与hotspot 32位虚拟机相同的虚拟机上 适用。

- SVN错误及处理

xiangqian0505

SVN提交文件时服务器强行关闭

在SVN服务控制台打开资源库“SVN无法读取current” ---摘自网络 写道 SVN无法读取current修复方法 Can't read file : End of file found

文件:repository/db/txn_current、repository/db/current

其中current记录当前最新版本号,txn_current记录版本库中版本