CVPR 2021 | MSRA提出像素级别自监督预训练方法PixPro,大幅提升下游检测分割任务性能...

点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

作者:本文系CVer粉丝投稿 | 编辑:Amusi

过去的一年,基于图像级别对比学习(Contrastive Learning)的自监督学习方法在ImageNet线性评估上取得了不俗的成绩,但其在重要的下游任务物体检测和语义分割上并未有太大提升。清华、西交大和MSRA提出了像素级别(Pixel-level)的对比学习新基准PixContrast和挖掘像素级别一致性的新方法PixPro,大幅提升了自监督方法在物体检测和语义分割等下游任务上的性能。基于ResNet-50,PixPro在Pascal VOC(C4)物体检测,COCO (FPN/C4)物体检测和Cityscapes语义分割任务上分别取得了60.2 AP,41.4/40.5 mAP和77.2 mIoU的结果,分别比之前的最优方法提升了2.6 AP,0.8/1.0 mAP和1.0 mIoU。

Propagate Yourself: Exploring Pixel-Level Consistency for Unsupervised Visual

Representation Learning

论文地址:https://arxiv.org/abs/2011.10043

代码地址:https://github.com/zdaxie/PixPro

注:文中部分的图示选自下述链接,推荐学习

https://ancientmooner.github.io/doc/recent-progress-self-supervised-learning-cv-hanhu.pdf

自MoCo以来,自监督学习方法在ImageNet线性评估上的表现取得了长足的进步,其top-1准确率在过去一年内从60.6%上升到了CLSA的76.2%,提升幅度达到了惊人的15.6%,如下图所示:

图1 过去一年自监督预训练方法在ImageNet-1K线性评估上的性能提升

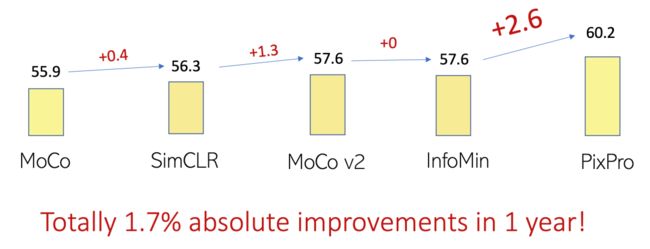

然而,在主要的下游微调任务Pascal VOC物体检测上,其性能在过去的一年里只从MoCo的55.9 AP上升到了InfoMin的57.6 AP,提升幅度仅有1.7 AP,如下图所示:

图2 过去一年自监督预训练方法在Pascal VOC物体检测任务上的性能提升

基于此,MSRA提出了主要针对下游密集任务的自监督算法PixPro,一下子将之前最好的结果提升了2.6 AP,比过去一年总的进步还要大。而其中的关键,就是从图像(实例)级别的预训练,转向像素级别的预训练。如图3所示,左边是传统的基于实例区分的自监督学习方法,包括memory bank,MoCo,SimCLR,BYOL,SwaV和PIC等方法均属于此类,右边是该文提出的PixPro方法,其基于像素级别的预训练任务,通过区分图像上的每个像素来进行预训练。

图3 从实例级别(Instance-level)对比学习到像素级别(Pixel-level)对比学习

在Pascal VOC物体检测任务上,PixPro比之前最优的自监督预训练方法提升了2.6 AP,达到了60.2 AP,远超过去一年的提升。在COCO(FPN/C4)物体检测和Cityscapes语义分割上,PixPro分别比之前的最优方法提升了0.8/1.0 mAP和1.0 mIoU,取得了41.4/40.5 mAP和77.2 mIoU的结果。

【基准方法PixContrast】

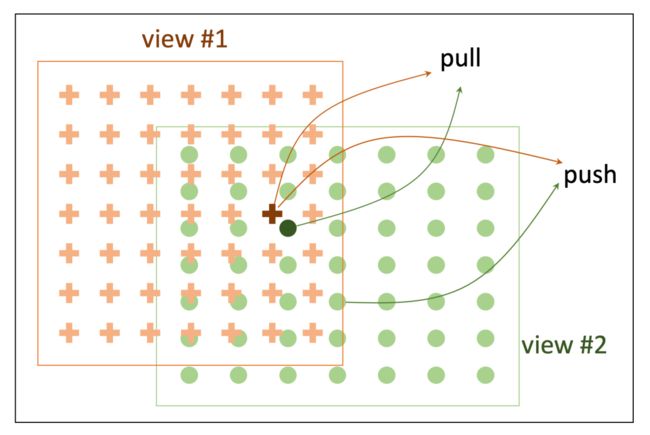

图4 像素级别对比学习(Pixel-level Contrastive Learning)任务

图5 PixContrast网络结构

该文首先将对比学习直接推广到像素级别,示意图和网络结构图如图4和图5所示。在该预训练任务中,学习的目标是将两个视图中距离较近像素点的特征拉近(pull),同时推远(push)距离较远像素点的特征。该方法称为PixContrast,其在检测和分割等下游任务上已能取得不错的性能。

【PixPro方法】

图6 像素到传播一致性(Pixel-to-Propagation Consistency)任务

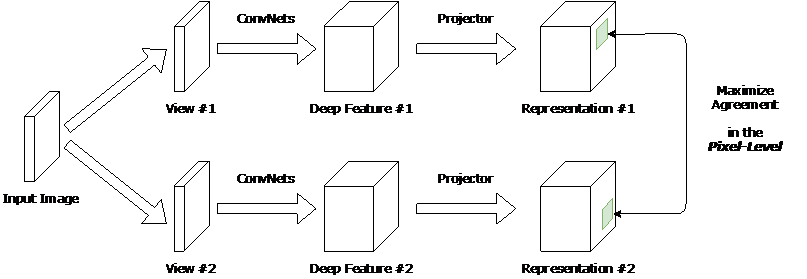

图7 PixPro 网络结构

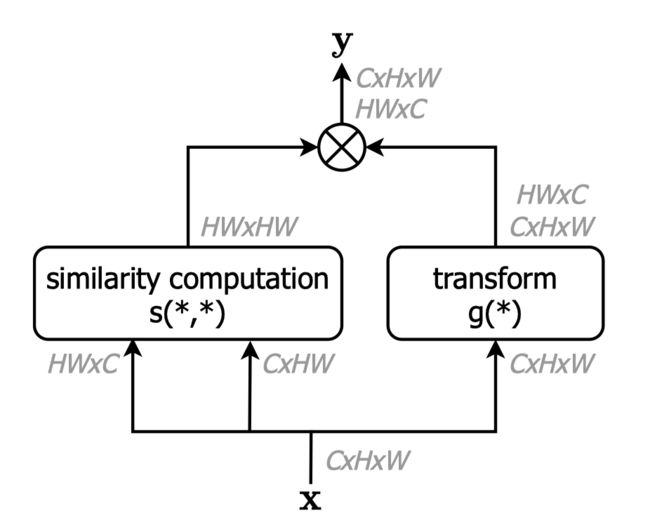

图8 像素传播模块(Pixel Propagation Module,PPM)

此前的基准方法PixContrast只鼓励尽可能的区分每个像素,该任务使得学习到的特征具备很强的空间敏感性,这有利于分割中边缘部分的识别。然而,在实际密集预测任务中,特征的空间平滑性很重要,这种性质对于识别物体中心部分会很有用。为了使特征同时具备空间敏感性和平滑性,该文提出了PixPro方法,如图6所示,视图1采用正常的特征,而视图2采用经过平滑后的特征,该特征平滑模块如图8所示,而网络的整体结构如图7所示。此外,该方法去掉了拉远的分支,而只关注距离较近的像素之间的特征一致性,这进一步放松了空间敏感性,而增强了特征的空间平滑性。

【扩展】

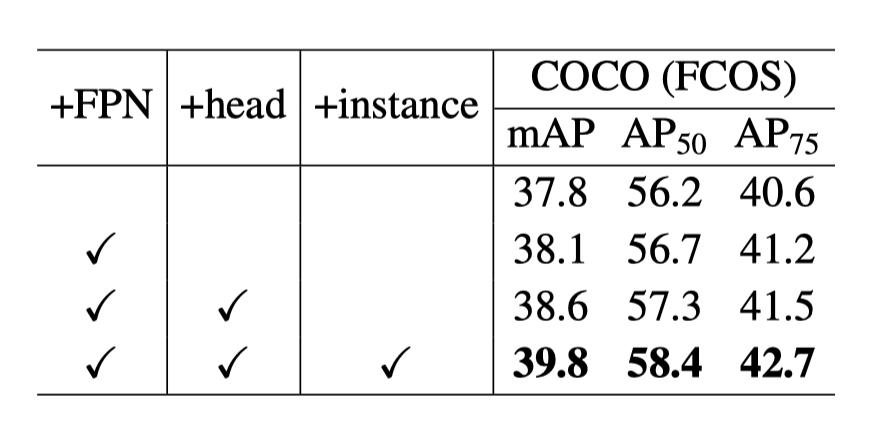

图9 将带有FPN结构的FCOS与PixPro相结合

像素级别的预训练使得预训练可以拓展到除backbone以外的其他部分,例如物体检测中常用的FPN结构,实验发现,预训练FPN能对物体检测基准算法FCOS带来明显提升。

此外,像素级别的预训练还能与实力对比学习很方便的结合,并兼容。

【实验】

表1. 系统级别结果

如表1所示,PixPro使用ResNet-50在Pascal VOC(C4)物体检测,COCO(FPN/C4)物体检测和Cityscapes语义分割任务上分别取得了60.2 AP,41.4/40.5 mAP和77.2 mIoU的点数,比之前最好的无监督方法高出了2.6 AP,0.8/1.0 mAP和1.0 mIoU的点数,更远超有监督预训练的基准。

表2 PixPro与基准方法PixContrast的比较

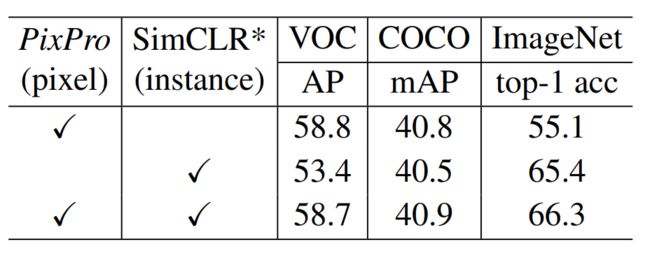

表3 PixPro方法与实例级别方法形成互补

表4 PixPro预训练下游任务网络以及结合实例级别对比学习结果

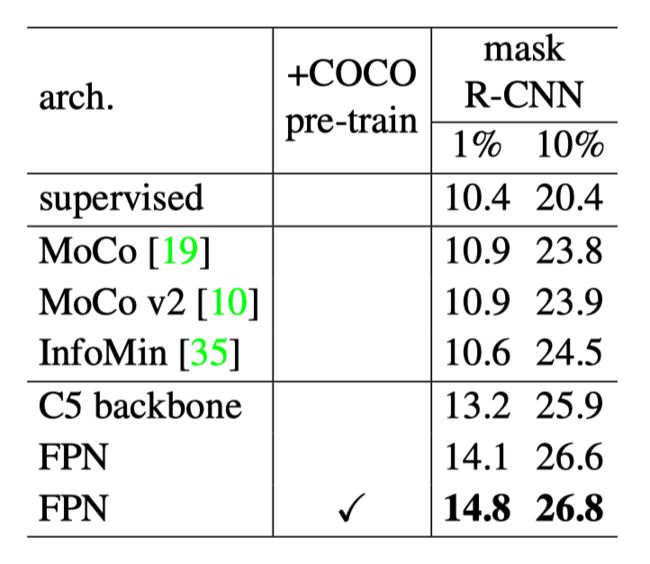

表5 PixPro在半监督学习上的表现

论文PDF和代码下载

后台回复:PixPro,即可下载上述论文PDF和代码

后台回复:CVPR2021,即可下载CVPR 2021论文和代码开源的论文合集

重磅!CVer-垂直方向交流群成立

扫码添加CVer助手,可申请加入CVer-垂直方向 微信交流群,方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、PyTorch和TensorFlow等群。

一定要备注:研究方向+地点+学校/公司+昵称(如目标检测+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲长按加小助手微信,进交流群

▲点击上方卡片,关注CVer公众号