深度学习 语音转换 歌声转换 歌唱语音转换

章目录https://blog.csdn.net/qq_40168949/article/details/109577549

-

-

- 一、VC

-

- 1. 【小数据VC】Attention-Based Speaker Embeddings for One-Shot Voice Conversion [2020 interspeech]

- 2. 【提升质量】ATTS2S-VC: SEQUENCE-TO-SEQUENCE VOICE CONVERSION WITH ATTENTION AND CONTEXT PRESERVATION MECHANISMS [2019 icassp]

- 3. 【实时VC】ConVoice: Real-Time Zero-Shot Voice Style Transfer with Convolutional Network [投稿 2020 interspeech]

- 二、SVC

-

- 1. 【singer conversion】PitchNet-Unsupervised Singing Voice Conversion with Pitch Adversarial Network [2020 icassp]

- 2. 【singer conversion】PPG-based singing voice conversion with adversarial representation learning [投稿2021 icassp]

- 3. 【singer conversion】 Unsupervised Singing Voice Conversion [2019 arxiv]

- 三、音乐相关

-

- 1. 【音乐演奏风格转换:莫扎特--贝多芬】A Universal Music Translation Network [2017 NIPS]

- 2. 【风格转换的效果评估--分类器】Evaluation of Vocal Audio Style Transfer

- 3. 【音乐风格转换】MelGAN-VC: Voice Conversion and Audio Style Transfer on arbitrarily long samples using Spectrograms[2019 arxiv]

- 4. 【风格转换:pop/jazz--classic,音频剪辑】MIDI-VAE: Modeling dynamics and instrumentation of music with applications to style transfer[ISMIR 2018]

- 5. 【singing voice --to-- musical instruments】Neural Style Transfer for Audio Spectrograms [2017 NIPS]

- 6. 【改变乐器的音色,不改变节奏等信息】TimbreTron- A WaveNet (CycleGAN(CQT(Audio))) Pipeline for Musical Timbre Transfer 【2019 ICLR】

- 7.【歌唱风格转换 (像是特殊音色转换)】Singing Style Transfer Using Cycle-Consistent Boundary Equilibrium Generative Adversarial Networks【2018 ICML】

- [说话风格转换]Cycle-consistent Adversarial Networks for Non-parallel Vocal Effort Based Speaking Style Conversion[2019 icassp]

- emotion

-

- Converting Anyone’s Emotion:Towards Speaker-Independent Emotional Voice Conversion [2020-10, LHZ]

-

一、VC

1. 【小数据VC】Attention-Based Speaker Embeddings for One-Shot Voice Conversion [2020 interspeech]

论文

单位:日本NTT

seq-seq with attention的VC,

2. 【提升质量】ATTS2S-VC: SEQUENCE-TO-SEQUENCE VOICE CONVERSION WITH ATTENTION AND CONTEXT PRESERVATION MECHANISMS [2019 icassp]

3. 【实时VC】ConVoice: Real-Time Zero-Shot Voice Style Transfer with Convolutional Network [投稿 2020 interspeech]

单位:Higher School of Economics, Saint Petersburg,Russia

introduction:

zero-shot voice conversion (VC) without any parallel or transcribed data.

预训练的ASR, SV(speaker verification)模型,VC模型是全CNN,没有自回归。

人的语音可以分为四个部分:Timbre–说话人的音色,content–文本信息, pitch and rhythm ----韵律信息。

之前的VC主要分为两种,timbre conversion–逐帧对source进行转换,但保存source的韵律信息;非等长对齐通过RNN/attention对source和target进行非等长对齐,尽管这种方法较好的转换了target的韵律信息,但是对于长句子样本时通常比较慢或者韵律变差。

网络更小,计算更快,单独训练好的SV模型提取speaker embedding而不是look up table更有可能实现zero-shot VC。

代码链接,demo展示

二、SVC

1. 【singer conversion】PitchNet-Unsupervised Singing Voice Conversion with Pitch Adversarial Network [2020 icassp]

单位:腾讯ai lab,Chengqi Deng

abstract:

现有的SVC很多不在调上,说明pitch预测的不准。本文是为了更精确的预测pitch,更灵活的修正pitch。

本文提出用adversarial trained pitch regression network帮助encoder更好的学习pitch不变的音素表示singer-invariance embedding,另外一个单独的module送入source中提取的pitch到decoder module。本文是基于非平行数据做的SVC任务,参考之前的WaveNet encoder,虽然可以合成高相似度的语音,但是语音的质量不好—phone和pitch联合建模的缺点。

demo展示

2. 【singer conversion】PPG-based singing voice conversion with adversarial representation learning [投稿2021 icassp]

单位:头条

论文链接

demo: 添加链接描述

技术点:多个子网络,对抗训练,互相弥补促进性能,demo展示还不错

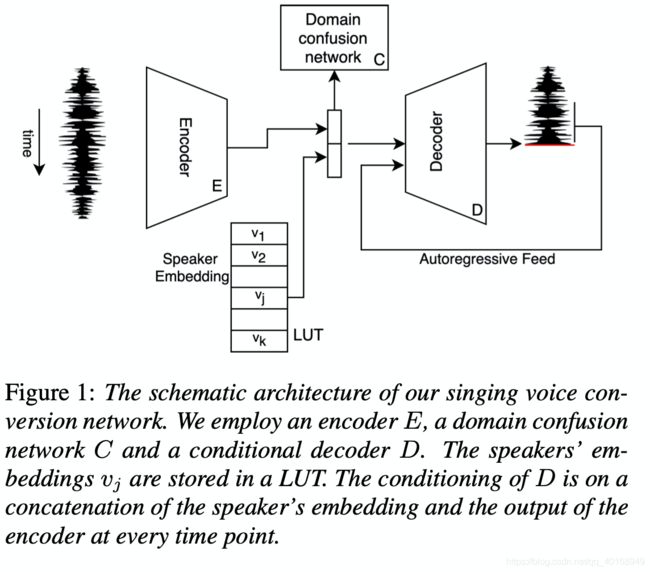

3. 【singer conversion】 Unsupervised Singing Voice Conversion [2019 arxiv]

三、音乐相关

1. 【音乐演奏风格转换:莫扎特–贝多芬】A Universal Music Translation Network [2017 NIPS]

Facebook AI,Noam Mor

introduction:

第一次做音乐风格的转换,比如演奏乐器,题材,和风格。

youtube视频demo—莫扎特风格和贝多芬风格的转换。

2. 【风格转换的效果评估–分类器】Evaluation of Vocal Audio Style Transfer

有的任务在做音乐风格的转换,将一个歌手的音乐转换为另外一个歌手的风格,用一个分类器对现有的歌手音乐进行分类(尤其是演唱的部分),然后用于评判歌唱风格转换的有效性。

3. 【音乐风格转换】MelGAN-VC: Voice Conversion and Audio Style Transfer on arbitrarily long samples using Spectrograms[2019 arxiv]

孪生网络进行domain translation,可以做VC,也可以做音乐风格的转换(jazz–classical, classical—jazz)

youtube demo展示

孪生网络和伪孪生网络介绍

- Siamese network:两个结构完全一样的网络,共享权重(甚至可以是一个网络),输入两个特征,用于衡量两个向量的相似度;

- pseudo-siamese network,伪孪生神经网络:两边可以是不同的神经网络,不共享权重,适用于处理两个输入"有一定差别"的情况

- 举例说明两者的区别,比如,我们要计算两个句子或者词汇的语义相似度,使用siamese network比较适合;如果验证标题与正文的描述是否一致(标题和正文长度差别很大),或者文字是否描述了一幅图片(一个是图片,一个是文字),就应该使用pseudo-siamese network。也就是说,要根据具体的应用,判断应该使用哪一种结构,哪一种Loss。

- 孪生网络不仅仅可以对比两个输入,也可以是三个输入(一个正样本两个副样本,或者一个负例+两个正例),triplet loss效果会变好,但是更多的三孪生/四孪生不常见。

- loss function的选择上,可以用cosine/exp/欧式距离等,cosine更适用于词汇级别的语义相似度度量,而exp更适用于句子级别、段落级别的文本相似性度量。其中的原因可能是cosine仅仅计算两个向量的夹角,exp还能够保存两个向量的长度信息,而句子蕴含更多的信息

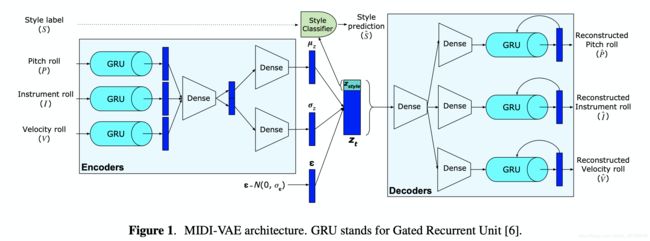

4. 【风格转换:pop/jazz–classic,音频剪辑】MIDI-VAE: Modeling dynamics and instrumentation of music with applications to style transfer[ISMIR 2018]

ISMIR 计算机音乐顶会

单位:ETH Zurich Switzerland 苏黎世联邦理工

- 创新点:音乐创作上的首次成功尝试

- introduction:生成任务不仅仅是生成新的数据,也包括将现有的数据转换成其他的格式。

尽管风格迁移在图像上取得精彩的成果,但是对于时序任务仍然不太好。 目前成功的尝试有(1)餐厅点评(2)改变音乐演奏的乐器。但是对于流行乐改编为古典乐,或者反过来是什么样的效果。 - (1)风格转换:可以用多种乐器生成和弦音乐,加入note/duration的变化,学到更多的音乐信息。然后对音乐风格整体进行变换;(2)音乐生成和插入:对不同乐曲的小节直接插入生成的音频,使得整体听起来和谐自然。

图像上的风格迁移,本文转换的youtube-demo, 开源代码

pitch和速度对风格转换有影响,乐器和风格相关性比较强

5. 【singing voice --to-- musical instruments】Neural Style Transfer for Audio Spectrograms [2017 NIPS]

假设音乐中表征音乐人风格的部分主要由dynamical aspects决定,因此模型旨在学习调整note pitches的速度。

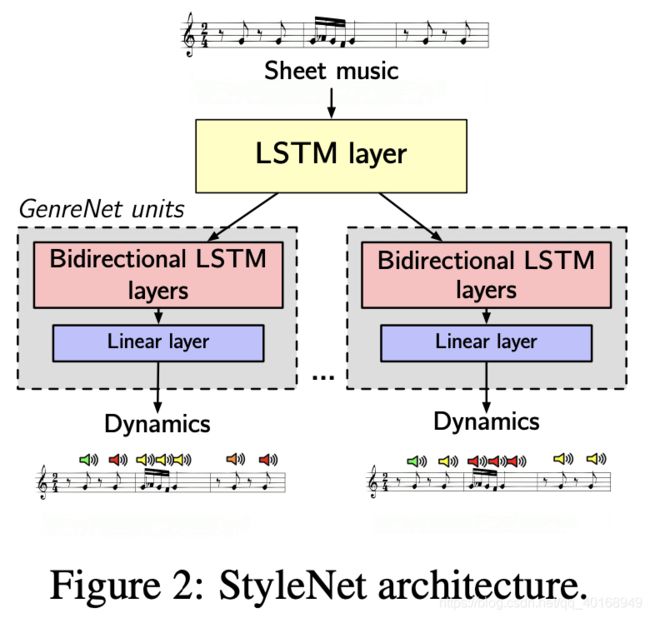

单个的GenreNet 从note序列中学习dynamic信息,但是只学到一种题材的。多个GenreNet组合成为StyleNet,建模多种不同的风格。

测试:

(1)Identify the Human:受测者判断是否能够区分真正创作者的音乐和AI生成的音乐;

(2)Identify the Style:受测者判断音乐属于Classical或者jazz

6. 【改变乐器的音色,不改变节奏等信息】TimbreTron- A WaveNet (CycleGAN(CQT(Audio))) Pipeline for Musical Timbre Transfer 【2019 ICLR】

视频demo-做的蛮好的

开源代码

musical timbre transfer :只改变乐器的音色,不改变音乐中的节奏等其他的音乐信息。

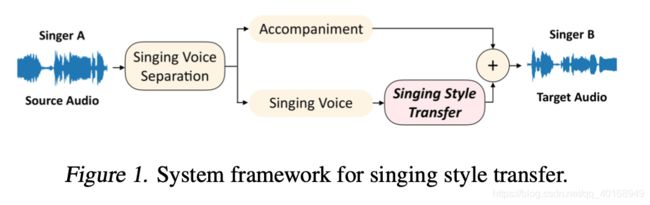

7.【歌唱风格转换 (像是特殊音色转换)】Singing Style Transfer Using Cycle-Consistent Boundary Equilibrium Generative Adversarial Networks【2018 ICML】

- 首先将source分离成伴奏和vocal,

- 然后对vocal进行歌唱风格转换,最后和伴奏合起来(本文的关注点,假设输入的vocal是干净的)

中/英文demo,source是干净的清唱,conversion-target像是加电音的歌唱(韵律节奏不变)

[说话风格转换]Cycle-consistent Adversarial Networks for Non-parallel Vocal Effort Based Speaking Style Conversion[2019 icassp]

语音demo

emotion

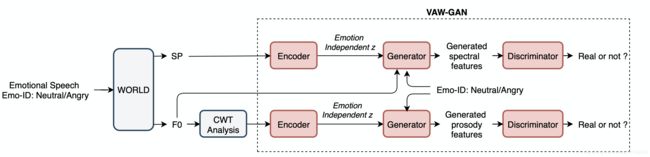

Converting Anyone’s Emotion:Towards Speaker-Independent Emotional Voice Conversion [2020-10, LHZ]

code and demo

语音质量很差,对判断模型是否有效干扰很大。

EVC(emotional voice conversion):保留语音中的文本信息和说话人特征,转换情感。说话人无关的emotion state,基于非平行数据和VAW-GAN。

情感转换和spectral以及prosody的转换都有关系。

传统的VC只关注spectral的转换。