stable diffusion使用入门

目录

1、stable diffusion简要说明

2、安装stable-diffusion-webui

(1)下载地址

(2)执行启动命令

3、Lora模型介绍

4、模型下载

(1)Lora模型使用

(2)底座模型使用

1、stable diffusion简要说明

根据文本的描述产生详细图像,它是一种潜在扩散模型。

(1)反向提示词:允许用户指定模型在图像生成过程中应该避免的提示,适用于由于用户提供的普通提示词,或者由于模型最初的训练,造成图像输出中出现不良的图像特征。与使用强调符相比,使用反向提示词在降低生成不良的图像的频率方面具有高度统计显著的效果。

(2)Img2Img:它接受一个提示词、现有图像的文件路径和0.0~0.1之间的去操强度,并在原始图像的基础上产生一个新的图像,该图像也具有提示词中提供的元素。去噪强度表示添加到输出图像的噪声量,值越大,图像变化越多,但在语义上可能与提供的提示不一致。

2、安装stable-diffusion-webui

这个工具是使用stable diffusion模型的web工程

(1)下载地址

从 https://github.com/AUTOMATIC1111/stable-diffusion-webui 下载 stable-diffusion-webui源码本地进行编译。

(2)执行启动命令

python launch.py --deepdanbooru --port 6006 --theme dark --share –xformers

通过share参数使用gradio工具可以得到公网的地址

python launch.py --deepdanbooru --listen --port 12346 --theme dark --xformers

通过listen参数可以通过ip地址访问服务,否则只能在部署的本机通过127.0.0.1访问服务。

第一次启动过程中可能会遇到各种报错,尤其是python包兼容的问题,不过不用担心你遇到的错误别人都遇到过,直接Goole里面找解法就行,大部分都是因为本地环境的软件版本不符导致的,通过升级版本即可,启动过程比较慢耐心等待。

如果需要模型在服务器上一直处于运行状态,可以参考nohup或者tmux命令。

3、Lora模型介绍

Lora模型是一种轻量级模型方案,它能够在底座模型的基础上训练指定风格或任务子模型。

比如上面的效果,使用的底座模型是:majicmixRealistic_v4;LoRA补丁模型是144M。

4、模型下载

Civitai是一个让人们可以轻松分享和发现AI艺术创作资源的平台。平台用户可以上传和共享他们使用自己的数据训练的AI生成自定义模型,或者浏览和下载其他用户创建的模型。然后可以将这些模型与 AI 艺术软件一起使用,以生成独特的艺术作品。

CivitAI官网地址:https://civitai.com/?utm_source=nettsz.com

底座模型可以从HuggingFace官网下载,地址为:https://huggingface.co/decapoda-research

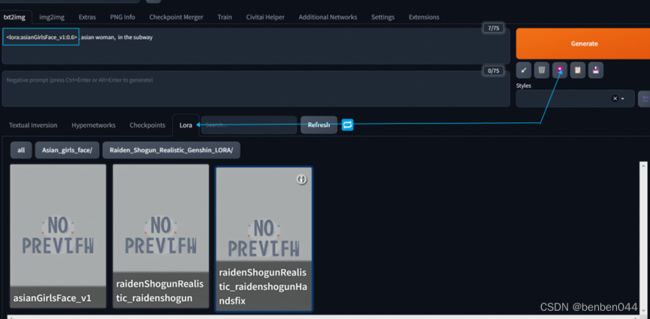

(1)Lora模型使用

Lora模型下载后放在如下目录中:xx/stable-diffusion-webui/models/Lora/

然后刷新模型,就可以在prompts中使用lora模型了。

(2)底座模型使用

一般在huggingface中下载,模型后缀也是safetensors结尾。比如majicmixRealistic_v4的链接地址为:https://huggingface.co/alanwalk/majicmixRealistic_v4.safetensors

底座模型下载后放在如下目录中:xx/stable-diffusion-webui/models/Stable-diffusion/ , 同SD-1.5底座模型在同一个位置。

然后在checkpoint中刷新,选择刚才下载的模型如下:

civitAI中Clip skip是在UI的Settings中进行设置,如下所示: