Docker-Cgroup 资源配置方法

前言

docker 使用cgroup控制资源,K8S 里面也有 limit (使用上限)

Docker通过 Cgroup 来控制容器使用的资源配额,包括 CPU、内存、磁盘三大方面, 基本覆盖了常见的资源配额和使用量控制。

Cgroup 是 Control Groups 的缩写,是Linux 内核提供的一种可以限制、记录、隔离进程组所使用的物理资源(如 CPU、内存、磁盘 IO 等等)的机制

07年谷歌,可以控制资源分配通过操作系统内核,控制应用程序使用内存资源、cpu资源、 文件系统资源等等

cgroup是一种资源控制手段

也是容器隔离的6个名称空间的一种实现手段

每个容器相当于一个进程

CPU使用率控制

cpu周期: 1s为一个周期的定律,参数值一般为100000 (CPU衡量单位是秒)

假如需要给此容器分配cpu使用率的20%,则参数需要设置为20000,相当于每个周期分配给这个容器0.2s

cpu在一个时刻,只能给一个进程占用

一、使用 stress 工具测试 CPU 和内存

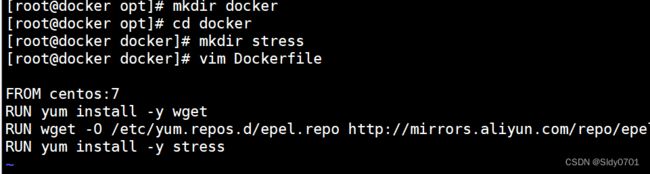

使用 Dockerfile 来创建一个基于 Centos 的 stress 工具镜像。

[root@localhost ~]# mkdir /opt/stress

[root@localhost ~]# vim /opt/stress/Dockerfile

FROM centos:7

RUN yum install -y wget

RUN wget -O /etc/yum.repos.d/epel.repo http://mirrors.aliyun.com/repo/epel-7.repo

RUN yum install -y stress

[root@localhost ~]# cd /opt/stress/

[root@localhost stress]# docker build -t centos:stress .

使用如下命令创建容器,命令中的–cpu-shares 参数值不能保证可以获得 1 个 vcpu 或 者多少 GHz 的 CPU 资源,它仅是一个弹性的加权值。

[root@docker stress]# docker run -itd --cpu-shares 100 centos:stress

f7e01bda640b16b0616226483a518036edd43a0c9332a1eb1293c182e076d391

nginx

upstream tomcat_server {

192.168.226.129:8080 weight=1

192.168.226.130:8080 weight=2

}

说明:默认情况下,每个 Docker容器的CPU份额都是1024。单独一个容器的份额是没有意义的。只有在同时运行多个容器时,容器的 CPU 加权的效果才能体现出来。

例如,两个容 器 A、B 的 CPU 份额分别为 1000 和 500,在CPU进行时间片分配的时候,容器A比容器B多一倍的机会获得 CPU 的时间片。

但分配的结果取决于当时主机和其他容器的运行状态, 实际上也无法保证容器 A一定能获得CPU时间片。比如容器A的进程一直是空闲的,

那么容器B是可以获取比容器A更多的CPU时间片的。极端情况下,例如主机上只运行了一个容器,即使它的 CPU 份额只有 50,它也可以独占整个主机的CPU资源。

一个主机运行一个容器,只运行了一个应用(容器也是虚拟化技术 )

一个主机运行一个应用

Cgroups 只在容器分配的资源紧缺时,即在需要对容器使用的资源进行限制时,才会生效。因此,无法单纯根据某个容器的CPU份额来确定有多少CPU资源分配给它,

资源分配 结果取决于同时运行的其他容器的CPU分配和容器中进程运行情况。

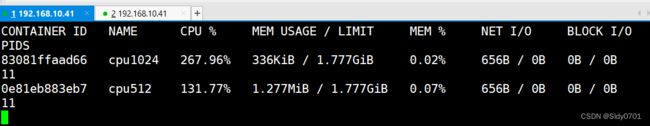

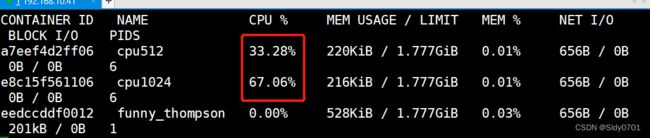

可以通过 cpu share 可以设置容器使用 CPU 的优先级/权重,比如启动了两个容器及运行查看 CPU 使用百分比。

[root@docker stress]# docker run -tid --name cpu512 --cpu-shares 512 centos:stress stress -c 10 //容器产生10个子函数进程

[root@dockert stress]# docker exec -it f4953c0d7e76 bash //进入容器使用top查看cpu使用情况

//再开启一个容器做比较

[root@docker stress]# docker run -tid --name cpu1024 --cpu-shares 1024 centos:stress stress -c 10

[root@localhost stress]# docker exec -it 5590c57d27b0 bash //进容器使用top对比两个容器的%CPU,比例是1:2

二、CPU 周期限制

Docker 提供了–cpu-period、–cpu-quota 两个参数控制容器可以分配到的 CPU 时钟周期。

–cpu-period 是用来指定容器对 CPU 的使用要在多长时间内做一次重新分配。

cd /sys/fs/cgroup/cpu/docker容器ID/cpu.cfs_quota_us

[root@docker root4]# cd /sys/fs/

[root@docker fs]# ls

bpf cgroup pstore selinux xfs

[root@docker fs]# cd cgroup/

[root@docker cgroup]# ls

blkio cpuacct cpuset freezer memory net_cls,net_prio perf_event systemd

cpu cpu,cpuacct devices hugetlb net_cls net_prio pids

[root@docker cgroup]# cd cpu

[root@docker cpu]# ls'

> ^C

[root@docker cpu]# ls

cgroup.clone_children cpuacct.usage cpu.rt_runtime_us notify_on_release

cgroup.event_control cpuacct.usage_percpu cpu.shares release_agent

cgroup.procs cpu.cfs_period_us cpu.stat system.slice

cgroup.sane_behavior cpu.cfs_quota_us docker tasks

cpuacct.stat cpu.rt_period_us machine.slice user.slice

[root@docker cpu]# cd docker/

[root@docker docker]# ls

0e81eb883eb7ea51eb2e324a2fb2b33aecd88e4a80bb328af7d9e53255f65513 cpu.cfs_period_us

83081ffaad66f7e9833727001c9f93f9389b7da21b57ef7a70084f4f419d701f cpu.cfs_quota_us

cgroup.clone_children cpu.rt_period_us

cgroup.event_control cpu.rt_runtime_us

cgroup.procs cpu.shares

cpuacct.stat cpu.stat

cpuacct.usage notify_on_release

cpuacct.usage_percpu tasks

[root@docker docker]# cd 0e81eb883eb7ea51eb2e324a2fb2b33aecd88e4a80bb328af7d9e53255f65513/

[root@docker 0e81eb883eb7ea51eb2e324a2fb2b33aecd88e4a80bb328af7d9e53255f65513]# ls

cgroup.clone_children cpuacct.stat cpu.cfs_period_us cpu.rt_runtime_us notify_on_release

cgroup.event_control cpuacct.usage cpu.cfs_quota_us cpu.shares tasks

cgroup.procs cpuacct.usage_percpu cpu.rt_period_us cpu.stat

[root@docker 0e81eb883eb7ea51eb2e324a2fb2b33aecd88e4a80bb328af7d9e53255f65513]#

1、宿主机怎么提供资源、怎么控制docker容器中的应用的:

CPU —>VCPU–>以进程的方式体现在vorkstation环境(docker环境中)—》docker表现形式是容器

–>Vcpu以进程的方式控制容器–》容器中的应用需要的是服务进程支持–》宿主机内核中cpu可以被cgroup管理(通过

分配资源手段)–》linux 内核中的cgroup可以控制管理docker 容器中的应用

–cpu-quota 是用来指定在这个周期内,最多可以有多少时间用来跑这个容器。

与 --cpu-shares 不同的是,这种配置是指定一个绝对值,容器对 CPU 资源的使用绝对不会超过配置的值。

cpu-period 和 cpu-quota 的单位为微秒(μs)。cpu-period 的最小值为 1000 微秒, 最大值为 1 秒(10^6 μs),默认值为 0.1 秒(100000 μs)。

cpu-quota 的值默认为 -1, 表示不做控制。cpu-period 和 cpu-quota 参数一般联合使用。

redis 中,用来表示的永久 -1

ttl teacher

-1

lrange teacher 0 -1

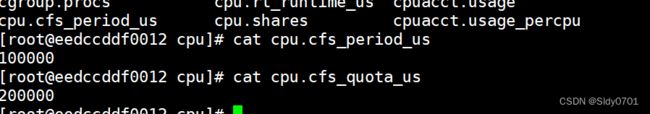

例如:容器进程需要每 1 秒使用单个 CPU 的 0.2 秒时间,可以将 cpu-period 设置 为 1000000(即 1 秒),cpu-quota 设置为 200000(0.2 秒)。

当然,在多核情况下,如果允许容器进程完全占用两个 CPU,则可以将 cpu-period 设置为 100000(即 0.1 秒), cpu-quota 设置为 200000(0.2 秒)。

[root@localhost stress]# docker run -tid --cpu-period 100000 --cpu-quota 200000 centos:stress

[root@localhost stress]# docker exec -it 98d2aaa50019 bash

[root@docker stress]# docker run -tid --cpu-period 100000 --cpu-quota 200000 centos:stress

eedccddf00128f82fd1a9488a369310fc511bd16641140cac83094e42de0edc7

[root@docker stress]# docker ps -a

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

eedccddf0012 centos:stress "/bin/bash" About a minute ago Up About a minute funny_thompson

[root@docker stress]# docker exec -it eedccddf0012 /bin/bash

[root@eedccddf0012 /]# cd /sys

[root@eedccddf0012 sys]# cd fs

[root@eedccddf0012 fs]# cd cgroup/

[root@eedccddf0012 cgroup]# ls

blkio cpuacct freezer net_cls perf_event

cpu cpuset hugetlb net_cls,net_prio pids

cpu,cpuacct devices memory net_prio systemd

[root@eedccddf0012 cgroup]# cd cpu

[root@eedccddf0012 cpu]# ls

cgroup.clone_children cpu.cfs_quota_us cpu.stat notify_on_release

cgroup.event_control cpu.rt_period_us cpuacct.stat tasks

cgroup.procs cpu.rt_runtime_us cpuacct.usage

cpu.cfs_period_us cpu.shares cpuacct.usage_percpu

[root@eedccddf0012 cpu]# cat cpu.cfs_period_us

100000

[root@eedccddf0012 cpu]# cat cpu.cfs_quota_us

200000

###查询容器的资源限制参数

2、在指定容器目录中

[root@98d2aaa50019 /]# cat /sys/fs/cgroup/cpu/docker/容器ID/cpu.cfs_period_us

100000

[root@98d2aaa50019 /]# cat /sys/fs/cgroup/cpu/docker/容器ID/cpu.cfs_quota_us

200000

3、使用docker inspect 容器ID/容器名

"CpuPeriod": 100000,

"CpuQuota": 200000,

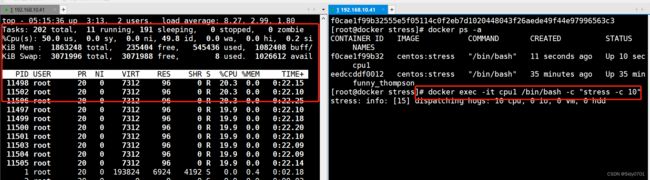

三、CPU Core 控制

对多核 CPU 的服务器,Docker 还可以控制容器运行使用哪些 CPU 内核,即使用–cpuset-cpus 参数。

这对具有多 CPU 的服务器尤其有用,可以对需要高性能计算的容器进行性能最优的配置。

[root@docker stress]# docker run -tid --name cpu1 --cpuset-cpus 0-1 centos:stress

f0cae1f99b32555e5f05114c0f2eb7d1020448043f26aede49f44e97996563c3

[root@docker stress]# docker ps -a

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

f0cae1f99b32 centos:stress "/bin/bash" 11 seconds ago Up 10 seconds cpu1

eedccddf0012 centos:stress "/bin/bash" 35 minutes ago Up 35 minutes funny_thompson

[root@docker stress]# docker run -tid --name cpu1 --cpuset-cpus 0-1 cent

f0cae1f99b32555e5f05114c0f2eb7d1020448043f26aede49f44e97996563c3

[root@docker stress]# docker ps -a

CONTAINER ID IMAGE COMMAND CREATED STATUS NAMES

f0cae1f99b32 centos:stress "/bin/bash" 11 seconds ago Up 10 seco cpu1

eedccddf0012 centos:stress "/bin/bash" 35 minutes ago Up 35 minu funny_thompson

[root@docker stress]# docker exec -it cpu1 /bin/bash -c "stress -c 10"

stress: info: [15] dispatching hogs: 10 cpu, 0 io, 0 vm, 0 hdd

执行以上命令需要宿主机为双核,表示创建的容器只能用 0、1两个内核。最终生成 的 cgroup 的 CPU 内核配置如下:

[root@dockerstress]#cat/sys/fs/cgroup/cpuset/docker/f8481d4957529e5c9ed392d169c3dba0f076399bf46132e3073e8e10c7983ec4/cpuset.cpus

0-1

通过下面指令可以看到容器中进程与 CPU 内核的绑定关系,达到绑定 CPU 内核的目的。

[root@localhost stress]# docker exec 631eea630b21 taskset -c -p 1 //容器内部第一个进程号pid为1被绑定到指定CPU上运行

pid 1’s current affinity list: 0,1

1、创建容器时 直接使用参数指定资源限制

2、创建容器后,指定资源分配

修改宿主机对应容器资源控制的文件

/sys/fs/cgroup/*

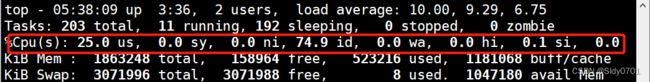

四、CPU 配额控制参数的混合使用

通过 cpuset-cpus 参数指定容器 A 使用 CPU 内核 0,容器 B 只是用 CPU 内核 1。

在主机上只有这两个容器使用对应 CPU 内核的情况,它们各自占用全部的内核资源,cpu-shares 没有明显效果。

cpuset-cpus、cpuset-mems 参数只在多核、多内存节点上的服务器上有效,并且必须与实际的物理配置匹配,否则也无法达到资源控制的目的。

在系统具有多个 CPU 内核的情况下,需要通过 cpuset-cpus 参数为设置容器 CPU 内核才能方便地进行测试。

//宿主系统修改为4核心CPU

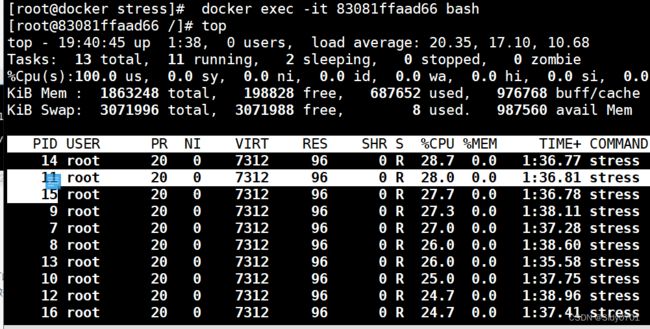

[root@docker stress]#docker run -tid --name cpu512 --cpuset-cpus 1 --cpu-shares 512 centos:stress stress -c 5

a7eef4d2ff06a8df21067bee6ea0a67f2a9aecac0d89bae18faea13

[root@docker stress]# docker run -tid --name cpu1024 --cpuset-cpus 1 --cpu-shares 1024 centos:stress stress -c 5

e8c15f5611063f12c72b4c057d6bfa6359352aae562eee168f966abff6389d75

[root@docker stress]# docker ps -a

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

e8c15f561106 centos:stress "stress -c 5" 13 seconds ago Up 12 seconds cpu1024

45025186b16e centos:stress "stress -c 5" About a minute ago Up About a minute cpu3

eedccddf0012 centos:stress "/bin/bash" About an hour ago Up About an hour funny_thompson

[root@docker stress]# docker exec -it a7eef4d2ff06 bash

[root@a7eef4d2ff06 /]# exit

exit

[root@localhost stress]# top //记住按1查看每个核心的占用

Tasks: 172 total, 2 running, 170 sleeping, 0 stopped, 0 zombie

%Cpu0 : 0.0 us, 0.0 sy, 0.0 ni,100.0 id, 0.0 wa, 0.0 hi, 0.0 si, 0.0 st

%Cpu1 : 0.0 us, 0.0 sy, 0.0 ni,100.0 id, 0.0 wa, 0.0 hi, 0.0 si, 0.0 st

%Cpu2 : 0.0 us, 0.0 sy, 0.0 ni,100.0 id, 0.0 wa, 0.0 hi, 0.0 si, 0.0 st

%Cpu3 :100.0 us, 0.0 sy, 0.0 ni, 0.0 id, 0.0 wa, 0.0 hi, 0.0 si, 0.0 st

KiB Mem : 7994072 total, 6394056 free, 450124 used, 1149892 buff/cache

KiB Swap: 4194300 total, 4194300 free, 0 used. 7174064 avail Mem

[root@localhost stress]# docker run -tid --name cpu4 --cpuset-cpus 3 --cpu-shares 1024 centos:stress stress -c 1

[root@localhost stress]# docker exec -it 0eed2c8a20df bash

总结

上面的 centos:stress 镜像安装了 stress 工具,用来测试 CPU 和内存的负载。通过 在两个容器上分别执行 stress -c 1 命令,

将会给系统一个随机负载,产生 1 个进程。这个进程都反复不停的计算由 rand() 产生随机数的平方根,直到资源耗尽。

观察到宿主机上的 CPU 使用率,第三个内核的使用率接近 100%, 并且一批进程的 CPU 使用率明显存在 2:1 的使用比例的对比。

五、内存限额

与操作系统类似,容器可使用的内存包括两部分:物理内存和 Swap。

Docker 通过下面两组参数来控制容器内存的使用量。

-m 或 --memory:设置内存的使用限额,例如 100M、1024M。

–memory-swap:设置 内存+swap 的使用限额。

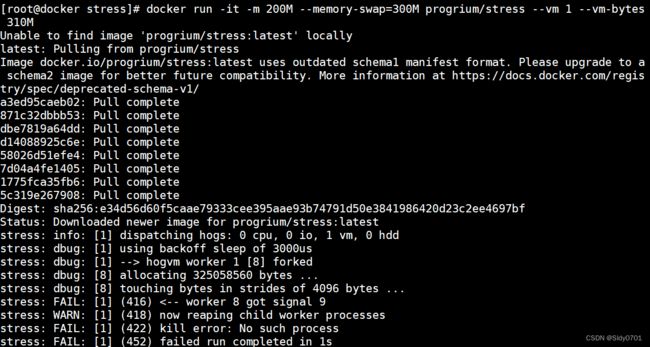

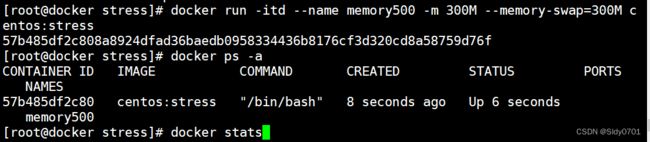

执行如下命令允许该容器最多使用 200M 的内存和 300M 的 swap。

[root@docker stress]# docker run -itd --name memory500 -m 300M --memory-swap=300M centos:stress 57b485df2c808a8924dfad36baedb0958334436b8176cf3d320cd8a58759d76f [root@docker stress]# docker ps -a CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES 57b485df2c80 centos:stress "/bin/bash" 8 seconds ago Up 6 seconds memory500 #单纯做swap和物理内存的硬限制

–vm 1:启动 1 个内存工作线程。

–vm-bytes 280M:每个线程分配 280M 内存。

默认情况下,容器可以使用主机上的所有空闲内存。

与 CPU 的 cgroups 配置类似, Docker 会自动为容器在目录 /sys/fs/cgroup/memory/docker/<容器的完整长 ID>

中创建相应 cgroup 配置文件

如果让工作线程分配的内存超过 300M,分配的内存超过限额,stress 线程报错,容器 退出。

[root@docker stress]# docker run -it -m 200M --memory-swap=300M progrium/stress --vm 1 --vm-bytes 310M

Unable to find image 'progrium/stress:latest' locally

latest: Pulling from progrium/stress

Image docker.io/progrium/stress:latest uses outdated schema1 manifest format. Please upgrade to a schema2 image for better future compatibility. More information at https://docs.docker.com/registry/spec/deprecated-schema-v1/

a3ed95caeb02: Pull complete

871c32dbbb53: Pull complete

dbe7819a64dd: Pull complete

d14088925c6e: Pull complete

58026d51efe4: Pull complete

7d04a4fe1405: Pull complete

1775fca35fb6: Pull complete

5c319e267908: Pull complete

Digest: sha256:e34d56d60f5caae79333cee395aae93b74791d50e3841986420d23c2ee4697bf

Status: Downloaded newer image for progrium/stress:latest

stress: info: [1] dispatching hogs: 0 cpu, 0 io, 1 vm, 0 hdd

stress: dbug: [1] using backoff sleep of 3000us

stress: dbug: [1] --> hogvm worker 1 [8] forked

stress: dbug: [8] allocating 325058560 bytes ...

stress: dbug: [8] touching bytes in strides of 4096 bytes ...

stress: FAIL: [1] (416) <-- worker 8 got signal 9

stress: WARN: [1] (418) now reaping child worker processes

stress: FAIL: [1] (422) kill error: No such process

stress: FAIL: [1] (452) failed run completed in 1s

六、Block IO 的限制

默认情况下,所有容器能平等地读写磁盘,可以通过设置–blkio-weight 参数来改变 容器 block IO 的优先级。

–blkio-weight 与 --cpu-shares 类似,设置的是相对权重值,默认为 500。

在下面 的例子中,容器 A 读写磁盘的带宽是容器 B 的两倍。

[root@docker stress]# docker run -it --name container_A --blkio-weight 600 centos:stress

[root@350e948a790a /]# cat /sys/fs/cgroup/blkio/blkio.weight

600

[root@localhost docker]# docker run -it --name container_B --blkio-weight 300 centos:stress

[root@9f5062a35cec /]# cat /sys/fs/cgroup/blkio/blkio.weight

300

七、bps 和 iops 的限制

bps 是 byte per second,每秒读写的数据量。

iops 是 io per second,每秒 IO 的次数。

可通过以下参数控制容器的 bps 和 iops:

–device-read-bps,限制读某个设备的 bps。

–device-write-bps,限制写某个设备的 bps。

–device-read-iops,限制读某个设备的 iops。

–device-write-iops,限制写某个设备的 iops。

下面的示例是限制容器写 /dev/sda 的速率为 5 MB/s。

[root@localhost docker]# docker run -it --device-write-bps /dev/sda:5MB centos:stress

[root@96a5d7c68b96 /]# dd if=/dev/zero of=test bs=1M count=1024 oflag=direct //可以按ctrl+c中断查看

906+0 records in

906+0 records out

950009856 bytes (950 MB) copied, 181.202 s, 5.2 MB/s

通过 dd 命令测试在容器中写磁盘的速度。因为容器的文件系统是在 host /dev/sda 上 的,

在容器中写文件相当于对 host /dev/sda 进行写操作。另外,oflag=direct 指定用 direct IO 方式写文件,

这样 --device-write-bps 才能生效。

结果表明限速 5MB/s 左右。作为对比测试,如果不限速,结果如下。

[root@localhost docker]# docker run -it centos:stress

[root@10531445df8d /]# dd if=/dev/zero of=test bs=1M count=1024 oflag=direct

1024+0 records in

1024+0 records out

1073741824 bytes (1.1 GB) copied, 0.928611 s, 1.2 GB/s

构建镜像(docker build)时指定资源限制

–build-arg=[] : 设置镜像创建时的变量;

–cpu-shares : 设置 cpu 使用权重;

–cpu-period : 限制 CPU CFS周期;

–cpu-quota : 限制 CPU CFS配额;

–cpuset-cpus : 指定使用的CPU id;

–cpuset-mems : 指定使用的内存 id;

–disable-content-trust :忽略校验,默认开启;

-f : 指定要使用的Dockerfile路径;

–force-rm : 设置镜像过程中删除中间容器;

–isolation : 使用容器隔离技术;

–label=[] : 设置镜像使用的元数据;

-m : 设置内存最大值;

–memory-swap : 设置Swap的最大值为内存+swap,"-1"表示不限swap;

–no-cache : 创建镜像的过程不使用缓存;

–pull : 尝试去更新镜像的新版本;

–quiet, -q : 安静模式,成功后只输出镜像 ID;

–rm : 设置镜像成功后删除中间容器;

–shm-size : 设置/dev/shm的大小,默认值是64M;

–ulimit : Ulimit配置。

–squash : 将 Dockerfile 中所有的操作压缩为一层。

–tag, -t: 镜像的名字及标签,通常 name:tag 或者 name 格式;可以在一次构建中为一个镜像设置多个标签。

–network: 默认 default。在构建期间设置RUN指令的网络模式

小结

1、资源限制的主要类型

1、CPU 权重shares、quota、cpuset

2、磁盘 BPS、TPS限制,指定使用哪个磁盘、磁盘分区

3、内存 -m -swap 内存、交换分区

大部分做的是上限的限制

2、资源限制的几种方式

1、build 构建镜像时,可以指定该镜像的资源限制

2、run 将镜像跑为容器的时候,可以指定容器的资源限制

3、容器启动之后, 可以在宿主机对应容器的目录下。修改资源限制,然后重载

/sys/fs/cgroup/*(cpu、blk、mem)/docker/容器ID/ —>修改对应的资源限制文件参数就可以

3、资源限制的状态查询

(1)、docker inspect 镜像ID/容器ID

(2)、直接查看宿主机对应容器ID资源限制的文件

cgroup 资源 docker 原理之一 ,namespaces 6个名称空间

docker inspect ### 可以查看docker里面有多少个容器