- guava loadingCache代码示例

IM 胡鹏飞

Java工具类介绍

publicclassTest2{publicstaticvoidmain(String[]args)throwsException{LoadingCachecache=CacheBuilder.newBuilder()//设置并发级别为8,并发级别是指可以同时写缓存的线程数.concurrencyLevel(8)//设置缓存容器的初始容量为10.initialCapacity(10)//设置缓存

- docker-compose方式搭建lnmp环境——筑梦之路

筑梦之路

linux系统运维国产化dockerandroidadb

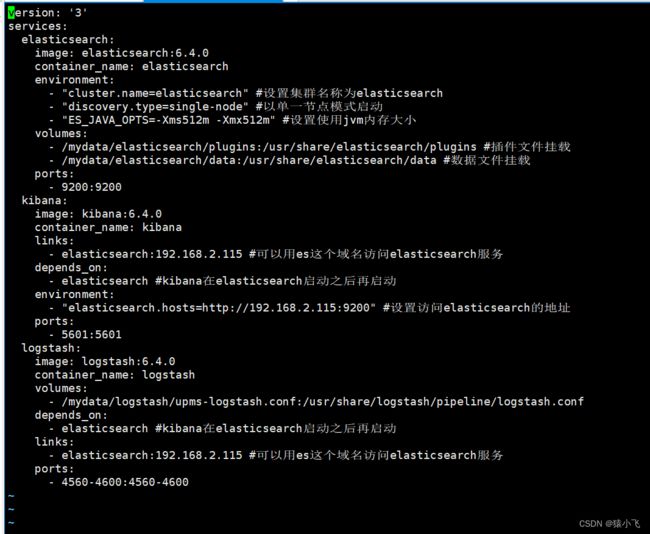

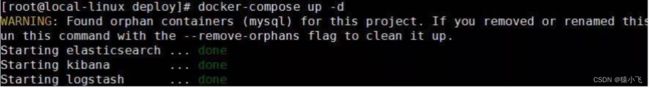

docker-compose.yml文件#生成docker-compose.ymlcat>docker-compose.ymlnginx/conf.d/default.conf">www/index.phpecho"开始启动服务..."docker-composeup-d#获取本机ipip_addr=$(hostname-I|awk'{print$1}')echo"部署完成!"echo"访问测试页

- EMQX 社区版单机和集群部署

pcj_888

MQTTMQTTEMQ

EMQ支持Docker,宿主机,k8s部署;支持单机或集群部署。以下给出EMQX社区版单机和集群部署方法1.Docker单机部署官方推荐最小配置:2核4G下载容器镜像dockerpullemqx/emqx:5.3.2启动容器dockerrun-d--nameemqx\-p1883:1883\-p8083:8083\-p8883:8883\-p8084:8084\-p18083:18083\emqx

- docker安装node部分问题

自律的蜗牛

docker容器node.js

sudonlatestsudo:n:commandnotfound如果运行sudonlatest时出现:sudo:n:commandnotfound说明n版本管理工具未安装或未添加到PATH环境变量。解决方案1️⃣先检查n是否已安装运行:whichn或者:command-vn如果有输出/usr/local/bin/n,说明n已安装,但可能需要sudo访问。如果没有任何输出,说明n没有安装,跳到方法

- 玩转Docker | 使用Docker部署gopeed下载工具

心随_风动

玩转Dockerdocker容器运维

玩转Docker|使用Docker部署gopeed下载工具前言一、gopeed介绍Gopeed简介主要特点二、系统要求环境要求环境检查Docker版本检查检查操作系统版本三、部署gopeed服务下载镜像创建容器检查容器状态检查服务端口安全设置四、访问gopeed应用五、测试与下载六、总结前言在当今信息爆炸的时代,高效地获取和管理网络资源变得尤为重要。无论是下载大型文件还是进行日常的数据传输,一个稳

- Docker指定网桥和指定网桥IP

$dockernetworklsNETWORKIDNAMEDRIVER7fca4eb8c647bridgebridge9f904ee27bf5nonenullcf03ee007fb4hosthostBridge默认bridge网络,我们可以使用dockernetworkinspect命令查看返回的网络信息,我们使用dockerrun命令是将网络自动应用到新的容器Host如果是hosts模式,启动容

- docker0网卡没有ip一步解决

ξ流ぁ星ぷ132

tcp/ip网络服务器

正常查看ip的时候一直显示没有ip这里先删除docker0网卡iplinkdeletedocker0然后重启服务systemctlrestartdocker再次查看显示有ip了并且查看配置文件也是正常的cat/etc/docker/daemon.json{"registry-mirrors":["https://docker.m.daocloud.io","https://docker.imgdb

- 系统迁移从CentOS7.9到Rocky8.9

我有两台阿里云上的服务器是CentOS7.9,由于CentOS7已经停止支持,后续使用的话会有安全漏洞,所以需要尽快迁移,个人使用的话目前兼容性好的还是RockyLinux8,很多脚本改改就能用了。一、盘点系统和迁移应用查看当前系统发行版版本cat/etc/os-release盘点迁移清单服务器应用部署方式docker镜像来源v1wordpressdockerdockerhubv1zdirdock

- Docker容器底层原理详解:从零理解容器化技术

Debug Your Career

面试docker容器dockerjava

一、容器本质:一个“隔离的进程”关键认知:Docker容器并不是一个完整的操作系统,而是一个被严格隔离的进程。这个进程拥有独立的文件系统、网络、进程视图等资源,但它直接运行在宿主机内核上(而虚拟机需要模拟硬件和操作系统)。类比理解:想象你在一个办公楼里租了一间独立办公室(容器)。你有自己的桌椅(文件系统)、电话分机(网络)、门牌号(主机名),但共享整栋楼的水电(宿主机内核)和电梯(硬件资源)。办公

- 在 Windows 上安装 Docker Desktop

不老刘

人工智能windowsdocker容器

还是简单说一下,如何在Windows上安装DockerDesktop,具体步骤如下:系统要求Windows10/1164-bit(专业版、企业版或教育版,版本21H2或更高)启用WSL2(WindowsSubsystemforLinux2)或Hyper-V至少4GB内存BIOS中启用虚拟化(VT-x/AMD-V)安装步骤1.下载DockerDesktop访问Docker官网下载页面。下载Docke

- C++STL-set

s15335

C++STLc++开发语言

一.基础概念set也是一种容器,像vector,string这样,但它是树形容器。在物理结构上是二叉搜索树,逻辑上还是线性结构。set容器内元素不可重复,multiset内容器元素可以重复;这两个容器,插入的元素都是有序排列。二.基础用法1.set对象创建1.默认构造函数sets1;2.初始化列表sets2_1={9,8,7,6,5};//56789sets2_2({9,8,7,7,6,5});/

- Spring WebFlux 响应式编程原理与实战指南

SpringWebFlux响应式编程原理与实战指南一、技术背景与应用场景随着微服务与高并发的迅速发展,传统的阻塞式编程模型在处理大量并发请求时容易导致线程资源耗尽、响应延迟增高。SpringWebFlux基于ReactiveStreams规范,通过非阻塞、背压机制,实现高吞吐、低延迟的Web服务。典型应用场景包括:实时数据推送:WebSocket或Server-SentEvents场景。高并发AP

- Kubernetes自动扩缩容方案对比与实践指南

浅沫云归

后端技术栈小结kubernetesautoscalingdevops

Kubernetes自动扩缩容方案对比与实践指南随着微服务架构和容器化的广泛采用,Kubernetes自动扩缩容(Autoscaling)成为保障生产环境性能稳定与资源高效利用的关键技术。面对水平Pod扩缩容、垂直资源调整、集群节点扩缩容以及事件驱动扩缩容等多种需求,社区提供了HPA、VPA、ClusterAutoscaler、KEDA等多种方案。本篇文章将从业务背景、方案对比、优缺点分析、选型建

- zookeeper etcd区别

sun007700

zookeeperetcd分布式

ZooKeeper与etcd的核心区别体现在设计理念、数据模型、一致性协议及适用场景等方面。ZooKeeper基于ZAB协议实现分布式协调,采用树形数据结构和临时节点特性,适合传统分布式系统;而etcd基于Raft协议,以高性能键值对存储为核心,专为云原生场景优化,是Kubernetes等容器编排系统的默认存储组件。12架构与设计目标差异ZooKeeper。设计定位:专注于分

- 面试官:Spring 如何控制 Bean 的加载顺序?

在大多数情况下,我们不需要手动控制Bean的加载顺序,因为Spring的IoC容器足够智能。核心原则:依赖驱动加载SpringIoC容器会构建一个依赖关系图(DependencyGraph)。如果BeanA依赖于BeanB(例如,A的构造函数需要一个B类型的参数),Spring会保证在创建BeanA之前,BeanB已经被完全创建和初始化好了。@ServicepublicclassServiceA{

- C++ 标准库 <numeric>

以下对C++标准库中头文件所提供的数值算法与工具做一次系统、深入的梳理,包括算法功能、示例代码、复杂度分析及实践建议。一、概述中定义了一组对数值序列进行累加、内积、差分、扫描等操作的算法,以及部分辅助工具(如std::iota、std::gcd/std::lcm等)。所有算法均作用于迭代器区间,符合STL风格,可与任意容器或原始数组配合使用。从C++17、20起,又陆续加入了并行友好的std::r

- 学习日记-spring-day45-7.10

永日45670

学习springjava

知识点:1.初始化Bean单例池完成getBeancreateBean(1)知识点核心内容重点单例词初始化在容器初始化阶段预先创建单例对象,避免在getBean时动态创建单例词必须在容器初始化时完成加载,否则会触发异常getBean方法逻辑1.从beanDefinitionMap查询BeanDefinition2.根据scope判断单例/多例3.单例:直接从单例词获取4.多例:反射动态创建新对象多

- Ubuntu 安装 RAGFlow 简单流程

steven_41936912

ubuntulinuxRAGFlow

Docker拉取镜像慢可以更换镜像源sudotee/etc/docker/daemon.json<<-'EOF'{"registry-mirrors":["https://docker.m.daocloud.io","https://docker.imgdb.de","https://docker-0.unsee.tech","https://docker.hlmirror.com","https

- c++中迭代器的本质

三月微风

c++开发语言

C++迭代器的本质与实现原理迭代器是C++标准模板库(STL)的核心组件之一,它作为容器与算法之间的桥梁,提供了统一访问容器元素的方式。下面从多个维度深入解析迭代器的本质特性。一、迭代器的基本定义与分类迭代器的本质迭代器是一种行为类似指针的对象,用于遍历和操作容器中的元素。它提供了一种统一的方式来访问不同容器中的元素,而无需关心容器的具体实现细节。标准分类体系C++标准定义了5种迭代器类型,按功能

- OpenWebUI系列之 如何通过docker自动将其更新到OpenWebUI最新版本

知识大胖

NVIDIAGPU和大语言模型开发教程dockerllmopenwebui

实战需求OpenWebUI是一个可扩展、功能丰富且用户友好的自托管WebUI,旨在完全离线运行。它支持各种LLM运行器,包括Ollama和OpenAI兼容API。如何通过docker自动将其更新到OpenWebUI最新版本?系列文章《OpenWebUI系列之如何通过docker更新到OpenWebUI的最新版本》权重0,本地类、opewebui类《OpenWebUI系列之如何通过docker自动将

- 远程登录docker执行shell报错input is not a terminal问题

背景最近要远程去k8sdocker里面获取信息,于是,写了一个如下的命令,执行完之后,报错了。ssh192.168.100.2sudocrictlexec-itxxx.docker/usr/bin/lscpu--online--extended错误信息如下:time=“2025-07-11T21:00:39+08:00”level=fatalmsg=“execingcommandincontain

- Docker高级管理 --Dockerfile镜像制作

牛爷爷敲代码

docker容器LNMPdockerfile镜像制作

Docker高级管理--Dockerfile镜像制作一、Dockerfile基础概念1.定义与作用定义:Dockerfile是一个包含创建Docker镜像所需指令的文本文件。作用:自动化镜像构建流程,避免手动配置的繁琐和不一致性。版本控制:Dockerfile可纳入代码仓库,便于团队协作和追踪变更。可重复性:相同的Dockerfile构建出的镜像内容完全一致。2.核心组件指令(Instructio

- 如何在Windows系统下使用Dockerfile构建Docker镜像:完整指南

996蹲坑

windowsdocker容器

前言Docker作为当前最流行的容器化技术,已经成为开发、测试和运维的必备工具。本文将详细介绍在Windows系统下使用Dockerfile构建Docker镜像的完整流程,包括两种镜像构建方式的对比、Dockerfile核心指令详解、实战案例演示以及Windows系统下的特殊注意事项。一、Docker镜像构建的两种方式1.容器转为镜像(不推荐)这种方式适合临时保存容器状态,但不适合生产环境使用:#

- Docker初识:mysql8主从复制(单向)- 主从搭建扩展知识

滴水可藏海

#mysql数据库

主从服务(master-slave)新学习到的知识。1、全库同步与部分同步上回书说到Docker初识:mysql8主从复制(单向)的配置都是针对全库配置的。但是实际上并不需要针对全库做备份,只需要对一些特别重要的库或者表来进行同步。例如information_schema等。可以通过配置文件中的一些属性指定需要针对哪些库或者哪些表记录binlog。Master配置:#需要同步的二进制数据库名bin

- 玩转Docker | 使用Docker部署HomeBox家庭库存管理工具

心随_风动

玩转Dockerdocker容器运维

玩转Docker|使用Docker部署HomeBox家庭库存管理工具前言一、HomeBox介绍Homebox简介主要特点主要使用场景二、系统要求环境要求环境检查Docker版本检查检查操作系统版本三、部署HomeBox服务下载HomeBox镜像编辑部署文件创建容器检查容器状态检查服务端口安全设置四、访问HomeBox服务访问HomeBox首页注册账号五、HomeBox使用体验总结前言随着智能家居和

- docker常见问题解决方法

小王聊技术

docker

目录迁移至其他服务器清理Docker占用的磁盘空间常见问题:迁移至其他服务器1.将docker容器导出dockerexport-o保存路径/xxx.tar容器id2.将容器tar远程拷贝到新的服务器(从新的服务器上向老服务器上请求复制)scproot@服务器地址:/data/xxx.tar/root3.将导入的tar包转为镜像dockerimport-cxxx.tarimage_name:tag

- 麒麟v10arm64自制nginx1.26.1的docker镜像包

睡不醒的双眼皮

dockernginx

#基础镜像openeuler2203arm64#1.宿主机下载nginx对应版本编译./configure--prefix=/usr/local/nginx--conf-path=/etc/nginx/nginx.conf&&make&&makeinstall2.#创建构建镜像目录mkdir/opt/dockerfilecp-r/usr/local/nginx/opt/dockerfile/ngi

- 玩转Docker | 使用Docker部署NotepadMX笔记应用程序

心随_风动

玩转Dockerdocker笔记eureka

玩转Docker|使用Docker部署NotepadMX笔记应用程序前言一、NotepadMX介绍工具简介主要特点二、系统要求环境要求环境检查Docker版本检查检查操作系统版本三、部署NotepadMX服务下载NotepadMX镜像编辑部署文件创建容器检查容器状态检查服务端口安全设置四、访问NotepadMX服务访问NotepadMX首页设置访问验证编辑笔记总结前言在如今快节奏的工作与学习中,一

- 三、【docker】docker和docker-compose的常用命令

文章目录一、docker常用命令1、镜像管理2、容器管理3、容器监控和调试4、网络管理5、数据卷管理6、系统维护7、实用组合命令8、常用技巧二、docker-compose常用命令1、基本命令2、构建相关3、运行维护4、常用组合命令5、实用参数一、docker常用命令1、镜像管理#查看本地镜像dockerimages#拉取镜像dockerpull:#删除镜像dockerrmi#构建镜像docker

- mac挂载阿里云盘做本地盘【webdav-aliyundriver】【CloudMounter】

木有会

杂七杂八家庭工作站鼓捣鼓捣

转自:提升工作效率-mac挂载阿里云盘做本地盘webdav-aliyundriver用来把阿里云盘变成本地文件服务器。CloudMounter这个工具可以用来挂载文件服务器当做本地磁盘。webdav-aliyundriver安装:github:https://github.com/messense/aliyundrive-webdav比较喜欢用docker,感觉干净些。下载镜像dockerpull

- ASM系列五 利用TreeApi 解析生成Class

lijingyao8206

ASM字节码动态生成ClassNodeTreeAPI

前面CoreApi的介绍部分基本涵盖了ASMCore包下面的主要API及功能,其中还有一部分关于MetaData的解析和生成就不再赘述。这篇开始介绍ASM另一部分主要的Api。TreeApi。这一部分源码是关联的asm-tree-5.0.4的版本。

在介绍前,先要知道一点, Tree工程的接口基本可以完

- 链表树——复合数据结构应用实例

bardo

数据结构树型结构表结构设计链表菜单排序

我们清楚:数据库设计中,表结构设计的好坏,直接影响程序的复杂度。所以,本文就无限级分类(目录)树与链表的复合在表设计中的应用进行探讨。当然,什么是树,什么是链表,这里不作介绍。有兴趣可以去看相关的教材。

需求简介:

经常遇到这样的需求,我们希望能将保存在数据库中的树结构能够按确定的顺序读出来。比如,多级菜单、组织结构、商品分类。更具体的,我们希望某个二级菜单在这一级别中就是第一个。虽然它是最后

- 为啥要用位运算代替取模呢

chenchao051

位运算哈希汇编

在hash中查找key的时候,经常会发现用&取代%,先看两段代码吧,

JDK6中的HashMap中的indexFor方法:

/**

* Returns index for hash code h.

*/

static int indexFor(int h, int length) {

- 最近的情况

麦田的设计者

生活感悟计划软考想

今天是2015年4月27号

整理一下最近的思绪以及要完成的任务

1、最近在驾校科目二练车,每周四天,练三周。其实做什么都要用心,追求合理的途径解决。为

- PHP去掉字符串中最后一个字符的方法

IT独行者

PHP字符串

今天在PHP项目开发中遇到一个需求,去掉字符串中的最后一个字符 原字符串1,2,3,4,5,6, 去掉最后一个字符",",最终结果为1,2,3,4,5,6 代码如下:

$str = "1,2,3,4,5,6,";

$newstr = substr($str,0,strlen($str)-1);

echo $newstr;

- hadoop在linux上单机安装过程

_wy_

linuxhadoop

1、安装JDK

jdk版本最好是1.6以上,可以使用执行命令java -version查看当前JAVA版本号,如果报命令不存在或版本比较低,则需要安装一个高版本的JDK,并在/etc/profile的文件末尾,根据本机JDK实际的安装位置加上以下几行:

export JAVA_HOME=/usr/java/jdk1.7.0_25

- JAVA进阶----分布式事务的一种简单处理方法

无量

多系统交互分布式事务

每个方法都是原子操作:

提供第三方服务的系统,要同时提供执行方法和对应的回滚方法

A系统调用B,C,D系统完成分布式事务

=========执行开始========

A.aa();

try {

B.bb();

} catch(Exception e) {

A.rollbackAa();

}

try {

C.cc();

} catch(Excep

- 安墨移动广 告:移动DSP厚积薄发 引领未来广 告业发展命脉

矮蛋蛋

hadoop互联网

“谁掌握了强大的DSP技术,谁将引领未来的广 告行业发展命脉。”2014年,移动广 告行业的热点非移动DSP莫属。各个圈子都在纷纷谈论,认为移动DSP是行业突破点,一时间许多移动广 告联盟风起云涌,竞相推出专属移动DSP产品。

到底什么是移动DSP呢?

DSP(Demand-SidePlatform),就是需求方平台,为解决广 告主投放的各种需求,真正实现人群定位的精准广

- myelipse设置

alafqq

IP

在一个项目的完整的生命周期中,其维护费用,往往是其开发费用的数倍。因此项目的可维护性、可复用性是衡量一个项目好坏的关键。而注释则是可维护性中必不可少的一环。

注释模板导入步骤

安装方法:

打开eclipse/myeclipse

选择 window-->Preferences-->JAVA-->Code-->Code

- java数组

百合不是茶

java数组

java数组的 声明 创建 初始化; java支持C语言

数组中的每个数都有唯一的一个下标

一维数组的定义 声明: int[] a = new int[3];声明数组中有三个数int[3]

int[] a 中有三个数,下标从0开始,可以同过for来遍历数组中的数

- javascript读取表单数据

bijian1013

JavaScript

利用javascript读取表单数据,可以利用以下三种方法获取:

1、通过表单ID属性:var a = document.getElementByIdx_x_x("id");

2、通过表单名称属性:var b = document.getElementsByName("name");

3、直接通过表单名字获取:var c = form.content.

- 探索JUnit4扩展:使用Theory

bijian1013

javaJUnitTheory

理论机制(Theory)

一.为什么要引用理论机制(Theory)

当今软件开发中,测试驱动开发(TDD — Test-driven development)越发流行。为什么 TDD 会如此流行呢?因为它确实拥有很多优点,它允许开发人员通过简单的例子来指定和表明他们代码的行为意图。

TDD 的优点:

&nb

- [Spring Data Mongo一]Spring Mongo Template操作MongoDB

bit1129

template

什么是Spring Data Mongo

Spring Data MongoDB项目对访问MongoDB的Java客户端API进行了封装,这种封装类似于Spring封装Hibernate和JDBC而提供的HibernateTemplate和JDBCTemplate,主要能力包括

1. 封装客户端跟MongoDB的链接管理

2. 文档-对象映射,通过注解:@Document(collectio

- 【Kafka八】Zookeeper上关于Kafka的配置信息

bit1129

zookeeper

问题:

1. Kafka的哪些信息记录在Zookeeper中 2. Consumer Group消费的每个Partition的Offset信息存放在什么位置

3. Topic的每个Partition存放在哪个Broker上的信息存放在哪里

4. Producer跟Zookeeper究竟有没有关系?没有关系!!!

//consumers、config、brokers、cont

- java OOM内存异常的四种类型及异常与解决方案

ronin47

java OOM 内存异常

OOM异常的四种类型:

一: StackOverflowError :通常因为递归函数引起(死递归,递归太深)。-Xss 128k 一般够用。

二: out Of memory: PermGen Space:通常是动态类大多,比如web 服务器自动更新部署时引起。-Xmx

- java-实现链表反转-递归和非递归实现

bylijinnan

java

20120422更新:

对链表中部分节点进行反转操作,这些节点相隔k个:

0->1->2->3->4->5->6->7->8->9

k=2

8->1->6->3->4->5->2->7->0->9

注意1 3 5 7 9 位置是不变的。

解法:

将链表拆成两部分:

a.0-&

- Netty源码学习-DelimiterBasedFrameDecoder

bylijinnan

javanetty

看DelimiterBasedFrameDecoder的API,有举例:

接收到的ChannelBuffer如下:

+--------------+

| ABC\nDEF\r\n |

+--------------+

经过DelimiterBasedFrameDecoder(Delimiters.lineDelimiter())之后,得到:

+-----+----

- linux的一些命令 -查看cc攻击-网口ip统计等

hotsunshine

linux

Linux判断CC攻击命令详解

2011年12月23日 ⁄ 安全 ⁄ 暂无评论

查看所有80端口的连接数

netstat -nat|grep -i '80'|wc -l

对连接的IP按连接数量进行排序

netstat -ntu | awk '{print $5}' | cut -d: -f1 | sort | uniq -c | sort -n

查看TCP连接状态

n

- Spring获取SessionFactory

ctrain

sessionFactory

String sql = "select sysdate from dual";

WebApplicationContext wac = ContextLoader.getCurrentWebApplicationContext();

String[] names = wac.getBeanDefinitionNames();

for(int i=0; i&

- Hive几种导出数据方式

daizj

hive数据导出

Hive几种导出数据方式

1.拷贝文件

如果数据文件恰好是用户需要的格式,那么只需要拷贝文件或文件夹就可以。

hadoop fs –cp source_path target_path

2.导出到本地文件系统

--不能使用insert into local directory来导出数据,会报错

--只能使用

- 编程之美

dcj3sjt126com

编程PHP重构

我个人的 PHP 编程经验中,递归调用常常与静态变量使用。静态变量的含义可以参考 PHP 手册。希望下面的代码,会更有利于对递归以及静态变量的理解

header("Content-type: text/plain");

function static_function () {

static $i = 0;

if ($i++ < 1

- Android保存用户名和密码

dcj3sjt126com

android

转自:http://www.2cto.com/kf/201401/272336.html

我们不管在开发一个项目或者使用别人的项目,都有用户登录功能,为了让用户的体验效果更好,我们通常会做一个功能,叫做保存用户,这样做的目地就是为了让用户下一次再使用该程序不会重新输入用户名和密码,这里我使用3种方式来存储用户名和密码

1、通过普通 的txt文本存储

2、通过properties属性文件进行存

- Oracle 复习笔记之同义词

eksliang

Oracle 同义词Oracle synonym

转载请出自出处:http://eksliang.iteye.com/blog/2098861

1.什么是同义词

同义词是现有模式对象的一个别名。

概念性的东西,什么是模式呢?创建一个用户,就相应的创建了 一个模式。模式是指数据库对象,是对用户所创建的数据对象的总称。模式对象包括表、视图、索引、同义词、序列、过

- Ajax案例

gongmeitao

Ajaxjsp

数据库采用Sql Server2005

项目名称为:Ajax_Demo

1.com.demo.conn包

package com.demo.conn;

import java.sql.Connection;import java.sql.DriverManager;import java.sql.SQLException;

//获取数据库连接的类public class DBConnec

- ASP.NET中Request.RawUrl、Request.Url的区别

hvt

.netWebC#asp.nethovertree

如果访问的地址是:http://h.keleyi.com/guestbook/addmessage.aspx?key=hovertree%3C&n=myslider#zonemenu那么Request.Url.ToString() 的值是:http://h.keleyi.com/guestbook/addmessage.aspx?key=hovertree<&

- SVG 教程 (七)SVG 实例,SVG 参考手册

天梯梦

svg

SVG 实例 在线实例

下面的例子是把SVG代码直接嵌入到HTML代码中。

谷歌Chrome,火狐,Internet Explorer9,和Safari都支持。

注意:下面的例子将不会在Opera运行,即使Opera支持SVG - 它也不支持SVG在HTML代码中直接使用。 SVG 实例

SVG基本形状

一个圆

矩形

不透明矩形

一个矩形不透明2

一个带圆角矩

- 事务管理

luyulong

javaspring编程事务

事物管理

spring事物的好处

为不同的事物API提供了一致的编程模型

支持声明式事务管理

提供比大多数事务API更简单更易于使用的编程式事务管理API

整合spring的各种数据访问抽象

TransactionDefinition

定义了事务策略

int getIsolationLevel()得到当前事务的隔离级别

READ_COMMITTED

- 基础数据结构和算法十一:Red-black binary search tree

sunwinner

AlgorithmRed-black

The insertion algorithm for 2-3 trees just described is not difficult to understand; now, we will see that it is also not difficult to implement. We will consider a simple representation known

- centos同步时间

stunizhengjia

linux集群同步时间

做了集群,时间的同步就显得非常必要了。 以下是查到的如何做时间同步。 在CentOS 5不再区分客户端和服务器,只要配置了NTP,它就会提供NTP服务。 1)确认已经ntp程序包: # yum install ntp 2)配置时间源(默认就行,不需要修改) # vi /etc/ntp.conf server pool.ntp.o

- ITeye 9月技术图书有奖试读获奖名单公布

ITeye管理员

ITeye

ITeye携手博文视点举办的9月技术图书有奖试读活动已圆满结束,非常感谢广大用户对本次活动的关注与参与。 9月试读活动回顾:http://webmaster.iteye.com/blog/2118112本次技术图书试读活动的优秀奖获奖名单及相应作品如下(优秀文章有很多,但名额有限,没获奖并不代表不优秀):

《NFC:Arduino、Andro