[Style Transfer]——Adversarial Stain Transfer for Histopathology Image Analysis

Adversarial Stain Transfer for Histopathology Image Analysis

对抗染色迁移用于组织病理学分析

Abstract

病理组织切片的色彩信息对病理组织学分析和诊断至关重要,临床诊断中,病理学家通常依靠颜色做出诊断,而自动化的诊断方法也多基于色彩或强度信息来提取组织特征。但病理组织染色的不一致逐渐成为自动化病理分析的一大障碍,因此研究人员提出了一系列解决染色归一化的策略,比如有的策略依赖于收集颜色统计数据来进行图像的颜色匹配,本文则从风格迁移的角度来解决染色归一化的问题。

通过设计一个具有染色归一化组件的判别网络来为特定的组织病理学图像进行修正,本文通过生成网络来学习某一数据集内的图像特征,再根据具体任务搭建分割或分类网络完成染色迁移任务。这种端到端的模型结合了多种损失项,但不需要额外的预处理等。最终本文在分割和分类任务中均进行了染色归一化效果的测试。

Section I Introduction

通常,组织病理学和细胞病理学是癌症诊断的主要工具,事实上,除了一些罕见病,病理学家主要就是通过病理学家对显微镜下组织切片的形态学分析进行癌症的诊断。

组织切片的制备过程需要使用天然或化学染剂对透明的活检组织进行染色,主要是对细胞核和细胞质进行染色,常用的染剂为HE(苏木精-伊红),其中苏木精染液为碱性,主要是细胞核染色为紫蓝色,伊红为酸性,主要是细胞质染色为红色。

从染色过程的的叙述就可以看出,染色过程中存在一系列变量会影响最终的染色效果,如不同组织对染色剂的反应、组织的厚度、染色剂的浓度以及染色过程中的温度等都会影响组织染色的最终结果,Fig1就展示了不同染色的结果。

![[Style Transfer]——Adversarial Stain Transfer for Histopathology Image Analysis_第1张图片](http://img.e-com-net.com/image/info8/eb017b6976644757ae302663f1d98c53.jpg)

切片染色的结果直接影响后续疾病的诊断,因此需要控制染色过程中的变量,使得染色抑一致。但制定一个规范的切片染色制备过程显然不现实,因为涉及到太多手工制备过程;更现实的方法是通过软件对染色图像进行归一化,随后用于机器学习的癌症分类或组织分割系统中,因为这些系统对切片组织外观、颜色的变化是十分敏感的。

目前针对染色不一致的问题主要由以下三种解决方式:

(1)使用灰度图绕过颜色不一致的问题;

(2)基于颜色的统计信息来合成新图像,从而增强模型对颜色不一致的鲁棒性;

(3)采用颜色匹配对图像进行预处理,通常被称为染色归一化技术,将数据集中的所有图像都映射到参考的模板图像中。

其中,忽略图像的颜色信息或通过数据增强来学习图像的颜色不变特征,不可避免的损失了利用颜色来捕获相关的临床信息;而方法3中的染色归一化策略也十分依赖于参考图像的选择。

因此,本文聚焦于如何自动化进行组织病理学分析,无需特殊的图像采集策略,跨越不同病理图像,自动进行如细胞核分割或癌症分类任务,因此需要在染色不一致的图像上进行染色迁移,这样就不需要在图像分析过程中引入预处理步骤或重新训练整个模型了。此外,本文还认为这种自动化分析系统不应仅局限于单个参开模板,而是能够通过学习数据集的分布信息更好的传递染色信息,因此本文提出了一个端到端的训练框架,通过对抗学习进行染色归一化。

简而言之,就是给定两个染色不一致的数据集,通过一个生成网络隐式学习图像的颜色分布信息,然后将输入数据进行染色迁移,在保持原有纹理特征的基础上尽可能迁移到目标染色风格;而判别网络则会根据具体的任务进行判断。本文测试了3个数据集在分割和分类任务中的表现。

Section II Related Works

早期工作主要可分为三类:

(1)色彩无关的数据增强策略

(2)基于统计信息的颜色匹配策略

(3)生成模型用于风格迁移

Part A Color-Invariant Methods

许多研究已经表明纹理特征对组织病理学图像分析中的重要性,因此许多纹理特征如灰度co-occurrence matric,local binary patterns,wavelet transforms等都得到了广泛应用,借助以上工具可以通过灰度图提取特征,染过了数据集之间染色不一致的问题。

另一种是基于颜色信息进行数据增强,从而提升模型对颜色变化的鲁棒性。尤其在深度歇息中借助所谓的fancy PCA策略改变图像的RGB值从而生成新的图像。这种策略已经在多种组织病理学的深度学习应用中得到了应用,从而学习鲁棒性更强的特征。

但是组织病理学图像的颜色强度还有特殊的含义,因为他们与染色浓度相关,与生物的组织构成有关。如果使用灰度图就忽略了这方面蕴含的信息。

Part B Color-Matching Methods

在众多借助颜色信息进行训练的自动分析系统中,大部分需要对图像进行一个预处理步骤,通过计算图像的颜色统计信息与作为模板的图像进行匹配,从而进行颜色归一化。进行颜色匹配就有多种策略,比如Rinhard通过计算参考图像和输入图像的颜色直方图进行匹配,颜色直方图匹配通常假设各染色剂的比例在归一化的图像中是相近的,但在大多数实际的组织图像中是不同的。

为了解决直方图匹配存在的局限性,又提出了归一化前染色分离的匹配策略,即将图像分解为不同染色成分,然后再每个染色通道上分别进行归一化。

而提取、分离图像的染色信息也有多种方法。比如通过染色矩阵(staining matrix)提取染色信息,也有借助非负矩阵分解的,以及期望最大化等。

但对于部分组织聚集、颜色不平衡的情况下以上染色分离策略的效果就不那么好,比如将不同类的组织映射到同一种中。

为了避免上述情况的发生,可以考虑在参考图像和目标图像之间进行簇到簇的分布对齐。

除了以上限制,染色分离策略还仅仅局限于单张参考图像信息,如果参考图像不具有足够的表征能力,可能会导致归一化错误。

Part C Style Transfer and Generativr Learning

因此,本文将染色归一化看做风格迁移任务,将不同数据集中的组织病理图像归一化到相同的染色风格上。在计算机视觉领域,风格迁移通常被视为纹理信息的转移,目标是合成特定纹理图像的同时保留原图的语义信息。因此涉及到图像特征表述的学习、风格特征的学习。近期借助CNN强大的学习能力已经可以分别调控图像的内容信息和风格信息了。Gatys通过gram matrix学习图像的风格信息,用于像素级别的匹配;但这种方法并不能直接适用于病理图像的染色归一,因为这种基于像素点的匹配没有考虑数据的分布信息。

其他的探索有:Minervini等人提出一种监督学习用于颜色转换,Zhang等人训练的网络可以将灰度图映射到量化后的颜色输出分布空间中。但以上也需要借助mask来训练分割网络或无法保证保留纹理信息,限制了进一步应用到病理图像上。

因此,本文工作基于生成对抗网络,通过生成网络和判别网络的对抗训练在保留原图结构的基础上根据目标图整个数据集而不是单张参考图像的统计数据进行匹配。同时,进行的并不是像素级别的匹配而是基于图像的特征表示。这样有利于训练好的图像分析模型应用于其他测试数据集。

Section III Method

本文的目的是训练一个带有染色归一组件的判别网络用于病理图像的分析(分类或分割),此网络必须适用于不同染色的图像而无需额外的预处理或训练步骤。

Part A Problem Setting

源数据集来自于lab A,{XA,YA}分别代表图像及标签,目标域lab B中仅有图像没有标注信息,本文假设两个域中的图像染色情况并不一致(比如由于采集的中心、染色剂的浓度、显微镜的型号不同导致的染色不一致)。基于此种问题设定来训练模型。

Part B Model Definition

Fig2展示了模型的各部分组成。

![[Style Transfer]——Adversarial Stain Transfer for Histopathology Image Analysis_第2张图片](http://img.e-com-net.com/image/info8/3b7a87fb000f410582e069e7fe4becad.jpg)

其中训练图像XA带标签,而测试图像XB不带标签,而染色迁移网络(stain transfer network)负责完成不同数据分布之间的映射。其中生成模型G输入原域图像生成归一化后的图像X’B,而特定任务网络在判别样本的基础上进一步完成分类或分割任务。

可以看到Stain Transfer Network不仅将一张图像作为参考模板,而是将整个测试数据集中的样本的颜色信息分布进行特征提取,进行颜色匹配。

具体的网络结构:

Stain Transfer Network:采用了含有skip connection的encoder-decoder结构,每个卷积模块包括conv->BN->ReLU,skip connection的作用是在不断下采样过程中使得纹理等信息得到有效的传递。

Task-Specific Network:

特定任务网络需要完成

(1)区分真实样本还是合成样本

(2)完成图像分类/分割(根据具体任务)。

因此本文选用了AlexNet同时进行判别和分类。模型最后三层FC层就是特定任务层,而在最后一层池化层后面还添加了一层额外的卷积层用于鉴别图像。

Objective:

优化目标即总的损失函数:

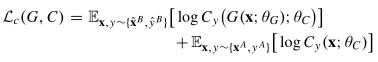

包含对抗损失Ladv,正则化损失Lr和类别损失Lc三部分组成。

![]()

正则化损失Lr用于保留原图的结构信息不在迁移过程中变形,通过计算图像的颜色梯度捕捉图像的边界进行保留。与W相乘会对生成图与输入图边界位置上的不一致进行惩罚;此外,编解码结构中skip connection的使用也一定程度上保留了图像浅层的纹理信息。

![]()

类别损失Lc通过计算交叉熵损失产生图像的类别的概率预测。其中第一项对应生成图像的类别损失,第二项表示训练图像的类别损失。

经过染色归一化后再进行分类可以使得模型学习归一化后的鉴别特征,因为不同的染色代表着不同组织类型的差异,而归一化后学习的特征可以很好的迁移到其他任务中。

下面是整个训练的伪代码:

![[Style Transfer]——Adversarial Stain Transfer for Histopathology Image Analysis_第3张图片](http://img.e-com-net.com/image/info8/8e8edfeee1724235aa7c2b95e61e0b11.jpg)

每一个epoch会先计算对抗损失并更新参数θC,随后计算类别损失+更新参数θC,以上都是梯度上升;最后将二者梯度下降更新θG,因此θC和θG在一个循环中迭代优化的。

Section IV Validation Experiments

为了验证Stain Transfer Network的有效性,进行了两类实验,一是对染色归一化后的病理图像进行定量定性的分析;二是测试归一化后的图像用于特定任务上的表现。

采用的数据集包括:

MITOS-ATYPIA ICPR‘14challenge挑战赛中的部分数据,包含11份30倍放大倍率的病理图像,采用Aperop扫描,patch大小250250;

MICCAI’16 GlaS challenge的接肠腺癌病理图像进行良恶性二分类;train:val:test=85:20:60,patch=250250

最后还在large size卵巢癌WSI图像中进行了测试,这一数据集更具难度,因为训练图像都是经过专业的病理学家挑选的最具代表的亚型,因而与测试图像存在很大差异;而且图像的颜色不一致如染色不足、过染也在测试集出现,而训练集中的图像很少有这种情况发生,因此训练难度更大。

Part A Experiment Design

回顾一下,stain trnasfer network基于UNet的编解码结构,而特定任务网络使用的是AlexNet,输入的图像没有经过任何预处理,为了防止过拟合,在UNet中每一层还使用了BN和dropout。

Learning rate:

stain trnasfer network:1e-3

Task-Specific network:2e-4

框架Pytorch

NVIDIA Titan X GPU

实验将未归一化、仅使用灰度图和基于颜色进行数据增强的图像作为对照组与染色归一化的图像进行对比。

以及实验还分别测试了对抗损失、正则化损失和类别损失的有效性。

Part B Results

Table 1展示了不同输入图像、不同损失函数组合在不同数据集上进行分类和分割的表对比。

![[Style Transfer]——Adversarial Stain Transfer for Histopathology Image Analysis_第4张图片](http://img.e-com-net.com/image/info8/407da24e7877427eb6f41420bdd71564.jpg)

Importance of Color:

从Table 1可以看出,仅使用灰度图虽然训练过程精度会下降,但颜色信息的丢弃提高了模型的泛化能力,但也只在某些数据集上(如MITOSIS,它由非常相似的纹理特征,只是染色存在差异);而仅使用灰度图在COLON,OVARY等数据集上表现更加糟糕,可以看出颜色信息在识别卵巢癌亚型中有着重要作用,是识别HGSC的关键。

颜色对乳腺癌识别有重要作用,可以从基于颜色进行数据增强这一项上表现不佳得到证实,因为数据增强学习的是颜色不变的特征,这种特征并不适合卵巢癌的亚型识别。

Importance of Normalization:

进行归一化和未进行染色归一化的任一数据集进行对比都能看到性能的提升,这验证了在自动组织病理学图像分析中染色归一化的重要性。

可以看到仅使用类别损失时在train和val上的分类精度和未归一化的相近,但在test测试数据集上却获得了提升,这不仅反映了网络结构带来性能的提升里面也有归一化的功劳。

Color Matching vs Style Matching

在进行颜色匹配时本文重复进行了十次参考图像的随机选择,当随机选择不同参考图像进行匹配时可以看到性能上的巨大差异,不同的参考图像之间精度相差高达38%,这反应了颜色匹配技术对于参考图像选择的敏感性。

而使用对抗损失进行染色迁移的效果普遍好于颜色匹配,精度会提升2%-28%不等。Fig4可视化了一些基于颜色匹配或迁移后的图像,可以看到颜色匹配对于图像组织的分布十分敏感,有的图像中甚至连背景都让染上了颜色,此外由于仅基于单张参考图像,很容易受到参考图像中的伪影、噪声的影响。

![[Style Transfer]——Adversarial Stain Transfer for Histopathology Image Analysis_第5张图片](http://img.e-com-net.com/image/info8/c7407b78d0994ae2977f8526d9ee4c64.jpg)

Class-Spefic Stain Normalization

当结合多种损失进行染色归一化时可以看到对特定的分类任务有明显提升,测试集分别提升了(18.5%,5.1%,16.9%)。

本文提出的模型可以看做是引导数据针对特定任务进行增强的一种网络,与其他增强技术相比,本文基于迁移网络合成的数据更加服从整个数据集的分布。

此外本文还对归一化后的图像质量进行了评价,通过计算三个数据集所有生成图像与原始训练图像之间的平均直方图交叉核分数来衡量分布的相似程度,对比结果参见Table II。

![[Style Transfer]——Adversarial Stain Transfer for Histopathology Image Analysis_第6张图片](http://img.e-com-net.com/image/info8/3893c50c76ad4adaa05f737de1ee27d8.jpg)

![[Style Transfer]——Adversarial Stain Transfer for Histopathology Image Analysis_第7张图片](http://img.e-com-net.com/image/info8/178fa60042a64665b601c768238aa8be.jpg)

model’s Sensitivity

本文还测试了模型的敏感度。通过逐个添加损失项可以看出,没有使用正则化的对抗性损失已经对分类性能有较为明显的提升;随着正则化损失的加入分类精度有了细微提升,因此对于其他特定任务都可以通过增加正则化损失进一步提升模型精度。

Section V Discussion and Conclusions

在组织病理学分析中病理组织的染色对病情的诊断和分析是至关重要的,但由于多种因素均会导致染色不一致,因此对染色图像进行归一化十分具有挑战性,归一化技术应该具有以下特性:

(1)最好是基于整个区域的分布信息而不是基于单个参考图像

(2)应该充分开绿道特殊组织

(3)归一化过程中不能改变原组织结构。

因此本文提出染色归一化网络(Stain Transfer Network),通过对抗训练学习整个数据集的染色特征,进一步用归一化后的图像提升分类或分割任务的性能。整个模型是端到端的训练,无需任何预处理步骤,可以迁移到其他域的分布。

本文的方法也在三种不同的数据集,包括大型的WSI图像上均进行了测试。实验结果表明基于数据集的分布信息进行归一化后的图像比通过color matching的图像更不敏感,更具鲁棒性,对抗网络也可以学习到更加与染色相关的特征。

截止目前(2017)本文是第一个设计出完全可训练的借助对抗学习进行归一化的网络,尽管结果很可观但仍有一定局限:效果依赖于参与训练的数据分布;本文目前仅使用了基本的结构还可以使用更复杂的结构进一步提升性能;也可以尝试着往参数压缩或者学习test-train的混合分布信息。

未来的工作将进一步探究结构上的改变是否能带来性能的提升。