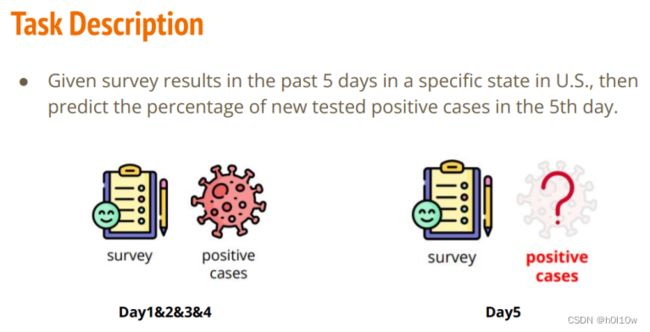

HW1: COVID-19 Cases Prediction

任务描述

助教给出的代码:https://colab.research.google.com/drive/1FTcG6CE-HILnvFztEFKdauMlPKfQvm5Z#scrollTo=YdttVRkAfu2t

数据(kaggle):https://www.kaggle.com/competitions/ml2022spring-hw1

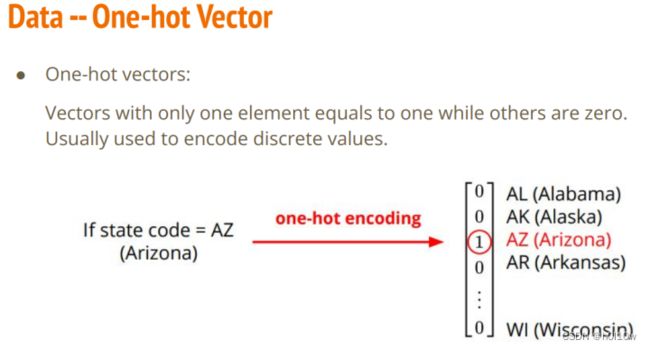

数据说明

具体数据以CSV中的为准,比如ppt中说有37个州,CSV中我数了一下其实只有34个州。

代码详解

导包

# 数学操作

import math

import numpy as np

# Pytorch

import torch

import torch.nn as nn

from torch.utils.data import Dataset, DataLoader, random_split

# 读写数据

import pandas as pd

import os

import csv

# 可视化

from tqdm import tqdm

import matplotlib.pyplot as plt

构建数据集

class COVID19Dataset(Dataset):

'''

x: 特征

y: 目标,如果为空就进行预测

'''

def __init__(self, x, y=None):

super().__init__()

if y is None:

self.y = y

else:

self.y = torch.FloatTensor(y)

self.x = torch.FloatTensor(x)

def __getitem__(self, index):

if self.y is None:

return self.x[index]

else:

return self.x[index], self.y[index]

def __len__(self):

return len(self.x)

Pytorch用torch.utils.data.Dataset构建数据集,想要构建自己的数据集,则需继承Dataset类,并重写两个方法:

- len : 定义整个数据集的长度。使用

len(dataset)时会被调用。 - getitem:用于索引数据集中的数据,比如

dataset[i]。

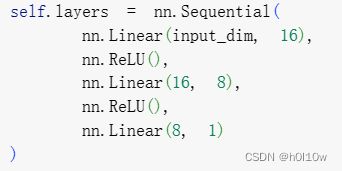

构建模型

class My_Model(nn.Module):

def __init__(self, input_dim):

super().__init__()

# TODO: 调参

self.layers = nn.Sequential(nn.Linear(input_dim, 64), nn.ReLU(),

nn.Linear(64, 1))

def forward(self, x):

x = self.layers(x)

x = x.squeeze(1)

return x

nn.Module类是所有网络结构层次的父类。当要实现一个自己的层的时候,必须要继承这个类,并且在__init__中完成初始化的步骤和forward中完成计算图的前向构建的过程。

值得一提的是,nn.Module类实现了__call__这个魔术方法,因此我们能够将模型的实例对象当作函数来使用。即我们会看到y = model(x)这样的写法,其中model是My_Model类的实例对象。

在源码里的__call__方法中,调用了上面我们重写的forward方法。因此,我们不需要显式地调用forward方法来实现前向传播。并且,因为__call__方法中还有一些其他逻辑,我们最好也不要直接通过实例对象.forward(x)来调用前向传播。

看过数据就会发现,模型参考的特征有很多。助教代码里取的数值太小了,前向传播的时候会引起信息丢失。因此我调到了64,跑出来的结果也表明有优化效果。

一些工具函数

def train_valid_split(data_set, valid_ratio, seed):

"""将训练数据划分为训练集和验证集"""

valid_set_size = int(valid_ratio * len(data_set))

train_set_size = len(data_set) - valid_set_size

train_set, valid_set = random_split(data_set,

[train_set_size, valid_set_size],

generator=torch.manual_seed(seed))

return np.array(train_set), np.array(valid_set)

def select_feat(train_data, valid_data, test_data, select_all=True):

'''挑选特征'''

y_train, y_valid = train_data[:, -1], valid_data[:, -1]

raw_x_train, raw_x_valid = train_data[:, :-1], valid_data[:, :-1]

raw_x_test = test_data

if select_all:

feat_idx = list(range(raw_x_train.shape[1]))

else:

feat_idx = [0, 1, 2, 3, 4] #TODO: 调参

return raw_x_train[:,

feat_idx], raw_x_valid[:,

feat_idx], raw_x_test[:,

feat_idx], y_train, y_valid

将训练数据划分为训练集和验证集是为了可以提前退出训练。根据验证集上模型跑出来的效果来决定是否提前退出训练,如果一段时间内效果不会更好,即可提前退出。

训练函数

def trainer(train_loader, valid_loader, model, config, device):

# 定义损失函数,平均平方损失

criterion = nn.MSELoss(reduction='mean')

# 定义优化算法, 这里采用梯度下降算法

optimizer = torch.optim.SGD(model.parameters(),

lr=config['learning_rate'],

momentum=0.9)

if not os.path.isdir('./models'):

os.mkdir('./models')

n_epochs, best_loss, step, early_stop_count = config[

'n_epochs'], math.inf, 0, 0

loss_per_epoch = []

for epoch in range(n_epochs):

model.train() #设置为训练模式

loss_record = []

train_pbar = tqdm(train_loader, position=0, leave=True)

for x, y in train_pbar:

optimizer.zero_grad() #设置梯度为0

x, y = x.to(device), y.to(device)

pred = model(x)

loss = criterion(pred, y) # 计算偏差

loss.backward() # 计算梯度,反向传播,也就是常说的链式法则求导

optimizer.step() # 更新参数,即w-lr*grad这一步

step += 1

loss_record.append(loss.detach().item())

train_pbar.set_description(f'Epoch [{epoch+1}/{n_epochs}]')

train_pbar.set_postfix({'loss': loss.detach().item()})

mean_train_loss = sum(loss_record) / len(loss_record)

loss_per_epoch.append(mean_train_loss)

model.eval() # 设置为评估模式

loss_record = []

for x, y in valid_loader:

x, y = x.to(device), y.to(device)

with torch.no_grad():

pred = model(x)

loss = criterion(pred, y)

loss_record.append(loss.item())

mean_valid_loss = sum(loss_record) / len(loss_record)

print(

f'Epoch [{epoch+1}/{n_epochs}]: Train loss: {mean_train_loss:.4f}, Valid loss: {mean_valid_loss:.4f}'

)

if mean_valid_loss < best_loss:

best_loss = mean_valid_loss

torch.save(model.state_dict(), config['save_path'])

print('Saving model with loss {:.3f}...'.format(best_loss))

early_stop_count = 0

else:

early_stop_count += 1

if early_stop_count >= config['early_stop']:

print('\nModel is not improving, so we halt the training session.')

plt.plot(list(range(1, len(loss_per_epoch) + 1)), loss_per_epoch)

plt.xlabel('Epoch')

plt.ylabel('Loss')

plt.title('How Loss Changes')

plt.savefig('./how_loss_changes.jpg')

return

这里面最主要的就是那两重for循环。epoch是训练轮数,每一轮都会将所有的训练数据跑一遍。在每一个epoch里面,一般会将训练数据划分为batch,每次训练一个batch,这就是里面那重for循环的作用。划分batch是因为当数据量很大的时候,不可能一次将所有的数据调入内存或显存,所以只能划分batch一批一批的训练。

在里面那重循环,x是训练数据里的输入模型的部分,y是训练数据里实际的结果。

在代码pred = model(x)里,我们用实例对象当作函数来使用。model是My_Model类的实例对象。pred是模型的输出。后面就会用pred和y来计算偏差,然后根据自己选择的优化方法来减小偏差。这份代码里采用的是最简单的梯度下降算法。

反向传播图解可以参考这篇文章:http://galaxy.agh.edu.pl/~vlsi/AI/backp_t_en/backprop.html

预测函数

def predict(test_loader, model, device):

model.eval() # 设置为评估模式

preds = []

for x in tqdm(test_loader):

x = x.to(device)

with torch.no_grad():

pred = model(x)

preds.append(pred.detach().cpu())

preds = torch.cat(preds, dim=0).numpy()

return preds

def save_pred(preds, file):

'''保存预测结果'''

with open(file, 'w') as fp:

writer = csv.writer(fp)

writer.writerow(['id', 'tested_positive'])

for i, p in enumerate(preds):

writer.writerow([i, p])

主程序

device = 'cuda' if torch.cuda.is_available() else 'cpu'

config = {

'seed': 5201314, # 随机数种子

'select_all': True, # 是否使用所有特征

'valid_ratio': 0.1, # 验证集占比

'n_epochs': 3000, # 训练轮数

'batch_size': 256, # 分组大小

'learning_rate': 1e-5,

'early_stop': 400, # 400步没有效果就停止训练

'save_path': './models/model.ckpt' # 模型存储路径

}

# 读取数据

train_data, test_data = pd.read_csv('./covid_train.csv').values, pd.read_csv(

'./covid_test.csv').values

# 去掉第一列的id

train_data, test_data = train_data[:, 1:], test_data[:, 1:]

# 划分训练集和验证集

train_data, valid_data = train_valid_split(train_data, config['valid_ratio'],

config['seed'])

print(f"""train_data size: {train_data.shape}

valid_data size: {valid_data.shape}

test_data size: {test_data.shape}

""")

x_train, x_valid, x_test, y_train, y_valid = select_feat(

train_data, valid_data, test_data, config['select_all'])

train_dataset = COVID19Dataset(x_train, y_train)

valid_dataset = COVID19Dataset(x_valid, y_valid)

test_dataset = COVID19Dataset(x_test)

train_loader = DataLoader(train_dataset,

batch_size=config['batch_size'],

shuffle=True,

pin_memory=True)

valid_loader = DataLoader(valid_dataset,

batch_size=config['batch_size'],

shuffle=True,

pin_memory=True)

test_loader = DataLoader(test_dataset,

batch_size=config['batch_size'],

shuffle=False,

pin_memory=True)

# 建立模型

model = My_Model(input_dim=x_train.shape[1]).to(device)

# 开始训练

trainer(train_loader, valid_loader, model, config, device)

# 预测

model = My_Model(input_dim=x_train.shape[1]).to(device)

model.load_state_dict(torch.load(config['save_path']))

preds = predict(test_loader, model, device)

save_pred(preds, 'pred.csv')

助教的代码里藏了一个小坑,他把训练数据里第一列的id也放进去训练了。因此,我这里读取数据之后把id这一列去掉了。

运行结果

代码运行结果

kaggle上的评测

总结

头一回接触机器学习,不会什么高深的模型,只能简单地调调参。看懂代码就是胜利(一行一行地百度)!