场景

公司微服务快上线了,微服务都是用Docker容器进行部署的,在同一台主机下,把服务都部署上,注册到Nacos的IP与PORT都是内网的IP与Dockerfile中定义的端口号,看起来好像也没什么问题,通过网关去调用也是可以调通的,请注意这有一个大前提:

必须把所有服务容器部署在同一台主机上时才可以!

当服务实例没有部署在同一主机上,比如网关服务在A服务器,服务a在B服务器上,同样注册到Nacos (或其它注册中心) ,此时上报上来的都是内网的IP,那么当外部有请求进来的时候,网关通过Nacos的服务列表,找到了对应的服务a的内网IP,一调用发现调用不通

ps:内网怎么会通……

任务

微服务容器可以不在同一台服务器上,互相调用

想法

- 既然上报的是内网的IP,我直接让他上报宿主机的IP和端口呗

- 使用Docker的host网络模式

- 修改部署脚本,通过shell部署容器时,获取宿主机IP与设置的映射端口号

- 让Docker的网络互通

分析

以下分别按上边的“想法”部分来进行说明下问题

- 翻遍官方文档与Github,得出的方案又有两个:

- 固定IP端口,把宿主机IP与端口写死在配置文件中:看起来是解决了,但是问题是无法水平扩展了 ——勉强能用

- 固定网卡,防止因多网卡环境上报错误IP端口:没有用的,进入容器中

ifconfig发现内部网卡只有两个,分别是eth0与lo,对应网卡的IP就是内网IP ——还是没用

- 使用Docker的Host网络模式,你会发现IP这回上报的的确是宿主机IP,但是端口号不对啊……如果自己去通过shell使用Java参数传入待映射的端口号的话,这种情况理论上是可行的,唯一缺点是

docker ps再也直接看不到端口号了,需要额外去docker inspect——可以用 - 映射端口号可以获取,但是主机的网卡名称不同,写死后不灵活,如果有的是

eth0,有的是ens33呢?还有更多不可测的情况! ——或许可用 - 通过一些成熟的Docker容器网络共享,但是会有一定的性能损耗 ——完全可用

概念与选型

最稳妥的办法——使用Docker网络共享,在搜索引擎的帮助下,我决定用Overlay的方式来实现效果

以下简单说下Overlay:

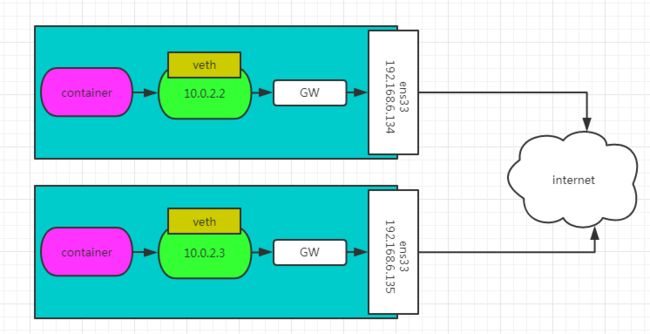

容器在两个跨主机进行通信的时候,是使用overlay network这个网络模式进行通信;如果使用host也可以实现跨主机进行通信,直接使用这个物理的ip地址就可以进行通信。overlay它会虚拟出一个网络比如10.0.2.3这个ip地址。在这个overlay网络模式里面,有一个类似于服务网关的地址,然后把这个包转发到物理服务器这个地址,最终通过路由和交换,到达另一个服务器的ip地址。

想要实现Overlay网络,需要引入一个K-V数据库,来保存网络状态信息,包括 Network、Endpoint、IP 等。Consul、Etcd 和 ZooKeeper 都是 Docker 支持的K-V数据库

我们这里使用 Consul,相比其它K-V数据库,Consul提供的界面化方便管理,所以这里使用Consul实现Overlay

通过让每个服务器的Docker daemon将自己的IP注册到Consul中,来共享Docker内网,这里共享的内网是Overlay网络模式的,也只有在注册的Docker环境下使用同overlay网络的容器,才能互相通讯

ps: 创建完成后,不使用overlay网络的跨服务器容器,不能ping通

小试身手

单节点的Consul实现Overlay网络,使用Docker镜像

环境说明

| 服务器OS | 主机IP | Docker版本 | 网卡名 |

|---|---|---|---|

| Ubuntu Server 18.04 LTS | 192.168.87.133 | 18.09.6 | ens33 |

| Ubuntu Server 18.04 LTS | 192.168.87.139 | 18.09.7 | ens33 |

待使用的Consul版本为1.5.2,看Docker Hub上提示漏洞目前最小的。

本测试环境适用于Systemd管理的Linux发行版

Consul没有使用非官方的progrium/consul,主要是因为这个镜像实在太老了,四年前的如果有漏洞也没能及时修复,所以自己去

去趟了遍官方的坑!

注意事项

每台运行docker的主机都不能同hostname,可以使用

$ sudo hostnamectl set-hostname your-new-hostname同hostname会导致同名的主机docker无法互相通信

动手做

准备Consul使用镜像在133服务器上启动,所以可以先配置下Docker daemon的启动参数指向133服务器

- 分别修改133、139两台服务器的docker.service

$ ifconfig

#已经去除干扰网卡,记录网卡名为ens33

ens33: flags=4163 mtu 1500

inet 192.168.87.133 netmask 255.255.255.0 broadcast 192.168.87.255

inet6 fe80::20c:29ff:fe02:e00a prefixlen 64 scopeid 0x20

ether 00:0c:29:02:e0:0a txqueuelen 1000 (Ethernet)

RX packets 156739 bytes 233182466 (233.1 MB)

RX errors 0 dropped 0 overruns 0 frame 0

TX packets 45173 bytes 2809606 (2.8 MB)

TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0

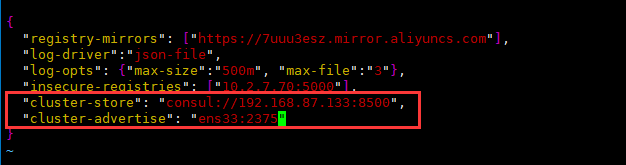

$ vim /etc/docker/daemon.json 保存退出.

cluster-store:配置的Consul的leader地址,单体直接写,其它软件注意协议

cluster-advertise: 指定监听的网卡和端口,也可以指定接收订阅消息的IP:PORT

还有一种是直接修改docker.service的,参考如下:

$ cd /etc/systemd/system/multi-user.target.wants $ sudo vim docker.service找到

ExecStart=字眼,在此行末尾添加如下代码--cluster-store=consul://192.168.87.133:8500 --cluster-advertise=ens33:2375效果如下:

操作效果与以上方法保持一致

接着执行命令,重启docker服务,另一台服务器操作方式相同,注意网卡名称

$ sudo systemctl daemon-reload && sudo systemctl restart docker- 在133服务器启动Consul服务

docker run -d --network host -h consul --name=consul --restart=always -e CONSUL_BIND_INTERFACE=ens33 consul:1.5.2用主机模式的原因是防止有些端口没有映射出来,还有就是想让Consul识别外部网卡的方式只能host模式,下面给个非host的方式

$ docker run -di -h consul -p 8500:8500 --name=consul consul:1.5.2

- 创建Docker overlay共享网络

$ docker network create -d overlay my_overlay这里与普通创建网络不同在于指定了overlay模式的网络,

-d也可以写为--driver

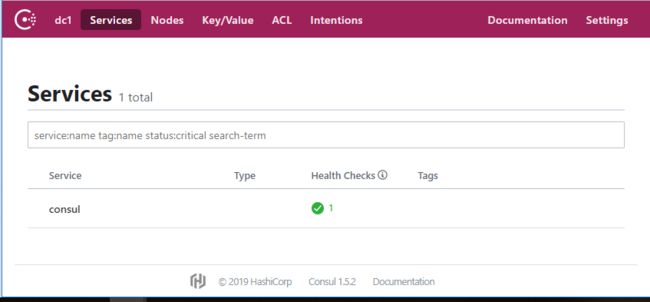

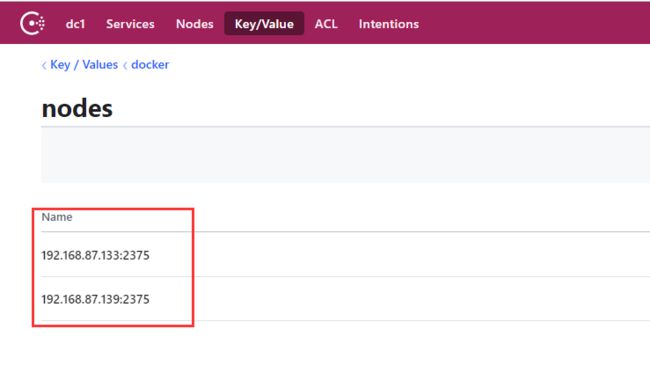

- 访问Consul的页面,如我的是

192.168.87.133:8500

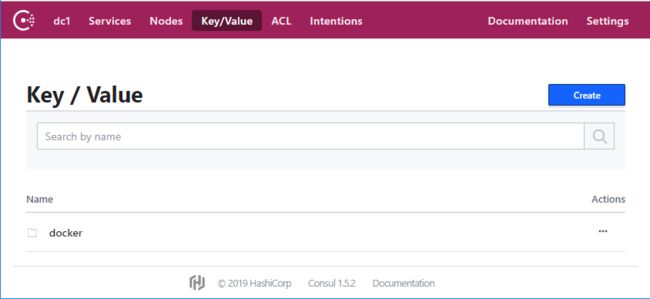

我们的配置在Key/Value处,

点击docker -> nodes

出现上边的两个节点,分别是两个docker daemon (守护进程) 注册的值

测试

新建两个centos的容器分别在两台服务器上,使用overlay 我们刚才创建的网络

133服务器

$ docker run -di --network my_overlay --name mycentos1 centos:7139服务器

$ docker run -di --network my_overlay --name mycentos2 centos:7

--net全拼为--network,--开头的可不加=

查看133服务器mycentos1容器的IP

$ docker inspect -f "{{ .NetworkSettings.Networks.my_overlay.IPAddress}}" mycentos1

10.0.1.2查看139服务器mycentos2容器的IP

$ docker inspect -f "{{ .NetworkSettings.Networks.my_overlay.IPAddress}}" mycentos2

10.0.1.3分别从133服务器ping 139服务器的mycentos2的内网IP

反过来ping也是一样的,但是并不是让我们通过外部去访问的,通过同一overlay网络的容器就可以,不信我们作如下尝试

133服务器

$ docker exec -it mycentos1 bash

# ping 10.0.1.3访问得通,没有丢包,反过来也是一样的,篇幅有限就不试验了

这起码说明,现在的服务的确已经网络互通了,下篇文章我们来搞下生产用的集群方式

引文

- 技术漫谈 | docker overlay网络实现

- Docker容器之overlay网络

- Docker跨主机网络——overlay

- Day22:介紹 Docker 的 Network (三)

- Consul KV

- Docker Hub Consul

- Github docker-library/docs

- Github docker-consul

本文系Hellxz学习与实践文章,禁止布布扣、码迷等第三方爬虫网站爬取