第P1周:实现mnist手写数字识别

- 本文为365天深度学习训练营 中的学习记录博客

- 原作者:K同学啊

我的环境:

- 语言环境:Python3.10.7

- 编译器:VScode

- 深度学习环境:TensorFlow 2.13.0

一、前期工作:

1、导入数据集

导入库

import torch

import torch.nn as nn

import matplotlib.pyplot as plt

import torchvision

torch:PyTorch库,用于张量操作和深度学习。torch.nn:PyTorch中的神经网络模块。matplotlib.pyplot:用于绘图的Matplotlib库。torchvision:专门用于处理计算机视觉数据集和模型的PyTorch库。

设置设备:

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

此代码段检查是否有支持CUDA的GPU可用,并相应地设置device变量。如果有GPU可用,则会使用GPU;否则将使用CPU。

加载MNIST数据集:

train_ds = torchvision.datasets.MNIST('data', train=True,

transform=torchvision.transforms.ToTensor(),

download=True)

test_ds = torchvision.datasets.MNIST('data', train=False,

transform=torchvision.transforms.ToTensor(),

download=True)

train_ds和test_ds是由torchvision提供的MNIST数据集类的实例。'data'是数据集将被下载和存储的目录。train=True和train=False表示数据集是训练集还是测试集。transform指定应用于数据集样本的变换。在这种情况下,使用torchvision.transforms.ToTensor()将图像数据转换为PyTorch张量。download=True确保在指定目录中没有数据集时下载数据集。

批大小:

batch_size = 32

创建数据加载器:

train_dl = torch.utils.data.DataLoader(train_ds, batch_size=batch_size, shuffle=True)

test_dl = torch.utils.data.DataLoader(test_ds, batch_size=batch_size)

train_dl和test_dl是数据加载器对象,用于加载训练和测试数据集。train_ds和test_ds是之前创建的训练和测试数据集对象。batch_size指定每个批次的样本数量。shuffle=True表示在每个epoch开始时是否对数据进行随机洗牌。

取出一个批次数据并查看格式:

imgs, labels = next(iter(train_dl))

print(imgs.shape)

- 使用

next(iter(train_dl))获取一个批次的训练数据。这会返回一个批次的图像数据(imgs)和相应的标签数据(labels)。 imgs.shape打印出图像数据的形状。在这个例子中,批次大小为32,每张图像通道数为1,高度和宽度为28。

可视化批次中的图像:

plt.figure(figsize=(20, 5))

for i, imgs in enumerate(imgs[:20]):

npimg = np.squeeze(imgs.numpy())

plt.subplot(2, 10, i+1)

plt.imshow(npimg, cmap=plt.cm.binary)

plt.axis('off')

plt.show()

- 通过

plt.figure(figsize=(20, 5))创建一个大图像,大小为20英寸宽、5英寸高,用于容纳20张子图。 - 使用一个循环遍历批次中的前20张图像。

np.squeeze(imgs.numpy())将张量转换为NumPy数组,并将冗余的维度进行压缩,以便在显示时可以正确绘制图像。plt.subplot(2, 10, i+1)在大图像中创建一个子图,以2行10列的格式排列。plt.imshow(npimg, cmap=plt.cm.binary)显示图像,使用二进制的颜色映射。plt.axis('off')关闭坐标轴显示。plt.show()显示绘制的图像。

2.重要内容说明

什么是张量?

张量(Tensor)是一个多维数组,是深度学习中的核心数据结构。在数学和计算机科学中,张量是向量(1维数组)和矩阵(2维数组)的推广,可以有任意数量的维度。在深度学习框架(如PyTorch和TensorFlow)中,张量是进行各种计算的基本单位。

以下是一些张量的重要特点:

-

维度(阶): 张量的维度被称为阶(rank)。0阶张量是标量(scalar),1阶张量是向量,2阶张量是矩阵,以此类推。例如,3阶张量可以看作是一个立方体的数据集。

-

形状: 张量的形状描述了每个维度的大小。例如,一个形状为

(3, 4)的2阶张量表示一个3行4列的矩阵。 -

数据类型: 张量可以包含不同类型的数据,如整数、浮点数等。在深度学习中,通常使用浮点数来表示网络的权重和输入数据。

-

设备: 张量可以在不同的设备上存储和处理,如CPU和GPU。GPU上的张量操作通常比在CPU上更快,因为GPU可以并行处理大量数据。

torchvision.datasets.MNIST详解

torchvision.datasets是Pytorch自带的一个数据库,我们可以通过代码在线下载数据,这里使用的是torchvision.datasets中的MNIST数据集。

torchvision.datasets.MNIST函数原型:

torchvision.datasets.MNIST(root, train=True, transform=None, target_transform=None, download=False)

参数说明:

root (string) :数据地址

train (string) :True = 训练集,False = 测试集

download (bool,optional) : 如果为True,从互联网上下载数据集,并把数据集放在root目录下。

transform (callable, optional ):这里的参数选择一个你想要的数据转化函数,直接完成数据转化

target_transform (callable,optional) :接受目标并对其进行转换的函数/转换。

transform (callable, optional )常用参数设置

除了使用 torchvision.transforms.ToTensor() 作为 transform 参数,还可以进行其他的预定义转换操作。

将图像数据转换为张量:

transform = torchvision.transforms.ToTensor()

train_ds = torchvision.datasets.MNIST('data', train=True, transform=transform, download=True)

将图像数据进行标准化(归一化):

transform = torchvision.transforms.Compose([

torchvision.transforms.ToTensor(),

torchvision.transforms.Normalize(mean=[0.5], std=[0.5]) # Example values, adjust accordingly

])

train_ds = torchvision.datasets.MNIST('data', train=True, transform=transform, download=True)

对图像进行随机水平翻转:

transform = torchvision.transforms.Compose([

torchvision.transforms.ToTensor(),

torchvision.transforms.RandomHorizontalFlip()

])

train_ds = torchvision.datasets.MNIST('data', train=True, transform=transform, download=True)

将图像大小调整为固定大小:

transform = torchvision.transforms.Compose([

torchvision.transforms.Resize((32, 32)), # Resize to a 32x32 image

torchvision.transforms.ToTensor()

])

train_ds = torchvision.datasets.MNIST('data', train=True, transform=transform, download=True)

torch.utils.data.DataLoader详解

torch.utils.data.DataLoader是Pytorch自带的一个数据加载器,结合了数据集和取样器,并且可以提供多个线程处理数据集。

函数原型:

torch.utils.data.DataLoader(dataset, batch_size=1, shuffle=None, sampler=None, batch_sampler=None, num_workers=0, collate_fn=None, pin_memory=False, drop_last=False, timeout=0, worker_init_fn=None, multiprocessing_context=None, generator=None, *, prefetch_factor=2, persistent_workers=False, pin_memory_device=‘’)

参数说明:

● dataset(string) :加载的数据集

● batch_size (int,optional) :每批加载的样本大小(默认值:1)

● shuffle(bool,optional) : 如果为True,每个epoch重新排列数据。

● sampler (Sampler or iterable, optional) : 定义从数据集中抽取样本的策略。 可以是任何实现了 len 的 Iterable。 如果指定,则不得指定 shuffle 。

● batch_sampler (Sampler or iterable, optional) : 类似于sampler,但一次返回一批索引。与 batch_size、shuffle、sampler 和 drop_last 互斥。

● num_workers(int,optional) : 用于数据加载的子进程数。 0 表示数据将在主进程中加载(默认值:0)。

● pin_memory (bool,optional) : 如果为 True,数据加载器将在返回之前将张量复制到设备/CUDA 固定内存中。 如果数据元素是自定义类型,或者 collate_fn返回一个自定义类型的批次。

● drop_last(bool,optional) : 如果数据集大小不能被批次大小整除,则设置为 True 以删除最后一个不完整的批次。 如果 False 并且数据集的大小不能被批大小整除,则最后一批将保留。 (默认值:False)

● timeout(numeric,optional) : 设置数据读取的超时时间 , 超过这个时间还没读取到数据的话就会报错。(默认值:0)

● worker_init_fn(callable,optional) : 如果不是 None,这将在步长之后和数据加载之前在每个工作子进程上调用,并使用工作 id([0,num_workers - 1] 中的一个 int)的顺序逐个导入。 (默认:None)

二、构建简单的神经CNN网络

导入库:

import torch.nn.functional as F

● torch.nn.functional 是PyTorch的函数库,提供了许多神经网络中常用的函数,如激活函数、损失函数等。

设定类别数:

num_classes = 10

●num_classes 表示图像分类任务中的类别数,这里假设有10个类别。

定义神经网络模型:

class Model(nn.Module):

def __init__(self):

super().__init__()

self.conv1 = nn.Conv2d(1, 32, kernel_size=3)

self.pool1 = nn.MaxPool2d(2)

self.conv2 = nn.Conv2d(32, 64, kernel_size=3)

self.pool2 = nn.MaxPool2d(2)

self.fc1 = nn.Linear(1600, 64)

self.fc2 = nn.Linear(64, num_classes)

def forward(self, x):

x = self.pool1(F.relu(self.conv1(x)))

x = self.pool2(F.relu(self.conv2(x)))

x = torch.flatten(x, start_dim=1)

x = F.relu(self.fc1(x))

x = self.fc2(x)

return x

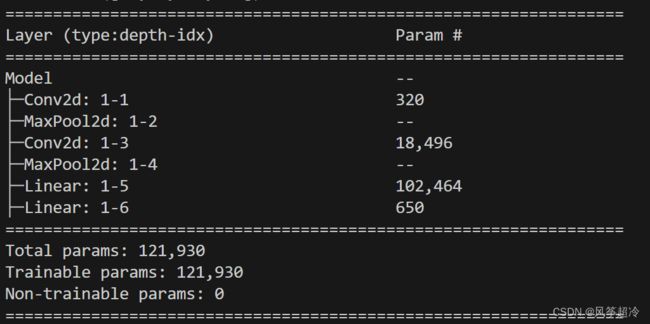

对于一般的CNN网络来说,都是由特征提取网络和分类网络构成,其中特征提取网络用于提取图片的特征,分类网络用于将图片进行分类。

● nn.Conv2d为卷积层,用于提取图片的特征,传入参数为输入channel,输出channel,池化核大小

● nn.MaxPool2d为池化层,进行下采样,用更高层的抽象表示图像特征,传入参数为池化核大小

● nn.ReLU为激活函数,使模型可以拟合非线性数据

● nn.Linear为全连接层,可以起到特征提取器的作用,最后一层的全连接层也可以认为是输出层,传入参数为输入特征数和输出特征数(输入特征数由特征提取网络计算得到,如果不会计算可以直接运行网络,报错中会提示输入特征数的大小,下方网络中第一个全连接层的输入特征数为1600)

● nn.Sequential可以按构造顺序连接网络,在初始化阶段就设定好网络结构,不需要在前向传播中重新写一遍

加载并打印模型:

from torchinfo import summary

# 将模型转移到GPU中(我们模型运行均在GPU中进行)

model = Model().to(device)

summary(model)

三、训练模型

1.代码

1.设置超参数

loss_fn = nn.CrossEntropyLoss() # 创建损失函数

learn_rate = 1e-2 # 学习率

opt = torch.optim.SGD(model.parameters(),lr=learn_rate)

2.编写训练函数

def train(dataloader, model, loss_fn, optimizer):

size = len(dataloader.dataset) # 训练集的大小,一共60000张图片

num_batches = len(dataloader) # 批次数目,1875(60000/32)

train_loss, train_acc = 0, 0 # 初始化训练损失和正确率

for X, y in dataloader: # 获取图片及其标签

X, y = X.to(device), y.to(device)

# 计算预测误差

pred = model(X) # 网络输出

loss = loss_fn(pred, y) # 计算网络输出和真实值之间的差距,targets为真实值,计算二者差值即为损失

# 反向传播

optimizer.zero_grad() # grad属性归零

loss.backward() # 反向传播

optimizer.step() # 每一步自动更新

# 记录acc与loss

train_acc += (pred.argmax(1) == y).type(torch.float).sum().item()

train_loss += loss.item()

train_acc /= size

train_loss /= num_batches

return train_acc, train_loss● X, y = X.to(device), y.to(device) :将图像数据和标签数据移动到所使用的设备(CPU或GPU)上。

计算预测误差:

pred = model(X)

loss = loss_fn(pred, y)

- 使用模型对图像数据进行前向传播,得到预测值

pred。 - 计算预测值

pred与真实标签y之间的损失,即损失函数的输出。

反向传播和参数更新:

optimizer.zero_grad()

loss.backward()

optimizer.step()

- 将优化器中的梯度信息清零。

- 计算损失的梯度(反向传播)。

- 根据梯度和优化算法,更新模型的参数。

计算正确率和损失:

train_acc += (pred.argmax(1) == y).type(torch.float).sum().item()

train_loss += loss.item()

- 计算本批次的正确预测数量,通过比较预测值中的最大值索引是否与真实标签一致来判断。

- 累加损失值,用于计算平均损失。

计算训练结果:

train_acc /= size

train_loss /= num_batches

- 计算整个训练集的平均正确率和平均损失。

3.编写测试函数

def test (dataloader, model, loss_fn):

size = len(dataloader.dataset) # 测试集的大小,一共10000张图片

num_batches = len(dataloader) # 批次数目,313(10000/32=312.5,向上取整)

test_loss, test_acc = 0, 0

# 当不进行训练时,停止梯度更新,节省计算内存消耗

with torch.no_grad():

for imgs, target in dataloader:

imgs, target = imgs.to(device), target.to(device)

# 计算loss

target_pred = model(imgs)

loss = loss_fn(target_pred, target)

test_loss += loss.item()

test_acc += (target_pred.argmax(1) == target).type(torch.float).sum().item()

test_acc /= size

test_loss /= num_batches

return test_acc, test_loss

4.正式训练

epochs = 5

train_loss = []

train_acc = []

test_loss = []

test_acc = []

for epoch in range(epochs):

model.train()

epoch_train_acc, epoch_train_loss = train(train_dl, model, loss_fn, opt)

model.eval()

epoch_test_acc, epoch_test_loss = test(test_dl, model, loss_fn)

train_acc.append(epoch_train_acc)

train_loss.append(epoch_train_loss)

test_acc.append(epoch_test_acc)

test_loss.append(epoch_test_loss)

template = ('Epoch:{:2d}, Train_acc:{:.1f}%, Train_loss:{:.3f}, Test_acc:{:.1f}%,Test_loss:{:.3f}')

print(template.format(epoch+1, epoch_train_acc*100, epoch_train_loss, epoch_test_acc*100, epoch_test_loss))

print('Done')

2.重要问题说明

测试函数和训练函数是在神经网络训练过程中两个不同的环节所使用的函数,它们的功能和目的有所不同:

1. 训练函数:

- 训练函数用于训练神经网络模型,它执行以下关键步骤:

- 从训练数据中获取批次数据(输入图像和真实标签)。

- 在模型中进行前向传播,生成预测结果。

- 计算预测结果与真实标签之间的损失。

- 执行反向传播,计算损失对模型参数的梯度。

- 使用优化器根据梯度更新模型参数。

- 跟踪训练过程中的正确率和损失。

- 训练函数的目标是通过多次迭代训练,逐渐调整模型参数,使模型能够学习从输入到输出的映射关系,从而在训练数据上表现良好。

2. 测试函数:

- 测试函数用于评估训练好的神经网络模型在新数据上的性能,它执行以下关键步骤:

- 从测试数据中获取批次数据(输入图像和真实标签)。

- 在模型中进行前向传播,生成预测结果。

- 计算预测结果与真实标签之间的损失,或者其他评价指标(如准确率、精确率等)。

- 跟踪测试过程中的性能指标。

- -测试函数的目标是验证模型在未见过的数据上的泛化能力,以及检查模型是否出现过拟合。测试函数的结果可以帮助确定模型的性能并进行调整。

训练函数用于优化模型参数,使其适应训练数据,而测试函数用于评估模型在新数据上的性能。在神经网络训练过程中,通常会在每个epoch结束后使用测试函数来监测模型的泛化能力和训练过程的进展。

四、结果可视化

import matplotlib.pyplot as plt

#隐藏警告

import warnings

warnings.filterwarnings("ignore") #忽略警告信息

plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

plt.rcParams['figure.dpi'] = 100 #分辨率

epochs_range = range(epochs)

plt.figure(figsize=(12, 3))

plt.subplot(1, 2, 1)

plt.plot(epochs_range, train_acc, label='Training Accuracy')

plt.plot(epochs_range, test_acc, label='Test Accuracy')

plt.legend(loc='lower right')

plt.title('Training and Validation Accuracy')

plt.subplot(1, 2, 2)

plt.plot(epochs_range, train_loss, label='Training Loss')

plt.plot(epochs_range, test_loss, label='Test Loss')

plt.legend(loc='upper right')

plt.title('Training and Validation Loss')

plt.show()

五、完整代码

import torch

import torch.nn as nn

import matplotlib.pyplot as plt

import torchvision

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

device

train_ds = torchvision.datasets.MNIST('data',

train=True,

transform=torchvision.transforms.ToTensor(), # 将数据类型转化为Tensor

download=True)

test_ds = torchvision.datasets.MNIST('data',

train=False,

transform=torchvision.transforms.ToTensor(), # 将数据类型转化为Tensor

download=True)

batch_size = 32

train_dl = torch.utils.data.DataLoader(train_ds,

batch_size=batch_size,

shuffle=True)

test_dl = torch.utils.data.DataLoader(test_ds,

batch_size=batch_size)

# 取一个批次查看数据格式

# 数据的shape为:[batch_size, channel, height, weight]

# 其中batch_size为自己设定,channel,height和weight分别是图片的通道数,高度和宽度。

imgs, labels = next(iter(train_dl))

print(imgs.shape)

torch.Size([32, 1, 28, 28])

import numpy as np

import torch.nn.functional as F

num_classes = 10 # 图片的类别数

class Model(nn.Module):

def __init__(self):

super().__init__()

# 特征提取网络

self.conv1 = nn.Conv2d(1, 32, kernel_size=3) # 第一层卷积,卷积核大小为3*3

self.pool1 = nn.MaxPool2d(2) # 设置池化层,池化核大小为2*2

self.conv2 = nn.Conv2d(32, 64, kernel_size=3) # 第二层卷积,卷积核大小为3*3

self.pool2 = nn.MaxPool2d(2)

# 分类网络

self.fc1 = nn.Linear(1600, 64)

self.fc2 = nn.Linear(64, num_classes)

# 前向传播

def forward(self, x):

x = self.pool1(F.relu(self.conv1(x)))

x = self.pool2(F.relu(self.conv2(x)))

x = torch.flatten(x, start_dim=1)

x = F.relu(self.fc1(x))

x = self.fc2(x)

return x

from torchinfo import summary

# 将模型转移到GPU中(我们模型运行均在GPU中进行)

model = Model().to(device)

summary(model)

loss_fn = nn.CrossEntropyLoss() # 创建损失函数

learn_rate = 1e-2 # 学习率

opt = torch.optim.SGD(model.parameters(),lr=learn_rate)

# 训练循环

def train(dataloader, model, loss_fn, optimizer):

size = len(dataloader.dataset) # 训练集的大小,一共60000张图片

num_batches = len(dataloader) # 批次数目,1875(60000/32)

train_loss, train_acc = 0, 0 # 初始化训练损失和正确率

for X, y in dataloader: # 获取图片及其标签

X, y = X.to(device), y.to(device)

# 计算预测误差

pred = model(X) # 网络输出

loss = loss_fn(pred, y) # 计算网络输出和真实值之间的差距,targets为真实值,计算二者差值即为损失

# 反向传播

optimizer.zero_grad() # grad属性归零

loss.backward() # 反向传播

optimizer.step() # 每一步自动更新

# 记录acc与loss

train_acc += (pred.argmax(1) == y).type(torch.float).sum().item()

train_loss += loss.item()

train_acc /= size

train_loss /= num_batches

return train_acc, train_loss

def test (dataloader, model, loss_fn):

size = len(dataloader.dataset) # 测试集的大小,一共10000张图片

num_batches = len(dataloader) # 批次数目,313(10000/32=312.5,向上取整)

test_loss, test_acc = 0, 0

# 当不进行训练时,停止梯度更新,节省计算内存消耗

with torch.no_grad():

for imgs, target in dataloader:

imgs, target = imgs.to(device), target.to(device)

# 计算loss

target_pred = model(imgs)

loss = loss_fn(target_pred, target)

test_loss += loss.item()

test_acc += (target_pred.argmax(1) == target).type(torch.float).sum().item()

test_acc /= size

test_loss /= num_batches

return test_acc, test_loss

epochs = 5

train_loss = []

train_acc = []

test_loss = []

test_acc = []

for epoch in range(epochs):

model.train()

epoch_train_acc, epoch_train_loss = train(train_dl, model, loss_fn, opt)

model.eval()

epoch_test_acc, epoch_test_loss = test(test_dl, model, loss_fn)

train_acc.append(epoch_train_acc)

train_loss.append(epoch_train_loss)

test_acc.append(epoch_test_acc)

test_loss.append(epoch_test_loss)

template = ('Epoch:{:2d}, Train_acc:{:.1f}%, Train_loss:{:.3f}, Test_acc:{:.1f}%,Test_loss:{:.3f}')

print(template.format(epoch+1, epoch_train_acc*100, epoch_train_loss, epoch_test_acc*100, epoch_test_loss))

print('Done')

import matplotlib.pyplot as plt

#隐藏警告

import warnings

warnings.filterwarnings("ignore") #忽略警告信息

plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

plt.rcParams['figure.dpi'] = 100 #分辨率

epochs_range = range(epochs)

plt.figure(figsize=(12, 3))

plt.subplot(1, 2, 1)

plt.plot(epochs_range, train_acc, label='Training Accuracy')

plt.plot(epochs_range, test_acc, label='Test Accuracy')

plt.legend(loc='lower right')

plt.title('Training and Validation Accuracy')

plt.subplot(1, 2, 2)

plt.plot(epochs_range, train_loss, label='Training Loss')

plt.plot(epochs_range, test_loss, label='Test Loss')

plt.legend(loc='upper right')

plt.title('Training and Validation Loss')

plt.show()