虚拟现实下的手势识别综述

虚拟现实下的手势识别综述

目录

- 虚拟现实下的手势识别综述

-

- 摘要

- 关键词:

- 1.引言

- 2.国内外研究现状

- 3.手势识别的关键技术

-

- 3.1手势分割

- 3.2手势建模

- 3.3手势识别

- 3.4特征提取

- 4.存在的问题及发展趋势

- 5.结论

- 参考文献

摘要

随着虚拟现实、人机交互等技术的快速发展,手势识别的研究也得到了广泛的关注。然而,很少有对虚拟现实中手势识别进行全面分析、总结、评述的相关综述研究。针对这一问题,分析比较了现有虚拟现实下手势识别技术的思路和特点,从手势分割、手势建立、手势识别以及特征提取等多个方面对虚拟现实下的手势识别技术的研究现状和发展前景进行了分析,总结出了各种方法的优缺点。在此基础上对手势识别存在的问题及发展趋势进行了总结,展望了手势识别技术今后的研究方向。

关键词:

手势识别;虚拟现实;交互技术;手势建模

1.引言

近年来,随着虚拟现实和机器学习等相关学科的发展,人机交互技术( human computer interaction,HCI)正逐渐从以“计算机为中心”向“以人为中心”转移。人机交互技术经过几十年的发展,其输人设备从最初的纸带发展到键盘、鼠标、手柄等,使得人与计算机之间的交流已经普及到了大众化的程度。曾经在很长一段时间里,人机交互领域的研究聚焦于图形用户界面(graphics user interface,GUI),其目的是使得普通用户能够更加简单、方便地使用计算机。然而,随着普适计算等新技术的出现,如何使人与机器之间的交互能够自然地模拟人与人之间的交互已经变得越来越重要。相对于传统的二维图形用户界面,以人体自身直接作为交流平台的自然用户界面为操作者提供了更为直观、 舒适的交互体验,并进行了大量的相关研究,如人脸识别、手势识别、眼动跟踪,以及体势识别等。作为一种不需要中间媒介、非常人性化的人机交互方式,手势是一种理想的自然用户界面(Natural user interface,NUI),它使人们可以用一种更自由的方式与计算机进行交流。

手势是一种非语言的交流形式,通常被定义为手或者手与臂结合所产生的各种姿势和动作,以表达想法、情绪或者强调[1]。手势是一种符合人类日常习惯的交互手段。在日常生活中人们之间的交流通常会辅以手势来传达一些信息或表达某种特定的意图,可以分为静态手势和动态手势。静态手势识别考虑某个时间点上手势的外形特征,动态手势关注一段时间内人的一系列动作,增加了时间信息和动作特征。

最初的手势识别主要是利用机器设备的直接检测来获取人手与各个关节的空间信息,其典型代表设备如数据手套[2]等。1983年来自AT&T的Grimes[3]原创性地发明了最早的数据手套;1984年,VPL公司生产的数据手套能够使用光纤传感器检测出手指的弯曲程度; Liang等[4]利用数据手套识别出台湾手语中多个基本词条.其识别率达到90.5%;1991年,Virtual Technologies公司推出了Cyber Glove,该手套包含了线形弯曲传感器和电子张力变形测量器、能够获得较高的精度和稳定性;吴江琴等[5]使用Cyber Glove进行中国手语识别、对孤立词的识别率达到90%.对简单语句的识别率则达到了92%;Assam和Grobel[6]从带颜色手套的实验者的记录视频中提取特征,采用隐马尔科夫模型( Hidden Markov Model,HMM)识别了261个孤立词汇,其正确率达到91.3%。后来因数据手套受到了手势的自然性和可识别的手势较少的限制,光学标记法诞生并取代了数据手套。该方法也可提供良好的效果,但仍需较为复杂的设备机器设备的直接检测;虽然手势识别的准确度和稳定性得到了提高,但却限制了手势的自然表达方式。针对这些技术问题,Erol等[7]对2007年以前的研究工作进行了分析和总结;关然等[8]从手势分割和手势识别两个方面重点分析了最新的研究进展。但是,上述研究主要集中在手势的鲁棒性分割与识别方面,并不能全面体现该领域相关技术的最新进展。

为此,本文对近几年虚拟现实下的手势识别研究进行了归纳梳理,重点阐述了手势识别的研究思路,与主流方法。本文第2节主要介绍手势识别国内外研究现状;第3节介绍手势识别的关键技术,包括手势分割、手势建模、手势识别以及特征提取等方面;第4节阐述现阶段手势识别研究存在的问题及发展趋势;最后总结全文。

2.国内外研究现状

手是人类最灵敏的身体部分,在物理世界中能够被用来完成各种操作任务,而具有高效运动/操作技能的双手也可以很方便地被训练用来执行人机交互上下文中的各种虚拟控制任务.例如,将手映射为一个虚拟鼠标,来完成虚拟场景中各种指点和勾画任务[9];将手势应用在虚拟/增强现实环境下,用来驱动漫游或者完成对虚拟对象的抓取、平移、旋转和缩放等各种操作[10];将手势应用在交互桌面系统中,使得用户能够像在物理桌面上操作真实物体一样操作交互桌面系统中的数字物体[11]。

在20世纪90年代初,就开始了手势识别的研究。付永刚[12]采用两个摄像机实现了一个双手交互的Video Desk系统,系统将采集的视频图像与预先定义好的捏取、指点及拖拽等常用手势进行对比匹配来进行手势识别。1991年,日本富士通公司完成了对46个手势符号的识别工作[13]。HyeSun[14]建立了手势的六维特征向量,并利用整合的HMM识别出了13种手势:这种方法相比于传统的HMM方法而言,能够通过手势之间的关系来改善识别结果.其不足之处是过程比较复杂。Wilson 和Bobick[15]提出了一种基于状态的手势识别方法。通过将手势看作为空间中的一条轨迹将轨迹曲线划分成不同的状态,然后用一组连续的状态序列来表示手势将等待识别的图像序列与原型进行对比。所得的结果作为识别的判据,Korea Polytechnic大学的Lee等[16]用熵分析法从背景较为复杂的视频流中分割并提取出手势区域以进行手势识别,该系统可识别6种手势,平均识别率达到95%。美国MIT媒体实验室的Darrel等[17]采用动态时间规整算法对“Hello”手势进行识别,识别率达到了97%。Yang[18]对 40个美国手语进行识别,所采用的方法是时延神经网络。学习的对象是手势的运动轨迹该方法在在训练集上的识别率高达99% ,测试集的识别率也达到了96%。

虽然国内对手势识别的研究较晚但取得的成果较显著比较具有代表性的主要有,清华大学祝远新等[19]提出了一种基于表观的新的手势识别技术该课题组通过结合手势的运;动表观形状表观和时序信息建立了动态手势的时空表观模型为抽取时空表观模型的参数,提出了基于运动形状和颜色等多模式信息分层融合的策略而且建立的实验系统可对种手势进行在线识别。识别率超过90%[20,21]。北方交通大学的王延江等人提取手势轨迹中关键点的运动方向。将之与标准手势中所有可能的特征码进行匹配从而实现识别手势轨迹中科院软件所的王西颖等[22]结合HMM与模糊神经网络提出了一种基于HMM-FNN模型的结构,能够识出复杂背景下的动态手势。上海交通大学的刘江华等[23]通过跟踪双手的运动识别的动态手势。采用光流法和耦合隐马尔科夫模型,所能达到的识别率为96.7%。张习文和王西颖[24]等利用一组二维手势模型来替代三维模型。其过程是先利用贝叶斯分类器对静态手势进行识别、然后动态跟踪图像:中的手指和指尖由于该方法结合了基于模型和表观方法的特点因此大大地减少了计算量。中科院自动化所的方亦凯[25]提出一种快速的尺度空间特征检测方法。通过对手势图像中的Blob和Ridge结构的检测,得到手掌与手指的结构描述,进而完成手势识别。

3.手势识别的关键技术

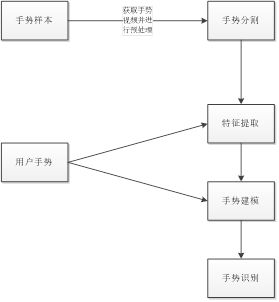

一般来说,基于视觉的手势识别基本流程如图1所示。设计手势特征和手势模型,并利用手势样本提取特征,对手势模型进行训练,最终建立手势模型。在此基础上,通过视频采集设备获取新的手势视频并进行预处理,接着对手势图像进行手势分割,从而比较准确地提取图像中的人手部分,然后进行手势特征提取;最后,利用前面建立好的手势模型对输入的手势进行分类识别。本文以手势识别步骤为主脉来剖析手势识别的关键技术。

图 1 手势识别基本流程

3.1手势分割

手势分割是指把图像中属于手势的像素点与不属于手势的像素点区分开来,得到手势在图像中的区域。手势分割的结果会对需要手部细节特征提取和识别的系统产生一定的影响,手势分割的技术难点在于环境因素的复杂性,以及手势动作在空间上的灵活性导致的手部外形特征复杂多变。目前不存在一种在所有应用系统和背景条件下都能取得良好的分割效果的方法。从手势分割的技术实现上来看,常见手势的分割方法主要有基于表现特征、基于运动信息,以及多模式的分割。

表观特征是指手的肤色、纹理、指尖、手型和手的轮廓等。在众多的手势分割方法中肤色分割则是最常用的手势分割方法。依据选择色彩空间的不同,研究者在不同的颜色空间下建模对手势进行分割。Van[26]研究基于RGB空间的肤色建模方法;刘昌盛[27]采用YUV颜色空间进行手势分割;黄国范[28]等利用人体肤色的聚类特性;冯志全等[29]提出基于肤色亮度的手势分割方法;刘军等[30]在色调、亮度、色饱和度空间(hue intensity saturation,HIS)中,通过非参数化的颜色直方图取得肤色范围。基于颜色空间的分割技术的缺陷是在不同的光照条件下,肤色变化较大,当光源亮度或位置角度发生变化时,误检出伪肤色的概率显著增加。

手势动作往往和背景存在差异,一些学者利用运动信息达到了手势分割的目的。这一领域主要有差影和光流两种研究方法。差影法对消除背景图像具有明显的效果,但缺陷是只适用于运动对象的分割。与之相比,光流计算方法不需要预先获取图像背景,在复杂环境下能够清晰地表示手势的运动。Hackenberg等[31]运用光流法,实现手势的实时追踪;刘蓉等[32]印采用佩戴在手腕的单个加速度传感器获取手势加速度信号,提出一种实时手势加速度动作分割和识别方案。基于运动的分割方法一般需要在一些假设前提下才能发挥作用,例如,差影法需要前景图像和背景图像有明显的颜色差别;而光流法要求背景为静止状态和尽量保持光照恒定,且图像里的主运动分量必须是手势运动。

为克服复杂环境下单一手势分割方法的局限,一些学者提出基于多线索融合的分割方法。如Weng等[33]融合颜色、运动和形状定位,提高了手势分割的准确度;赵云等[34]提出结合肤色模型和动态跟踪窗口的手势分割算法;方奎等[35]提出基于样本集均匀化的肤色模型,并建立了基于统计分析的手势分割方案。为降低复杂环境下手势分割的难度和计算复杂度,很多研究通过在手指或手掌上作特殊标识,或者强制要求使用单色的墙壁、特殊颜色的服装来简化背景。从分割准确度的角度来看,这些方法确实提升了系统分割的性能,但诸多人为的限制不仅影响了的人机交互的自然性,而且应用范围也受到了一定的限制。

3.2手势建模

在传统手势识别系统中,手势建模是一个最基本的步骤,不同的手势模型方法,其特征提取的方法也不同。对动态手势识别而言,模型主要建立在图像本身有变化或运动轨迹的基础上。总体上,手势建模方法主要分为基于表观的手势模型和基于三维的手势模型。

基于表观的手势模型利用手势在图像序列中的表观特征进行建模。常采用灰度图或历史图、可变形模板、图像特征属性以及运动参数模型。灰度图和历史图采用直方图等统计方式统计图像序列中的时空信息来建立手势模型[36];可变形模板是从轮廓影像中抽取一些特征点,构成具有一定的形变,能够描述诸如平移、旋转等全局运动的点集[37];图像特征属性指从图像序列中抽取具有辨识度的属性参数,如轮廓、角点、图像矩等[38];运动参数表观模型更多地考虑模型的时空关系,可选择的运动参数包括平移、旋转、形变以及方位等,这种表观模型可利用光流等手段分割图像中的运动区域,建立手势的时空表观特征[39]。

动态手势中存在大量的关节约束和运动依赖关系,骨架模型[40]和几何模型[41]是其常用的方法。三维模型应具有足够的自由度以适应图像中手的尺寸。利用简单的几何结构对骨架模型进行进一步简化,可加快计算机实时处理和渲染的速度。完全恢复手势模型要求对手势的形状和运动具有先验知识,一般很难用于实时操作。因此,实际应用中常采取部分恢复手势模型的策略,提取指尖或手掌的信息就可完成定位和导航等相对复杂的任务。

基于表观的手势模型的计算复杂度低,利用少量的局部特征就可以建立手势模型,应用较为广泛但通用性受到限制。基于骨架的三维模型的适应范围广,所需特征维数高,存在的缺点是系统可能会陷入“维数灾难”。因此,采用PCA算法[42]等来降低特征空间的维度。在建立手势模型的过程中,深度学习方法的应用越来越广泛,如文献[43]利用两流递归神经网络(2S-RNN)有效地融合多模态特征并对手势序列进行建模。

3.3手势识别

不同的手势模型决定了手势识别方法的多样性。研究方法主要包含以下4种。

隐马尔可夫模型(hidden markov model,HMM)早期主要用于语音识别领域,近年来在手势识别方向发展非常迅速,涌现了许多具有代表性的研究方法。江超等[44]结合粒子滤波和HMM实现了手势运动轨迹的动态识别;严焰等[45]利用HMM对手势指令建模,并采用K-Means算法矢量量化手势特征序列,以提高手势识别性能;常亚男[46]采样HMM二次训练误识样本方法对非典型手势进行识别,识别率达到98.06%,但其缺陷是初始化过程过于复杂,且由于跟踪和识别分开进行,导致运算量非常大。目前,HMM虽然在语音识别领域取得了巨大的成功,但是在手势识别中的表现却并不令人十分满意,这主要是由于传统的HMM方法需要为每种手势分别建立HMM模型,计算量巨大,影响了系统的实时性能。因此,如何在模型复杂性和系统实时性之间寻求平衡,以适应手势识别的实际应用,将是研究者值得深入探讨的问题。

神经网络具有高度的并行性、自适应性及一定的学习能力等特点,一些学者将这一方法应用于手势识别领域。Murthy等[47]使用BP网络,实现了数十种手势的分类识别。但传统的BP网络存在一些固有的缺点,如容易限于局部极小、收敛速度慢。不能有效利用以往的学习经验等。针对这些问题,许多改进算法不断被提出来。Li等[48]提出自适应确定隐含层神经元数目的算法,将Chebyshev前馈神经网络推广到动态手势学习和识别;Tusor等[49]将模糊理论和人工神经网络结合,建立了模糊神经网络的拓扑结构,用模糊特征值去描述和区分不同的手的姿势。神经网络模型种类繁多,针对不同的应用需求,可衍生出不同的形式,但其识别准确建立在大容量的训练样本基础之上。虽然一些改进的网络训练迭代规则可以提高训练速度,但仍不能完全避免冗长的学习训练过程,因此,该方法不太适应需要对用户手势进行在线学习的情况。

基于时间规整的方法可分为基于压缩时间轴的识别和基于动态时间规整的识别(DTW)。前者是通过选择某一时间无关的参数,将动态手势的连续轨迹转化为静态离散的点,然后利用静态手势识别算法对动态手势分类识别。黄国范等[50]将动态手势转换为一系列肤色轨迹点的静态矢量图,实现手势分类识别。DTW方法利用非线性规整函数消除时间上的非线性波动,从而在不同时间轴,上消除时空表示模式之间的差别。陈文[51]提出适合基于加速度传感器的智能终端的E-DTW手势识别算法,通过斜率限定曲线路径,减轻模板匹配的计算量,降低手势识别的开销。

为克服单一视觉信号的不足,多传感器信息检测和融合技术逐渐被引入到手势识别中,成为手势识别领域研究的一个热点。目前主要有加速度计融合、数据手套融合、肌电融合3种方式,刘煜[52]利用的是三轴微加速度计与三轴微陀螺仪的手持设备。对于一些特定手势动作,有学者利用加速度传感器捕捉人的体感动作,取得了不错的识别率。梁秀波等[53]利用智能手机和Wiimote作为加速度数据采集设备,将手势的识别用于人机交互系统,但加速度传感器在低速和与旋转相关的动作识别方面存在缺陷;为此,王万良等[54]将地磁传感器和加速度传感器数据融合,由隐马尔科夫模型进行手势分类和识别。多信息融合的方法能有效补充单一。视觉信息识别的缺陷,但目前多数的研究只是简单的采样融合。由于不同类别的信息具有的时空变换不同,如何深层次有效地协调融合将是研究者今后重点需要考虑的问题。

3.4特征提取

手势模型确定后,手势分析下一步的任务是需要在选定的模型下完成特征提取和匹配,从而为后续的识别提供分类基础信息。按照提取特征级别的不同,一般可以分为低层几何特征、高层全局特征和3D特征。低层几何特征并不考虑图像的内容,只包含了手势的局部信息,如角点、轮廓、重心等。因此,很难。适应手势的缩放与平移等变换。针对这一问题,一些学者采用Hu矩、Zernike矩、傅里叶描述子等全局特征进行手势识别。李丹娇等[55]提出融合CSS形状描述子与傅里叶描述子的手势特征提取方法,陈启军等[56]利用傅里叶描述子提取手势特征,并结合Camshift算法和Kalman滤波预测识别手势的运动。与前两种特征相比,3D模型特征不会有遮挡等问题,但直接获取关节、 骨架等模型特征非常困难。目前,不管哪一类特征,其提取结果非常依赖于前期分割的质量。因此,如何将手势分割和特征提取一定程度。上融合,或直接忽略分割的影响,将是今后发展的研究方向。

4.存在的问题及发展趋势

手势识别是一个非常具有挑战性的研究课题。自然手势存在多样性、多义性等特点,复杂的动态手势必须关注手势时间序列上的变化、手的运动轨迹、手的外形特征等多个方面,这使得基于视觉的手势识别技术面临许多关键问题,手势识别的研究仍然有一些技术难题需要突破。

首先是手势目标检测与跟踪问题。手势目标检测是手势识别中重要的一步,其好坏直接影响到手势识别效果。环境因素,如复杂多变的背景、不同光照条件等因素的影响,给手势分割带来很大困难;此外,手势在执行过程中可能存在部分遮挡,并且由于手是可变形体,能够做出各种复杂的手势动作,这些都加大了手势分割的难度,目前的手势分割方法还不能完全准确地定位出人手。

其次是动态手势的时空差异性。人类的手势动作在空间上有很大的灵活性,同类的手势动作,由于不同动作执行者的习惯不同,每次手势轨迹的幅度、方向以及位置都不尽相同,即使是同一人重复做多次,每次的运动速度和幅度都不可能完全一样。另外,从不同角度观察同一手势也会有不同的外观。

第三就是实时性问题。基于视觉的手势识别系统涉及到大量视频数据的处理,对计算机的运算速度和存储容量要求很高。为了保证较高的识别率,在手势实际识别中,采取的办法是使用多维参数提取手势特征。但参数维度过高会增加处理器的负载,导致计算速度下降。普通用户所使用的计算机处理器性能还不能满足非常复杂的识别算法需要,这使得手势识别很难达到实时性要求。

到目前为止,手势识别的研究仍主要集中在技术层面的实现问题,综合利用其他学科已有的研究成果相对不足。如手势交互时必须要考虑人的心理特征,可利用心理学的基础研究建立具有自然、高效的交互体验的手势模型。冯志全等[57]从认知心理的角度对人手的行为进行分析,建立了操作者手势的4阶段行为预测模型,并研究了基于行为模型的手势跟踪和交互算法。从现有的研究状况和手势识别未来的发展需求来看,综合利用多学科已有的研究成果,是值得研究者深人考虑的内容。

5.结论

虚拟现实下的手势识别在人机交互领域具有不可替代的地位,经过几十年的广泛研究。手势识别技术已经取得了很大的进展。但由于手势通常处于复杂的环境下,而复杂的背景因素则会导致手势分割的准确性下降,不能精确地提取并识别手势。本文从手势分割、手势建立、手势识别以及特征提取等多个方面对虚拟现实下的手势识别技术的研究现状和发展前景进行了分析,总结出了各种方法的优缺点,指出当前研究存在的问题以及发展趋势随着人机交互的发展手势识别技术研究渐渐趋于成熟,各种算法的推陈出新必将给视觉手势识别带来新的研究途径。

参考文献

[1] Goldinmeadow S.The role of gesture in communication and thinking.Trends in Cognitive Sciences,1999,3(11):419-429.

[2] Meenakshi P.Hand gesture recognition based on shape parameters[C]//International Conference on Computing,Communication and Applications(ICCC A).2012:317-319

[3] Grimes G J. Digital data entry glove interface device:Technical Report US Patent 4[R]. 1983:414-537

[4] Ouhyoung M,Liang R H.A sign language recognition system using hidden markov model and context sensitive search[C]//Proceedings of the ACM Symposium on Virtual Reality Software and Technology.1996 :59-66

[5] 吴江琴,高文.基于视觉手套数输入的汉语手指字母的识别[J].模式识别与人工智能,1999,12(1):74-78

[6] Grobel K,Assan M.Isolated sign language recognition using hidden makov model [C]//IEEE International Conference on Computational Cy bernetics and Simulation, 1997,1:162 -167

[7] EROL A,BEBIS G,NICOLESCU M,et al.Vision-based hand pose estimation: A review[J].Computer Vision and Image Understanding,2007,108(1/2) :52-73.

[8] 关然,徐向民,罗雅愉,等.基于计算机视觉的手势检测识别技术[J].计算机应用与软件,2013,30(1):155-160.

[9] Mo Z Y,Lewis J P,Neumann U.SmartCanvas: A gesture-driven itelligent drawing desk system[A]. Proc of the 10th International Conference on Intelligent User Interfaces[C].New York: ACM Press,2005.239-243.

[10] Kolsch M,et al. Vision-Based Hand Gesture Interfaces for Wearable Computing and Virtual Environments[D].Santa Barbara:University of California, 2004.

[11] Hlliges O, Izadi S, Wilson A D,et al. Interactions in the air:Adding further depth to interactive tabletops[A].Proc of the 22th Annual ACM Symp on User Interface Software and Technology[C].New York:ACM Press ,2009.139-148.

[12] 付永刚,张凤军,戴国忠.双手交互界面研究进展[J].计算机研究与发展,2005,42(4):604-613

[13] Takahashi T,Kishino F. Hand gesture coding based on experiments using a hand gesture interface device[J].ACM SIGCHI Bulletin,1991,23(2):67-74

[14] ParkHS, KimE Y, Jang SS, et al. An HMM based gesture recognition for perceptual user interface[M]//Advances in Multi-media Information Processing. Springer Berlin Heidelberg,2005 : 1027-1034

[15] Bobick A F, Wilson A D. A state-based approach to the representation and recognition of gesture[J]. IEEE Transaction on Pattern Analysis and Machine Intelligence,1997,19(12):1325-1337

[16] LeeJ s,Lee YJ,Lee E H,et al. Hand region extraetion and gesture recognition from video stream with complex background through entropy analysis [C] // Proceedings of the 26th Annual International Conference of the IEEE EMBS. San Francisco,CA, USA ,2004:490-493

[17] Darrell T, Pentland A. Space time gesture [C]// IEEE Conference on Compute Vision and Pattern Recognition. 1993: 335-340

[18] Yang M H, Ahuja N. Recognizing bhand gestures using motion trajectories[ M]. Face Detection and Gesture R ecognition for Human-Computer Interaction. Springer US,2001 :53-81

[19] 祝远新,徐光祐,黄裕.基于表观的动态孤立手势识别[J].软件学报, 2000,11(1):54-61

[20] 任海兵,祝远新,徐光裕,等.连续动态手势的时空表观建模及识别[J].计算机学报[J],2000, 23(8) :824-828

[21] 任海兵,祝远新徐光裕,等,复杂背景下的手势分割与识别[J].自动化学报, 2002 , 28(2) :256 -261

[22] 王西颖,戴国忠,张习文,等.基于HMM-FNN模型的复杂动态手势识别[J].软件学报, 2008, 19(9) :2302- 2312

[23] 刘江华,陈佳品,程君实.基于光流及耦合隐马尔可夫模型的动态手势识别[J].上海交通大学学报,2003 ,37(5):720-723

[24] 方亦凯,程健,汪孔桥,等.基于快速尺度空间特征检测的手势识别方法[J].中国图象图形学报,2009,14(2):214-220

[25] LI M,SUN L, HUO Q.Precise hand segmentation from a single depth image[C]//International Conference on Pattern Recognition.IEEE,2017:2398 -2403.

[26] Van-Den-BerghM,Van-Gool L. Combining RGB and TOF cameras for rea-time 3D hand gesture interaction[C]//IEEE Workshop on Application of Computer Vision.New Jersey,2011:66-72

[27] 刘昌盛,厉树忠赵姝颖.等一种复杂背景下的手部图像分割方法[J].河北科技师范学院学报,2007,21(3):46-49

[28] 黄国范,程小平,基于历史的动态手势识别[J].西南大学学报,(自然科学版) ,2009 ,31(1):106-110.

[29] 冯志全,杨波,郑艳伟.基于特征点分布分析的手势特征检测方法[J].计算机集成制造系统,2011,17(11):2333-2340.

[30] 刘军,田国会,李荣宽,等.智能空间下基于手势识别的人机交互[J].北京联合大学学报:自然科学版,2010,24(2):14-18.

[31] HACKENBERG G, MCCALL R, BROLL W. Lightweight palm and finger tracking for realtime 3D gesture control [C]// Proceeding on Virtual Reality Conference. Singapore: IEEE Press ,2011:19-26.

[32] 刘蓉,刘明.实时手势加速度动作分割与识别研究[J].小型微型计算机系,2012,33(7):1620-1624.

[33] WENG Chuan- bo,LI Yang, ZHANG Ming- min,et al. Robust hand posture recognition integrating multi-cue hand tracking[M]. Germany : Springer-Verlag,2010:497-508.

[34] 赵云,夏小玲.使用肤色模型和动态跟踪窗口的手势跟踪算法[J].计算机工程与应用,2010,46(34):199-203.

[35] 方奎,欧阳宁,莫建文.基于椭圆模型的手势识别与仿真[J].计算机仿真,2011 ,28(3):267-280.

[36] TRAN T H,VO T H,TRAN D T,et al. Dynamic hand gesture recognition using RGB-D motion history and kernel descriptor [C] // International Conference on Advanced Technologies for Communications. IEEE, 2014 :268-273.

[37] QIN S, YANG Y,JIANG Y. Gesture recognition from depth images using motion and shape features[C] // International Symposium on Instrumentation and Measurement , Sensor Network and Automation. IEEE,2014:172-175.

[38] REN Z, YUAN J, ZHANG Z. Robust hand gesture recognition based on finger earth mover’s distance with a commodity depthcamera [C] // ACM International Conference on Multimedia.ACM,2011 : 1093- 1096.

[39] SINGHA J,LASKAR R H. Hand gesture recognition using two- level speed normalization, feature selection and classifier fusion[J]. Multimedia Systems,2017,23:1-16.

[40] BERGH M V D,GOOL L V. Combining RGB and ToF cameras for realtime 3D hand gesture interaction[C] // IEEE Workshop on Applications of Computer Vision. IEEE Computer Society,2011 :66-72.

[41] CHONG Y,HUANG J,PAN S. Hand Gesture Recognition Using Appearance Features Based on 3D Point Cloud[J]. Journal of Software Engineering &. Applications, 2016,9(4): 103-111.

[42] WU L Y,WEI S N,ZHOU B B,et al. Hierarchical extreme learning machine gesture recognition method based on PCA dimension reduction[J ]. Electronic Measurement Technology ,2017,40(3) :82-88. (in Chinese) .

吴良圆,魏书宁,周棒棒,等.基于PCA降维的分层超限学习机手势识别方法[J].电子测量技术,2017,40(3) :82- 88.

[43] CHAI X,LIU Z, YIN F,et al. Two streams Recurrent Neural Networks for Large Scale Continuous Gesture Recognition[C] //International Conference on Pattern Recognition. IEEE, 2017:31-36.

[44] 江超,艾矫燕.基于OpenCV的摄像头动态手势轨迹识别及其应用[J].计算机应用,2012,32(增刊1):128-133.

[45] 严焰,刘蓉,黃璐,等.基于HMM的手势识别研究[J].华中师范大学学报:自然科学版,2012 ,46(5)555-559.

[46] 常亚男.基于HMM的动态手势识别[D].广州:华南理工大学,2012:5.

[47] MURTHY G R S,JADON R S. Hand gesture recognition using neural networks[C] // Proceeding on Advance Computing Conference (IACC). Patiala:IEEE Press , 2010:134-138.

[48] LI Mu, HE Yi-gang. Nonlinear system identification using adaptive chebyshev neural networks[J]. Intelligent Computing and Intelligent Systems ,2010:243-247.

[49] TUSOR B, VARKONY1 K A R. Circular fuzzy neural network based hand gesture and posture modeling[C]// Proceeding on Instrumentation and Measurement Technology Conference (I2MTC). Texas: IEEE Press, 2010:815-820.

[50] 黄国范,程小平.基于历史的动态手势识别[J].西南大学学报:自然科学版,2009,31(1):106-110.

[51] 陈文.基于加速度传感器的智能终端手势识别关键技术研究[D].长沙:国防科学技术学,2011:11.

[52] 刘煜.基于惯性传感器的手机手势识别研究[D].西安:西安电子科技大学,2012:4.

[53] 梁秀波,张顺,李启雷.运动传感驱动的3D直观手势交互[J].计算机辅助设计与图形图像学报,2010,22(3):521-526.

[54] 王万良,杨经纬,蒋一波.基于运动传感器的手势识别[J].传感技术学报,2011,24(12):1723-1726.

[55] 李丹娇,彭进业,冯晓毅,等.结合CSS与傅里叶描述子的手势特征提取[J].计算机工程,2012,36(6):178-181.

[56] 陈启军,朱振娇,顾爽.基于傅立叶描述字和HMM的手势识别[J].控制工程,2012,19(4):634-638.

[57] 冯志全,杨波,李毅,等.基于交互行为分析的手势跟踪方法[J].计算机集成制造系统,2012,18(1):31-40.