Linux 虚拟机安装 hadoop

目录

1 hadoop下载

2 解压hadoop

3 为 hadoop 文件夹改名

4 给 hadoop 文件夹赋权

5 修改环境变量

6 刷新环境变量

7 在hadoop313目录下创建文件夹data

8 检查文件

9 编辑 ./core-site.xml文件

10 编辑./hadoop-env.sh文件

11 编辑./hdfs-site.xml文件

12 编辑./mapred-site.xml 文件

13 编辑./yarn-site.xml文件

14 编辑./workers文件

15 初始化

16 配置免密登录

17 启动和关闭hadoop

18 测试 hadoop

1 hadoop下载

hadoop3.1.3网盘资源如下:

链接:https://pan.baidu.com/s/1a2fyIUABQ0e-M8-T522BjA?pwd=2jqu 提取码: 2jqu

2 解压hadoop

解压 hadoop 压缩包到/opt/soft 目录中

tar -zxf ./hadoop-3.1.3.tar.gz -C /opt/soft/查看是否已经解压到/opt/soft 目录中

ls /opt/soft

3 为 hadoop 文件夹改名

将hadoop-3.1.3/ 改成hadoop313

mv hadoop-3.1.3/ hadoop313

4 给 hadoop 文件夹赋权

chown -R root:root ./hadoop313/

5 修改环境变量

# HADOOP_HOME

export HADOOP_HOME=/opt/soft/hadoop313

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$HADOOP_HOME/lib

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

export HDFS_JOURNALNODE_USER=root

export HDFS_ZKFC_USER=root

export YARN_RESOURCEMANAGER_USER=root

export YARN_NODEMANAGER_USER=root

export HADOOP_MAPRED_HOME=$HADOOP_HOME

export HADOOP_COMMON_HOME=$HADOOP_HOME

export HADOOP_HDFS_HOME=$HADOOP_HOME

export HADOOP_YARN_HOME=$HADOOP_HOME

export HADOOP_INSTALL=$HADOOP_HOME

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

export HADOOP_LIBEXEC_DIR=$HADOOP_HOME/libexec

export JAVA_LIBRARY_PATH=$HADOOP_HOME/lib/native

export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoop

6 刷新环境变量

source /etc/profile

7 在hadoop313目录下创建文件夹data

mkdir ./data8 检查文件

查看/opt/soft/hadoop313/etc/hadoop路径下是否有如下文件

9 编辑 ./core-site.xml文件

vim ./core-site.xml在

注意自己的 hostname 是否一致,还有是否做了域名映射

域名映射可以参考Linux安装配置Oracle+plsql安装配置(详细)_sqlplus 安装_超爱慢的博客-CSDN博客

前几步骤

fs.defaultFS

hdfs://kb129:9000

hadoop.tmp.dir

/opt/soft/hadoop313/data

hadoop.http.staticuser.user

root

io.file.buffer.size

131073

hadoop.proxyuser.root.hosts

*

hadoop.proxyuser.root.groups

*

10 编辑./hadoop-env.sh文件

找到被注释的export JAVA_HOME或者直接重新写一个

注意自己的 JAVA_HOME 路径是否与本文一致

vim ./hadoop-env.shexport JAVA_HOME=/opt/soft/jdk18011 编辑./hdfs-site.xml文件

vim ./hdfs-site.xml在

dfs.replication

1

dfs.namenode.name.dir

/opt/soft/hadoop313/data/dfs/name

dfs.datanode.data.dir

/opt/soft/hadoop313/data/dfs/data

dfs.permissions.enabled

false

12 编辑./mapred-site.xml 文件

vim ./mapred-site.xml在

注意自己的主机名

mapreduce.framework.name

yarn

mapreduce.jobhistory.address

kb129:10020

mapreduce.jobhistory.webapp.address

kb129:19888

mapreduce.map.memory.mb

4096

mapreduce.reduce.memory.mb

4096

mapreduce.application.classpath

/opt/soft/hadoop313/etc/hadoop:/opt/soft/hadoop313/share/hadoop/common/lib/*:/opt/soft/hadoop313/share/had oop/common/*:/opt/soft/hadoop313/share/hadoop/hdfs/*:/opt/soft/hadoop313/share/hadoop/hdfs/lib/*:/opt/soft/hadoop313/ share/hadoop/mapreduce/*:/opt/soft/hadoop313/share/hadoop/mapreduce/lib/*:/opt/soft/hadoop313/share/hadoop/yarn/*:/op t/soft/hadoop313/share/hadoop/yarn/lib/*

13 编辑./yarn-site.xml文件

vim ./yarn-site.xml在

注意自己的主机名(hostname)是否一致

yarn.resourcemanager.connect.retry-interval.ms

20000

yarn.resourcemanager.scheduler.class

org.apache.hadoop.yarn.server.resourcemanager.scheduler.fair.FairScheduler

yarn.nodemanager.localizer.address

kb129:8040

yarn.nodemanager.address

kb129:8050

yarn.nodemanager.webapp.address

kb129:8042

yarn.nodemanager.aux-services

mapreduce_shuffle

yarn.nodemanager.local-dirs

/opt/soft/hadoop313/yarndata/yarn

yarn.nodemanager.log-dirs

/opt/soft/hadoop313/yarndata/log

yarn.nodemanager.vmem-check-enabled

false

14 编辑./workers文件

vim ./workers将里面的内容替换成你的主机名(hostname)

如:

kb129

15 初始化

hadoop namenode -format看到下面内容即为成功初始化

16 配置免密登录

返回家目录

ssh-keygen -t rsa -P ""回车后再回车

会出现以下画面

查看是否有.ssh文件

ll -a配置免密登录

cat /root/.ssh/id_rsa.pub >> /root/.ssh/authorized_keys测试免密登录(ssh连接自己)

ssh -p 22 root@kb159如果不用输密码就算配置成功

第一次连接会有输入 yes 或 no 的选择

以后连接不会有这样的提示会直接连接成功

连接成功后返回本机输入 exit 回车

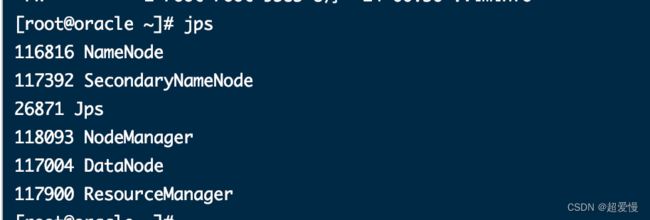

17 启动和关闭hadoop

启动 hadoop

start-all.sh 关闭 hadoop

stop-all.sh 18 测试 hadoop

在浏览器输入网址http://192.168.153.129:9870/ 可出现页面(注意替换自己的 IP 地址)

再或者查看 hadoop 版本

hadoop version