大数据组件-Flume集群环境的启动与验证

【大数据学习记录篇】-持续更新中~

个人主页:beixi@

本文章收录于专栏(点击传送):【大数据学习】

持续更新中,感谢各位前辈朋友们支持学习~

上一篇文章写到了Flume集群环境的安装,这篇文章接着上篇文章延伸Flume集群环境的启动与验证,如果Flume集群环境没有搭建的小伙伴们可以参考我上一篇文章:大数据组件-Flume集群环境搭建

文章目录

-

- 1.环境介绍

- 2.Flume集群环境的启动与验证

1.环境介绍

本次用到的环境有:

Oracle Linux 7.4,三台虚拟机,分别为master,slave1,slave2

JDK1.8.0_144

Hadoop2.7.4集群环境

Flume1.6.0

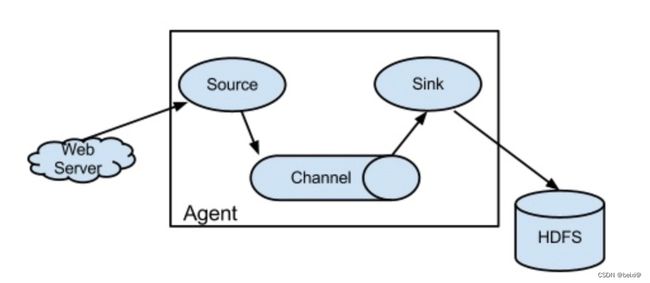

2.Flume集群环境的启动与验证

1.在master机上启动flume

/opt/flume/bin/flume-ng agent -n a1 -c conf -f /opt/flume/conf/master.conf -Dflume.root.logger=INFO,console &

2.切换slave1,启动slave1上的flume

/opt/flume/bin/flume-ng agent -n a1 -c conf -f /opt/flume/conf/slave.conf -Dflume.root.logger=INFO,console &

3.切换至slave2,启动slave2上的flume

/opt/flume/bin/flume-ng agent -n a1 -c conf -f /opt/flume/conf/slave.conf -Dflume.root.logger=INFO,console &

4.切换至”从节点1,双击桌面上的“Xfce终端”图标重新打开一个命令窗口。

5.新建立文件slave1.txt,输入如下内容,拷贝至flume的logs目录。

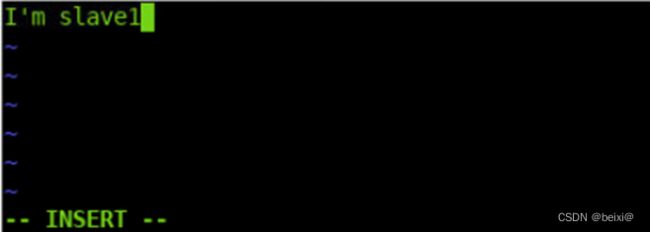

vi slave1.txt

I'm slave1

6.按键Esc,按键”:wq!”保存退出。

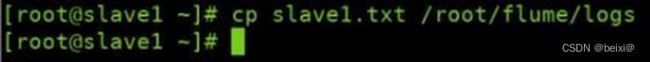

7.拷贝文件slave1.txt至flume的logs目录。

cp slave1.txt /root/flume/logs

8.切换至”主节点“,查看master机的启动命令窗口,会看到写入描述。

9.在“主节点”,双击桌面上的“Xfce终端”图标重新打开一个命令窗口。

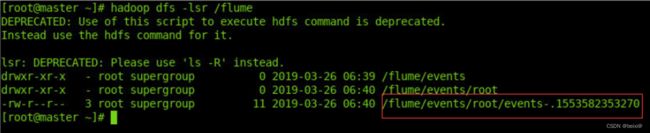

10.在“主节点”新打开一个命令窗口中查看HDFS日志上传情况列表。

hadoop dfs -lsr /flume

11.查看HDFS列表中日志的内容,即上一步截图中红框中的文件内容。注意:这个日志文件每次上传名会不一样,本次查询文件名为上图红框所示。

hadoop dfs -cat /flume/events/root/events-.1553582353270

12.切换至”从节点2“,双击桌面上的“Xfce终端”图标重新打开一个命令窗口。

13.新建立文件slave2.txt,输入如下内容,拷贝至flume的logs目录。

vi slave2.txt

I'm slave2

14.按键Esc,按键”:wq!”保存退出。

15.拷贝文件slave2.txt至flume的logs目录。

cp slave2.txt /root/flume/logs

16.切换至”主节点“,查看master机的启动命令窗口,会看到写入描述,此时表示新内容写入HDFS完成,然后可查看HDFS里新加的内容。

17.在“主节点”,双击桌面上的“Xfce终端”图标重新打开一个命令窗口。

18.在“主节点”新打开一个命令窗口中查看HDFS日志上传情况列表。

hadoop dfs -lsr /flume

19.查看HDFS日志上传列表中日志的内容,即上一步截图中红框中的文件内容。注意:这个日志文件每次上传名会不一样,本次查询文件名为上图红框所示。

hadoop dfs -cat /flume/events/root/events-.1553583628068