PCM音频数据、DSD音频数据,DOP及spdif

PCM音频数据、DSD音频数据,DOP及spdif

- 一、PCM

- 二、DSD

- 三、DOP

- 四、SPDIF

本文引用:

http://article.pchome.net/pic-1717286-1.html

http://www.360doc.com/content/17/0929/09/46862318_691041839.shtml

https://www.zhihu.com/question/393437399/answer/1446905385

采样率、和位深度是数字音频的两个维度。

采样率: 用数字的方式记录声音需要多次采样,采样率是1秒钟内对声音波形的采样次数,采样率越高,对声音形状的记录越清晰具体。比如VCD的标准采样率是44100HZ,DVD是48000HZ,96000/192000是高清蓝光。

位深度: 是记录声音响度动态范围的,音量从最大到最小的范围就是动态范围。位深度越大,声音的音量对比越明显,层次越丰富。16Bit可以提供96db的动态范围(扣除高频颤动,实际为92db),每增加一个Bit的量化精度,响度范围大约增加6db。24Bit大约可以提供144db的动态范围。采样率决定声音的形态(精度),比特率决定声音的响度范围(动态范围)。高采样率可以精准传递音乐的质感,高比特率可以完整传达音乐中的情绪烈度。录制声音的话,在硬件(话筒、声卡)支持的范围内调高一些参数是有用的,录得声音会更好。如果是播放,单纯提高参数基本没有实际的效果,音频源文件是什么样就是什么样。

作者:亦聚群英

链接:https://www.zhihu.com/question/393437399/answer/1446905385

来源:知乎

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

一、PCM

我们电脑中常见WAV格式的音频文件其内部封装的正是PCM的音频,苹果的OS X系统下则是采用aiff格式来存储封装PCM的音频。PCM的全称是Pulse-code modulation。中文是脉冲编码调制,是一种音频模拟信号的数字化方法。PCM将信号的强度依照同样的间距分成数段,然后用独特的二进制来量化。将音频模拟信号转变成数字信号的过程是一种调制的过程,从数字信号回制成模拟信号的过程则是解调。

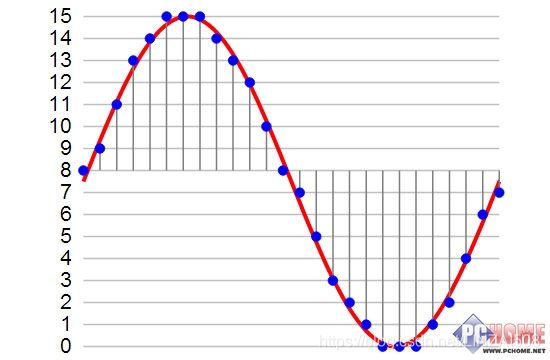

- 4bit位深的PCM编码示意图

我们都知道音频信号是一种模拟信号,日常使用的PC则是数字化设备,内部采用存储的是数字信号,因此在PC这些数字设备当中播放音频就必须先将音频进行数字化的存储,PCM则可以看作是这样的一个解决方法,它可以将音频模拟信号转化成数字信号。上图的当中的红色曲线代表了一个正弦波,蓝色的点则是取样点,横坐标是采样频率,纵坐标是采样位深,这样我们就能从正弦波得到9、11、12、13、14等一组数据,而这些数据可以被数字化的设备轻松识别,这个过程可以看作是一个PCM编码的大致原理,同时也可以解释为何我们日常播放的音频当中会注明24bit或是48kHz这些参数。在实际应用当脉冲编码调制肯定不会是那么简单的,通常是由专门的芯片来完成的,这就是ADC(模数转换器)。

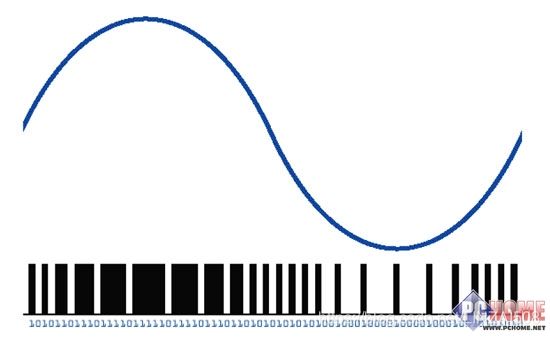

- 这张图更加形象的阐述了PCM的编码原理

当然我们得到了这些数字化的音频信号后并不能简单的将其存储在CD或是硬盘当中,为了在播放时能够识别不同规格的PCM还需要为其添加一定的标识或是进行分割,因此我们就将PCM封装成了WAV或是aiff格式,当然直接用虚拟信号采样得到的PCM体积是比较庞大,通常还会对PCM进行压缩,类似于ape、flac、tta等就是PCM经过无损编码压缩后的结果,而我们常见mp3、aac等则是经过了有损压缩。

- TI PCM1794A DAC芯片

经过压缩后的PCM在体积上会有不少优势,但播放时需要先将压缩数据解压成还原成PCM才能过DAC芯片解码成模拟音频信号供信号放大器使用。压缩音频编码解码成PCM的过程中并不涉及数字和模拟信号的转换,一般通过CPU即可完成,而PCM还原成模拟信号则需要DAC才可完成,并不能通过CPU来进行,DAC并不是支持解调任何规格的PCM,目前较高规格的PCM可以达到32bit/192kHz,而大多数声卡当中DAC至支持24bit/192kHz的规格,因此播放时还需通过CPU对高规格的PCM进行向下采样。

说到这里大致可以了解凡事数字信号之间的转换可以通过CPU等数字化的可编程设备来进行,而数字模拟信号之间的转换必须通过专门设计的DAC、ADC进行。

二、DSD

DSD,Direct Stream Digital(DSD)是属于索尼和飞利浦的专利技术,这也难怪索尼的高端音频设备会支持。DSD和我们现用这些音频编码格式最大的区别就是它是基于PDM(pulse-density modulation)脉冲密度调制实现,完全有别于基于PCM的音频。PDM是通过密度来表示模拟音频信号的,PDM每次采样的精度都是1bit,从图中可以看出在正弦波波峰的位置几乎都是1,而波谷的位置则是0,因此通过PDM调至的音频信号并不能通过现有的基于PCM的DAC进行解调。

- DSD编码的大致原理

- PCM与DSD采样方式比较

目前DSD拥有四种不同的采样率2.8224MHz(64Fs,亦叫DSD64,意思是64倍的CD采样频率【44100Hz】,即64X44100hz=2.8224MHz)、5.6448 MHz(128Fs)、 11.2MHz(256Fs)和22.5792MHz(512Fs)。DSD使用的最多的场合是Super Audio CD (SACD),这也是目前绝大多数DSD音频的来源,在SACD当中采用的是采样率2.8224MHz的DSD,同时考虑到体积的需求大约在2005年的时候还推出了DSD的无损压缩格式DST(Direct Stream Transfer),DST同样是可以直接使用在SACD当中。

- CD与SACD规格对比

如果将SACD和CD的参数进行对比的话,可以看到SACD最大的优势是在于6声道音频的支持以及拥有更高的响应频率,但笔者认为SACD的响应频率意义并不大,因为人类听觉的极限频率在20Hz-20kHz,超出20kHz的部分人耳完全无法感知到。但就每秒的比特率来说,SACD当中的DSD达到了5645kbps,而普通的CD则是1411kbps,理论上来说DSD记录了比PCM更多的数据,解调成模拟音频信号时能够带来更小的失真。如果采用22.5792MHz的DSD的话每秒比特率则会翻倍至45160kbps,这数据量是PCM远不能达到的。

- 支持DSD解码的索尼PHA-2解码耳放

DSD的优势所在

由于DSD采用了和PCM不同的原理进行调制,因此笔者认为DSD的大多数参数,例如位深、采样率等和PCM是没有可比性的,而笔者认为DSD优于PCM的方面主要是以下两点。DSD较大的比特率可以带来更加丰富的声音细节,这点对于发烧友还是一般大众都是非常有用的,而高达20Hz-50kHz的频率响应可能对普通用户来说意义不大。

1.DSD能够记录更加多的音频数据。

2.DSD拥有更宽的频率响应。

- 支持DSD录制的索尼PCM-D100录音棒

DSD为何无法普及

DSD既然优于PCM,那为何迟迟无法普及,虽然DSD知名度并不高但从1999年推出至今也有15年的历史了,笔者则认为主要是因为一下这四点,导致DSD普及受阻,就目前的情况来说DSD要想完全普及可能还有很长一段路要走,可能很长一段时间内DSD只是核心音频发烧友的玩物。

1.消费者缺乏获取渠道,目前只能购买SACD,无法通过时下流行的在线购买数字音乐方式获取。

2.原生支持DSD解码的设备太少,大多数情况下只能先将DSD转换成PCM在进行播放,无法体验到DSD的优势。

3.支持DSD的软件也相当稀少,软件很少原生支持,需要安装插件,播放过程比较麻烦。

4.DSD属于私有专利,其他厂商跟进支持颇有难度。

三、DOP

DOP(DSD over PCM), 就是用PCM通道来传输DSD音频数据的外包装壳协议。目前DSD界面有DSD同轴输出(DSD/PCM SPDIF,DSD/PDM SPDIF是同样的,叫spdif),DSD AES/EBU(三根线,AES/EBU可以在三针信号中(XLR)传输两个声道)输出,DSD-DAC(不论界面还是同轴),都是通过DOP协议。DSD在PCM 上传输,是不会变成PCM音频数据的,DOP是个协议,是对DSD的一个包装。在DSD数据由播放器播放出来进程中,DSD文件拿出来就会先包装成DOP,成了DOP后就可以像PCM一样在PCM通道中传输,输出后将DOP变成DSD数据(其包装只是在DSD加了标志信息,不会对DSD数据有变动,几乎没有计算,只是浪费了点带宽)

四、SPDIF

SPDIF可以传输PCM音频数据和DOP 的DSD音频数据,至于要传什么数据,按相应的标准设置好即可。不过要取出DOP中的DSD数据,要有相应的DSD逻辑芯片处理。

DSD解码器来说,DSD原生的接口其实就两根线,一根数据线(DATA[8:1]),一根时钟线(SCLK)。SACD 对于DSD 接口来说 其实就是 2.8224MHZ的频率, 即每秒传2.8224M 个数据位给DAC 。SPDIF DOP就是频率就是176.4KHZ, 实际有效的数据就是16bit (共24位,但高8位是DOP的标志信息,无用), 176.4khz*16=2.8224MHZ,所以两者完全对应,无需任何的转换,直接spdif传过来,就可以通过原生的DSD接口送给DSD DA。

更多学习内容:

数字化音频

PCM是什么