双输入注意的RefineNet在糖尿病视网膜病变多病变分割中的应用

Multiple lesion segmentation(多病变分割) in diabetic retinopathy(糖尿病性视网膜病变) with dual-input(双输入) attentive(注意力) RefineNet

目录

一、摘要

二、引言

2.1 DARNet的内部结构和整体流程

2.2 主要贡献

三、方法实现

3.1 全局图像编码器和patch图像编码器

3.2 注意力细化解码器(ARM)

(1) 残差卷积单元(RCU)

(2) 注意力融合模块(AFB)

(3) 链式残差合并(CRP)

五、损失函数

六、实验

6.1 与最先进方法的对比实验

(1) IDRiD性能

(2) 在E-Ophtha上的表现

6.2 消融研究

七、结论

一、摘要

研究问题:针对糖尿病视网膜病变结构复杂、大小不一、类间相似性大等问题,提出了一种双输入注意力RefineNet,即DARNet,用于糖尿病视网膜病变的多病变自动分割。

网络结构:DARNet包括全局图像编码器、局部图像编码器和注意力细化解码器(ARM)(主要模块)。整个图像和patch图像被用作双输入,并分别馈送到ResNet 50和ResNet 101进行下采样(基线网络)。高级注意力细化解码器采用双重注意力机制,将两个编码器中的同级别特征与低级注意力细化模块的输出进行多尺度特征融合,将模型聚焦在病变区域以生成准确的预测(注意力模块)。

研究成果:在三个数据集上评估了四个病变的分割性能,所提出的方法在IDRiD,E-ophtha和DDR上达到了0.9582/0.9617/0.9578的平均准确率和0.9521/0.9637/0.9508的dice分数。大量的实验结果表明,所提出的DARNet优于当前的最先进的模型,具有更好的鲁棒性和准确性。该方法不仅保留了多尺度病变的轮廓细节和形状特征,而且克服了相似组织和噪声的干扰,实现了多尺度病变的精确分割。

二、引言

2.1 DARNet的内部结构和整体流程

为了解决复杂的结构,各种尺寸和不同种类的病变之间的相似性的问题,本文提出了一种双输入注意精炼网(DARNet)的多病变分割。

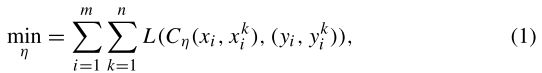

网络结构:DARNet采用双输入编解码器结构,该模型包括整体图像编码器、分块图像编码器和注意力细化解码器。

输入输出:输入为整幅图像和patch图像,输出为四个病灶的分割结果。

整体流程:首先,将整个图像和patch图像分别发送到ResNet50和ResNet101,进行下采样以提取特征。其次,ResNet50和ResNet101中第四个残差块的深度特征同时被馈送到底层注意力细化模块(ARM)以融合全局和局部特征。第三,来自两个编码器中的相同级别的特征图和前一个ARM的输出被馈送到当前ARM,以融合多尺度病变特征。最后,将顶层ARM的融合特征图发送到密集sigmoid层(二分类)以获得最终的病变分割结果。

2.2 主要贡献

1) 为了充分利用眼底图像的全局粗信息和局部细特征,将全图像和斑块作为双输入,提出了一种双输入注意力细化网络(DARNet)实现DR的多病灶分割。

2) 本文提出了一个注意力细化模块(ARM),以充分整合不同病变的多级上下文特征。它由残差卷积单元(RCU)、注意力融合块(AFB)和链式残差池(CRP)组成。ARM使用细粒度的局部特征作为辅助信息来促进粗粒度全局信息的重组,从而将网络集中在病变区域。

3) 在IDRiD、E-Ophtha和DDR三个眼底图像数据集上进行了综合实验。1. 消融研究表明,整体图像和斑块图像作为双输入和注意力融合块有助于提高病变分割的性能。2. 对比实验表明,该框架优于当前最先进的方法,并具有更好的鲁棒性和准确性。3. 该方法能有效地避免其他相似组织的干扰和噪声的干扰,实现视网膜图像多尺度病变的自动准确分割。

三、方法实现

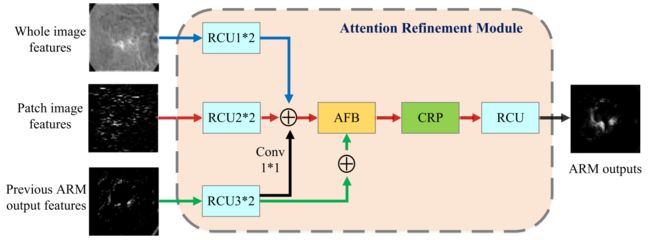

由于眼底图像中病变的不同类型,每个原始图像对应于最多四个标签。

裁剪patch:入分割网络之前,我们将每个训练图像和病变mask ![]() 裁剪成n个块,

裁剪成n个块,![]() 。训练目标函数为:

。训练目标函数为:

其中,![]() 表示原始眼底图像,

表示原始眼底图像,![]() 表示病变标记,m表示训练集中的图像的数量。

表示病变标记,m表示训练集中的图像的数量。

DARNet的整体架构如下图所示:

架构概述:该模型采用编码器(下采),解码器(上采)结构,由全局图像编码器、patch图像编码器和注意力细化解码器(ARM)组成。

3.1 全局图像编码器和patch图像编码器

目的:ResNet通过跳跃连接引入残差块来改善信息流(避免退化问题),并由多个浅层网络组成以加快网络收敛。

方法:两个编码器分别将整个图像和patch(裁剪块)发送到ResNet50和ResNet101,进行下采样以获得不同分辨率的特征图。

结构:ResNet 50和ResNet 101都是由四个残差块组成,每个残差块后输出图像的分辨率都降低到原始图像的1/4。

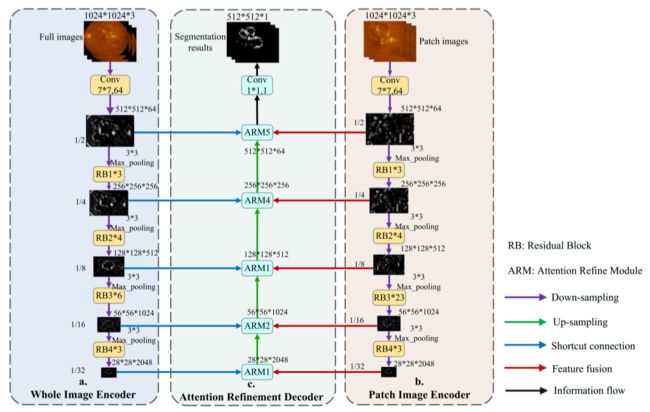

残差块构成:每个残差块包括三个卷积层、两个批归一化(BN)层和三个修正线性单元(ReLU)层的卷积层。

全局图像编码路径和patch图像编码路径可以定义为:

3.2 注意力细化解码器(ARM)

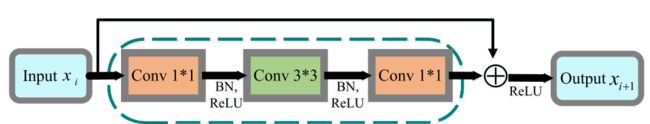

ARM模块由残差卷积单元(RCU)、注意力融合模块(AFB)和链式残差池(CRP)组成。

目的:

1. RCU模块用于提取多尺度特征。

2. AFB模块利用局部特征作为辅助信息,促进全局信息的重组,使模型聚焦于(定位)病变区域。

3. CRP用于捕获较大图像区域中的上下文特征。

以这种方式,(多尺度)融合细粒度局部信息和粗全局信息有利于生成准确的病变分割结果。

输入:ResNet50和ResNet101中的同一层级的残差块的深度特征,除了ARM1以外的ARM模块还需要输入前一次ARM的输出特征。

过程:首先,将整幅图像特征、patch图像特征和前一次ARM模块的输出特征分别输入到三个RCU模块中提取多尺度特征。其次,三个RCU模块输出的特征图被集成到AFB模块中以定位病变区域。第三,将融合的注意力特征馈送到CRP模块以捕获较大图像区域中的上下文特征。最后,池化操作的输出被馈送到RCU以获得最终预测。相关定义如下:

其中, ![]() 、

、![]() 表示第 j 个ARM的输入的全图像和patch图像特征,

表示第 j 个ARM的输入的全图像和patch图像特征, ![]() 表示前一个ARM的输出特征,

表示前一个ARM的输出特征,![]() 、

、![]() 和

和 ![]() 分别表示三个输入的融合特征,信道注意力特征和空间注意力特征。

分别表示三个输入的融合特征,信道注意力特征和空间注意力特征。![]() 和

和 ![]() 分别表示ARM的注意力权重和第 j 个ARM模块的输出。

分别表示ARM的注意力权重和第 j 个ARM模块的输出。

(1) 残差卷积单元(RCU)

RCU模块的详细结构,如图所示:

它包括两个ReLU和两个卷积层,内核大小为3 × 3。此外,它使用加法来融合卷积前后的特征图。

(2) 注意力融合模块(AFB)

这是一个双重注意机制。

目的:增强特定的语义信息以改善通道之间的依赖性,而且可以在空间上捕获丰富的上下文特征表示。

结构:这是一个双重注意机制,由通道注意模块和空间注意模块组成,通道注意和空间注意都是由一个单独的多头自注意力模块捕获。

1. 通道注意力模块

输入:将来自ARM中的三种类型的输入的融合特征定义为

![]()

其中,W、H和C分别表示特征图的宽度、高度和通道数。

过程:首先,将融合特征分别整形为 ![]() ,

, ![]() 和

和![]() 。然后,

。然后,![]() 和

和![]() 利用矩阵乘法和softmax运算得到通道注意力图

利用矩阵乘法和softmax运算得到通道注意力图 ![]() 。然后,

。然后,![]() 和

和![]() 再通过矩阵乘法和一个整形操作,将特征图恢复到原大小。最后,再与原特征

再通过矩阵乘法和一个整形操作,将特征图恢复到原大小。最后,再与原特征![]() 通过各元素相加操作得到最终的通道注意特征。定义如下:

通过各元素相加操作得到最终的通道注意特征。定义如下:

![]()

Q:通道注意力图

的作用?

A:我们来看一个稍微传统的捕获通道注意力的多头注意力模块结构,可以明显看到融合通道注意力的第一步是压缩空间得到一个通道特征向量:

而本文中通道注意力图

的操作示意图如下所示(它最终得到的是一个att 图而不是单个向量):

相当于多个通道注意力向量,虽然它不像传统的单个通道特征向量特征那么集中,但是也能起到通道注意力的效果。(这里可以做个对比试验,效果不一定)

2. 空间注意力模块(改进了传统的空间注意力模块,降低计算复杂度!!!)

过程:在融合特征图上执行三个卷积运算以获得三个分支。首先,将来自前两个分支的特征图的通道维度降低到 C/f 以降低计算复杂度。其次,将整形后的特征 ![]() 和

和 ![]() 相乘。第三,使用softmax函数来获得空间注意力图。最后,通过

相乘。第三,使用softmax函数来获得空间注意力图。最后,通过![]() (这里与通道注意力模块相似)计算空间注意特征。

(这里与通道注意力模块相似)计算空间注意特征。

细节:实验中设置 f 为 8、16、32和64,以适应以下不同尺度的特征图28 × 28 × 2048、56×56×1024、128×128×512和256 ×256×256。

ARM(总)的最终输出:是 ![]() 和

和 ![]() 以及前一个ARM的输出

以及前一个ARM的输出 ![]() 的逐像素加权相加。

的逐像素加权相加。

(3) 链式残差合并(CRP)

CRP的具体结构如图所示,它是由多个池化操作组成的链,类似于RefineNet的CRP。每个池化模块包含卷积层和最大池化层。下一个CRP将前一个CRP的输出作为输入,因此当前CRP可以重用前一个池化操作的结果。因此,在不使用较大池化窗口的情况下从较大背景区域捕获上下文特征。

五、损失函数

由于视网膜图像中的病变像素和正常像素之间的严重不平衡,如果不考虑样本不平衡问题,预测往往更倾向于健康像素。因此,我们使用类平衡的二进制交叉熵损失和dice损失的加权和作为建议DARNet的整体损失函数,以解决潜在的过拟合问题。

令 ![]() 表示病变标签,并且

表示病变标签,并且 ![]() 表示网络的预测,则损失函数定义为:

表示网络的预测,则损失函数定义为:

dice损失能够缓解缓解数据集数据不平衡问题。

ACL2020 | 香侬科技提出使用Dice Loss缓解数据集数据不平衡问题

六、实验

数据集:IDRiD、E-Ophtha和DDR三个眼底图像数据集上评估了DARNet 的分割性能。

评估指标:sensitivity (Sen), specificity (Spe), accuracy(Acc) 和 Dice 来评估各种网络的分割性能。此外还采用了接受者操作特征曲线(ROC)可视化病变分割的不同方法的性能。

6.1 与最先进方法的对比实验

(1) IDRiD性能

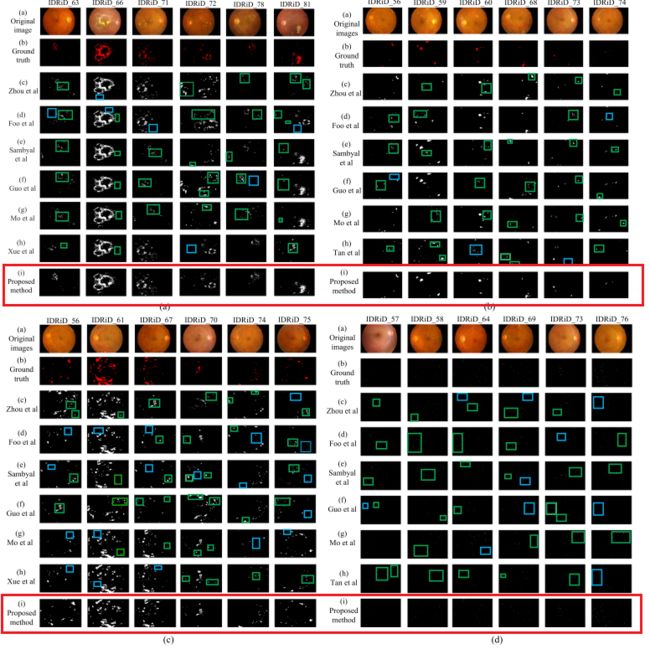

a,b,c,d分别展示多种不同的对比网络在硬渗出(EX)、软渗出(SE)、微动脉瘤(MA)和出血(HE) 病变图像中的分割效果。

上图所示,使用四种颜色来表示本文所提出网络的分割效果(四种不同的病变)。红色表示 EX,黄色表示 SE,蓝色表示MA,绿色表示HE。

分析:在 IDRiD数据集上定量比较了我们的方法和其他 7 种最先进的方法的 4 个病灶分割性能。由表可知,提出的方法在分割 EX、SE、MA和HE时,Acc和Dice分别达到了 0.9823/0.9752/0.9217/0.9537 和 0.9782/0.9642/0.9183/0.9478,在 IDRiD 数据集上的实验结果

证明了DARNet 在多病灶分割方面的优越性。

(2) 在E-Ophtha上的表现

a,b分别展示多种不同的对比网络在硬渗出(EX)、微动脉瘤(MA) 病变图像中的分割效果。

上图显示了不同网络在分割EX和MA中的ROC曲线,以评估实验性能。据观察,所提出的DARNet的AUC值高于其他四种方法的EX分割或MA分割的性能。

分析:从下表中可以看出,提出的方法在大多数标准上超越了其他方法,并且分割EX和MA的Acc和Dice分别达到0.9746/0.9489和0.9761/0.9513。与Guo et al.,EX和MA的Acc和Dice分别增加了20.03%/25.07%和26.02%/29.66%。上述结果表明,所提出的模型的优越性,超过了现有的最先进的方法。

6.2 消融研究

双输入消融实验和注意融合模块消融实验,如下表所示:

分析:1. 与单输入框架相比,双输入网络的分割性能优于单输入网络。具体而言,与基线模型 1 和模型 2 相比,DARNet 的 Acc 和 Dice 分别增加了 1.96%/1.21%/0.54%和 2.58%/1.31%/0.4%。2. 使用注意细化模块(ARM)时,正确率和 Dice 分数分别提高了 0.93%和 0.97%。这说明 ARM能够充分整合多层上下文特征,使网络更加关注病变区域。

七、结论

1. 这是一个双输入网络,通过patch输入来提高细小病变特征的分辨率。

2. 注意力融合模块(AFB)是一个通道注意 + 空间注意模块,通道注意模块通过获取一个通道注意力图,再进行特征融合,空间注意模块进行了计算量的压缩。

3. 本文采用了残差网络作为主干网络,保证了训练过程中不会出现退化问题。