深度学习——实战Kaggle比赛:预测房价

深度学习——实战Kaggle比赛:预测房价

文章目录

- 前言

- 一、Kaggle初识

-

- 1.1. 注册Kaggle账号

- 1.2. 进入房价预测比赛页面

- 二、预测房价实战

-

- 2.1. 下载和缓存数据集

- 2.2. 访问和读取数据

- 2.3. 数据预处理

- 2.4. 训练

- 2.5. K折交叉验证

- 2.6. 模型选择

- 2.7. 提交Kaggle预测

- 总结

前言

经过前面两章理论知识的摧残后,终于到了最期待的实战环节了,本章将记录一下实战Kaggle比赛:预测房价。

参考书:

《动手学深度学习》

一、Kaggle初识

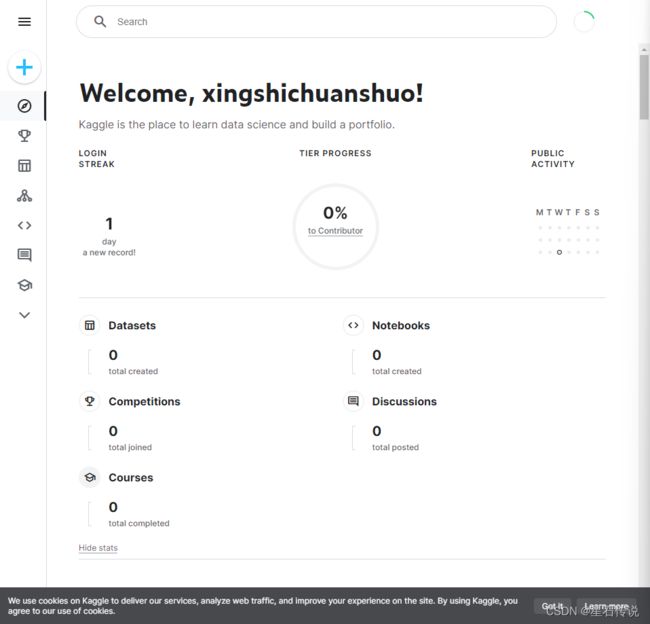

1.1. 注册Kaggle账号

我开始直接在电脑的网页上搜索,想要用邮箱注册:

结果发现行不通(没有那个进行人机身份验证)。

在网上参考了这篇文章:

解决kaggle邮箱注册时无法发送验证码的问题

我就用我自己的手机试了一下,发现可以(不太明白为什么):

在个人账户那里,还有个手机号码验证

最后我重新返回电脑的网页,用在手机上注册的来登录,成功登录:

1.2. 进入房价预测比赛页面

https://www.kaggle.com/c/house-prices-advanced-regression-techniques

二、预测房价实战

此数据集由Bart de Cock于2011年收集 :cite:De-Cock.2011,

涵盖了2006-2010年期间亚利桑那州埃姆斯市的房价。 这个数据集是相当通用的,不会需要使用复杂模型架构。

它比哈里森和鲁宾菲尔德的波士顿房价 数据集要大得多,也有更多的特征。

2.1. 下载和缓存数据集

这里我们(实现几个函数来方便下载数据)。 首先,我们建立字典DATA_HUB, 它可以将数据集名称的字符串映射到数据集相关的二元组上, 这个二元组包含数据集的url和验证文件完整性的sha-1密钥。 所有类似的数据集都托管在地址为DATA_URL的站点上。

import hashlib

import os

import tarfile

import zipfile

import numpy as np

import requests

import torch

from d2l import torch as d2l

from torch import nn

# @save

DATA_HUB = dict()

DATA_URL = 'http://d2l-data.s3-accelerate.amazonaws.com/'

"""

下面的download函数用来下载数据集, 将数据集缓存在本地目录(默认情况下为../data)中, 并返回下载文件的名称。

如果缓存目录中已经存在此数据集文件,并且其sha-1与存储在DATA_HUB中的相匹配, 我们将使用缓存的文件,以避免重复的下载。

"""

def download(name, cache_dir=os.path.join("..", "data")): # @save

""" 下载一个DATA_HUB中的文件,返回本地文件名"""

assert name in DATA_HUB, f"{name}不存在于{DATA_HUB}" # 断言

url, sha1_hash = DATA_HUB[name]

os.makedirs(cache_dir, exist_ok=True)

fname = os.path.join(cache_dir, url.split("/")[-1]) # 获取文件名

if os.path.exists(fname):

sha1 = hashlib.sha1()

with open(fname, 'rb') as f: # 以二进制只读模式打开文件

while True:

data = f.read(1048576) # 1048576 是一个数值常量,表示每次从文件中读取的字节数;从文件对象f中读取1MB的数据,并将其存储到变量data中

if not data:

break

sha1.update(data)

if sha1.hexdigest() == sha1_hash: # 计算其 SHA1 校验码并与预期的 sha1_hash 进行比较

return fname # 如果一致,则直接返回文件名,表示命中缓存

print(f"正在从{url}下载{fname}...") # 如果没有命中缓存,打印下载信息

r = requests.get(url, stream=True, verify=True) # 获取文件内容,并将其写入本地文件 fname 中。

with open(fname, "wb") as f:

f.write(r.content)

return fname # 返回本地文件名,表示下载完成。

"""

我们还需实现两个实用函数: 一个将下载并解压缩一个zip或tar文件,

另一个是将本书中使用的所有数据集从DATA_HUB下载到缓存目录中

"""

# folder 是一个可选参数,表示要将文件解压到哪个文件夹中。

def download_extract(name, folder=None): # @save

"""下载并解压zip/tar文件"""

fname = download(name)

base_dir = os.path.dirname(fname) # 获取 fname 的目录名

data_dir, ext = os.path.splitext(fname)

"""

获取 fname 的扩展名,并将其存储在变量 ext 中。

同时,也获取了文件名不包含扩展名的部分,并将其存储在 data_dir 变量中。

"""

if ext == ".zip": # 根据文件扩展名选择使用模块打开文件,并将文件对象存储在 fp 变量中。

fp = zipfile.ZipFile(fname, "r")

elif ext in (".tar", ".gz"):

fp = tarfile.open(fname, "r")

else:

assert False, "只有zip/tar文件可以被压缩"

fp.extractall(base_dir) # 将文件解压缩到指定目录中

return os.path.join(base_dir, folder) if folder else data_dir

# 如果传入了 folder 参数,则返回指定目录下的路径。否则,返回原始文件名(不包含扩展名)所在的目录

# 用于下载 DATA_HUB 中所有的文件

def download_all(): # @save

"""下载DATA_HUB中的所有文件"""

for name in DATA_HUB:

download(name)

2.2. 访问和读取数据

为方便起见,我们可以使用上面定义的脚本下载并缓存Kaggle房屋数据集。(也可以直接从官网下载)

import pandas as pd

"""

访问和读取数据

"""

DATA_HUB['kaggle_house_train'] = ( #@save

DATA_URL + 'kaggle_house_pred_train.csv',

'585e9cc93e70b39160e7921475f9bcd7d31219ce')

DATA_HUB['kaggle_house_test'] = ( #@save

DATA_URL + 'kaggle_house_pred_test.csv',

'fa19780a7b011d9b009e8bff8e99922a8ee2eb90')

train_data = pd.read_csv(download('kaggle_house_train'))

test_data = pd.read_csv(download('kaggle_house_test'))

#训练数据集包括1460个样本,每个样本80个特征和1个标签, 而测试数据集包含1459个样本,每个样本80个特征。

print(train_data.shape)

print(test_data.shape)

#让我们看看[前四个和最后两个特征,以及相应标签](房价)。

print(train_data.iloc[0:4, [0, 1, 2, 3, -3, -2, -1]])

#移除第一列ID值以及最后的标签值,只获取所有特征列

all_features = pd.concat((train_data.iloc[:,1:-1],test_data.iloc[:,1:]))

2.3. 数据预处理

首先,我们[将所有缺失的值替换为相应特征的平均值。然后,为了将所有特征放在一个共同的尺度上, 我们通过将特征重新缩放到零均值和单位方差来标准化数据

接下来,我们处理离散值。 这包括诸如“MSZoning”之类的特征。 (我们用独热编码替换它们)

根据独热编码,如果“MSZoning”的原始值为“RL”, 则:“MSZoning_RL”为1,“MSZoning_RM”为0

可以看到此转换会将特征的总数量从79个增加到331个。 最后,通过values属性,我们可以 [从pandas格式中提取NumPy格式,并将其转换为张量表示]用于训练。

房价就像股票价格一样,我们关心的是相对数量,而不是绝对数量。

因此,我们更关心相对误差 y − y ^ y \frac{y - \hat{y}}{y} yy−y^, 而不是绝对误差 y − y ^ y - \hat{y} y−y^。

例如,如果我们在俄亥俄州农村地区估计一栋房子的价格时,

假设我们的预测偏差了10万美元,然而那里一栋典型的房子的价值是12.5万美元,那么模型可能做得很糟糕。

另一方面,如果我们在加州豪宅区的预测出现同样的10万美元的偏差,(在那里,房价中位数超过400万美元)这可能是一个不错的预测。

解决这个问题的一种方法是用价格预测的对数来衡量差异。

事实上,这也是比赛中官方用来评价提交质量的误差指标。

即将满足 ∣ log y − log y ^ ∣ ≤ δ |\log y - \log \hat{y}| \leq \delta ∣logy−logy^∣≤δ的 δ \delta δ 转换为 e − δ ≤ y ^ y ≤ e δ e^{-\delta} \leq \frac{\hat{y}}{y} \leq e^\delta e−δ≤yy^≤eδ。

这使得预测价格的对数与真实标签价格的对数之间出现以下均方根误差(rmse):

1 n ∑ i = 1 n ( log y i − log y ^ i ) 2 . \sqrt{\frac{1}{n}\sum_{i=1}^n\left(\log y_i -\log \hat{y}_i\right)^2}. n1i=1∑n(logyi−logy^i)2.

"""

数据预处理

"""

# 先对数值型数据标准化

numeric_features = all_features.dtypes[all_features.dtypes != 'object'].index

all_features[numeric_features] = all_features[numeric_features].apply(

lambda x: (x - x.mean()) / (x.std())

)

# 标准化后,所有均值为0,因此我们可以将缺失值设置为0

all_features[numeric_features] = all_features[numeric_features].fillna(0)

# 接下来则是处理离散值(包括诸如“MSZoning”之类的特征,用独热编码替换它们)

# “Dummy_na=True”将“na”(缺失值)视为有效的特征值,并为其创建指示符特征

all_features = pd.get_dummies(all_features, dummy_na=True, dtype=np.float32)

#print(all_features.shape)

# 通过values属性,可以从pandas格式中提取NumPy格式,并将其转换为张量表示用于训练。

n_train = train_data.shape[0]

train_features = torch.tensor(all_features[:n_train].values, dtype=torch.float32)

test_features = torch.tensor(all_features[n_train:].values, dtype=torch.float32)

train_labels = torch.tensor(train_data.SalePrice.values.reshape(-1, 1), dtype=torch.float32)

print(train_features.shape)

print(train_features)

#结果:

torch.Size([1460, 330])

tensor([[ 0.0673, -0.1844, -0.2178, ..., 1.0000, 0.0000, 0.0000],

[-0.8735, 0.4581, -0.0720, ..., 1.0000, 0.0000, 0.0000],

[ 0.0673, -0.0559, 0.1372, ..., 1.0000, 0.0000, 0.0000],

...,

[ 0.3025, -0.1416, -0.1428, ..., 1.0000, 0.0000, 0.0000],

[-0.8735, -0.0559, -0.0572, ..., 1.0000, 0.0000, 0.0000],

[-0.8735, 0.2439, -0.0293, ..., 1.0000, 0.0000, 0.0000]])

2.4. 训练

首先,我们训练一个带有损失平方的线性模型。 显然线性模型很难让我们在竞赛中获胜,但线性模型提供了一种健全性检查,以查看数据中是否存在有意义的信息。

如果我们在这里不能做得比随机猜测更好,那么我们很可能存在数据处理错误。

如果一切顺利,线性模型将作为基线(baseline)模型, 让我们直观地知道最好的模型有超出简单的模型多少。

# 训练:

loss = nn.MSELoss()

in_features = train_features.shape[1]

def get_net():

net = nn.Sequential(nn.Linear(in_features, 1))

return net

# 房价就像股票价格一样,我们关心的是相对数量,而不是绝对数量

# 我们更关心相对误差:(y_true-y_pre) / y_true

def log_rmse(net, features, labels):

# 为了在取对数时进一步稳定该值,将小于1的值设置为1

clipped_pred = torch.clamp(net(features), 1, float("inf"))

rmse = torch.sqrt(loss(torch.log(clipped_pred), torch.log(labels)))

return rmse.item()

# 与前面的部分不同,我们的训练函数将借助Adam优化器

# Adam优化器的主要吸引力在于它对初始学习率不那么敏感。

def train(net, train_features, train_labels, test_features, test_labels,

num_epochs, lr, weight_decay, batch_size):

train_ls, test_ls = [], []

train_iter = d2l.load_array((train_features, train_labels), batch_size)

# 使用Adam优化算法:

optimizer = torch.optim.Adam(net.parameters(),

lr=lr,

weight_decay=weight_decay)

for epoch in range(num_epochs):

for X, y in train_iter:

optimizer.zero_grad()

l = loss(net(X), y)

l.backward()

optimizer.step()

train_ls.append(log_rmse(net, train_features, train_labels))

if test_labels is not None:

test_ls.append(log_rmse(net, test_features, test_labels))

return train_ls, test_ls

2.5. K折交叉验证

# K折交叉验证, 它有助于模型选择和超参数调整(选择第i个切片作为验证数据,其余部分作为训练数据)

def get_k_fold_data(k, i, X, y):

assert k > 1

fold_size = X.shape[0] // k

X_train, y_train = None, None

for j in range(k):

idx = slice(j * fold_size, (j + 1) * fold_size)

x_part, y_part = X[idx,:], y[idx]

if j == i:

x_valid, y_valid = x_part, y_part

elif X_train is None:

X_train, y_train = x_part, y_part

else:

X_train = torch.cat([X_train, x_part], 0)

y_train = torch.cat([y_train, y_part], 0)

return X_train, y_train, x_valid, y_valid

# 当我们在K折交叉验证中训练K次后,返回训练和验证误差的平均值。

def k_fold(k, X_train, y_train, num_epochs, learning_rate, weight_decay,

batch_size):

train_l_sum, valid_l_sum = 0, 0

for i in range(k):

data = get_k_fold_data(k, i, X_train, y_train)

net = get_net()

train_ls, valid_ls = train(net, *data, num_epochs, learning_rate,

weight_decay, batch_size)

train_l_sum += train_ls[-1]

valid_l_sum += valid_ls[-1]

if i == 0:

d2l.plot(list(range(1, num_epochs + 1)), [train_ls, valid_ls],

xlabel='epoch', ylabel='rmse', xlim=[1, num_epochs],

legend=['train', 'valid'], yscale='log')

print(f'折{i + 1},训练log rmse{float(train_ls[-1]):f}, '

f'验证log rmse{float(valid_ls[-1]):f}')

return train_l_sum / k, valid_l_sum / k

2.6. 模型选择

# 模型选择;

k, num_epochs, lr, weight_decay, batch_size = 5, 100, 7, 0, 64

train_l, valid_l = k_fold(k, train_features, train_labels, num_epochs, lr,

weight_decay, batch_size)

print(f'{k}-折验证: 平均训练log rmse: {float(train_l):f}, '

f'平均验证log rmse: {float(valid_l):f}')

d2l.plt.show()

"""

既然我们知道应该选择什么样的超参数, 我们不妨使用所有数据对其进行训练 (而不是仅使用交叉验证中使用的1−1/K的数据)。

然后,我们通过这种方式获得的模型可以应用于测试集。 将预测保存在CSV文件中可以简化将结果上传到Kaggle的过程。

"""

def train_and_pred(train_features, test_features, train_labels, test_data,

num_epochs, lr, weight_decay, batch_size):

net = get_net()

train_ls, _ = train(net, train_features, train_labels, None, None,

num_epochs, lr, weight_decay, batch_size)

d2l.plot(np.arange(1, num_epochs + 1), [train_ls], xlabel='epoch',

ylabel='log rmse', xlim=[1, num_epochs], yscale='log')

print(f'训练log rmse:{float(train_ls[-1]):f}')

# 将网络应用于测试集。

preds = net(test_features).detach().numpy()

# 将其重新格式化以导出到Kaggle

test_data['SalePrice'] = pd.Series(preds.reshape(1, -1)[0])

submission = pd.concat([test_data['Id'], test_data['SalePrice']], axis=1)

submission.to_csv('submission.csv', index=False)

# 如果测试集上的预测与K倍交叉验证过程中的预测相似, 那就是时候把它们上传到Kaggle了。

# 下面的代码将生成一个名为submission.csv的文件。

train_and_pred(train_features, test_features, train_labels, test_data,

num_epochs, lr, weight_decay, batch_size)

# d2l.plt.style.use("ggplot")

d2l.plt.show()

#结果:

折1,训练log rmse0.163011, 验证log rmse0.155025

折2,训练log rmse0.155532, 验证log rmse0.185428

折3,训练log rmse0.156310, 验证log rmse0.159695

折4,训练log rmse0.161521, 验证log rmse0.152944

折5,训练log rmse0.157828, 验证log rmse0.179974

5-折验证: 平均训练log rmse: 0.158840, 平均验证log rmse: 0.166613

训练log rmse:0.150134

2.7. 提交Kaggle预测

接下来, 我们可以提交预测到Kaggle上,并查看在测试集上的预测与实际房价(标签)的比较情况。

- 看一下评分结果:(直接看排名,不太懂评分标准)

总结

本章跟着书中的操作复现了一遍,书中的代码的许多函数都是从零开始构建,跟之前学的直接引用模块中的函数不太一样。本章记录了如何加入一个Kaggle比赛,提交结果。在这个项目实战中,感觉就是用了很简单的线性模型(简单的了解了一下整个大概流程),从数据预处理到训练再到后面的参数调整。

寂兮寥兮,独立而不改,周行而不殆,可以为天下母。

–2023-10-5 进阶篇