【大数据】HDFS的使用与集群角色(学习笔记)

一、HDFS Shell

1、介绍

命令行界面(CLI)是指用户通过键盘输入指令,计算机接收到指令后,予以执行一种人际交互方式。

Hadoop提供了文件系统的shell命令行客户端

hadoop fs [generic options]

2、文件系统协议

HDFS Shell CLI支持操作多种文件系统,包括本地文件系统(file:///)、分布式文件系统(hdfs://mn:8020)等。

具体操作的是什么文件系统取决于命令中文件路径URL中的前缀协议。

如果没有指定前缀,则将会读取环境变量中的fs.defaultFS属性,以该属性值作为默认文件系统。

3、常用操作

1)创建文件夹

hadoop fs -mkdir [-p] <path>

path 为待创建的目录

-p选项的行为与Unix mkdir -p非常相似,它会沿着路径创建父目录

2)查看目录

hadoop fs -ls [-h] [-R] [<path> ...]

path 指定目录路径

-h 人性化显示文件size

-R递归查看指定目录及其子目录

3)上传文件

hadoop fs -put [-f] [-p] <localsrc> ... <dst>

-f 覆盖目标文件(已存在下)

-p 保留访问和修改时间,所有权和权限。

localsrc 本地文件系统(客户端所在机器)

dst 目标文件系统(HDFS)

4)查看文件内容

hadoop fs -cat <src> ...

读取指定文件全部内容,显示在标准输出控制台。

注意:对于大文件内容读取,慎重!

5)下载文件

hadoop fs -get [-f] [-p] <src> ... <localdst>

下载文件到本地文件系统指定目录,localdst必须是目录

-f 覆盖目标文件(已存在下)

-p 保留访问和修改时间,所有权和权限

拷贝HDFS文件

hadoop fs -cp [-f] <src> ... <dst>

-f 覆盖目标文件(已存在下)

6)追加数据

hadoop fs -appendToFile <localsrc> ... <dst>

将所有给定本地文件的内容追加到给定dst文件。

dst如果文件不存在,将创建该文件。

如果

7)移动操作

hadoop fs -mv <src> ... <dst>

移动文件到指定文件夹下

可以使用该命令移动数据,重命名文件的名称

二、集群角色与职责

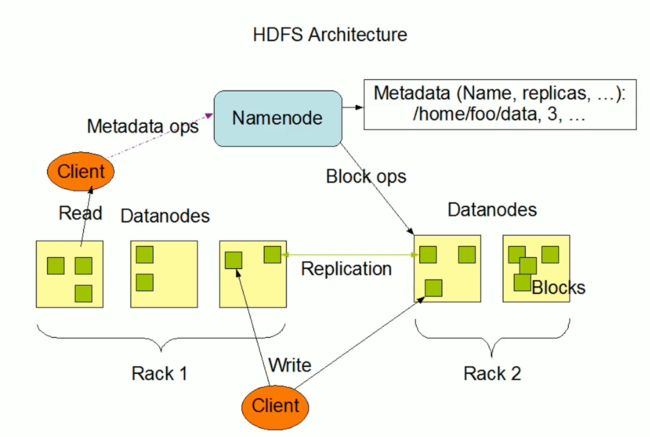

1、官方架构图

2、主角色:namenode

NameNode是Hadoop分布式文件系统的核心,架构中的主角色。

NameNode内部通过内存和磁盘文件两种方式管理元数据。

NameNode成为了访问HDFS的唯一入口。

NameNode仅存储HDFS的元数据:文件系统中所有文件的目录树,并跟踪整个集群中的文件,不存储实际数据。

NameNode知道HDFS中任何给定文件的块列表及其位置。使用此信息NameNode知道如何从块中构建文件。

NameNode不持久化存储每个文件中各个块所在的datanode的位置信息,这些信息会在系统启动时从DataNode重建。

NameNode是Hadoop集群中的单点故障。

NameNode所在机器通常会配置有大量内存(RAM)。

3、从角色:datanode

DataNode是Hadoop HDFS中的从角色,负责具体的数据块存储。

DataNode负责最终数据块block的存储。是集群的从角色,也称为Slave。

DataNode启动时,会将自己注册到NameNode并汇报自己负责持有的块列表。

当某个DataNode关闭时,不会影响数据的可用性。 NameNode将安排由其他DataNode管理的块进行副本复制。

DataNode所在机器通常配置有大量的硬盘空间,因为实际数据存储在DataNode中。DataNode的数量决定了HDFS集群的整体数据存储能力。通过和NameNode配合维护着数据块。

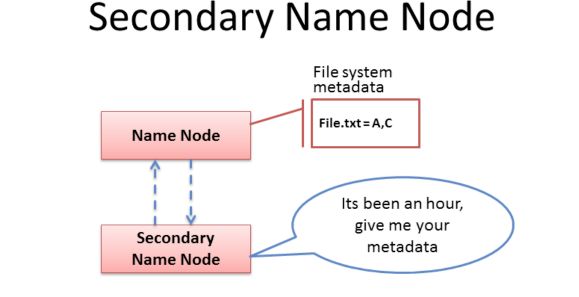

4、主角色辅助角色: secondarynamenode

Secondary NameNode充当NameNode的辅助节点,但不能替代NameNode。

帮助主角色进行元数据文件的合并动作。可以通俗的理解为主角色的“秘书”

三、读写数据流程

1、完整流程图

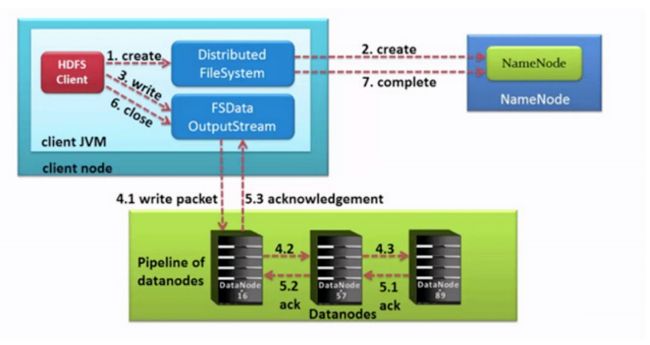

1)写数据完整流程图

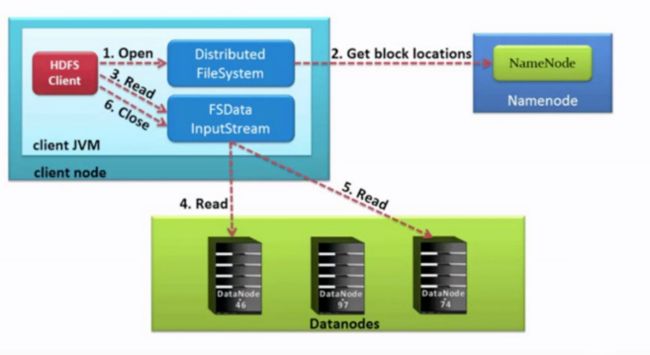

2)读数据完整流程图

2、Pipeline管道

Pipeline,中文翻译为管道。这是HDFS在上传文件写数据过程中采用的一种数据传输方式。

客户端将数据块写入第一个数据节点,第一个数据节点保存数据之后再将块复制到第二个数据节点,后者保存后将其复制到第三个数据节点。

顺序的沿着一个方向传输,这样能够充分利用每个机器的带宽,避免网络瓶颈和高延迟时的连接,最小化推送所有数据的延时。

3、ACK应答响应

ACK (Acknowledge character)即是确认字符,在数据通信中,接收方发给发送方的一种传输类控制字符。表示发来的数据已确认接收无误。

在HDFS pipeline管道传输数据的过程中,传输的反方向会进行ACK校验,确保数据传输安全。

4、默认3副本存储策略

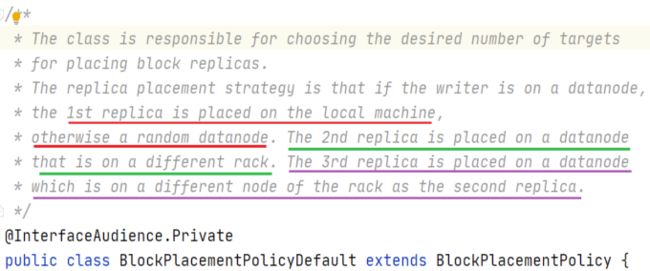

默认副本存储策略是由BlockPlacementPolicyDefault指定。

- 第一块副本:优先客户端本地,否则随机。

- 第二块副本:不同于第一块副本的不同机架。

- 第三块副本:第二块副本相同机架不同机器。

5、写数据流程

1、HDFS客户端创建对象实例DistributedFileSystem, 该对象中封装了与HDFS文件系统操作的相关方法。

2、调用DistributedFileSystem对象的create()方法,通过RPC请求NameNode创建文件。NameNode执行各种检查判断:目标文件是否存在、父目录是否存在、客户端是否具有创建该文件的权限。检查通过,NameNode就会为本次请求记下一条记录,返回FSDataOutputStream输出流对象给客户端用于写数据。

3、客户端通过FSDataOutputStream输出流开始写入数据。

4、客户端写入数据时,将数据分成一个个数据包(packet 默认64k), 内部组件DataStreamer请求NameNode挑选出适合存储数据副本的一组DataNode地址,默认是3副本存储。DataStreamer将数据包流式传输到pipeline的第一个DataNode,该DataNode存储数据包并将它发送到pipeline的第二个DataNode。同样,第二个DataNode存储数据包并且发送给第三个(也是最后一个)DataNode。

5、传输的反方向上,会通过ACK机制校验数据包传输是否成功。

6、客户端完成数据写入后,在FSDataOutputStream输出流上调用close()方法关闭。

6、读数据流程

1、HDFS客户端创建对象实例DistributedFileSystem, 调用该对象的open()方法来打开希望读取的文件。

2、DistributedFileSystem使用RPC调用namenode来确定文件中前几个块的块位置(分批次读取)信息。对于每个块,namenode返回具有该块所有副本的datanode位置地址列表,并且该地址列表是排序好的,与客户端的网络拓扑距离近的排序靠前。

3、DistributedFileSystem将FSDataInputStream输入流返回到客户端以供其读取数据。

4、客户端在FSDataInputStream输入流上调用read()方法。然后,已存储DataNode地址的InputStream连接到文件中第一个块的最近的DataNode。数据从DataNode流回客户端,结果客户端可以在流上重复调用read()。

5、当该块结束时,FSDataInputStream将关闭与DataNode的连接,然后寻找下一个block块的最佳datanode位置。这些操作对用户来说是透明的。所以用户感觉起来它一直在读取一个连续的流。客户端从流中读取数据时,也会根据需要询问NameNode来检索下一批数据块的DataNode位置信息。

6、一旦客户端完成读取,就对FSDataInputStream调用close()方法。