学习笔记:SpringCloud 微服务技术栈_实用篇①_基础知识

- 若文章内容或图片失效,请留言反馈。部分素材来自网络,若不小心影响到您的利益,请联系博主删除。

前言

- 学习视频链接

- SpringCloud + RabbitMQ + Docker + Redis + 搜索 + 分布式,史上最全面的 SpringCloud 微服务技术栈课程 | 黑马程序员 Java 微服务

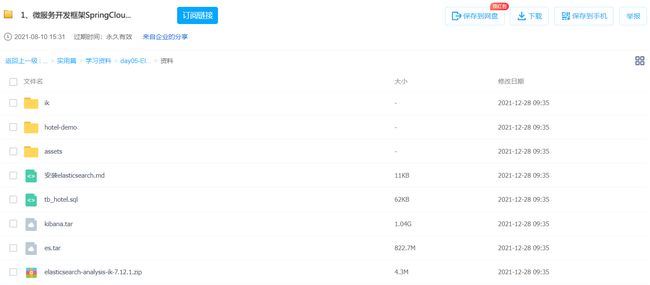

- 学习资料链接

- 2022 最新版 Java 学习 路线图>第 4 阶段:中间键 & 服务框架>1.微服务开发框架 SpringCloud + RabbitMQ + Docker + Redis + 搜索 + 分布式 史上最全面的微服务全技术栈课程(

提取码:dor4)

- 写这篇博客旨在制作笔记,巩固知识。同时方便个人在线阅览,回顾知识。

- 博客的内容主要来自视频内容和资料中提供的学习笔记。

系列目录

SpringCloud 微服务技术栈_实用篇①_基础知识

SpringCloud 微服务技术栈_实用篇②_黑马旅游案例

SpringCloud 微服务技术栈_高级篇①_微服务保护

SpringCloud 微服务技术栈_高级篇②_分布式事务

SpringCloud 微服务技术栈_高级篇③_分布式缓存

SpringCloud 微服务技术栈_高级篇④_多级缓存

SpringCloud 微服务技术栈_高级篇⑤_可靠消息服务

本文目录

微服务远程调用、Eureka 注册中心、Ribbon 负载均衡原理、Nacos 注册中心

- SpringCloudDay01

Nacos 配置管理、Feign 远程调用、GetWay 服务网关

- SpringCloudDay02

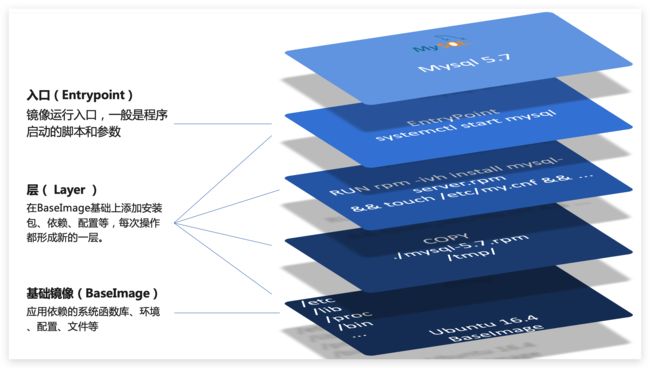

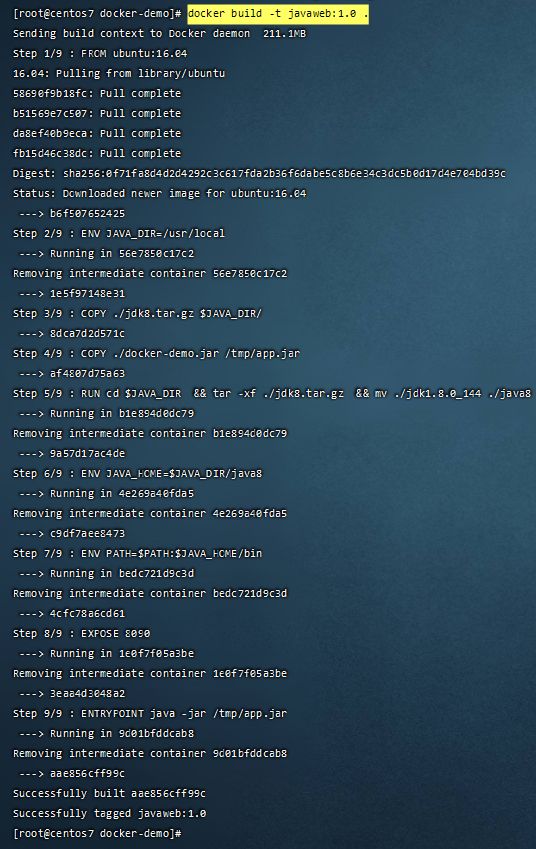

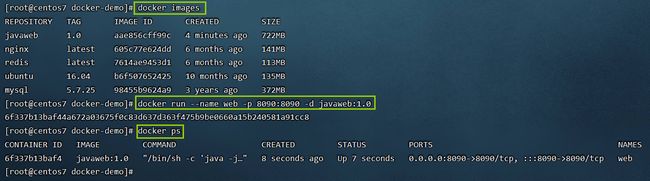

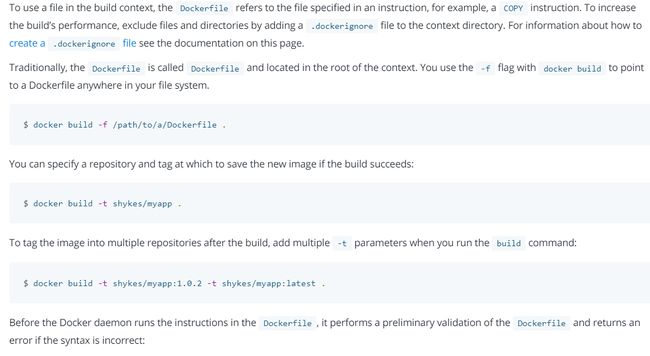

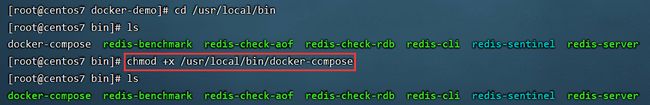

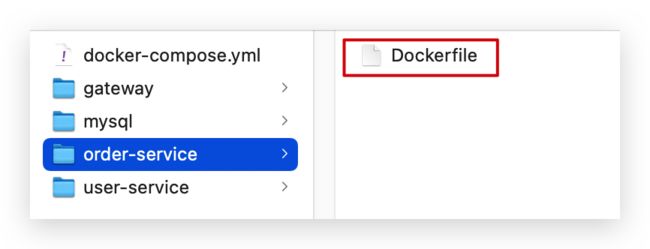

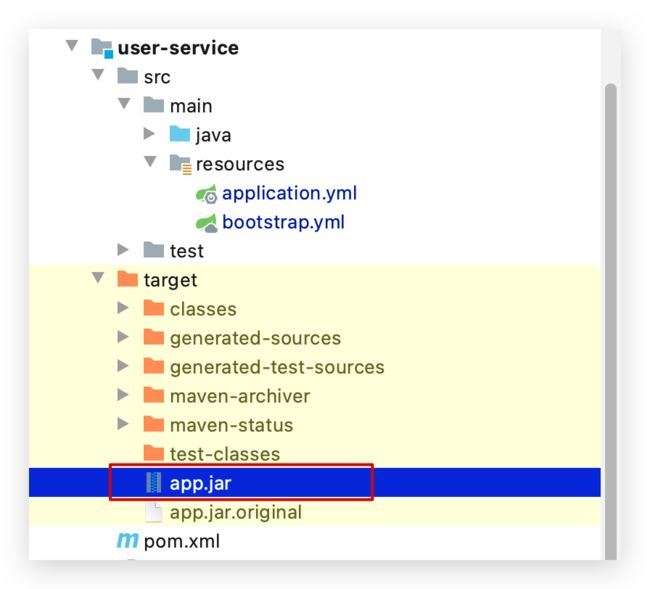

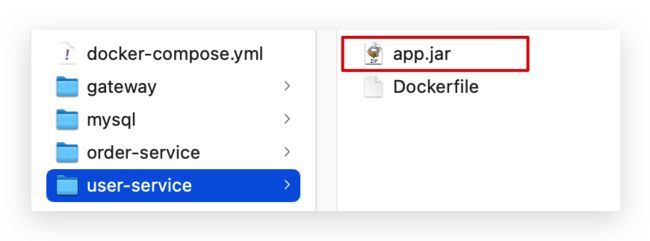

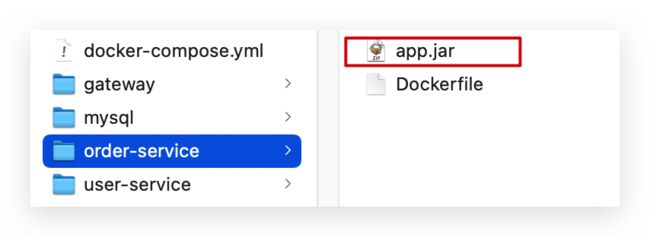

Docker 的基本操作、Dockerfile 的自定义镜像、了解 Docker-Compose、Dokcer 镜像服务

- SpringCloudDay03

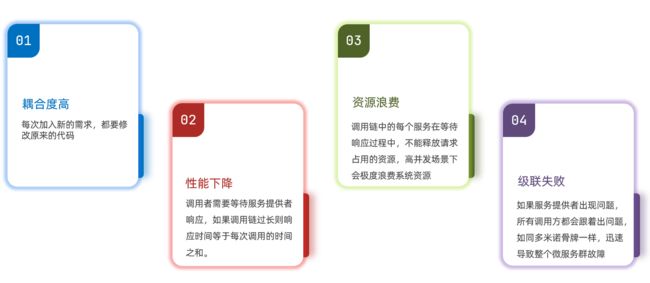

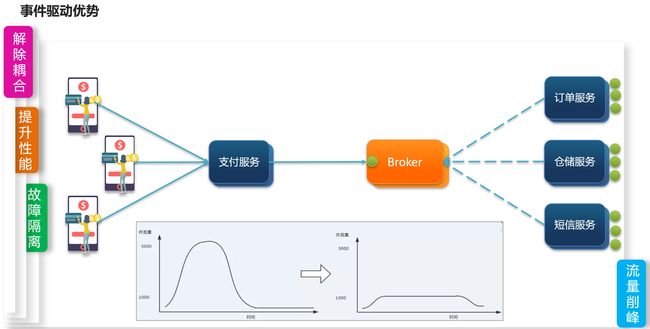

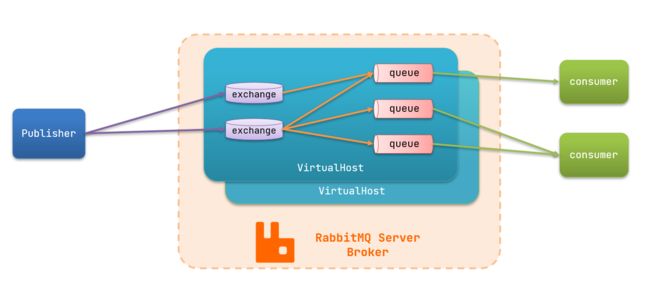

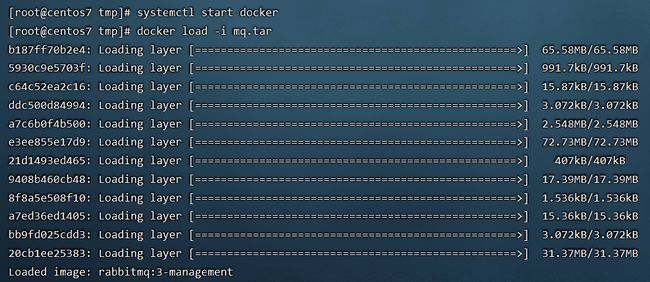

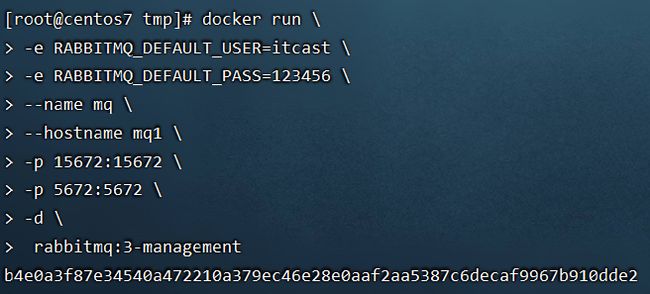

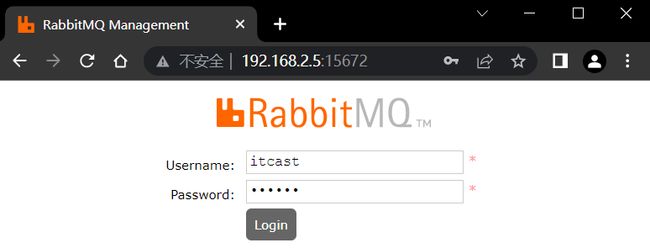

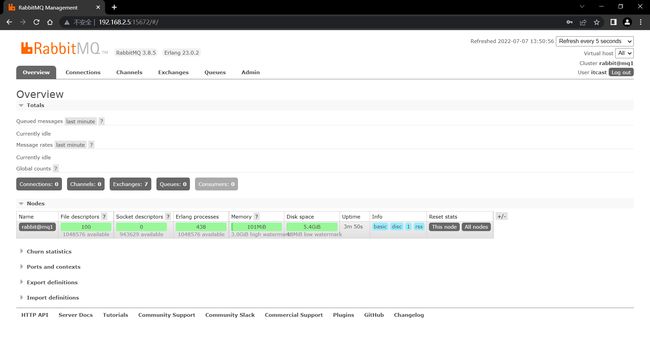

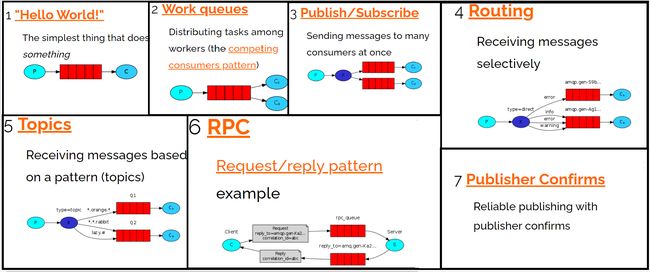

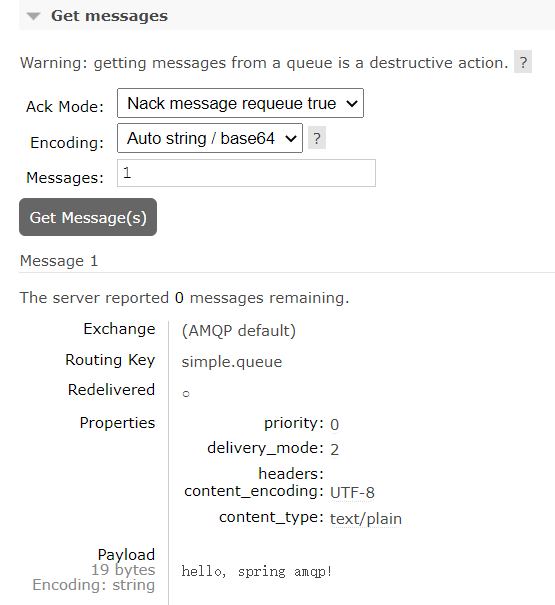

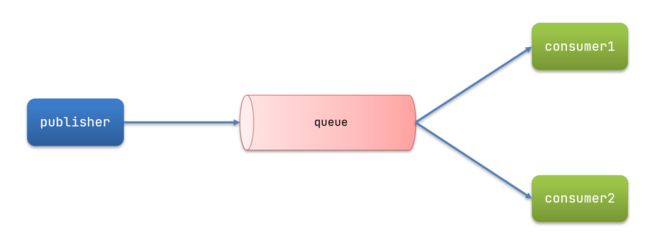

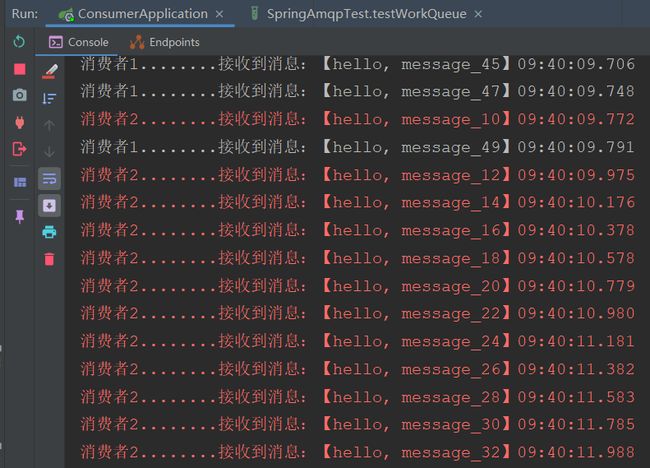

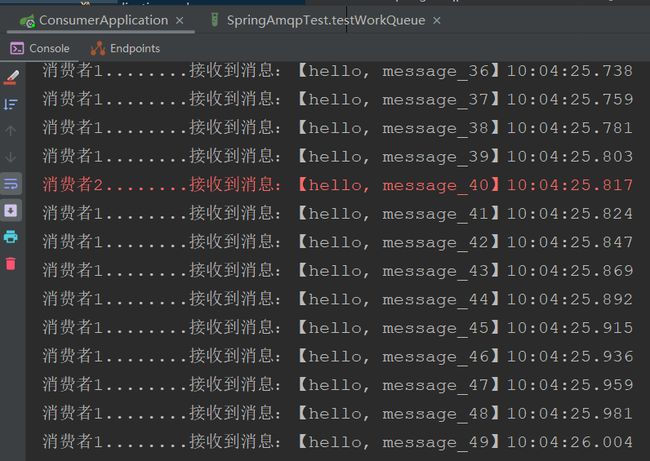

了解 MQ、快速入门 RabbitMQ、了解 SpringAMQP

- SpringCloudDay04

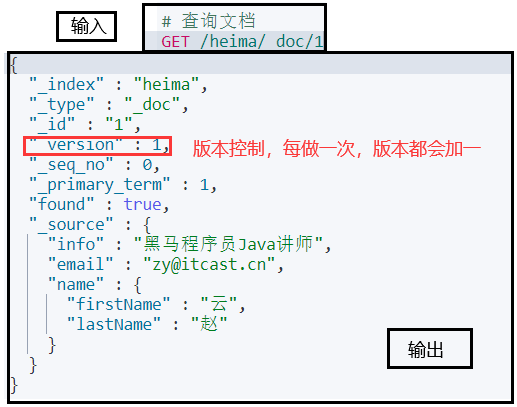

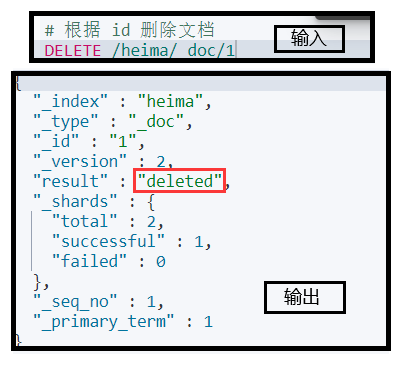

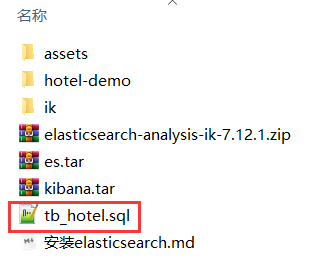

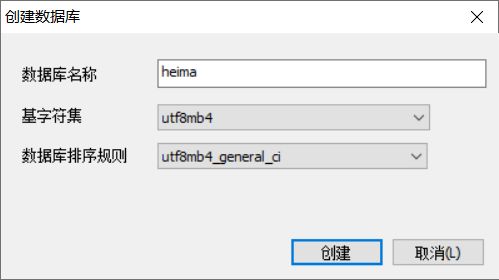

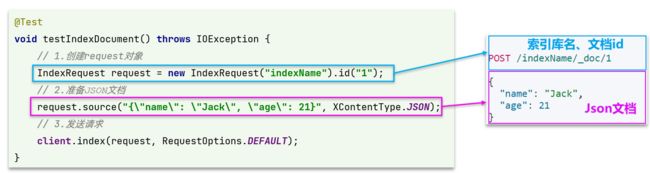

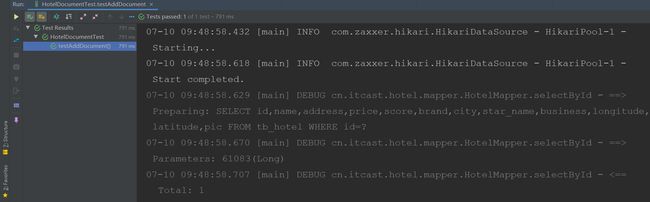

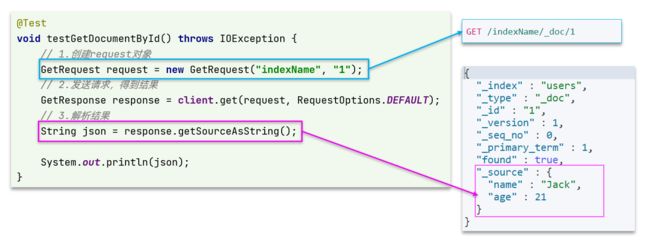

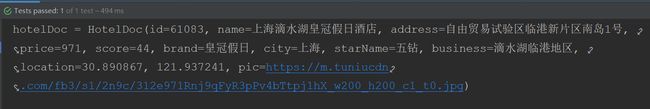

ElasticSearch 基础:索引库操作、文档操作、RestAPI、RestClient 操作文档

- SpringCloudDay05

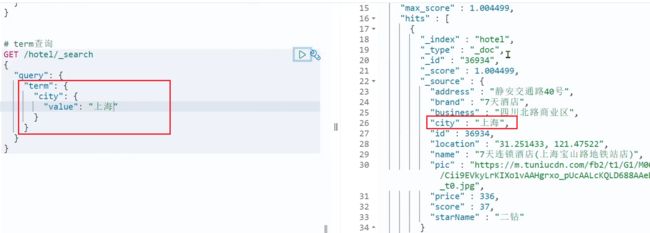

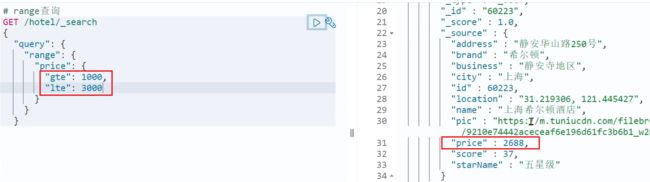

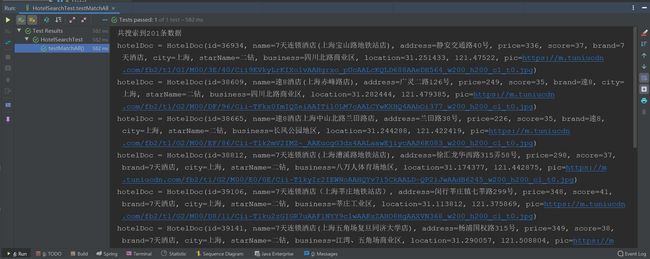

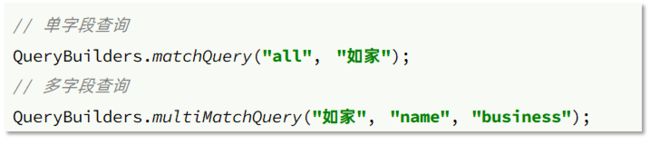

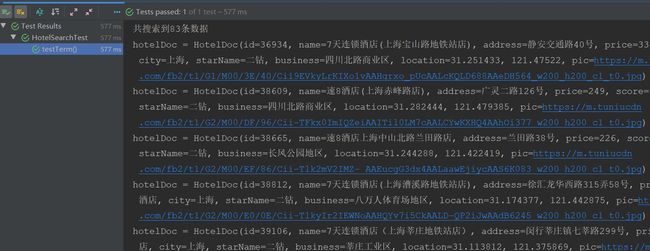

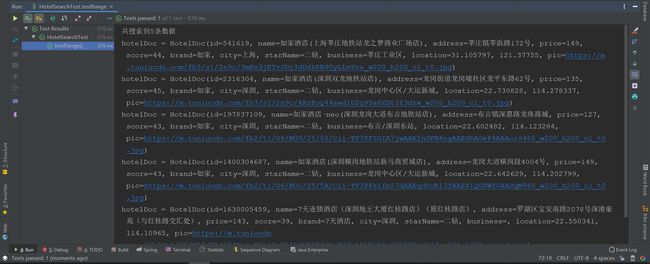

ElasticSearch 搜索功能:DSL 查询文档、搜索结果处理、RestClient 查询文档、黑马旅游案例

- SpringCloudDay06

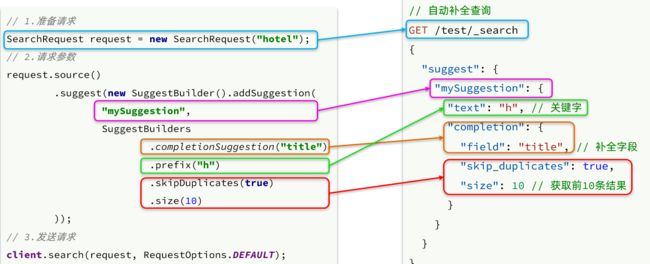

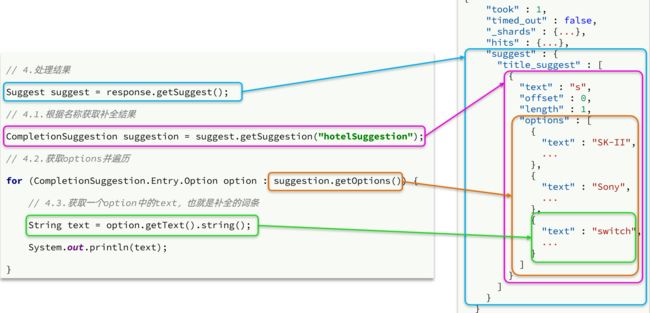

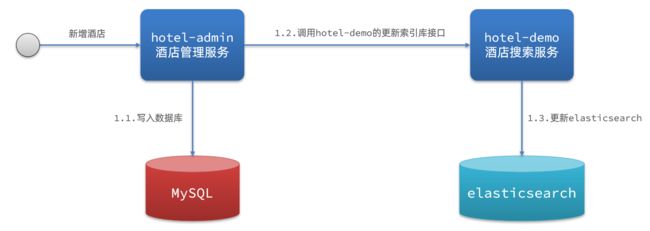

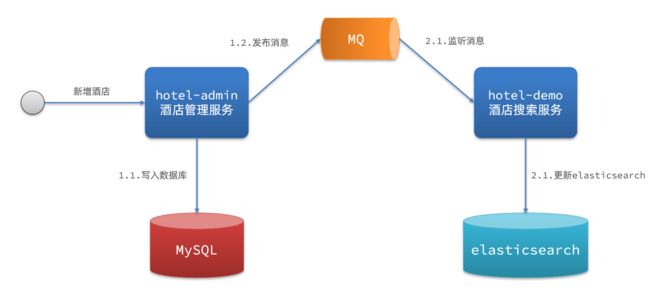

ElasticSearch 深入学习:数据聚合、自动补全、数据补全、集群

- SpringCloudDay07

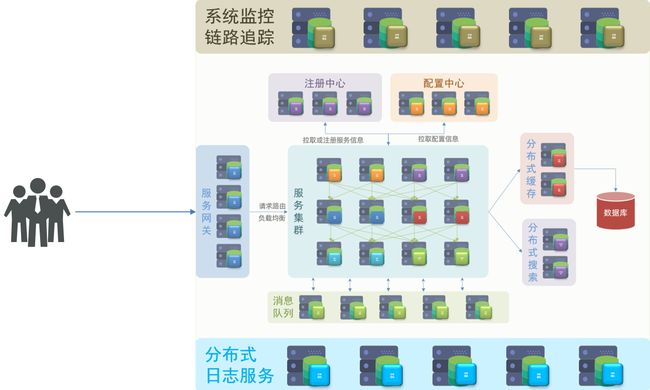

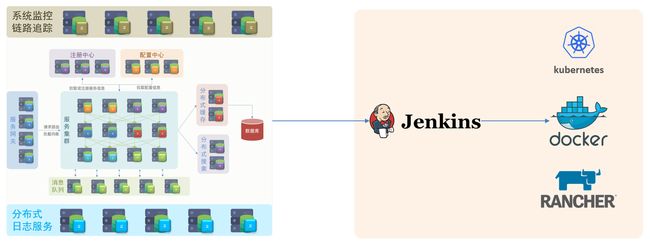

0.微服务技术栈导学

- 以下为视频中的截图

# SpringCloudDay01

SpringCloud 学习 Day01(实用篇-1)

- 认识微服务

- 分布式服务架构案例

- Eureka 注册中心

- Ribbon 负载均衡原理

- Nacos 注册中心

1.认识微服务

随着互联网行业的发展,对服务的要求也越来越高,服务架构也从单体架构逐渐演变为现在流行的微服务架构。

1.1.服务架构演变

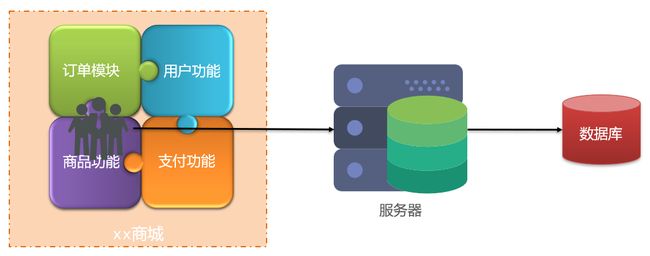

1.1.1.单体架构

单体架构:将业务的所有功能集中在一个项目中开发,打成一个包部署。

- 优点:架构简单、部署成本低

- 缺点:耦合度高(维护困难、升级困难)

1.1.2.分布式架构

分布式架构:根据业务功能对系统做拆分,每个业务功能模块作为独立项目开发,称为一个服务。

- 优点:降低服务耦合、有利于服务升级和拓展

- 缺点:服务调用关系错综复杂

服务治理

分布式架构虽然降低了服务耦合,但是服务拆分时也有很多问题需要思考:

- 服务拆分的粒度如何界定?

- 服务之间如何调用?

- 服务的调用关系如何管理?

人们需要制定一套行之有效的标准来约束分布式架构。

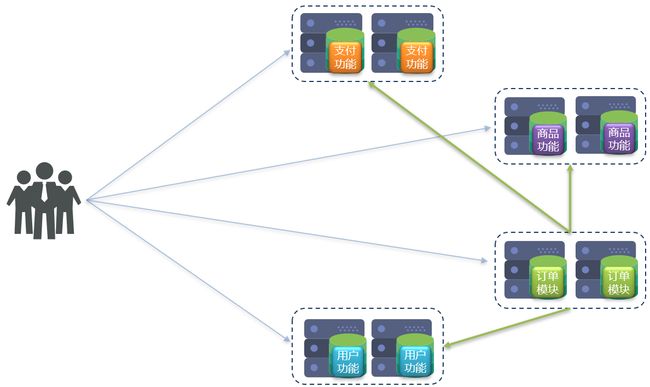

1.1.3.微服务

微服务是一种经过良好架构设计的分布式架构方案。

微服务架构特征

- 单一职责:微服务拆分粒度更小,每一个服务都对应唯一的业务能力,做到单一职责,避免重复业务开发

- 面向服务:微服务对外暴露业务接口

- 自治:团队独立、技术独立、数据独立、部署独立

- 隔离性强:服务调用做好隔离、容错、降级,避免出现级联问题

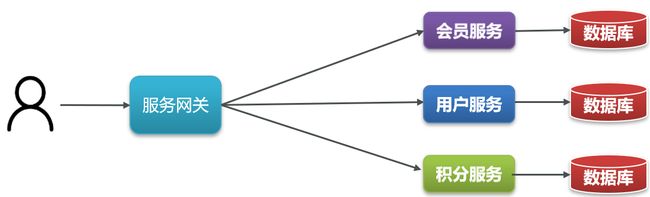

微服务架构图

微服务部署(持续集成)

微服务图解(举例)

微服务的上述特性其实是在给分布式架构制定一个标准,进一步降低服务之间的耦合度,提供服务的独立性和灵活性。

从而做到高内聚,低耦合。

因此,可以认为微服务是一种经过良好架构设计的分布式架构方案 。

但方案该怎么落地?选用什么样的技术栈?全球的互联网公司都在积极尝试自己的微服务落地方案。

其中在 Java 领域最引人注目的就是 SpringCloud 提供的方案了。

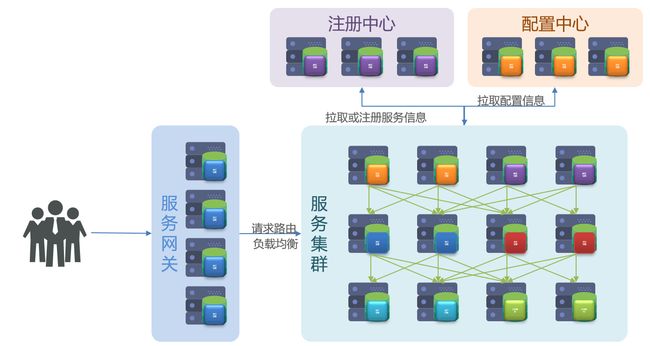

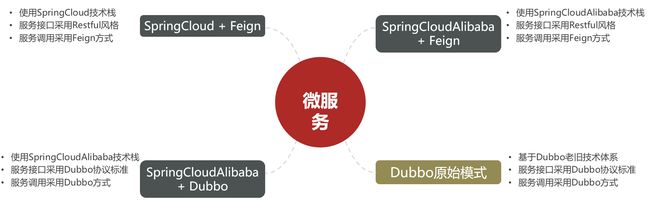

1.2.微服务技术对比

- 微服务结构

微服务这种方案需要技术框架来落地,全球的互联网公司都在积极尝试自己的微服务落地技术。

在国内最知名的就是 SpringCloud 和阿里巴巴的 Dubbo。

- 微服务技术对比

Dubbo |

SpringCloud |

SpringCloudAlibaba |

|

|---|---|---|---|

| 注册中心 | zookeeper、Redis | Eureka、Consul | Nacos、Eureka |

| 服务远程调用 | Dubbo 协议 | Feign(Http 协议) | Dubbo、Feign |

| 配置中心 | 无 | SpringCloudConfig | SpringCloudConfig、Nacos |

| 服务网关 | 无 | SpringCloudGateway、Zuul | SpringCloudGateway、Zuul |

| 服务监控和保护 | dubbo-admin,功能弱 | Hystix | Sentinel |

- 企业需求

1.3.SpringCloud

SpringCloud 是目前国内使用最广泛的微服务框架。

官网地址:https://spring.io/projects/spring-cloud。

SpringCloud 集成了各种微服务功能组件,并基于 SpringBoot 实现了这些组件的自动装配。

SpringCloud 提供了良好的开箱即用体验。

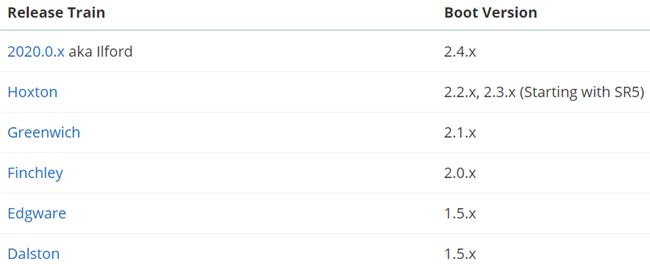

另外,SpringCloud 底层是依赖于 SpringBoot 的,并且有版本的兼容关系。

我们这里学习的版本是 Hoxton.SR10,因此对应的 SpringBoot 版本是 2.3.x 版本。

1.4.总结

- 单体架构:简单方便,高度耦合,扩展性差,适合小型项目。

- 例如:学生管理系统

- 分布式架构:松耦合,扩展性好,但架构复杂,难度大。适合大型互联网项目。

- 例如:京东、淘宝

- 微服务:一种良好的分布式架构方案

- 优点:拆分粒度更小、服务更独立、耦合度更低

- 缺点:架构非常复杂,运维、监控、部署难度提高

- SpringCloud 是微服务架构的一站式解决方案,集成了各种优秀微服务功能组件

2.分布式服务架构案例

2.1.服务拆分原则

- 不同微服务,不要重复开发相同业务

- 微服务数据独立,不要访问其它微服务的数据库

- 微服务可以将自己的业务暴露为接口,供其它微服务调用

2.2.服务拆分示例

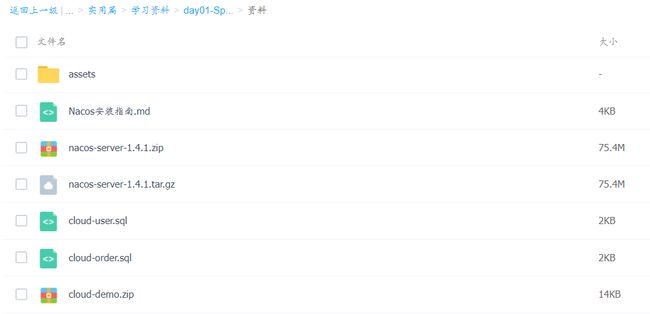

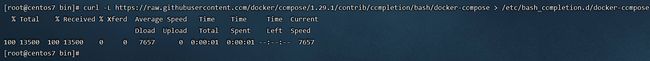

课前资料

2022 最新版 Java 学习 路线图>第 4 阶段_中间键&服务框架>1.微服务开发框架 SpringCloud + RabbitMQ + Docker + Redis + 搜索 + 分布式 史上最全面的微服务全技术栈课程>实用篇>学习资料>day01-SpringCloud01(提取码:dor4)

2.2.1.案例 Demo

导入服务拆分 Demo

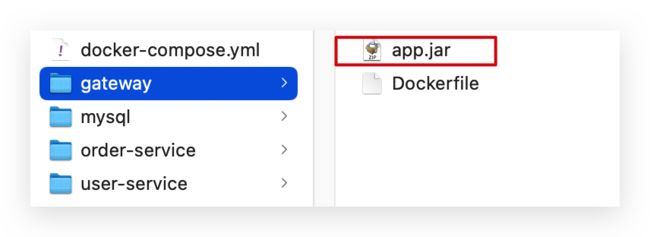

- 导入课前资料提供的工程:cloud-demo

- 项目结构

![]()

- 首先,将课前资料提供的

cloud-order.sql和cloud-user.sql导入到 MySQL 中。

该项目导入的部分依赖以及所继承的工程

这里只是提一下,项目里有完整的文件。这里没打算赘述

<parent>

<groupId>org.springframework.bootgroupId>

<artifactId>spring-boot-starter-parentartifactId>

<version>2.3.9.RELEASEversion>

<relativePath/>

parent>

<dependency>

<groupId>org.springframework.cloudgroupId>

<artifactId>spring-cloud-dependenciesartifactId>

<version>Hoxton.SR10version>

<type>pomtype>

<scope>importscope>

dependency>

<dependency>

<groupId>com.alibaba.cloudgroupId>

<artifactId>spring-cloud-alibaba-dependenciesartifactId>

<version>2.2.5.RELEASEversion>

<type>pomtype>

<scope>importscope>

dependency>

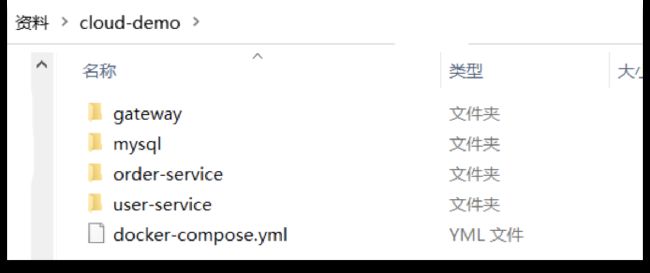

数据库 & 数据表说明

其中 cloud_order 和 cloud_user 数据库的字符集为 utf8、排序规则是 utf8_general_ci。

数据库 cloud-order 中仅有一张表:tb_order

数据库 cloud_user 中仅有一张表:tb_user

其中 tb_order.user_id = tb_user.id。

不过因为是跨库的俩表,所以无法作关联查询。

相关的项目结构 和 Idea 的窗口

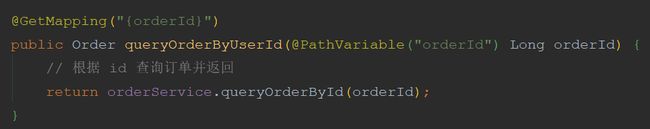

在 order-service 服务中,有一个根据 id 查询订单的接口

order-service 模块中的 src/main/java/cn/itcast/order/web/OrderController.java

@RestController

@RequestMapping("order")

public class OrderController {

@Autowired

private OrderService orderService;

@GetMapping("{orderId}")

public Order queryOrderByUserId(@PathVariable("orderId") Long orderId) {

// 根据id查询订单并返回

return orderService.queryOrderById(orderId);

}

}

在 user-service 中有一个根据 id 查询用户的接口

user-service 模块中的 src/main/java/cn/itcast/user/web/UserController.java

@Slf4j

@RestController

@RequestMapping("/user")

public class UserController {

@Autowired

private UserService userService;

/**

* 路径: /user/110

*

* @param id 用户id

* @return 用户

*/

@GetMapping("/{id}")

public User queryById(@PathVariable("id") Long id) {

return userService.queryById(id);

}

}

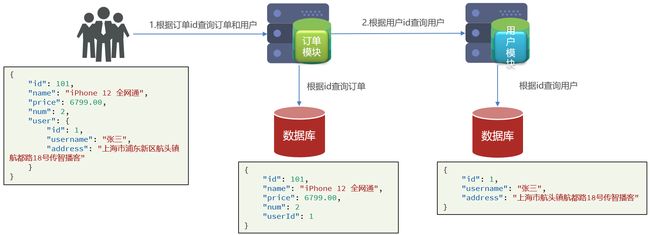

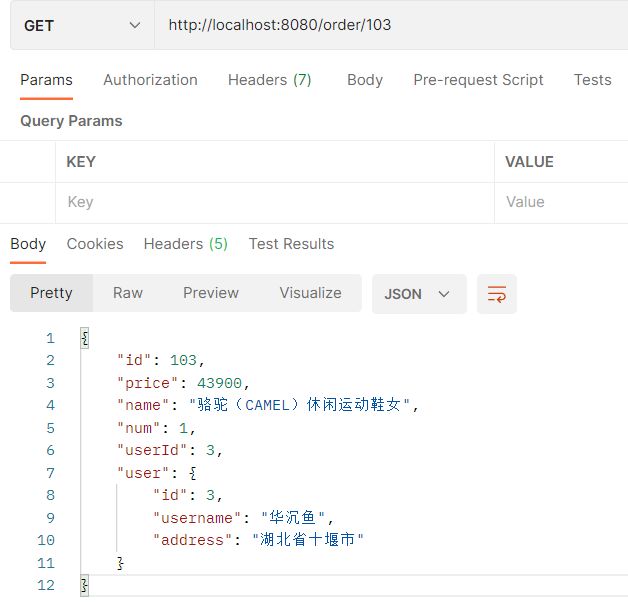

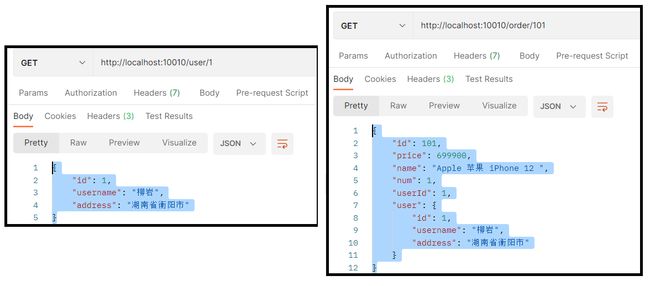

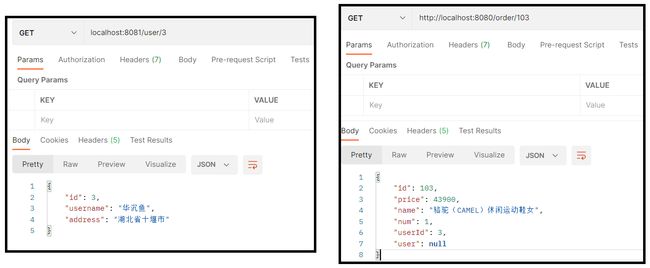

查询结果

这里使用的接口测试工具是 Postman

根据 id 查询用户,返回值是 User 对象。

根据 id 查询订单,返回值是 Order 对象,其中的 user 为 null。

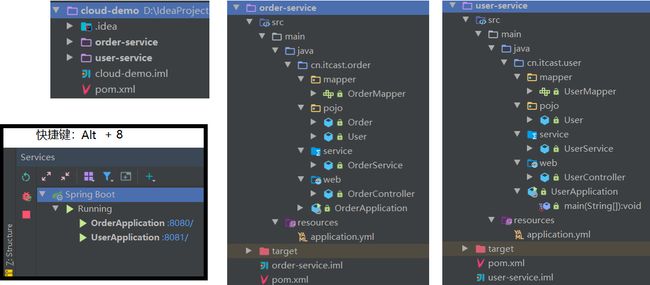

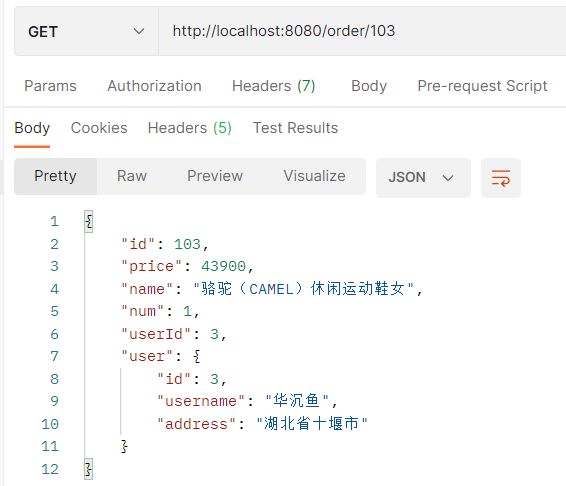

2.2.2.实现远程调用案例

案例需求:根据订单 id 查询订单的同时,把订单所属的用户信息一起返回。

远程调用方式分析

因此,我们需要在 order-service中 向 user-service 发起一个 http 的请求,调用 http://localhost:8081/user/{userId} 这个接口。

大致步骤

- 注册一个 RestTemplate 的实例到 Spring 容器

- 修改 order-service 服务中的 OrderService 类中的 queryOrderById 方法

- 根据 Order 对象中的 userId 查询 User

- 将查询的 User 填充到 Order 对象,一起返回

- 注册 RestTemplate

在 order-service 服务的 OrderApplication 启动类中,注册 RestTemplate 实例

order-service 模块中的 src/main/java/cn/itcast/order/OrderApplication.java

@MapperScan("cn.itcast.order.mapper")

@SpringBootApplication

public class OrderApplication {

public static void main(String[] args) {

SpringApplication.run(OrderApplication.class, args);

}

/* ************************************* */

/**

* 创建 RestTemplate 并注入 Spring 容器

*

* @return

*/

@Bean

public RestTemplate restTemplate() {

return new RestTemplate();

}

/* ************************************* */

}

- 修改 order-service 服务中的的 OrderService 类中的 queryOrderById 方法

order-service 模块中的 cn/itcast/order/service/OrderService.java

@Service

public class OrderService {

@Autowired

private OrderMapper orderMapper;

/* ******************************* */

@Autowired

private RestTemplate restTemplate;

/* ******************************* */

public Order queryOrderById(Long orderId) {

// 1.查询订单

Order order = orderMapper.findById(orderId);

/* ***************************************************************** */

//2. 利用 RestTemplate 发起 HTTP 请求,查询用户

//2.1.url 路径

String url = "http://localhost:8081/user/" + order.getUserId();

//2.2.发送 http 请求,实现远程调用

User user = restTemplate.getForObject(url, User.class);

//3.封装 user 至 order

order.setUser(user);

/* ***************************************************************** */

// 4.返回

return order;

}

}

程序运行结果展示

2.3.总结

微服务拆分

- 微服务需要根据业务模块拆分,做到单一职责,不要重复开发相同的业务。

- 微服务可以将业务暴露为接口,供其他服务使用。

- 不同微服务都应该有自己独立的数据库。

微服务调用方式

- 基于 RestTemplate 发起的 http 请求实现远程调用

- http 请求做远程调用是与语言无关的调用,只要知道对方的 ip、端口、接口路径、请求参数即可。

3.eureka 注册中心

3.1.提供者与消费者

在服务调用关系中,会有两个不同的角色:服务提供者、服务消费者。

服务提供者:一次业务中,被其它微服务调用的服务。(提供接口给其它微服务)

服务消费者:一次业务中,调用其它微服务的服务。(调用其它微服务提供的接口)

但是,服务提供者与服务消费者的角色并不是绝对的,而是相对于业务而言。

如果服务 A 调用了服务 B,而服务 B 又调用了服务 C,服务 B 的角色是什么?

- 对于 A 调用 B 的业务而言:A 是服务消费者,B 是服务提供者

- 对于 B 调用 C 的业务而言:B 是服务消费者,C 是服务提供者

因此,服务 B 既可以是服务提供者,也可以是服务消费者。

小结

- 服务提供者:暴露接口给其他微服务调用

- 服务消费者:调用其他微服务提供的接口

- 提供者与消费者角色其实是相对的

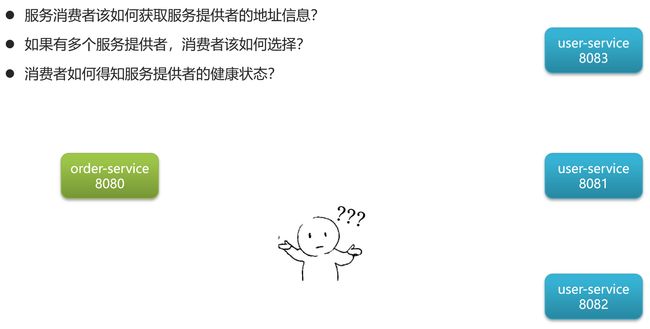

3.2.远程调用出现的问题

假如我们的服务提供者 user-service 部署了多个实例。

- order-service 在发起远程调用的时候,该如何得知 user-service 实例的 ip 地址和端口?

- 有多个 user-service 实例地址,order-service 调用时该如何选择?

- order-service 如何得知某个 user-service 实例是否依然健康,是不是已经宕机?

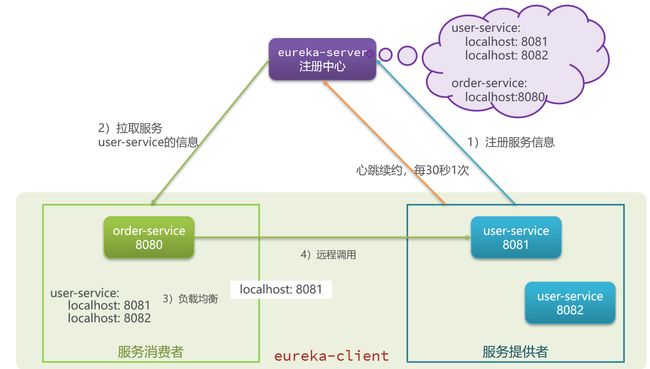

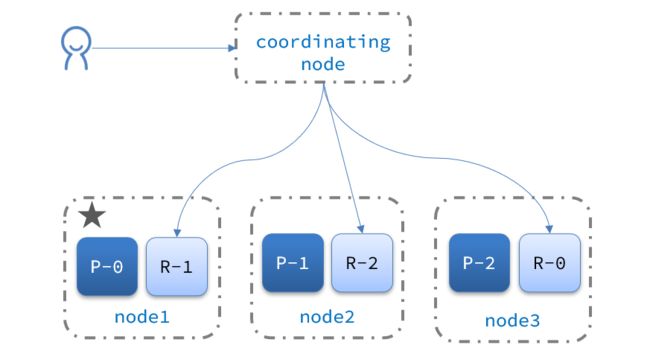

3.3.Eureka 的作用

以上的这些问题都需要利用 SpringCloud 中的注册中心来解决。

其中最广为人知的注册中心就是 Eureka。

- 注意

- 一个微服务,既可以是服务提供者,又可以是服务消费者。

- 因此 eureka 将服务注册、服务发现等功能统一封装到了 eureka-client 端

在 Eureka 架构中,微服务角色有两类:服务端和客户端。

- EurekaServer:服务端,注册中心

- 记录服务信息

- 心跳监控

- EurekaClient:客户端

- Provider:服务提供者。例如案例中的 user-service

- 注册自己的信息到 EurekaServer

- 每隔 30 秒向 EurekaServer 发送心跳

- consumer:服务消费者。例如案例中的 order-service

- 根据服务名称从 EurekaServer 拉取服务列表

- 基于服务列表做负载均衡,选中一个微服务后发起远程调用

- Provider:服务提供者。例如案例中的 user-service

消费者该如何获取服务提供者具体信息?

- 服务提供者启动时向 eureka 注册自己的信息

- eureka 保存这些信息

- 消费者根据服务名称向 eureka 拉取提供者信息

如果有多个服务提供者,消费者该如何选择?

- 服务消费者利用负载均衡算法,从服务列表中挑选一个

消费者如何感知服务提供者健康状态?

- 服务提供者会每隔 30 秒向 EurekaServer 发送心跳请求,报告健康状态

- eureka 会更新记录服务列表信息,心跳不正常会被剔除

- 消费者就可以拉取到最新的信息

现在回答之前的各个问题

问题 1:order-service 如何得知 user-service 实例地址?

- user-service 服务实例启动后,将自己的信息注册到 eureka-server(Eureka 服务端)。即服务注册

- eureka-server 保存服务名称到服务实例地址列表的映射关系

- order-service 根据服务名称,拉取实例地址列表。这个叫服务发现或服务拉取。

问题 2:order-service 如何从多个 user-service 实例中选择具体的实例?

- order-service 从实例列表中利用负载均衡算法选中一个实例地址

- 向该实例地址发起远程调用

问题 3:order-service 如何得知某个 user-service 实例是否依然健康,是不是已经宕机?

- user-service 会每隔一段时间(默认 30 秒)向 eureka-server 发起请求,报告自己状态,称为心跳

- 当超过一定时间没有发送心跳时,eureka-server 会认为微服务实例故障,将该实例从服务列表中剔除

- order-service 拉取服务时,就能将故障实例排除了

- 接下来,就需要我们来动手实践了。

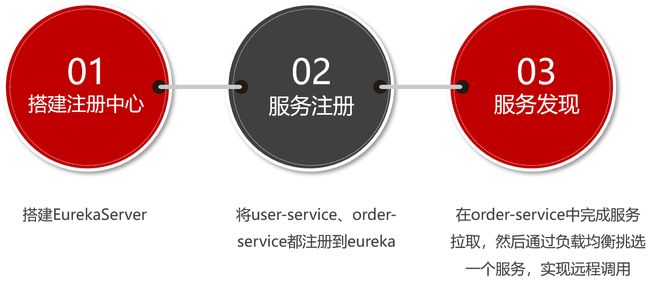

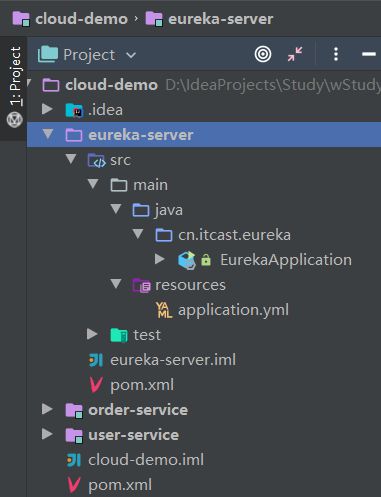

3.4.搭建 eureka-server

首先大家注册中心服务端:eureka-server,这必须是一个独立的微服务。

- 在 cloud-demo 父工程下,创建一个子模块 eureka-server

- 引入 spring-cloud-starter-netflix-eureka-server 的依赖

- 编写启动类,添加 @EnableEurekaServer 注解

- 添加配置文件:application.yml

- 启动服务

- 在 cloud-demo 父工程下,创建一个子模块 eureka-server

- 引入 spring-cloud-starter-netflix-eureka-server 的依赖

总模块 cloud-demo 中的 pom.xml

<properties>

<project.build.sourceEncoding>UTF-8project.build.sourceEncoding>

<project.reporting.outputEncoding>UTF-8project.reporting.outputEncoding>

<java.version>1.8java.version>

<spring-cloud.version>Hoxton.SR10spring-cloud.version>

<mysql.version>8.0.17mysql.version>

<mybatis.version>2.1.1mybatis.version>

properties>

eureka-server 模块中的 pom.xml

<dependencies>

<dependency>

<groupId>org.springframework.cloudgroupId>

<artifactId>spring-cloud-starter-netflix-eureka-serverartifactId>

dependency>

dependencies>

- 编写启动类,添加

@EnableEurekaServer注解

eureka-server 模块中的 src/main/java/cn/itcast/eureka/EurekaApplication.java

@EnableEurekaServer

@SpringBootApplication

public class EurekaApplication {

public static void main(String[] args) {

SpringApplication.run(EurekaApplication.class);

}

}

- 添加配置文件:

application.yml

eureka-server 模块中的 src/main/resources/application.yml

server:

port: 10086 # 服务端口

spring:

application:

name: eurekaserver # eureka 的服务名称

eureka:

client:

service-url: # eureka 的地址信息

defaultZone: http://127.0.0.1:10086/eureka

- 启动服务

在浏览器访问:http://127.0.0.1:10086

3.5.服务注册

- 引入 eureka-client 依赖

- 在 application.yml 下配置 eureka 地址

- 启动多个实例

- 引入 eureka-client 依赖

在 user-service 和 order-service 的俩模块下的 pom.xml 都导入如下的依赖。

<dependency>

<groupId>org.springframework.cloudgroupId>

<artifactId>spring-cloud-netflix-eureka-clientartifactId>

dependency>

<dependency>

<groupId>org.springframework.cloudgroupId>

<artifactId>spring-cloud-starter-netflix-eureka-clientartifactId>

dependency>

- 在 application.yml 下配置 eureka 地址

根据情况来编写 user-service 和 order-service 的俩模块下的 /resources/application.yml 的信息。

server:

port: 8080 # order-service 模块

# port: 8081 # user-service 模块

spring:

datasource:

# url: jdbc:mysql://localhost:3306/cloud_order?useSSL=false # MySQL5

url: jdbc:mysql://localhost:3306/cloud_order?serverTimezone=Asia/Shanghai&useUnicode=true&characterEncoding=utf-8&zeroDateTimeBehavior=convertToNull&useSSL=false&allowPublicKeyRetrieval=true # MySQL8

username: root

password: root

# driver-class-name: com.mysql.jdbc.Driver # MySQL5

driver-class-name: com.mysql.cj.jdbc.Driver # MySQL8

#####################################################

application:

# eureka 的服务名称

name: order-service # order-service 模块

# name: user-service # user-service 模块

#####################################################

mybatis:

type-aliases-package: cn.itcast.user.pojo

configuration:

map-underscore-to-camel-case: true

logging:

level:

cn.itcast: debug

pattern:

dateformat: MM-dd HH:mm:ss:SSS

#####################################################

eureka:

client:

service-url: # eureka 的地址信息

defaultZone: http://127.0.0.1:10086/eureka

#####################################################

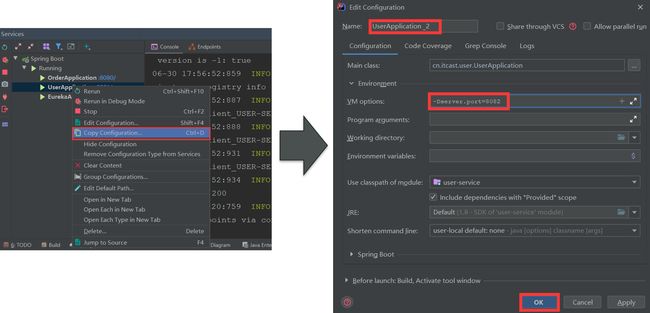

- 启动多个实例

为了演示一个服务有多个实例的场景,我们添加一个 SpringBoot 的启动配置,再启动一个 user-service。

配置成功后运行项目。

运行时 SpringBoot 窗口会出现两个 user-service 的启动配置。

eureka-server 管理页面的用例表也会显示相关信息。

显然,无论是消费者还是提供者,引入 eureka-client 依赖、知道 eureka 地址后,都可以完成注册服务。

3.6.服务发现

服务拉取是基于服务名称获取服务列表,然后对服务列表做负载均衡

下面,我们将对 order-service 进行逻辑修改。

向 eureka-server 拉取 user-service 的信息,实现服务发现(服务拉取)。

即 order-service 要去 eureka-server 中拉取 user-service 服务的实例列表,并且实现负载均衡。

不过这些动作不用我们去做,只需要添加一些注解即可。

- 修改 OrderService 的 queryOrderById 方法,修改访问的 url 路径,用服务名代替 ip、端口。

order-service 模块:src/main/java/cn/itcast/order/service/OrderService.java

//2.1.url 路径

//String url = "http://localhost:8081/user/" + order.getUserId();

String url = "http://user-service/user/" + order.getUserId();

- 在 order-service 项目的启动类 OrderApplication 中的 RestTemplate 添加负载均衡注解。

给 RestTemplate 这个 Bean 添加一个 @LoadBalanced 注解

order-service 模块:src/main/java/cn/itcast/order/OrderApplication.java

@Bean

@LoadBalanced //负载均衡注解

public RestTemplate restTemplate() {

return new RestTemplate();

}

之后 spring 会自动帮助我们从 eureka-server 端,根据 user-service 这个服务名称,获取实例列表,而后完成负载均衡。

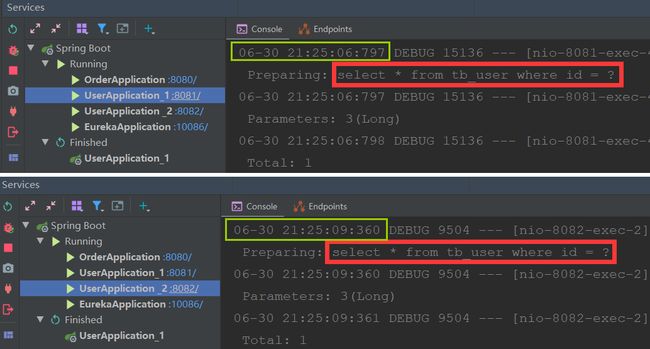

- 结果展示

发起多次请求:localhost:8080/order/103

此时 idea 的控制台界面

显然,俩端口均有响应。

3.7.总结

1.搭建 EurekaServer

- 引入 eureka-server 依赖

- 添加 @EnableEurekaServer 注解

- 在 application.yml 中配置 eureka 地址

2.服务注册

- 引入 eureka-client 依赖

- 在 application.yml 中配置 eureka 地址

3.服务发现

- 引入 eureka-client 依赖

- 在 application.yml 中配置 eureka 地址

- 给 RestTemplate 添加 @LoadBalanced 注解

- 用服务提供者的服务名称远程调用

4.Ribbon 负载均衡

4.1.负载均衡原理

4.1.1.提问

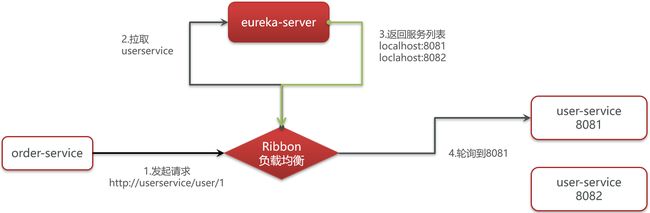

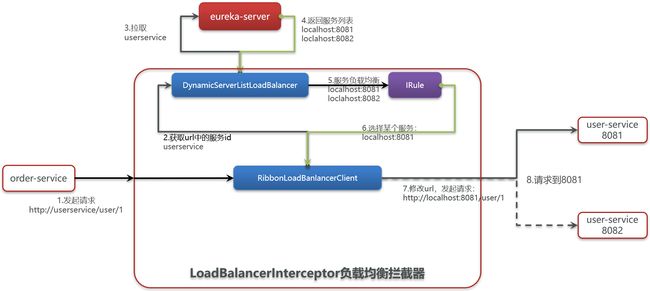

上一节中,我们添加了 @LoadBalanced 注解,即可实现负载均衡功能,这是什么原理呢?

此处我们发出的请求明明是 http://userservice/user/1,最终是怎么变成 http://localhost:8081 的呢?

4.1.2.源码探究

为什么我们只输入了 service 名称就可以访问了呢?之前还要获取 ip 和端口。

显然有人帮我们根据 service 名称,获取到了服务实例的 ip 和端口。

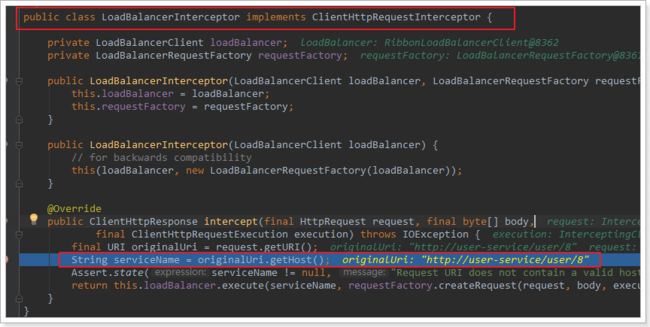

它就是LoadBalancerInterceptor,这个类会在对 RestTemplate 的请求进行拦截。

然后从 Eureka 中获取服务列表(根据服务 id),随后利用负载均衡算法得到真实的服务地址信息,替换服务 id。

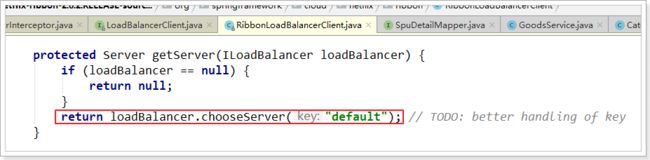

- LoadBalancerIntercepor

可以看到这里的 intercept 方法,拦截了用户的 HttpRequest 请求,然后做了几件事:

request.getURI():获取请求 uri,本例中就是http://user-service/user/8originalUri.getHost():获取 uri 路径的主机名,其实就是服务 id,user-servicethis.loadBalancer.execute():处理服务 id,和用户请求。

这里的 this.loadBalancer 是 LoadBalancerClient 类型,我们继续跟入。

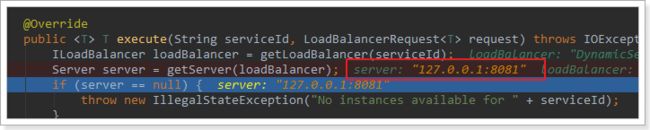

- LoadBalancerClient

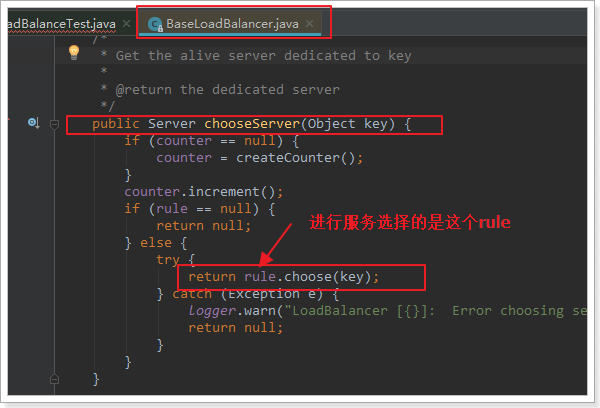

继续跟入 LoadBalancerIntercepor 中的 execute 方法,来到 LoadBalancerClient

代码是这样的:

- getLoadBalancer(serviceId):根据服务 id 获取 ILoadBalancer,而 ILoadBalancer 会拿着服务 id 去 eureka 中获取服务列表并保存起来。

- getServer(loadBalancer):利用内置的负载均衡算法,从服务列表中选择一个。本例中,可以看到获取了 8082 端口的服务

放行后,再次访问并跟踪,发现获取的是 8081

显然实现了负载均衡。

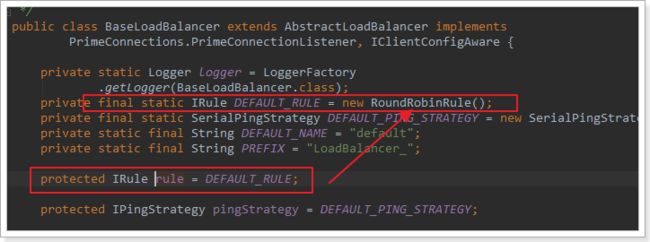

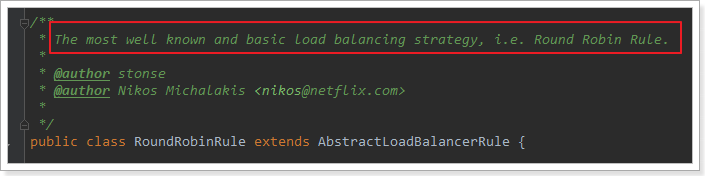

- 负载均衡策略 IRule

在刚才的代码中,可以看到获取服务是通过一个 getServer 方法来做负载均衡

继续跟踪源码 chooseServer 方法,发现这么一段代码

我们看看这个 rule 是谁

这里的 rule 默认值是一个 RoundRobinRule,根据类的介绍可知其为轮询。

到这里,整个负载均衡的流程我们就清楚了。

4.1.3.小结

SpringCloudRibbon 的底层采用了一个拦截器,拦截了 RestTemplate 发出的请求,对地址做了修改。

基本流程如下:

- 拦截 RestTemplate 请求

http://user-service/user/1 - RibbonLoadBalancerClient 会从请求 url 中获取服务名称,也就是 user-service

- DynamicServerListLoadBalancer 根据 user-service 到 eureka 拉取服务列表

- eureka 返回列表,

localhost:8081、localhost:8082 - IRule 利用内置负载均衡规则,从列表中选择一个,例如

localhost:8081 - RibbonLoadBalancerClient 修改请求地址,用

localhost:8081替代 userservice,得到http://localhost:8081/user/1,发起真实请求

4.2.负载均衡策略

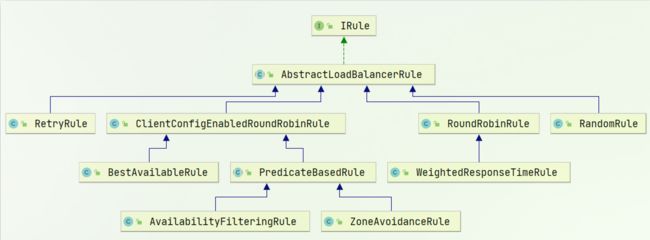

负载均衡的规则都定义在 IRule 接口中,而 IRule 有很多不同的实现类。

每一个子接口都是一种规则。

常见规则

| 内置负载均衡规则类 | 规则描述 |

|---|---|

RoundRobinRule |

简单轮询服务列表来选择服务器。它是 Ribbon 默认的负载均衡规则。 |

AvailabilityFilteringRule |

对以下两种服务器进行忽略 (1)在默认情况下,这台服务器如果 3 次连接失败,这台服务器就会被设置为 “短路” 状态。 短路状态将持续 30 秒,如果再次连接失败,短路的持续时间就会几何级地增加。 (2)并发数过高的服务器。 如果一个服务器的并发连接数过高,配置了 AvailabilityFilteringRule 规则的客户端也会将其忽略。 并发连接数的上限,可以由客户端的属性进行配置。 该属性为 |

WeightedResponseTimeRule |

为每一个服务器赋予一个权重值。 服务器响应时间越长,这个服务器的权重就越小。 这个规则会随机选择服务器,这个权重值会影响服务器的选择。 |

ZoneAvoidanceRule |

以区域可用的服务器为基础进行服务器的选择。 使用 Zone 对服务器进行分类,这个 Zone 可以理解为一个机房、一个机架等。 而后再对 Zone 内的多个服务做轮询。 |

BestAvailableRule |

忽略那些短路的服务器,并选择并发数较低的服务器。 |

RandomRule |

随机选择一个可用的服务器。 |

RetryRule |

重试机制的选择逻辑。 |

默认的实现就是 ZoneAvoidanceRule,是一种轮询方案。

4.3.自定义负载均衡策略

通过定义 IRule 实现可以修改负载均衡规则,有两种方式:代码的方式和配置文件的方式。

- 代码方式:在 order-service 中的 OrderApplication 类中,定义一个新的 IRule。

这种方案是作用于全局的。

也就是说,在 order-service 中调用任何服务时,都采用相同的负载均衡策略。

order-service 模块中的 src/main/java/cn/itcast/order/OrderApplication.java

/**

* 自定义负载均衡规则:此处设置为随机

*

* @return

*/

@Bean

public IRule randomRule() {

return new RandomRule();

}

- 配置文件方式:在 order-service 的 application.yml 文件中,添加新的配置也可以修改规则。

order-service 模块中的 src/main/resources/application.yml

user-service: # 给某个微服务配置负载均衡规则

ribbon:

NFLoadBalancerRuleClassName: com.netflix.loadbalancer.RandomRule # 负载均衡规则:此处设置为随机

- 注意:一般使用默认的负载均衡规则,不做修改。

4.4.饥饿加载

Ribbon 默认是采用懒加载,即第一次访问时才会去创建 LoadBalanceClient,请求时间会很长。

而饥饿加载则会在项目启动时创建,降低第一次访问的耗时,通过配置开启饥饿加载。

比如我们可以在 order-service 模块内的 src/main/resources/application.yml 中配置加载信息。

ribbon:

eager-load:

enabled: true # 开启饥饿加载

clients: user-service # 指定对 user-service 这个服务饥饿加载

ribbon:

eager-load:

enabled: true # 开启饥饿加载

clients: # 指定饥饿加载的多个服务的名称

- user-service

- xxx-service

4.5.总结

1.Ribbon负载均衡规则

- 规则接口是 IRule

- 默认实现是 ZoneAvoidanceRule。根据 zone 选择服务列表,然后轮询

2.负载均衡自定义方式

- 代码方式:配置灵活,但修改时需要重新打包发布

- 配置方式:直观,方便,无需重新打包发布,但是无法做全局配置

3.饥饿加载

- 通过配置文件开启饥饿加载

- 通过配置文件指定饥饿加载的微服务名称

5.Nacos 注册中心

国内公司一般都推崇阿里巴巴的技术。

比如注册中心,SpringCloudAlibaba 也推出了一个名为 Nacos 的注册中心。

5.1.认识 Nacos

Nacos 是阿里巴巴的产品,现在是 SpringCloud 中的一个组件。

相比 Eureka 功能更加丰富,在国内受欢迎程度较高。

![]()

5.2.Windows 安装启动 Nacos

Windows 安装

- 下载安装包

- 解压

- 端口配置

- 启动

- 访问

- 小结

- 下载安装包

开发阶段采用单机安装即可。

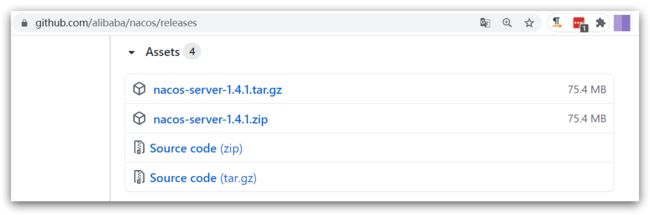

在 Nacos 的 GitHub 页面,提供有下载链接,可以下载编译好的 Nacos 服务端或者源代码

GitHub 主页:https://github.com/alibaba/nacos

GitHub 的 Release 下载页:https://github.com/alibaba/nacos/releases

本课程采用 1.4.1.X 版本的 Nacos,课前资料已经准备了安装包。

Windows 版本使用 nacos-server-1.4.1.zip 包即可。

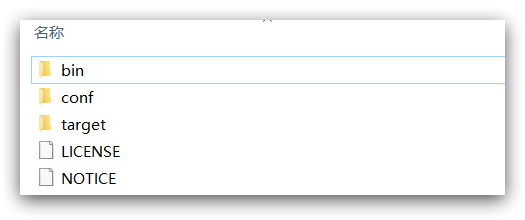

- 解压

将这个包解压到任意非中文目录下

目录说明:bin(启动脚本)、conf(配置文件)。

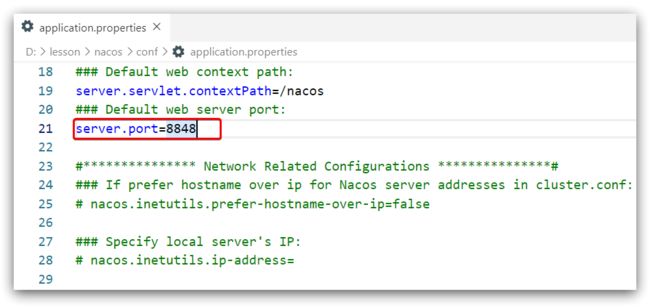

- 端口配置

Nacos 的默认端口是 8848,如果你电脑上的其它进程占用了 8848 端口,请先尝试关闭该进程。

如果无法关闭占用 8848 端口的进程,也可以进入 nacos 的 conf 目录,修改配置文件中的端口。

- 启动

启动非常简单,进入 bin 目录,结构如下

然后执行命令即可(windows 命令)

startup.cmd -m standalone

其中,standalone 意为单机启动模式。

执行后的效果图

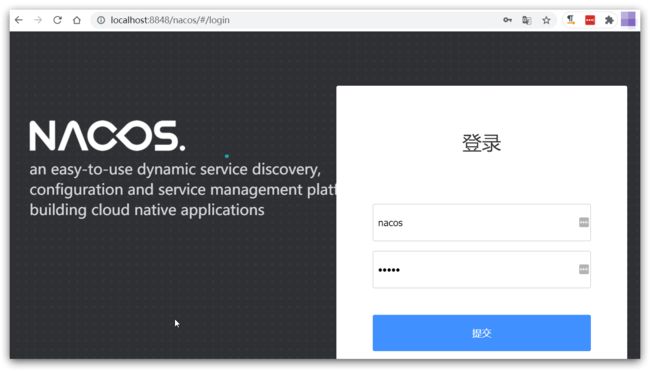

- 访问

在浏览器输入地址:http://127.0.0.1:8848/nacos 即可

默认的用户和密码都是 nacos。

成功登录后,就会进入这样的页面。

- 小结

Nacos服务搭建

- 下载安装包、解压到非中文命名的目录

- 在

bin目录下运行指令:startup.cmd -m standalone

5.3.服务注册到 Nacos

Nacos 是 SpringCloudAlibaba 的组件。

而 SpringCloudAlibaba 也遵循 SpringCloud 中定义的服务注册、服务发现规范。

因此使用 Nacos 和使用 Eureka 对于微服务来说,并没有太大区别。

Nacos 和 Eureka 的主要差异在于:依赖不同、服务地址不同

5.3.1.引入依赖

在 cloud-demo 父工程的 pom 文件中的

<dependency>

<groupId>com.alibaba.cloudgroupId>

<artifactId>spring-cloud-alibaba-dependenciesartifactId>

<version>2.2.6.RELEASEversion>

<type>pomtype>

<scope>importscope>

dependency>

然后在 user-service 和 order-service 中的 pom 文件中引入 nacos-discovery 依赖

同时也需要注释掉 eureka 的依赖。

<dependency>

<groupId>com.alibaba.cloudgroupId>

<artifactId>spring-cloud-starter-alibaba-nacos-discoveryartifactId>

dependency>

5.3.2.配置 Nacos 地址

在 user-service 和 order-service 的 application.yml 中添加 nacos 地址

spring:

cloud:

nacos:

server-addr: localhost:8848

当然,此处也需注释掉 eureka 的地址

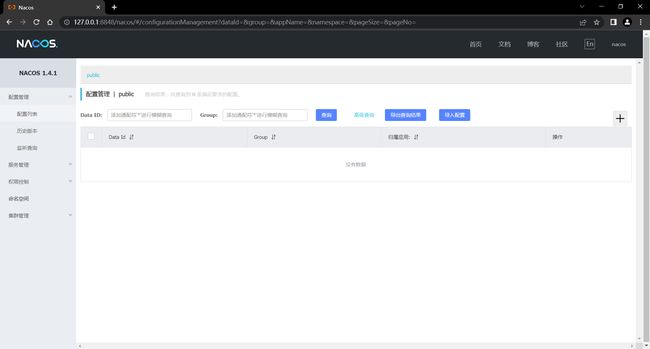

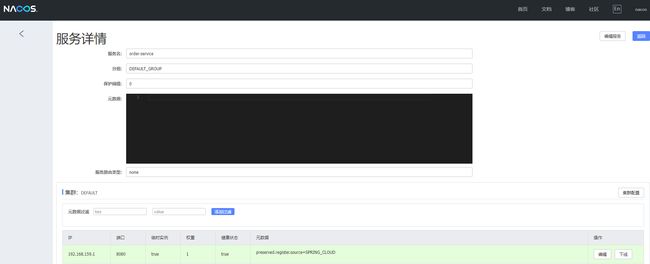

重启微服务后,登录 nacos 管理页面,我们在 “服务管理” 的 “服务列表” 里可以发现微服务信息

在 “详情” 则有着更为详细的数据信息。

5.3.3.小结

Nacos 服务注册或发现

- 引入 nacos.discovery 依赖

- 配置 nacos 地址 spring.cloud.nacos.server-addr

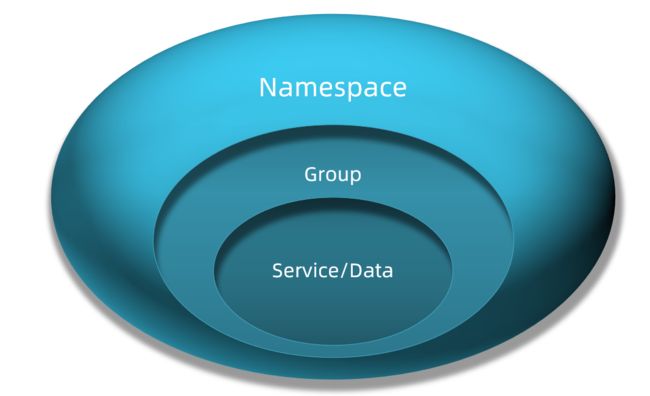

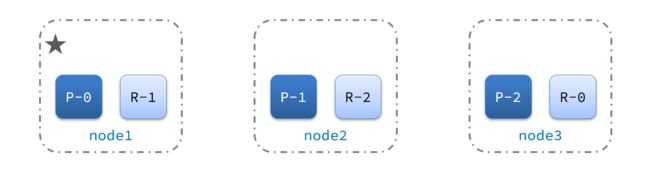

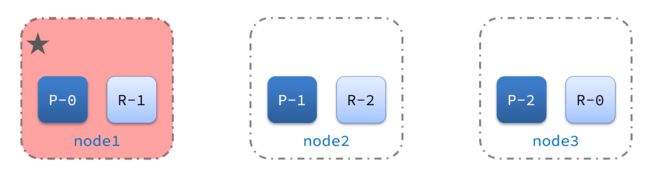

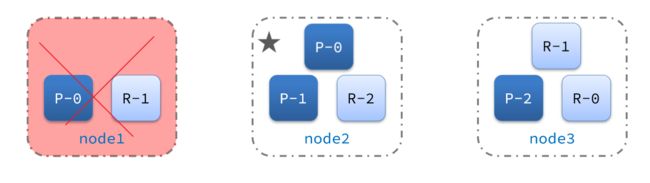

5.4.Nacos 服务多级存储模型

5.4.1.Nacos 概述

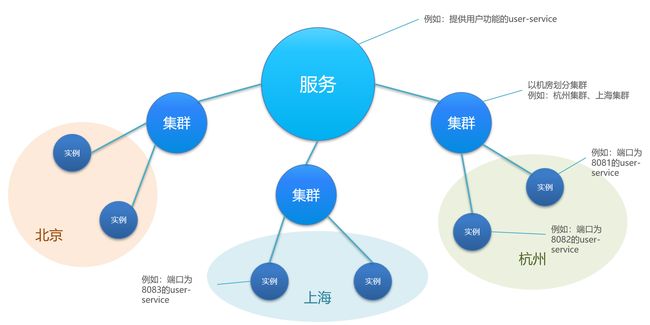

一个服务可以有多个实例。

例如我们的 user-service,可以有:127.0.0.1:8081、127.0.0.1:8082、127.0.0.1:8083

假如这些实例分布于全国各地的不同机房。

例如:127.0.0.1:8081(在上海机房)、127.0.0.1:8082(在上海机房)、127.0.0.1:8083(在杭州机房)

Nacos 就将同一机房内的实例划分为一个集群。

也就是说,user-service 是服务,一个服务可以包含多个集群。

如杭州、上海,每个集群下可以有多个实例,形成分级模型。

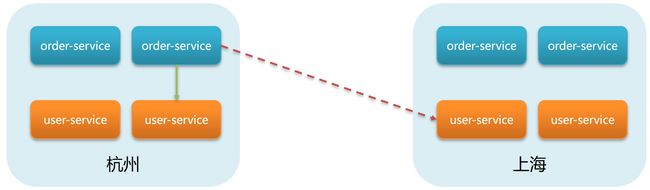

微服务互相访问时,应该尽可能访问同集群实例,因为本地访问速度更快。

当本集群内不可用时,才访问其它集群。

如上图,杭州机房内的 order-service 应该优先访问同机房的 user-service。

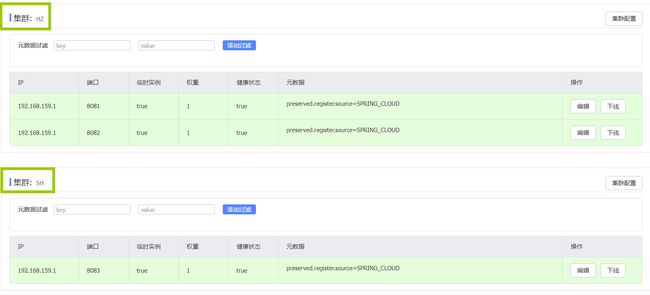

5.4.2.给 user-service 配置集群

修改 user-service 的 application.yml 文件,添加集群配置

spring:

cloud:

nacos:

server-addr: localhost:8848 # nacos 服务地址

discovery:

cluster-name: HZ # 集群名称

# cluster-name: SH # 集群名称

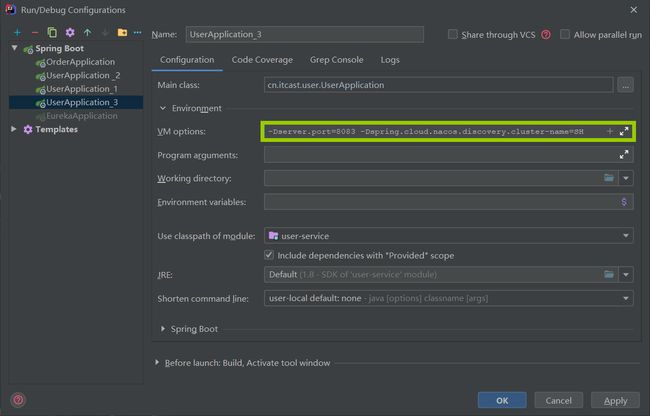

我们可以给 UserApplication_1 服务和 UserApplciation_2 服务设置集群名称为:HZ

给 UserApplication_3 服务设置集群名称为 SH

- 可以在前两个服务启动后,更改配置文件的内容,再启动第三个服务来达到上述的目的

- 也可以直接通过 Idea 工具来设置集群名称

-Dserver.port=8083 -Dspring.cloud.nacos.discovery.cluster-name=SH

重启微服务,进入 Nacos 管理界面

5.4.3.同集群优先的负载均衡

默认的 ZoneAvoidanceRule 并不能实现根据同集群优先来实现负载均衡。

因此 Nacos 中提供了一个 NacosRule 的实现,可以优先从同集群中挑选实例。

- 给 order-service 配置集群信息

修改 order-service 的 application.yml 文件,添加集群配置。

spring:

cloud:

nacos:

server-addr: localhost:8848 # nacos 的服务端地址

discovery:

cluster-name: HZ # 配置集群名称,即机房地址

- 修改负载均衡规则

修改 order-service 的 application.yml 文件,修改负载均衡规则。

user-service:

ribbon:

NFLoadBalancerRuleClassName: com.alibaba.cloud.nacos.ribbon.NacosRule # 负载均衡规则

NacosRule 优先选择本地集群,再在本地集群内的多个服务采用随机方式进行负载均衡。

5.4.4.小结

Nacos 服务分级存储模型

- 一级是服务。例如 user-service

- 二级是集群。例如杭州或上海

- 三级是实例。例如杭州机房的某台部署了 user-service 的服务器

如何设置实例的集群属性

- 修改 application.yml 文件,添加 spring.cloud.nacos.discovery.cluster-name 属性

NacosRule 负载均衡策略

- 优先选择同集群服务实例列表

- 本地集群找不到提供者,才去其它集群寻找,并且会报警告

- 确定了可用实例列表后,再采用随机负载均衡挑选实例

5.5.权重配置

实际部署中会出现这样的场景

服务器设备性能有差异,部分实例所在机器性能较好,另一些较差,我们希望性能好的机器承担更多的用户请求。

但默认情况下 NacosRule 是同集群内随机挑选,不会考虑机器的性能问题。

因此,Nacos 提供了权重配置来控制访问频率,权重越大则访问频率越高。

- 在 nacos 控制台,找到 user-service 的实例列表,点击编辑,即可修改权重。

- 在弹出的编辑窗口,修改权重

- 注意:如果权重修改为 0,则该实例永远不会被访问。

实际的权重控制

- Nacos 控制台可以设置实例的权重值,0~1 之间

- 同集群内的多个实例,权重越高被访问的频率越高

- 权重设置为 0 则完全不会被访问

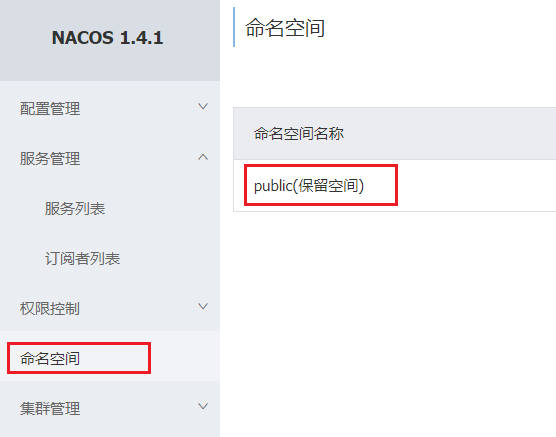

5.6.环境隔离

5.6.1.简单介绍

Nacos 提供了 namespace 来实现环境隔离功能。

- nacos 中可以有多个 namespace

- namespace 下可以有 group、service 等

- 不同 namespace 之间相互隔离,例如不同 namespace 的服务互相不可见

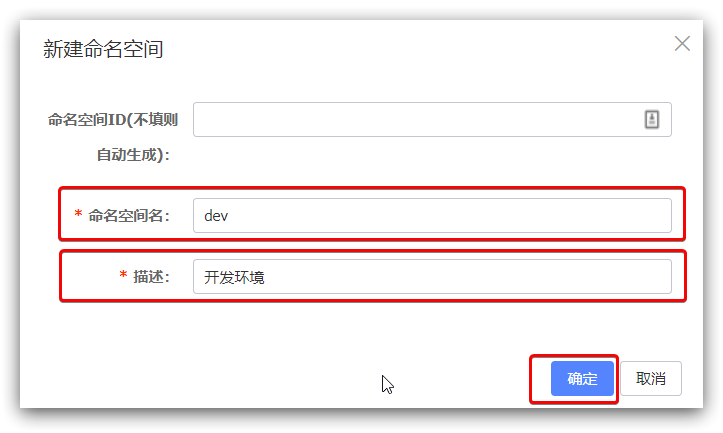

5.6.2.创建 namespace

默认情况下,所有 service、data、group 都在同一个 namespace,名为 public

我们可以点击页面新增按钮,添加一个 namespace。

然后,填写表单

5.6.3.给微服务配置 namespace

给微服务配置 namespace 只能通过修改配置来实现。

例如,修改 order-service 的 application.yml 文件

spring:

cloud:

nacos:

server-addr: localhost:8848

discovery:

cluster-name: HZ

namespace: 492a7d5d-237b-46a1-a99a-fa8e98e4b0f9 # 命名空间,填 ID

重启 order-service 后,访问控制台,可以看到下面的结果

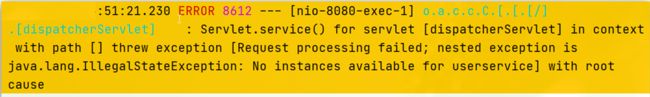

此时访问 order-service,因为 namespace 不同,会导致找不到 userservice,控制台会报错

5.6.4.小结

Nacos 环境隔离

- 每个 namespace 都有唯一 id

- 服务设置 namespace 时要写 id 而不是名称

- 不同 namespace 下的服务互相不可见

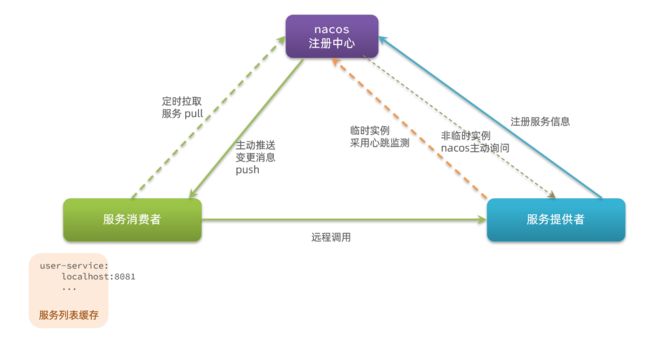

5.7.Nacos 与 Eureka 的区别

Nacos 的服务实例分为两种类型

- 临时实例:如果实例宕机超过一定时间,会从服务列表剔除,默认的类型。

- 非临时实例:如果实例宕机,不会从服务列表剔除,也可以叫永久实例。

配置一个服务实例为永久实例,比如这里可以选择 order-service 服务实例。

spring:

cloud:

nacos:

discovery:

ephemeral: false # 设置为非临时实例

Nacos 和 Eureka 整体结构类似,服务注册、服务拉取、心跳等待,但是也存在一些差异。

- Nacos 与 eureka 的共同点

- 都支持服务注册和服务拉取

- 都支持服务提供者心跳方式做健康检测

- Nacos 与 Eureka 的区别

- Nacos 支持服务端主动检测提供者状态:临时实例采用心跳模式,非临时实例采用主动检测模式

- 临时实例心跳不正常会被剔除,非临时实例则不会被剔除

- Nacos 支持服务列表变更的消息推送模式,服务列表更新更及时

- Nacos 集群默认采用 AP 方式;当集群中存在非临时实例时,采用 CP 模式。而 Eureka 集群采用 AP 方式

# SpringCloudDay02

SpringCloud 学习 Day02(实用篇-2)

- Nacos 配置管理

- Feign 远程调用

- GetWay 服务网关

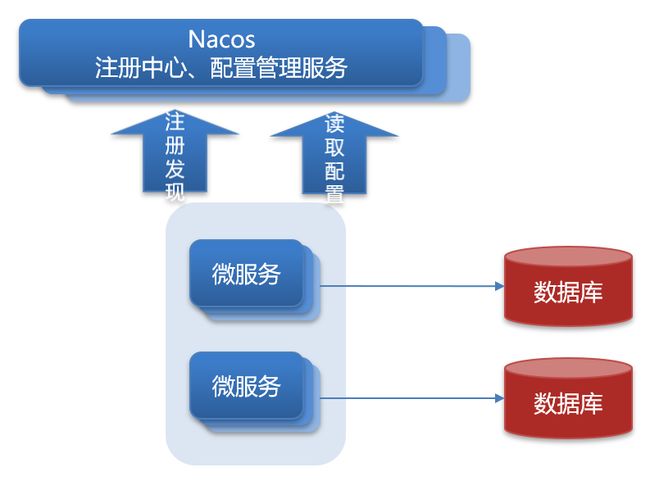

6.Nacos 配置管理

Nacos 除了可以做注册中心,同样可以做配置管理来使用。

6.1.统一配置管理

当微服务部署的实例越来越多,达到数十、数百时,逐个修改微服务配置就会让人抓狂,而且很容易出错。

我们需要一种统一配置管理方案,可以集中管理所有实例的配置。

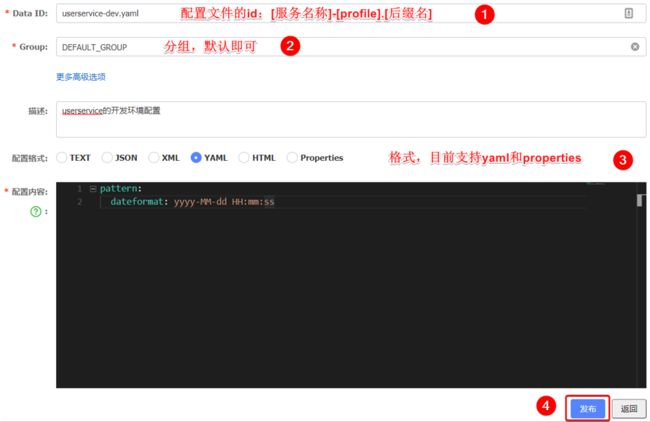

6.1.1.在 Nacos 中添加配置文件

在 Nacos 中管理配置

在弹出表单中填写配置信息

- 注意

- 项目的核心配置,需要热更新的配置才有放到 nacos 管理的必要。

- 基本不会变更的一些配置还是保存在微服务本地比较好。

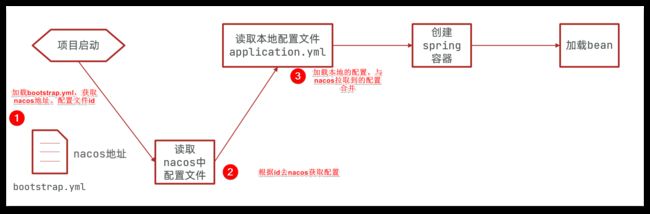

6.1.2.微服务配置拉取

微服务要拉取 nacos 中管理的配置,并且与本地的 application.yml 配置合并,才能完成项目启动。

但如果尚未读取 application.yml,又如何得知 nacos 地址呢?

因此 spring 引入了一种新的配置文件:bootstrap.yaml 文件,会在 application.yml 之前被读取。

- 引入 nacos-config 依赖

在 user-service 服务中,引入 nacos-config 的客户端依赖

<dependency>

<groupId>com.alibaba.cloudgroupId>

<artifactId>spring-cloud-starter-alibaba-nacos-configartifactId>

dependency>

- 添加

bootstrap.yaml

在 user-service 中添加一个 bootstrap.yaml 文件

spring:

application:

name: userservice # 服务名称

profiles:

active: dev #开发环境,这里是 dev

cloud:

nacos:

server-addr: localhost:8848 # Nacos 地址

config:

file-extension: yaml # 文件后缀名

同时,这里需要注释掉之前在 user-service 的 application.yml 文件中的一些重复的内容

诸如 application.name 、cloud.nacos.xxx 的内容。

这里会根据 spring.cloud.nacos.server-addr 获取 nacos 地址。

再根据 ${spring.application.name}-${spring.profiles.active}.${spring.cloud.nacos.config.file-extension} 作为文件 id ,来读取配置。

本例中,就是去读取 userservice-dev.yaml

- 读取 nacos 配置

在 user-service 中的 UserController 中添加业务逻辑,读取 pattern.dateformat 配置

/* 目前 UserController 需要导入的包(这里容易导错包,故直接贴上有关包的代码)*/

import cn.itcast.user.pojo.User;

import cn.itcast.user.service.UserService;

import lombok.extern.slf4j.Slf4j;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.beans.factory.annotation.Value;

import org.springframework.web.bind.annotation.*;

import java.time.LocalDateTime;

import java.time.format.DateTimeFormatter;

@Value("${pattern.dateformat}")

//@NacosValue("${pattern.dateformat}")

private String dateformat;

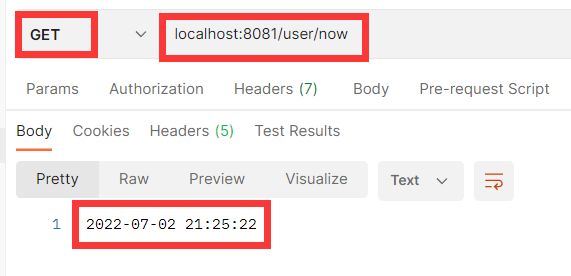

@GetMapping("now")

public String now() {

// 完成日期格式化并返回

System.out.println(dateformat);

return LocalDateTime.now().format(DateTimeFormatter.ofPattern(dateformat));

}

效果就是这样子。

我这里使用的是 Postman 工具,当然你也可以直接在页面上访问。

6.1.3.小结

- 在 Nacos 中添加配置文件

- 在微服务中引入 nacos 的 config 依赖

- 在微服务中添加

bootstrap.yml,配置 nacos 地址、当前环境、服务名称、文件后缀名。- 这些决定了程序启动时去 nacos 读取哪个文件

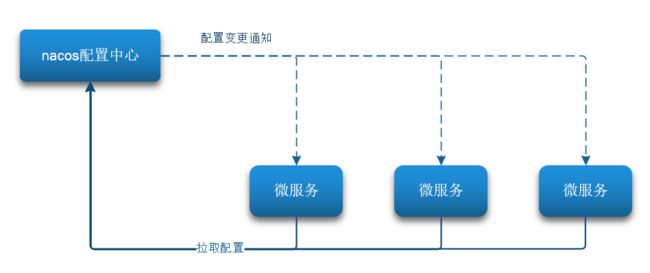

6.2.配置热更新

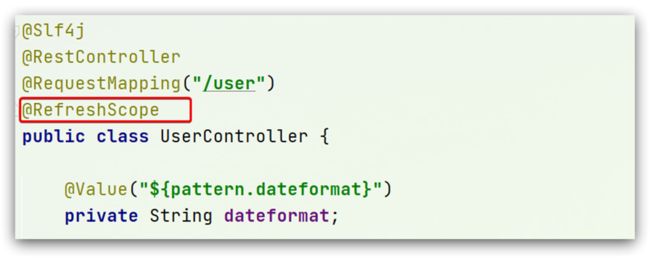

我们最终的目的,是修改 nacos 中的配置后,微服务中无需重启即可让配置生效,也就是配置热更新。

要实现配置热更新,有两种方式可供选择

- 在

@Value注入的变量所在类上添加注解@RefreshScope - 使用

@ConfigurationProperties注解代替@Value注解

方式一:在 @Value 注入的变量所在类上添加注解 @RefreshScope。

user-service 服务下的 src/main/java/cn/itcast/user/web/UserController.java

方式二:使用 @ConfigurationProperties 注解代替 @Value 注解。

在 user-service 服务中,添加一个类,读取 patterrn.dateformat属性

user-service 下的 src/main/java/cn/itcast/user/config/PatternProperties.java

@Component

@Data

@ConfigurationProperties(prefix = "pattern")

public class PatternProperties {

private String dateformat;

}

若代码报红:Spring Boot Configuration Annotation Processor not configured,可以在 pom.xml 中添加依赖

在 user-service 下的 pom.xml 导入 spring-boot-configuration-processor 的相关依赖

<dependency>

<groupId>org.springframework.bootgroupId>

<artifactId>spring-boot-configuration-processorartifactId>

<optional>trueoptional>

dependency>

在 UserController 类中使刚刚创建的类代替 @Value,并且注释掉之前的代码

修改 user-service 下的 src/main/java/cn/itcast/user/web/UserController.java 的代码

//@RefreshScope // 需要注释的注解

//@Value("${pattern.dateformat}") // 注释掉的代码

//private String dateformat; // 注释掉的代码

@Autowired

private PatternProperties patternProperties;

//编写 Controller,通过日期格式化器现在的时间并返回

@GetMapping("now")

public String now() {

//return LocalDateTime.now().format(DateTimeFormatter.ofPattern(dateformat));// 注释掉的代码

return LocalDateTime.now().format(DateTimeFormatter.ofPattern(patternProperties.getDateformat()));

}

小结

Nacos 配置更改后,微服务可以实现热更新

- 方式一:通过

@Value注解注入,结合@RefreshScope来刷新 - 方式二:通过

@ConfigurationProperties注入,自动刷新

注意事项

- 不是所有的配置都适合放到配置中心。都放到配置中心的话,维护起来就比较麻烦

- 建议将一些关键参数,需要运行时调整的参数放到 nacos 配置中心,一般都是自定义配置

6.3.配置共享

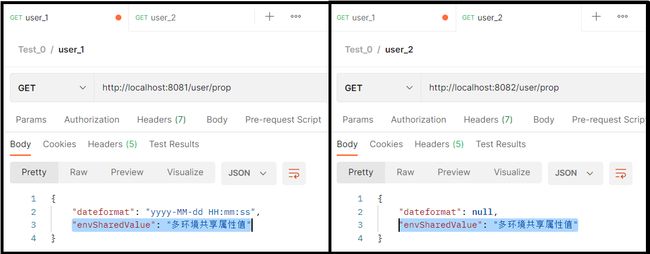

其实微服务启动时,会去 nacos 读取多个配置文件,例如:

[spring.application.name]-[spring.profiles.active].yaml,例如:userservice-dev.yaml[spring.application.name].yaml,例如:userservice.yaml

无论 profile 如何变化,[spring.application.name].yaml 这个文件一定会加载

因此多环境共享配置可以写入这个文件。

优先级:[服务名]-[环境].yaml > [服务名].yaml > 本地配置

步骤

- 添加一个环境共享配置

- 在

user-service中读取共享配置 - 运行两个 UserApplication,使用不同的 profile

- 配置共享的优先级

- 添加一个环境共享配置

我们在 nacos 中添加一个 userservice.yaml 文件

![]()

- 在

user-service中读取共享配置

在 user-service 服务中,修改 PatternProperties 类,读取新添加的属性

user-service 下的 src/main/java/cn/itcast/user/config/PatternProperties.java

@Data

@Component

@ConfigurationProperties(prefix = "pattern")

public class PatternProperties {

private String dataformat;

/* ***************************** */

private String envSharedValue;

/* ***************************** */

}

在 user-service 服务中,修改 UserController,添加一个方法:

@GetMapping("/prop")

public PatternProperties properties() {

return patternProperties;

}

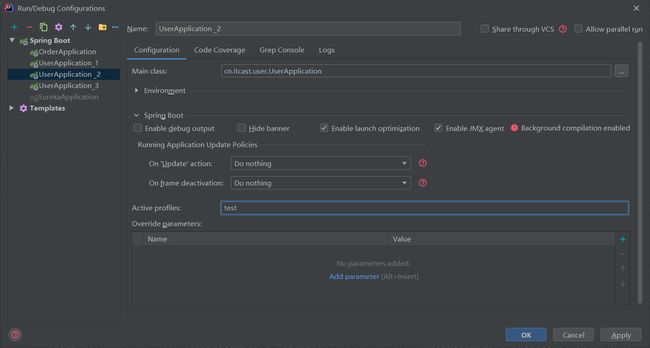

- 运行两个 UserApplication,使用不同的 profile

UserApplication_1(8081)使用的 profile 是 dev

UserApplication_2(8082)使用的 profile 是 test(这里就只贴一张图了)

启动 UserApplication_1 和 UserApplication_2,访问 http://localhost:8081/user/prop 和 http://localhost:8082/user/prop

可以看出来,不管是 dev,还是 test 环境,都读取到了 envSharedValue 这个属性的值。

- 配置共享的优先级

当 nacos、服务本地同时出现相同属性时,优先级有高低之分

6.4.搭建 Nacos 集群

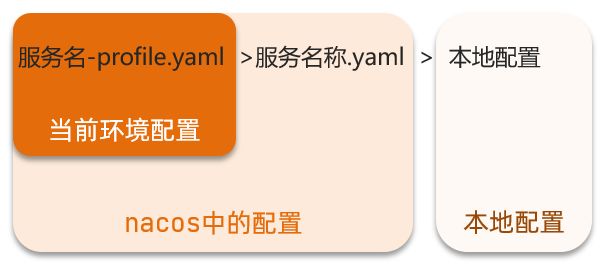

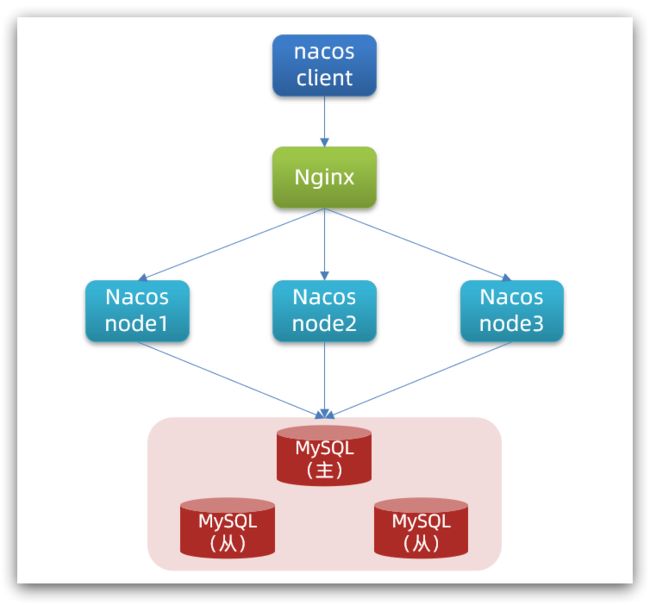

Nacos 生产环境下一定要部署为集群状态

6.4.1.集群架构图

官方给出的 Nacos 集群图

其中包含 3 个 nacos 节点,然后一个负载均衡器代理 3 个 Nacos。

这里负载均衡器可以使用 nginx。

我们计划的集群结构

三个 nacos 节点的地址

| 节点 | ip | port |

|---|---|---|

| nacos1 | 192.168.150.1 | 8845 |

| nacos2 | 192.168.150.1 | 8846 |

| nacos3 | 192.168.150.1 | 8847 |

6.4.2.搭建集群的基本步骤

- 搭建 MySQL 集群并初始化数据库表

- 下载解压 nacos

- 修改集群配置(节点信息)、数据库配置

- 分别启动多个 nacos 节点

- nginx 反向代理

6.4.3.初始化数据库

Nacos 默认数据存储在内嵌数据库 Derby 中,不属于生产可用的数据库。

官方推荐的最佳实践是使用带有主从的高可用数据库集群。

这里我们以单点的数据库为例来讲解。

首先新建一个数据库,命名为 nacos,字符集是 utf8,排序规则是 utf8_general_ci。

而后导入下面的 SQL。

CREATE TABLE `config_info` (

`id` bigint(20) NOT NULL AUTO_INCREMENT COMMENT 'id',

`data_id` varchar(255) NOT NULL COMMENT 'data_id',

`group_id` varchar(255) DEFAULT NULL,

`content` longtext NOT NULL COMMENT 'content',

`md5` varchar(32) DEFAULT NULL COMMENT 'md5',

`gmt_create` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP COMMENT '创建时间',

`gmt_modified` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP COMMENT '修改时间',

`src_user` text COMMENT 'source user',

`src_ip` varchar(50) DEFAULT NULL COMMENT 'source ip',

`app_name` varchar(128) DEFAULT NULL,

`tenant_id` varchar(128) DEFAULT '' COMMENT '租户字段',

`c_desc` varchar(256) DEFAULT NULL,

`c_use` varchar(64) DEFAULT NULL,

`effect` varchar(64) DEFAULT NULL,

`type` varchar(64) DEFAULT NULL,

`c_schema` text,

PRIMARY KEY (`id`),

UNIQUE KEY `uk_configinfo_datagrouptenant` (`data_id`,`group_id`,`tenant_id`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8 COLLATE=utf8_bin COMMENT='config_info';

/******************************************/

/* 数据库全名 = nacos_config */

/* 表名称 = config_info_aggr */

/******************************************/

CREATE TABLE `config_info_aggr` (

`id` bigint(20) NOT NULL AUTO_INCREMENT COMMENT 'id',

`data_id` varchar(255) NOT NULL COMMENT 'data_id',

`group_id` varchar(255) NOT NULL COMMENT 'group_id',

`datum_id` varchar(255) NOT NULL COMMENT 'datum_id',

`content` longtext NOT NULL COMMENT '内容',

`gmt_modified` datetime NOT NULL COMMENT '修改时间',

`app_name` varchar(128) DEFAULT NULL,

`tenant_id` varchar(128) DEFAULT '' COMMENT '租户字段',

PRIMARY KEY (`id`),

UNIQUE KEY `uk_configinfoaggr_datagrouptenantdatum` (`data_id`,`group_id`,`tenant_id`,`datum_id`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8 COLLATE=utf8_bin COMMENT='增加租户字段';

/******************************************/

/* 数据库全名 = nacos_config */

/* 表名称 = config_info_beta */

/******************************************/

CREATE TABLE `config_info_beta` (

`id` bigint(20) NOT NULL AUTO_INCREMENT COMMENT 'id',

`data_id` varchar(255) NOT NULL COMMENT 'data_id',

`group_id` varchar(128) NOT NULL COMMENT 'group_id',

`app_name` varchar(128) DEFAULT NULL COMMENT 'app_name',

`content` longtext NOT NULL COMMENT 'content',

`beta_ips` varchar(1024) DEFAULT NULL COMMENT 'betaIps',

`md5` varchar(32) DEFAULT NULL COMMENT 'md5',

`gmt_create` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP COMMENT '创建时间',

`gmt_modified` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP COMMENT '修改时间',

`src_user` text COMMENT 'source user',

`src_ip` varchar(50) DEFAULT NULL COMMENT 'source ip',

`tenant_id` varchar(128) DEFAULT '' COMMENT '租户字段',

PRIMARY KEY (`id`),

UNIQUE KEY `uk_configinfobeta_datagrouptenant` (`data_id`,`group_id`,`tenant_id`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8 COLLATE=utf8_bin COMMENT='config_info_beta';

/******************************************/

/* 数据库全名 = nacos_config */

/* 表名称 = config_info_tag */

/******************************************/

CREATE TABLE `config_info_tag` (

`id` bigint(20) NOT NULL AUTO_INCREMENT COMMENT 'id',

`data_id` varchar(255) NOT NULL COMMENT 'data_id',

`group_id` varchar(128) NOT NULL COMMENT 'group_id',

`tenant_id` varchar(128) DEFAULT '' COMMENT 'tenant_id',

`tag_id` varchar(128) NOT NULL COMMENT 'tag_id',

`app_name` varchar(128) DEFAULT NULL COMMENT 'app_name',

`content` longtext NOT NULL COMMENT 'content',

`md5` varchar(32) DEFAULT NULL COMMENT 'md5',

`gmt_create` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP COMMENT '创建时间',

`gmt_modified` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP COMMENT '修改时间',

`src_user` text COMMENT 'source user',

`src_ip` varchar(50) DEFAULT NULL COMMENT 'source ip',

PRIMARY KEY (`id`),

UNIQUE KEY `uk_configinfotag_datagrouptenanttag` (`data_id`,`group_id`,`tenant_id`,`tag_id`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8 COLLATE=utf8_bin COMMENT='config_info_tag';

/******************************************/

/* 数据库全名 = nacos_config */

/* 表名称 = config_tags_relation */

/******************************************/

CREATE TABLE `config_tags_relation` (

`id` bigint(20) NOT NULL COMMENT 'id',

`tag_name` varchar(128) NOT NULL COMMENT 'tag_name',

`tag_type` varchar(64) DEFAULT NULL COMMENT 'tag_type',

`data_id` varchar(255) NOT NULL COMMENT 'data_id',

`group_id` varchar(128) NOT NULL COMMENT 'group_id',

`tenant_id` varchar(128) DEFAULT '' COMMENT 'tenant_id',

`nid` bigint(20) NOT NULL AUTO_INCREMENT,

PRIMARY KEY (`nid`),

UNIQUE KEY `uk_configtagrelation_configidtag` (`id`,`tag_name`,`tag_type`),

KEY `idx_tenant_id` (`tenant_id`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8 COLLATE=utf8_bin COMMENT='config_tag_relation';

/******************************************/

/* 数据库全名 = nacos_config */

/* 表名称 = group_capacity */

/******************************************/

CREATE TABLE `group_capacity` (

`id` bigint(20) unsigned NOT NULL AUTO_INCREMENT COMMENT '主键ID',

`group_id` varchar(128) NOT NULL DEFAULT '' COMMENT 'Group ID,空字符表示整个集群',

`quota` int(10) unsigned NOT NULL DEFAULT '0' COMMENT '配额,0表示使用默认值',

`usage` int(10) unsigned NOT NULL DEFAULT '0' COMMENT '使用量',

`max_size` int(10) unsigned NOT NULL DEFAULT '0' COMMENT '单个配置大小上限,单位为字节,0表示使用默认值',

`max_aggr_count` int(10) unsigned NOT NULL DEFAULT '0' COMMENT '聚合子配置最大个数,,0表示使用默认值',

`max_aggr_size` int(10) unsigned NOT NULL DEFAULT '0' COMMENT '单个聚合数据的子配置大小上限,单位为字节,0表示使用默认值',

`max_history_count` int(10) unsigned NOT NULL DEFAULT '0' COMMENT '最大变更历史数量',

`gmt_create` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP COMMENT '创建时间',

`gmt_modified` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP COMMENT '修改时间',

PRIMARY KEY (`id`),

UNIQUE KEY `uk_group_id` (`group_id`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8 COLLATE=utf8_bin COMMENT='集群、各Group容量信息表';

/******************************************/

/* 数据库全名 = nacos_config */

/* 表名称 = his_config_info */

/******************************************/

CREATE TABLE `his_config_info` (

`id` bigint(64) unsigned NOT NULL,

`nid` bigint(20) unsigned NOT NULL AUTO_INCREMENT,

`data_id` varchar(255) NOT NULL,

`group_id` varchar(128) NOT NULL,

`app_name` varchar(128) DEFAULT NULL COMMENT 'app_name',

`content` longtext NOT NULL,

`md5` varchar(32) DEFAULT NULL,

`gmt_create` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP,

`gmt_modified` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP,

`src_user` text,

`src_ip` varchar(50) DEFAULT NULL,

`op_type` char(10) DEFAULT NULL,

`tenant_id` varchar(128) DEFAULT '' COMMENT '租户字段',

PRIMARY KEY (`nid`),

KEY `idx_gmt_create` (`gmt_create`),

KEY `idx_gmt_modified` (`gmt_modified`),

KEY `idx_did` (`data_id`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8 COLLATE=utf8_bin COMMENT='多租户改造';

/******************************************/

/* 数据库全名 = nacos_config */

/* 表名称 = tenant_capacity */

/******************************************/

CREATE TABLE `tenant_capacity` (

`id` bigint(20) unsigned NOT NULL AUTO_INCREMENT COMMENT '主键ID',

`tenant_id` varchar(128) NOT NULL DEFAULT '' COMMENT 'Tenant ID',

`quota` int(10) unsigned NOT NULL DEFAULT '0' COMMENT '配额,0表示使用默认值',

`usage` int(10) unsigned NOT NULL DEFAULT '0' COMMENT '使用量',

`max_size` int(10) unsigned NOT NULL DEFAULT '0' COMMENT '单个配置大小上限,单位为字节,0表示使用默认值',

`max_aggr_count` int(10) unsigned NOT NULL DEFAULT '0' COMMENT '聚合子配置最大个数',

`max_aggr_size` int(10) unsigned NOT NULL DEFAULT '0' COMMENT '单个聚合数据的子配置大小上限,单位为字节,0表示使用默认值',

`max_history_count` int(10) unsigned NOT NULL DEFAULT '0' COMMENT '最大变更历史数量',

`gmt_create` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP COMMENT '创建时间',

`gmt_modified` datetime NOT NULL DEFAULT CURRENT_TIMESTAMP COMMENT '修改时间',

PRIMARY KEY (`id`),

UNIQUE KEY `uk_tenant_id` (`tenant_id`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8 COLLATE=utf8_bin COMMENT='租户容量信息表';

CREATE TABLE `tenant_info` (

`id` bigint(20) NOT NULL AUTO_INCREMENT COMMENT 'id',

`kp` varchar(128) NOT NULL COMMENT 'kp',

`tenant_id` varchar(128) default '' COMMENT 'tenant_id',

`tenant_name` varchar(128) default '' COMMENT 'tenant_name',

`tenant_desc` varchar(256) DEFAULT NULL COMMENT 'tenant_desc',

`create_source` varchar(32) DEFAULT NULL COMMENT 'create_source',

`gmt_create` bigint(20) NOT NULL COMMENT '创建时间',

`gmt_modified` bigint(20) NOT NULL COMMENT '修改时间',

PRIMARY KEY (`id`),

UNIQUE KEY `uk_tenant_info_kptenantid` (`kp`,`tenant_id`),

KEY `idx_tenant_id` (`tenant_id`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8 COLLATE=utf8_bin COMMENT='tenant_info';

CREATE TABLE `users` (

`username` varchar(50) NOT NULL PRIMARY KEY,

`password` varchar(500) NOT NULL,

`enabled` boolean NOT NULL

);

CREATE TABLE `roles` (

`username` varchar(50) NOT NULL,

`role` varchar(50) NOT NULL,

UNIQUE INDEX `idx_user_role` (`username` ASC, `role` ASC) USING BTREE

);

CREATE TABLE `permissions` (

`role` varchar(50) NOT NULL,

`resource` varchar(255) NOT NULL,

`action` varchar(8) NOT NULL,

UNIQUE INDEX `uk_role_permission` (`role`,`resource`,`action`) USING BTREE

);

INSERT INTO users (username, password, enabled) VALUES ('nacos', '$2a$10$EuWPZHzz32dJN7jexM34MOeYirDdFAZm2kuWj7VEOJhhZkDrxfvUu', TRUE);

INSERT INTO roles (username, role) VALUES ('nacos', 'ROLE_ADMIN');

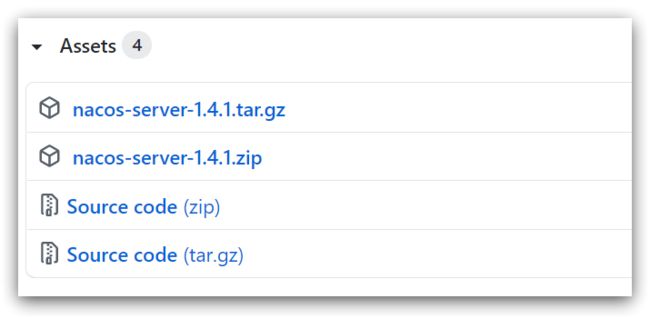

6.4.5.下载 Nacos

nacos 在 GitHub 上有下载地址:https://github.com/alibaba/nacos/tags,可选择任意版本下载。

本例中使用的是 1.4.1 版本

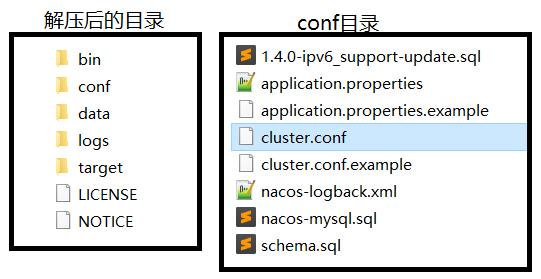

6.4.4.配置 Nacos

将包解压到非中文目录,其中 bin 目录:启动脚本,conf 目录:配置文件

进入 nacos 的 conf 目录,复制配置文件 cluster.conf.example,命名为 cluster.conf

之后添加内容

127.0.0.1:8845

127.0.0.1.8846

127.0.0.1.8847

修改 application.properties 文件,添加数据库配置

spring.datasource.platform=mysql

db.num=1

db.url.0=jdbc:mysql://127.0.0.1:3306/nacos?characterEncoding=utf8&connectTimeout=1000&socketTimeout=3000&autoReconnect=true&useUnicode=true&useSSL=false&serverTimezone=UTC

db.user.0=root

db.password.0=123

6.4.6.启动

将 nacos 文件夹复制三份,分别命名为:nacos1、nacos2、nacos3

然后分别修改三个文件夹中的 application.properties

nacos1

server.port=8845

nacos2

server.port=8846

nacos3

server.port=8847

然后分别启动三个 nacos 节点

startup.cmd

当三个终端都出现:Nacos started successfully in cluster mode. use external storage,表示集群启动成功。

6.4.7.Nginx 反向代理

找到课前资料提供的 nginx 安装包,解压到任意非中文目录下。

修改 conf/nginx.conf 文件,配置如下

upstream nacos-cluster {

server 127.0.0.1:8845;

server 127.0.0.1:8846;

server 127.0.0.1:8847;

}

server {

listen 80;

server_name localhost;

location /nacos {

proxy_pass http://nacos-cluster;

}

}

而后在浏览器访问:http://localhost/nacos 即可。

代码中 application.yml 文件配置如下

spring:

cloud:

nacos:

server-addr: localhost:80 # Nacos地址

之后我们可以启动两个 user-service 服务,并在 Nacos 界面设置一个配置。

之后我们可以在数据库中发现,相关记录已经存储到数据库中的 config_info 表了。

说明持久化已经成功了。

6.4.8.优化

- 实际部署时,需要给做反向代理的 nginx 服务器设置一个域名,这样后续如果有服务器迁移 nacos 的客户端也无需更改配置

- Nacos 的各个节点应该部署到多个不同服务器,做好容灾和隔离

7.Feign 远程调用

7.1.RestTemplate 存在的问题

这是之前利用 RestTemplate 发起远程调用的代码

String url = "http://user-service/user/" + order.getUserId();

User user = restTemplate.getForObject(url, User.class);

存在下面的问题:① 代码可读性差,编程体验不统一;② 参数复杂 URL 难以维护。

Feign 是一个声明式的 http 客户端,官方地址:https://github.com/OpenFeign/feign

其作用就是帮助我们优雅的实现 http 请求的发送,解决上面提到的问题。

7.2.Feign 替代 RestTemplate

7.2.1.导入依赖

我们在 order-service 服务的 pom 文件中引入 feign 的依赖

<dependency>

<groupId>org.springframework.cloudgroupId>

<artifactId>spring-cloud-starter-openfeignartifactId>

dependency>

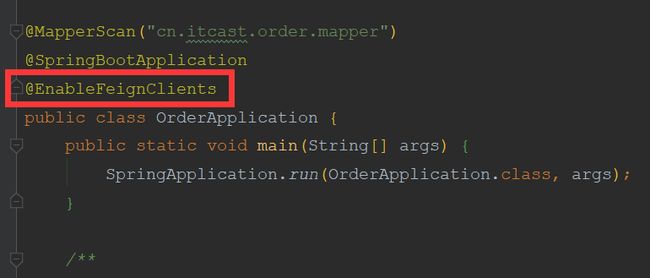

7.2.2.添加注解

在 order-service 的启动类添加注解开启 Feign 的功能:@EnableFeignClients

7.2.3.编写 Feign 的客户端

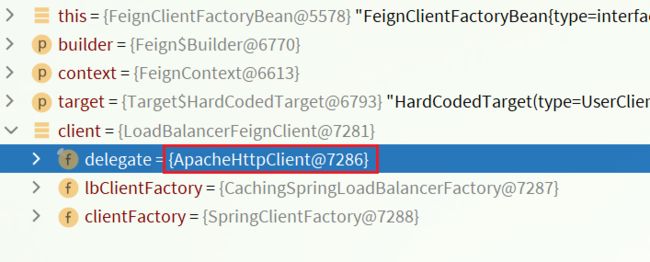

在 order-service 中新建一个接口,内容如下

order-service 服务下的 src/main/java/cn/itcast/order/clients/UserClient.java

package cn.itcast.order.clients;

import cn.itcast.order.pojo.User;

import org.springframework.cloud.openfeign.FeignClient;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.PathVariable;

@FeignClient("userservice")

public interface UserClient {

@GetMapping("/user/{id}")

User findById(@PathVariable("id") Long id);

}

这个客户端主要是基于 SpringMVC 的注解来声明远程调用的信息

- 服务名称:

userservice - 请求方式:GET

- 请求路径:

/user/{id} - 请求参数:

Long id - 返回值类型:User

这样,Feign 就可以帮助我们发送 http 请求,无需自己使用 RestTemplate 来发送了。

7.2.4.测试

修改 order-service 中的 OrderService 类中的 queryOrderById 方法

并且使用 Feign 客户端代替 RestTemplate

@Autowired

private UserClient userClient;

public Order queryOrderById(Long orderId) {

// 1.查询订单

Order order = orderMapper.findById(orderId);

// 2.用 Feign 远程调用

User user = userClient.findById(order.getUserId());

// 3.封装 user 到 Order

order.setUser(user);

// 4.返回

return order;

}

此外,记得修改 order-service 服务下的 application.yml 文件的内容

- 注释掉 namespace

- 将

cloud.nacos.server-addr的值改为localhost:80。

观察 Idea 控制台可以发现,此时我们不仅实现了远程调用,还实现了负载均衡。

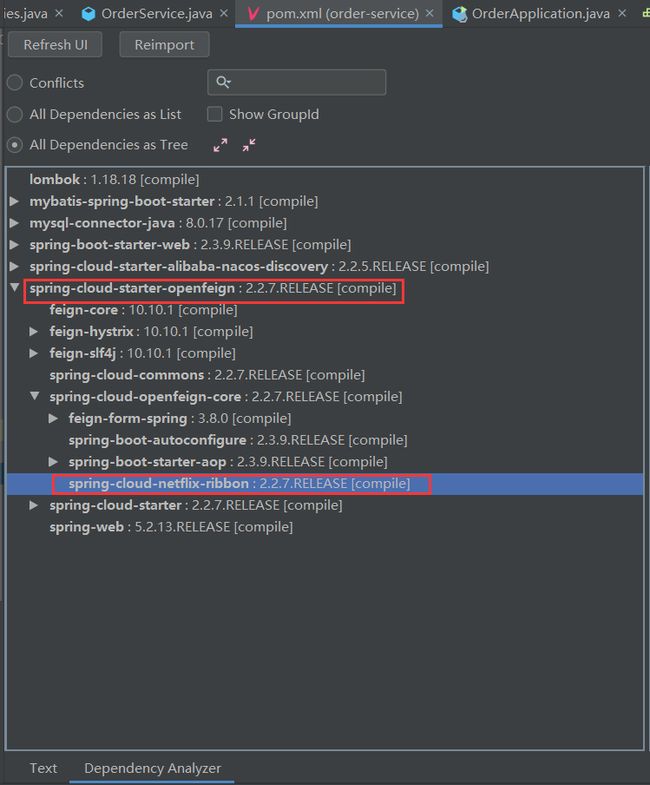

事实上,我们可以通过观察 order-service 依赖的树形图,

来了解到 spring-cloud-starter-openfeign 中已经集成了 spring-cloud-netflix-ribbon,自动实现了负载均衡。

7.2.5.小结

使用 Feign 的步骤

- 引入依赖

- 添加

@EnableFeignClients注解 - 编写 FeignClient 接口

- 使用 FeignClient 中定义的方法代替 RestTemplate

7.3.自定义配置

7.3.1.自定义配置表

Feign 运行自定义配置来覆盖默认配置。可以修改的配置如下。

| 类型 | 作用 | 说明 |

|---|---|---|

feign.Logger.Level |

修改日志级别 | 包含四种不同的级别:NONE、BASIC、HEADERS、FULL |

feign.codec.Decoder |

响应结果的解析器 | http 远程调用的结果做解析,例如解析 json 字符串为 java 对象 |

feign.codec.Encoder |

请求参数编码 | 将请求参数编码,便于通过 http 请求发送 |

feign. Contract |

支持的注解格式 | 默认是 SpringMVC 的注解 |

feign. Retryer |

失败重试机制 | 请求失败的重试机制,默认是没有,不过会使用 Ribbon 的重试 |

一般我们需要配置的就是日志级别

下面以日志为例来演示如何自定义配置。

7.3.2.配置文件方式

基于配置文件修改 feign 的日志级别可以针对单个服务:

feign:

client:

config:

userservice: # 针对某个微服务的配置

loggerLevel: FULL # 日志级别

也可以针对所有服务:

feign:

client:

config:

default: # 这里用 default 就是全局配置,如果是写服务名称,则是针对某个微服务的配置

loggerLevel: FULL # 日志级别

而日志的级别分为四种:

- NONE:不记录任何日志信息,这是默认值。

- BASIC:仅记录请求的方法,URL 以及响应状态码和执行时间

- HEADERS:在 BASIC 的基础上,额外记录了请求和响应的头信息

- FULL:记录所有请求和响应的明细,包括头信息、请求体、元数据。

7.3.3.Java 代码方式

也可以基于 Java 代码来修改日志级别,先声明一个类,然后声明一个 Logger.Level 的对象

比如我可以在 order-service 服务下创建一个类:cn/itcast/order/config/DefaultFeignConfiguration.java

public class DefaultFeignConfiguration {

@Bean

public Logger.Level feignLogLevel(){

return Logger.Level.BASIC; // 日志级别为 BASIC

}

}

如果要全局生效,将其放到启动类的 @EnableFeignClients 这个注解中:

比如这里就可以放在 order-service 服务下的 cn/itcast/order/OrderApplication.java

@EnableFeignClients(defaultConfiguration = DefaultFeignConfiguration .class)

如果是局部生效,则把它放到对应的 @FeignClient 这个注解中:

比如这里就可以放在 order-service 服务下的 cn/itcast/order/clients/UserClient.java

@FeignClient(value = "userservice", configuration = DefaultFeignConfiguration .class)

7.3.4.小结

Feign 的日志配置

- 方式一是配置文件,

feign.client.config.xxx.loggerlevel- 如果 xxx 是 default,则代表全局

- 如果 xxx 是服务名称(例如 userservice),那么它代表的就是某服务

- 方式二是 java 代码配置 Logger.Level 这个 Bean

- 如果在

@EnableFeignClients注解声明则代表全局 - 如果在

@FeignClient注解中声明则代表某服务

- 如果在

7.4.Feign 使用优化

7.4.1.分析

Feign 底层发起 http 请求,依赖于其它的框架。

其底层客户端实现包括:

- URLConnection:默认实现,不支持连接池

- Apache HttpClient:支持连接池

- OKHttp:支持连接池

因此提高 Feign 的性能主要手段就是使用连接池代替默认的 URLConnection。

日志界别的话,最好用 basic 或 none。

这里我们用 Apache的HttpClient 来演示。

7.4.2.引入依赖

在 order-service 的 pom.xml 文件中引入 Apache 的 HttpClient 依赖

<dependency>

<groupId>io.github.openfeigngroupId>

<artifactId>feign-httpclientartifactId>

dependency>

7.4.3.配置连接池

在 order-service 的 application.yml 中添加配置

feign:

client:

config:

default: # default 全局的配置

loggerLevel: BASIC # 日志级别,BASIC 就是基本的请求和响应信息

httpclient:

enabled: true # 开启 feign 对 HttpClient 的支持

max-connections: 200 # 最大的连接数

max-connections-per-route: 50 # 每个路径的最大连接数

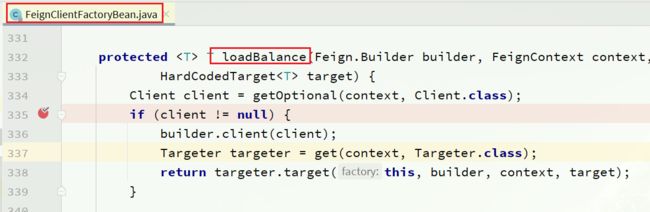

接下来,在 FeignClientFactoryBean 中的 loadBalance 方法中打断点:

Debug 方式启动 order-service 服务,可以看到这里的 client,底层就是 Apache HttpClient

7.4.4.总结

Feign 的优化

- 日志级别尽量用 basic

- 使用 HttpClient 或 OKHttp 代替 URLConnection

- 引入 feign-httpClient 依赖

- 配置文件开启 httpClient 功能,设置连接池参数

7.5.最佳实践

7.5.1.分析

最佳实践,就是使用过程中总结的经验,最好的一种使用方式。

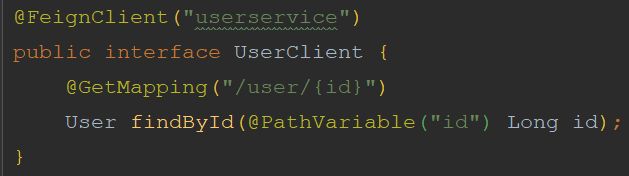

经由观察可以发现,Feign 的客户端与服务提供者的 controller 代码非常相似

feign 客户端

UserController

有没有一种办法简化这种重复的代码编写呢?

7.5.2.继承方式

给消费者的 FeignClient 和提供者的 controller 定义统一的父接口作为标准

一样的代码可以通过继承来共享

- 定义一个 API 接口,利用定义方法,并基于 SpringMVC 注解做声明

- Feign 客户端和 Controller 都集成改接口

优点

- 简单、实现了代码共享

缺点

- 服务提供方、服务消费方紧耦合

- 参数列表中的注解映射并不会继承,因此 Controller 中必须再次声明方法、参数列表、注解

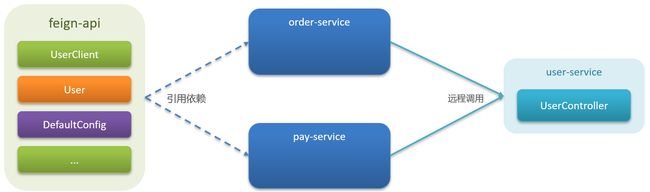

7.5.3.抽取方式

将 Feign 的 Client 抽取为独立模块,并且把接口有关的 POJO、默认的 Feign 配置都放到这个模块中,提供给所有消费者使用。

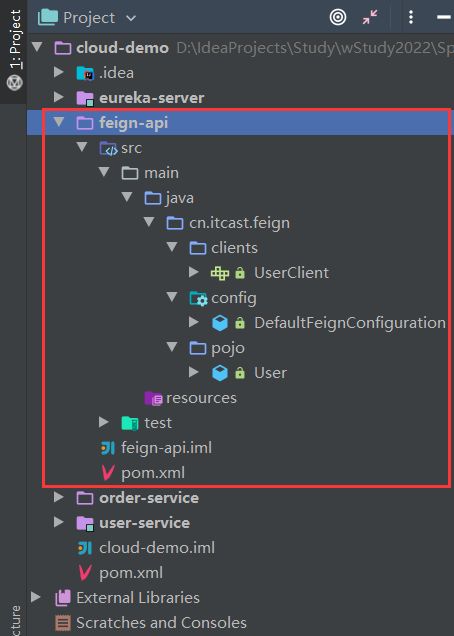

例如,将 UserClient、User、Feign 的默认配置都抽取到一个 feign-api 包中,所有微服务引用该依赖包,即可直接使用。

实现最佳实践方式二(抽取方式)的步骤如下

- 首先创建一个 module,命名为

feign-api,然后引入 feign 的 starter 依赖 - 将

order-service中编写的 UserClient、User、DefaultFeignConfiguration 都复制到 feign-api 项目中 - 在

order-service中引入 feign-api 的依赖 - 修改

order-service中的所有与上述三个组件有关的 import 部分,改成导入 feign-api 中的包 - 重启测试

7.5.4.小结

Feign 的最佳实践

- 继承方式:让 controller 和 FeignClient 继承同一接口

- 抽取方式:将 FeignClient、POJO、Feign 的默认配置都定义到一个项目中,供所有消费者使用

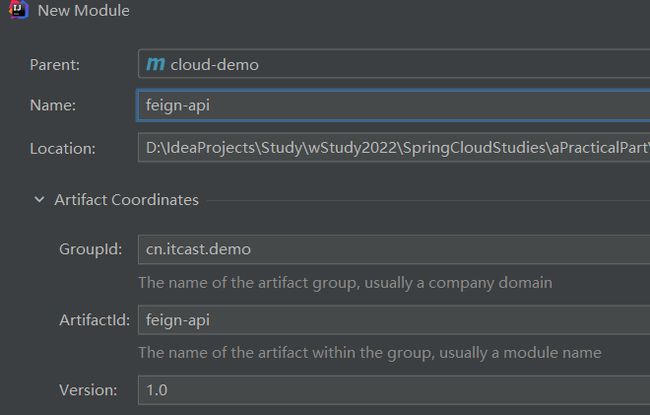

7.6.实现基于抽取的最佳实践

7.6.1.抽取

首先创建一个 module,命名为 feign-api

在 feign-api 中然后引入 feign 的 starter 依赖

<dependency>

<groupId>org.springframework.cloudgroupId>

<artifactId>spring-cloud-starter-openfeignartifactId>

dependency>

然后,order-service 中编写的 UserClient、User、DefaultFeignConfiguration 都复制到 feign-api 项目中。

下图为最终的项目结构

7.6.2.使用 feign-api

- 在

order-service中使用feign-api

首先,删除 order-service 中的 UserClient、User、DefaultFeignConfiguration 等类或接口。

在 order-service 的 pom.xml 文件中中引入 feign-api 的依赖

<dependency>

<groupId>cn.itcast.demogroupId>

<artifactId>feign-apiartifactId>

<version>1.0version>

dependency>

修改 order-service 中的所有与上述三个组件有关的导包部分,改成导入 feign-api 中的包

即 Order、OrderService、OrderApplication

7.6.3.重启测试

重启 OrderApplication ,Idea 控制台报错,启动失败。

Field userClient in cn.itcast.order.service.OrderService

required a bean of type 'cn.itcast.feign.clients.UserClient'

that could not be found.

![]()

这是因为 UserClient 现在在 cn.itcast.feign.clients 包下,

而 order-service 的 @EnableFeignClients 注解是在 cn.itcast.order 包下,不在同一个包,无法扫描到 UserClient

7.6.4.解决扫描包问题

当定义的 FeignClient 不在 SpringBootApplication 的扫描包范围时,这些 FeignClient 无法使用。

我们需要导入包。

不同包的 FeignClient 的导入有两种方式

- 在

@EnableFeignClients注解中添加 basePackages,指定 FeignClient 所在的包 - 在

@EnableFeignClients注解中添加 clients,指定具体 FeignClient 的字节码

方式一

- 指定 Feign 应该扫描的包

@EnableFeignClients(basePackages = "cn.itcast.feign.clients")

方式二(推荐)

- 指定需要加载的 Client 接口:

@EnableFeignClients(clients = {UserClient.class})

例如我们可以在 order-service 服务下的 src/main/java/cn/itcast/order/OrderApplication.java 上方添加注解

@MapperScan("cn.itcast.order.mapper")

@SpringBootApplication

@EnableFeignClients(clients = UserClient.class, defaultConfiguration = DefaultFeignConfiguration.class)

public class OrderApplication {

... ...

}

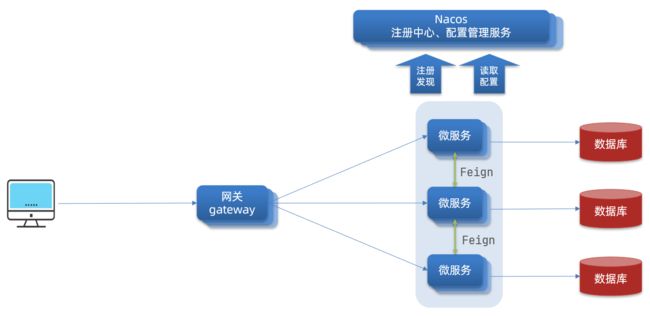

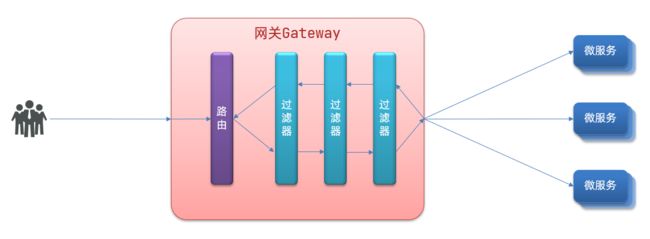

8.Gateway 服务网关

Spring Cloud Gateway 是 Spring Cloud 的一个全新项目。

该项目是基于 Spring 5.0,Spring Boot 2.0 和 Project Reactor 等响应式编程和事件流技术开发的网关,

它旨在为微服务架构提供一种简单有效的统一的 API 路由管理方式。

8.1.为什么需要网关

Gateway 网关是我们服务的守门神,所有微服务的统一入口。

网关的核心功能特性:请求路由、权限控制、限流

权限控制:网关作为微服务入口,需要校验用户是是否有请求资格,如果没有则进行拦截。

路由和负载均衡:

- 一切请求都必须先经过 gateway,但网关不处理业务。

- 而是根据某种规则,把请求转发到某个微服务,这个过程叫做路由。

- 当然路由的目标服务有多个时,还需要做负载均衡。

限流:当请求流量过高时,在网关中按照下流的微服务能够接受的速度来放行请求,避免服务压力过大。

在SpringCloud 中网关的实现包括两种:gateway、zuul

Zuul 是基于 Servlet 的实现,属于阻塞式编程。

而 SpringCloudGateway 则是基于 Spring5 中提供的 WebFlux,属于响应式编程的实现,具备更好的性能。

架构图

- 网关功能:1.身份认证和权限校验;2.服务路由、负载均衡;3.请求限流

8.2.gateway 快速入门

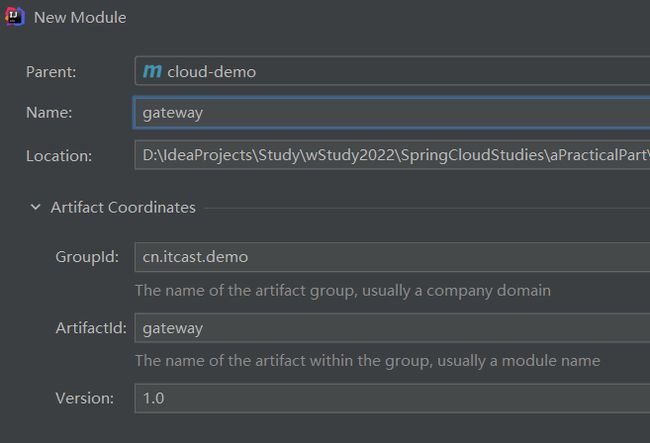

下面,我们就演示下网关的基本路由功能。

基本步骤

- 创建 SpringBoot 工程 gateway,引入网关依赖

- 编写启动类

- 编写基础配置和路由规则

- 启动网关服务进行测试

8.2.1.创建 gateway 服务,引入依赖

创建服务

引入依赖

gateway 服务下的 pom.xml 文件

<dependency>

<groupId>org.springframework.cloudgroupId>

<artifactId>spring-cloud-starter-gatewayartifactId>

dependency>

<dependency>

<groupId>com.alibaba.cloudgroupId>

<artifactId>spring-cloud-starter-alibaba-nacos-discoveryartifactId>

dependency>

8.2.2.编写启动类

gateway 服务下的 src/main/java/cn/itcast/gateway/GatewayApplication.java

package cn.itcast.gateway;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

@SpringBootApplication

public class GatewayApplication {

public static void main(String[] args) {

SpringApplication.run(GatewayApplication.class, args);

}

}

8.2.3.编写基础配置和路由规则

创建 application.yml 文件

server:

port: 10010 # 网关端口

spring:

application:

name: gateway # 服务名称

cloud:

nacos:

# 我这里依旧使用的是 Nacos 集群

# server-addr: localhost:8848 # nacos 地址

server-addr: localhost:80 # 之前设置的 nacos 的集群地址

gateway:

routes: # 网关路由配置

- id: user-service # 路由 id,自定义,只要唯一即可

# uri: http://127.0.0.1:8081 # 路由的目标地址 http 就是固定地址

uri: lb://userservice # 路由的目标地址 lb 就是负载均衡,后面跟服务名称

predicates: # 路由断言,也就是判断请求是否符合路由规则的条件

- Path=/user/** # 这个是按照路径匹配,只要以 /user/ 开头就符合要求

- id: order-service

uri: lb://orederservice

predicates:

- Path=/order/**

我们将符合 Path 规则的一切请求,都代理到 uri参数指定的地址。

本例中,我们将 /user/** 开头的请求,代理到 lb://userservice,

lb(loadBalance)是负载均衡,根据服务名拉取服务列表,实现负载均衡。

8.2.4.重启测试

重启网关,访问 http://localhost:10010/user/1 时,符合 /user/** 规则,

请求转发到 uri:http://userservice/user/1,得到了结果

这里需要注意的地方是:

第一点

确定自己使用的是 Nacos 单例环境还是 Nacos 集群环境,不同环境的服务下的配置文件都要进行内容的更改。

spring.cloud.nacos.server-addr: localhost:80 是之前配置的集群环境;

spring.cloud.nacos.server-addr: localhost:8848 是 Nacos 的默认地址,以单机方式启动:startup.cmd -m standalone。

第二点

如果访问 http://localhost:10010/order/101 时,报 503 错误的话,

请检查 order-servie 服务下的 application.yml,注释掉 spring.cloud.nacos.discovery.cluster-name,

从而确保所有服务都在一个集群环境里。

这两个坑我是一个不剩的全踩上去了。

8.2.5.网关路由的流程图

搭建网关服务

8.2.6.小结

网关搭建步骤

- 创建项目,引入 nacos 服务发现和 gateway 依赖

- 配置

application.yml,包括服务基本信息、nacos 地址、路由

路由配置

- 路由 id:路由的唯一标示

- 路由目标(uri):路由的目标地址,http 代表固定地址,lb 代表根据服务名负载均衡

- 路由断言(predicates):判断路由的规则,

- 路由过滤器(filters):对请求或响应做处理

接下来,就重点来学习路由断言和路由过滤器的详细知识。

8.3.断言工厂

路由断言工厂 Route Predicate Factory

predicates:路由断言,判断请求是否符合要求,符合则转发到路由目的地。

我们在配置文件中写的断言规则只是字符串,这些字符串会被 Predicate Factory 读取并处理,转变为路由判断的条件。

例如 Path=/user/** 是按照路径匹配,

这个规则是由 org.springframework.cloud.gateway.handler.predicate.PathRoutePredicateFactory 类来处理的。

像这样的断言工厂在 SpringCloudGateway 还有十几个。

| 名称 | 说明 | 示例 |

|---|---|---|

After |

是某个时间点后的请求 | - After=2037-01-20T17:42:47.789-07:00[America/Denver] |

Before |

是某个时间点之前的请求 | - Before=2031-04-13T15:14:47.433+08:00[Asia/Shanghai] |

Between |

是某两个时间点之前的请求 | - Between=2037-01-20T17:42:47.789-07:00[America/Denver], 2037-01-21T17:42:47.789-07:00[America/Denver] |

Cookie |

请求必须包含某些 cookie | - Cookie=chocolate, ch.p |

Header |

请求必须包含某些 header | - Header=X-Request-Id, \d+ |

Host |

请求必须是访问某个 host(域名) | - Host=**.somehost.org,**.anotherhost.org |

Method |

请求方式必须是指定方式 | - Method=GET,POST |

Path |

请求路径必须符合指定规则 | - Path=/red/{segment},/blue/** |

Query |

请求参数必须包含指定参数 | - Query=name, Jack 或者 - Query=name |

RemoteAddr |

请求者的 ip 必须是指定范围 | - RemoteAddr=192.168.1.1/24 |

Weight |

权重处理 |

我们只需要掌握 Path 这种路由工程就可以了。

详情还请见官网:https://docs.spring.io/spring-cloud-gateway/docs/current/reference/html/#gateway-request-predicates-factories

8.4.过滤器工厂

GatewayFilter 是网关中提供的一种过滤器,可以对进入网关的请求和微服务返回的响应做处理

8.4.1.路由过滤器的种类

Spring 提供了 31 种不同的路由过滤器工厂。

| 名称 | 说明 |

|---|---|

AddRequestHeader |

给当前请求添加一个请求头 |

RemoveRequestHeader |

移除请求中的一个请求头 |

AddResponseHeader |

给响应结果中添加一个响应头 |

RemoveResponseHeader |

从响应结果中移除有一个响应头 |

RequestRateLimiter |

限制请求的流量 |

| … … | … … |

具体情况还请浏览官网:https://docs.spring.io/spring-cloud-gateway/docs/current/reference/html/#gatewayfilter-factories

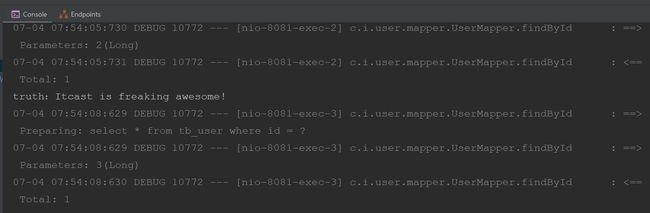

8.4.2.请求头过滤器

下面我们以 AddRequestHeader 为例来讲解。

- 案例需求:给所有进入

userservice的请求添加一个请求头:Truth=itcast is freaking awesome!

实现方式:在 gateway 服务修改的 application.yml 文件,给 userservice 的路由添加过滤器

spring:

cloud:

gateway:

routes:

- id: user-service

uri: lb://userservice

predicates:

- Path=/user/**

filters: # 过滤器

- AddRequestHeader=Truth, Itcast is freaking awesome! # 添加请求头

当前过滤器写在 userservice 路由下,因此仅仅对访问 userservice 的请求有效。

修改 userservice 服务下的 src/main/java/cn/itcast/user/web/UserController.java queryById 方法

@GetMapping("/{id}")

public User queryById(@PathVariable("id") Long id,

@RequestHeader(value = "Truth", required = false) String truth) {

System.out.println("truth:" + truth);

return userService.queryById(id);

}

向浏览器发送 Get 请求后:http://localhost:10010/user/3 的结果

8.4.3.默认过滤器

如果要对所有的路由都生效,则可以将过滤器工厂写到 default 下。格式如下:

gateway 下的 application.yml

spring:

cloud:

gateway:

routes:

- id: user-service

uri: lb://userservice

predicates:

- Path=/user/**

default-filters: # 默认过滤项

- AddRequestHeader=Truth, Itcast is freaking awesome!

8.4.4.小结

过滤器的作用是什么?

- 对路由的请求或响应做加工处理,比如添加请求头

- 配置在路由下的过滤器只对当前路由的请求生效

defaultFilters 的作用是什么?

- 对所有路由都生效的过滤器

8.5.全局过滤器

上一节学习的过滤器,网关提供了 31 种,但每一种过滤器的作用都是固定的。

如果我们希望拦截请求,做自己的业务逻辑则没办法实现。

8.5.1.全局过滤器作用

全局过滤器的作用也是处理一切进入网关的请求和微服务响应,与 GatewayFilter 的作用一样。

区别在于 GatewayFilter 通过配置定义,处理逻辑是固定的;

而 GlobalFilter 的逻辑需要自己写代码实现。

定义方式是实现 GlobalFilter 接口。

public interface GlobalFilter {

/**

* 处理当前请求,有必要的话通过 {@link GatewayFilterChain} 将请求交给下一个过滤器处理

*

* @param exchange 请求上下文,里面可以获取 Request、Response 等信息

* @param chain 用来把请求委托给下一个过滤器

* @return {@code Mono} 返回标示当前过滤器业务结束

*/

Mono<Void> filter(ServerWebExchange exchange, GatewayFilterChain chain);

}

在 filter 中编写自定义逻辑,可以实现下列功能:登录状态判断、权限校验、请求限流等

8.5.2.自定义全局过滤器

案例需求

- 定义全局过滤器,拦截请求,判断请求的参数是否满足下面条件:

- 参数中是否有 authorization,authorization 参数值是否为 admin

- 如果同时满足则放行,否则拦截

实现

在 gateway 中定义一个过滤器

src/main/java/cn/itcast/gateway/AuthorizeFilter.java

package cn.itcast.gateway;

import org.springframework.cloud.gateway.filter.GatewayFilterChain;

import org.springframework.cloud.gateway.filter.GlobalFilter;

import org.springframework.core.Ordered;

import org.springframework.core.annotation.Order;

import org.springframework.http.HttpStatus;

import org.springframework.http.server.reactive.ServerHttpRequest;

import org.springframework.stereotype.Component;

import org.springframework.util.MultiValueMap;

import org.springframework.web.server.ServerWebExchange;

import reactor.core.publisher.Mono;

//@Order(-1)//顺序注解

@Component

public class AuthorizeFilter implements GlobalFilter, Ordered {

@Override

public Mono<Void> filter(ServerWebExchange exchange, GatewayFilterChain chain) {

//1.获取请求参数

ServerHttpRequest request = exchange.getRequest();

MultiValueMap<String, String> params = request.getQueryParams();

//2.获取参数中的 authorization 参数

String auth = params.getFirst("authorization");

//3.判断参数值是否大于 admin

if ("admin".equals(auth)) {

//4.是。放行

return chain.filter(exchange);

}

//5.否。拦截

//5.1.设置状态码

exchange.getResponse().setStatusCode(HttpStatus.UNAUTHORIZED);

//5.2.拦截请求

return exchange.getResponse().setComplete();

}

@Override

public int getOrder() {

return -1;

}

}

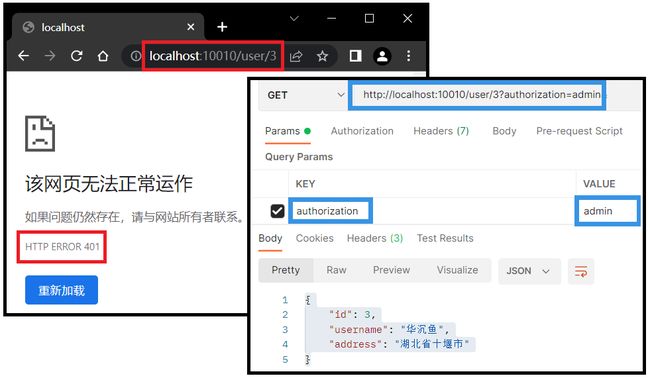

测试,查看结果

访问 http://localhost:10010/user/3 ,401 错误,获取不到数据。

访问 http://localhost:10010/user/1?authorization=admin,成功获取到数据信息。

8.5.3.过滤器执行顺序

请求进入网关会碰到三类过滤器:当前路由的过滤器、DefaultFilter、GlobalFilter

请求路由后,会将当前路由过滤器和 DefaultFilter、GlobalFilter,合并到一个过滤器链(集合)中,排序后依次执行每个过滤器:

排序的规则是什么呢?

- 每一个过滤器都必须指定一个 int 类型的 order 值,order值越小,优先级越高,执行顺序越靠前。

- GlobalFilter 通过实现 Ordered 接口,或者添加

@Order注解来指定 order 值,由我们自己指定 - 路由过滤器和 defaultFilter 的 order 由 Spring 指定,默认是按照声明顺序从 1 递增。

- 当过滤器的 order 值一样时,会按照

defaultFilter > 路由过滤器 > GlobalFilter的顺序执行。

可以参考一下几个类源码来查看

org.springframework.cloud.gateway.route.RouteDefinitionRouteLocator#getFilters()

- 该方法是先加载 defaultFilters,然后再加载某个 route 的 filters,然后合并。

org.springframework.cloud.gateway.handler.FilteringWebHandler#handle()

- 该方法会加载全局过滤器,与前面的过滤器合并后根据 order 排序,组织过滤器链

8.5.4.小结

全局过滤器的作用是什么?

- 对所有路由器都生效的过滤器,并且可以自定义处理逻辑

实现全局过滤器的步骤

- 实现 GlobalFilter 接口

- 添加

@Order注解或实现 Ordered 接口 - 编写处理逻辑

路由过滤器、defaultFilter、全局过滤器的执行顺序?

- order 值越小,优先级越高

- 当 order 值一样时,顺序是 defaultFilter 最先,然后是局部的路由过滤器,最后是全局过滤器

8.6.跨域问题

8.6.1.什么是跨域问题

跨域:域名不一致就是跨域

跨域主要包括:

- 域名不同:

www.taobao.com和www.taobao.org;www.jd.com和miaosha.jd.com - 域名相同,端口不同:

localhost:8080和localhost8081

跨域问题:浏览器禁止请求的发起者与服务端发生跨域 ajax 请求,请求被浏览器拦截的问题

解决方案:CORS(Cross-Origin Resource Sharing)

网络通信技术

CORS,全称 Cross-Origin Resource Sharing,是一种允许当前域(domain)的资源(比如 html/js/web service)被其他域(domain)的脚本请求访问的机制,通常由于同域安全策略(the same-origin security policy)浏览器会禁止这种跨域请求。(百度百科)

更多详情请见:https://www.ruanyifeng.com/blog/2016/04/cors.html

8.6.2.模拟跨域问题

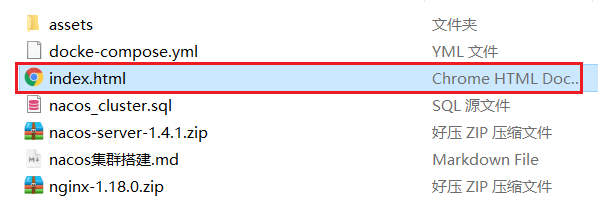

找到课前资料的页面文件

index.html 的内容

DOCTYPE html>

<html lang="en">

<head>

<meta charset="UTF-8">

<meta name="viewport" content="width=device-width, initial-scale=1.0">

<meta http-equiv="X-UA-Compatible" content="ie=edge">

<title>Documenttitle>

head>

<body>

<pre>

spring:

cloud:

gateway:

globalcors: # 全局的跨域处理

add-to-simple-url-handler-mapping: true # 解决 options 请求被拦截问题

corsConfigurations:

'[/**]':

allowedOrigins: # 允许哪些网站的跨域请求

- "http://localhost:8090"

- "http://www.leyou.com"

allowedMethods: # 允许的跨域 ajax 的请求方式

- "GET"

- "POST"

- "DELETE"

- "PUT"

- "OPTIONS"

allowedHeaders: "*" # 允许在请求中携带的头信息

allowCredentials: true # 是否允许携带 cookie

maxAge: 360000 # 这次跨域检测的有效期

pre>

body>

<script src="https://unpkg.com/axios/dist/axios.min.js">script>

<script>

axios.get("http://localhost:10010/user/1?authorization=admin")

.then(resp => console.log(resp.data))

.catch(err => console.log(err))

script>

html>

放入 tomcat 或者 nginx 这样的 web 服务器中,启动并访问。

我这里使用的是 VSCode 工具

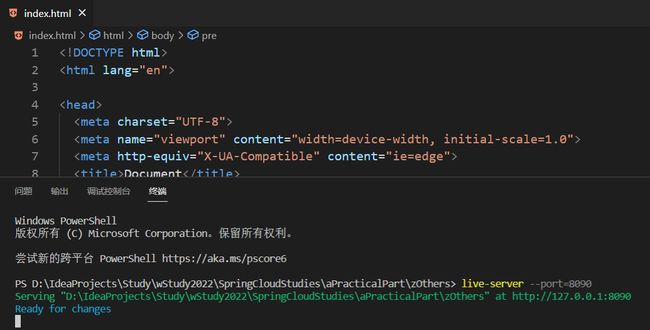

可以在浏览器控制台看到下面的错误

从 localhost:8090 访问 localhost:10010,端口不同,显然是跨域的请求。

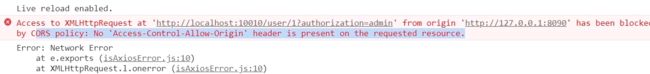

8.6.3.解决跨域问题

在 gateway 服务的 application.yml 文件中,添加下面的配置

spring:

cloud:

gateway:

# 。。。

globalcors: # 全局的跨域处理

add-to-simple-url-handler-mapping: true # 解决 options 请求被拦截问题

corsConfigurations:

'[/**]': # 拦截一切请求

allowedOrigins: # 允许哪些网站的跨域请求

- "http://localhost:8090"

allowedMethods: # 允许的跨域 ajax 的请求方式

- "GET"

- "POST"

- "DELETE"

- "PUT"

- "OPTIONS"

allowedHeaders: "*" # 允许在请求中携带的头信息

allowCredentials: true # 是否允许携带 cookie

maxAge: 360000 # 这次跨域检测的有效期

配置完成后重启网关服务

显然,成功获取到了数据。

# SpringCloudDay03

SpringCloud 学习 Day03(实用篇-3) Docker

- 初识 Docker

- Docker 的基本操作

- Dockerfile 自定义镜像

- Docker-Compose

- Docker 镜像服务

9.初始 Docker

9.1.什么是 Docker

微服务虽然具备各种各样的优势,但服务的拆分通用给部署带来了很大的麻烦。

- 分布式系统中,依赖的组件非常多,不同组件之间部署时往往会产生一些冲突。

- 在数百上千台服务中重复部署,环境不一定一致,会遇到各种问题

9.1.1.应用部署的环境问题

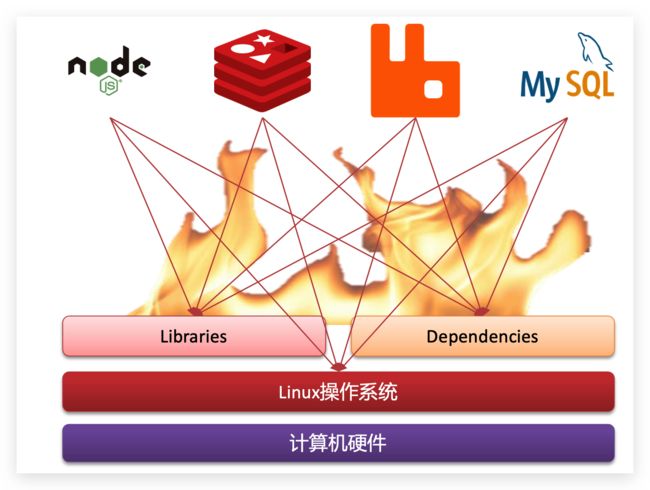

大型项目组件较多,运行环境也较为复杂,部署时会碰到一些问题:

- 依赖关系复杂,容易出现兼容性问题

- 开发、测试、生产环境有差异

例如一个项目中,部署时需要依赖于 node.js、Redis、RabbitMQ、MySQL 等,

这些服务部署时所需要的函数库、依赖项各不相同,甚至会有冲突。给部署带来了极大的困难。

9.1.2.Docker 解决依赖兼容问题

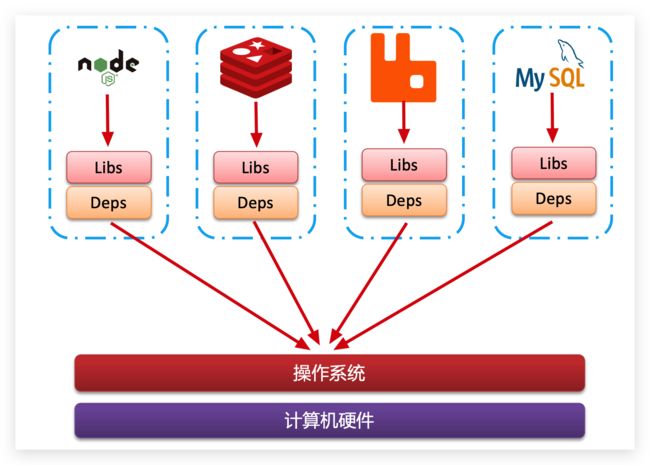

Docker 为了解决依赖的兼容问题的,采用了两个手段:

- 将应用的 Libs(函数库)、Deps(依赖)、配置与应用一起打包

- 将每个应用放到一个隔离容器去运行,避免互相干扰

这样打包好的应用包中,既包含应用本身,也保护应用所需要的 Libs、Deps,

无需再操作系统上安装这些,自然就不存在不同应用之间的兼容问题了。

虽然解决了不同应用的兼容问题,但是开发、测试等环境会存在差异,操作系统版本也会有差异,怎么解决这些问题呢?

9.1.3.Docker 解决操作系统环境差异

要解决不同操作系统环境差异问题,必须先了解操作系统结构。

以一个 Ubuntu 操作系统为例,结构如下:

结构包括:

- 计算机硬件:例如 CPU、内存、磁盘等

- 系统内核:所有 Linux 发行版的内核都是 Linux,例如 CentOS、Ubuntu、Fedora 等。

内核可以与计算机硬件交互,对外提供内核指令,用于操作计算机硬件。 - 系统应用:操作系统本身提供的应用、函数库。这些函数库是对内核指令的封装,使用更加方便。

应用于计算机交互的流程如下:

- 应用调用操作系统应用(函数库),实现各种功能

- 系统函数库是对内核指令集的封装,会调用内核指令

- 内核指令操作计算机硬件

Ubuntu 和 CentOS 都是基于 Linux 内核,无非是系统应用不同,提供的函数库有差异:

此时,如果将一个 Ubuntu 版本的 MySQL 应用安装到 CentOS 系统,

MySQL 在调用 Ubuntu 函数库时,会发现找不到或者不匹配,就会报错了:

Docker 如何解决不同系统环境的问题?

- Docker 将用户程序与所需要调用的系统(比如 Ubuntu)函数库一起打包

- Docker 运行到不同操作系统时,直接基于打包的函数库,借助于操作系统的 Linux 内核来运行

如图:

9.1.4.小结

Docker 如何解决大型项目依赖关系复杂,不同组件依赖的兼容性问题?

- Docker 允许开发中将应用、依赖、函数库、配置一起打包,形成可移植镜像

- Docker 应用运行在容器中,使用沙箱机制,相互隔离

Docker 如何解决开发、测试、生产环境有差异的问题?

- Docker 镜像中包含完整运行环境,包括系统函数库,仅依赖系统的 Linux 内核,因此可以在任意 Linux 操作系统上运行

Docker 是一个快速交付应用、运行应用的技术

- 可以将程序及其依赖、运行环境一起打包为一个镜像,可以迁移到任意 Linux 操作系统

- 运行时利用沙箱机制形成隔离容器,各个应用互不干扰

- 启动、移除都可以通过一行命令完成,方便快捷

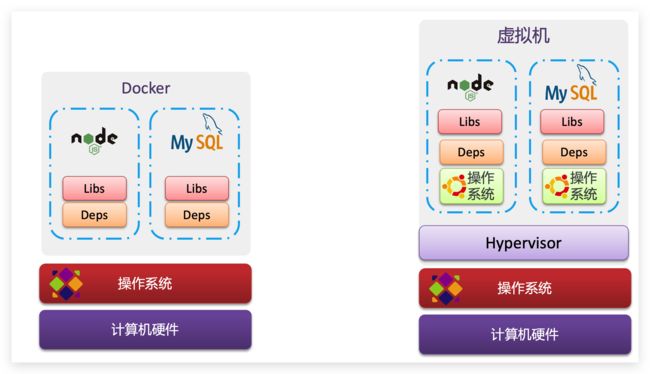

9.2.Docker 和虚拟机的区别

Docker 可以让一个应用在任何操作系统中非常方便的运行。

而以前我们接触的虚拟机,也能在一个操作系统中,运行另外一个操作系统,保护系统中的任何应用。

两者有什么差异呢?

虚拟机(virtual machine)是在操作系统中模拟硬件设备,然后运行另一个操作系统,

比如在 Windows 系统里面运行 Ubuntu 系统,这样就可以运行任意的 Ubuntu 应用了。

Docker 仅仅是封装函数库,并没有模拟完整的操作系统。

对比来看的话

| 特性 | Docker |

虚拟机 |

|---|---|---|

| 性能 | 接近原生 | 性能较差 |

| 硬盘占用 | 一般为 MB | 一般为 GB |

| 启动 | 秒级 | 分钟级 |

小结

Docker 和虚拟机的差异:

- docker 是一个 系统进程;虚拟机是在操作系统中的操作系统

- docker 体积小、启动速度快、性能好;虚拟机体积大、启动速度慢、性能一般

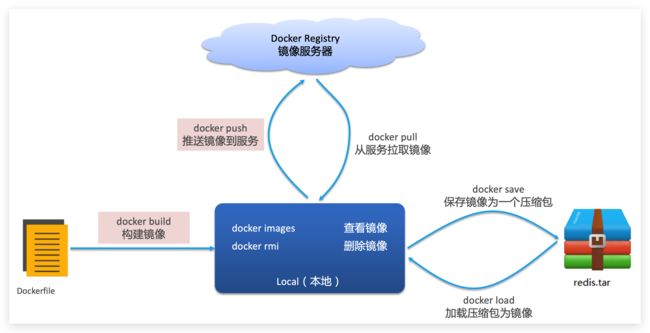

9.3.Docker 架构

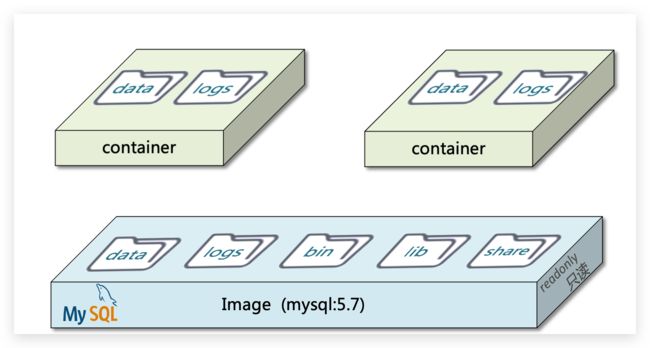

9.3.1.镜像和容器

镜像(Image):Docker 将应用程序及其所需的依赖、函数库、环境、配置等文件打包在一起,称为镜像。

容器(Container):镜像中的应用程序运行后形成的进程就是容器,只是 Docker 会给容器进程做隔离,对外不可见。

一切应用最终都是代码组成,都是硬盘中的一个个的字节形成的文件。只有运行时,才会加载到内存,形成进程。

而镜像,就是把一个应用在硬盘上的文件、及其运行环境、部分系统函数库文件一起打包形成的文件包。这个文件包是只读的。

容器呢,就是将这些文件中编写的程序、函数加载到内存中允许,形成进程,只不过要隔离起来。

因此一个镜像可以启动多次,形成多个容器进程。

例如你下载了一个 QQ,如果我们将 QQ 在磁盘上的运行文件及其运行的操作系统依赖打包,形成 QQ 镜像。

然后你可以启动多次,双开、甚至三开 QQ,跟多个妹子聊天。

9.3.2.DockerHub

开源应用程序非常多,打包这些应用往往是重复的劳动。

为了避免这些重复劳动,人们就会将自己打包的应用镜像,

例如 Redis、MySQL 镜像放到网络上,共享使用,就像 GitHub 的代码共享一样。

- DockerHub:DockerHub 是一个官方的 Docker 镜像的托管平台。这样的平台称为 Docker Registry。

- 国内也有类似于 DockerHub 的公开服务,比如 网易云镜像服务、阿里云镜像库 等。

我们一方面可以将自己的镜像共享到 DockerHub,另一方面也可以从 DockerHub 拉取镜像:

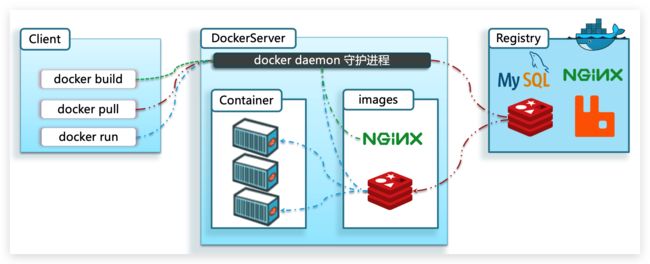

9.3.3.Docker 架构

我们要使用 Docker 来操作镜像、容器,就必须要安装 Docker。

Docker 是一个 CS 架构的程序,由两部分组成:

- 服务端(server):Docker 守护进程,负责处理 Docker 指令,管理镜像、容器等

- 客户端(client):通过命令或 RestAPI 向 Docker 服务端发送指令。可以在本地或远程向服务端发送指令。

9.3.4.小结

镜像

- 将应用程序及其依赖、环境、配置打包在一起

容器

- 镜像运行起来就是容器,一个镜像可以运行多个容器

Docker 结构

- 服务端:接收命令或远程请求,操作镜像或容器

- 客户端:发送命令或者请求到 Docker 服务端

DockerHub

- 一个镜像托管的服务器,类似的还有阿里云镜像服务,统称为 DockerRegistry

9.4.安装启动配置 Docker

9.4.1.相关说明

企业部署一般都是采用 Linux 操作系统,而其中又数 CentOS 发行版占比最多,因此我们在 CentOS 下安装 Docker。

- 版本信息

Docker 分为 CE 和 EE 两大版本。

CE 即社区版(免费,支持周期 7 个月),EE 即企业版,强调安全,付费使用,支持周期 24 个月。

Docker CE 分为 stable、test 和 nightly 三个更新频道。

- 硬件要求

官方网站上有各种环境下的 安装指南,这里主要介绍 Docker CE 在 CentOS 上的安装。

Docker CE 支持 64 位版本 CentOS 7,并且要求内核版本不低于 3.10。

CentOS 7 满足最低内核的要求,所以我们在 CentOS 7 安装 Docker。

- 关于在虚拟机中安装 CentOS7 的操作,可以参考我之前写的博客:【Centos7 的下载安装及之后的基本操作】

- 有关 Linux 系统的一些基础知识,则可以参考我之前写的博客:【瑞吉外卖⑩ | Linux 粗略学习 & Redis 粗略学习】

9.4.2.卸载之前安装过的 Docker

如果之前安装过旧版本的 Docker,可以使用下面命令卸载

yum remove docker \

docker-client \

docker-client-latest \

docker-common \

docker-latest \

docker-latest-logrotate \

docker-logrotate \

docker-selinux \

docker-engine-selinux \

docker-engine \

docker-ce

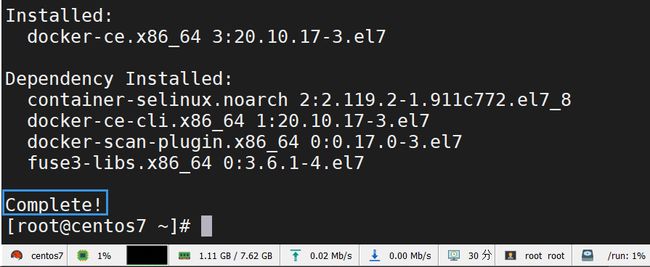

9.4.3.具体的安装操作

- 首先要确保虚拟机可以联网,安装 yum 工具

安装必需的软件包, yum-util 提供 yum-config-manager 功能,另外两个是 devicemapper 驱动依赖的

yum install -y yum-utils \

device-mapper-persistent-data \

lvm2 --skip-broken

- 然后更新本地镜像源

设置 docker 镜像源

yum-config-manager \

--add-repo \

https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

sed -i 's/download.docker.com/mirrors.aliyun.com\/docker-ce/g' /etc/yum.repos.d/docker-ce.repo

将软件包信息提前在本地索引缓存(旨在可以提高搜索安装软件的速度。执行这个命令可以提升 yum 安装的速度)

yum makecache fast

- 安装 Docker

yum install -y docker-ce

docker-ce 为社区免费版本。稍等片刻,docker 即可安装成功。

这里我使用的远程控制工具是 Mobaxterm,视频中使用的是 FinalShell

使用以下命令查看安装的 Docker 版本

docker -v

9.5.启动 Docker

- 关闭防火墙

- Docker 进程相关命令

- 配置镜像

- Docker 应用需要用到各种端口,逐一去修改防火墙设置。非常麻烦,因此建议直接关闭防火墙!

关闭防火墙

systemctl stop firewalld

禁止开机自启动防火墙

systemctl disable firewalld

- Docker 进程相关命令

启动 Docker 服务

systemctl start docker

查看 Docker 服务状态

systemctl status docker

关闭 Docker 服务

systemctl stop docker

重启 Docker 服务

systemctl restart docker

开机自启动 Docker 服务

systemctl enable docker

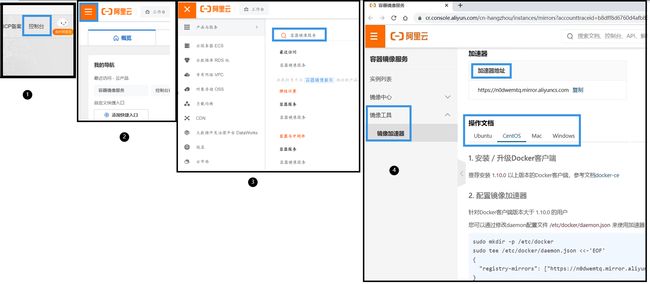

- 配置镜像

docker 官方镜像仓库网速较差,我们需要设置国内镜像服务,这里我们选用阿里云镜像服务。

可以直接参考阿里云的镜像加速文档:https://cr.console.aliyun.com/cn-hangzhou/instances/mirrors

或者使用账号登录阿里云,点击 “控制台“,然后点击 “三” 在搜索栏中输入 “容器镜像服务”。

最后点击 “镜像工具” 的 “镜像加速器” 就可以看到 “加速器地址”。

在其下方的操作文档里,有非常详细的操作文档,我们将其文档上的内容复制直接到 Linux 系统的终端即可。

我们也可以使用以下命令来查看阿里云地址是否写入文件中

cat /etc/docker/daemon.json

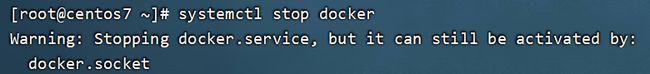

9.6.卸载 Docker

卸载 docker 前,务必要先关掉 docker 服务

systemctl stop docker

yum remove docker-ce docker-ce-cli containerd.io

清理 docker 默认在 /var/lib 目录下配置的数据

rm -rf /var/lib/docker

rm -rf /var/lib/containerd

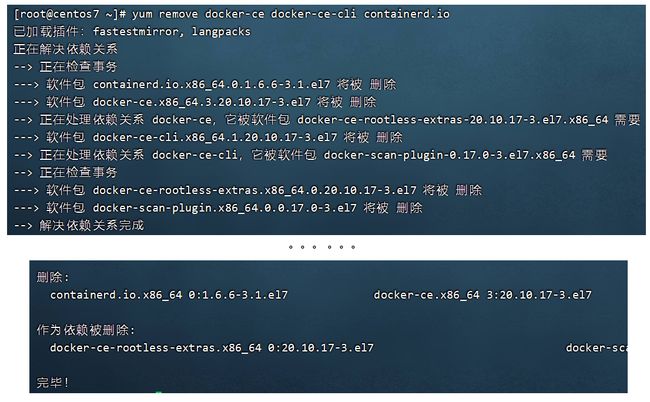

10.Docker 的基本操作

10.1.镜像操作

10.1.1.镜像名称

首先来看下镜像的名称组成

- 镜名称一般分两部分组成:

[repository]:[tag]。 - 在没有指定 tag 时,默认是 latest,代表最新版本的镜像

这里的 mysql 就是 repository,5.7 就是 tag,合一起就是镜像名称,代表 5.7 版本的 MySQL 镜像。

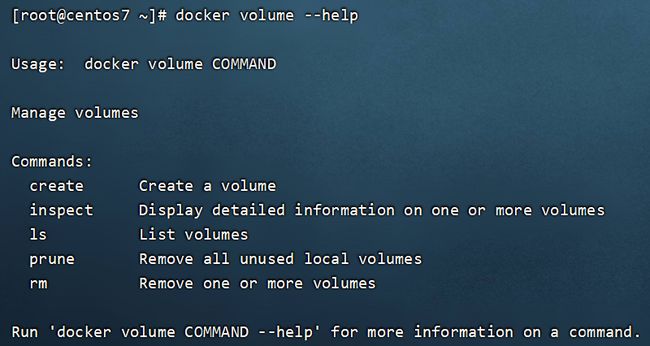

10.1.2.镜像命令

常见的镜像操作命令如图

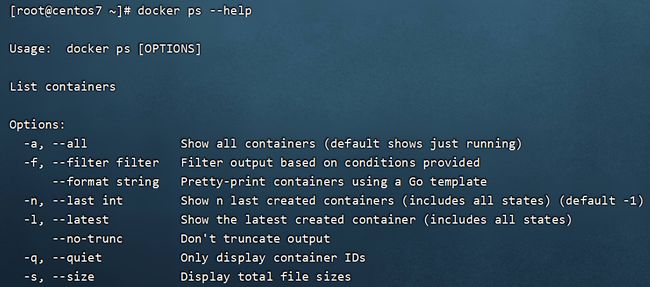

Docker 的命令很多,我们不需要全记住。

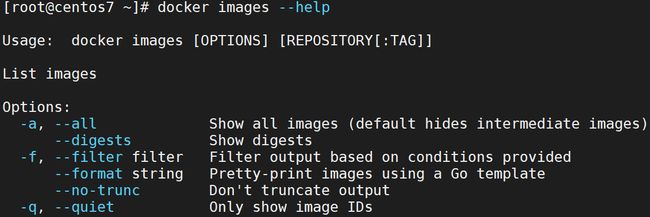

使用 docker --help 查看帮助文档即可。使用 docker xx --help 可以查看 xx 相关命令的帮助文档。

比如我想查看镜像的相关命令,输入 docker images --help 即可。

docker images --help

10.1.3.案例1(拉取、查看镜像)

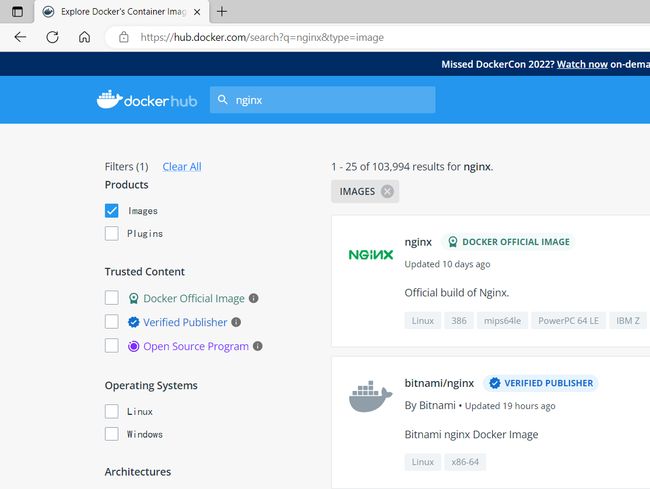

需求:从 DockerHub 中拉取一个 nginx 镜像并查看

- 首先去镜像仓库搜索 nginx 镜像,比如 DockerHub。

相关链接:

https://hub.docker.com/search?q=nginx&type=image

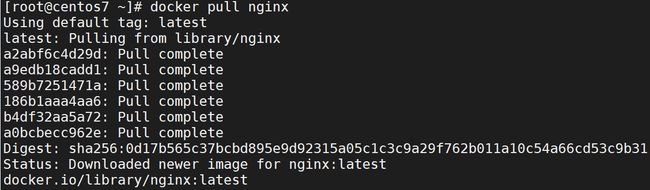

- 根据查看到的镜像名称,通过命令

docker pull nginx拉取自己需要的镜像

docker pull nginx

- 通过命令

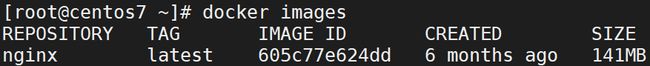

docker images查看拉取到的镜像

docker images

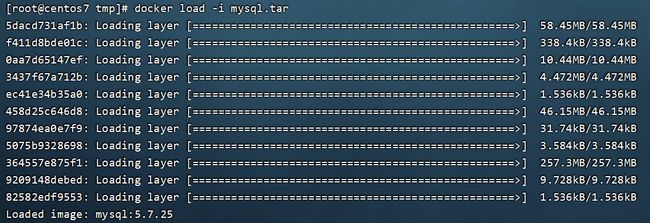

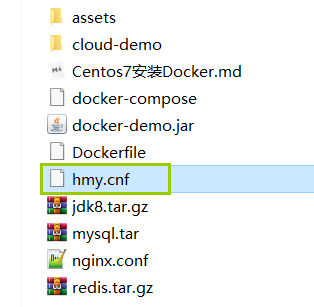

10.1.4.案例2(保存、导入镜像)

需求:利用 docker save 将 nginx 镜像导出磁盘,然后再通过 load 加载回来

- 利用

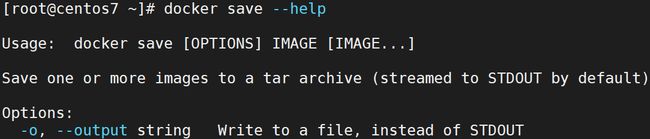

docker xx --help命令查看docker save和docker load的语法

例如,查看 save 命令用法,可以输入命令:docker save --help

docker save --help

- 使用

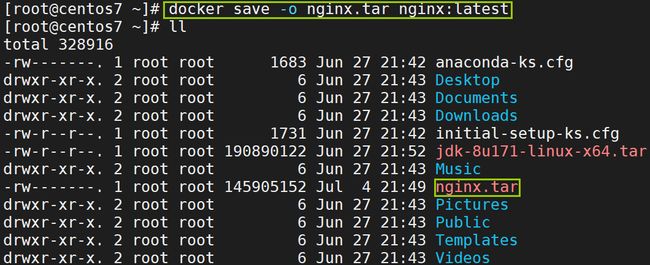

docker save导出镜像到磁盘

由上图易知命令 docker save 的完整格式 docker save -o [保存的目标文件名称] [镜像名称]

docker save -o nginx.tar nginx:latest

- 使用

docker load加载镜像

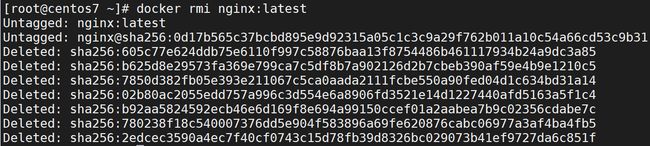

先删除本地的 nginx 镜像

docker rmi nginx:latest

之后我们通过 docket images 发现镜像已经成功被删除。

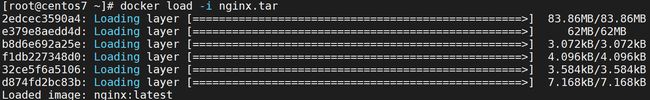

最后再运行命令 docker load -i nginx.tar,加载本地文件

docker load -i nginx.tar

10.1.5.练习案例

部分 Docker 镜像操作命令

docker images (查看镜像)、docker rmi(删除镜像)

docker pull(拉取镜像)、docker push(将本地的镜像上传到镜像仓库)

docker save (保存镜像为一个压缩包)、docker load(加载压缩包成为镜像)

docker search [镜像名称](从网络中查找需要的镜像)

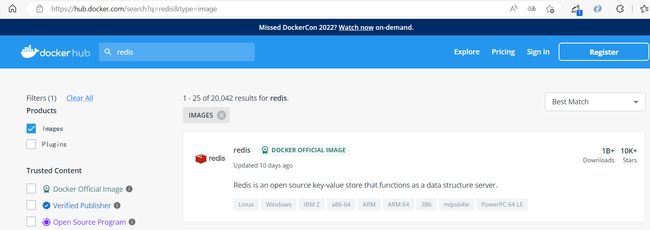

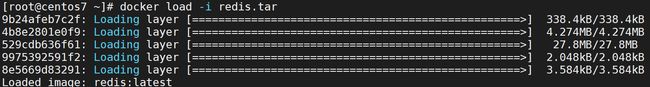

练习案例-需求:去 DockerHub 搜索并拉取一个 Redis 镜像

练习案例-目标:

- 去 DockerHub 搜索 Redis 镜像

- 查看 Redis 镜像的名称和版本

- 利用

docker pull命令拉取镜像 - 利用

docker save命令将redis:latest打包为一个redis.tar包 - 利用

docker rmi删除本地的redis:latest - 利用

docker load重新加载redis.tar文件

练习案例-实际操作:

- 去 DockerHub 搜索 Redis 镜像

相关链接:

https://hub.docker.com/search?q=redis&type=image

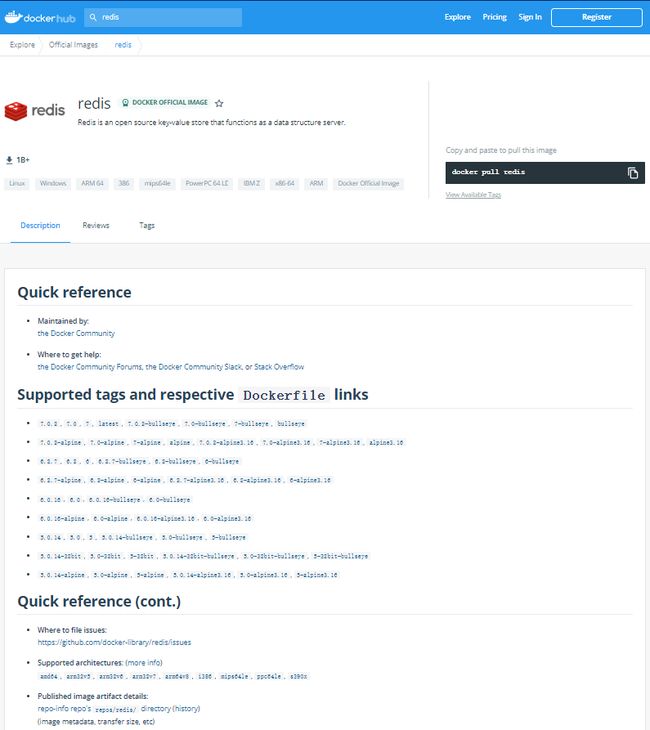

- 查看 Redis 镜像的名称和版本

相关链接:

https://hub.docker.com/_/redis

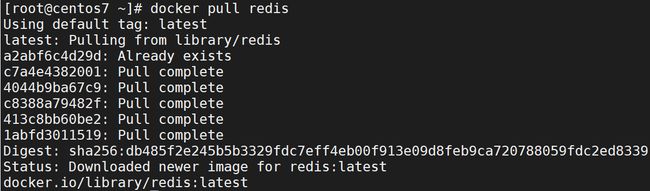

- 利用

docker pull命令拉取镜像

docker pull redis

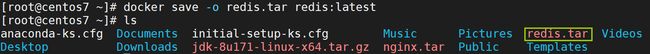

- 利用

docker save命令将redis:latest打包为一个redis.tar包

docker save -o redis.tar redis:latest

- 利用

docker rmi删除本地的redis:latest

docker rmi redis:latest

- 利用

docker load重新加载redis.tar文件

docker load -i redis.tar

10.2.容器操作

10.2.1.容器相关命令

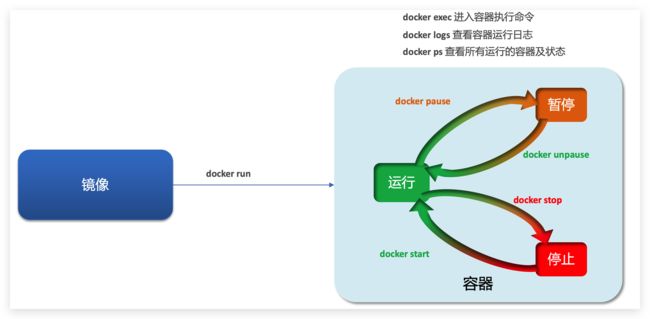

容器操作的命令如图

容器保护三个状态

- 运行:进程正常运行

- 暂停:进程暂停,CPU 不再运行,并不释放内存

- 停止:进程终止,回收进程占用的内存、CPU 等资源

其中:

docker run:创建并运行一个容器,处于运行状态docker pause:让一个运行的容器暂停docker unpause:让一个容器从暂停状态恢复运行docker stop:停止一个运行的容器docker start:让一个停止的容器再次运行docker rm:删除一个容器

10.2.2.案例1(创建并运行一个容器)

去 DockerHub 上查看 Nignx 的容器的运行命令:https://hub.docker.com/search?q=nginx

在 https://hub.docker.com/_/nginx 下的页面的 description 中发现了一个命令

创建并运行容器的命令

docker run --name containerName -p 80:80 -d nginx

命令解读:

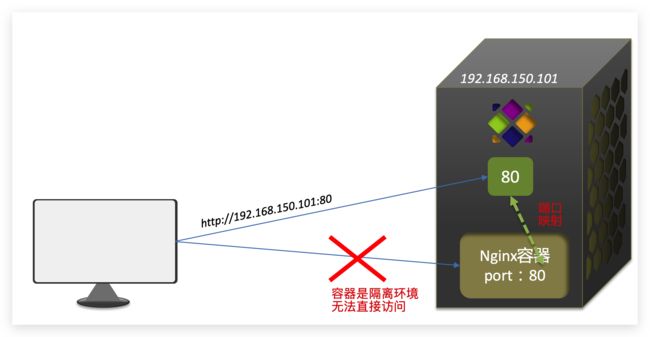

docker run:创建并运行一个容器--name: 给容器起一个名字,比如叫做 mn-p:将宿主机端口与容器端口映射,冒号左侧是宿主机端口,右侧是容器端口-d:后台运行容器nginx:镜像名称,例如 nginx

这里的 -p 参数,是将容器端口映射到宿主机端口。

默认情况下,容器是隔离环境,我们直接访问宿主机的 80 端口,肯定访问不到容器中的 nginx。

现在,将容器的 80 与宿主机的 80 关联起来,当我们访问宿主机的 80 端口时,就会被映射到容器的 80,这样就能访问到 nginx 了:

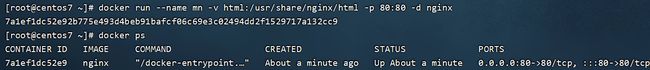

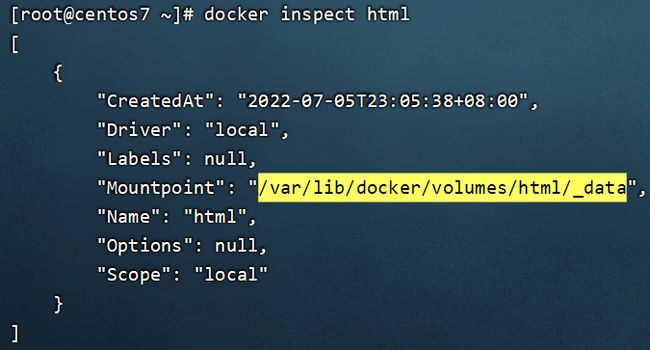

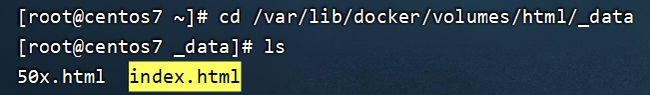

具体操作

创建并运行 nginx 容器。成功后,控制台显示容器唯一 id

docker run --name mn -p 80:80 -d nginx

查看所有运行的容器即状态 (因为我的 MobaXterm 的输出格式有点小问题,故这里使用 FinalShell)

docker ps

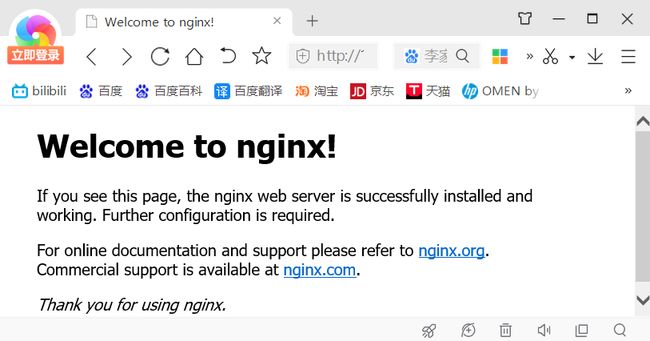

输入 虚拟机的IP地址,可以访问到 Nginx 的欢迎页面(因为之前设置的宿主机映射端口都是 80)

如果之前设置的宿主机端口是 8080 ,则需要输入 虚拟机IP地址:8080 才可以访问的到

查看容器日志:docker logs containerName

docker logs mn

动态跟踪日志,可以实时查看容器日志信息:docker logs -f containerName

docker logs -f mn

欲获得更多的有关容器日志的信息,输入 docker logs --help 即可

docker logs --help

![]()

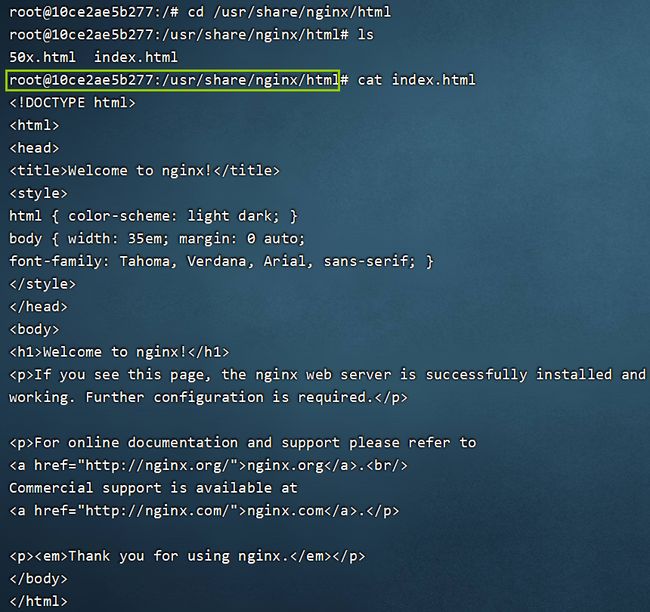

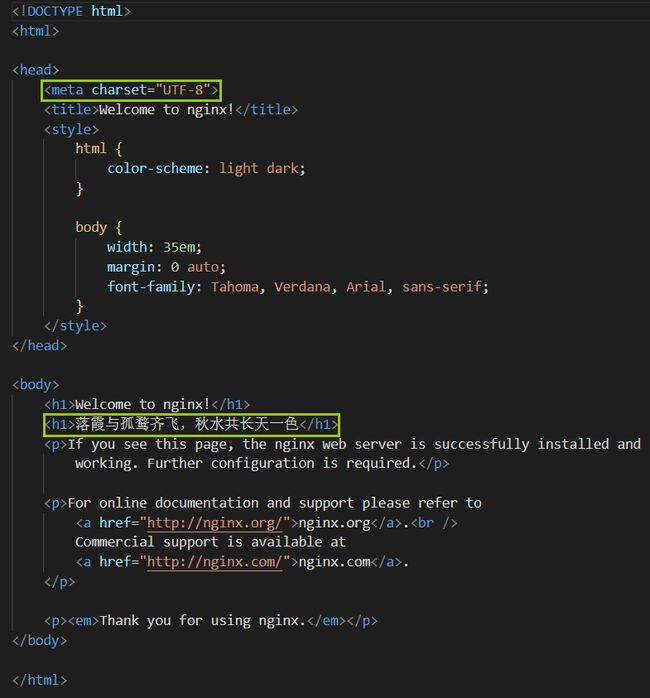

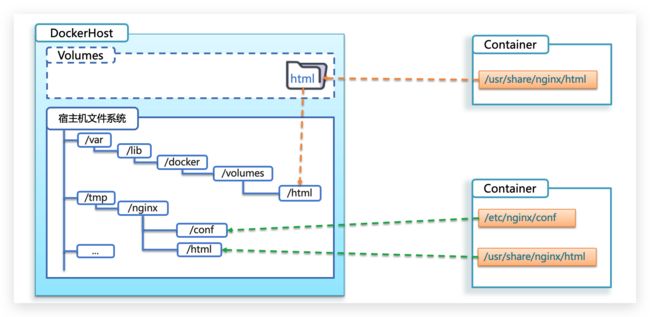

10.2.3.案例2(进入容器,修改文件)

需求:进入 Nginx 容器,修改 HTML 文件内容,添加 “stand power”。

提示:进入容器要用到 docker exec 命令。

操作步骤

- 进入容器。进入我们刚刚创建的 nginx 容器的命令为:

docker exec -it containerName bash

docker exec -it mn bash

命令解读

docker exec:进入容器内部,执行一个命令-it: 给当前进入的容器创建一个标准输入、输出终端,允许我们与容器交互mn:要进入的容器的名称bash:进入容器后执行的命令,bash 是一个 linux 终端交互命令

- 进入 nginx 的 HTML 所在目录

/usr/share/nginx/html

容器内部会模拟一个独立的 Linux 文件系统,看起来如同一个 linux 服务器一样

nginx 的环境、配置、运行文件全部都在这个文件系统中,包括我们要修改的 html 文件。

可以看作是 Linux 的阉割版,容器内部只有 Nginx 运行需要的东西。

前往 https://hub.docker.com/_/nginx?tab=description 页面

我们可以找到设置静态页面的方法。其中我们可以找到静态页面的位置。

![]()

当然,你也可以使用命令:find / -name containerName

find / -name nginx

找到 index.html 的位置后,就输入命令 cd /usr/local/nginx/html 进入目录。

- 修改

index.html的内容

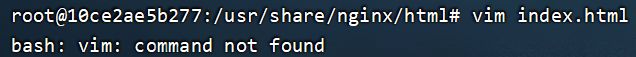

Nginx 容器内没有 vim 命令,无法直接修改(也没有 vi 命令)

我们用其他命令来修改

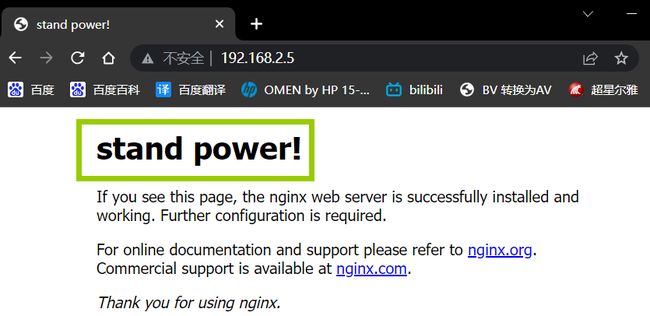

sed -i -e 's#Welcome to nginx#stand power#g' -e 's###g' index.html

sed 全名为 stream editor,流编辑器。

sed -i命令的具体情况可见博客:《sed -i命令详解》

在浏览器访问自己的虚拟机地址,例如我的是:http://192.168.2.5,即可看到结果

- 退出并关闭容器

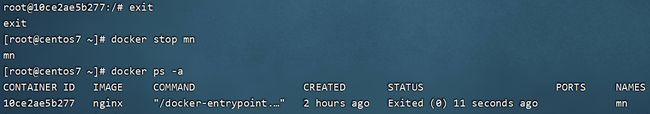

关闭容器的命令:docker stop containerName

docker stop mn

显示所有容器状态(包括停止运行的容器)

docker ps -a

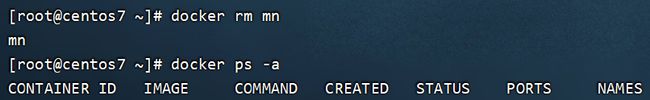

删除容器的命令:docker rm containerName

docker rm mn

关于以上的这些命令,都可以通过 docker xxx --help 来查看。希望诸位善用 --help

查看 docker ps 的帮助文档

docker ps --help

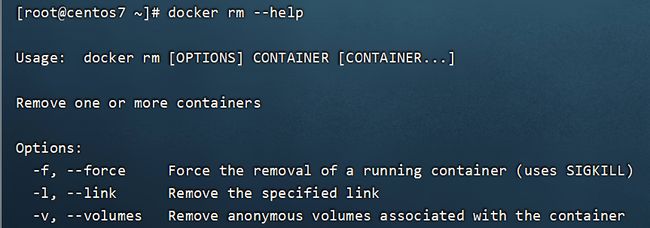

强制删除正在运行的容器:docker rm -f containerName

dokcer rm -f

欲知更多详情还请使用命令:docker rm --help

docker rm --help

10.2.4.练习案例

案例需求:

- 创建并允许一个 redis 容器,并且支持数据持久化

- 进入 redis 容器,并且执行

redis-cli客户端命令,存入num=666

操作步骤

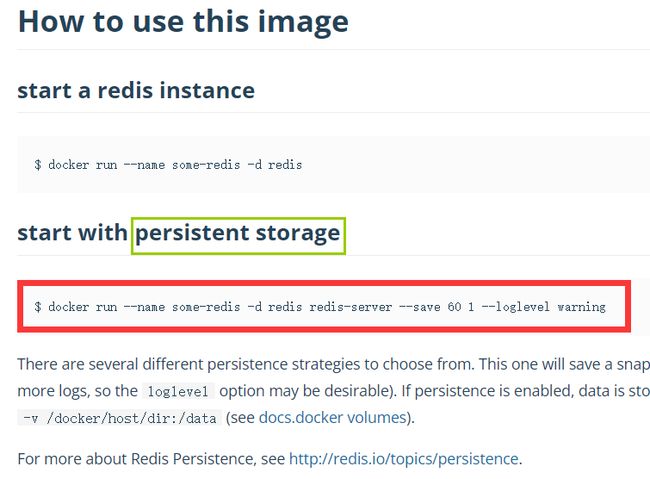

- 步骤一:到 DockerHub 搜索 Redis 镜像

- 步骤二:查看 Redis 镜像文档中的帮助信息

- 步骤三:利用

docker run命令运行一个 Redis 容器 - 步骤四:进入 redis 容器,并且执行

redis-cli客户端命令,存入num=666

具体操作

- 到 DockerHub 搜索 Redis 镜像

https://hub.docker.com/search?q=redis、https://hub.docker.com/_/redis?tab=description

- 查看 Redis 镜像文档中的帮助信息

docker run --name some-redis -d redis redis-server --save 60 1 --loglevel warning

- 利用

docker run命令运行一个 Redis 容器

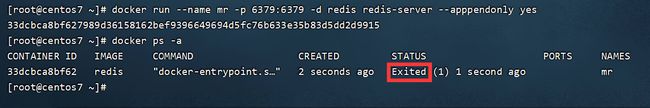

视频中给出的命令,与官网给出的命令约有不同,应该是官网命令更新过了。

使用视频中给出的命令,启动失败(视频发布时间是 2021-8-11)

docker run --name mr -p 6379:6379 -d redis redis-server --apppendonly yes

使用官网给出的新命令。启动成功。(访问时间是 2022-07-05)

docker run --name mr -p 6379:6379 -d redis redis-server --save 60 1 --loglevel warning

- 我这里使用的是图形化界面工具是:

Redis Desketop Manager- 源码仓库地址:https://github.com/uglide/RedisDesktopManager

- 安装包仓库地址:https://github.com/lework/RedisDesktopManager-Windows/releases

连接成功!

![]()

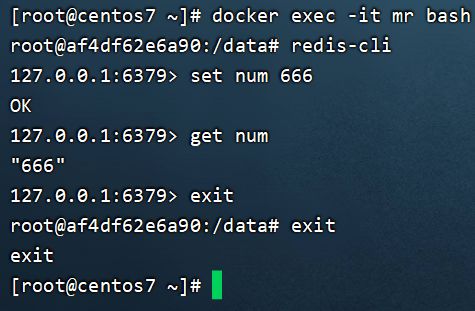

- 进入 redis 容器,并且执行

redis-cli客户端命令,存入num=666

进入 Redis 容器内部

docker -it mr bash

打开 redis-cli 客户端

redis-cli

设置指定 key 的值(string)

set num 666

获取指定 key 的值(string)

get num

当然,我们也可以直接进入 redis-cli 客户端

10.2.5.小结

docker run 命令的常见参数有哪些?

--name:指定容器名称-p:指定端口映射-d:让容器后台运行

查看容器日志的命令

docker logs- 添加

-f参数可以持续查看日志

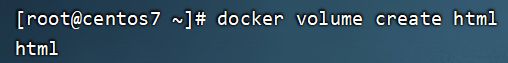

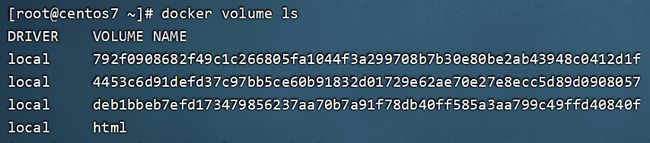

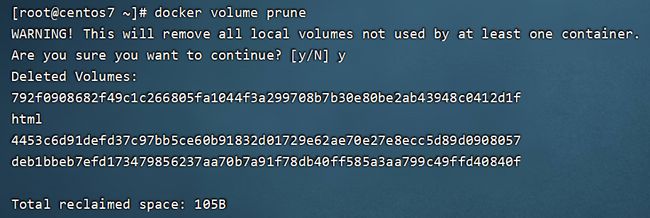

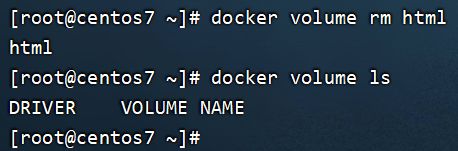

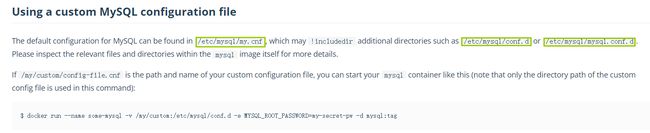

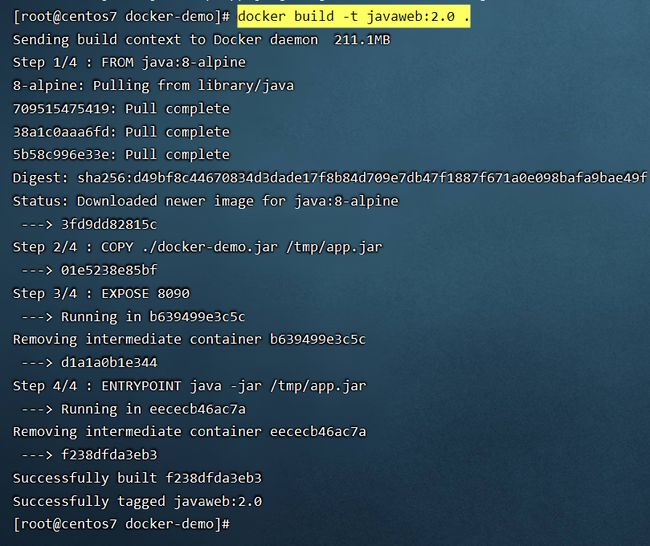

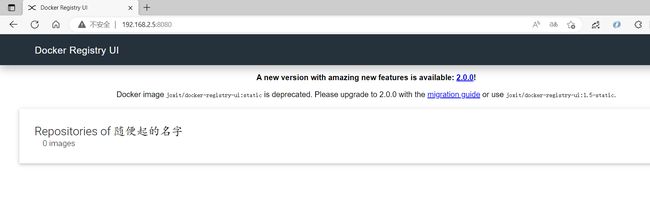

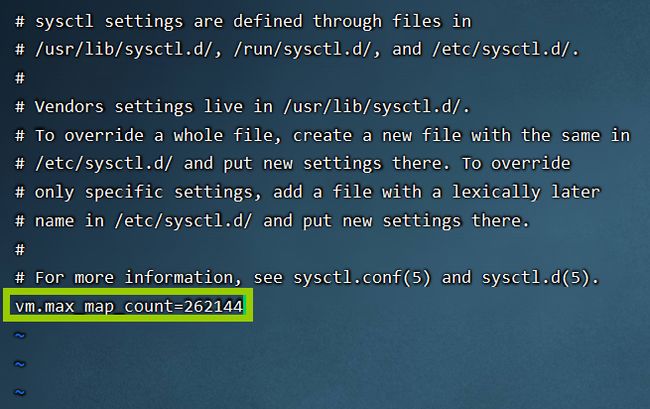

查看容器状态