理解 R-CNN:目标检测的一场革命

一、介绍

对象检测是一项基本的计算机视觉任务,涉及定位和识别图像或视频中的对象。多年来,人们开发了多种方法来应对这一挑战,但基于区域的卷积神经网络(R-CNN)的发展标志着目标检测领域的重大突破。R-CNN 及其后续变体彻底改变了我们检测和定位对象的方式,从而在自动驾驶车辆、机器人和图像分析等应用领域取得了重大进步。在本文中,我们将探讨 R-CNN 的演变、其关键组件及其对计算机视觉领域的影响。

理解 R-CNN:对象检测的革命是我们揭示视觉世界中隐藏维度的镜头,使曾经模糊的东西变得清晰。它提醒我们,创新是指引我们走向更光明、更准确、更安全的未来的灯塔。

二、物体检测的演变

在 R-CNN 出现之前,目标检测主要依赖于传统的计算机视觉技术,例如 Haar 级联和定向梯度直方图 (HOG)。这些方法在准确性、稳健性和效率方面存在局限性。相比之下,卷积神经网络(CNN)在图像分析任务中表现出了巨大的前景,从而促进了基于深度学习的目标检测方法的发展。

三. R-CNN 的诞生

Ross Girshick 在 2013 年提出了 R-CNN 框架,它代表基于区域的卷积神经网络。R-CNN 采用了一种完全不同的方法,将区域提案的选择性搜索与用于对象分类的 CNN 结合起来。R-CNN方法的关键步骤如下:

- 区域提案:选择性搜索用于生成一组可能包含对象的区域提案。这些区域被从图像中提取出来并视为潜在的对象。

- 特征提取:然后将每个区域提案调整为固定大小,并通过预训练的 CNN 来提取该区域的固定长度特征向量。

- 对象分类:提取的特征被输入到单独的分类器中以进行对象检测。就原始 R-CNN 而言,这通常是支持向量机 (SVM)。

- 微调:用于特征提取的CNN通常是像AlexNet或VGG这样的预训练模型,在目标检测任务上进行微调以提高性能。

四.R-CNN 的影响

R-CNN 的引入改变了目标检测领域的游戏规则,原因如下:

- 提高准确性:与传统方法相比,R-CNN 显着提高了目标检测准确性,在基准数据集上取得了最先进的结果。

- 定位:R-CNN 不仅可以识别目标,还可以提供准确的边界框定位,使其适合需要精确目标检测的应用。

- 端到端学习: R-CNN 为目标检测中的端到端学习铺平了道路。通过在检测任务上对 CNN 进行微调,整个过程变得更加精简和优化。

五.限制和变体

尽管取得了成功,但 R-CNN 仍然存在一些局限性,主要是由于区域提案的独立处理而导致速度和内存消耗方面。为了解决这些问题,开发了 R-CNN 的几种变体:

- Fast R-CNN:2015 年,Fast R-CNN 被引入,它在所有区域提议中共享 CNN 特征,使得该过程显着更快且内存效率更高。

- Faster R-CNN:Faster R-CNN(2015)在 Fast R-CNN 的基础上引入了区域提议网络(RPN),可以学习生成区域提议,进一步提高速度和准确性。

- Mask R-CNN: 2017 年,Mask R-CNN 扩展了 R-CNN,还可以执行实例分割,使其能够同时检测和分割图像中的对象。

六、代码

在 Python 中从头开始实现 R-CNN(基于区域的卷积神经网络)是一项复杂的任务,涉及多个步骤。为了简单起见,下面我将提供一个使用 scikit-learn 库的 R-CNN 的简化示例。请记住,对于实际应用,您应该使用 TensorFlow 或 PyTorch 等深度学习框架来执行特征提取和对象检测任务。

本示例将重点介绍 R-CNN 的基本概念和步骤,而不是完整的端到端解决方案。完整的实现通常涉及使用预先训练的 CNN 模型进行特征提取、微调和其他优化。

import cv2

import numpy as np

from sklearn.svm import SVC

from sklearn.preprocessing import StandardScaler

from sklearn.model_selection import train_test_split

from sklearn.metrics import precision_score

# 包含图像和注释的样本数据集

# 将其替换为实际数据集和注释

image_paths = [ " image1.jpg" , "image2.jpg" , "image3.jpg" ]

边界框 = [[ 10 , 20 , 100 , 150 ], [ 30 , 40 , 120 , 180 ], [ 15 , 25 , 110 , 160 ]]

class_labels = [ 0 , 1 , 0 ]

# 提取特征(这里应该使用预先训练的 CNN)

def extract_features ( image_path ):

image = cv2.imread(image_path)

features = np.random.rand( 4096 ) # 的占位符特征提取

return features

# 提取所有图像的特征

features_list = [extract_features(image_path) for image_path in image_paths]

# 将数据集拆分为训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(features_list, class_labels, test_size= 0.2 , random_state = 42 )

# 缩放特征

scaler = StandardScaler()

X_train = scaler.fit_transform(X_train)

X_test = scaler.transform(X_test)

# 训练分类器(本例中为SVM)

classifier = SVC()

classifier.fit(X_train, y_train )

# 对测试集进行预测

y_pred = classifier.predict(X_test)

# 打印模型详细信息

print (classifier.class_weight)

# 评估模型

precision = precision_score(y_test, y_pred)

print ( "Accuracy:" , precision)在这个简化的例子中:

- 我们有一个包含三个图像、它们的边界框和类标签(0 或 1)的示例数据集。

- 我们为每个图像提取特征(在本例中为占位符)。在实践中,您应该使用预先训练的 CNN 来提取有意义的特征。

- 数据集分为训练集和测试集以进行评估。

- 我们扩展了功能以提高 SVM 性能。

- 支持向量机 (SVM) 分类器根据这些特征进行训练。

- 对测试集进行预测,并计算准确性作为评估指标。

对于实际应用程序,您可以使用预先训练的 CNN(例如 VGG、ResNet 或其他)替换特征提取步骤。此外,您还可以微调模型并实现更高级的区域提议和边界框回归机制。

要生成绘图、混淆矩阵和可视化图像,您可以使用 Matplotlib 和 Scikit-learn 等库。以下是如何在 Python 中创建这些可视化效果:

混淆矩阵:您可以创建混淆矩阵来可视化模型在测试集上的性能。

from sklearn.metrics import confusion_matrix

import seaborn as sns

import matplotlib.pyplot as plt

confusion = confusion_matrix(y_test, y_pred)

labels = ['Class 0', 'Class 1']

plt.figure(figsize=(8, 6))

sns.heatmap(confusion, annot=True, fmt='d', xticklabels=labels, yticklabels=labels, cmap="Blues")

plt.xlabel('Predicted')

plt.ylabel('Actual')

plt.title('Confusion Matrix')

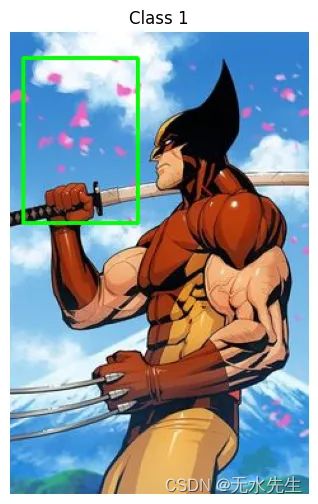

plt.show()带有边界框的图像:要可视化带有边界框和类标签的图像,您可以使用 OpenCV 和 Matplotlib。

for i in range(len(y_pred)):

image = cv2.imread(image_paths[i])

if y_pred[i] == 1:

color = (0, 255, 0) # Green bounding box for Class 1

else:

color = (0, 0, 255) # Red bounding box for Class 0

x_min, y_min, x_max, y_max = bounding_boxes[i]

cv2.rectangle(image, (x_min, y_min), (x_max, y_max), color, 2)

plt.figure(figsize=(6, 6))

plt.imshow(cv2.cvtColor(image, cv2.COLOR_BGR2RGB))

plt.title(f'Class {y_pred[i]}')

plt.axis('off')

plt.show()

在此代码中,我们使用 Matplotlib 创建混淆矩阵图并使用边界框可视化测试图像。边界框颜色基于预测的类别(绿色为类别 1,红色为类别 0)。实际的类别标签显示为每个图像的标题。

埃弗顿戈梅德博士

七、结论

R-CNN 及其后续变体重塑了计算机视觉中目标检测的格局。这些模型不仅显着提高了准确性,而且还使该过程更加高效且易于各种应用程序使用。从最初的 R-CNN 到其衍生品(如 Fast R-CNN 和 Faster R-CNN)的历程,表明了该领域在准确性和效率之间取得平衡的不断努力。R-CNN 为现代目标检测模型奠定了基础,并继续激发进一步的发展,使其成为计算机视觉发展的重要里程碑。