- 条件概率:不确定性决策的基石

大千AI助手

人工智能Python#OTHER决策树算法机器学习人工智能条件概率概率论

条件概率是概率论中的核心概念,用于描述在已知某一事件发生的条件下,另一事件发生的概率。它量化了事件之间的关联性,是贝叶斯推理、统计建模和机器学习的基础。本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!一、定义与公式设(A)和(B)是两个随机事件,且(P(B)>0):条件概率(P(A\midB))表示

- 人工智能-基础篇-2-什么是机器学习?(ML,监督学习,半监督学习,零监督学习,强化学习,深度学习,机器学习步骤等)

weisian151

人工智能人工智能机器学习学习

1、什么是机器学习?机器学习(MachineLearning,ML)是人工智能的一个分支,是一门多领域交叉学科,涉及概率论、统计学、逼近论、凸分析等数学理论。其核心目标是让计算机通过分析数据,自动学习规律并构建模型,从而对未知数据进行预测或决策,而无需依赖显式的程序指令。基本思想:通过数据驱动的方式,使系统能够从经验(数据)中改进性能,形成对数据模式的抽象化表达。基本概念:模型:模型是对现实世界现

- 概率密度基本概念

Summer_Anny

概率论

概率密度(ProbabilityDensity)是概率论中用于描述随机变量分布的一种方式,特别适用于连续随机变量。它并不是一个概率值,而是表示单位范围内的概率大小或“浓度”。更具体地说,概率密度表示在某个特定值附近,随机变量可能取到某个值的相对可能性。概率密度的几个关键点:概率密度与概率的关系:概率密度函数(PDF)本身并不能直接给出某个特定值发生的概率。因为对于连续随机变量,单一值的概率是零。然

- 线性代数和c语言先学哪个,线性代数和哪个更有用?

段丞博

线性代数和c语言先学哪个

一、从数学与应用数学这个专业来分析下“线性代数”和“高等数学”这两块的内容,无论哪块知识在“考研究生数学科目中的考试”都会涉汲到的,而且有些专业的考试也包括概率论与数理统计这块知识。线性代数和哪个更有用?1、线性代数内容:行列式、矩阵、向量、线性方程组、特征值和特征向量、二次型。2、高等数学内容:函数·极限·连续、导数与微分、不定积分、定积分及广义积分、中值定理的证明、常微分方程、一元微积分的应用

- ICBDDM2025:大数据与数字化管理前沿峰会

鸭鸭鸭进京赶烤

学术会议大数据图像处理计算机视觉AI编程人工智能机器人考研

在选择大学专业时,可以先从自身兴趣、能力和职业规划出发,初步确定几个感兴趣的领域。然后结合外部环境因素,如专业前景、教育资源和就业情况等,对这些专业进行深入的分析和比较。大数据专业:是一个热门且前沿的学科领域,它涉及到数据的收集、存储、处理、分析和应用等多个方面。课程设置基础课程数学基础:高等数学、线性代数、概率论与数理统计等。这些课程为大数据分析提供了必要的数学工具,例如线性代数在机器学习算法中

- 第九课:大白话教你朴素贝叶斯

顽强卖力

机器学习-深度学习-神经网络算法python大数据数据分析

这节课咱们来聊聊朴素贝叶斯(NaiveBayes),这个算法名字听起来像是个“天真无邪的数学小天才”,但其实它是个超级实用的分类工具!我会用最接地气的方式,从定义讲到代码实战,保证你笑着学会,还能拿去忽悠朋友!一:朴素贝叶斯是啥?——当概率论遇上“天真”假设1.1定义:贝叶斯定理的“偷懒版”问题:你想判断一封邮件是不是垃圾邮件,或者一条评论是不是好评。贝叶斯定理(原版):[P(A|B)=\frac

- 贝叶斯算法:从概率推断到智能决策的基石

weixin_47233946

算法算法

##引言在人工智能与机器学习的蓬勃发展中,贝叶斯算法以其独特的概率推理方式和动态更新的特性,在垃圾邮件过滤、疾病诊断、推荐系统等关键领域展现出强大的应用价值。本文将从概率论基础出发,深入解析贝叶斯算法的核心思想及其实现方式,揭示这一统计学方法如何演变为现代智能系统的决策利器。---##一、贝叶斯定理:概率之门的钥匙###1.1基本公式表述贝叶斯定理的数学表达式揭示事件间的关联关系:$$P(A|B)

- 清风数学建模个人笔记--模糊综合评价

fvdj0

数学建模笔记

目录一、量二、分类三、模糊函数的三种表示方法四、应用:模糊综合评价(评判)一、量①确定性:经典数学(几何、代数)②不确定性:随机性(概率论、随机过程)灰性(灰色系统)模糊性(模糊数学)二、分类:偏小型:年轻、小、冷中间型:中年、中、暖偏大型:年老、大、热三、模糊函数的三种表示方法(1)模糊统计法(设计调查问卷,不推荐,主观性最弱)(2)借助已有的尺度(需要已有的指标,并能收集到数据)论域模糊集隶属

- 【西瓜书】机器学习(周志华)学习问题记录

_linyu__

基础知识机器学习周志华西瓜书

简述西瓜书的鼎鼎大名早有耳闻,于是毫无疑问买来入门。写此文章的时候刚要做完第二章的练习题。在看的时候有一些感慨:需要一定的数理基础,尤其是概率论的内容。但是如果没学过也不建议直接去啃概率论,只要把相关的部分看看即可。周老师默认我们能力很强,所以有些地方说得不够详细,仅靠此书无法理解,需要自己另行查阅。有一些疑似谬误的地方,但是我自己能力较差,又苦于没有人佐证,所以并不敢说周老师一定错了。在看的过程

- 数学中的泛函分析与算子理论

AI天才研究院

计算AI大模型应用入门实战与进阶ChatGPT实战大数据人工智能语言模型AILLMJavaPython架构设计AgentRPA计算AI大模型应用

1.背景介绍1.1数学的发展与泛函分析的产生数学作为一门科学,自古以来就在不断地发展和演变。从最初的算术、几何,到后来的微积分、线性代数,再到现代的拓扑学、概率论等,数学的研究领域不断扩展。泛函分析作为一门现代数学的分支,起源于20世纪初,它主要研究无限维空间中的函数和算子,为许多现代科学和工程问题提供了理论基础。1.2泛函分析与算子理论的关系泛函分析与算子理论密切相关。泛函分析主要研究无限维空间

- 【图像处理入门】8. 数学基础与优化:线性代数、概率与算法调优实战

小米玄戒Andrew

图像处理:从入门到专家图像处理线性代数算法python计算机视觉概率论算法调优

摘要图像处理的核心离不开数学工具的支撑。本文将深入解析线性代数、概率论在图像领域的应用,包括矩阵变换与图像几何操作的关系、噪声模型的数学描述,以及遗传算法、粒子群优化等智能算法在参数调优中的实践。通过理论结合代码案例,帮助读者掌握从数学原理到工程优化的完整链路。一、线性代数:图像变换的数学基石1.矩阵运算与图像几何变换在图像处理入门3中,我们通过仿射变换矩阵实现图像平移、旋转与缩放。其本质是线性代

- AI大模型从0到1记录学习 大模型技术之机器学习 day27-day60

Gsen2819

算法大模型人工智能人工智能学习机器学习

机器学习概述机器学习(MachineLearning,ML)主要研究计算机系统对于特定任务的性能,逐步进行改善的算法和统计模型。通过输入海量训练数据对模型进行训练,使模型掌握数据所蕴含的潜在规律,进而对新输入的数据进行准确的分类或预测。机器学习是一门多领域交叉学科,涉及概率论、统计学、逼近论、凸优化、算法复杂度理论等多门学科。人工智能、机器学习与深度学习人工智能(AI)是计算机科学的一个广泛领域,

- 大数定律与中心极限定理:概率论的双子星

Algo-hx

概率论与数理统计概率论

目录引言5大数定律与中心极限定理5.1大数定律:频率的稳定性5.1.1辛钦大数定律定理内容5.1.2伯努利大数定律定理内容5.1.3切比雪夫大数定律定理内容对比总结表5.2中心极限定理:正态分布的普适性5.2.1独立同分布情形定理内容图释5.2.2李雅普诺夫定理定理内容核心思想图释5.2.3棣莫弗-拉普拉斯定理定理内容应用条件图释对比总结表5.3定理对比:LLNvsCLT引言当随机现象的个体行为无

- (十七)深度学习之线性代数:核心概念与应用解析

只有左边一个小酒窝

深度学习深度学习线性代数人工智能

1线性代数在深度学习中的定位1.1深度学习的数学基础支柱线性代数是深度学习的核心数学工具之一,与微积分、概率论共同构成深度学习的理论基础。深度学习本质上是对高维数据的处理与建模,而线性代数提供了描述和操作高维空间中数据与变换的语言和方法。1.2从数据表示到模型运算的桥梁数据结构化表示:深度学习处理的图像、文本、音频等数据,通常被转化为向量、矩阵或张量(多维数组)。例如:图像:RGB图像可表示为三维

- (详细介绍)什么是 Spherical Gaussian(球形高斯分布)

音程

数学数学

文章目录什么是SphericalGaussian?几何意义:为什么叫“球形”?特点总结:应用场景举例:✅示例代码(Python)相关概念对比:SphericalGaussian(球形高斯分布)是概率论与统计学中一个非常常见且重要的概念,尤其在机器学习、信号处理、模式识别等领域有广泛应用。什么是SphericalGaussian?SphericalGaussianDistribution(球形高斯分

- 贝叶斯原理:解锁不确定性的智慧钥匙(全网最详细)

富士达幸运星

贝叶斯原理人工智能机器学习

在浩瀚的统计学与概率论海洋中,贝叶斯原理如同一盏明灯,照亮了我们在不确定性中前行的道路。它不仅仅是一种计算方法,更是一种深刻的思维方式,让我们能够基于有限的信息和先验知识,对未知事件做出更加合理的预测和判断。本文将带您一窥贝叶斯原理的奥秘,探索它如何在各个领域发光发热。一、贝叶斯原理的起源与核心概念起源贝叶斯原理得名于18世纪的英国数学家托马斯·贝叶斯(ThomasBayes),尽管他本人并未直接

- 为什么计算机不用e进制,按道理说e进制难道不是最高效的吗?e进制理论上为何被认为信息编码更优,但实际却难以实现?

前端

在现代计算机科学中,二进制无疑是计算机体系结构的根基,这一选择深刻影响了计算机的设计、性能以及发展方向。然而,数字系统的底层进制理论却远远不止二进制一种可能性。从数学的角度来看,常用进制中有一个特殊的数——数学常数e(自然对数的底,约等于2.71828),它在无数数学和物理领域扮演着极其重要的角色。e的独特性质使得很多数学函数的表达变得简洁自然,且e在连续复利、概率论、信息论等领域都有着独特的优势

- 【概率论】正态分布的由来——从大一同学的视角出发

应有光

基础知识概率论机器学习

数学系大佬勿喷,本文以非数同学的视角出发0.启发与思考正态分布平时常常遇到,无论是在概率论中的“中心极限定理”,还是平时在学习ML中遇到的“高斯混合模型”,或者是在深度学习中,常常将一些数据假设为正态分布的情况。我们平时可能由于知到中心极限定理,因此默认正态分布是一个很好的分布。但是,这为什么不能是平均分布呢?二项分布呢?泊松分布?或者是其它抽样分布?接下来我们将简要探讨正态分布的由来:1.背景我

- 【概率论与数理统计】第二章 随机变量及其分布(1)

Arthur古德曼

概率论与数理统计概率论随机变量分布离散型连续型夏明亮

第二章随机变量及其分布第一章种学习了随机现象、随机试验、随机事件等概念,讨论了随机事件的关系、运算以及概率;且只考虑了个别事件下的频率问题。接下来,进一步第需要建立随机试验结果与实数的对应关系,这类似于函数的映射,我们称之为随机变量,以便使用高等数学的方法来研究随机试验。1离散型随机变量1.1随机变量的概念随机变量的数学定义:**定义1:**设EEE为随机试验,Ω\OmegaΩ为其样本空间,若对于

- 随机变量及其分布:概率论的量化核心

Algo-hx

概率论与数理统计概率论

标题引言2随机变量及其分布2.1随机变量定义与分类2.2离散型随机变量:概率质量函数(PMF)概率分布律性质经典分布4.**各分布之间的关系**2.3分布函数(CDF):统一描述工具定义性质离散型应用2.4连续型随机变量:概率密度函数(PDF)定义性质经典分布均匀分布指数分布正态分布2.5随机变量函数的分布问题:已知XXX分布,求Y=g(X)Y=g(X)Y=g(X)分布解法框架重要公式(当ggg严

- 詹森不等式(Jensen’s Inequality)——EM算法的基础

phoenix@Capricornus

模式识别中的数学问题机器学习

詹森不等式(Jensen’sInequality)是数学中一个非常重要的不等式,广泛应用于概率论、统计学、凸优化、信息论等领域。它基于凸函数和凹函数的性质。一、基本定义设函数fff是定义在区间III上的凸函数(convexfunction),且随机变量XXX的取值落在III内,期望存在,则有:E[f(X)]⩾f(E[X]){E}[f(X)]\geqslantf({E}[X])E[f(X)]⩾f(E

- 机器学习与深度学习16-概率论和统计学01

my_q

机器学习与深度学习机器学习深度学习概率论

目录前文回顾1.什么是概率论和统计学2.概率的基本概念3.什么是概率密度函数和累积分布函数4.均值、中位数与众数前文回顾上一篇文章地址:链接1.什么是概率论和统计学概率论和统计学是数学中重要的分支,用于研究随机事件和数据的分布、关联性以及不确定性。概率论是研究随机事件发生的可能性和规律的数学学科。它提供了一套工具和方法来描述和分析随机变量、随机过程以及他们之间的关系。概率论包括概率分布、随机变量、

- Python概率论

麻辣小兔喵

Pythonpython概率论机器学习

概率论是数学的一个分支,它研究随机事件的概率和统计规律。在Python中,有很多强大的概率统计库可以帮助我们进行概率计算和数据分析,比如NumPy、SciPy和Pandas等库。下面我将为您介绍一些基本的概率概念以及如何在Python中实现它们。1.概率的基本概念在概率论中,我们通常会用以下的符号表示:P(A):表示事件A发生的概率,其取值范围在[0,1]之间。P(A|B):表示在事件B发生的条件

- C++概率论算法详解:理论基础与实践应用

清言神力,创作奇迹。接受福利,做篇笔记。参考资料[0]概率论中均值、方差、标准差介绍及C++/OpenCV/Eigen的三种实现.https://blog.csdn.net/fengbingchun/article/details/73323475.[4]C++中的随机数及其在算法竞赛中的使用-博客园.https://www.cnblogs.com/cmy-blog/p/random.html.[

- 我2025上岸大模型就靠它了,冲击大厂大模型岗位!大模型学习路线(2025最新)从零基础入门到精通_大模型学习路线

大模型老炮

学习人工智能程序员Agent大模型教学知识库大模型

大模型学习路线图第一阶段:基础知识准备在这个阶段,您需要打下坚实的数学基础和编程基础,这是学习任何机器学习和深度学习技术所必需的。\1.数学基础线性代数:矩阵运算、向量空间、特征值与特征向量等。概率统计:随机变量、概率分布、贝叶斯定理等。微积分:梯度、偏导数、积分等。学习资料书籍:GilbertStrang,《线性代数及其应用》SheldonRoss,《概率论与随机过程》在线课程:KhanAcad

- 神仙级大模型教程分享,不用感谢,请叫我活雷锋!大模型 学习路线非常详细_大模型学习路线(2025最新)

程序员辣条

学习人工智能大模型产品经理智能体大模型教程AI大模型

大模型学习路线图第一阶段:基础知识准备在这个阶段,您需要打下坚实的数学基础和编程基础,这是学习任何机器学习和深度学习技术所必需的。1.数学基础线性代数:矩阵运算、向量空间、特征值与特征向量等。概率统计:随机变量、概率分布、贝叶斯定理等。微积分:梯度、偏导数、积分等。学习资料书籍:GilbertStrang,《线性代数及其应用》SheldonRoss,《概率论与随机过程》在线课程:KhanAcade

- 最大似然估计(MLE)与最小二乘估计(LSE)的区别

江湖小妞

概率论

最大似然估计与最小二乘估计的区别标签(空格分隔):概率论与数理统计最小二乘估计对于最小二乘估计来说,最合理的参数估计量应该使得模型能最好地拟合样本数据,也就是估计值与观测值之差的平方和最小。设Q表示平方误差,Yi表示估计值,Ŷi表示观测值,即Q=∑ni=1(Yi−Ŷi)2最大似然估计对于最大似然估计来说,最合理的参数估计量应该使得从模型中抽取该n组样本的观测值的概率最大,也就是概率分布函数或者

- 概率论的基本概念

Mr.魏(魏先生)

概率论的起源与发展概率论产生于十六世纪十六世纪中叶,卡当在赌博时研究不输的方法1654年,德·美黑——“合理分配赌注问题”1657年,惠更斯——《论机会游戏的计算》1933年,柯尔莫哥洛夫——《概率论的基本概念》数理统计的历史1763年,贝叶斯贝叶斯方法1809年,高斯和勒让德——最小二乘法皮尔逊、戈赛特、费歇——频率曲线、多元分析、估计和方差分析概率论是数理统计学的基础,数理统计学是概率论的一种

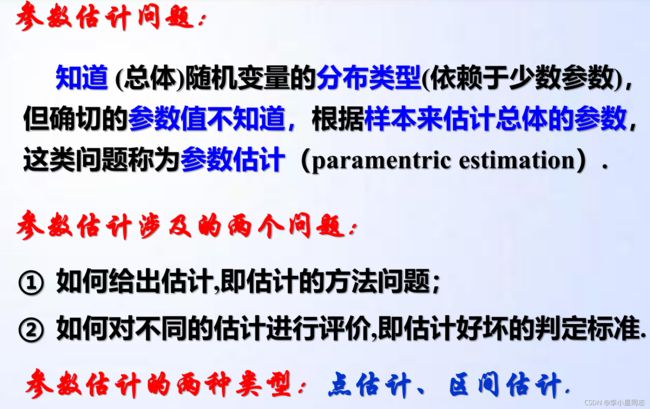

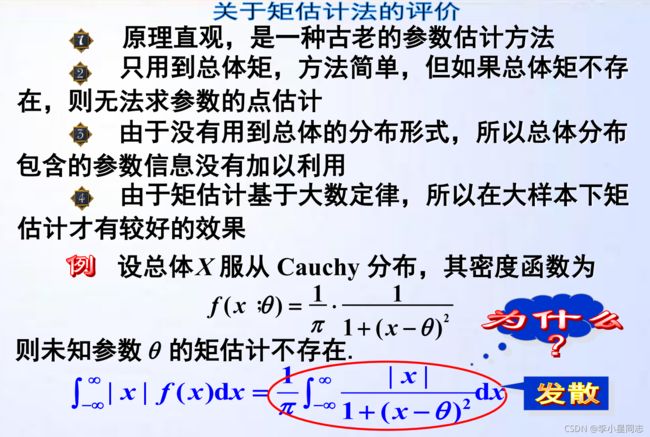

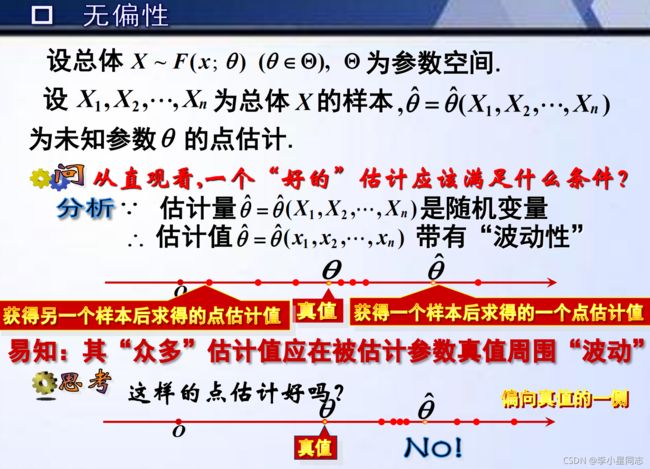

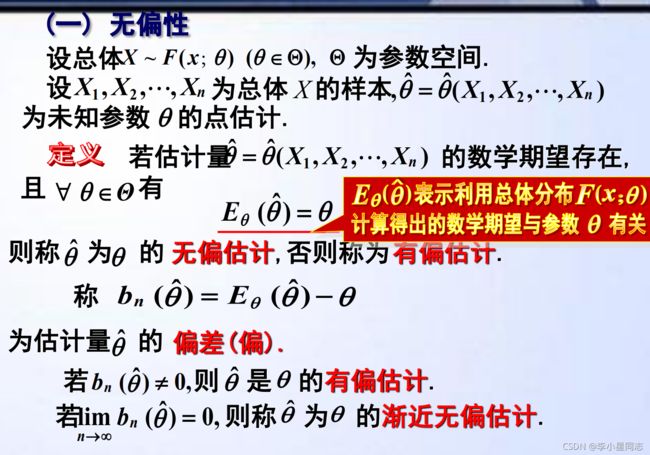

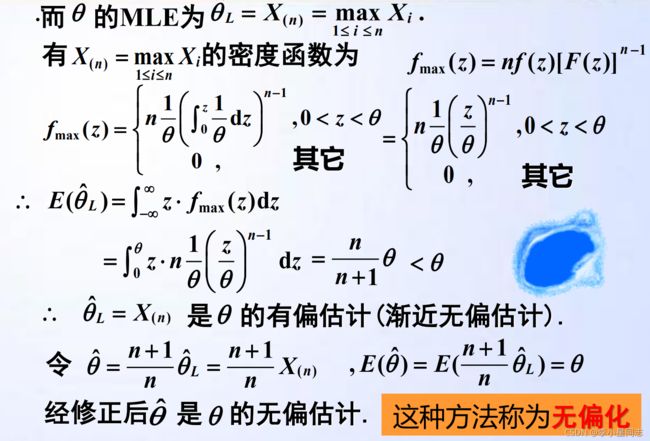

- 【概率论基本概念01】点估计

无水先生

概率模型统计学模型概率论

一、说明关于概率和统计的学习,需要从根本上、原始概念中一点一点积累,这些基本概念的头绪特别多,一次性交待它们的面有困难,我们只能从点上入手,将点与点的关系连成面,最后完成系统学习的目的,这是一个长期任务。二、关于估计的基本概念2.1我们将学习哪些关于“估计”内容我们将主要指向如下学习内容:学习如何找到总体参数的最大似然估计量。学习如何找到总体参数的矩估计方法。学习如何检查估计量对于特定参数是否无偏

- 《算法导论(第4版)》阅读笔记:p1178-p1212

算法

《算法导论(第4版)》学习第25天,p1178-p1212总结,总计35页。一、技术总结1.AppendixC:CountingandProbability附录C介绍了计数理论(如:和规则,积规则,串,排列,组合,二项式系数,二项式界等),概率理论(如:样本空间,事件,概率论公理,离散概率分布,连续均匀概率分布,贝叶斯定理等),几何分布与二项分布,二项分布的尾部探究。第5章会时不时的涉及这些内容,

- java工厂模式

3213213333332132

java抽象工厂

工厂模式有

1、工厂方法

2、抽象工厂方法。

下面我的实现是抽象工厂方法,

给所有具体的产品类定一个通用的接口。

package 工厂模式;

/**

* 航天飞行接口

*

* @Description

* @author FuJianyong

* 2015-7-14下午02:42:05

*/

public interface SpaceF

- nginx频率限制+python测试

ronin47

nginx 频率 python

部分内容参考:http://www.abc3210.com/2013/web_04/82.shtml

首先说一下遇到这个问题是因为网站被攻击,阿里云报警,想到要限制一下访问频率,而不是限制ip(限制ip的方案稍后给出)。nginx连接资源被吃空返回状态码是502,添加本方案限制后返回599,与正常状态码区别开。步骤如下:

- java线程和线程池的使用

dyy_gusi

ThreadPoolthreadRunnabletimer

java线程和线程池

一、创建多线程的方式

java多线程很常见,如何使用多线程,如何创建线程,java中有两种方式,第一种是让自己的类实现Runnable接口,第二种是让自己的类继承Thread类。其实Thread类自己也是实现了Runnable接口。具体使用实例如下:

1、通过实现Runnable接口方式 1 2

- Linux

171815164

linux

ubuntu kernel

http://kernel.ubuntu.com/~kernel-ppa/mainline/v4.1.2-unstable/

安卓sdk代理

mirrors.neusoft.edu.cn 80

输入法和jdk

sudo apt-get install fcitx

su

- Tomcat JDBC Connection Pool

g21121

Connection

Tomcat7 抛弃了以往的DBCP 采用了新的Tomcat Jdbc Pool 作为数据库连接组件,事实上DBCP已经被Hibernate 所抛弃,因为他存在很多问题,诸如:更新缓慢,bug较多,编译问题,代码复杂等等。

Tomcat Jdbc P

- 敲代码的一点想法

永夜-极光

java随笔感想

入门学习java编程已经半年了,一路敲代码下来,现在也才1w+行代码量,也就菜鸟水准吧,但是在整个学习过程中,我一直在想,为什么很多培训老师,网上的文章都是要我们背一些代码?比如学习Arraylist的时候,教师就让我们先参考源代码写一遍,然

- jvm指令集

程序员是怎么炼成的

jvm 指令集

转自:http://blog.csdn.net/hudashi/article/details/7062675#comments

将值推送至栈顶时 const ldc push load指令

const系列

该系列命令主要负责把简单的数值类型送到栈顶。(从常量池或者局部变量push到栈顶时均使用)

0x02 &nbs

- Oracle字符集的查看查询和Oracle字符集的设置修改

aijuans

oracle

本文主要讨论以下几个部分:如何查看查询oracle字符集、 修改设置字符集以及常见的oracle utf8字符集和oracle exp 字符集问题。

一、什么是Oracle字符集

Oracle字符集是一个字节数据的解释的符号集合,有大小之分,有相互的包容关系。ORACLE 支持国家语言的体系结构允许你使用本地化语言来存储,处理,检索数据。它使数据库工具,错误消息,排序次序,日期,时间,货

- png在Ie6下透明度处理方法

antonyup_2006

css浏览器FirebugIE

由于之前到深圳现场支撑上线,当时为了解决个控件下载,我机器上的IE8老报个错,不得以把ie8卸载掉,换个Ie6,问题解决了,今天出差回来,用ie6登入另一个正在开发的系统,遇到了Png图片的问题,当然升级到ie8(ie8自带的开发人员工具调试前端页面JS之类的还是比较方便的,和FireBug一样,呵呵),这个问题就解决了,但稍微做了下这个问题的处理。

我们知道PNG是图像文件存储格式,查询资

- 表查询常用命令高级查询方法(二)

百合不是茶

oracle分页查询分组查询联合查询

----------------------------------------------------分组查询 group by having --平均工资和最高工资 select avg(sal)平均工资,max(sal) from emp ; --每个部门的平均工资和最高工资

- uploadify3.1版本参数使用详解

bijian1013

JavaScriptuploadify3.1

使用:

绑定的界面元素<input id='gallery'type='file'/>$("#gallery").uploadify({设置参数,参数如下});

设置的属性:

id: jQuery(this).attr('id'),//绑定的input的ID

langFile: 'http://ww

- 精通Oracle10编程SQL(17)使用ORACLE系统包

bijian1013

oracle数据库plsql

/*

*使用ORACLE系统包

*/

--1.DBMS_OUTPUT

--ENABLE:用于激活过程PUT,PUT_LINE,NEW_LINE,GET_LINE和GET_LINES的调用

--语法:DBMS_OUTPUT.enable(buffer_size in integer default 20000);

--DISABLE:用于禁止对过程PUT,PUT_LINE,NEW

- 【JVM一】JVM垃圾回收日志

bit1129

垃圾回收

将JVM垃圾回收的日志记录下来,对于分析垃圾回收的运行状态,进而调整内存分配(年轻代,老年代,永久代的内存分配)等是很有意义的。JVM与垃圾回收日志相关的参数包括:

-XX:+PrintGC

-XX:+PrintGCDetails

-XX:+PrintGCTimeStamps

-XX:+PrintGCDateStamps

-Xloggc

-XX:+PrintGC

通

- Toast使用

白糖_

toast

Android中的Toast是一种简易的消息提示框,toast提示框不能被用户点击,toast会根据用户设置的显示时间后自动消失。

创建Toast

两个方法创建Toast

makeText(Context context, int resId, int duration)

参数:context是toast显示在

- angular.identity

boyitech

AngularJSAngularJS API

angular.identiy 描述: 返回它第一参数的函数. 此函数多用于函数是编程. 使用方法: angular.identity(value); 参数详解: Param Type Details value

*

to be returned. 返回值: 传入的value 实例代码:

<!DOCTYPE HTML>

- java-两整数相除,求循环节

bylijinnan

java

import java.util.ArrayList;

import java.util.List;

public class CircleDigitsInDivision {

/**

* 题目:求循环节,若整除则返回NULL,否则返回char*指向循环节。先写思路。函数原型:char*get_circle_digits(unsigned k,unsigned j)

- Java 日期 周 年

Chen.H

javaC++cC#

/**

* java日期操作(月末、周末等的日期操作)

*

* @author

*

*/

public class DateUtil {

/** */

/**

* 取得某天相加(减)後的那一天

*

* @param date

* @param num

*

- [高考与专业]欢迎广大高中毕业生加入自动控制与计算机应用专业

comsci

计算机

不知道现在的高校还设置这个宽口径专业没有,自动控制与计算机应用专业,我就是这个专业毕业的,这个专业的课程非常多,既要学习自动控制方面的课程,也要学习计算机专业的课程,对数学也要求比较高.....如果有这个专业,欢迎大家报考...毕业出来之后,就业的途径非常广.....

以后

- 分层查询(Hierarchical Queries)

daizj

oracle递归查询层次查询

Hierarchical Queries

If a table contains hierarchical data, then you can select rows in a hierarchical order using the hierarchical query clause:

hierarchical_query_clause::=

start with condi

- 数据迁移

daysinsun

数据迁移

最近公司在重构一个医疗系统,原来的系统是两个.Net系统,现需要重构到java中。数据库分别为SQL Server和Mysql,现需要将数据库统一为Hana数据库,发现了几个问题,但最后通过努力都解决了。

1、原本通过Hana的数据迁移工具把数据是可以迁移过去的,在MySQl里面的字段为TEXT类型的到Hana里面就存储不了了,最后不得不更改为clob。

2、在数据插入的时候有些字段特别长

- C语言学习二进制的表示示例

dcj3sjt126com

cbasic

进制的表示示例

# include <stdio.h>

int main(void)

{

int i = 0x32C;

printf("i = %d\n", i);

/*

printf的用法

%d表示以十进制输出

%x或%X表示以十六进制的输出

%o表示以八进制输出

*/

return 0;

}

- NsTimer 和 UITableViewCell 之间的控制

dcj3sjt126com

ios

情况是这样的:

一个UITableView, 每个Cell的内容是我自定义的 viewA viewA上面有很多的动画, 我需要添加NSTimer来做动画, 由于TableView的复用机制, 我添加的动画会不断开启, 没有停止, 动画会执行越来越多.

解决办法:

在配置cell的时候开始动画, 然后在cell结束显示的时候停止动画

查找cell结束显示的代理

- MySql中case when then 的使用

fanxiaolong

casewhenthenend

select "主键", "项目编号", "项目名称","项目创建时间", "项目状态","部门名称","创建人"

union

(select

pp.id as "主键",

pp.project_number as &

- Ehcache(01)——简介、基本操作

234390216

cacheehcache简介CacheManagercrud

Ehcache简介

目录

1 CacheManager

1.1 构造方法构建

1.2 静态方法构建

2 Cache

2.1&

- 最容易懂的javascript闭包学习入门

jackyrong

JavaScript

http://www.ruanyifeng.com/blog/2009/08/learning_javascript_closures.html

闭包(closure)是Javascript语言的一个难点,也是它的特色,很多高级应用都要依靠闭包实现。

下面就是我的学习笔记,对于Javascript初学者应该是很有用的。

一、变量的作用域

要理解闭包,首先必须理解Javascript特殊

- 提升网站转化率的四步优化方案

php教程分享

数据结构PHP数据挖掘Google活动

网站开发完成后,我们在进行网站优化最关键的问题就是如何提高整体的转化率,这也是营销策略里最最重要的方面之一,并且也是网站综合运营实例的结果。文中分享了四大优化策略:调查、研究、优化、评估,这四大策略可以很好地帮助用户设计出高效的优化方案。

PHP开发的网站优化一个网站最关键和棘手的是,如何提高整体的转化率,这是任何营销策略里最重要的方面之一,而提升网站转化率是网站综合运营实力的结果。今天,我就分

- web开发里什么是HTML5的WebSocket?

naruto1990

Webhtml5浏览器socket

当前火起来的HTML5语言里面,很多学者们都还没有完全了解这语言的效果情况,我最喜欢的Web开发技术就是正迅速变得流行的 WebSocket API。WebSocket 提供了一个受欢迎的技术,以替代我们过去几年一直在用的Ajax技术。这个新的API提供了一个方法,从客户端使用简单的语法有效地推动消息到服务器。让我们看一看6个HTML5教程介绍里 的 WebSocket API:它可用于客户端、服

- Socket初步编程——简单实现群聊

Everyday都不同

socket网络编程初步认识

初次接触到socket网络编程,也参考了网络上众前辈的文章。尝试自己也写了一下,记录下过程吧:

服务端:(接收客户端消息并把它们打印出来)

public class SocketServer {

private List<Socket> socketList = new ArrayList<Socket>();

public s

- 面试:Hashtable与HashMap的区别(结合线程)

toknowme

昨天去了某钱公司面试,面试过程中被问道

Hashtable与HashMap的区别?当时就是回答了一点,Hashtable是线程安全的,HashMap是线程不安全的,说白了,就是Hashtable是的同步的,HashMap不是同步的,需要额外的处理一下。

今天就动手写了一个例子,直接看代码吧

package com.learn.lesson001;

import java

- MVC设计模式的总结

xp9802

设计模式mvc框架IOC

随着Web应用的商业逻辑包含逐渐复杂的公式分析计算、决策支持等,使客户机越

来越不堪重负,因此将系统的商业分离出来。单独形成一部分,这样三层结构产生了。

其中‘层’是逻辑上的划分。

三层体系结构是将整个系统划分为如图2.1所示的结构[3]

(1)表现层(Presentation layer):包含表示代码、用户交互GUI、数据验证。

该层用于向客户端用户提供GUI交互,它允许用户