【论文阅读】Transformer——Attention Is All You Need

文章目录

-

-

- 论文阅读

-

- 模型架构

- 代码合集

-

- utils.py

- model.py

- train.py

- test.py

-

论文阅读

因为本人算是半个CV人,没有NLP的基础,这篇文章和代码也只是浅尝辄止,下载了大佬的代码跑了跑,看了看model中文件就结束了,有错误希望指出

感谢知乎上的一个大神

知乎大神代码链接

Attention Is All You Need原文地址

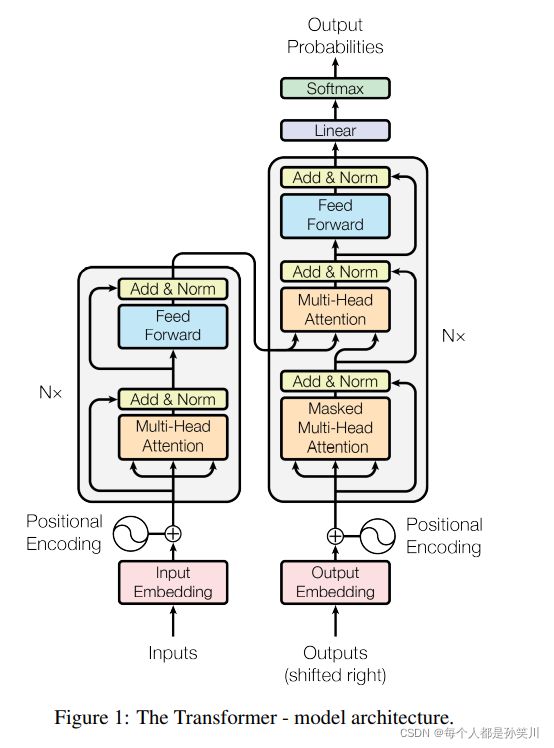

文章提出了一个简单的架构Transformer,没有使用RNN和卷积,只是使用了注意力机制,可以并行计算,训练时间很短。

model architecture:

模型架构

编码器:

Encoder部分主要是有N=6个方框中的block堆叠起来的,每一个block有两部分构成,一个是multi_Head Attention,另一个是前馈神经网络(两个全连接中有一个Relu),在两个部分中都使用残差网络和Layer Norm(BN是对所有Batch相同位置做归一化,LN是对一个样本中的所有位置做归一化)来进行最后处理

解码器:

Decoder部分,同样是由N=6个方框中的Block堆叠起来的,每个block有三部分,multi_Head Attention、Maked Multi-Head Attention(后面详谈)、Feed Forward,每个部分中都使用残差网络和Layer Norm(BN是对所有Batch相同位置做归一化,LN是对一个样本中的所有位置做归一化)来进行最后处理

注意力机制:

一般的注意力可以抽象为输入一个查询(query),去查询键值对(key-value pair)中的key,然后得到一个概率分布,再据此对value进行加权相加,获取当前query下的注意力表征。而我们的query,往往是Decoder中某一个step的输出,key-value pair往往是encoder的输出。

论文里面使用的也是这种attention机制,只不过其query、key、value都是由encoder的输出经过不同的变换而来,也即self-attention,所有的东西都是自己。也就是Self-Attention中的QKV都是由同一个输入通过三个不同的Linear得到的结果。

他们定义了一种叫“Scaled Dot-Product Attention”的计算方式,用于计算给定query、key和value下的注意力表征,如下图所示:

论文中使用的是最简单的乘Attention,也就是使用点积来判断QK的相近成都,这里与之不同的地方是,除了一个缩放因子,因为当dk比较小的时候,不加缩放与之类似,但是当dk比较大的时候,内积的量级会增加,导致softmax函数被推向梯度较小的区域

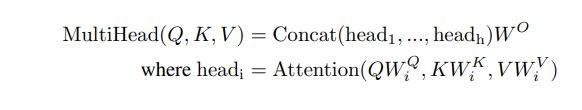

论文里还指出,使用单个注意力计算太过单薄,所以使用了多头注意力机制,分出来多个不同空间中的QKV,类似于CNN中多个卷积核得到图像中不同语义信息。

注意力机制的使用:

encoder中的自注意力机制,所有的QK V都是来源于同一个输入,也就是前面的输出或者是embedding的词向量通过三个线性运算得到的结果

decoder中的自注意力机制,有的QK V是都来源于前面的layer输出,通过三个线性运算的结果。有一个位置的QK 来源于encoder的输出,V来源于前面的layer输出

decoder中的masked self -attention 中的QK点积结果要做一个position的mask,防止当前pos可以获取到后面pos的信息

前馈网络:

这里的前馈网络就是两个线性层中间加一个Relu函数,公式如下

add&norm:

在整体架构图中,还有一个部分是add&norm,这其实是借鉴了图像中的残差思想。在self-attention和feed forward计算之后都会加上一个残差变换,同时也会加上Layer Normalization

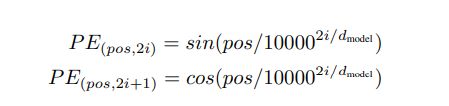

Posiontional Encoding:

因为没有使用Conv、RNN,没有相应的时序关系,但是Seq必须要用到对应的时序关系,所以文章对输入的embeddings add了一个positional Encoding代表相应的位置

positional encodings与embeddings有相同的维度

pos信息+字向量得到输入矩阵a

pos指的是一个batch中的第几个字,i指的是第pos个字向量中第i个索引位置,dmodel指的是字向量的维度(也就是每个字embedding到字向量的最大长度,代码中取的512)

代码合集

utils.py

import torch

import torch.utils.data as Data

# Encoder_input Decoder_input Decoder_output

sentences = [['我 是 学 生 P', 'S I am a student', 'I am a student E'], # S: 开始符号

['我 喜 欢 学 习', 'S I like learning P', 'I like learning P E'], # E: 结束符号

['我 是 男 生 P', 'S I am a boy', 'I am a boy E']] # P: 占位符号,如果当前句子不足固定长度用P占位

src_vocab = {'P': 0, '我': 1, '是': 2, '学': 3, '生': 4, '喜': 5, '欢': 6, '习': 7, '男': 8} # 词源字典 字:索引

src_idx2word = {src_vocab[key]: key for key in src_vocab}

src_vocab_size = len(src_vocab) # 字典字的个数

tgt_vocab = {'P': 0, 'S': 1, 'E': 2, 'I': 3, 'am': 4, 'a': 5, 'student': 6, 'like': 7, 'learning': 8, 'boy': 9}

idx2word = {tgt_vocab[key]: key for key in tgt_vocab} # 把目标字典转换成 索引:字的形式

tgt_vocab_size = len(tgt_vocab) # 目标字典尺寸

src_len = len(sentences[0][0].split(" ")) # Encoder输入的最大长度

tgt_len = len(sentences[0][1].split(" ")) # Decoder输入输出最大长度

# 把sentences 转换成src_vocab对应的字典索引

def make_data():

enc_inputs, dec_inputs, dec_outputs = [], [], []

for i in range(len(sentences)):

enc_input = [[src_vocab[n] for n in sentences[i][0].split()]]

dec_input = [[tgt_vocab[n] for n in sentences[i][1].split()]]

dec_output = [[tgt_vocab[n] for n in sentences[i][2].split()]]

enc_inputs.extend(enc_input)

dec_inputs.extend(dec_input)

dec_outputs.extend(dec_output)

return torch.LongTensor(enc_inputs), torch.LongTensor(dec_inputs), torch.LongTensor(dec_outputs)

# 自定义数据集函数

class MyDataSet(Data.Dataset):

def __init__(self, enc_inputs, dec_inputs, dec_outputs):

super(MyDataSet, self).__init__()

self.enc_inputs = enc_inputs

self.dec_inputs = dec_inputs

self.dec_outputs = dec_outputs

def __len__(self):

return self.enc_inputs.shape[0]

def __getitem__(self, idx):

return self.enc_inputs[idx], self.dec_inputs[idx], self.dec_outputs[idx]

model.py

import numpy as np

from torch import Tensor

import torch.nn as nn

from utils import *

d_model = 512 # 字 Embedding 的维度

d_ff = 2048 # 前向传播隐藏层维度

d_k = d_v = 64 # K(=Q), V的维度

n_layers = 6 # 有多少个encoder和decoder

n_heads = 8 # Multi-Head Attention设置为8

class PositionalEncoding(nn.Module):

def __init__(self, d_model, dropout=0.1, max_len=5000):

super(PositionalEncoding, self).__init__()

self.dropout = nn.Dropout(p=dropout)

pos_table = np.array([ # 每次pos的字向量都需要从0-d_model-1计算所有的值

[pos / np.power(10000, 2 * i / d_model) for i in range(d_model)]

if pos != 0 else np.zeros(d_model) for pos in range(max_len)

])

# 字嵌入维度为偶数时,从0 开始,step=2,为偶数

pos_table[1:, 0::2] = np.sin(pos_table[1:, 0::2])

# 字嵌入维度为奇数时,从1开始,step=2,为奇数

pos_table[1:, 1::2] = np.cos(pos_table[1:, 1::2])

# enc_inputs: [seq_len, d_model]

self.pos_table = torch.FloatTensor(pos_table).cuda()

# 这里使用到了广播机制,可以看forward里面的size

# 广播机制:

# 1、如果x和y的维度数量不同,对维度数量少的张量增加新的维度,且维度大小为1,使得两个张量的维度数量相同

# 2、对每个维度,结果的维度大小是x和y的维度大小的最大值。(其实如果某个维度大小不同,那么有一个维度大小肯定是1)

# 广播条件:

# 1、每个张量都至少有一个维度

# 2、对两个张量的维度从后往前处理,维度的大小(这个维度的长度)必须要么相等,要么其中一个为1,或者其中一个张量后面不存在维度了

def forward(self, enc_inputs):

# enc_inputs: [batch_size, seq_len, d_model]

# self.pos_table:[max_len,d_model]

# self.pos_talbe[:enc_inputs.size(1),:]:[seq_len,d_model],索引切片一下后面两个维度与enc_inputs相同了就

enc_inputs += self.pos_table[:enc_inputs.size(1), :]

return self.dropout(enc_inputs.cuda())

# seq_q: [batch_size, seq_len] ,seq_k: [batch_size, seq_len]

def get_attn_pad_mask(seq_q, seq_k):

batch_size, len_q = seq_q.size()

batch_size, len_k = seq_k.size()

# 判断 输入那些含有P(=0),用1标记 ,[batch_size, 1, len_k]

pad_attn_mask = seq_k.data.eq(0).unsqueeze(1)

return pad_attn_mask.expand(batch_size, len_q, len_k) # 扩展成多维度

# seq: [batch_size, tgt_len]

def get_attn_subsequence_mask(seq):

attn_shape = [seq.size(0), seq.size(1), seq.size(1)]

# 生成上三角矩阵,[batch_size, tgt_len, tgt_len]

subsequence_mask = np.triu(np.ones(attn_shape), k=1)

# [batch_size, tgt_len, tgt_len]

subsequence_mask = torch.from_numpy(subsequence_mask).byte()

return subsequence_mask

class ScaledDotProductAttention(nn.Module):

def __init__(self):

super(ScaledDotProductAttention, self).__init__()

# Q: [batch_size, n_heads, len_q, d_k]

def forward(self, Q, K, V, attn_mask):

# K: [batch_size, n_heads, len_k, d_k]

# V: [batch_size, n_heads, len_v(=len_k), d_v]

# attn_mask: [batch_size, n_heads, seq_len, seq_len]

# scores : [batch_size, n_heads, len_q, len_k]

scores = torch.matmul(Q, K.transpose(-1, -2)) / np.sqrt(d_k)

# 如果时停用词P就等于 0

scores.masked_fill_(attn_mask, -1e9)

attn = nn.Softmax(dim=-1)(scores)

# [batch_size, n_heads, len_q, d_v]

context = torch.matmul(attn, V)

return context, attn

class MultiHeadAttention(nn.Module):

def __init__(self):

super(MultiHeadAttention, self).__init__()

self.W_Q = nn.Linear(d_model, d_k * n_heads, bias=False)

self.W_K = nn.Linear(d_model, d_k * n_heads, bias=False)

self.W_V = nn.Linear(d_model, d_v * n_heads, bias=False)

self.fc = nn.Linear(n_heads * d_v, d_model, bias=False)

# input_Q: [batch_size, len_q, d_model]

def forward(self, input_Q, input_K, input_V, attn_mask):

# input_K: [batch_size, len_k, d_model]

# input_V: [batch_size, len_v(=len_k), d_model]

# attn_mask: [batch_size, seq_len, seq_len]

residual, batch_size = input_Q, input_Q.size(0)

# Q: [batch_size, n_heads, len_q, d_k]

Q = self.W_Q(input_Q).view(batch_size, -1,

n_heads, d_k).transpose(1, 2)

# K: [batch_size, n_heads, len_k, d_k]

K = self.W_K(input_K).view(batch_size, -1,

n_heads, d_k).transpose(1, 2)

# V: [batch_size, n_heads, len_v(=len_k), d_v]

V = self.W_V(input_V).view(batch_size, -1,

n_heads, d_v).transpose(1, 2)

# attn_mask : [batch_size, n_heads, seq_len, seq_len]

attn_mask = attn_mask.unsqueeze(1).repeat(1, n_heads, 1, 1)

# context: [batch_size, n_heads, len_q, d_v]

context, attn = ScaledDotProductAttention()(Q, K, V, attn_mask)

# attn: [batch_size, n_heads, len_q, len_k]

context = context.transpose(1, 2).reshape(batch_size, -1,

n_heads * d_v) # context: [batch_size, len_q, n_heads * d_v]

# [batch_size, len_q, d_model]

output = self.fc(context)

return nn.LayerNorm(d_model).cuda()(output + residual), attn

class PoswiseFeedForwardNet(nn.Module):

def __init__(self):

super(PoswiseFeedForwardNet, self).__init__()

self.fc = nn.Sequential(

nn.Linear(d_model, d_ff, bias=False),

nn.ReLU(),

nn.Linear(d_ff, d_model, bias=False))

# inputs: [batch_size, seq_len, d_model]

def forward(self, inputs: Tensor) -> Tensor:

residual = inputs

output = self.fc(inputs)

# [batch_size, seq_len, d_model]

return nn.LayerNorm(d_model).cuda()(output + residual)

class EncoderLayer(nn.Module):

def __init__(self):

super(EncoderLayer, self).__init__()

self.enc_self_attn = MultiHeadAttention() # 多头注意力机制

self.pos_ffn = PoswiseFeedForwardNet() # 前馈神经网络

# enc_inputs: [batch_size, src_len, d_model]

def forward(self, enc_inputs, enc_self_attn_mask):

# 输入3个enc_inputs分别与W_q、W_k、W_v相乘得到Q、K、V # enc_self_attn_mask: [batch_size, src_len, src_len]

enc_outputs, attn = self.enc_self_attn(enc_inputs, enc_inputs, enc_inputs,

# enc_outputs: [batch_size, src_len, d_model],

enc_self_attn_mask) # attn: [batch_size, n_heads, src_len, src_len]

# enc_outputs: [batch_size, src_len, d_model]

enc_outputs = self.pos_ffn(enc_outputs)

return enc_outputs, attn

class Encoder(nn.Module):

def __init__(self):

super(Encoder, self).__init__()

self.src_emb = nn.Embedding(

src_vocab_size, d_model) # 把字转换字向量

self.pos_emb = PositionalEncoding(

d_model) # 加入位置信息

self.layers = nn.ModuleList([EncoderLayer() for _ in range(n_layers)])

# enc_inputs: [batch_size, src_len]

def forward(self, enc_inputs):

# enc_outputs: [batch_size, src_len, d_model]

enc_outputs = self.src_emb(enc_inputs)

# enc_outputs: [batch_size, src_len, d_model]

enc_outputs = self.pos_emb(enc_outputs)

# enc_self_attn_mask: [batch_size, src_len, src_len]

enc_self_attn_mask = get_attn_pad_mask(enc_inputs, enc_inputs)

enc_self_attns = []

for layer in self.layers:

# enc_outputs : [batch_size, src_len, d_model],

enc_outputs, enc_self_attn = layer(enc_outputs, enc_self_attn_mask)

# enc_self_attn : [batch_size, n_heads, src_len, src_len]

enc_self_attns.append(enc_self_attn)

return enc_outputs, enc_self_attns

class DecoderLayer(nn.Module):

def __init__(self):

super(DecoderLayer, self).__init__()

self.dec_self_attn = MultiHeadAttention()

self.dec_enc_attn = MultiHeadAttention()

self.pos_ffn = PoswiseFeedForwardNet()

def forward(self, dec_inputs, enc_outputs, dec_self_attn_mask,

dec_enc_attn_mask): # dec_inputs: [batch_size, tgt_len, d_model]

# enc_outputs: [batch_size, src_len, d_model]

# dec_self_attn_mask: [batch_size, tgt_len, tgt_len]

# dec_enc_attn_mask: [batch_size, tgt_len, src_len]

dec_outputs, dec_self_attn = self.dec_self_attn(dec_inputs, dec_inputs,

dec_inputs,

dec_self_attn_mask) # dec_outputs: [batch_size, tgt_len, d_model]

# dec_self_attn: [batch_size, n_heads, tgt_len, tgt_len]

dec_outputs, dec_enc_attn = self.dec_enc_attn(dec_outputs, enc_outputs,

enc_outputs,

dec_enc_attn_mask) # dec_outputs: [batch_size, tgt_len, d_model]

# dec_enc_attn: [batch_size, h_heads, tgt_len, src_len]

# dec_outputs: [batch_size, tgt_len, d_model]

dec_outputs = self.pos_ffn(dec_outputs)

return dec_outputs, dec_self_attn, dec_enc_attn

class Decoder(nn.Module):

def __init__(self):

super(Decoder, self).__init__()

self.tgt_emb = nn.Embedding(tgt_vocab_size, d_model)

self.pos_emb = PositionalEncoding(d_model)

self.layers = nn.ModuleList([DecoderLayer() for _ in range(n_layers)])

# dec_inputs: [batch_size, tgt_len]

def forward(self, dec_inputs, enc_inputs, enc_outputs):

# enc_intpus: [batch_size, src_len]

# enc_outputs: [batsh_size, src_len, d_model]

# [batch_size, tgt_len, d_model]

dec_outputs = self.tgt_emb(dec_inputs)

# [batch_size, tgt_len, d_model]

dec_outputs = self.pos_emb(dec_outputs).cuda()

dec_self_attn_pad_mask = get_attn_pad_mask(

dec_inputs, dec_inputs).cuda() # [batch_size, tgt_len, tgt_len]

dec_self_attn_subsequence_mask = get_attn_subsequence_mask(

dec_inputs).cuda() # [batch_size, tgt_len, tgt_len]

dec_self_attn_mask = torch.gt((dec_self_attn_pad_mask +

dec_self_attn_subsequence_mask), 0).cuda() # [batch_size, tgt_len, tgt_len]

# [batc_size, tgt_len, src_len]

dec_enc_attn_mask = get_attn_pad_mask(dec_inputs, enc_inputs)

dec_self_attns, dec_enc_attns = [], []

# dec_outputs: [batch_size, tgt_len, d_model]

for layer in self.layers:

# dec_self_attn: [batch_size, n_heads, tgt_len, tgt_len]

# dec_enc_attn: [batch_size, h_heads, tgt_len, src_len]

dec_outputs, dec_self_attn, dec_enc_attn = layer(dec_outputs, enc_outputs, dec_self_attn_mask,

dec_enc_attn_mask)

dec_self_attns.append(dec_self_attn)

dec_enc_attns.append(dec_enc_attn)

return dec_outputs, dec_self_attns, dec_enc_attns

class Transformer(nn.Module):

def __init__(self):

super(Transformer, self).__init__()

self.Encoder = Encoder().cuda()

self.Decoder = Decoder().cuda()

self.projection = nn.Linear(d_model, tgt_vocab_size, bias=False).cuda()

# enc_inputs: [batch_size, src_len]

def forward(self, enc_inputs, dec_inputs):

# dec_inputs: [batch_size, tgt_len]

# enc_outputs: [batch_size, src_len, d_model],

enc_outputs, enc_self_attns = self.Encoder(enc_inputs)

# enc_self_attns: [n_layers, batch_size, n_heads, src_len, src_len]

dec_outputs, dec_self_attns, dec_enc_attns = self.Decoder(

dec_inputs, enc_inputs, enc_outputs) # dec_outpus : [batch_size, tgt_len, d_model],

# dec_self_attns: [n_layers, batch_size, n_heads, tgt_len, tgt_len],

# dec_enc_attn : [n_layers, batch_size, tgt_len, src_len]

# dec_logits: [batch_size, tgt_len, tgt_vocab_size]

dec_logits = self.projection(dec_outputs)

return dec_logits.view(-1, dec_logits.size(-1)), enc_self_attns, dec_self_attns, dec_enc_attns

train.py

import argparse

import torch.nn as nn

import torch.optim as optim

from utils import *

from model import Transformer

def main(args):

print(args)

device = torch.device(args.device if torch.cuda.is_available() else "cpu")

print("using {} device.".format(device))

enc_inputs, dec_inputs, dec_outputs = make_data()

dataset = MyDataSet(enc_inputs, dec_inputs, dec_outputs)

loader = Data.DataLoader(dataset, batch_size=args.batch_size, shuffle=True)

print(len(loader))

model = Transformer().to(device)

criterion = nn.CrossEntropyLoss(ignore_index=0) # 忽略 占位符 索引为0.

optimizer = optim.SGD(model.parameters(), lr=args.lr, momentum=0.99)

for epoch in range(50):

# enc_inputs : [batch_size, src_len]

for enc_inputs, dec_inputs, dec_outputs in loader:

# dec_inputs : [batch_size, tgt_len]

# dec_outputs: [batch_size, tgt_len]

enc_inputs, dec_inputs, dec_outputs = enc_inputs.to(

device), dec_inputs.to(device), dec_outputs.to(device)

outputs, enc_self_attns, dec_self_attns, dec_enc_attns = model(

enc_inputs, dec_inputs)

# outputs: [batch_size * tgt_len, tgt_vocab_size]

loss = criterion(outputs, dec_outputs.view(-1))

print('Epoch:', '%04d' % (epoch + 1),

'loss =', '{:.6f}'.format(loss))

optimizer.zero_grad()

loss.backward()

optimizer.step()

torch.save(model, args.save_path)

print("保存模型")

if __name__ == "__main__":

parser = argparse.ArgumentParser()

parser.add_argument('--batch_size', type=int, default=2)

parser.add_argument('--device', default='cuda:0')

parser.add_argument('--lr', type=float, default=1e-3)

parser.add_argument('--save_path', type=str, default='./model.pth')

opt = parser.parse_args()

main(opt)

test.py

from utils import *

def test(model, enc_input, start_symbol):

enc_outputs, enc_self_attns = model.Encoder(enc_input)

dec_input = torch.zeros(1, tgt_len).type_as(enc_input.data)

next_symbol = start_symbol

for i in range(0, tgt_len):

dec_input[0][i] = next_symbol

dec_outputs, _, _ = model.Decoder(dec_input, enc_input, enc_outputs)

projected = model.projection(dec_outputs)

prob = projected.squeeze(0).max(dim=-1, keepdim=False)[1]

next_word = prob.data[i]

next_symbol = next_word.item()

return dec_input

enc_inputs, dec_inputs, dec_outputs = make_data()

loader = Data.DataLoader(MyDataSet(enc_inputs, dec_inputs, dec_outputs), 2, True)

enc_inputs, _, _ = next(iter(loader))

model = torch.load('model.pth')

predict_dec_input = test(model, enc_inputs[0].view(1, -1).cuda(), start_symbol=tgt_vocab["S"])

predict, _, _, _ = model(enc_inputs[0].view(1, -1).cuda(), predict_dec_input)

predict = predict.data.max(1, keepdim=True)[1]

print([src_idx2word[int(i)] for i in enc_inputs[0]], '->',

[idx2word[n.item()] for n in predict.squeeze()])