- Java的包结构

MingDong523

笔记

Java的包结构类就相当于文件夹(目录)。包结构的作用一般有以下两个方面第一个就是Java的包是根据Java文件的功能和性质来区分,方便区分和查找另一个就是重复的文件名可以存在于不同的包(文件夹)里。当我们选择去创建Java包时有两种创建方式,其中一种就是手动创建,手动创建包太过繁琐,不推荐。而另一种就是使用代码去创建(打包语句package),当我们使用打包语句时要注意一下几点1.在写packa

- Java中String类型的20个方法

MingDong523

笔记

根据长度来使用的方法:返回类型:int方法签名:String.length()作用:用来计算String中字符的个数根据数组来使用的方法:返回类型:byte类型的数组byte[]方法签名:String.getBytes()作用:将String类型转换成byte类型的数组返回类型:char类型的数组char[]方法签名:String.toCharArray()作用:将String类型转变成char类

- 深入浅出:序列化与反序列化的全面解析

进击的小白菜

一些开发常识开发语言开发常识

文章目录1.引言2.什么是序列化?2.1为什么需要序列化?3.什么是反序列化?3.1反序列化的重要性4.序列化与反序列化的实现4.1JSON(JavaScriptObjectNotation)4.2XML(eXtensibleMarkupLanguage)4.3ProtocolBuffers(Protobuf)4.4MessagePack5.安全性考虑6.性能优化7.结论附录:常见问题解答Q1:什

- Java高频面试之集合-13

牛马baby

面试职场和发展java哈希算法HashMap

hello啊,各位观众姥爷们!!!本baby今天来报道了!哈哈哈哈哈嗝面试官:为什么hash函数能降哈希碰撞?哈希函数通过以下核心机制有效降低碰撞概率,确保不同输入尽可能映射到不同的哈希值:一、设计原理与数学基础均匀分布(UniformDistribution)目标:使任意输入经过哈希计算后,结果在输出空间中均匀分布。数学方法:利用模运算、位操作等,确保输入变化时哈希值的变化无规律。示例:#简单哈

- Java高频面试之集合-08

牛马baby

java面试python

hello啊,各位观众姥爷们!!!本baby今天来报道了!哈哈哈哈哈嗝面试官:详细说说CopyOnWriteArrayListCopyOnWriteArrayList详解CopyOnWriteArrayList是Java并发包(java.util.concurrent)中提供的线程安全列表,基于“写时复制”(Copy-On-Write)机制实现。它适用于读多写少的高并发场景,如事件监听器列表、配置

- Java高频面试之集合-02

牛马baby

java面试开发语言

hello啊,各位观众姥爷们!!!本baby今天来报道了!哈哈哈哈哈嗝面试官:说说队列queueJava队列(Queue)详解队列(Queue)是Java集合框架中一种先进先出(FIFO)的线性数据结构,广泛应用于生产者-消费者模型、任务调度、线程池等场景。Java提供了丰富的队列实现,涵盖线程安全、阻塞、优先级等特性。一、队列的核心接口与操作Java队列的顶层接口是java.util.Queue

- Java高频面试之集合-07

牛马baby

java面试开发语言

hello啊,各位观众姥爷们!!!本baby今天来报道了!哈哈哈哈哈嗝面试官:ArrayList和Vector的区别是什么?ArrayList与Vector的区别详解ArrayList和Vector都是Java中基于动态数组实现的List接口的实现类,但它们在设计、性能和线程安全性上有显著差异。以下是两者的核心区别:1.线程安全性特性ArrayListVector线程安全非线程安全(方法未同步)线

- Java高频面试之SE-23

牛马baby

java面试windows

hello啊,各位观众姥爷们!!!本baby今天又来了!哈哈哈哈哈嗝Java中的Stream是Java8引入的一种全新的数据处理方式,它基于函数式编程思想,提供了一种高效、简洁且灵活的方式来操作集合数据。Stream的核心思想是声明式编程(告诉程序“做什么”,而不是“怎么做”)。1.Stream的核心特点无存储:Stream不存储数据,只是对数据源的视图(如集合、数组、I/O通道等)。函数式操作:

- 2025计算机毕设全流程实战指南:Java/Python+协同过滤+小程序开发避坑手册

启点毕设

课程设计javapython大四论文指南查重降重技巧毕业设计spring

技术框架的选择是项目开发的关键起点,直接影响开发效率和最终成果质量。然而,许多开发者在选择技术框架时面临困难:现有知识储备不足以支撑复杂项目需求,团队经验有限,框架选择缺乏前瞻性常导致后期问题。尽管技术框架的选择过程充满挑战,但合适的框架能为项目开发和维护奠定基础,而不当的选择则可能带来持续的技术债务和开发困扰。所以,建议对项目技术框架把握不好的同学,最好是找自己的研究生学长或者老师详细的把关机技

- linux服务器上的项目读取本地文件,java访问linux服务器读取文件路径

防晒霜白癜风患者

java访问linux服务器读取文件路径内容精选换一换通过ADC将文件传输到Host。参见准备环境完成环境配置。以运行用户登录安装Toolkit组件的服务器。执行命令,将A.java文件传输到Host的指定路径下。adc--hostxx.xx.xx.xx:22118--sync/tmp/A.java"~/ide_daemon"将xx.xx.xx.xx替换为实际的Host的IP地址。如果Conv2D

- [0948]基于JAVA的城市路网智慧管理系统的设计与实现

阿鑫学长【毕设工场】

javapython人工智能毕业设计课程设计

毕业设计(论文)开题报告表姓名学院专业班级题目基于JAVA的城市路网智慧管理系统的设计与实现指导老师(一)选题的背景和意义开题报告背景与意义:随着我国城市化进程的加快,城市路网系统日益庞大复杂,交通管理面临的挑战愈发严峻。传统的路网管理模式由于信息更新不及时、数据处理效率低下、智能化程度不足等问题,已无法满足现代城市管理对高效、精准、智能交通管理的需求。因此,设计并实现一套基于Java的城市路网智

- 45-JavaEE 开发中的动态代理与序列化技术

只不过是胆小鬼罢了

WEB安全开发java

在JavaEE开发领域,动态代理与序列化技术是两个关键知识点,它们在很多场景下发挥着重要作用。以下是对这两部分知识的深入探讨。动态代理代理模式概述代理模式是Java中常用的设计模式之一,其核心思想是代理类与委托类实现相同的接口。代理类的主要职责是为委托类进行预处理、消息过滤、转发消息以及事后处理等操作。这种模式在很多场景下都有应用,比如权限控制、日志记录、事务管理等。JDK动态代理实现步骤创建接口

- Electron打包文件生成.exe文件打开即可使用

糕冷小美n

electronjavascript前端

1、Electron打包,包括需要下载的内容和环境配置步骤注意:Electron是一个使用JavaScript、HTML和CSS构建跨平台桌面应用程序的框架首先需要电脑环境有Node.js和npm我之前的文章有关nvm下载node的说明也可以去官网下载检查是否有node和npm环境命令node-vnpm-v输出版本号,说明安装成功2、创建Electron项目2.1创建项目目录打开命令行工具,创建一

- JavaScript基础-事件对象

難釋懷

javascript开发语言

在现代Web开发中,事件处理是实现动态和交互式网页的核心。当用户与页面进行交互时(如点击按钮、提交表单等),浏览器会生成相应的事件。为了有效地响应这些事件,JavaScript提供了事件对象,它包含了关于事件的详细信息。本文将详细介绍事件对象的概念、重要的属性和方法,并通过实例展示其应用场景。一、什么是事件对象?每当一个事件被触发时,浏览器都会创建一个事件对象,这个对象包含了该事件的所有相关信息,

- Java 常用类Date

浅橙boy

java开发语言

这次介绍Java中常用类中的一种Date,一般常用的Date的包名为util即java.util.Date。还有一种Date类的包名为spl即java.spl.Date,这次不做介绍。包名为spl的Date类作用于和spl数据库打交道,其内容只包括日期,没有时间,包名为util的Date类作用于平常日期使用其内容包括日期和时间,且大部分的构造器和方法已经过时了,下面介绍的是平时还可以使用的方法和构

- 学习-Java常用类之Calendar类

AIains

Educoder—Javajava

第1关:学习-Java常用类之Calendar类任务描述相关知识编程要求测试说明任务描述本关任务:获取给定年月的最后一天。相关知识我们通过之前的学习已经能够格式化并创建一个日期对象了,但是我们如何才能设置和获取日期数据的特定部分呢,比如说小时,日,或者分钟?我们又如何在日期的这些部分加上或者减去值呢?calendar类是一个抽象类,是Java日期处理的核心类之一。Calendar类为操作日历字段,

- Java基础回顾 Day5

小斌的Debug日记

Java基础回顾java开发语言

基础数据类型4类8种byte8位(常用流操作)short16位(运用场景不多)int32位(最常用)long64位(常用于表示时间毫秒)float32位(精度为7位,精度低)double64位(精度为15位,更常用)char16位(也可以算术运算)boolean8位(值为true或者false)基本数据类型的转换小转大为隐式转换,大转小为显式转换可能会丢失精度i++和++ii++是先取值在加1,而

- Three.js世界中的三要素:场景、相机、渲染器

Front_Yue

3D技术实践指南javascriptthree.js3d

一、Three.js简介Three.js是一个基于WebGL的JavaScript库,它允许开发者在网页上创建和显示复杂的3D图形和动画,而无需用户安装任何额外的插件或软件。Three.js在Web开发中的地位非常重要,它通过提供简单直观的API,极大地降低了3D图形开发的门槛,使得开发者可以更专注于实现创意。Three.js广泛应用于游戏开发、虚拟现实、数据可视化、艺术创作等多个领域。二、场景:

- 【Kivy App】Pyjnius是什么?

Botiway

移动APPKivypython

Pyjnius是一个Python库,用于在Python中访问Java类和方法,特别适用于在Kivy或其它Python应用中调用AndroidAPI。以下是Pyjnius的详细介绍、安装和使用方法:1.Pyjnius是什么?Pyjnius是一个Python-to-Java的桥接工具,允许Python代码直接调用Java类和方法。它基于JavaNativeInterface(JNI),主要用于以下场景

- 代码训练day7哈希表2

徵686

散列表数据结构

1.四数相加IIleetcode454哈希表判断是否存在classSolution{//四数相加ii统计个数publicintfourSumCount(int[]nums1,int[]nums2,int[]nums3,int[]nums4){HashMapmap=newHashMapmagazine.length())returnfalse;//java字符串长度s.length()for(cha

- 若依集成knife4j实现swagger文档增强

Roc-xb

knife4j

knife4j的前身是swagger-bootstrap-ui,为了契合微服务的架构发展,由于原来swagger-bootstrap-ui采用的是后端Java代码+前端Ui混合打包的方式,在微服务架构下显的很臃肿,因此项目正式更名为knife4j。目录一、单体版本1、ruoyi-admin\pom.xml模块添加整合依赖2、SwaggerController.java修改跳转访问地址二、前后端分离

- 猫头虎 分享已解决Bug || java.lang.ClassNotFoundException 全解析与解决方案

AI后端

已解决的Bug专栏bugjava开发语言服务发现rustpythonpip

猫头虎分享已解决Bug||java.lang.ClassNotFoundException全解析与解决方案摘要:最近有粉丝在后台留言,问到项目启动时遇到了一个经典问题:java.lang.ClassNotFoundException。这个问题看似简单,却困扰了无数开发者。今天,猫头虎以真实开发经历为背景,从Bug原因剖析到全方位解决方案,手把手带你攻克这个问题!本文涵盖了:问题原因:从类加载机制到

- Android Studio 中将 AAR 包发布到 Maven 本地仓库

帅次

AndroidStudioandroidstudiomavenandroidkotlinfluttergradlemacos

目录1.配置build.gradle.kts(或build.gradle)2.配置publishing任务3.发布到本地Maven仓库3.1Couldnotfindmethodpublications()forarguments...3.2bash:./gradlew:Permissiondenied3.3AndroidGradlepluginrequiresJava17torun.Youarec

- android视频缓存框架 [AndroidVideoCache](https://github.com/danikula/AndroidVideoCache) 源码解析与评估

MrJarvisDong

thirdparty源码

文章目录android视频缓存框架[AndroidVideoCache](https://github.com/danikula/AndroidVideoCache)源码解析与评估引言使用方式关键类解析HttpProxyCacheServer代理缓存服务类**java.net.ProxySelector**代理选择Pinger判断本地serverSocket是否存活GetRequest封装用于获取

- 基于JAVA中的spring框架和jsp实现自然灾害论坛平台项目【附项目源码+论文说明】

大雄是个程序员

项目实践自然灾害论坛平台java项目源码spring毕业设计课程设计网页设计

摘要在上个世纪末期,也就是20世纪末,随着计算机技术的发展与进步和数据库方面的知识在互联网的大力运用,互联网技术以及网站技术在网上的大力推广,网上论坛(自然灾害论坛)也逐渐在网兴起,它的出现帮助了网上各种特定的群体进行一个在线的知识传递与信息的交流。本计算机自然灾害论坛设计,采用了JSP(JAVA)技术和MYSQL数据库开发,尝试实现了自然灾害论坛的基本功能以及帮助我们掌握了论坛技术的核心特点。该

- Java架构师成长之路

hweiyu00

分享spring微服务springcloudjava

概述本教程主要从6个方面,全面讲解Java技术栈的知识。1.性能调优深入理解MySQL底层原理、索引逻辑,数据结构与算法。使用Explain进行优化分析MVCC原理剖析日志机制解析2.框架源码掌握Spring底层原理带你手写一个Spring解析IOC、AOP源码、以及事务原理3.并发编程剖析Java底层锁机制CAS、JUC工具使用、AQS源码分析以及并发的集合类的讲解4.分布式开发剖析分布式中使用

- Java面试高频问题深度解析:JVM、锁机制、SQL优化与并发处理

Debug Your Career

面试java面试jvm

问题列表Java中如何实现一个工作流引擎?Bean的作用域有哪些?JVM中的锁机制是如何工作的?三个方法分别被synchronized锁住,方法a调用方法b,b能获取到a的锁吗?会有什么问题?SQL优化时,EXPLAIN中需要关注哪些关键点?什么是覆盖索引?SELECT*一定不会命中索引吗?SELECT*和SELECT全字段在性能上有区别吗?什么是回表?它与索引有什么关系?100万数据分给10个线

- JavaScript基础-DOM的一些基本常用语法

Southern Wind

JavaScriptjavascript

总结了一下JS一直到DOM中所用的单词的用法输入方式:window.prompt('请输入数据');输出方式:1、window.alert('HelloJavaScript');2、console.log输出到控制台3、输出数据到页面document.write('hello')JavaScript数据类型1、基本类型string:字符型number:数值型boolean:布尔型2、特殊类型und

- CopyOnWriteArrayList详解

重生之我在成电转码

java开发语言集合

1️⃣什么是CopyOnWriteArrayList?java.util.concurrent包下的线程安全的List读多写少场景下的性能优选核心思想:写时复制(Copy-On-Write)2️⃣底层原理内部维护一个volatileObject[]array读操作:直接读取数组,不加锁,性能极高写操作(增删改):加ReentrantLock互斥锁把原数组复制一份新数组在新数组上操作操作完成后,替换

- JavaScript基础-删除事件(解绑事件)

難釋懷

javascript前端开发语言

在现代Web开发中,动态地添加和移除事件处理器是构建交互式网页的关键技能之一。虽然添加事件处理器相对直观,但了解如何有效地移除或“解绑”这些处理器同样重要。这不仅有助于优化性能,还能防止潜在的内存泄漏问题。本文将介绍几种方法来删除JavaScript中的事件处理器,并探讨它们的应用场景及最佳实践。一、为什么需要删除事件?随着页面复杂度的增加,不恰当地管理事件处理器可能会导致性能下降或出现意外行为。

- ASM系列五 利用TreeApi 解析生成Class

lijingyao8206

ASM字节码动态生成ClassNodeTreeAPI

前面CoreApi的介绍部分基本涵盖了ASMCore包下面的主要API及功能,其中还有一部分关于MetaData的解析和生成就不再赘述。这篇开始介绍ASM另一部分主要的Api。TreeApi。这一部分源码是关联的asm-tree-5.0.4的版本。

在介绍前,先要知道一点, Tree工程的接口基本可以完

- 链表树——复合数据结构应用实例

bardo

数据结构树型结构表结构设计链表菜单排序

我们清楚:数据库设计中,表结构设计的好坏,直接影响程序的复杂度。所以,本文就无限级分类(目录)树与链表的复合在表设计中的应用进行探讨。当然,什么是树,什么是链表,这里不作介绍。有兴趣可以去看相关的教材。

需求简介:

经常遇到这样的需求,我们希望能将保存在数据库中的树结构能够按确定的顺序读出来。比如,多级菜单、组织结构、商品分类。更具体的,我们希望某个二级菜单在这一级别中就是第一个。虽然它是最后

- 为啥要用位运算代替取模呢

chenchao051

位运算哈希汇编

在hash中查找key的时候,经常会发现用&取代%,先看两段代码吧,

JDK6中的HashMap中的indexFor方法:

/**

* Returns index for hash code h.

*/

static int indexFor(int h, int length) {

- 最近的情况

麦田的设计者

生活感悟计划软考想

今天是2015年4月27号

整理一下最近的思绪以及要完成的任务

1、最近在驾校科目二练车,每周四天,练三周。其实做什么都要用心,追求合理的途径解决。为

- PHP去掉字符串中最后一个字符的方法

IT独行者

PHP字符串

今天在PHP项目开发中遇到一个需求,去掉字符串中的最后一个字符 原字符串1,2,3,4,5,6, 去掉最后一个字符",",最终结果为1,2,3,4,5,6 代码如下:

$str = "1,2,3,4,5,6,";

$newstr = substr($str,0,strlen($str)-1);

echo $newstr;

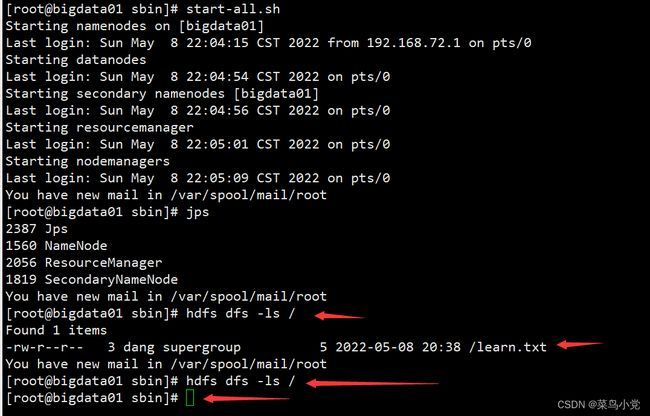

- hadoop在linux上单机安装过程

_wy_

linuxhadoop

1、安装JDK

jdk版本最好是1.6以上,可以使用执行命令java -version查看当前JAVA版本号,如果报命令不存在或版本比较低,则需要安装一个高版本的JDK,并在/etc/profile的文件末尾,根据本机JDK实际的安装位置加上以下几行:

export JAVA_HOME=/usr/java/jdk1.7.0_25

- JAVA进阶----分布式事务的一种简单处理方法

无量

多系统交互分布式事务

每个方法都是原子操作:

提供第三方服务的系统,要同时提供执行方法和对应的回滚方法

A系统调用B,C,D系统完成分布式事务

=========执行开始========

A.aa();

try {

B.bb();

} catch(Exception e) {

A.rollbackAa();

}

try {

C.cc();

} catch(Excep

- 安墨移动广 告:移动DSP厚积薄发 引领未来广 告业发展命脉

矮蛋蛋

hadoop互联网

“谁掌握了强大的DSP技术,谁将引领未来的广 告行业发展命脉。”2014年,移动广 告行业的热点非移动DSP莫属。各个圈子都在纷纷谈论,认为移动DSP是行业突破点,一时间许多移动广 告联盟风起云涌,竞相推出专属移动DSP产品。

到底什么是移动DSP呢?

DSP(Demand-SidePlatform),就是需求方平台,为解决广 告主投放的各种需求,真正实现人群定位的精准广

- myelipse设置

alafqq

IP

在一个项目的完整的生命周期中,其维护费用,往往是其开发费用的数倍。因此项目的可维护性、可复用性是衡量一个项目好坏的关键。而注释则是可维护性中必不可少的一环。

注释模板导入步骤

安装方法:

打开eclipse/myeclipse

选择 window-->Preferences-->JAVA-->Code-->Code

- java数组

百合不是茶

java数组

java数组的 声明 创建 初始化; java支持C语言

数组中的每个数都有唯一的一个下标

一维数组的定义 声明: int[] a = new int[3];声明数组中有三个数int[3]

int[] a 中有三个数,下标从0开始,可以同过for来遍历数组中的数

- javascript读取表单数据

bijian1013

JavaScript

利用javascript读取表单数据,可以利用以下三种方法获取:

1、通过表单ID属性:var a = document.getElementByIdx_x_x("id");

2、通过表单名称属性:var b = document.getElementsByName("name");

3、直接通过表单名字获取:var c = form.content.

- 探索JUnit4扩展:使用Theory

bijian1013

javaJUnitTheory

理论机制(Theory)

一.为什么要引用理论机制(Theory)

当今软件开发中,测试驱动开发(TDD — Test-driven development)越发流行。为什么 TDD 会如此流行呢?因为它确实拥有很多优点,它允许开发人员通过简单的例子来指定和表明他们代码的行为意图。

TDD 的优点:

&nb

- [Spring Data Mongo一]Spring Mongo Template操作MongoDB

bit1129

template

什么是Spring Data Mongo

Spring Data MongoDB项目对访问MongoDB的Java客户端API进行了封装,这种封装类似于Spring封装Hibernate和JDBC而提供的HibernateTemplate和JDBCTemplate,主要能力包括

1. 封装客户端跟MongoDB的链接管理

2. 文档-对象映射,通过注解:@Document(collectio

- 【Kafka八】Zookeeper上关于Kafka的配置信息

bit1129

zookeeper

问题:

1. Kafka的哪些信息记录在Zookeeper中 2. Consumer Group消费的每个Partition的Offset信息存放在什么位置

3. Topic的每个Partition存放在哪个Broker上的信息存放在哪里

4. Producer跟Zookeeper究竟有没有关系?没有关系!!!

//consumers、config、brokers、cont

- java OOM内存异常的四种类型及异常与解决方案

ronin47

java OOM 内存异常

OOM异常的四种类型:

一: StackOverflowError :通常因为递归函数引起(死递归,递归太深)。-Xss 128k 一般够用。

二: out Of memory: PermGen Space:通常是动态类大多,比如web 服务器自动更新部署时引起。-Xmx

- java-实现链表反转-递归和非递归实现

bylijinnan

java

20120422更新:

对链表中部分节点进行反转操作,这些节点相隔k个:

0->1->2->3->4->5->6->7->8->9

k=2

8->1->6->3->4->5->2->7->0->9

注意1 3 5 7 9 位置是不变的。

解法:

将链表拆成两部分:

a.0-&

- Netty源码学习-DelimiterBasedFrameDecoder

bylijinnan

javanetty

看DelimiterBasedFrameDecoder的API,有举例:

接收到的ChannelBuffer如下:

+--------------+

| ABC\nDEF\r\n |

+--------------+

经过DelimiterBasedFrameDecoder(Delimiters.lineDelimiter())之后,得到:

+-----+----

- linux的一些命令 -查看cc攻击-网口ip统计等

hotsunshine

linux

Linux判断CC攻击命令详解

2011年12月23日 ⁄ 安全 ⁄ 暂无评论

查看所有80端口的连接数

netstat -nat|grep -i '80'|wc -l

对连接的IP按连接数量进行排序

netstat -ntu | awk '{print $5}' | cut -d: -f1 | sort | uniq -c | sort -n

查看TCP连接状态

n

- Spring获取SessionFactory

ctrain

sessionFactory

String sql = "select sysdate from dual";

WebApplicationContext wac = ContextLoader.getCurrentWebApplicationContext();

String[] names = wac.getBeanDefinitionNames();

for(int i=0; i&

- Hive几种导出数据方式

daizj

hive数据导出

Hive几种导出数据方式

1.拷贝文件

如果数据文件恰好是用户需要的格式,那么只需要拷贝文件或文件夹就可以。

hadoop fs –cp source_path target_path

2.导出到本地文件系统

--不能使用insert into local directory来导出数据,会报错

--只能使用

- 编程之美

dcj3sjt126com

编程PHP重构

我个人的 PHP 编程经验中,递归调用常常与静态变量使用。静态变量的含义可以参考 PHP 手册。希望下面的代码,会更有利于对递归以及静态变量的理解

header("Content-type: text/plain");

function static_function () {

static $i = 0;

if ($i++ < 1

- Android保存用户名和密码

dcj3sjt126com

android

转自:http://www.2cto.com/kf/201401/272336.html

我们不管在开发一个项目或者使用别人的项目,都有用户登录功能,为了让用户的体验效果更好,我们通常会做一个功能,叫做保存用户,这样做的目地就是为了让用户下一次再使用该程序不会重新输入用户名和密码,这里我使用3种方式来存储用户名和密码

1、通过普通 的txt文本存储

2、通过properties属性文件进行存

- Oracle 复习笔记之同义词

eksliang

Oracle 同义词Oracle synonym

转载请出自出处:http://eksliang.iteye.com/blog/2098861

1.什么是同义词

同义词是现有模式对象的一个别名。

概念性的东西,什么是模式呢?创建一个用户,就相应的创建了 一个模式。模式是指数据库对象,是对用户所创建的数据对象的总称。模式对象包括表、视图、索引、同义词、序列、过

- Ajax案例

gongmeitao

Ajaxjsp

数据库采用Sql Server2005

项目名称为:Ajax_Demo

1.com.demo.conn包

package com.demo.conn;

import java.sql.Connection;import java.sql.DriverManager;import java.sql.SQLException;

//获取数据库连接的类public class DBConnec

- ASP.NET中Request.RawUrl、Request.Url的区别

hvt

.netWebC#asp.nethovertree

如果访问的地址是:http://h.keleyi.com/guestbook/addmessage.aspx?key=hovertree%3C&n=myslider#zonemenu那么Request.Url.ToString() 的值是:http://h.keleyi.com/guestbook/addmessage.aspx?key=hovertree<&

- SVG 教程 (七)SVG 实例,SVG 参考手册

天梯梦

svg

SVG 实例 在线实例

下面的例子是把SVG代码直接嵌入到HTML代码中。

谷歌Chrome,火狐,Internet Explorer9,和Safari都支持。

注意:下面的例子将不会在Opera运行,即使Opera支持SVG - 它也不支持SVG在HTML代码中直接使用。 SVG 实例

SVG基本形状

一个圆

矩形

不透明矩形

一个矩形不透明2

一个带圆角矩

- 事务管理

luyulong

javaspring编程事务

事物管理

spring事物的好处

为不同的事物API提供了一致的编程模型

支持声明式事务管理

提供比大多数事务API更简单更易于使用的编程式事务管理API

整合spring的各种数据访问抽象

TransactionDefinition

定义了事务策略

int getIsolationLevel()得到当前事务的隔离级别

READ_COMMITTED

- 基础数据结构和算法十一:Red-black binary search tree

sunwinner

AlgorithmRed-black

The insertion algorithm for 2-3 trees just described is not difficult to understand; now, we will see that it is also not difficult to implement. We will consider a simple representation known

- centos同步时间

stunizhengjia

linux集群同步时间

做了集群,时间的同步就显得非常必要了。 以下是查到的如何做时间同步。 在CentOS 5不再区分客户端和服务器,只要配置了NTP,它就会提供NTP服务。 1)确认已经ntp程序包: # yum install ntp 2)配置时间源(默认就行,不需要修改) # vi /etc/ntp.conf server pool.ntp.o

- ITeye 9月技术图书有奖试读获奖名单公布

ITeye管理员

ITeye

ITeye携手博文视点举办的9月技术图书有奖试读活动已圆满结束,非常感谢广大用户对本次活动的关注与参与。 9月试读活动回顾:http://webmaster.iteye.com/blog/2118112本次技术图书试读活动的优秀奖获奖名单及相应作品如下(优秀文章有很多,但名额有限,没获奖并不代表不优秀):

《NFC:Arduino、Andro