这就是你日日夜夜想要的docker!!!---------Docker资源控制--Cgroup

文章目录

- 一、什么是 Cgroup?

- 二、使用 stress 工具测试 CPU 和内存

-

- 1、stress工具介绍

- 2、使用 Dockerfile 来创建一个 stress 的工具镜像:

- 三、实操

-

- 1、CPU弹性的加权值--cpu-shares

- 2、--cpu-period、–cpu-quota 控制容器 CPU 时钟周期

- 3、--cpuset-cpus 控制cpu核心数

- 4、 --cpuset-cpus 指定核心数和 --cpu-shares 权重结合使用

- 5、内存限额

- 6、Block IO 的限制

- 7、bps 和 iops 的限制

默认情况下容器是没有资源限制的,因为它本身就是一个进程,当一个容器占用太多资源的话,会对其他容器产生影响,所以 ,合理应该分配容器资源是作为管理员必须要关注的问题。

一、什么是 Cgroup?

Docker通过 Cgroup 来控制容器使用的资源配额,包括 CPU、内存、磁盘三大方面,基本覆盖了常见的资源配额和使用量控制。

Cgroup 是 Linux 内核提供的一种可以限制、记录、隔离进程组所使用的物理资源的机制。

Cgroup 子系统

- blkio:设置限制每个块设备的输入输出控制;

- cpu:使用调度程序为 cgroup 任务提供 cpu 的访问;

- memory:设置每个 cgroup 的内存限制以及产生内存资源报告;

- cpuacct:产生 cgroup 任务的 cpu 资源报告;

- cpuset:如果是多核心的 cpu,这个子系统会为 cgroup 任务分配单独的 cpu 和内存;

- devices:允许或拒绝 cgroup 任务对设备的访问;

- freezer:暂停和恢复 cgroup 任务;

- net_cls:标记每个网络包以供 cgroup 方便使用;

- ns:命名空间子系统;

- perf_event:增加了对每个 cgroup 的监测跟踪能力,可以监测属于某个特定的 cgroup 的所有线程及运行在特定 CPU 上的线程;

二、使用 stress 工具测试 CPU 和内存

1、stress工具介绍

stress 是Unix类系统下的工作量和压力测试工具。它将对用户指定的CPU数量的I/O,内存和硬盘的负载并报告它检测到任何错误。它用于自动压力测试和调试系统组件失败的唯一或更经常负荷时。它可以运行在x86,ppc64的,和PPC 32 GNU / Linux的,Tru64的,SPARC Solaris的,和其他平台。

2、使用 Dockerfile 来创建一个 stress 的工具镜像:

首先使用 Dockerfile 来创建一个基于 Centos 的 stress 的工具镜像

[root@localhost ~]# mkdir /opt/stress

[root@localhost ~]# cd /opt/stress/

[root@localhost stress]# vim Dockerfile

FROM centos:7

RUN yum install -y wget

RUN wget -O /etc/yum.repos.d/epel.repo http://mirrors.aliyun.com/repo/epel-7.repo

RUN yum install -y stress

[root@localhost stress]# docker build -t centos:stress . 创建镜像

三、实操

1、CPU弹性的加权值–cpu-shares

默认情况下,每个 Docker 容器的CPU的份额都是1024,单独一个容器的份额是没有意义的。只有在同时运行多个容器时,容器的 CPU 加权的效果才能体现出来。

例如,两个容器 A、B 的CPU份额分别是 1000 和 500 ,在 CPU 进行时间片分配的时候,容器A比容器B多一倍的机会获得 CPU 的时间片。但分配的结果取决于当时主机和其他容器的运行状态,实际上也无法保证容器 A 一定能获得CPU 时间片。比如容器 A 的进程一直是空闲的,那么容器 B 是可以获取比容器 A 更多的 CPU 时间片。极端情况下,例如主机上只运行了一个容器,即使它的 CPU 份额只有 50,它也可以独占整个主机的 CPU 资源。

Cgroup 只在容器分配的资源紧缺时,即在需要对容器使用的资源进行限制时,才会生效。因此,无法单纯根据某个容器的 CPU 份额来确定有多少 CPU 资源分配给它,资源分配结果取决于同时运行的其他容器的 CPU 分配和容器中进程运行情况。可以通过 cpu share 可以设置容器使用 CPU 的优先级。

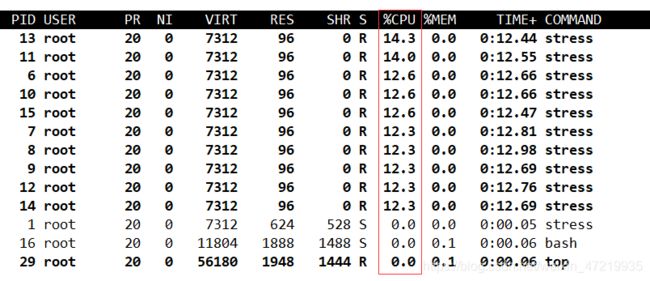

//容器产生10个子函数进程:

[root@localhost stress]# docker run -itd --name cpu512 --cpu-shares 512 centos:stress stress -c 10

99086cce962308fdb5417df189571e39f375ab2c067887cbac48e773225f25c7

//进入容器再使用top命令查看cpu使用情况:

[root@localhost stress]# docker exec -it 99086cce9623 bash

[root@99086cce9623 /]# top

.. ..

.. ..

.. ..

.. ..

按 q 退出,

[root@99086cce9623 /]# exit //退出整个容器

此时,我们可以再开启另外一个容器做比较:

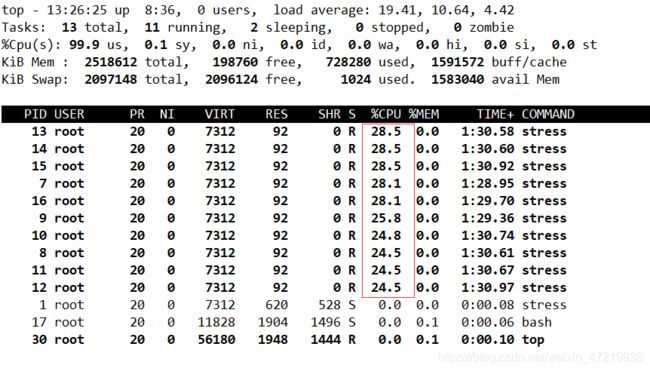

[root@localhost stress]# docker run -itd --name cpu1024 --cpu-shares 1024 centos:stress stress -c 10

81e29988fce779c6b3e10fb8570ae2358db4090e1987202bb7919260287eca66

[root@localhost stress]# docker exec -it 81e29988fce7 bash

[root@81e29988fce7 /]# top

通过进入容器,观察两个容器的 %CPU,可以发现比例是 1:2

2、–cpu-period、–cpu-quota 控制容器 CPU 时钟周期

- –cpu-period :是用来指定容器对 CPU 的使用要在多长时间内做一次重新分配。

- –cpu-quota :是用来指定在这个周期内,最多可以有多少时间用来跑这个容器。

- 与 --cpu-shares 不同的是。这种配置是指定一个绝对值,容器对 CPU 资源的使用绝对不会超过配置的值。

注意:

- cpu-period 和 cpu-quota 的单位是微秒;

- cpu-period 的最小值是1000微秒,最大值为1秒,默认值为0.1秒。

- cpu-quota 的值默认是 -1 ,表示不做控制;

- cpu-period 和 cpu-quota 参数一般联合使用。

容器进程需要每一秒使用单个 CPU 的0.2秒时间,可以将 cpu-period 设置为 1000000(即1秒),cpu-quota 设置为 200000(0.2秒)

当然,在多核情况下,如果允许容器进程完全占有两个 CPU,则可以将 cpu-period 设置为 100000(即0.1秒),cpu-quota 设置为 200000(0.2秒),cpu刷新是0.1秒间隔 那么我在你这使用了0.1秒后还有0.1秒怎么办,就让下一个cpu来处理

[root@localhost stress]# docker run -itd --cpu-period 100000 --cpu-quota 200000 centos:stress

3f2a577cf6a281347338cbf9734440b3b8a29e771dc4890a9f243eb0773f6c09

[root@localhost stress]# docker exec -it 3f2a577cf6a2 bash

[root@3f2a577cf6a2 /]# cat /sys/fs/cgroup/cpu/cpu.cfs_period_us

100000

[root@3f2a577cf6a2 /]# cat /sys/fs/cgroup/cpu/cpu.cfs_quota_us

200000

3、–cpuset-cpus 控制cpu核心数

对于多核 CPU 的服务器,Docker 还可以控制容器运行使用哪些 CPU 内核,即使用 --cpuset-cpus 参数。这对具有多 CPU 的服务器尤其有用,可以对需要高性能计算的容器进行性能最优配置。

[root@localhost ~]# docker run -itd --name cpu02 --cpuset-cpus=0-2 centos:stress

76994f5d310de48ee635f69270f7c9b4cba1e65aad935ff1e0d6e098441104eb

//执行该命令(需要宿主机为四核),表示创建的容器只能使用0、1、2 三个内核。

[root@localhost ~]# docker exec -it 76994f5d310d bash //进入容器

[root@76994f5d310d /]# cat /sys/fs/cgroup/cpuset/cpuset.cpus

0-2

通过下面指令可以看到容器中进程与 CPU 内核的绑定关系,达到 CPU 内核的目的:

[root@localhost ~]# docker exec 76994f5d310d taskset -c -p 1

pid 1's current affinity list: 0-2

//容器内部第一个进程号 pid为1,被绑定到指定CPU上运行。

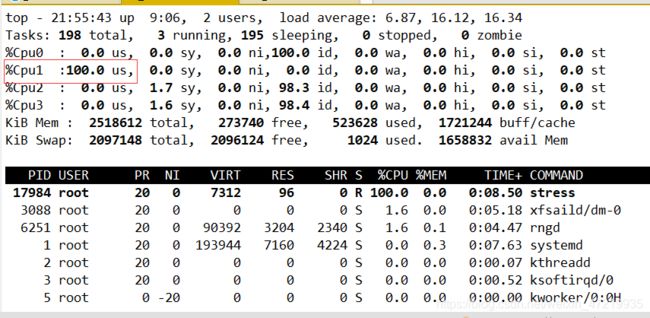

4、 --cpuset-cpus 指定核心数和 --cpu-shares 权重结合使用

通过 cpuset-cpus 参数指定容器 A 使用 CPU 内核 0,容器B 只是用 CPU 内核1;在主机上只有这两个容器使用对应 CPU 内核的情况,它们各自占有全部的内核资源,cpu-shares 没有明显效果。cpuset-cpus、cpuset-mems 参数只在多核、多内存节点上的服务器上有效,并且必须与实际的物理配置匹配,否则也无法达到资源控制的目的。在系统具有多个 CPU 内核的情况下,需要通过 cpuset-cpus 参数为设置容器 CPU 内核才能方便地进行测试。

[root@localhost ~]# docker run -itd --name cpu3 --cpuset-cpus 1 --cpu-shares 512 centos:stress stress -c 1

d6e122af832297a05b6993ea3146a2a62969557989933ac9f1bf59f2a1de5c50

[root@localhost ~]# docker exec -it d6e122af8322 bash

[root@d6e122af8322 /]# top //top查看后,按1可以看到每个核心的占用情况

此时返回真机查看,只有cpu2,刚才指定的cpu在满额跑,此时看不出权重的效果,再重新开一个容器进行试验

我们再创建一个容器:

[root@localhost ~]# docker run -itd --name cpu4 --cpuset-cpus 3 --cpu-shares 1024 centos:stress stress -c 1

d375a1ba761a711d55a01d95c7a5d494e62f86d447d36422be666cacf6483ca1

[root@localhost ~]# docker exec -it d375a1ba761a bash

[root@d375a1ba761a /]# top

此时发现刚才分配的–cpu-shares权重毫无效果,说明在不同cpu之间的权重是不生效的,默认全部跑满

5、内存限额

与操作系统类似,容器可使用的内存包括两部分:物理内存 和 Swap;

docker 通过下面两组参数来控制容器内存的使用量:

-m 或 --memory:设置内存的使用限额,例如 100M、1024M;

–memory-swap:设置内存 +swap 的使用限额。

例如:执行如下命令允许该容器最多使用 200M的内存,300M 的swap:

[root@localhost ~]# docker run -it -m 200M --memory-swap=300M progrium/stress --vm 1 --vm-bytes 280M

// --vm 1:启动1个内存工作线程;

--vm-bytes 280M :每个线程分配280M内存;

-m:设置内存限制为200M

-memory-swap:设置内存加swap的使用限额

如果让工作线程分配的内存超过 300M,分配的内存超过限额,stress线程报错,容器退出:

[root@localhost ~]# docker run -it -m 200M --memory-swap=300M progrium/stress --vm 1 --vm-bytes 310M

6、Block IO 的限制

默认情况下,所有容器能平等地读写磁盘,可以通过设置 --blkio-weight 参数来改变容器 block IO 的优先级。

–blkio-weight 与 --cpu-shares 类似,设置的是相对权重值,默认为500

在下面的例子中,容器 A 读写磁盘的带宽是容器 B 的两倍:

[root@localhost ~]# docker run -it --name container_A --blkio-weight 600 centos:stress

[root@0f9b8d716206 /]# cat /sys/fs/cgroup/blkio/blkio.weight

[root@localhost ~]# docker run -it --name container_B --blkio-weight 300 centos:stress

[root@55bdce1cab5d /]# cat /sys/fs/cgroup/blkio/blkio.weight

7、bps 和 iops 的限制

-

bps :是 byte per second,每秒读写的数据量;

-

iops :是 io per second,每秒 IO 的次数;

可以通过以下的参数来控制 bps 和 iops:

- device-read-bps:限制读某个设备的 bps;

- device-write-bps:限制写某个设备的 bps;

- device-read-iops:限制读某个设备的 iops;

- device-write-iops:限制写某个设备的 iops。

例如:

限制容器 写 /dev/sda 磁盘的速率为 5MB/s:

[root@localhost ~]# docker run -it --device-write-bps /dev/sda:5MB centos:stress

[root@ec0ec2adf134 /]# dd if=/dev/zero of=test bs=1M count=1024 oflag=direct

// direct:读写数据采用直接IO方式 bs 数据块大小为1m count个数为1024个

^C780+0 records in

780+0 records out

817889280 bytes (818 MB) copied, 156.018 s, 5.2 MB/s

[root@localhost ~]# dd if=/dev/zero of=test bs=1M count=1024 oflag=direct

^C记录了390+0 的读入

记录了390+0 的写出

408944640字节(409 MB)已复制,1.48195 秒,276 MB/秒