Python爬虫编程:数据解析模块之bs4,超详细

一、bs4简介

BeautifulSoup,是python中的一个库,是一个可以从HTML或XML文件中提取数据的Python库;它能够通过提供一些简单的函数用来处理导航、搜索、修改分析树等功能。它是一个工具箱,通过解析文档为用户提供需要抓取的数据,因为简单,所以不需要多少代码就可以写出一个完整的应用程序。Beautiful Soup会帮你节省数小时甚至数天的工作时间。

Beautiful Soup自动将输入文档转换为Unicode编码,输出文档转换为utf-8编码。你不需要考虑编码方式,除非文档没有指定一个编码方式,这时,Beautiful Soup就不能自动识别编码方式了。然后,你仅仅需要说明一下原始编码方式就可以了。

Beautiful Soup已成为和lxml、html6lib一样出色的python解释器,为用户灵活地提供不同的解析策略或强劲的速度。

二、使用方法步骤

1.安装bs4

pip install bs4

mamba install bs4 -c conda-forge2.首先导入bs4库

from bs4 import BeautifulSoup3.利用requests打开网址

当然您也可以用其他方法打开网址。以https://www.sina.com.cn/为例

import requests

url = "https://www.sina.com.cn/"

r1 = requests.get(url,'lxml')

r1.encoding='utf-8'

#print (r1.text)输出的结果就是网页的内容。

4.创造一个BeautifulSoup对象

soup =BeautifulSoup(r1.text,'lxml')

#print(soup)两个参数:第一个参数是要解析的html文本,第二个参数是使用那种解析器,对于HTML来讲就是html.parser,这个是bs4自带的解析器。

如果一段HTML或XML文档格式不正确的话,那么在不同的解析器中返回的结果可能是不一样的。

| 解析器 |

使用方法 |

优势 |

| python标准库 |

BeautifulSoup(html, “html.parser”) |

1、Python的内置标准库 |

| lxml HTML |

BeautifulSoup(html, “lxml”) |

1.速度快 |

| lxml XML |

BeautifulSoup(html, [“lxml”, “xml”]) BeautifulSoup(html, “xml”) |

1.速度快 |

| html5lib |

BeautifulSoup(html, “html5lib”) |

1.做好的容错性 |

5.对获取到的源码进行筛选和处理

然后通过这个对象来实现对获取到的源码进行筛选和处理

print(soup.prettify()) #格式化输出全部内容

print(soup.标签名)

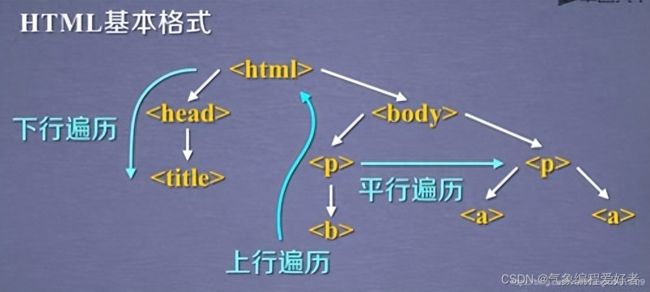

#标签名有html,head,title,meta,body,script,style等等https://pic.sogou.com/d?query=BS4%20%E5%9B%BE%E7%89%87&forbidqc=&entityid=&preQuery=&rawQuery=&queryList=&st=&did=43三、bs4对象的转换

将一段文档传入BeautifulSoup的构造方法,就能得到一个文档的对象

from bs4 import BeautifulSoup

# 获得文档对象 - soup

soup = BeautifulSoup(open(文档路径, encoding=编码格式),features=解析器)或传入字符串或文件句柄

# 传入字符串

soup = BeautifulSoup('recall', features='lxml')

# 输出recall

# 传入文件句柄

soup = BeautifulSoup('recall')

# 输出recall

解析过程:

文档被转换成Unicode,并且HTML实例都被转换成Unicode编码

BeautifulSoup选择最合适的解析器来解析这段文档,如果手动指定解析器,那么BeautifulSoup会选择指定解析器来解析指定文档

注意:默认解析器情况下,BeautifulSoup会将当前文档作为HTML格式解析,如果要解析XML文档,需要指定"xml"解析器

四、 对象的种类

BeautifulSoup将复杂的HTML文档解转换成一个复杂的树形结构,每个节点都是python对象,所有对象可以归纳为4种:Tag, NavigableString, BeautifulSoup, Comment

1.Tag(标签)

tag对象与XML或HTML原生文档中的tag相同。

soup = BeautifulSoup('recall', features='lxml')

tag_soup = soup.a

print(type(tag_soup))

#输出:

tag的属性

tag中最重要的属性:name和attributes

(1)每个tag都有自己的名字,通过.name来获取

soup = BeautifulSoup('recall', features='lxml')

print(soup.a)

#liyuhong

print(soup.a.name)

#atag.name值的改变(将改变HTML文档):

soup.a.name = "p"

print(soup.a)

#None

print(soup.p)

#recall

解析过程:

(2)一个tag可能有多个属性,操作与字典相同,通过.attrs来获取。

soup = BeautifulSoup('liyuhong', features='lxml')

# 字典操作

soup.a.attrs['class']

#['celebrity']

# 或直接取点属性

soup.a.attrs

#{'class': ['celebrity']}(3)tag.attrs的改变(改、增、删)

soup = BeautifulSoup('li', features='lxml')

# 直接打印源tag

print(soup.a)

#li

# 1.改变属性的值

soup.a.attrs['class'] = 'ljj'

print(soup.a)

#li

# 2.添加属性的值

soup.a.attrs['id'] = 'li'

print(soup.a)

#li

# 3.删除属性的值

del soup.a.attrs['class']

print(soup.a)

#li多值属性:最常见的多值属性是class,多值属性的返回 list。

soup = BeautifulSoup('li', features='lxml')

print(soup.a)

print(soup.a.attrs['class']

# 两个值的class属性

#li

#['celebrity', 'ljj']2.NavigableString(标签的值)

字符串常包含在tag内。BeautifulSoup常用NavigableString类来包装tag中的字符串。但是字符串中不能包含其他 tag。

soup = BeautifulSoup('li', features='lxml')

print(soup.a.string)

#li

print(type(soup.a.string))

#tag中包含的字符串不能被编辑,但是可以被替换成其他字符串,用replace_with()方法

soup = BeautifulSoup('li', features='lxml')

soup.a.string.replace_with('UFO')

print(soup.a.string)

#UFO

print(soup.a)

UFO3.BeautifulSoup(文档)

BeautifulSoup 对象表示的是一个文档的全部内容。大部分时候,可以把它当作 Tag 对象。但是 BeautifulSoup 对象并不是真正的 HTM L或 XML 的 tag,它没有attribute属性,name 属性是一个值为“[document]”的特殊属性。

print(soup.name)

#[document]

print(type(soup))

#4.Comment(注释及特殊字符串)

特殊类型的NavigableString,comment一般表示文档的注释部分。

a1 = BeautifulSoup("")

comment = a1.b.string

print(comment) # This is a comment

print(type(comment)) # 五、bs4语法

(一)获取属性

# 获取p标签的属性

# 方法一

soup.p.attrs(返回字典) or soup.p.attrs['class'](class返回列表,其余属性返回字符串)

# 方法二

soup.p['class'](class返回列表,其余属性返回字符串)

# 方法三

soup.p.get('class')(class返回列表,其余属性返回字符串)(二)获取文本

# 获取标签的值的三种方法

soup.p.string

soup.p.text

soup.p.get.text()注意:当标签的内容还有标签时,string方法返回为None,而其他两个方法获取纯文本内容

(三)find方法

返回一个对象

soup.find('a')

soup.find('a', class_='xxx') # 注意class后的下划线

soup.find('a', title='xxx')

soup.find('a', id='xxx')

soup.find('a', id=compile(r'xxx'))注意:find只能找到符合要求的第一个标签,他返回的时一个对象

(四)find_all方法

返回一个列表,列表里是所有符合要求的对象

soup.find_all('a')

soup.find_all(['a','span']) #返回所有的a和span标签

soup.find_all('a', class_='xxx')

soup.find_all('a', id=compile(r'xxx'))

# 提取出前两个符合要求的

soup.find_all('a', limit=3)(五)select方法

返回列表。类似CSS写法来筛选元素,标签名不加任何修饰,类名加点,id名加#

1. 通过标签名查找

soup.select('a')

soup.select('a, span') # 注意引号的位置2.通过类名查找

soup.select('.class')3.通过id名查找

soup.select('#id')4. 通过子标签查找

# 直接子元素(必须相邻)

soup.select('body > div >a')

# 间接子元素(不需相邻)

soup.select('body a')5.组合查找

标签名、类名、id名进行组合,空格隔开

soup.select('a #id')6.属性查找

soup.select('a[href="https://www.baidu.com"]')六、CSS选择器

BS4 支持大部分的 CSS 选择器,比如常见的标签选择器、类选择器、id 选择器,以及层级选择器。Beautiful Soup 提供了一个 select() 方法,通过向该方法中添加选择器,就可以在 HTML 文档中搜索到与之对应的内容。

css的规则:

标签名不加任何修饰,类名前加点,id名前加#,在这里用的方法大致是一样的,用到的方法是soup.select(),它的返回值是一个列表list

#通过标签名字

print(soup.select('title'))

#通过类名

print(soup.select('.class'))

#通过id

print(soup.select('#a_1'))组合查找

这里和在写css的格式是一样的

print(soup.select('.class #id'))

#意思是查找.class类下的id是id的元素子查询

print(soup.select('head > title'))

属性查找

print(soup.select(p[class="new"]))