用于事件论元抽取的上下文软提示(ACL2023)

Contextualized Soft Prompts for Extraction of Event Arguments

1、写作动机:

现有的基于提示的方法主要依赖于离散和手动设计的提示,无法利用每个示例的具体上下文来提高定制化,以实现最佳性能。此外,当前提示的离散性质阻碍了将来自多个外部文档的相关上下文合并到丰富EAE提示中。

2、主要贡献:

提出了一种新颖的基于提示的EAE方法,明确引入可学习的软提示,以实现对示例的提示定制、稳定性改进和相关示例上下文的整合。

3、模型:

3.1相关符号:

D = {D1, . . . , D|D|}为训练数据中的文档集,ek ∈ Di为文档Di中的当前事件触发词,其事件类型为et。T={t1,...,t|T|}为事件类型集合。

3.2相关上下文聚合:

模型首先旨在从D中与ek的事件类型et相关的文档中聚合上下文表示,以丰富软提示计算。

第一步:构建文档集D和事件类型T之间的事件类型提及图G,以促进表示聚合。具体而言,图的节点集V包括文档D和事件类型T,即V = D ∪ T。仅当Du ∈ D和G中存在类型为tv的事件提及时,才在G中连接文档Du和事件类型tv。

第二步:在Du中的每个事件触发词ek之前和之后引入标记

第三步:通过对事件触发词ek的

第四步:然后,图G和文档和事件类型的表示D0u和t0v通过图注意力网络,通过G中的连接聚合表示,生成富含信息的Du和tv的表示DLu和tLv。将et的表示et_hat看作下一步ek ∈ Di的提示计算的相关文档的上下文信息的聚合。

3.3软提示计算:

设ek_hat是是BART编码的事件触发词ek的表示。那么,EAE模型对于Di中的触发词ek的软提示将是一个大小为Ms × d的矩阵Psoft,其中Ms是一个超参数,d是核心模型BART中隐藏向量的维数,从而允许Psoft集成到BART的计算中。

为了在模型中实现ek的软提示Psoft,将使用ek的上下文表示ek_hat来计算Psoft。此外,如上所述,Psoft还将根据ek的事件类型et的相关上下文表示的聚合et_hat进行调整,以丰富提示并促进事件论元提取。为此,使用一个可学习的前馈网络FF将ek和tLk的连接变换成大小为Ms × d的向量。然后,将该向量重塑为我们的软提示Psoft = reshape(FF([ek_hat; et_hat]))。

3.4基于提示的事件论元提取:

以Life.Consume.Unspecified为例,代表事件论元的硬提示为:

第一步:对于每个事件类型t,将其硬提示送到BART的embedding层,从而得到硬提示表示Pthard,大小为Mth × d(Mth是t的硬提示长度)。然后,将软提示和硬提示表示连接起来,创建一个用于EAE的单个提示Pr,即Prt = [Pthard, Psoft],大小为(Ms + Mth)×d。

第二步:使用BART编码器对Di的输入上下文进行编码,而提示Pt将用于提示BART解码器进行跨度提取。给定当前触发词ek ∈ Di,首先在Di中的ek之前和之后注入触发标记

第三步:使用BART解码器通过多层中的交叉注意力学习上下文和提示的更丰富表示,返回用于上下文和提示的表示Ddeci = BART-Decoder(Denci; Denci)和Prt _hat= BART-Decoder(Pr; Denci)。

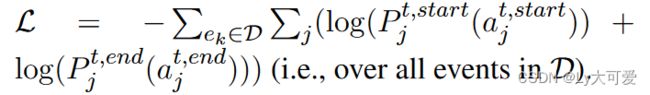

第四步:随后,对于事件类型t的第j个参数角色,通过对提示表示Prt_hat中对应的子token表示进行平均池化,得到一个角色表示φtj。我们使用两个选择头sstart和send(维度为d)来计算开始和结束跨度选择器φt,startj = φtj ⊙ sstart和φt,endj = φtj ⊙ send。每个跨度选择器元组θtj =(φt,startj,φt,endj)旨在选择t的第j个角色的至多一个跨度。若无该觉得跨度,则设置为(0,0)。在Di中每个token作为角色j的论元跨度的可能性的分布:Pt,startj = softmax(φt,startj Ddeci),Pt,endj = softmax(φt,endj Ddeci)。模型的损失函数:

3.5如何推理:

给定输入文本、事件类型和参数角色,我们考虑该角色的所有可能参数跨度,确保开始索引小于结束索引(包括(0,0)),其长度不超过在训练数据上计算的最大值。对于每个跨度,使用概率log(Pt,startj)+ log(Pt,endj)计算得分。

4、实验:

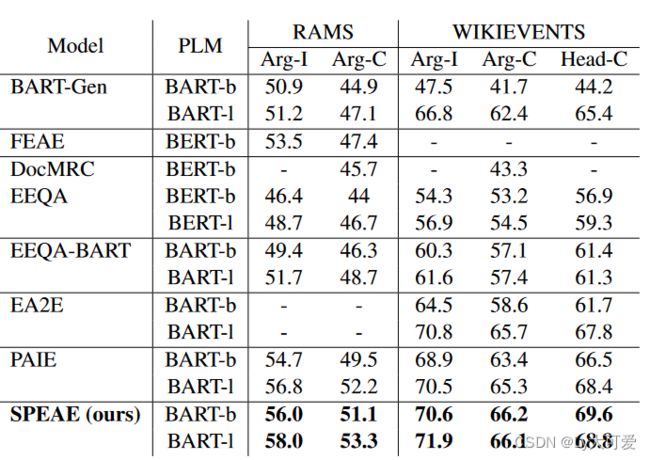

使用RAMS数据集和WIKIEVENTS数据集。

4.1比较实验:

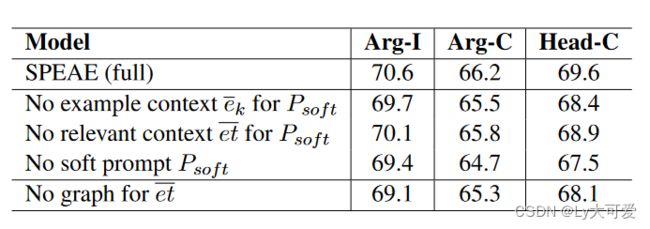

4.2消融实验:

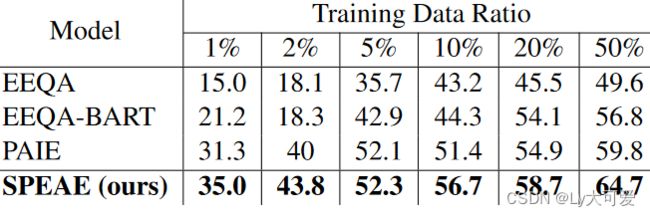

4.3低资源学习:

5、局限性:

1)本文的EAE方法使用了事件提及图,但是只考虑了GAT方法。

2)仍然需要依赖于离散提示来明确指定事件类型和论元角色。

3)软提示可解释性差。