负载均衡(1)

文章目录

- 一、为什么要使用负载均衡

-

- 四层负载均衡

- 七层负载均衡

- 四层负载均衡与七层负载均衡区别

- 二、Nginx负载均衡配置场景

-

- Nginx upstream虚拟配置语法

- 环境准备

- Web01服务器上配置nginx

- Web02服务器上配置nginx

- 配置Nginx负载均衡

- 负载均衡常见典型故障

- 三、Nginx负载均衡调度算法

-

- Nginx负载均衡[rr]轮询具体配置

- Nginx负载均衡[wrr]权重轮询具体配置

- Nginx负载均衡ip_hash

- 四、Nginx负载均衡后端状态

-

- 测试down状态测试该server不参与负载均衡的调度

- 测试backup以及down状态

- 测试max_fails失败次数和fail_timeout多少时间内失败多少次则标记down

- 测试max_conns最大TCP连接数

- 五、Nginx负载均衡健康检查

- 六、Nginx负载均衡会话保持

-

- 会话保持配置

- 安装phpmyadmin

- 使用浏览器访问页面,获取cookie信息

- 使用redis解决会话登录问题

- 七、Nginx四层负载均衡概述

-

- 四层+七层构建大规模集群架构使用场景

- 四层负载均衡总结

- Nginx四层负载均衡场景实践

- Nginx四层负载均衡端口转发

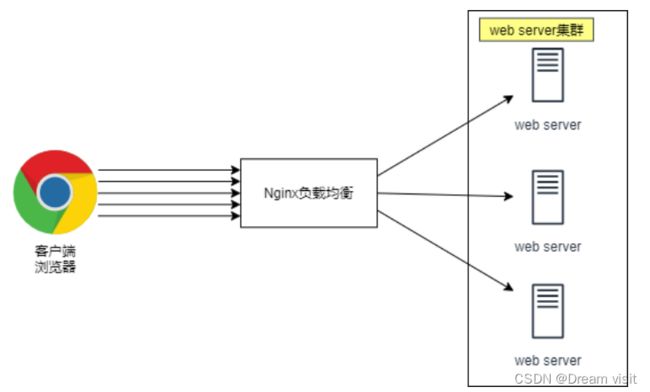

一、为什么要使用负载均衡

-

当我们的Web服务器直接面向用户,往往要承载大量并发请求,单台服务器难以负荷,我使用多台Web服务器组成集群,前端使用Nginx负载均衡,将请求分散的打到我们的后端服务器集群中,实现负载的分发。那么会大大提升系统的吞吐率、请求性能、高容灾

-

往往我们接触的最多的是

SLB(Server Load Balance)负载均衡,实现最多的也是SLB、那么SLB它的调度节点和服务节点通常是在一个地域里面。那么它在这个小的逻辑地域里面决定了他对部分服务的实时性、响应性是非常好的。 -

所以说当海量用户请求过来以后,它同样是请求调度节点,调度节点将用户的请求转发给后端对应的服务节点,服务节点处理完请求后在转发给调度节点,调度节点最后响应给用户节点。这样也能实现一个均衡的作用,那么Nginx则是一个典型的

SLB -

负载均衡的叫法有很多

- 负载均衡

- Load Balance

- LB

-

公有云中叫法

-

SLB 阿里云负载均衡

-

QLB 青云负载均衡

-

CLB 腾讯云负载均衡

-

ULB ucloud负载均衡

-

-

常见的负载均衡的软件

- Nginx

- Haproxy

- LVS

四层负载均衡

所谓四层负载均衡指的是 OSI 七层模型中的传输层,那么传输层Nginx已经能支持TCP/IP的控制,所以只需要对客户端的请求进行TCP/IP协议的包转发就可以实现负载均衡,那么它的好处是性能非常快、只需要底层进行应用处理,而不需要进行一些复杂的逻辑。

七层负载均衡

七层负载均衡它是在应用层,那么它可以完成很多应用方面的协议请求,比如我们说的http应用的负载均衡,它可以实现http信息的改写、头信息的改写、安全应用规则控制、URL匹配规则控制、以及转发、rewrite等等的规则,所以在应用层的服务里面,我们可以做的内容就更多,那么Nginx则是一个典型的七层负载均衡 SLB

四层负载均衡与七层负载均衡区别

四层负载均衡数据包在底层就进行了分发,而七层负载均衡数据包则是在最顶层进行分发、由此可以看出,七层负载均衡效率没有四负载均衡高。

但七层负载均衡更贴近于服务,如:http协议就是七层协议,我们可以用Nginx可以作会话保持,URL路径规则匹配、head头改写等等,这些是四层负载均衡无法实现的。

二、Nginx负载均衡配置场景

Nginx要实现负载均衡需要用到 proxy_pass 代理模块配置.

Nginx负载均衡与Nginx代理不同地方在于,Nginx的一个 location 仅能代理一台服务器,而Nginx负载均衡则是将客户端请求代理转发至一组upstream虚拟服务池.

Nginx upstream虚拟配置语法

Syntax: upstream name { ... }

Default: -

Context: http

#upstream例

upstream backend {

server backend1.example.com weight=5;

server backend2.example.com:8080;

server unix:/tmp/backend3;

server backup1.example.com:8080 backup;

}

server {

location / {

proxy_pass http://backend;

}

}

环境准备

| 角色 | 地址 | 主机名 |

|---|---|---|

| LB01 | ens33:192.168.175.10 | lb01 |

| web01 | ens33:192.168.175.20 | web01 |

| web02 | ens33:192.168.175.30 | web02 |

Web01服务器上配置nginx

[root@web01 ~]# cd /etc/nginx/conf.d/

[root@web01 conf.d]# vim node.conf

server {

listen 80;

server_name node.test.com;

location / {

root /code/node;

index index.html;

}

}

[root@web01 conf.d]# mkdir -p /code/node

[root@web01 conf.d]# echo "web01 ..." > /code/node/index.html

[root@web01 conf.d]# systemctl restart nginx

Web02服务器上配置nginx

[root@web02 ~]# cd /etc/nginx/conf.d/

[root@web02 conf.d]# vim node.conf

server {

listen 80;

server_name node.test.com;

location / {

root /code/node;

index index.html;

}

}

[root@web02 conf.d]# mkdir -p /code/node

[root@web02 conf.d]# echo "web02 ..." > /code/node/index.html

[root@web02 conf.d]# systemctl restart nginx

配置Nginx负载均衡

[root@lb01 ~]# cd /etc/nginx/conf.d/

[root@lb01 conf.d]# vim /etc/nginx/proxy_params

proxy_set_header Host $http_host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_connect_timeout 30;

proxy_send_timeout 60;

proxy_read_timeout 60;

proxy_buffering on;

proxy_buffer_size 32k;

proxy_buffers 4 128k;

[root@lb01 conf.d]# vim node_proxy.conf

upstream node {

server 192.168.175.20:80;

server 192.168.175.30:80;

}

server {

listen 80;

server_name node.test.com;

location / {

proxy_pass http://node;

include proxy_params;

}

}

[root@lb01 conf.d]# nginx -t

[root@lb01 conf.d]# systemctl restart nginx

负载均衡常见典型故障

如果后台服务连接超时,Nginx是本身是有机制的,如果出现一个节点down掉的时候,Nginx会更据你具体负载均衡的设置,将请求转移到其他的节点上,但是,如果后台服务连接没有down掉,但是返回错误异常码了如:504、502、500,这个时候你需要加一个负载均衡的设置,如下:

proxy_next_upstream http_500 | http_502 | http_503 | http_504 |http_404;意思是,当其中一台返回错误码404,500…等错误时,可以分配到下一台服务器程序继续处理,提高平台访问成功率。

server {

listen 80;

server_name node.test.com;

location / {

proxy_pass http://node;

proxy_next_upstream error timeout http_500 http_502 http_503 http_504 http_404;

}

}

三、Nginx负载均衡调度算法

| 调度算法 | 概述 |

|---|---|

| 轮询 | 按时间顺序逐一分配到不同的后端服务器(默认) |

| weight | 加权轮询,weight值越大,分配到的访问几率越高 |

| ip_hash | 每个请求按访问IP的hash结果分配,这样来自同一IP的固定访问一个后端服务器 |

| url_hash | 按照访问URL的hash结果来分配请求,是每个URL定向到同一个后端服务器 |

| least_conn | 最少链接数,那个机器链接数少就分发 |

Nginx负载均衡[rr]轮询具体配置

upstream load_pass {

server 192.168.175.10:80;

server 192.168.175.20:80;

}

Nginx负载均衡[wrr]权重轮询具体配置

upstream load_pass {

server 192.168.175.10:80 weight=5;

server 192.168.175.20:80;

}

Nginx负载均衡ip_hash

- 具体配置不能和weight一起使用。

#如果客户端都走相同代理, 会导致某一台服务器连接过多

upstream load_pass {

ip_hash;

server 192.168.175.10:80;

server 192.168.175.20:80;

}

四、Nginx负载均衡后端状态

- 后端Web服务器在前端Nginx负载均衡调度中的状态

| 状态 | 概述 |

|---|---|

| down | 当前的server暂时不参与负载均衡 |

| backup | 预留的备份服务器 |

| max_fails | 允许请求失败的次数 |

| fail_timeout | 经过max_fails失败后, 服务暂停时间 |

| max_conns | 限制最大的接收连接数 |

测试down状态测试该server不参与负载均衡的调度

upstream load_pass {

#不参与任何调度, 一般用于停机维护

server 192.168.175.10:80 down;

}

测试backup以及down状态

upstream load_pass {

server 192.168.175.10:80 backup;

server 192.168.175.20:80 max_fails=1 fail_timeout=10s;

}

location / {

proxy_pass http://load_pass;

include proxy_params;

}

测试max_fails失败次数和fail_timeout多少时间内失败多少次则标记down

upstream load_pass {

server 192.168.175.10:80;

server 192.168.175.20:80 max_fails=2 fail_timeout=10s;

}

测试max_conns最大TCP连接数

upstream load_pass {

server 192.168.175.10:80;

server 192.168.175.20:80 max_conns=1;

}

五、Nginx负载均衡健康检查

-

在Nginx官方模块提供的模块中,没有对负载均衡后端节点的健康检查模块,但可以使用第三方模块。

nginx_upstream_check_module来检测后端服务的健康状态。 -

第三方模块项目地址:https://github.com/yaoweibin/nginx_upstream_check_module

-

安装依赖包

[root@lb01 ~]# yum install -y gcc glibc gcc-c++ pcre-devel openssl-devel patch unzip wget

- 下载nginx源码包以及nginx_upstream_check模块第三方模块

[root@lb01 ~]# cd ~

[root@lb01 ~]# wget https://nginx.org/download/nginx-1.14.2.tar.gz

[root@lb01 ~]# wget https://github.com/yaoweibin/nginx_upstream_check_module/archive/master.zip

- 解压nginx源码包以及第三方模块

[root@lb01 ~]# tar xf nginx-1.14.2.tar.gz

[root@lb01 ~]# unzip master.zip

- 进入nginx目录,打补丁(nginx的版本是1.14补丁就选择1.14的,p1代表在nginx目录,p0是不在nginx目录)

#关闭原来yum装的nginx

[root@lb01 ~]# systemctl stop nginx

[root@lb01 ~]# cd nginx-1.14.2

[root@lb01 nginx-1.14.2]# ./configure --prefix=/etc/nginx --sbin-path=/usr/sbin/nginx --modules-path=/usr/lib64/nginx/modules --conf-path=/etc/nginx/nginx.conf --error-log-path=/var/log/nginx/error.log --http-log-path=/var/log/nginx/access.log --pid-path=/var/run/nginx.pid --lock-path=/var/run/nginx.lock --http-client-body-temp-path=/var/cache/nginx/client_temp --http-proxy-temp-path=/var/cache/nginx/proxy_temp --http-fastcgi-temp-path=/var/cache/nginx/fastcgi_temp --http-uwsgi-temp-path=/var/cache/nginx/uwsgi_temp --http-scgi-temp-path=/var/cache/nginx/scgi_temp --user=nginx --group=nginx --with-compat --with-file-aio --with-threads --with-http_addition_module --with-http_auth_request_module --with-http_dav_module --with-http_flv_module --with-http_gunzip_module --with-http_gzip_static_module --with-http_mp4_module --with-http_random_index_module --with-http_realip_module --with-http_secure_link_module --with-http_slice_module --with-http_ssl_module --with-http_stub_status_module --with-http_sub_module --with-http_v2_module --with-mail --with-mail_ssl_module --with-stream --with-stream_realip_module --with-stream_ssl_module --with-stream_ssl_preread_module --add-module=/root/nginx_upstream_check_module-master --with-cc-opt='-O2 -g -pipe -Wall -Wp,-D_FORTIFY_SOURCE=2 -fexceptions -fstack-protector-strong --param=ssp-buffer-size=4 -grecord-gcc-switches -m64 -mtune=generic -fPIC' --with-ld-opt='-Wl,-z,relro -Wl,-z,now -pie'

[root@lb01 ~]# cd /root/nginx-1.14.2

[root@lb01 ~]# patch -p1 < /root/nginx_upstream_check_module-master/check_1.14.0+.patch

[root@lb01 nginx-1.14.2]# make && make install

[root@lb01 nginx-1.14.2]# nginx -v

nginx version: nginx/1.14.2

- 在已有的负载均衡上增加健康检查的功能

[root@lb01 conf.d]# vim /etc/nginx/conf.d/proxy_web.conf

upstream node {

server 192.168.175.10:80;

server 192.168.175.20:80;

check interval=3000 rise=2 fall=3 timeout=1000 type=tcp;

#interval 检测间隔时间,单位为毫秒

#rise 表示请求2次正常,标记此后端的状态为up

#fall 表示请求3次失败,标记此后端的状态为down

#type 类型为tcp

#timeout 超时时间,单位为毫秒

}

server {

listen 80;

server_name node.test.com;

location / {

proxy_pass http://node;

include proxy_params;

}

location /upstream_check {

check_status;

}

}

抓包可以看到周期性的进行tcp syn检测连接状态

也可以改为用http类型去检测,type修改为http

check interval=3000 rise=2 fall=3 timeout=1000 type=http;

六、Nginx负载均衡会话保持

-

在使用负载均衡的时候会遇到会话保持的问题,可通过如下方式进行解决。

- 使用nginx的ip_hash,根据客户端的IP,将请求分配到对应的IP上

- 基于服务端的session会话共享(NFS,MySQL,memcache,redis,file)

-

在解决负载均衡会话问题,我们需要了解session和cookie的区别。

- 浏览器端存的是cookie每次浏览器发请求到服务端时,报文头是会自动添加cookie信息的。

- 服务端会查询用户的cookie作为key去存储里找对应的value(session)

- 同一域名下的网站的cookie都是一样的,所以无论几台服务器,无论请求分配到哪一台服务器上同一用户的cookie是不变的。也就是说cookie对应的session也是唯一的。所以,这里只要保证多台业务服务器访问同一个共享存储服务器(NFS,MySQL,memcache,redis,file)就行了。

会话保持配置

- 配置Nginx(两台机器都要配置)

[root@web01 ~]# vim /etc/nginx/conf.d/php.conf

server {

listen 80;

server_name php.test.com;

root /code/phpMyAdmin-4.8.4-all-languages;

location / {

index index.php index.html;

}

location ~ \.php$ {

fastcgi_pass 127.0.0.1:9000;

fastcgi_param SCRIPT_FILENAME $document_root$fastcgi_script_name;

include fastcgi_params;

}

}

[root@web01 ~]# nginx -t

[root@web01 ~]# systemctl restart nginx

[root@web02 ~]# vim /etc/nginx/conf.d/php.conf

server {

listen 80;

server_name php.test.com;

root /code/phpMyAdmin-4.8.4-all-languages;

location / {

index index.php index.html;

}

location ~ \.php$ {

fastcgi_pass 127.0.0.1:9000;

fastcgi_param SCRIPT_FILENAME $document_root$fastcgi_script_name;

include fastcgi_params;

}

}

[root@web02 ~]# nginx -t

[root@web02 ~]# systemctl restart nginx

安装phpmyadmin

web01和web02上都装

- 使用第三方扩展源安装php7.1

[root@localhost ~]# vim /etc/yum.repos.d/php.repo

[php]

name = php Repository

baseurl = https://repo.webtatic.com/yum/el7/x86_64/

gpgcheck = 0

[root@localhost ~]# yum install -y epel-release

[root@localhost ~]# yum -y install php71w php71w-cli php71w-common php71w-devel php71w-embedded php71w-gd php71w-mcrypt php71w-mbstring php71w-pdo php71w-xml php71w-fpm php71w-mysqlnd php71w-opcache php71wpecl-memcached php71w-pecl-redis php71w-pecl-mongodb unzip

配置php-fpm用户与nginx的运行用户保持一致

[root@localhost ~]# sed -i '/^user/c user = nginx' /etc/php-fpm.d/www.conf

[root@localhost ~]# sed -i '/^group/c user = nginx' /etc/php-fpm.d/www.conf

启动php-fpm并加入开机自启

[root@localhost ~]# systemctl start php-fpm

[root@localhost ~]# systemctl enable php-fpm

安装mariadb数据库(可以在负载均衡服务器上安装)

[root@localhost ~]# yum install mariadb-server mariadb -y

[root@localhost ~]# systemctl start mariadb

[root@localhost ~]# systemctl enable mariadb

[root@localhost ~]# mysqladmin password '123456'

[root@localhost ~]# mysql -uroot -p123456

MariaDB [(none)]> grant all privileges on *.* to root@'%' identified by '123456' with grant option;

登录mysql中开启root的远程登录权限,否则phpmyadmin上连接不了mysql

- 安装phpmyadmin

[root@web01 ~]# cd /code

[root@web01 code]# wget https://files.phpmyadmin.net/phpMyAdmin/4.8.4/phpMyAdmin-4.8.4-all-languages.zip

[root@web01 code]# unzip phpMyAdmin-4.8.4-all-languages.zip

- 配置phpmyadmin连接远程的数据库,这个数据库可以安装在代理服务器上后做测试

[root@web01 code]# cd phpMyAdmin-4.8.4-all-languages/

[root@web01 phpMyAdmin-4.8.4-all-languages]# cp config.sample.inc.php config.inc.php

[root@web01 phpMyAdmin-4.8.4-all-languages]# vim config.inc.php

$cfg['Servers'][$i]['host'] = '192.168.175.10'

- 配置权限

[root@web01 ~]# chown -R nginx.nginx /var/lib/php/

访问http://php.test.com/index.php

使用浏览器访问页面,获取cookie信息

- 查看服务器上的session

[root@web01 ~]# ll /var/lib/php/session/

总用量 4

-rw------- 1 nginx nginx 2625 7月 11 20:08 sess_aa3bdfab93197f49bbfddb15cb41a595

- 将web01上配置好的phpmyadmin以及nginx的配置文件推送到web02主机上

[root@web01 code]# scp -rp phpMyAdmin-4.8.4-all-languages root@192.168.175.30:/code/

[root@web01 code]# scp /etc/nginx/conf.d/php.conf root@192.168.175.30:/etc/nginx/conf.d/

- 在web02上重启Nginx服务

[root@web02 ~]# systemctl restart nginx

- 在web02上配置权限

[root@web02 ~]# chown -R nginx.nginx /var/lib/php/

- 接入负载均衡

[root@lb01 ~]# vim /etc/nginx/conf.d/proxy_php.com.conf

upstream php {

server 192.168.175.20:80;

server 192.168.175.30:80;

}

server {

listen 80;

server_name php.test.com;

location / {

proxy_pass http://php;

include proxy_params;

}

}

[root@lb01 ~]# nginx -t

[root@lb01 ~]# systemctl restart nginx

- 使用负载均衡的轮询功能之后,会发现,如果将session保存在本地文件的话,永远都登录不上去。

使用redis解决会话登录问题

- 安装redis内存数据库

#!/bin/bash

. /etc/init.d/functions

VERSION=redis-5.0.9

DIR1=/apps/redis

PASSWORD=centos

install() {

yum -y install make wget gcc tcl &> /dev/null || { action "安装所需包失败,请检测包或网络配置" false;exit;}

wget http://download.redis.io/releases/${VERSION}.tar.gz &> /dev/null || { action "Redis 源码下载失败" false; exit; }

tar xf $VERSION.tar.gz

cd $VERSION/

make -j 2 &> /dev/null && make PREFIX=${DIR1} install &> /dev/null && action "Redis 编译安装成功" || { action "Redis 编译安装失败" false;exit; }

ln -s ${DIR1}/bin/* /usr/bin/

mkdir -p ${DIR1}/{etc,data,log,run}

cd

cp $VERSION/redis.conf $DIR1/etc

sed -i -e "s/bind 127.0.0.1/bind 0.0.0.0/" -e "/# requirepass/a requirepass ${PASSWORD}" -e "/^dir .*/c dir ${DIR1}/data/" -e "/logfile .*/c logfile ${DIR1}/log/redis_6379.log" -e "/^pidfile .*/c pidfile ${DIR1}/run/redis_6379.pid" ${DIR1}/etc/redis.conf

if id redis &> /dev/null;then

action "redis 用户已经存在" false

else

useradd -r -s /sbin/nologin redis

action "redis 用户创建成功"

fi

chown -R redis.redis ${DIR1}

cat >> /etc/sysctl.conf <<EOF

net.core.somaxconn = 1024

vm.overcommit_memory = 1

EOF

sysctl -p

echo never > /sys/kernel/mm/transparent_hugepage/enabled

echo "echo never > /sys/kernel/mm/transparent_hugepage/enabled" >> /etc/rc.d/rc.local

chmod +x /etc/rc.d/rc.local

/etc/rc.d/rc.local

cat > /lib/systemd/system/redis.service <<EOF

[Unit]

Description=Redis persistent key-value database

After=network.target

[Service]

ExecStart=${DIR1}/bin/redis-server ${DIR1}/etc/redis.conf --supervised systemd

ExecStop=/bin/kill -s QUIT \$MAINPID

Type=notify

User=redis

Group=redis

RuntimeDirectory=redis

RuntimeDirectoryMode=0755

[Install]

WantedBy=multi-user.target

EOF

systemctl daemon-reload

systemctl enable --now redis &> /dev/null && action "redis 服务启动成功" || { action "redis 服务启动失败" false;exit; }

}

install

[root@lb01 ~]# redis-cli -a centos

- php配置session连接redis

[root@web01 ~]# vim /etc/php.ini

session.save_handler = redis

session.save_path = "tcp://192.168.175.10:6379"

;session.save_path = "tcp://192.168.175.10:6379?auth=centos" #如果redis存在密码,则使用该方式

session.auto_start = 1 #开启session.auto_start的优点在于,任何时候都不会因忘记执行session_start()或session_start()在程序里的位置不对,而导致错误;缺点在于,如果你使用的是第三方代码,则必须删去其中的全部 session_start(),否则将不能得到正确的结果。

[root@web01 ~]# vim /etc/php-fpm.d/www.conf

#注释php-fpm.d/www.conf里面的两条内容,否则session内容会一直写入/var/lib/php/session 目录中

;php_value[session.save_handler] = files

;php_value[session.save_path] = /var/lib/php/session

- 重启php-fpm nginx

[root@web01 ~]# systemctl restart php-fpm

[root@web01 ~]# systemctl restart nginx

- 将web01上配置好的文件推送到web02

[root@web01 ~]# scp /etc/php.ini root@192.168.175.30:/etc/php.ini

[root@web01 ~]# scp /etc/php-fpm.d/www.conf root@192.168.175.30:/etc/phpfpm.d/www.conf

- 在web02上重启php-fpm nginx

[root@web02 ~]# systemctl restart php-fpm

[root@web02 ~]# systemctl restart nginx

- redis查看数据

[root@lb01 ~]# redis-cli -a centos

127.0.0.1:6379> keys *

1) "PHPREDIS_SESSION:7e772fe37b1488069e3c54e419df7eda"

七、Nginx四层负载均衡概述

四层负载均衡是基于传输层协议包来封装的(如:TCP/IP),那我们前面使用到的七层是指的应用层,他的组装在四层的基础之上,无论四层还是七层都是指的OSI网络模型。

四层+七层来做负载均衡,四层可以保证七层的负载均衡的高可用性;如:nginx就无法保证自己的服务高可用,需要依赖LVS或者keepalive。

如:tcp协议的负载均衡,有些请求是TCP协议的(mysql、ssh),或者说这些请求只需要使用四层进行端口的转发就可以了,所以使用四层负载均衡。

四层+七层构建大规模集群架构使用场景

四层负载均衡总结

- 四层负载均衡仅能转发TCP/IP协议、UDP协议、通常用来转发端口,如:tcp/22、udp/53;

- 四层负载均衡可以用来解决七层负载均衡端口限制问题;(七层负载均衡最大使用65535个端口号)

- 四层负载均衡可以解决七层负载均衡高可用问题;(多台后端七层负载均衡能同时的使用)

- 四层的转发效率比七层的高得多,但仅支持tcp/ip协议,不支持http和https协议;

- 通常大并发场景通常会选择使用在七层负载前面增加四层负载均衡。

Nginx四层负载均衡场景实践

Nginx如何配置四层负载均衡

1、通过访问负载均衡的5555端口,实际是后端的web01的22端口在提供服务;

2、通过访问负载均衡的6666端口,实际是后端的mysql的3306端口在提供服务。

- 创建存放四层负载均衡配置文件的目录

[root@lb01 ~]# vim /etc/nginx/nginx.conf

include /etc/nginx/conf.c/*.conf;

#include /etc/nginx/conf.d/*.conf;

[root@lb01 ~]# mkdir /etc/nginx/conf.c

- 配置四层负载均衡

[root@lb01 ~]# vim /etc/nginx/conf.c/lb_domain.conf

stream {

upstream lb {

server 192.168.175.20:80 weight=5 max_fails=3 fail_timeout=30s;

server 192.168.175.30:80 weight=5 max_fails=3 fail_timeout=30s;

}

server {

listen 8080;

proxy_connect_timeout 3s;

proxy_timeout 3s;

proxy_pass lb;

}

}

- 四层负载均衡开启日志

- 四层负载均衡是没有access的日志的,因为在nginx.conf的配置中,access的日志格式是配置在http下的,而四层负载均衡配置是在http以外的

- 如果需要日志则需要配置在stream下面

[root@lb01 ~]# cd /etc/nginx/conf.c/

[root@lb01 conf.c]# vim lb_domain.conf

stream {

log_format proxy '$remote_addr $remote_port - [$time_local] $status $protocol '

'"$upstream_addr" "$upstream_bytes_sent" "$upstream_connect_time"';

access_log /var/log/nginx/proxy.log proxy;

upstream lb {

server 192.168.175.20:80 weight=5 max_fails=3 fail_timeout=30s;

server 192.168.175.30:80 weight=5 max_fails=3 fail_timeout=30s;

}

server {

listen 8080;

proxy_connect_timeout 3s;

proxy_timeout 3s;

proxy_pass lb;

}

}

[root@lb01 conf.c]# nginx -t

[root@lb01 conf.c]# systemctl restart nginx

- 浏览器访问域名或者IP,查看日志

[root@lb01 conf.c]# tail -f /var/log/nginx/proxy.log

192.168.175.1 55295 - [11/Jul/2021:23:27:09 +0800] 200 TCP "192.168.175.20:80" "0" "0.001"

192.168.175.1 64066 - [11/Jul/2021:23:27:13 +0800] 200 TCP "192.168.175.30:80" "0" "0.000"

192.168.175.1 58528 - [11/Jul/2021:23:27:16 +0800] 200 TCP "192.168.175.20:80" "0" "0.001"

192.168.175.1 65099 - [11/Jul/2021:23:27:20 +0800] 200 TCP "192.168.175.30:80" "0" "0.000"

192.168.175.1 55919 - [11/Jul/2021:23:27:20 +0800] 200 TCP "192.168.175.20:80" "6460" "0.001"

Nginx四层负载均衡端口转发

- 使用nginx四层负载均衡实现tcp的转发

请求负载均衡 5555 ---> 192.168.175.20:22;

请求负载均衡 6666 ---> 192.168.175.30:3306;

- 配置nginx四层负载均衡实现tcp的转发

[root@lb01 ~]# vim /etc/nginx/conf.c/lb_domain.conf

stream {

log_format proxy '$remote_addr $remote_port - [$time_local] $status $protocol '

'"$upstream_addr" "$upstream_bytes_sent" "$upstream_connect_time"' ;

access_log /var/log/nginx/proxy.log proxy;

#定义转发ssh的22端口

upstream ssh {

server 192.168.175.20:22;

}

#定义转发mysql的3306端口

upstream mysql {

server 192.168.175.30:3306;

}

server {

listen 5555;

proxy_connect_timeout 3s;

proxy_timeout 300s;

proxy_pass ssh;

}

server {

listen 6666;

proxy_connect_timeout 3s;

proxy_timeout 3s;

proxy_pass mysql;

}

}

[root@lb01 ~]# nginx -t

[root@lb01 ~]# systemctl restart nginx

- 测试

使用xshell测试ssh

ssh root@192.168.175.10 5555

命令行测试mysql连接

[root@web02 conf.d] # mysql -uroot -p123456 -h192.168.175.10 -P6666 -e"select user,host from mysql.user;"