中文语音标注工具FunASR(语音识别)

全称 A Fundamental End-to-End Speech Recognition Toolkit(一个语音识别工具)

可能大家用过whisper(openAi),它【标注英语的确很完美】,【但中文会出现标注错误】或搞了个没说的词替换上去,所以要人工核对,麻烦。

FunASR作用:能【准确】识别语音,并转成【文字、标出声调】

他的原理,就不讲了,俺是搞大数据的,python这东西就勉强能写个爬虫和接口,机器学习和ai相关的算法是0基础。

直接实战吧

首先,冲他这句话,我要给他点个赞!!!很是感动。

分2个步骤,安装和模型

安装:

目前只支持cpu方式(等gpu版本出来了,那速度更上一层楼)

我们这里是用作标注,标注是对每一句进行标注,所以很短,就【采用实时模型】。

ps:离线的模型太牛了,可以一次性标注几十小时的,感觉适合翻译有声阅读,感觉应用场景比较少

中文实时语音听写服务CPU版本部署

docker安装,不是我吹,docker是目前世界上最好的部署方法。

我建了一个文件夹fun_asr_docker_service 所有的命令默认都在这个文件夹下操作

有docker的同学-可以忽略下面这个

1.安装docker(可以忽略)

curl -O https://isv-data.oss-cn-hangzhou.aliyuncs.com/ics/MaaS/ASR/shell/install_docker.sh

sudo bash install_docker.sh2.启动docker镜像

拉取镜像(大概将近4GB)

sudo docker pull \

registry.cn-hangzhou.aliyuncs.com/funasr_repo/funasr:funasr-runtime-sdk-online-cpu-0.1.5名字挺长的,改个名

sudo docker tag registry.cn-hangzhou.aliyuncs.com/funasr_repo/funasr:funasr-runtime-sdk-online-cpu-0.1.5 fun_asr建立模型文件夹(对项目不熟悉的新手别乱改名哈--这个是阿里教程里的)

mkdir -p ./funasr-runtime-resources/models启动镜像(命令会进去镜像里面)

sudo docker run -p 10096:10095 -it --privileged=true \

-v $PWD/funasr-runtime-resources/models:/workspace/models \

fun_asr3.启动服务

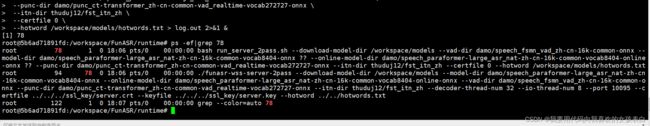

然后在docker镜像里面执行

cd FunASR/runtime

nohup bash run_server_2pass.sh \

--download-model-dir /workspace/models \

--vad-dir damo/speech_fsmn_vad_zh-cn-16k-common-onnx \

--model-dir damo/speech_paraformer-large_asr_nat-zh-cn-16k-common-vocab8404-onnx \

--online-model-dir damo/speech_paraformer-large_asr_nat-zh-cn-16k-common-vocab8404-online-onnx \

--punc-dir damo/punc_ct-transformer_zh-cn-common-vad_realtime-vocab272727-onnx \

--itn-dir thuduj12/fst_itn_zh \

--certfile 0 \

--hotword /workspace/models/hotwords.txt > log.out 2>&1 &服务参数说明(具体是啥意思,看这个表)

# 如果您想关闭ssl,增加参数:--certfile 0 # 如果您想使用时间戳或者nn热词模型进行部署,请设置--model-dir为对应模型: # damo/speech_paraformer-large-vad-punc_asr_nat-zh-cn-16k-common-vocab8404-onnx(时间戳) # damo/speech_paraformer-large-contextual_asr_nat-zh-cn-16k-common-vocab8404-onnx(nn热词) # 如果您想在服务端加载热词,请在宿主机文件./funasr-runtime-resources/models/hotwords.txt配置热词(docker映射地址为/workspace/models/hotwords.txt): # 每行一个热词,格式(热词 权重):阿里巴巴 20 --download-model-dir 模型下载地址,通过设置model ID从Modelscope下载模型 --model-dir modelscope model ID 或者 本地模型路径 --online-model-dir modelscope model ID 或者 本地模型路径 --quantize True为量化ASR模型,False为非量化ASR模型,默认是True --vad-dir modelscope model ID 或者 本地模型路径 --vad-quant True为量化VAD模型,False为非量化VAD模型,默认是True --punc-dir modelscope model ID 或者 本地模型路径 --punc-quant True为量化PUNC模型,False为非量化PUNC模型,默认是True --itn-dir modelscope model ID 或者 本地模型路径 --port 服务端监听的端口号,默认为 10095 --decoder-thread-num 服务端线程池个数(支持的最大并发路数), 脚本会根据服务器线程数自动配置decoder-thread-num、io-thread-num --io-thread-num 服务端启动的IO线程数 --model-thread-num 每路识别的内部线程数(控制ONNX模型的并行),默认为 1, 其中建议 decoder-thread-num*model-thread-num 等于总线程数 --certfile ssl的证书文件,默认为:../../../ssl_key/server.crt,如果需要关闭ssl,参数设置为0 --keyfile ssl的密钥文件,默认为:../../../ssl_key/server.key --hotword 热词文件路径,每行一个热词,格式:热词 权重(例如:阿里巴巴 20), 如果客户端提供热词,则与客户端提供的热词合并一起使用,服务端热词全局生效,客户端热词只针对对应客户端生效。

启动成功

4.客户端测试

下载测试的打包文件(这里面包含了所有的客户端demo源文件)

wget https://isv-data.oss-cn-hangzhou.aliyuncs.com/ics/MaaS/ASR/sample/funasr_samples.tar.gz

python测试

先在本地跑,然后要安装web-socket和pyauidio

python funasr_wss_client.py --host "ip" --port 10095 --mode 2pass --audio_in audio.wav

windows参考:---下面的第三种【 语音问题 】解决在win 32/64上无法安装 pyaudio ?_pyaudio安装 windows-CSDN博客

其他测试demo方法参考:

https://github.com/alibaba-damo-academy/FunASR/blob/main/runtime/docs/SDK_tutorial_online_zh.md#html-client

模型:

中文模型有【2个常用】

paraformer-zh(非实时,会生成时间戳)

paraformer-zh-online(实时,不会生成时间戳)

参考:

GitHub - alibaba-damo-academy/FunASR: A Fundamental End-to-End Speech Recognition Toolkit and Open Source SOTA Pretrained Models.

阿里达摩院开源大型端到端语音识别工具包FunASR | 弥合学术与工业应用之间的差距 - 知乎