在eclipse下编译hadoop2.0源码

Hadoop是一个分布式系统基础架构,由apache基金会维护并更新。官网地址: http://hadoop.apache.org/

Hadoop项目主要包括以下4个模块:

- Hadoop Common: 为其他Hadoop模块提供基础设施。

- Hadoop HDFS: 一个高高靠、高吞吐量的分布式文件系统。

- Hadoop MapReduce: 一个分布式的计算框架,包括任务调度和集群资源管理。

- Hadoop YARN: 一个新的MapReduce框架。有兴趣的同学请参考: http://www.ibm.com/developerworks/cn/opensource/os-cn-hadoop-yarn/

由于项目的需要,我只需要用到Hadoop中的前两个子模块,即Hadoop Common和Hadoop HDFS。

在编译源码之前,我先介绍一下我的开发环境:

- Ubuntu 12.04 LTS

- Eclipse 4.3

- JDK1.6.0_45

- Maven 3.0.4

- SVN1.6.17

- ProtocolBuffer(貌似Ubuntu自带了,如果没有,请自行下载安装)

最新的Hadoop采用maven作为项目构建工具,所以系统需要安装maven。下面正式开始Hadoop源码的编译之旅。

首先用svn签出Hadoop的最新版本(hadoop 2.*):

svn checkout http://svn.apache.org/repos/asf/hadoop/common/trunk/ hadoop-dev

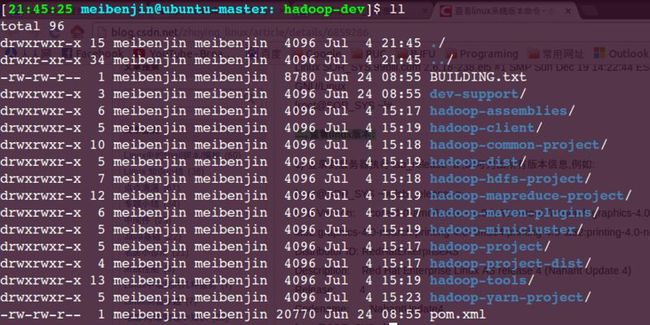

打开hadoop-dev文件夹,目录结构如下图

这就是Hadoop的源代码目录,顺便统计了一下源代码行数,1231074(包含注释、空行)。本文主要关心两个子项目,分别是hadoop-common-project、hadoop-hdfs-project。

接下来就需要为导入Eclipse构建Hadoop项目,虽然我们只关心上面提到的两个子项目,但是为了防止后续出现依赖问题,在构建时请在项目根目录下执行命令:

cd ~/hadoop-dev mvn install -DskipTests mvn eclipse:eclipse -DdownloadSources=true -DdownloadJavadocs=true

在执行mvn(即maven)命令时,请保证网络连接正常,因为mvn可能会下载一些Jar包来解决依赖问题。这可能需要花一段时间,完成上面的命令后,导入eclipse的准备工作已经做好了。

在导入之前,我们还有一个工作,就是安装eclipse的maven插件。安装的方法这里不做介绍。

接下来的工作是导入Eclipse中进行编译,打开eclipse,步骤如下:

- 菜单File->Import...

- 选择"Existing Projects into workspace"

- 选择hadoop-dev目录下的 hadoop-common-project 目录作为根目录

- 选择hadoop-annotations, hadoop-auth, hadoop-auth-examples, hadoop-nfs 和 hadoop-common projects

- 单击 "Finish"

- 菜单File->Import...

- 选择"Existing Projects into workspace"

- 选择hadoop-dev目录下的hadoop-assemblies目录作为根目录

- 选择hadoop-assemblies project

- 单击"Finish"

- 菜单File->Import...

- 选择"Existing Projects into workspace"

- 选择hadoop-dev目录下的hadoop-hdfs-project目录作为根目录

- 选择hadoop-hdfs project

- 单击"Finish"

由于我的项目只要用到hadoop的这几个模块,因此只导入了hadoop的部分模块,如果你们想导入其他的模块进行二次开发,可按上面相同的方式导入相应的子项目。

接下来就是利用eclipse编译hadoop,单击Run->Run Configuration...,会打开运行配置对话框,我们可以看到左侧有个Maven Build,双击Maven Build会新建一个配置页,按照下图的方式填写

注意,Base directory 填写的是hadoop项目的根目录,即 ~/hadoop-dev。单击Run,hadoop项目就开始编译了,这需要花一些时间,注意在这期间请保持网络连接正常。原因同上。

其实上面的过程也可以由命令行来完成,eclipse插件那一步都可以省了,命令行编译方法如下:

cd ~/hadoop-dev

mvn package -Pdist -DskipTests -Dtar

回到eclipse,编译成功后,eclipse的console窗口会输出BUILD SUCESS信息,这表示hadoop项目已经编译成功。

为了调试hadoop, 接下来的工作就是利用上面编译成功的hadoop构建hadoop环境。

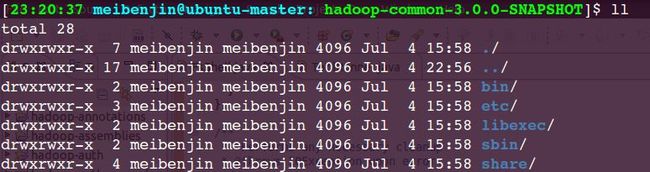

前面编译的结果都保存在各个项目的target目录下,以hadoop-common为例,编译的结果在 ~/hadoop-dev/hadoop-common-project/hadoop-common/target/hadoop-common-3.0.0-SNAPSHOT/ 下。这个目录下面的结构如下图:

其他的比如hadoop-hdfs、hadoop-mapreduce等也在对应的target目录下,路径与上面的类似,里面的目录结构和上图是一样的。

我们首先在用户目录下建立一个hadoop目录(mkdir ~/hadoop),把上图的所在目录下的所有项拷贝到这个新建的目录下,由于我只用common和hdfs,因此我的拷贝过程只针对这两个子项目。(目前我们有找到很好的方法编译,只能编译好后再从各个子项目中去拷贝,有解决方案的童鞋请一定留言~)

由于上面的过程比较繁琐,我写成了一个脚本,稍后会发布到github上(附上github上脚本的地址:https://github.com/meibenjin/hadoop2.0-configuration),如果你等不及了,就先将就着拷贝一下吧。完成上面的操作以后,~/hadoop下的目录结构和上图一样。

现在,我简单介绍一下新版的hadoop的目录结构, 看着很像linux的目录结构吧。 bin和sbin目录下是一些hadoop命令,ect目录下就是配置文件了。share目录下是hadoop需要用的一些jar包。

hadoop的配置我就不在这里写了(如有必要,我另写一篇博客),具体的配置可上hadoop网站查看官方文档。也可以看这个博客:http://www.cnblogs.com/scotoma/archive/2012/09/18/2689902.html 其中提到的slaves和yarn-site.xml文件在hadoop-yarn-project下。 为了调试hadoop方便,请配置成伪分布模式。

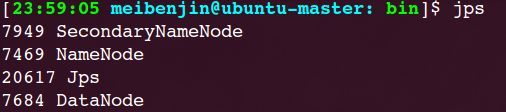

配置成功以后,启动hadoop相关的进程,命令如下:

hadoop namenode -format start-dfs.sh

查看进程是否启动成功,输入命令,jps得到下图输出:

这表示,hadoop相关的进程已经成功启动。

未完待续。。。

本文来自博客园,如果查看原文请点击 http://www.cnblogs.com/meibenjin/p/3172889.html