- python flask sqlalchemy JSON 数据查询

Purple_Grape207

pythonflaskpython

classUser(db.Model):id=db.Column(db.Integer,primary_key=True)username=db.Column(db.String(80),unique=True,nullable=False)email=db.Column(db.String(120),unique=True,nullable=False)userInfos=db.Column(d

- python连接clickhouse两种方法

dair6

sql相关问题python数据库sql

1.使用Client类importloggingfromapscheduler.schedulers.blockingimportBlockingSchedulerfromclickhouse_driverimportClientlogger=logging.getLogger(__name__)#操作日志对象classCkClient():"""数据库连接的公共类,初始化连接,自定义查询,删除等

- TeXstudio 编写基本的 Latex (备忘)

波格斯特

Latex

目录0.TeXstudio设置1.基本页面简单的一个例子来点章节再加个简单封皮加个目录小细节0.TeXstudio设置保证为UTF-8在选项卡选项中设置编译器为XeLaTeX1.基本页面简单的一个例子\documentclass{ctexart}%使用中文版的article文档类型排版\begin{document}hello,world你好,世界\end{document}来点章节\docume

- CSDN每日一练

文盲老顾

算法每日一练

每日一练不会做的题目n边形划分K树盗版解锁密码小豚鼠搬家清理磁盘空间待更新未能完全通过case的题目拯救爱情环形单向链表硬币的面值(CSDN已修改用例数据,2023-2-14)小计不会做的题目n边形划分练习题地址https://edu.csdn.net/skill/program/28790?practiceId=19348927题目名称:n边形划分时间限制:1000ms内存限制:256M题目描述

- LLM:RMSNorm

微风❤水墨

LLM&AIGC&VLPLLMRMSNorm

importtorchimporttorch.nnasnnclassLayerNorm(nn.Module):def__init__(self,dim:int,eps:float):super(LayerNorm,self).__init__()self.dim=dimself.eps=epsself.weight=nn.Parameter(torch.ones(self.dim))self.bi

- unittest vs pytest区别

賢843

接口自动化测试pytest

unittestvspytest对比unittest像“手动挡汽车”:操作步骤多,规则严格,适合老司机。pytest像“自动挡汽车”:开起来轻松,功能强大,适合新手和高效开发。区别点unittest(你学过的)pytest(更强大的新工具)测试用例写法必须写一个类,继承unittest.TestCase不用类!直接写函数,函数名以test_开头就行断言语法必须用self.assertEqual(a

- Android 里SQLite和ROOM框架简单介绍

大林不要掉头发

android数据库

简单的AndroidSQLite使用最简单的SQLite在Android开发中,SQLite是一个轻量级的关系型数据库管理系统,经常用于存储和管理应用程序的数据。如果你刚刚学习Android数据库的使用,你一定要学习SQLite的使用。以下是一个简单的示例,展示了如何在Android应用中创建SQLite数据库、创建表、插入数据以及查询数据。创建SQLite数据库、创建表publicclassDB

- 一段java代码输出Hello world经历了哪些过程

无畏@

java

一段Java代码从编写到输出Hello,World!,经历了多个步骤和组件的协作。以下是详细的过程解析:1.编写Java代码首先,编写一个简单的Java程序:java复制publicclassHelloWorld{publicstaticvoidmain(String[]args){System.out.println("Hello,World!");}}代码说明:定义了一个类HelloWorld

- Swagger2 多环境安全配置

L烧鱼

学习笔记javaswagger

一、生产环境关闭Swagger我们该怎么做?1、在配置文件新增开关#swagger开关swagger2.enable=true2、修改SwaggerConfifig动态设置开关@Configuration@EnableSwagger2publicclassSwaggerConfig{ @Value("${swagger2.enable}") privatebooleanenable; @Be

- Java高级特性深度解析:构造方法、继承关系与动态代理

小志开发

java

一、构造方法的深度探索1.1反射调用私有构造方法//获取私有构造方法示例ClassuserClass=User.class;ConstructorprivateCons=userClass.getDeclaredConstructor();privateCons.setAccessible(true);//突破访问限制Useruser=privateCons.newInstance();代码解析:

- MongoDB副本集介绍与部署

寒秋丶

数据库数据库mongodb运维linux运维开发性能测试数据仓库

MongoDB副本集(ReplicaSet)作为MongoDB数据库的核心功能之一,为开发人员提供了一种简单而有效的方式来实现数据的高可用性和冗余备份。在本文中,我们将探讨MongoDB副本集的概念、工作原理以及如何配置和管理一个稳健的副本集环境。关于MongoDB分片介绍与部署,可以参考:MongoDB分片介绍与部署一、副本集介绍1、副本集(replicaset)MongoDB的副本集(Repl

- 代码随想录训练营Day2|力扣977有序数组的平方、209长度最小的子数组、59螺旋矩阵

好名字可以让你的朋友更容易记住你498

一刷代码随想录leetcode矩阵算法c++

1.有序数组的平方题目链接:.-力扣(LeetCode)文章讲解:代码随想录视频讲解:双指针法经典题目|LeetCode:977.有序数组的平方_哔哩哔哩_bilibili双指针法:代码:classSolution{public:vectorsortedSquares(vector&nums){//非递减数组平方后,较大的值都分布在两端,可以利用这个特性从两边入手取值//双指针intcount=n

- vue3学习教程第二十六节(Hooks 封装注意事项)

刺客-Andy

vue3vue.jsjavascript前端

1、什么是HooksHooks最先提出的是React,在React16之后提出了所有以use开头定义的函数,用于复杂功能编写、函数组件中状态管理共用、副作用处理而抽离的共用的单一功能可复用的函数;2、Hooks与mixinsClass在应用中的差异在vue2中的mixinsClass主要有以下缺点:a、数据来源不清晰:在一个单文件组件中引入多个mixins或者class时候,想要追踪一个方法或者属

- 代码随想录数组链表总结(day1-day4)

文化说不定

链表算法数据结构python

数组1.二分查找习惯写左闭右闭,终止条件尽量放最前面,放后面有可能递归再经过一次处理就出不来了顺序存储查找定位的题目优先想是否为二分查找的变形(二分查找的条件太苛刻了感觉,但是效果也很好,所以如果是顺序存储的话,尽量先想二分查找)classSolution:defsearch(self,nums:List[int],target:int)->int:defbinary(low,high):iflo

- 笔记:代码随想录算法训练营day42:LeetCode188.买卖股票的最佳时机IV,309.最佳买卖股票时机含冷冻期,714.买卖股票的最佳时机含手续费

jingjingjing1111

笔记动态规划leetcode

学习资料:代码随想录感觉还没有把这个股票的递归变成直觉的东西.anyway,每一天的各种状态都是从上一天的各种状态中优化出来的,到最后的再选择一个最大的状态,应该是没啥问题,不会有漏掉的情况188.买卖股票的最佳时机IV力扣题目链接思路:和上一题差不多,限制上买卖次数倒比不限制买卖次数复杂了不少要给上一题的代码套个循环classSolution{public:intmaxProfit(intk,v

- Spring上下文工具类

neo_Ggx23

工具类springjava后端

文章目录获取ip地址请求上下文相关Spring上下文获取Bean对象获取ip地址publicclassIpUtils{privateIpUtils(){}/***获取请求ip地址**@return{@linkString}*/publicstaticStringgetIpAddress(){HttpServletRequestrequest=RequestContextHolderUtils.ge

- 使用stream流对List集合中对象的某个字段值升序、降序排列

neo_Ggx23

工具类服务器知识点list数据结构springboot后端java

classUser{Integersorted;//假设这是你的字段//构造函数和其他方法publicUser(Integersorted){this.sorted=sorted;}publicIntegergetSorted(){returnsorted;}@OverridepublicStringtoString(){return"User{"+"sorted="+sorted+'}';}}升

- JVM 如何保证 Java 程序的安全性?

冰糖心书房

JVM2025Java面试系列jvmjava

JVM(JavaVirtualMachine)在设计时就考虑了安全性,它提供了一套多层次的安全机制,以保护系统免受恶意代码的侵害。这些机制主要包括:1.类加载器(ClassLoader)及双亲委派模型:类加载器的作用:负责加载Java类(.class文件)到JVM中。将类的字节码转换为内存中的Class对象。执行类的初始化。类加载器的类型:启动类加载器(BootstrapClassLoader):

- c++ 嵌套类(Nested Class)、局部类(Local Class)

JANGHIGH

C++c++开发语言

c++嵌套类(NestedClass)、局部类(LocalClass)一、嵌套类(NestedClass)典型场景示例:链表实现中的嵌套类二、局部类(LocalClass)典型场景示例:函数内部的策略类三、关键区别与注意事项注意事项四、总结C++中的嵌套类(NestedClass)和局部类(LocalClass)是两种特殊的类定义方式,用于优化代码组织和封装性。以下是详细说明和示例:一、嵌套类(N

- Vue3开发 vue-router的使用

CV菜鸟#

前端开发vue.jsjavascript前端

1、vue-router简介官方介绍:VueRouter是Vue.js(opensnewwindow)官方的路由管理器。它和Vue.js的核心深度集成,让构建单页面应用变得易如反掌。包含的功能有:嵌套的路由/视图表模块化的、基于组件的路由配置路由参数、查询、通配符基于Vue.js过渡系统的视图过渡效果细粒度的导航控制带有自动激活的CSSclass的链接HTML5历史模式或hash模式,在IE9中自

- C++程序设计语言笔记——抽象机制:派生类

钺不言

C++笔记c++笔记经验分享开发语言

0避免使用类型域。避免使用类型域(TypeCodes)是面向对象设计中的重要原则,因为类型域会导致代码耦合度高、难以维护,且违反开闭原则(对扩展开放,对修改关闭)。以下是替代类型域的常见方法及示例:1.使用多态(子类化)通过继承和多态,将不同类型的行为封装到子类中,消除显式的类型判断。重构前(使用类型域):classShape{inttype;//1=圆,2=矩形doubleradius;doub

- OSError: We couldn‘t connect to ‘https://huggingface.co‘ to load this file,

小李飞刀李寻欢

Notebookhuggingfacebert分类大模型

场景:训练bert-base-chinese下游任务:分类。在一个服务器可以用,但GPU只有一个卡,只能换一个服务器,换个服务器又要重装环境,但后者下载模型有问题,手动用git-lfs下载后指定位置报错:Traceback(mostrecentcalllast):/examples/pytorch/text-classification/run_glue.py",line622,inmain()/

- 编译错误error: invalid storage class

唯独不开心

linux内核代码学习宏

这个问题排查了,好一段时间,无果。百度一下,发现遇到这个问题的人还挺多的。大家的解决方案都是括号不匹配,应该是多了或少了吧。我就仔细检查了一下代码。由于编辑器自带了检查括号是否配对功能。所以,咋一看,没问题。最后,发现是一处,调用系统的宏定义的毛病。这个宏定义包含了左括号“{”,而我在使用的时候,我又添加了一个左括号。去掉后,编译通过。

- 3d 数学(叉乘、四元素、四元素旋转、四元素和四元素相乘、鼠标控制物体旋转、发射子弹、环形发射子弹、子弹缓冲池)

ོꦿ映ꦿ言᭄﹆ོོོ

unity3dunity学习c#

目录1、叉乘2、四元素3、四元素旋转4、四元素和四元素相乘5、鼠标控制物体旋转6、发射子弹7、环形发射子弹8、子弹缓冲池1、叉乘两个向量叉乘,得到一个新的向量,新向量跟原始两个向量都垂直,也就是得到由两个向量所确定平面的法向量。a(x,y,z)b(i,j,k)a*b=(y*k-z*j,x*k-z*i,x*j-y*i)publicclassCrossTest:MonoBehaviour{public

- java字符串练习题_java练习题——字符串

阿呆java

java

一.动手动脑之String.equals()方法:判断s1和s2的内容相同s1.equals(s2)。判断s1和s2的地址相同s1==s2。二.整理String类的Length()、charAt()、getChars()、replace()、toUpperCase()、toLowerCase()、trim()、toCharArray()使用说明1、length()字符串的长度2、charAt()截

- 【C++模板详解 —— 函数模板与类模板】

Asher_qq

C++c++java算法

C++模板详解——函数模板与类模板1.非类型模板参数2.模板的特化2.1概念2.2函数模板特化2.2.1全特化2.2.2偏特化2.3类模板特化2.3.1全特化2.3.2偏特化2.3.3类模板特化应用示例3模板分离编译3.1什么是分离编译3.2模板的分离编译3.3解决方法4.模板总结1.非类型模板参数模板参数分类类型形参与非类型形参。类型形参即:出现在模板参数列表中,跟在class或者typenam

- 了解JS递归

几度泥的菜花

javascript前端

在JavaScript中,递归是一个非常重要的概念,它允许函数在其定义内部调用自身。递归在处理许多类型的问题时非常有用,尤其是那些可以通过分解成更小、更简单的子问题来解决的问题。然而,递归也需要谨慎使用,因为它可能导致堆栈溢出(特别是当递归调用非常深时)。以下是关于JavaScript递归的一些深入了解:1.递归的基本结构递归函数通常包含两个基本部分:基本情况(BaseCase):这是递归停止的条

- C#线程和线程池

上位机小白***

c#开发语言

在C#中,线程和线程池是多线程编程的重要概念线程概念线程是操作系统能够进行运算调度的最小单位,它被包含在进程之中,是进程中的实际运作单位。一个进程可以包含多个线程,每个线程可以独立执行不同的任务,从而实现程序的并发执行。usingSystem;usingSystem.Threading;classProgram{staticvoidMain(){//创建一个新的线程,指定要执行的方法Threadn

- appium入坑必备--详解uiautomator2,让你摆脱usb_appium uiautomator2

weixin_45933550

appiumjavapython

APP元素定位+基本工具介绍万字详解基本操作uc-devtools与Airtest工具使用目录UiAutomatorUiautomator2环境搭建常用操作连接设备Wifi连接USB连接定位工具定位元素启动应用停止应用查包名定位方式ResourceId定位Text定位Description定位ClassName定位xpath定位坐标定位重复元素定位截图文件推送与拉取常用鼠标操作滑动屏幕解锁屏幕获取

- 代码随想录算法训练营day2| 209.长度最小的子数组|59.螺旋矩阵II|区间和|开发商购买土地

70ng

算法矩阵线性代数leetcodejava

209.长度最小的子数组找出该数组中满足其总和大于等于target的长度最小的子数组[numsl,numsl+1,...,numsr-1,numsr],并返回其长度**。**如果不存在符合条件的子数组,返回0。classSolution{publicintminSubArrayLen(inttarget,int[]nums){intfast=0;//快指针intslow=0;//慢指针intsum

- 关于旗正规则引擎下载页面需要弹窗保存到本地目录的问题

何必如此

jsp超链接文件下载窗口

生成下载页面是需要选择“录入提交页面”,生成之后默认的下载页面<a>标签超链接为:<a href="<%=root_stimage%>stimage/image.jsp?filename=<%=strfile234%>&attachname=<%=java.net.URLEncoder.encode(file234filesourc

- 【Spark九十八】Standalone Cluster Mode下的资源调度源代码分析

bit1129

cluster

在分析源代码之前,首先对Standalone Cluster Mode的资源调度有一个基本的认识:

首先,运行一个Application需要Driver进程和一组Executor进程。在Standalone Cluster Mode下,Driver和Executor都是在Master的监护下给Worker发消息创建(Driver进程和Executor进程都需要分配内存和CPU,这就需要Maste

- linux上独立安装部署spark

daizj

linux安装spark1.4部署

下面讲一下linux上安装spark,以 Standalone Mode 安装

1)首先安装JDK

下载JDK:jdk-7u79-linux-x64.tar.gz ,版本是1.7以上都行,解压 tar -zxvf jdk-7u79-linux-x64.tar.gz

然后配置 ~/.bashrc&nb

- Java 字节码之解析一

周凡杨

java字节码javap

一: Java 字节代码的组织形式

类文件 {

OxCAFEBABE ,小版本号,大版本号,常量池大小,常量池数组,访问控制标记,当前类信息,父类信息,实现的接口个数,实现的接口信息数组,域个数,域信息数组,方法个数,方法信息数组,属性个数,属性信息数组

}

&nbs

- java各种小工具代码

g21121

java

1.数组转换成List

import java.util.Arrays;

Arrays.asList(Object[] obj); 2.判断一个String型是否有值

import org.springframework.util.StringUtils;

if (StringUtils.hasText(str)) 3.判断一个List是否有值

import org.spring

- 加快FineReport报表设计的几个心得体会

老A不折腾

finereport

一、从远程服务器大批量取数进行表样设计时,最好按“列顺序”取一个“空的SQL语句”,这样可提高设计速度。否则每次设计时模板均要从远程读取数据,速度相当慢!!

二、找一个富文本编辑软件(如NOTEPAD+)编辑SQL语句,这样会很好地检查语法。有时候带参数较多检查语法复杂时,结合FineReport中生成的日志,再找一个第三方数据库访问软件(如PL/SQL)进行数据检索,可以很快定位语法错误。

- mysql linux启动与停止

墙头上一根草

如何启动/停止/重启MySQL一、启动方式1、使用 service 启动:service mysqld start2、使用 mysqld 脚本启动:/etc/inint.d/mysqld start3、使用 safe_mysqld 启动:safe_mysqld&二、停止1、使用 service 启动:service mysqld stop2、使用 mysqld 脚本启动:/etc/inin

- Spring中事务管理浅谈

aijuans

spring事务管理

Spring中事务管理浅谈

By Tony Jiang@2012-1-20 Spring中对事务的声明式管理

拿一个XML举例

[html]

view plain

copy

print

?

<?xml version="1.0" encoding="UTF-8"?>&nb

- php中隐形字符65279(utf-8的BOM头)问题

alxw4616

php中隐形字符65279(utf-8的BOM头)问题

今天遇到一个问题. php输出JSON 前端在解析时发生问题:parsererror.

调试:

1.仔细对比字符串发现字符串拼写正确.怀疑是 非打印字符的问题.

2.逐一将字符串还原为unicode编码. 发现在字符串头的位置出现了一个 65279的非打印字符.

- 调用对象是否需要传递对象(初学者一定要注意这个问题)

百合不是茶

对象的传递与调用技巧

类和对象的简单的复习,在做项目的过程中有时候不知道怎样来调用类创建的对象,简单的几个类可以看清楚,一般在项目中创建十几个类往往就不知道怎么来看

为了以后能够看清楚,现在来回顾一下类和对象的创建,对象的调用和传递(前面写过一篇)

类和对象的基础概念:

JAVA中万事万物都是类 类有字段(属性),方法,嵌套类和嵌套接

- JDK1.5 AtomicLong实例

bijian1013

javathreadjava多线程AtomicLong

JDK1.5 AtomicLong实例

类 AtomicLong

可以用原子方式更新的 long 值。有关原子变量属性的描述,请参阅 java.util.concurrent.atomic 包规范。AtomicLong 可用在应用程序中(如以原子方式增加的序列号),并且不能用于替换 Long。但是,此类确实扩展了 Number,允许那些处理基于数字类的工具和实用工具进行统一访问。

- 自定义的RPC的Java实现

bijian1013

javarpc

网上看到纯java实现的RPC,很不错。

RPC的全名Remote Process Call,即远程过程调用。使用RPC,可以像使用本地的程序一样使用远程服务器上的程序。下面是一个简单的RPC 调用实例,从中可以看到RPC如何

- 【RPC框架Hessian一】Hessian RPC Hello World

bit1129

Hello world

什么是Hessian

The Hessian binary web service protocol makes web services usable without requiring a large framework, and without learning yet another alphabet soup of protocols. Because it is a binary p

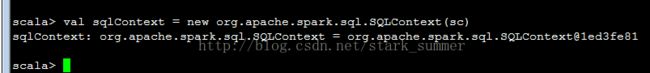

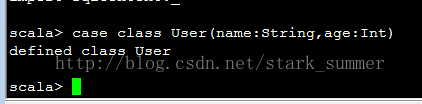

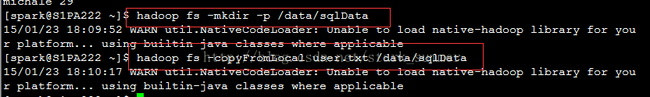

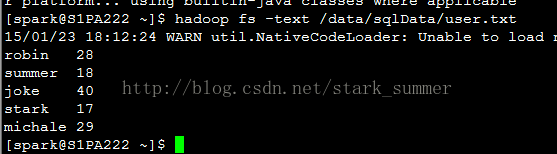

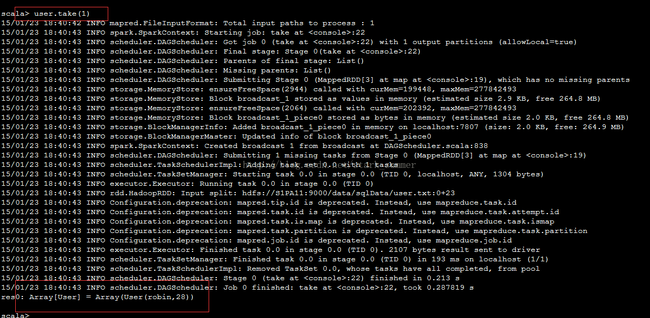

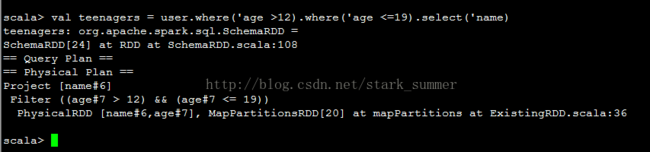

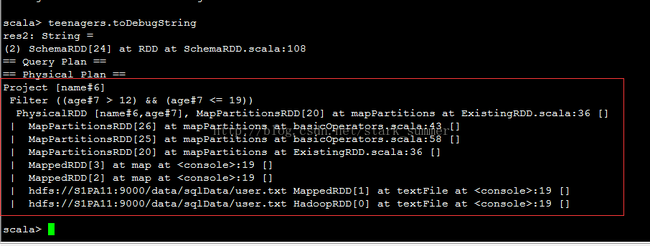

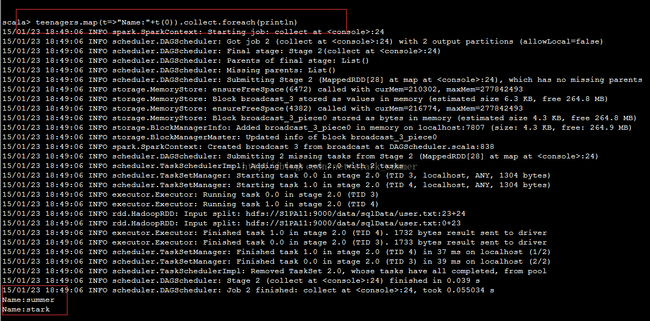

- 【Spark九十五】Spark Shell操作Spark SQL

bit1129

shell

在Spark Shell上,通过创建HiveContext可以直接进行Hive操作

1. 操作Hive中已存在的表

[hadoop@hadoop bin]$ ./spark-shell

Spark assembly has been built with Hive, including Datanucleus jars on classpath

Welcom

- F5 往header加入客户端的ip

ronin47

when HTTP_RESPONSE {if {[HTTP::is_redirect]}{ HTTP::header replace Location [string map {:port/ /} [HTTP::header value Location]]HTTP::header replace Lo

- java-61-在数组中,数字减去它右边(注意是右边)的数字得到一个数对之差. 求所有数对之差的最大值。例如在数组{2, 4, 1, 16, 7, 5,

bylijinnan

java

思路来自:

http://zhedahht.blog.163.com/blog/static/2541117420116135376632/

写了个java版的

public class GreatestLeftRightDiff {

/**

* Q61.在数组中,数字减去它右边(注意是右边)的数字得到一个数对之差。

* 求所有数对之差的最大值。例如在数组

- mongoDB 索引

开窍的石头

mongoDB索引

在这一节中我们讲讲在mongo中如何创建索引

得到当前查询的索引信息

db.user.find(_id:12).explain();

cursor: basicCoursor 指的是没有索引

&

- [硬件和系统]迎峰度夏

comsci

系统

从这几天的气温来看,今年夏天的高温天气可能会维持在一个比较长的时间内

所以,从现在开始准备渡过炎热的夏天。。。。

每间房屋要有一个落地电风扇,一个空调(空调的功率和房间的面积有密切的关系)

坐的,躺的地方要有凉垫,床上要有凉席

电脑的机箱

- 基于ThinkPHP开发的公司官网

cuiyadll

行业系统

后端基于ThinkPHP,前端基于jQuery和BootstrapCo.MZ 企业系统

轻量级企业网站管理系统

运行环境:PHP5.3+, MySQL5.0

系统预览

系统下载:http://www.tecmz.com

预览地址:http://co.tecmz.com

各种设备自适应

响应式的网站设计能够对用户产生友好度,并且对于

- Transaction and redelivery in JMS (JMS的事务和失败消息重发机制)

darrenzhu

jms事务承认MQacknowledge

JMS Message Delivery Reliability and Acknowledgement Patterns

http://wso2.com/library/articles/2013/01/jms-message-delivery-reliability-acknowledgement-patterns/

Transaction and redelivery in

- Centos添加硬盘完全教程

dcj3sjt126com

linuxcentoshardware

Linux的硬盘识别:

sda 表示第1块SCSI硬盘

hda 表示第1块IDE硬盘

scd0 表示第1个USB光驱

一般使用“fdisk -l”命

- yii2 restful web服务路由

dcj3sjt126com

PHPyii2

路由

随着资源和控制器类准备,您可以使用URL如 http://localhost/index.php?r=user/create访问资源,类似于你可以用正常的Web应用程序做法。

在实践中,你通常要用美观的URL并采取有优势的HTTP动词。 例如,请求POST /users意味着访问user/create动作。 这可以很容易地通过配置urlManager应用程序组件来完成 如下所示

- MongoDB查询(4)——游标和分页[八]

eksliang

mongodbMongoDB游标MongoDB深分页

转载请出自出处:http://eksliang.iteye.com/blog/2177567 一、游标

数据库使用游标返回find的执行结果。客户端对游标的实现通常能够对最终结果进行有效控制,从shell中定义一个游标非常简单,就是将查询结果分配给一个变量(用var声明的变量就是局部变量),便创建了一个游标,如下所示:

> var

- Activity的四种启动模式和onNewIntent()

gundumw100

android

Android中Activity启动模式详解

在Android中每个界面都是一个Activity,切换界面操作其实是多个不同Activity之间的实例化操作。在Android中Activity的启动模式决定了Activity的启动运行方式。

Android总Activity的启动模式分为四种:

Activity启动模式设置:

<acti

- 攻城狮送女友的CSS3生日蛋糕

ini

htmlWebhtml5csscss3

在线预览:http://keleyi.com/keleyi/phtml/html5/29.htm

代码如下:

<!DOCTYPE html>

<html>

<head>

<meta charset="UTF-8">

<title>攻城狮送女友的CSS3生日蛋糕-柯乐义<

- 读源码学Servlet(1)GenericServlet 源码分析

jzinfo

tomcatWebservlet网络应用网络协议

Servlet API的核心就是javax.servlet.Servlet接口,所有的Servlet 类(抽象的或者自己写的)都必须实现这个接口。在Servlet接口中定义了5个方法,其中有3个方法是由Servlet 容器在Servlet的生命周期的不同阶段来调用的特定方法。

先看javax.servlet.servlet接口源码:

package

- JAVA进阶:VO(DTO)与PO(DAO)之间的转换

snoopy7713

javaVOHibernatepo

PO即 Persistence Object VO即 Value Object

VO和PO的主要区别在于: VO是独立的Java Object。 PO是由Hibernate纳入其实体容器(Entity Map)的对象,它代表了与数据库中某条记录对应的Hibernate实体,PO的变化在事务提交时将反应到实际数据库中。

实际上,这个VO被用作Data Transfer

- mongodb group by date 聚合查询日期 统计每天数据(信息量)

qiaolevip

每天进步一点点学习永无止境mongodb纵观千象

/* 1 */

{

"_id" : ObjectId("557ac1e2153c43c320393d9d"),

"msgType" : "text",

"sendTime" : ISODate("2015-06-12T11:26:26.000Z")

- java之18天 常用的类(一)

Luob.

MathDateSystemRuntimeRundom

System类

import java.util.Properties;

/**

* System:

* out:标准输出,默认是控制台

* in:标准输入,默认是键盘

*

* 描述系统的一些信息

* 获取系统的属性信息:Properties getProperties();

*

*

*

*/

public class Sy

- maven

wuai

maven

1、安装maven:解压缩、添加M2_HOME、添加环境变量path

2、创建maven_home文件夹,创建项目mvn_ch01,在其下面建立src、pom.xml,在src下面简历main、test、main下面建立java文件夹

3、编写类,在java文件夹下面依照类的包逐层创建文件夹,将此类放入最后一级文件夹

4、进入mvn_ch01

4.1、mvn compile ,执行后会在