Scrapy在windows中的搭建配置记录(2)

‘default_encoding = sys.getdefaultencoding()’。

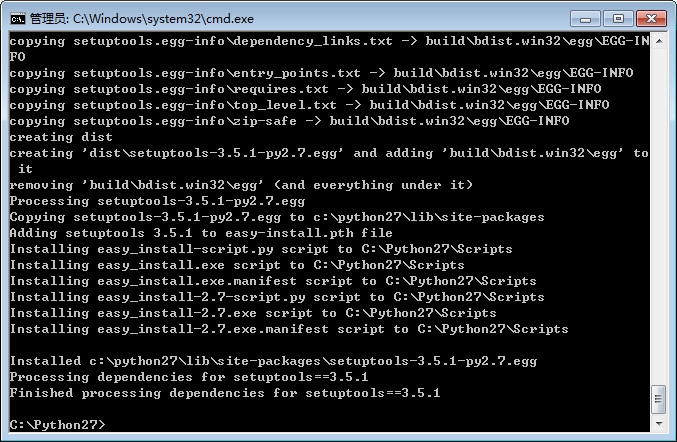

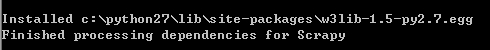

拭目以待Scrapy的安装。在cmd中输入easy_install Scrapy,终于开始成功的安装了。先去吃饭了。

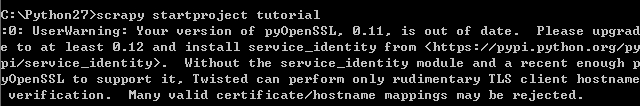

它的目录结构如下:

tutorial/

scrapy.cfg

tutorial/

__init__.py

items.py

pipelines.py

settings.py

spiders/

__init__.py

...

这是一些基本信息:

scrapy.cfg: 项目的配置文件。

tutorial/: 项目的python模块, 在这里稍后你将会导入你的代码。

tutorial/items.py: 项目items文件。

tutorial/pipelines.py: 项目管道文件。

tutorial/settings.py: 项目配置文件。

tutorial/spiders/: 你将要放入你的spider到这个目录中。

Items是装载我们抓取数据的容器。它们工作像简单的Python字典,它提供更多的保护,比如对未定义的字段提供填充功能防止出错。

它们通过创建scrapy.item.Item类来声明并定义它们的属性作为scrapy.item.Field 对象,就像是一个对象关系映射(假如你不熟悉ORMs,你将会看见它是一个简单的任务).

我们将需要的item模块化,来控制从demoz.org网站获取的数据,比如我们将要去抓取网站的名字,url和描述信息。我们定义这三种属性的域。我们编辑items.py文件,它在向导目录中。我们Item类看起来像这样。

fromscrapy.item importItem, Field classDmozItem(Item): title =Field() link =Field() desc =Field()

这个看起来复杂的,但是定义这些item能让你用其他Scrapy组件的时候知道你的item到底是什么

这下好了,配置的过程终于完成了,那么下面我们就要做一个真正意义上的爬虫了。

依然是照葫芦画瓢,从攻略上copy过来的:

Spiders是用户写的类,它用来去抓取一个网站的信息(或者一组网站) 。

我们定义一个初始化的URLs列表去下载,如何跟踪链接,如何去解析这些页面的内容去提取 items.创建一个Spider,你必须是scrapy.spider.BaseSpider的子类, 并定义三个主要的,强制性的属性。

名字: Spider的标识. 它必须是唯一的, 那就是说,你不能在不同的Spiders中设置相同的名字。

开始链接:Spider将会去爬这些URLs的列表。所以刚开始的下载页面将要包含在这些列表中。其他子URL将会从这些起始URL中继承性生成。

parse() 是spider的一个方法, 调用时候传入从每一个URL传回的Response对象作为参数。response是方法的唯一参数。

这个方法负责解析response数据和提出抓取的数据(作为抓取的items),跟踪URLs

parse()方法负责处理response和返回抓取数据(作为Item对象) 和跟踪更多的URLs(作为request的对象)

这是我们的第一个Spider的代码;由于没有详细的说明,我只好按照意思暂时将它它保存在c:\Python27\project\dmoz\spiders文件夹中,被命名为dmoz_spider.py:

fromscrapy.spider importBaseSpider

classDmozSpider(BaseSpider):

name ="dmoz"

allowed_domains =["dmoz.org"]

start_urls =[

"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/",

"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/"

]

defparse(self, response):

filename =response.url.split("/")[-2]

open(filename, 'wb').write(response.body)

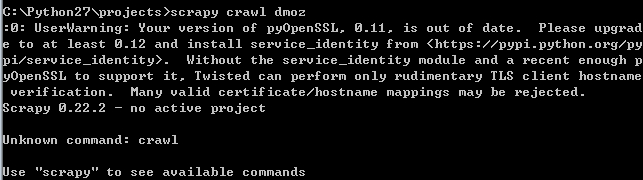

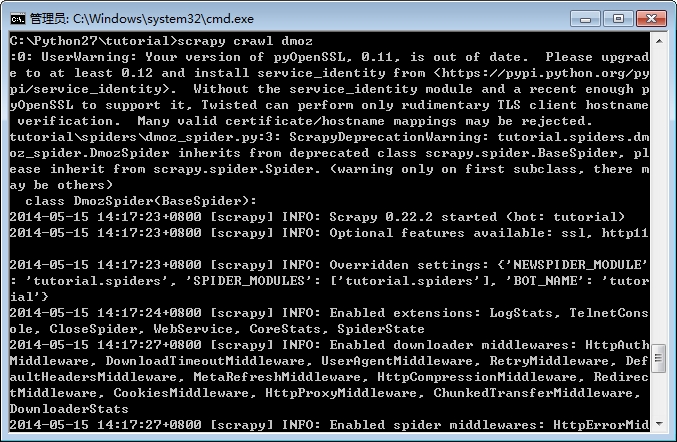

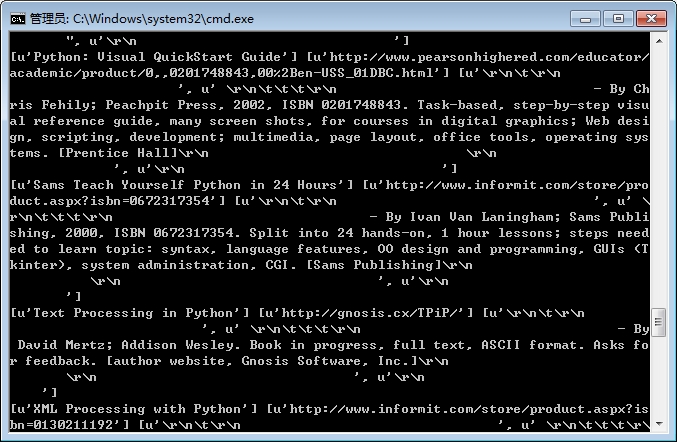

尝试着在cmd中进入到目录,然后运行scrapy crawl dmoz,结果给我返回这么一串

尝试了各种目录,发现还是不行。明显原文没有解释清楚这个路径到底是怎么回事。后来在网上查,把这个文件dmoz_spider.py放在

c:\Python27\tutorial\turorial\spiders里面,果然可以顺利运行了,虽然还带着警告,撒花!界面截图如下:

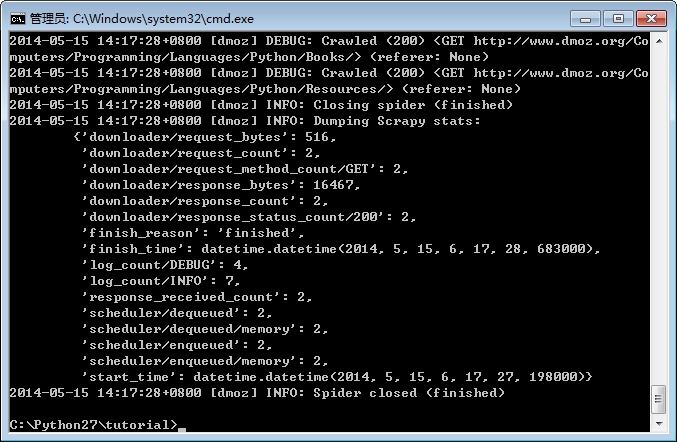

注意那些行包含[dmoz], 它和我们的spider相关。你能够看见每行初始化的URL日志信息。因为这些URLs是起始页面,所以他们没有引用referrers。 所以在每行的末尾部分,你能看见(referer: <None>).

但是有趣的是,在我们的parse方法作用下,创建了两个文件: Books and Resources, 它保存两个URLs的内容

刚刚发生了什么事情?

Scrapy为每一个start_urls创建一个scrapy.http.Request对象,并将爬虫的parse 方法指定为回调函数。

这些Request首先被调度,然后被执行,之后通过parse()方法,将scrapy.http.Response对象被返回,结果也被反馈给爬虫。

那么下面我们再做点什么呢?

提取Items

选择器介绍

我们有多种方式去提取网页中数据。Scrapy 使用的是XPath表达式,通常叫做XPath selectors。如果想了解更多关于选择器和提取数据的机制,可以看看如下教程XPath selectors documentation.这里我建议

到w3cschool学习xpath的教程,简单易懂,基本上一两个小时就能明白。

这里有一些表达式的例子和它们相关的含义:

/html/head/title: 选择<title>元素,在HTML文档的<head>元素里

/html/head/title/text(): 选择<title>元素里面的文本

//td: 选择所有的<td>元素

//div[@class="mine"]: 选择所有的div元素里面class属性为mine的

这里有许多的例子关于怎么使用XPath,可以说XPath表达式是非常强大的。如果你想要学习更多关于XPath,我们推荐如下教程this XPath tutorial.

为了更好使用XPaths, Scrapy提供了一个XPathSelector类,它有两种方式, HtmlXPathSelector(HTML相关数据)和XmlXPathSelector(XML相关数据)。如果你想使用它们,你必须实例化一个Response对象.

你能够把selectors作为对象,它代表文件结构中的节点。所以,第1个实例的节点相当于root节点,或者称为整个文档的节点。

选择器有三种方法(点击方法你能够看见完整的API文档)。

select(): 返回选择器的列表,每一个select表示一个xpath表达式选择的节点。

extract(): 返回一个unicode字符串 ,该字符串XPath选择器返回的数据。

re(): 返回unicode字符串列表,字符串作为参数由正则表达式提取出来。

在Shell里面使用选择器

为了更加形象的使用选择器,我们将会使用Scrapy shell,它同时需要你的系统安装IPython (一个扩展的Python控制台)。

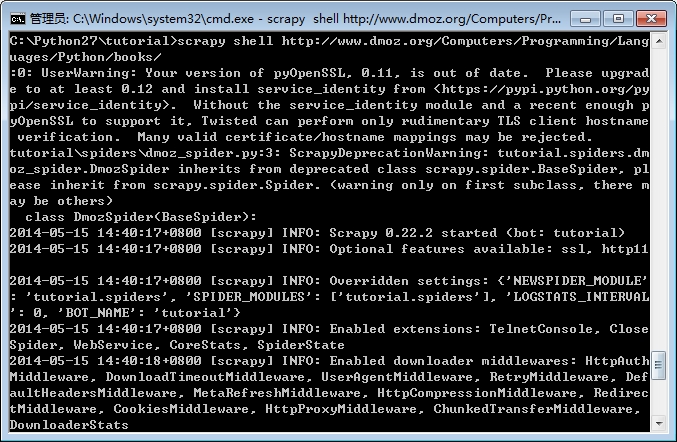

如果使用shell,你必须到项目的顶级目录上即c:\Python27\tutorial,然后运行如下命令:

scrapy shell http://www.dmoz.org/Computers/Programming/Languages/Python/Books/

shell将会显示如下的信息:

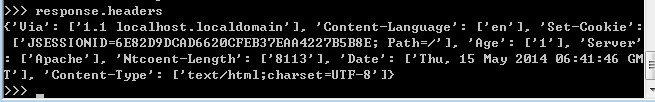

当shell装载之后,你将会得到一个response的本地变量。所以你输入reponse.body,你能够看见response的body部分或者你能够输入response.headers,你能够看见reponse.headers部分。

shell同样实例化了两个选择器,一个是HTML(在hvx变量里),一个是XML(在xxs变量里)。所以我们尝试怎么使用它们:

提取数据Extracting the data

现在我们开始尝试在这几个页面里提取真正的信息。

你能够在控制台里面输入response.body,检查源代码里面的XPaths是否与预期相同。然而,检查原始的HTML代码是一件非常枯燥乏味的事情。假如你想让你的工作变的简单,你使用Firefox扩展的插件例如Firebug来做这项任务。其实我一般都是用chrome的审查元素,感觉更方面。更多关于介绍信息请看Using Firebug for scraping和Using Firefox for scraping。

当你检查了页面源代码之后,你将会发现页面的信息放在一个<ul>元素里面,事实上,确切地说是第二个<ul>元素。

所以我们选择每一个<li>元素使用如下的代码:

hxs.select('//ul/li')

网站的描述信息可以使用如下代码:

hxs.select('//ul/li/text()').extract()

网站的标题:

hxs.select('//ul/li/a/text()').extract()

网站的链接:

hxs.select('//ul/li/a/@href').extract()

如前所述,每个select()调用返回一个selectors列表,所以我们可以结合select()去挖掘更深的节点。我们将会用到这些特性,所以:

sites =hxs.select('//ul/li')

forsite insites:

title =site.select('a/text()').extract()

link =site.select('a/@href').extract()

desc =site.select('text()').extract()

printtitle, link, desc

将代码添加到我们spider中:

from scrapy.spider import BaseSpider

from scrapy.selector import HtmlXPathSelector

class DmozSpider(BaseSpider):

name = "dmoz"

allowed_domains = ["dmoz.org"]

start_urls = [

"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/",

"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/"

]

def parse(self, response):

hxs = HtmlXPathSelector(response)

sites = hxs.select('//ul/li')

for site in sites:

title = site.select('a/text()').extract()

link = site.select('a/@href').extract()

desc = site.select('text()').extract()

print title, link, desc

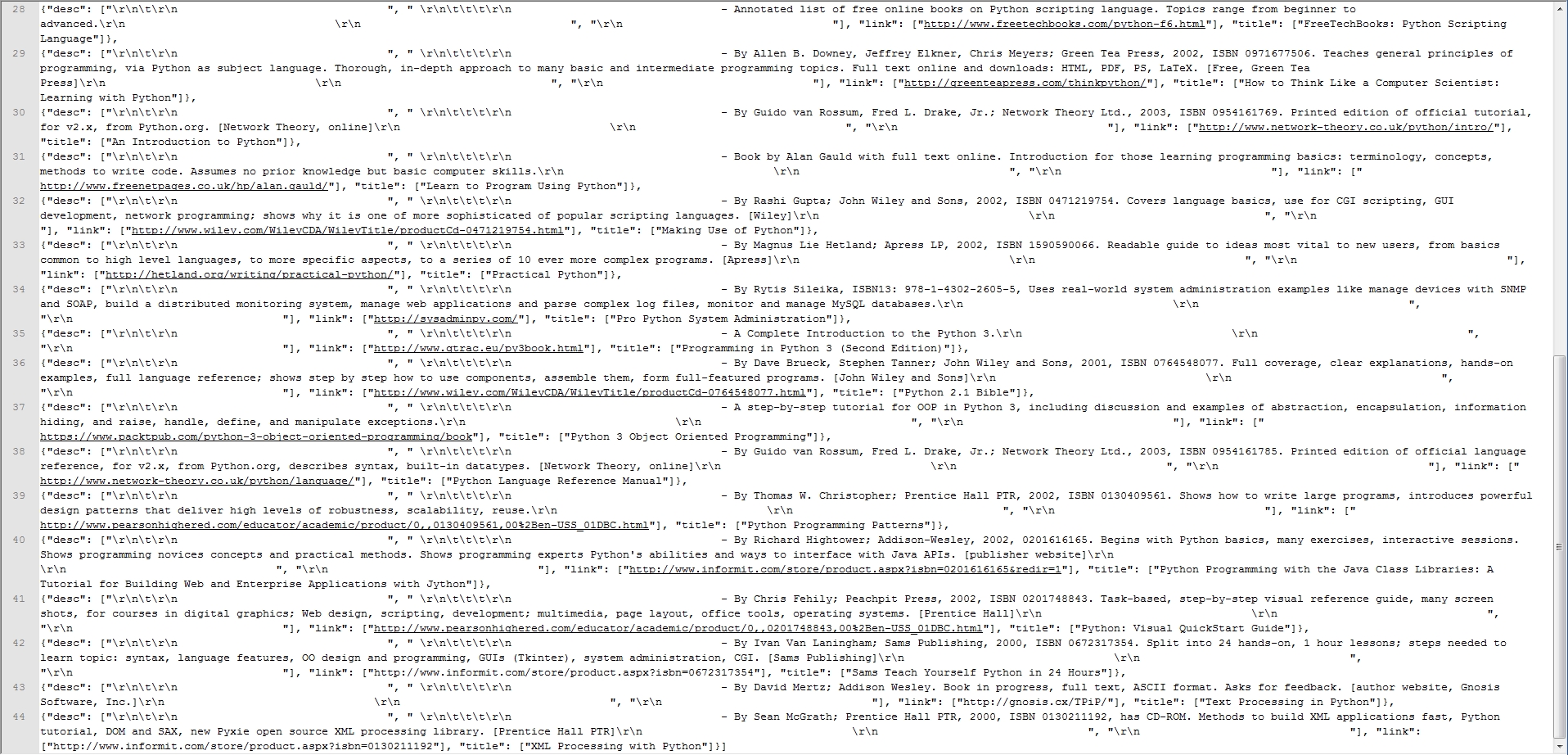

再次从cmd进入到c:\Python27\tutorial目录输入scrapy crawl dmoz

可以看到这次输出的内容有了好些变化。这些内容就是我们使用上面的代码获取的text和href

使用我们的 item

Spiders希望将抓取的数据放在 Item对象里。所以,为了返回我们抓取的数据,最终的代码要如下这么写 :

from scrapy.spider import BaseSpider

from scrapy.selector import HtmlXPathSelector

from tutorial.items import DmozItem

class DmozSpider(BaseSpider):

name = "dmoz"

allowed_domains = ["dmoz.org"]

start_urls = [

"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/",

"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/"

]

def parse(self, response):

hxs = HtmlXPathSelector(response)

sites = hxs.select('//ul/li')

items = []

for site in sites:

item = DmozItem()

item['title'] = site.select('a/text()').extract()

item['link'] = site.select('a/@href').extract()

item['desc'] = site.select('text()').extract()

items.append(item)

return items

存储抓取的数据

它将会产生一个items.json文件,它包含所有抓取的items(序列化的JSON)。

在一些小的项目里(例如我们的教程中),那就足够啦。然而,假如你想要执行更多复杂的抓取items,你能够写一个 Item Pipeline。 因为在项目创建的时候,一个专门用于Item Pipelines的占位符文件已经随着项目一起被建立,目录在tutorial/pipelines.py。如果你只需要存取这些抓取后的items的话,就不需要去实现任何的条目管道。

执行这条命令让我们来看看发生了什么。

找到tutorial的根目录,即c:\Python27\tutorial,我们发现在这里多了一个item.json文件,一开始我发现里面是空白的,不知道为什么,查看了控制台,发现是没有抓取任何东西,可能是网速问题造成页面打开失败了。又重新执行了一下就没有问题,此时的items.json里面有了一些数据。如下所示:

好了,基本的功能都已经实现了,今天就先到这里吧。