概率图模型(PGM)里的的条件独立(conditional independent)

条件独立(conditional independent)是概率论和概率图模型中的一个基本概念

预备知识:

贝叶斯公式(bayesian rule):

链式法则(chain rules of probability theory):

我们总可以对变量进行排序,将每个节点的父节点都放在该节点之前,通过链式法则可以把一个概率密度函数写成一般的因式分解的形式,对于变量顺序为:

当然通过这个公式我们也可以反向看出变量的排序。

在有向无环图(DAG,Directed Acyclic Graph)中,节点代表观测的随机变量,节点之间边代表变量之间的关系。这因为这些“边”的存在,明确了表示了变量节点之间的顺序和因果关系,如果用表示节点![]() 的父节点,那么有:

的父节点,那么有:

条件独立:

条件独立是概率论中的概念,给定Z的条件下若X和Y满足:

或者写做:

则称在给定条件Z的情况下X和Y独立,记做:![]()

DAG中的三种基本结构:

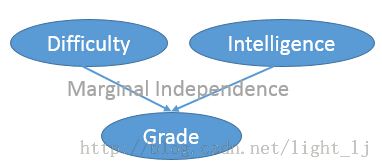

考试的难度和智商是相互独立的:

汇连结构:

但是,当已知学生的成绩的时候(也就是把成绩作为观察变量),显然考试难度和智商不在相互独立。难度高的话智商高的肯能行大,难度低的话智商高的可能性就小。

作为原因的多个因素,即使它们之间是相互独立的,给定结果之后这些原因就可能变的相关了。

所以像这种产生共同结果(Common Effect,or Collider)的事件,当结果不作为观测变量的时候,原因是相互独立的,也叫做边缘独立(Marginal Independence).

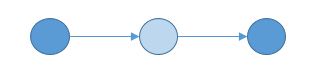

顺连结构:

这种顺序的结构里(经典的Markov链形式,过去、现在、未来),在已知成绩的条件下,考试难度和能否获得推荐信是相互独立的,一般成绩好获得推荐信的概率就大。

![]()

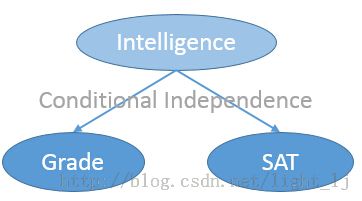

分连结构:

这种Common Cause(or Fork)结构,G和S是条件I独立的,可以理解为,Intelligence的存在揭示了Grade和SAT之间的所有“关系”

给定原因的情况下,多个结果之间如果没有因果关系是条件独立的。

总结:

对上面的三种结构的介绍进行总结可以得到Markov条件(Markov condition)也叫做局部Markov性:

变量节点会无条件依赖(unconditional dependent)于它的父节点(parent nodes),但是会条件独立(conditionally independent)于它的所有非后裔(nondescendants)节点,这个条件就是要已知它的父节点。

无向图里的条件独立:

这张图表示了,集合A中的节点到B中的节点的通路,总是至少通过一个集合C中的节点。,因此成立

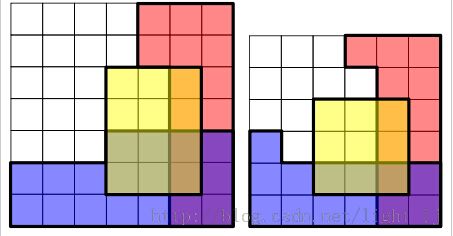

案例:

为了帮助理解条件独立的概念,引用一个来自维基百科的一个例子conditional independence:

事件R、B、Y 分别代表图中被涂为红色、蓝色和黄色的方块,事件的概率指每个颜色的小方块占总方块个数的比例。在给定Y的情况下R和B是条件独立的,因为有:

P(R、B | Y)=P(R | Y)P(B | Y),但是P(R、B | not Y)=P(R | not Y)P(B | not Y)是不成立的

事件独立的性质有:

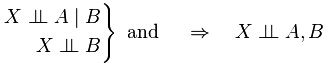

对应的条件独立的的性质有:

1、

![]()

2、

证明:

1、

2、

又

故