Hadoop2.5.2 HA高可靠性集群搭建(Hadoop+Zookeeper)

Hadoop2.5.2 HA高可靠性集群搭建(Hadoop+Zookeeper)

一.概述

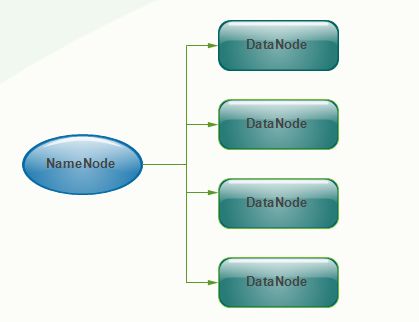

1.1 hadoop1.0的单点问题

Hadoop中的NameNode好比是人的心脏,非常重要,绝对不可以停止工作。在hadoop1时代,只有一个NameNode。如果该NameNode数据丢失或者不能工作,那么整个集群就不能恢复了。这是hadoop1中的单点问题,也是hadoop1不可靠的表现。如下图所示,便是hadoop1.0的架构图;

1.2 hadoop2.0对hadoop1.0单点问题的解决

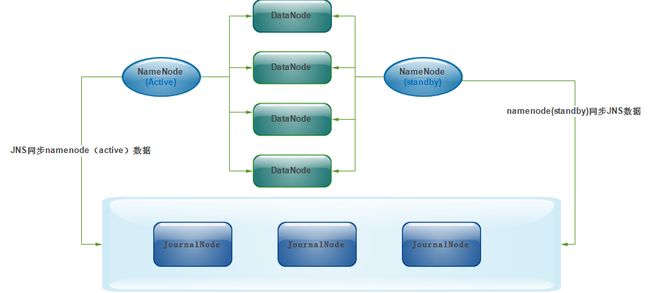

为了解决hadoop1中的单点问题,在hadoop2中新的NameNode不再是只有一个,可以有多个(目前只支持2个)。每一个都有相同的职能。一个是active状态的,一个是standby状态的。当集群运行时,只有active状态的NameNode是正常工作的,standby状态的NameNode是处于待命状态的,时刻同步active状态NameNode的数据。一旦active状态的NameNode不能工作,通过手工或者自动切换,standby状态的NameNode就可以转变为active状态的,就可以继续工作了。这就是高可靠。

1.3 使用JournalNode实现NameNode(Active和Standby)数据的共享

Hadoop2.0中,2个NameNode的数据其实是实时共享的。新HDFS采用了一种共享机制,Quorum Journal Node(JournalNode)集群或者Nnetwork File System(NFS)进行共享。NFS是操作系统层面的,JournalNode是hadoop层面的,我们这里使用JournalNode集群进行数据共享(这也是主流的做法)。如下图所示,便是JournalNode的架构图。

两个NameNode为了数据同步,会通过一组称作JournalNodes的独立进程进行相互通信。当active状态的NameNode的命名空间有任何修改时,会告知大部分的JournalNodes进程。standby状态的NameNode有能力读取JNs中的变更信息,并且一直监控edit log的变化,把变化应用于自己的命名空间。standby可以确保在集群出错时,命名空间状态已经完全同步了

1.4 NameNode之间的故障切换

对于HA集群而言,确保同一时刻只有一个NameNode处于active状态是至关重要的。否则,两个NameNode的数据状态就会产生分歧,可能丢失数据,或者产生错误的结果。为了保证这点,这就需要利用使用ZooKeeper了。首先HDFS集群中的两个NameNode都在ZooKeeper中注册,当active状态的NameNode出故障时,ZooKeeper能检测到这种情况,它就会自动把standby状态的NameNode切换为active状态。

二.Hadoop(HA)集群的搭建

2.1 配置详细

| 主机名 | IP | NameNode | DataNode | Year | Zookeeper | JournalNode |

| mast1 | 192.168.177.131 | 是 | 是 | 否 | 是 | 是 |

| mast2 | 192.168.177.132 | 是 | 是 | 否 | 是 | 是 |

| mast3 | 192.168.177.133 | 否 | 是 | 是 | 是 | 是 |

2.2 安装jdk

(省略)安装jdk和配置环境变量

2.2 SSH免登录

(省略),参考:http://eksliang.iteye.com/blog/2187265

2.4 Zookeeper集群搭建

(省略),参考,http://eksliang.iteye.com/blog/2107002,这是我的solr集群部署,也是使用zookeeper进行管理,zookeeper这里步骤跟操作一模一样,最后我的zoo.cfg文件如下所示

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

|

[hadoop

@Mast1

conf]$ cat zoo.cfg

# The number of milliseconds of each tick

tickTime=

2000

# The number of ticks that the initial

# synchronization phase can take

initLimit=

10

# The number of ticks that can pass between

# sending a request and getting an acknowledgement

syncLimit=

5

# the directory where the snapshot is stored.

dataDir=/home/hadoop/zookeeper/data

dataLogDir=/home/hadoop/zookeeper/datalog

# the port at which the clients will connect

clientPort=

2181

server.

1

=mast1:

2888

:

3888

server.

2

=mast2:

2888

:

3888

server.

3

=mast3:

2888

:

3888

|

2.5配置Hadoop配置文件

先配置mast1这台机器,配置后了后,将配置环境,复制到mast2、mast3上面即可!

hadoop2.0的配置存放在~/etc/hadoop目录下面,

- core.xml

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

|

<configuration>

<!-- 指定hdfs的nameservice为ns -->

<property>

<name>fs.defaultFS</name>

<value>hdfs:

//ns</value>

</property>

<!--指定hadoop数据临时存放目录-->

<property>

<name>hadoop.tmp.dir</name>

<value>/home/hadoop/workspace/hdfs/temp</value>

</property>

<property>

<name>io.file.buffer.size</name>

<value>

4096

</value>

</property>

<!--指定zookeeper地址-->

<property>

<name>ha.zookeeper.quorum</name>

<value>mast1:

2181

,mast2:

2181

,mast3:

2181

</value>

</property>

</configuration>

|

- hdfs-site.xml

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

|

<configuration>

<!--指定hdfs的nameservice为ns,需要和core-site.xml中的保持一致 -->

<property>

<name>dfs.nameservices</name>

<value>ns</value>

</property>

<!-- ns下面有两个NameNode,分别是nn1,nn2 -->

<property>

<name>dfs.ha.namenodes.ns</name>

<value>nn1,nn2</value>

</property>

<!-- nn1的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.ns.nn1</name>

<value>mast1:

9000

</value>

</property>

<!-- nn1的http通信地址 -->

<property>

<name>dfs.namenode.http-address.ns.nn1</name>

<value>mast1:

50070

</value>

</property>

<!-- nn2的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.ns.nn2</name>

<value>mast2:

9000

</value>

</property>

<!-- nn2的http通信地址 -->

<property>

<name>dfs.namenode.http-address.ns.nn2</name>

<value>mast2:

50070

</value>

</property>

<!-- 指定NameNode的元数据在JournalNode上的存放位置 -->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal:

//mast1:8485;mast2:8485;mast3:8485/ns</value>

</property>

<!-- 指定JournalNode在本地磁盘存放数据的位置 -->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/home/hadoop/workspace/journal</value>

</property>

<!-- 开启NameNode故障时自动切换 -->

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>

true

</value>

</property>

<!-- 配置失败自动切换实现方式 -->

<property>

<name>dfs.client.failover.proxy.provider.ns</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<!-- 配置隔离机制 -->

<property>

<name>dfs.ha.fencing.methods</name>

<value>sshfence</value>

</property>

<!-- 使用隔离机制时需要ssh免登陆 -->

<property>

<name>dfs.ha.fencing.ssh.

private

-key-files</name>

<value>/home/hadoop/.ssh/id_rsa</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:

///home/hadoop/workspace/hdfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:

///home/hadoop/workspace/hdfs/data</value>

</property>

<property>

<name>dfs.replication</name>

<value>

2

</value>

</property>

<!-- 在NN和DN上开启WebHDFS (REST API)功能,不是必须 -->

<property>

<name>dfs.webhdfs.enabled</name>

<value>

true

</value>

</property>

</configuration>

|

- mapred-site.xml

|

1

2

3

4

5

6

|

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

|

- yarn-site.xml

|

1

2

3

4

5

6

7

8

9

10

11

12

|

<configuration>

<!-- 指定nodemanager启动时加载server的方式为shuffle server -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- 指定resourcemanager地址 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>mast3</value>

</property>

</configuration>

|

- slaves

|

1

2

3

4

|

[hadoop

@Mast1

hadoop]$ cat slaves

mast1

mast2

mast3

|

- 修改JAVA_HOME

分别在文件hadoop-env.sh和yarn-env.sh中添加JAVA_HOME配置

|

1

2

|

#export JAVA_HOME=${JAVA_HOME} --原来

export JAVA_HOME=/usr/local/java/jdk1.

7

.0_67

|

虽然默认配置了${JAVA_HOME}的环境变量,但是hadoop启动时,会提示找不到,没有办法,指定绝对路径,这个是必须的。

- 配置hadoop的环境变量,参考我的配置

|

1

2

3

4

5

|

[hadoop

@Mast1

hadoop]$ vim ~/.bash_profile

export HADOOP_HOME=

"/home/hadoop/hadoop-2.5.2"

export PATH=$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/

native

export HADOOP_OPTS=

"-Djava.library.path=$HADOOP_HOME/lib"

|

- 将配置复制到mast2、mast3

|

1

2

3

4

|

scp -r ~/.bash_profile hadoop

@mast2

:/home/hadoop/

scp -r ~/.bash_profile hadoop

@mast3

:/home/hadoop/

scp -r $HADOOP_HOME/etc/hadoop hadoop

@mast2

:/home/hadoop/hadoop-

2.5

.

2

/etc/

scp -r $HADOOP_HOME/etc/hadoop hadoop

@mast3

:/home/hadoop/hadoop-

2.5

.

2

/etc/

|

至此Hadoop的配置完毕,接下来就是启动集群了

三.集群的启动

3.1 启动zookeeper集群

分别在mast1、mast2、mast3上执行如下命令启动zookeeper集群;

|

1

|

[hadoop

@Mast1

bin]$ sh zkServer.sh start

|

验证集群zookeeper集群是否启动,分别在mast1、mast2、mast3上执行如下命令验证zookeeper集群是否启动,集群启动成功,有两个follower节点跟一个leader节点;

|

1

2

3

4

|

[hadoop

@Mast1

bin]$ sh zkServer.sh status

JMX enabled by

default

Using config: /home/hadoop/zookeeper/zookeeper-

3.3

.

6

/bin/../conf/zoo.cfg

Mode: follower

|

3.2 启动journalnode集群

在mast1上执行如下命令完成JournalNode集群的启动

|

1

|

[hadoop

@Mast1

hadoop-

2.5

.

2

]$ sbin/hadoop-daemons.sh start journalnode

|

执行jps命令,可以查看到JournalNode的java进程pid

3.3 格式化zkfc,让在zookeeper中生成ha节点

在mast1上执行如下命令,完成格式化

|

1

|

hdfs zkfc –formatZK

|

(注意,这条命令最好手动输入,直接copy执行有可能会有问题,当时部署时我是蛋疼了许久)

格式成功后,查看zookeeper中可以看到

|

1

2

|

[zk: localhost:

2181

(CONNECTED)

1

] ls /hadoop-ha

[ns]

|

3.4 格式化hdfs

|

1

|

hadoop namenode –format

|

(注意,这条命令最好手动输入,直接copy执行有可能会有问题)

3.5 启动NameNode

首先在mast1上启动active节点,在mast1上执行如下命令

|

1

|

[hadoop

@Mast1

hadoop-

2.5

.

2

]$ sbin/hadoop-daemon.sh start namenode

|

在mast2上同步namenode的数据,同时启动standby的namenod,命令如下

|

1

2

3

4

|

#把NameNode的数据同步到mast2上

[hadoop

@Mast2

hadoop-

2.5

.

2

]$ hdfs namenode –bootstrapStandby

#启动mast2上的namenode作为standby

[hadoop

@Mast2

hadoop-

2.5

.

2

]$ sbin/hadoop-daemon.sh start namenode

|

3.6 启动启动datanode

在mast1上执行如下命令

|

1

|

[hadoop

@Mast1

hadoop-

2.5

.

2

]$ sbin/hadoop-daemons.sh start datanode

|

3.7 启动year

在作为资源管理器上的机器上启动,我这里是mast3,执行如下命令完成year的启动

|

1

|

[hadoop

@Mast3

hadoop-

2.5

.

2

]$ sbin/start-yarn.sh

|

3.8 启动ZKFC

在mast1上执行如下命令,完成ZKFC的启动

|

1

|

[hadoop

@Mast1

hadoop-

2.5

.

2

]$ sbin/hadoop-daemons.sh start zkfc

|

全部启动完后分别在mast1,mast2,mast3上执行jps是可以看到下面这些进程的

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

|

#mast1上的java PID进程

[hadoop

@Mast1

hadoop-

2.5

.

2

]$ jps

2837

NodeManager

3054

DFSZKFailoverController

4309

Jps

2692

DataNode

2173

QuorumPeerMain

2551

NameNode

2288

JournalNode

#mast2上的java PID进程

[hadoop

@Mast2

~]$ jps

2869

DFSZKFailoverController

2353

DataNode

2235

JournalNode

4522

Jps

2713

NodeManager

2591

NameNode

2168

QuorumPeerMain

#mast3

|