机器学习算法地图

本文及其它机器学习、深度学习算法的全面系统讲解可以阅读《机器学习与应用》,清华大学出版社,雷明著,由SIGAI公众号作者倾力打造,自2019年1月出版以来已重印3次。

- 书的购买链接

- 书的勘误,优化,源代码资源

文章《机器学习算法地图》系SIGAI原创,仅供个人学习使用,未经允许,不得转载,不能用于商业目的。如需获取原版PDF全文,可搜索关注VX公众号SIGAICN。(https://0x9.me/dxRg5)

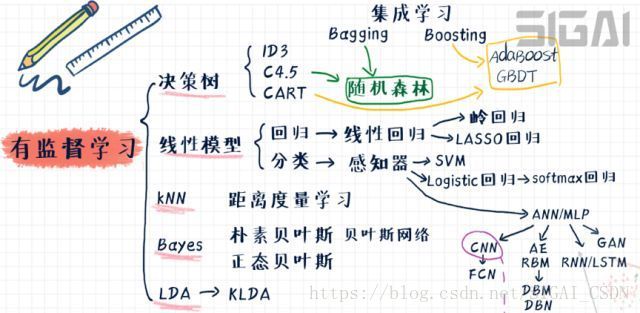

很多同学在学机器学习和深度学习的时候都有一个感受:所学的知识零散、不系统,缺乏整体感,这是普遍存在的一个问题。在这里,SIGAI对常用的机器学习和深度学习算法进行了总结,整理出它们之间的关系,以及每种算法的核心点,各种算法之间的比较。由此形成了一张算法地图,以帮助大家更好的理解和记忆这些算法。

如果你对这张图感兴趣,可以关注SIGAI公众号,给公众号发消息,得到电子版的下载地址,用作电脑桌面是非常不错的,绝对有逼格!我们把这张图用精美的纸打印出来了,如果你想要纸质版的,也可以给我们的公众号发消息,我们会用快递发送给你(快递费自付),贴在墙上也是不错的!

下面先看这张图:

关注微信公众号:SIGAICN,回复“算法地图”,即可获得高清电子版

图的左半部分列出了常用的机器学习算法与它们之间的演化关系,分为有监督学习,无监督学习,强化学习3大类。右半部分列出了典型算法的总结比较,包括算法的核心点如类型,预测函数,求解的目标函数,求解算法。

理解和记忆这张图,对你系统化的掌握机器学习与深度学习会非常有帮助!

我们知道,整个机器学习算法可以分为有监督学习,无监督学习,强化学习3大类。除此之外还有半监督学习,但我们可以把它归到有监督学习中。算法的演变与发展大多在各个类的内部进行,但也可能会出现大类间的交叉,如深度强化学习就是深度神经网络与强化学习技术的结合。

根据样本数据是否带有标签值(label),可以将机器学习算法分成有监督学习和无监督学习两类。如果要识别26个英文字母图像,我们要将每张图像和它是哪个字符即其所属的类型对应起来,这个类型就是标签值。

有监督学习(supervised learning)的样本数据带有标签值,它从训练样本中学习得到一个模型,然后用这个模型对新的样本进行预测推断。它的样本由输入值x与标签值y组成:

其中x为样本的特征向量,是模型的输入值;y为标签值,是模型的输出值。标签值可以是整数也可以是实数,还可以是向量。有监督学习的目标是给定训练样本集,根据它确定映射函数:

确定这个函数的依据是函数能够很好的解释训练样本,让函数输出值f(x)与样本真实标签值y之间的误差最小化,或者让训练样本集的对数似然函数最大化。这里的训练样本数是有限的,而样本所有可能的取值集合在很多情况下是一个无限集,因此只能从中选取一部分样本参与训练。

日常生活中的很多机器学习应用,如垃圾邮件分类,手写文字识别,人脸识别,语音识别等都是有监督学习。这类问题需要先收集训练样本,对样本进行进行标注,用标注好的训练样本训模型,然后根据模型对新的样本进行预测。

无监督学习(unsupervised learning)对没有标签的样本进行分析,发现样本集的结构或者分布规律。无监督学习的典型代表是聚类和数据降维。

强化学习是一类特殊的机器学习算法,它根据输入数据确定要执行的动作,在这里。输入数据是环境参数。和有监督学习算法类似,这里也有训练过程中。在训练时,对于正确的动作做出奖励,对错误的动作做出惩罚,训练完成之后就用得到的模型进行预测。

在有监督学习算法中,我们列出了5个分支:

关注微信公众号:SIGAICN,回复“算法地图”,即可获得高清电子版

分别是决策树,贝叶斯,线性模型,kNN,LDA(线性判别分析),集成学习。LDA也可以归类到线性模型中,但因为它是一种有监督的投影技术,我们单独列出。

决策树是一种基于规则的方法,它的规则是通过训练样本学习得到的,典型的代表是ID3,C4.5,以及分类与回归树。

集成学习是机器学习中一类重要的算法,它通过将多个简单的模型进行集成,得到一个更强大的模型,简单的模型称为弱学习器。决策树与集成学习算法相结合,诞生了随机森林,Boosting这两类算法(事实上,Boosting算法的弱学习器不仅可以用决策树,还可以用其他算法)。

线性模型是最大的一个分支,从它最后衍生除了一些复杂的非线性模型。如果用于分类问题,最简单的线性模型是线性回归,加上L2和L1正则化项之后,分别得到岭回归和LASSO回归。对于分类问题,最简单的是感知器模型,从它衍生出了支持向量机,logistic回归,神经网络3大分支。而神经网络又衍生出了各种不同的结构。包括自动编码器,受限玻尔兹曼机,卷积神经网络,循环神经网络,生成对抗网络等。当然,还有其他一些类型的神经网络,因为使用很少,所以在这里不列出。

kNN算法基于模板匹配的思想,是最简单的一种机器学习算法,它依赖于距离定义,而距离同样可以由机器学习而得到,这就是距离度量学习。

贝叶斯也是有监督学习算法中的一个大分支,最简单的是贝叶斯分类器,更复杂的有贝叶斯网络。而贝叶斯分类器又有朴素贝叶斯和正态贝叶斯两种实现。

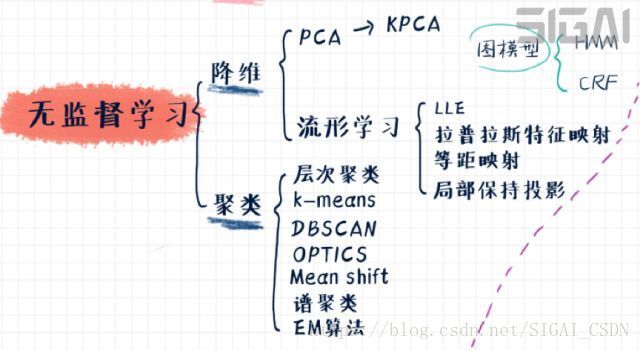

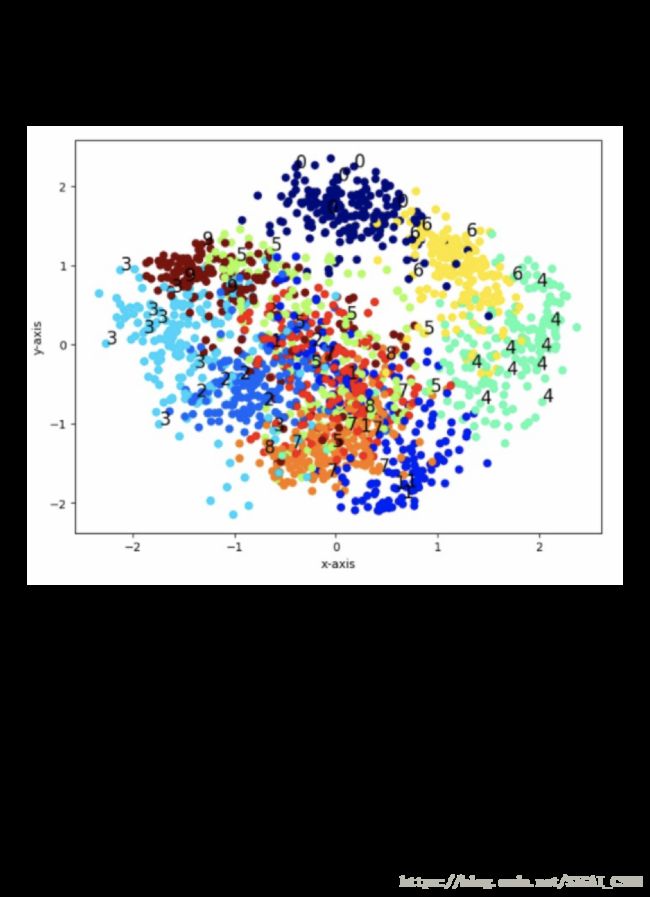

接下来说无监督学习,它可以分为数据降维算法和聚类算法两大类。演变关系如下图所示:

关注微信公众号:SIGAICN,回复“算法地图”,即可获得高清电子版

无监督的降维算法可以分为线性降维和非线性降维两大类。前者的典型代表是主成分分析(PCA),通过使用核技术,可以把它扩展为非线性的版本。流形学习是非线性降维技术的典型实现,代表性的算法有局部线性嵌入(LLE),拉普拉斯特征映射,等距映射,局部保持投影,它们都基于流形假设。流形假设不仅在降维算法中有用,在半监督学习、聚类算法中同样有使用。

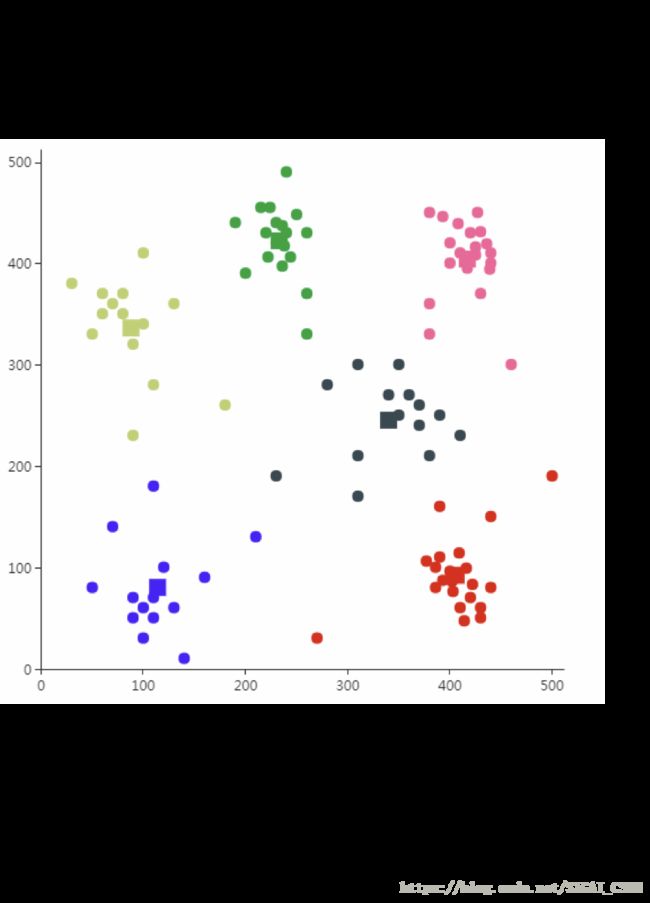

聚类算法可以分为层次距离,基于质心的聚类,基于概率分布的距离,基于密度的聚类,基于图的聚类这几种类型。它们从不同的角度定义簇(cluster)。基于质心的聚类典型代表是k均值算法。基于概率分布的聚类典型代表是EM算法。基于密度的聚类典型代表是DBSCAN算法,OPTICS算法,Mean shift算法。基于图的聚类典型代表是谱聚类算法。

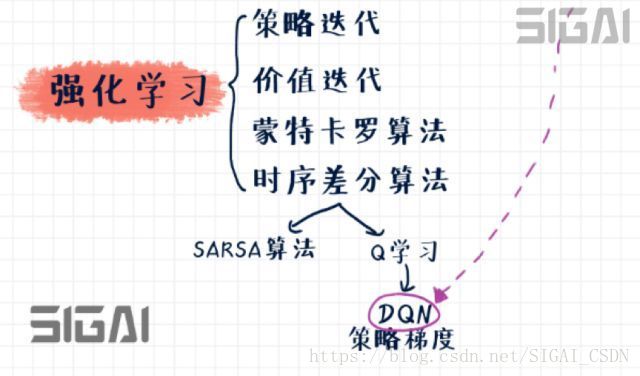

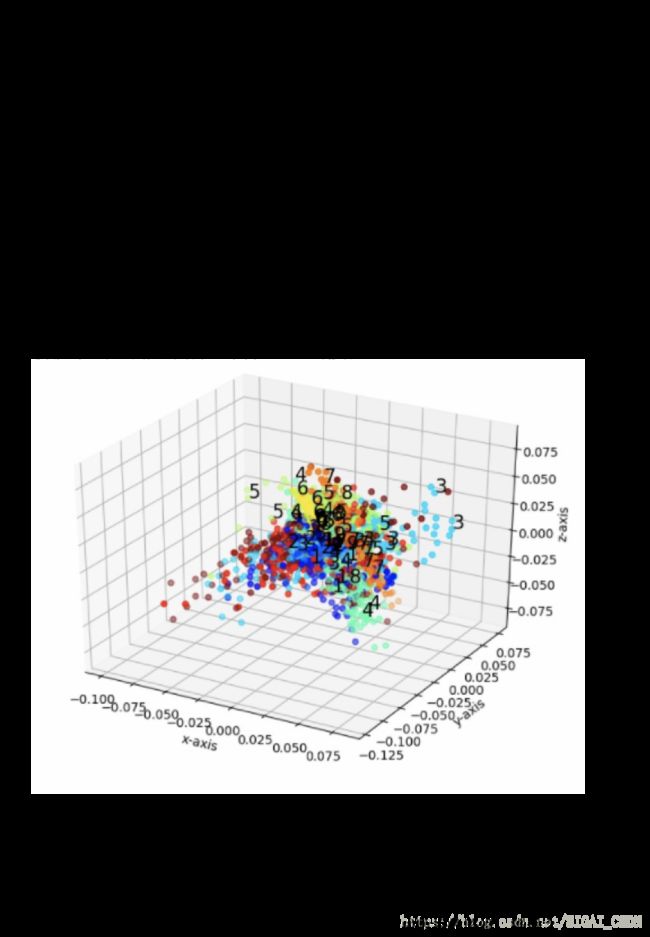

强化学习是机器学习中的一个特殊分支,用于决策、控制问题。这类算法的演变关系如下图所示:

关注微信公众号:SIGAICN,回复“算法地图”,即可获得高清电子版

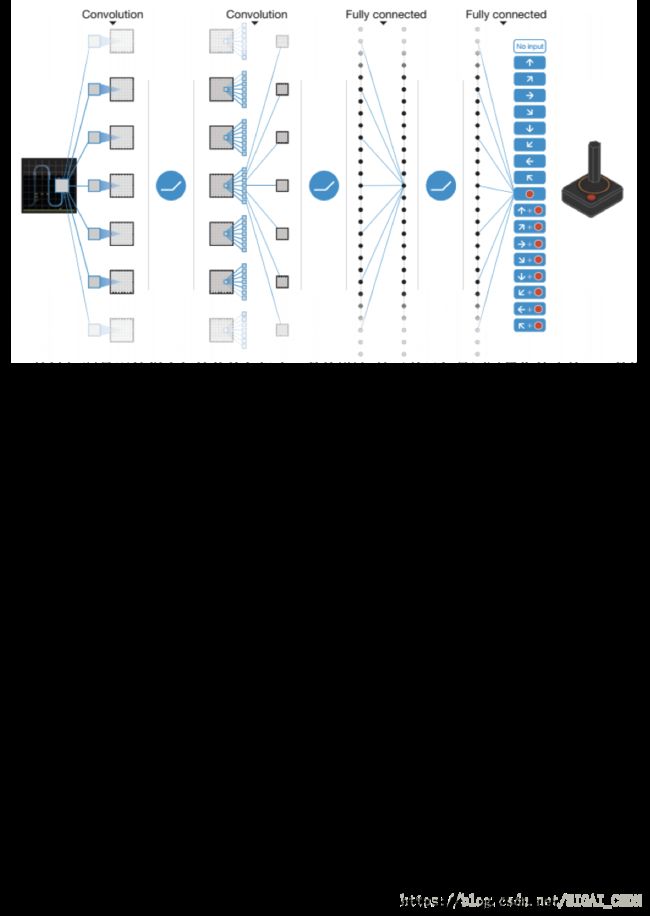

整个强化学习的理论模型可以抽象成马尔可夫决策过程。核心任务是求解使得回报最大的策略。如果直接用动态规划求解,则有策略迭代和价值迭代两类算法。他们都要求有精确的环境模型,即状态转移概率和奖励函数。如果做不到这一点,只能采用随机算法,典型的代表是蒙特卡罗算法和时序差分算法。强化学习与深度学习相结合,诞生了深度强化学习算法,典型代表是深度Q网络(DQN)以及策略梯度算法(策略梯度算法不仅可用神经网络作为策略函数的近似,还可以用其他函数)。

下面我们来分别介绍每种算法的核心知识点以及它们之间的关系。

有监督学习

先看有监督学习算法,它是当前实际应用中使用最广的机器学习算法。进一步可以分为分类问题与回归问题两大类。前面说过,有监督学习算法的预测函数为:

即根据输入数据x预测出输出数据y。如果y是整数的类别编号,则称为分类问题;如果y是实数值,则为回归问题。

贝叶斯分类器

分类问题中样本的特征向量取值x与样本所属类型y具有因果关系。因为样本属于类型y,所以具有特征值x。分类器要做的则相反,是在已知样本的特征向量为x的条件下反推样本所属的类别y。根据贝叶斯公式有:

只要知道特征向量的概率分布p(x),每一类出现的概率p(y),以及每一类样本的条件概率p(x|y),就可以计算出样本属于每一类的概率p(y|x)。如果只要确定类别,比较样本属于每一类的概率的大小,找出该值最大的那一类即可。因此可以忽略p(x),因为它对所有类都是一样的。简化后分类器的判别函数为:

训练时的目标是确定p(x|y)的参数,一般使用最大似然估计。如果假设样本特征向量的各个分量之间相互独立,则称为朴素贝叶斯分类器。如果假设特征向量x服从多维正态分布,则称为正态贝叶斯分类器。正态贝叶斯分类器的预测函数为:

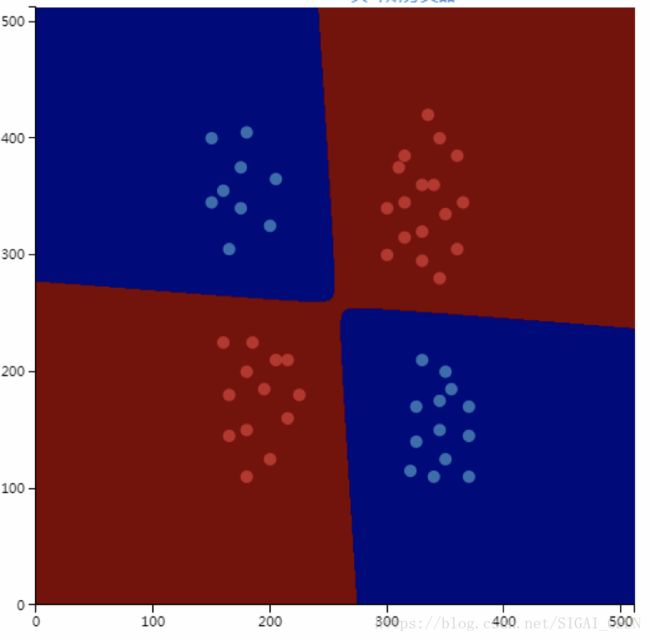

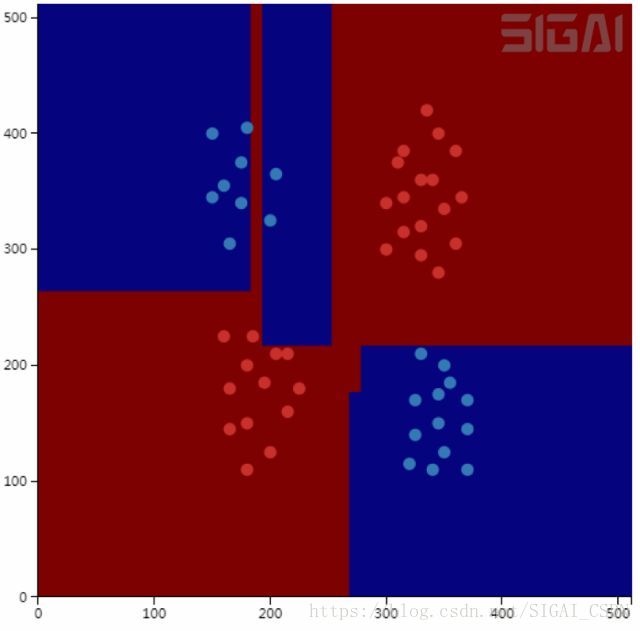

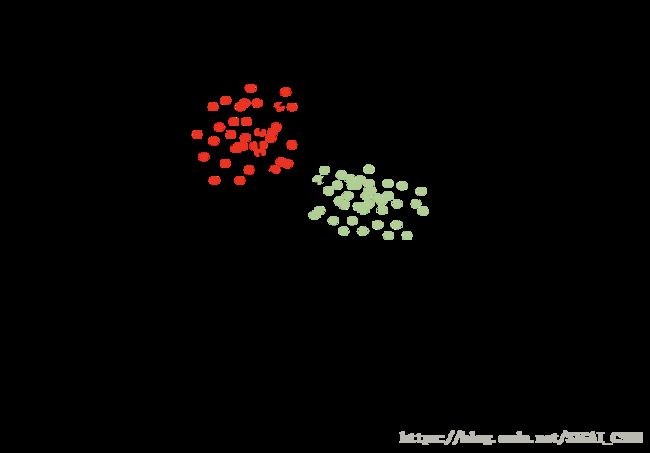

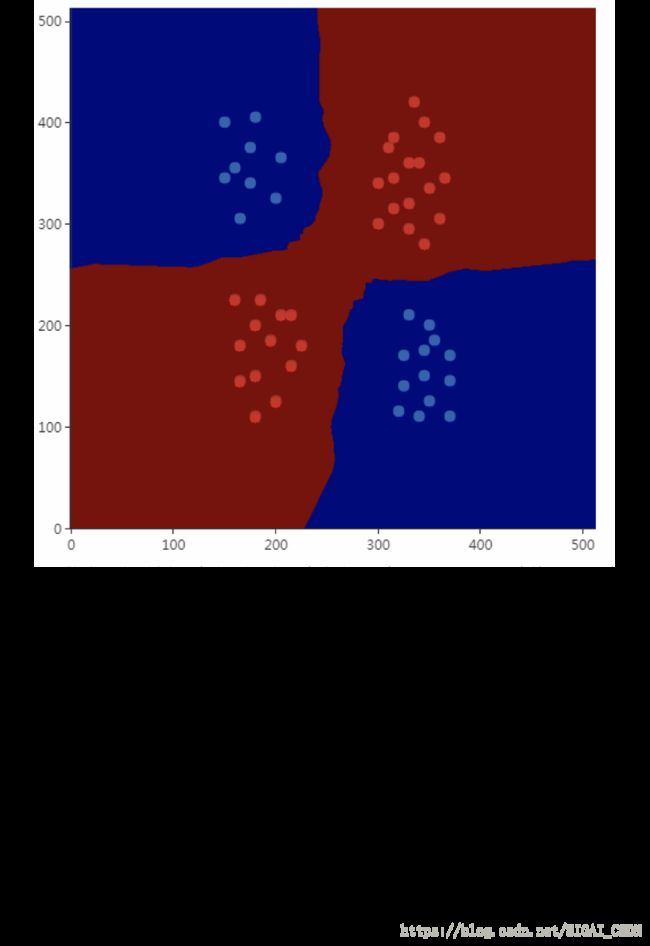

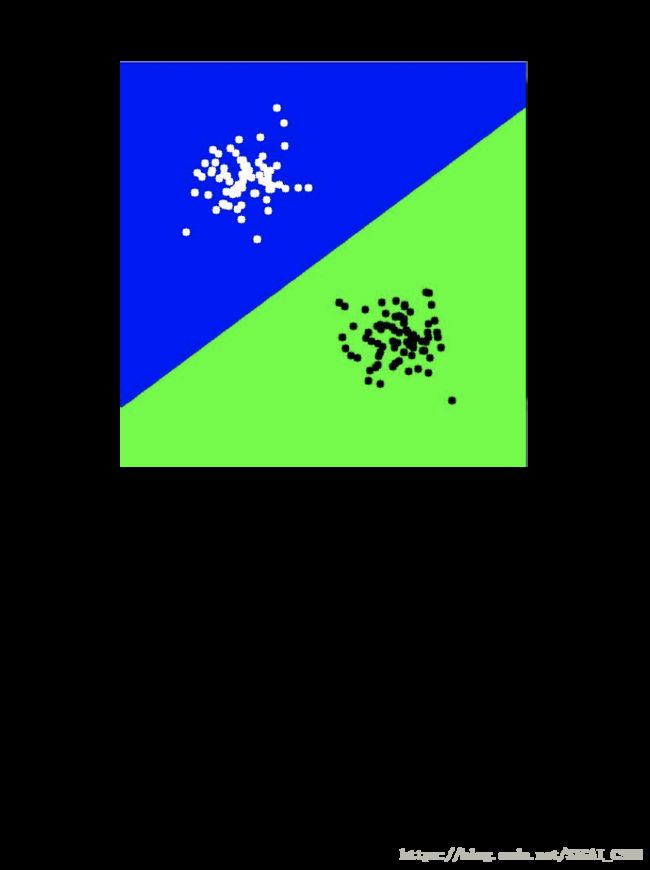

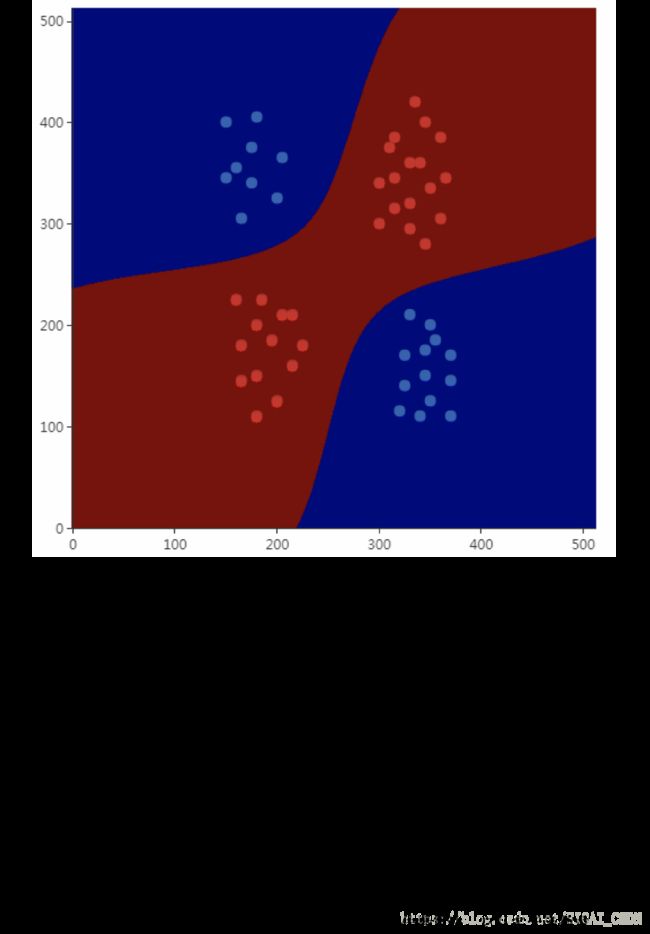

贝叶斯分类器是一种生成模型,是非线性模型,它天然的支持多分类问题。下图是正态贝叶斯分类器对异或问题的分类结果(来自SIGAI云端实验室):

决策树家族

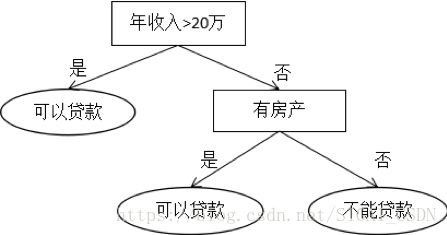

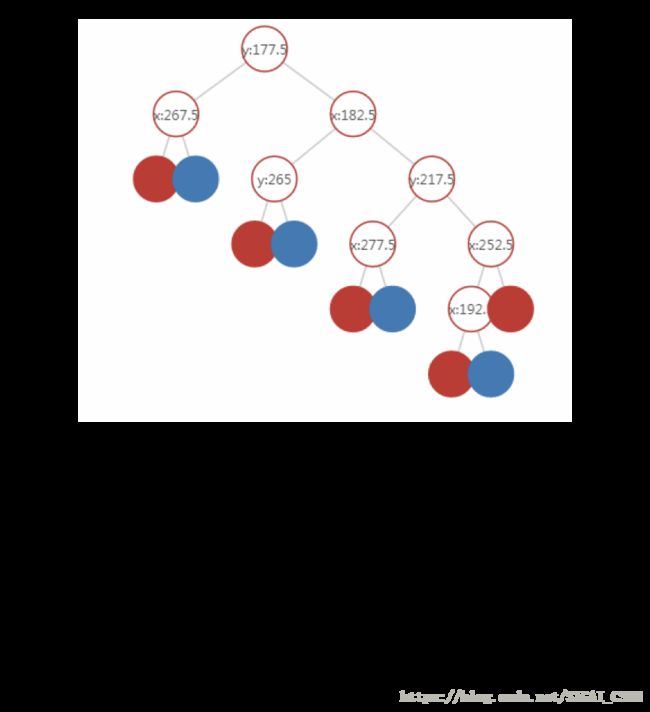

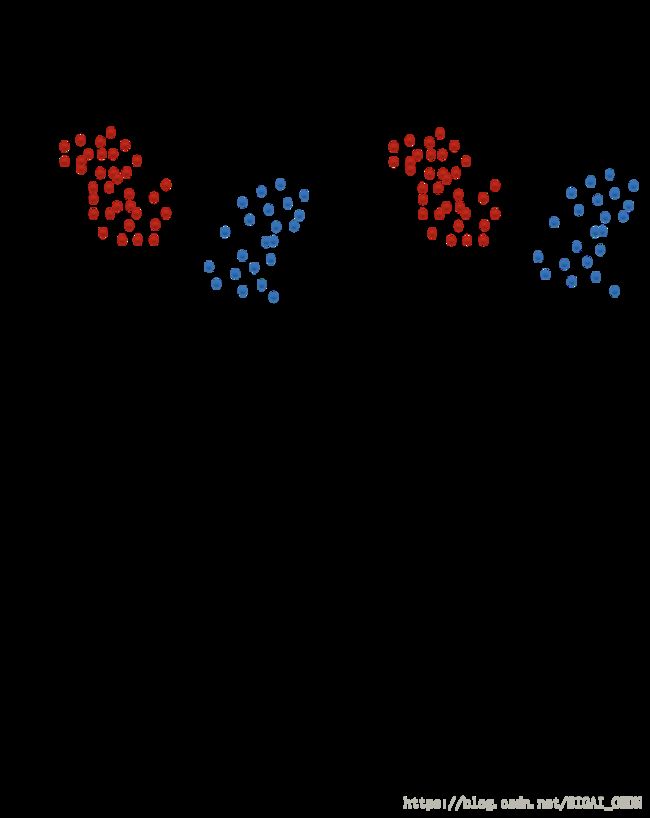

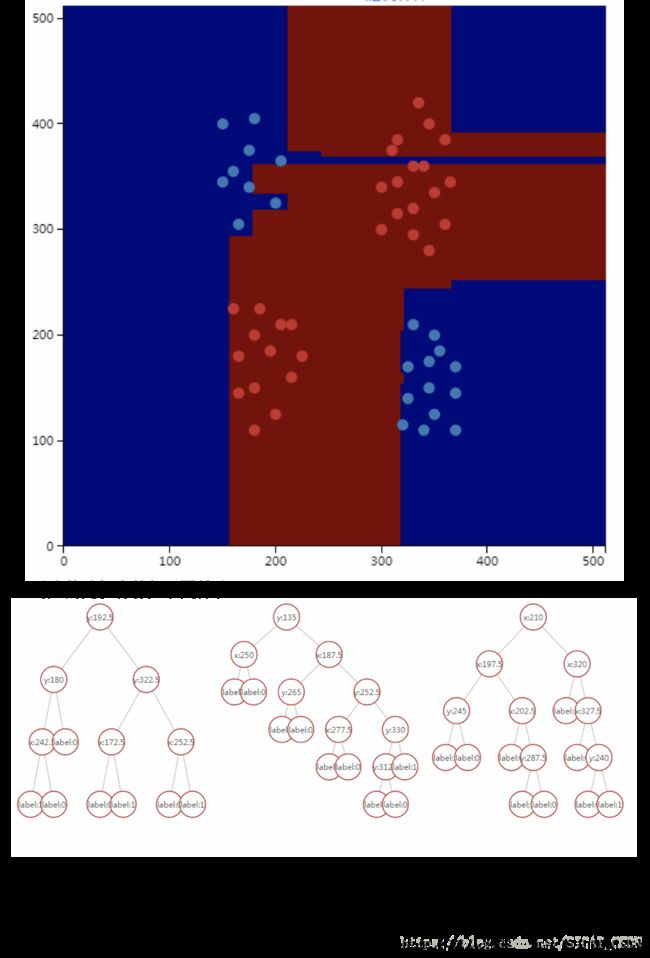

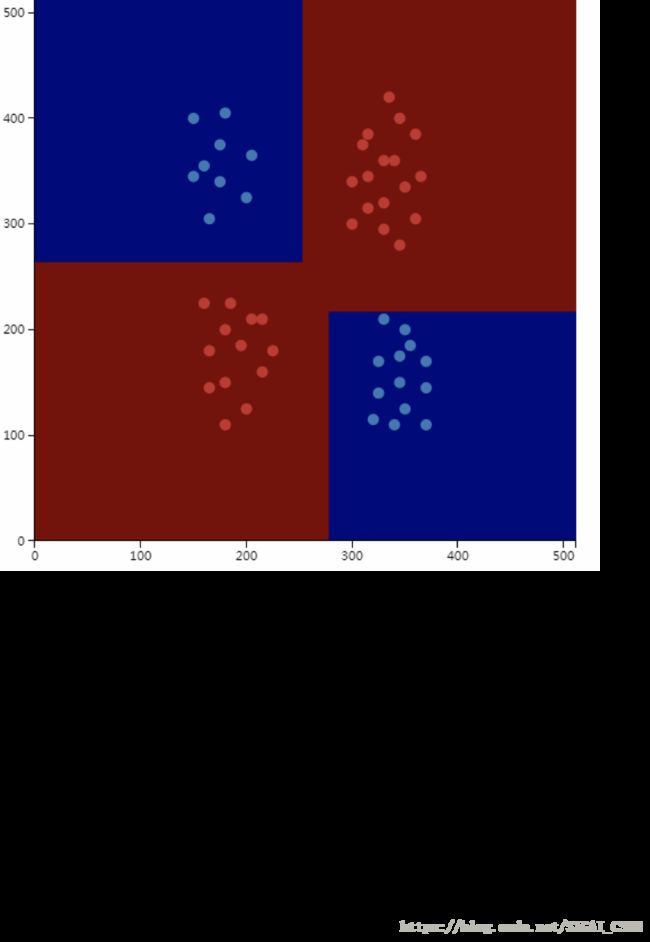

决策树是基于规则的方法,它用一组嵌套的规则进行预测,在树的每个决策节点处,根据判断结果进入一个分支,反复执行这种操作直到到达叶子节点,得到决策结果。决策树的这些规则通过训练得到,而不是人工制定的。下图是决策树的一个例子:

决策树是一种判别模型,也是非线性模型,天然支持多类分类问题。它既可以用于分类问题,也可以用于回归问题,具有很好的解释性,符合人类的思维习惯。常用的决策树有ID3,C4.5,分类与回归树(CART)等。

分类树对应的映射函数是多维空间的分段线性划分,即用平行于各个坐标轴的超平面对空间进行切分;回归树的映射函数是一个分段常数函数。决策树是分段线性函数但不是线性函数,它具有非线性建模的能力。只要划分的足够细,分段常数函数可以逼近闭区间上任意函数到任意指定精度,因此决策树在理论上可以对任意复杂度的数据进行分类或者回归。

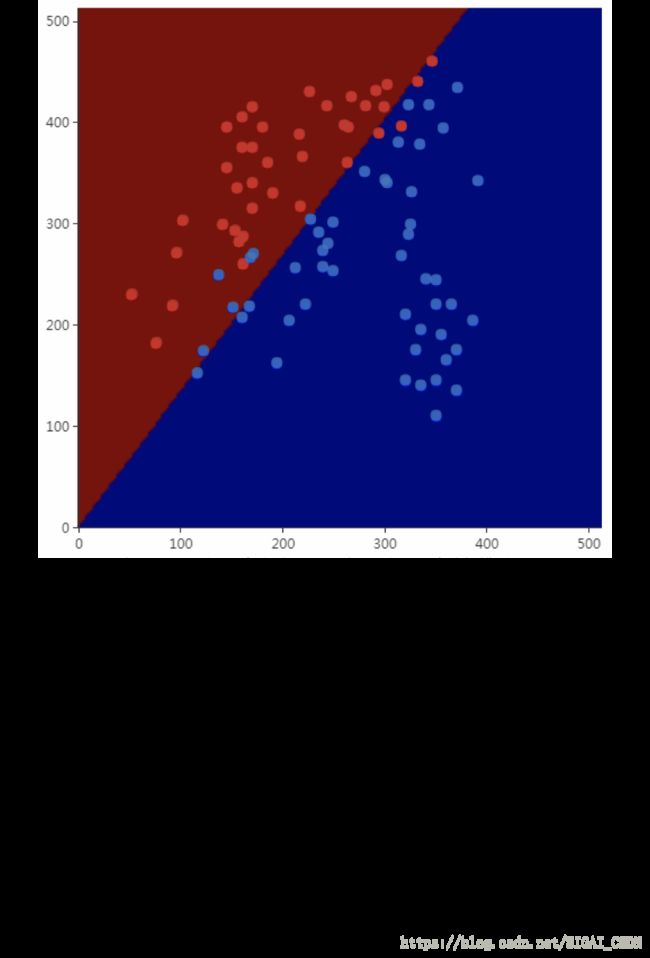

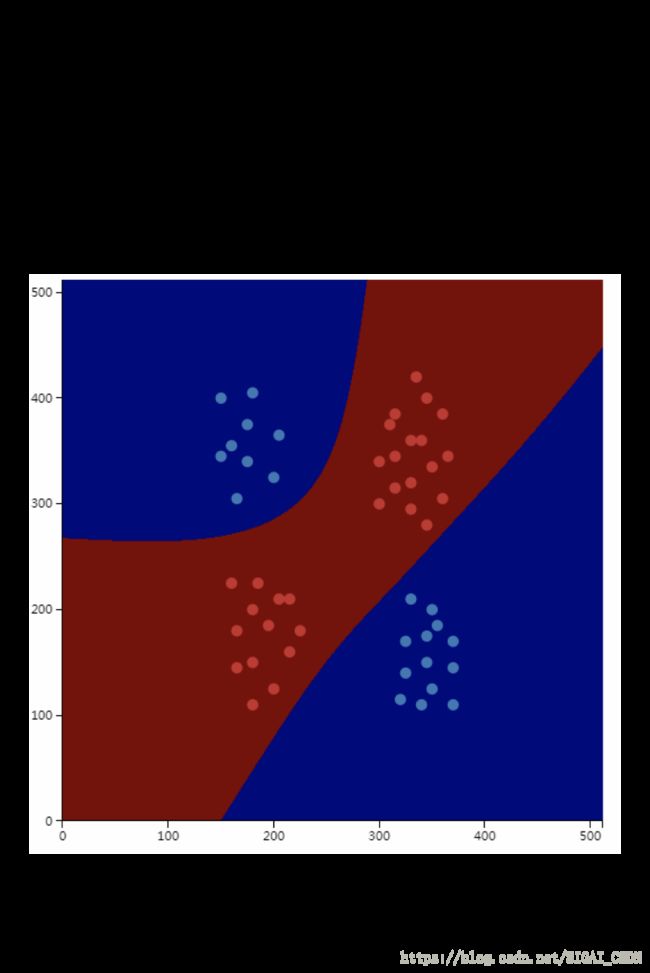

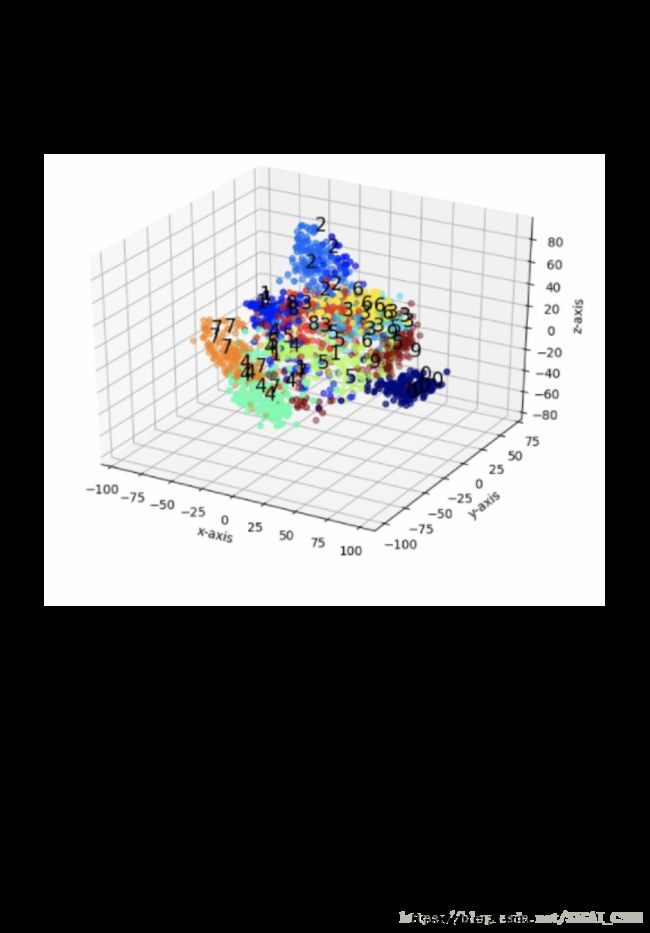

下图是决策树进行空间划分的一个例子。在这里有红色和蓝色两类训练样本,用下面两条平行于坐标轴的直线可以将这两类样本分开(来自SIGAI云端实验室):

这个划分方案对应的决策树如下图所示:

推荐文章

往期文章汇总

[1] 机器学习-波澜壮阔40年 SIGAI 2018.4.13.

[2] 学好机器学习需要哪些数学知识?SIGAI 2018.4.17.

[3] 人脸识别算法演化史 SIGAI 2018.4.20.

[4] 基于深度学习的目标检测算法综述 SIGAI 2018.4.24.

[5] 卷积神经网络为什么能够称霸计算机视觉领域? SIGAI 2018.4.26.

[6] 用一张图理解SVM的脉络 SIGAI 2018.4.28.

[7] 人脸检测算法综述 SIGAI 2018.5.3.

[8] 理解神经网络的激活函数 SIGAI 2018.5.5.

[9] 深度卷积神经网络演化历史及结构改进脉络-40页长文全面解读 SIGAI 2018.5.8.

[10] 理解梯度下降法 SIGAI 2018.5.11.

[11] 循环神经网络综述—语音识别与自然语言处理的利器 SIGAI 2018.5.15

[12] 理解凸优化 SIGAI 2018.5.18

[13]【实验】理解SVM的核函数和参数 SIGAI 2018.5.22

[14] 【SIGAI综述】行人检测算法 SIGAI 2018.5.25

[15] 机器学习在自动驾驶中的应用—以百度阿波罗平台为例(上) SIGAI 2018.5.29

[16] 理解牛顿法 SIGAI 2018.5.31

[17]【群话题精华】5月集锦—机器学习和深度学习中一些值得思考的问题 SIGAI 2018.6.1

[18] 大话Adaboost算法 SIGAI 2018.6.2

[19] FlowNet到FlowNet2.0:基于卷积神经网络的光流预测算法 SIGAI 2018.6.4

[20] 理解主成分分析(PCA) SIGAI 2018.6.6

[21] 人体骨骼关键点检测综述 SIGAI 2018.6.8

[22] 理解决策树 SIGAI 2018.6.11

[23] 用一句话总结常用的机器学习算法 SIGAI 2018.6.13

[24] 目标检测算法之YOLO SIGAI 2018.6.15

[25] 理解过拟合 SIGAI 2018.6.18

[26] 理解计算:从√2到AlphaGo ——第1季 从√2谈起 SIGAI 2018.6.20

[27] 场景文本检测——CTPN算法介绍 SIGAI 2018.6.22

[28] 卷积神经网络的压缩和加速 SIGAI 2018.6.25

[29] k近邻算法 SIGAI 2018.6.27

[30] 自然场景文本检测识别技术综述 SIGAI 2018.6.27

[31] 理解计算:从√2到AlphaGo ——第2季 神经计算的历史背景 SIGAI 2018.7.4

[32] 机器学习算法地图 SIGAI2018.7.6