利用Selenium爬取淘宝商品

淘宝页面数据是采用Ajax获取的,但是这些Ajax接口参数比较复杂,可能会加入加密秘钥。对于这种页面,最方便的方法是通过selenium。可以用Selenium来模拟浏览器操作,抓取淘宝商品信息。

1.目标

利用selenium抓取淘宝商品并用pyquery解析得到商品的图片、名称、价格、购买人数、商品图片、店铺所在地等信息,并将其保存到MongoDB数据库中。

2、准备工作

- 配置好ChromeDriver

- 安装Python的Selenium库

3.分析页面

抓取入口就是淘宝的搜索页面,这个链接可以通过直接构造参数访问。例如,如果搜索iPad,就可以直接访问 https://s.taobao.com/search?q=小米9呈现的就是第一页的搜索结果,

这里商品的搜索结果一般最大都为100页,要获取每一页的内容,只需要将页码从1到100顺序遍历即可,页码数是确定的。所以,直接在页面跳转文本框中输入要跳转的页码,然后点击“确定”按钮即可跳转到页码对应的页面。

这里不直接点击“下一页”的原因是:一旦爬取过程中出现异常退出,比如到50页退出了,此时点击“下一页”时,就无法快速切换到对应的后续页面了。此外,在爬取过程中,也需要记录当前的页码数,而且一旦点击“下一页”之后页面加载失败,还需要做异常检测,检测当前页面是加载到了第几页。整个流程相对比较复杂,所以这里我们直接用跳转的方式来爬取页面。

当我们成功加载出某一页商品列表时,利用Selenium即可获取页面源代码,然后再用相应的解析库解析即可。这里我们选用pyquery进行解析。下面我们用代码来实现整个抓取过程。

这一个商品条目,其中包含商品的基本信息,包括商品图片、名称、价格、购买人数、店铺名称和店铺所在地,我们要做的就是将这些信息都抓取下来。

3.代码实现

导入模块

from selenium import webdriver

from selenium.common.exceptions import TimeoutException

from selenium.webdriver.common.by import By

from selenium.webdriver.support import expected_conditions as EC

from selenium.webdriver.support.wait import WebDriverWait

from urllib.parse import quote

from pyquery import PyQuery as pq

import pymongo

配置

MONGO_URL = 'localhost'

MONGO_DB = 'zhou'

MONGO_COLLECTION = 'taobao'

client = pymongo.MongoClient(host=MONGO_URL, port=27017)

db = client[MONGO_DB]

COLLECTION = db[MONGO_COLLECTION]

browser = webdriver.Chrome()

wait = WebDriverWait(browser, 10)

KEYWORD = '魅族X8'

MAX_PAGE = 100

1.获取商品列表

先构造一个抓取的 URL:https://s.taobao.com/search?q=iPhone

这个URL非常简洁,参数q就是要搜索的关键字。只要改变这个参数,即可获取不同商品的列表。这里我们将商品的关键字定义成一个变量,然后构造出这样的一个URL。

然后,就需要用Selenium进行抓取了。我们实现如下抓取列表页的方法:

def index_page(page):

"""

抓取索引页

:param page: 页码

:return:

"""

print('正在抓取第', page, '页')

try:

url = 'https://s.taobao.com/search?q=' + quote(KEYWORD)

browser.get(url)

if page > 1:

input = wait.until(EC.presence_of_element_located((By.CSS_SELECTOR, '.m-page .input')))

submit = wait.until(EC.presence_of_element_located((By.CSS_SELECTOR, '#mainsrp-pager div.form > span.btn.J_Submit')))

input.clear()

input.send_keys(page)

submit.click()

wait.until(EC.text_to_be_present_in_element((By.CSS_SELECTOR, '#mainsrp-pager li.item.active > span'), str(page)))

wait.until(EC.presence_of_element_located((By.CSS_SELECTOR, '.m-itemlist .items .item')))

get_products()

except TimeoutException:

return index_page(page)

首先判断爬取的页面是否大于1,如果大于1,就进行跳页操作,否则等待页面加载完成。等待加载,使用了 WebDriverWait对象,指定最长等待时间为10秒。

在跳转页面是,需要用判断当前高亮的页码数是当前的页码数,这里使用了另一个等待条件text_to_be_present_in_element。它会等待指定的文本出现在某一个节点里面时即返回成功。这里我们将高亮的页码节点对应的CSS选择器和当前要跳转的页码通过参数传递给这个等待条件,这样它就会检测当前高亮的页码节点是不是我们传过来的页码数,如果是,就证明页面成功跳转到了这一页,页面跳转成功。

2.解析商品列表

def get_products():

"""

提取数据

:return:

"""

html = browser.page_source

doc = pq(html)

items = doc('#mainsrp-itemlist .items .item').items()

for item in items:

product = {

'title': item.find('.title').text(),

'image': item.find('.pic .img').attr('data-src'),

'price': item.find('.price').text(),

'deal': item.find('.deal-cnt').text(),

'shop': item.find('.shop').text(),

'location': item.find('.location').text()

}

print(product)

save_to_mongo(product)

3.保存至数据库

def save_to_mongo(result):

"""

保存至MongoDB

:param result: 结果

"""

try:

if COLLECTION.insert_one(result):

print('储存成功')

except Exception:

print('储存失败')

4.finally

if __name__ == '__main__':

"""

遍历每一页

"""

for i in range(1, MAX_PAGE + 1):

index_page(i)

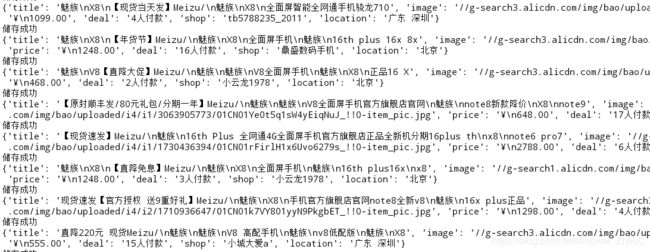

4.运行结果

运行代码,可以发现首先会弹出一个Chrome浏览器,然后会访问淘宝页面,接着控制台便会输出相应的提取结果。

MongoDB中的结果