【网络爬虫】Python3—urllib库的使用

前言

\quad\quad 爬虫基础知识这里介绍了和爬虫相关的一些基础知识,其中提到爬虫最初的操作便是模拟浏览器想服务器发出请求,那么我们应该如何操作呢?

\quad\quad 其实,Python已经为我们提供了功能齐全的类库来帮助我们完成这些请求,比如HTTP库有urllib、requests等。

本篇我们就来介绍urllib库的使用

环境

- anaconda3

- python3.6

- jupyter notebook

使用urllib

注:

- 在Python2中,有urllib和urllib2两个库来实现请求的发送,而在Python3中,以及不存在urllib2这个库了,统一为urllib。

- 它是Python内置的HTTP请求库,也就是说不需要额外安装

urllib库中的4个模块:

- request:它是最基本的HTTP请求模块,可以用来模拟发送请求。就像在浏览器里输入网址然后回车一样,只需要给库方法传入URL以及额外的参数,就可以模拟实现这个过程。

- error:异常处理模块,如果出现请求错误,我们可以捕获这些异常,然后进行重试或者其他操作以保证程序不会以外终止。

- parse:一个工具模块,提供了许多URL处理方法,比如拆分、解析、合并等

- robotparser:主要用来识别网站的robots.txt文件,然后判断哪些网站可以爬,哪些网站不可以爬,这个用的比较少。

发送请求

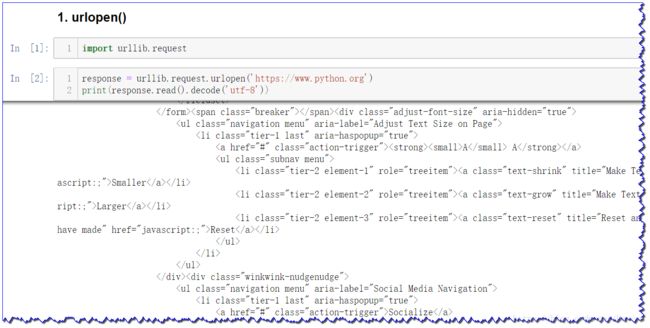

1. urlopen()

import urllib.request # 导入urllib.request模块,提供了最基本的构造HTTP请求的方法

response = urllib.request.urlopen('https://www.python.org') # 以python官网为例,把这个页面爬取下来

print(response.read().decode('utf-8')) # read()方法得到返回的网页内容

这里,我们只用了两行代码,就把python官网的网页抓取下来了,输出的是网页的源代码。得到代码后,我们想要的链接、图片地址、文本信息就都可以提取出来。

print(type(response)) # 输出响应类型

print(response.status) # 返回结果的状态码

print(response.getheaders()) # 响应的头信息

print(response.getheader('Server')) # 响应头中的Server值,nginx意思是服务器用nginx搭建的

HTTPResponse类型对象,主要包含:read()、readinto()、getheader(name)、getheaders()、fileno()等方法,以及msg、version、status、debuglevel、closed等属性

\quad\quad 如果想给链接传递一些参数,该怎么实现?我们先来看看urlopen()函数的API:

urllib.request.urlopen(url, data=None, timeout=- data参数

\quad\quad data参数是可选的,如果要添加该参数,并且如果它是字节流编码格式的内容,即bytes类型,则需要通过bytes()方法转化,另外传递了 这个参数,则它的请求方式就不再是GET方式,而是POST方式

import urllib.parse

data = bytes(urllib.parse.urlencode({'word':'hello'}), encoding = 'utf8') # 传递一个参数word,值为hello,需要被转码为bytes类型

response = urllib.request.urlopen('http://httpbin.org/post',data=data)

print(response.read())

- timeout参数

\quad\quad timeout参数用于设置超时时间,单位为秒,意思就是如果请求超过设置的时间,还没有得到响应,就会抛出异常,如果不指定,就会使用全局默认时间

response = urllib.request.urlopen('http://httpbin.org/get', timeout=1) # 设置超时时间为1秒

print(response.read())

\quad\quad 因此,我们可以设置这个超时时间来控制一个网页如果长时间未响应,就跳过它的抓取。

import socket

import urllib.error

try:

response = urllib.request.urlopen('http://httpbin.org/get', timeout=0.1)

except urllib.error.URLError as e:

if isinstance(e.reason, socket.timeout):

print('TIME OUT')

- 其他参数

- 除了data和timeout参数外,还有context参数,它必须是ssl.SSLContext类型,用来指定SSL设置

- caflie和capath这两个参数分别指定CA证书和它的路径

- cadefault已经弃用,默认为False

2. Request

\quad\quad 上面我们介绍了urlopen()方法可以实现最基本的发送,但这几个参数并不足以构建一个完整的请求,如果请求中需要加入Headers等信息,就可以利用更强大的Request。

import urllib.request

request = urllib.request.Request('https://python.org')

response = urllib.request.urlopen(request)

print(response.read().decode('utf-8'))

我们依然用urlopen()方法来发送请求,只不过这次该方法的参数不再是URL,而是一个Request类型的对象

通过这个,我们可以将请求独立成一个对象,可更加丰富和灵活地配置参数

urllib.request.Request(url, data=None, headers={}, origin_req_host=None, unverifiable=False, method=None)

- url:用于请求URL,必传参数

- data:如果要传,必须传bytes类型,如果它是字典,可以先用urllib.parse模块里的urlencode()编码

- headers:请求头,我们可以在构造请求时通过headers参数值构造,也可以通过调用请求实例的add_header()方法添加

添加请求头最常用的用法就是通过修改User-Agent来伪装浏览器

- origin_req_host:指的是请求方的host名称或者IP地址

- unverifiable:这个请求是否是无法验证,默认False,即用户没用足够权限来选取接受这个请求的结果

- method:是一个字符串,用来只是请求的方法,比如:GET、POST、PUT等

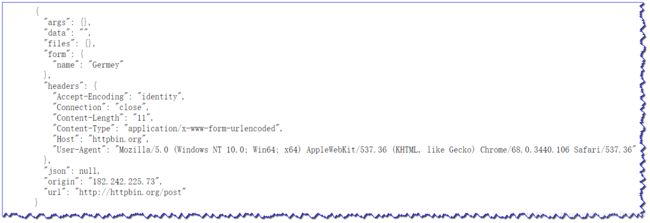

from urllib import request,parse

url = 'http://httpbin.org/post' # 请求URL

headers = { # headers指定User-Agent,Host

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/68.0.3440.106 Safari/537.36',

'Host':'httpbin.org'

}

dict = {

'name':'Germey'

}

data = bytes(parse.urlencode(dict), encoding='utf8') # 参数转化为字节流

req = request.Request(url=url, data=data, headers=headers, method='POST') # 指定请求方式为POST

response = request.urlopen(req)

print(response.read().decode('utf-8'))

结果发现,我们成功设置了data、headers和method

另外,headers也可以用add_header()方法来添加

req = request.Request(url = url, data = data, method='POST')

req.add_header('User-Agent','Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/68.0.3440.106 Safari/537.36')

高级用法:

\quad\quad 在上面的过程中,我们虽然可以构造请求,但是对于一些更高级的操作(比如Cookies处理、代理设置等),又该怎么办呢?

这是就需要更强大的工具Handler,urllib.request模块里的BaseHandler类,是所有其他Handler的父类,它提供了最基本的方法:

如:default_open()、protocol_request()等

以下为各种Handler子类继承了这个BaseHandler类:

-

HTTPDefaultErrorHandler:用于处理HTTP响应错误,错误都会抛出HTTPError类型的异常

-

HTTPRedirectHandler:用于处理重定向

-

HTTPCookieProcessor:用于处理Cookies

-

ProxyHandler:用于设置代理,默认代理为空

-

HTTPPasswordMgr:用于管理密码,它维护了用户名和密码的表

-

HTTPBasicAuthHandler:用于管理认证,如果一个链接打开需要认证,那么可以用它来解决认证问题

另外还有其他的Handler类,可参考Python官方文档

下面我们用几个实例来看看他们的用法:

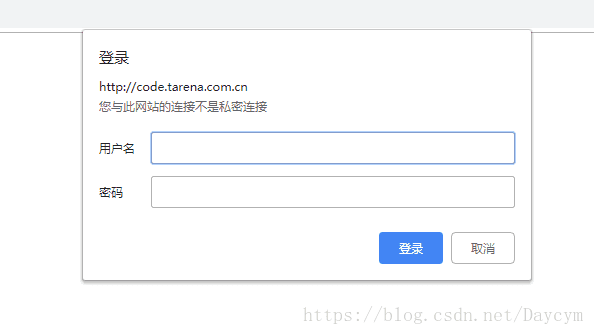

- 验证

有些网站在打开的时候就需要完验证,直接提示你输入用户名和密码

如果要请求这样的页面,我们可以借助HTTPBasicAuthHandler:

from urllib.request import HTTPPasswordMgrWithDefaultRealm,HTTPBasicAuthHandler,build_opener

from urllib.error import URLError

username = 'username' # 这里帐号密码未提供

password = 'password'

url = 'http://code.tarena.com.cn/'

p = HTTPPasswordMgrWithDefaultRealm() # 实例化HTTPPasswordMgrWithDefaultRealm对象

p.add_password(None, url, username, password) # 添加进去用户名和密码

auth_handler = HTTPBasicAuthHandler(p) # 实例化HTTPBasicAuthHandler对象,其参数是HTTPPasswordMgrWithDefaultRealm对象

opener = build_opener(auth_handler) # 通过build_opener()方法来构建一个Opener

try:

result = opener.open(url) # 利用opener的open()方法来打开链接 这样就可以完成验证了

html = result.read().decode('utf-8')

print(html)

except URLError as e:

print(e.reason)

- 代理

在做爬虫的时候,免不了要使用代理,要添加代理可以如下操作:

from urllib.error import URLError

from urllib.request import ProxyHandler, build_opener

# 使用ProxyHandler构建一个字典,键名为协议,键值为代理链接,这里的代理可能无效了,链接可在网上百度

proxy_handler = ProxyHandler({

'http':'http://127.0.0.1:9743',

'https':'https://127.0.0.1:9743'

})

opener = build_opener(proxy_handler)

try:

response = opener.open('https://www.baidu.com')

print(response.read().decode('utf-8'))

except URLError as e:

print(e.reason)

- Cookies

Cookies处理就需要相关的Handler

import http.cookiejar, urllib.request

# 获取Cookies

cookie = http.cookiejar.CookieJar() # 声明一个CookieJar对象

handler = urllib.request.HTTPCookieProcessor(cookie) # 利用HTTPCookieProcessor来构建一个Handler

opener = urllib.request.build_opener(handler) # 利用build_opener()方法构建出Opener

response = opener.open('http://www.baidu.com') # 执行open()函数

for item in cookie:

print(item.name + "=" + item.value)

# 用MozillaCookieJar 保存cookies

filename = 'cookies1.txt'

cookie = http.cookiejar.MozillaCookieJar(filename)

handler = urllib.request.HTTPCookieProcessor(cookie)

opener = urllib.request.build_opener(handler)

response = opener.open('http://www.baidu.com')

cookie.save(ignore_discard = True, ignore_expires = True)

# 用LWPCookieJar 保存cookies

filename = 'cookies2.txt'

cookie = http.cookiejar.LWPCookieJar(filename)

handler = urllib.request.HTTPCookieProcessor(cookie)

opener = urllib.request.build_opener(handler)

response = opener.open('http://www.baidu.com')

cookie.save(ignore_discard = True, ignore_expires = True)

# 从文件中读取cookies

cookie = http.cookiejar.LWPCookieJar()

cookie.load('cookies2.txt', ignore_discard=True, ignore_expires=True)

handler = urllib.request.HTTPCookieProcessor(cookie)

opener = urllib.request.build_opener(handler)

response = opener.open('http://www.baidu.com')

print(response.read().decode('utf-8'))

异常处理

\quad\quad urllib的error模块定义了由request模块产生的异常,如果出现了问题,request模块会抛出error模块中定义的异常。

1. URLError

from urllib import request,error

try:

response = request.urlopen('https://blog.csdn.net/Daycym/article/details/11') # 随便传入一个不存在的页面

except error.URLError as e:

print(e.reason) # 打印异常原因,不会报错

2. HTTPError

它是URLError的子类,专门用来处理HTTP请求错误,比如认证请求失败

- code: 返回HTTP的状态码,比如404表示网页不存在,500表示服务器内部错误

- reason: 同父类一样,用于返回错误的原因

- headers: 返回请求头

from urllib import request, error

try:

response = request.urlopen('https://blog.csdn.net/Daycym/article/details/11')

except error.HTTPError as e:

print(e.reason, e.code, e.headers) # 输出reason、code、headers属性

# 这是一个比较好的异常处理方法

# 可以先捕获子类异常再捕获父类异常

from urllib import request, error

try:

response = request.urlopen('https://blog.csdn.net/Daycym/article/details/11')

except error.HTTPError as e:

print(e.reason, e.code, e.headers)

except error.URLError as e:

print(e.reason)

else:

print('Request Successfully')

import socket

import urllib.request

import urllib.error

try:

response = urllib.request.urlopen('https://www.baidu.com', timeout=0.1)

except urllib.error.URLError as e:

print(type(e.reason)) # 有时候返回的不一定是字符串,也可能是对象

if isinstance(e.reason, socket.timeout):

print('TIME OUT')

解析链接

urllib库还提供了parse模块,它定义了处理URL的标准接口,例如URL各部分的抽取、合并以及链接转换

1. urlparse()

urllib.parse.urlparse(url, scheme='', allow_fragments=True)

- url: 必填项,即待解析的URL

- scheme: 它是默认的协议(比如http和https)

- allow_fragments: 即是否忽略fragment

from urllib.parse import urlparse

result =urlparse('https://www.baidu.com/index.html;user?id=5#comment')

print(type(result), result)

result = urlparse('www.baidu.com/index.html;user?id=5#comment', scheme='https')

print(result)

result = urlparse('http://www.baidu.com/index.html;user?id=5#comment', scheme='https')

print(result)

result = urlparse('www.baidu.com/index.html;user?id=5#comment', allow_fragments=False)

print(result)

result = urlparse('www.baidu.com/index.html;user?id=5#comment', allow_fragments=True)

print(result)

result = urlparse('https://www.baidu.com/index.html#comment', allow_fragments=True)

print(result)

print(result.scheme) # 获取scheme

print(result[0]) # 获取scheme 结果与上面一样

print(result.netloc) # 获取netloc

print(result[1]) # 获取netloc 结果与上面一样

2. urlumparse() URL的构造

from urllib.parse import urlunparse

data = ['http','www.baidu.com','index.html','user','a=6','comment'] # 长度必须为6

print(urlunparse(data))

运行结果为:http://www.baidu.com/index.html;user?a=6#comment

3. urlsplit()

from urllib.parse import urlsplit

result = urlsplit('http://www.baidu.com/index.html;user?id=5#comment')

print(result,result.scheme,result[0])

运行结果为:SplitResult(scheme='http', netloc='www.baidu.com', path='/index.html;user', query='id=5', fragment='comment') http http

4. urlunsplit()

from urllib.parse import urlunsplit

data = data = ['http','www.baidu.com','index.html','a=6','comment'] # 长度必须为5

print(urlunsplit(data))

运行结果为:http://www.baidu.com/index.html?a=6#comment

5. urljoin()

我们可以提供一个base_url(基础链接)作为第一个参数,将新的链接作为第二个参数,该方法会分析base_url的scheme、netoc和path这3个内容并对新链接缺失的部分进行补充

from urllib.parse import urljoin

print(urljoin('http://www.baidu.com', 'FAQ.html'))

print(urljoin('http://www.baidu.com', 'https://cuiqingcai.com/FAQ.html')) # 如果新的链接中有scheme、netoc和path,就用新的

print(urljoin('http://www.baidu.com/about.html', 'https://cuiqingcai.com/FAQ.html')) # base_url中的params、query和fragment不起作用

print(urljoin('http://www.baidu.com/about.html', 'https://cuiqingcai.com/FAQ.html?question=2'))

print(urljoin('http://www.baidu.com?wd=abc', 'https://cuiqingcai.com/index.php'))

print(urljoin('http://www.baidu.com', '?category=2#comment'))

print(urljoin('www.baidu.com', '?category=2#comment'))

print(urljoin('www.baidu.com#comment', '?category=2'))

运行结果为:

http://www.baidu.com/FAQ.html

https://cuiqingcai.com/FAQ.html

https://cuiqingcai.com/FAQ.html

https://cuiqingcai.com/FAQ.html?question=2

https://cuiqingcai.com/index.php

http://www.baidu.com?category=2#comment

www.baidu.com?category=2#comment

www.baidu.com?category=2

6. urlencode () 在构造GET请求的时候非常有用

from urllib.parse import urlencode

params = {

'name': 'germey',

'age': 22

}

base_url = 'http://www.baidu.com?'

url = base_url + urlencode(params)

print(url)

运行结果为:http://www.baidu.com?name=germey&age=22

7. parse_qs() 将一串GET请求参数转为字典

from urllib.parse import parse_qs

query = 'name=germey&age=22'

print(parse_qs(query))

运行结果为:{'name': ['germey'], 'age': ['22']}

8. parse_qsl() 将参数转为元祖组成的列表

from urllib.parse import parse_qsl

query = 'name=germey&age=22'

print(parse_qsl(query))

运行结果为:[('name', 'germey'), ('age', '22')]

9. quote() 将内容转化为URL编码的格式

URL中常带有中文参数,此时可能会导致乱码的问题,用这个方法可以将中文符转化为URL编码

from urllib.parse import quote

keyword = '壁纸'

url = 'https://www.baidu.com/s?wd=' + quote(keyword)

print(url)

运行结果为:https://www.baidu.com/s?wd=%E5%A3%81%E7%BA%B8

10.unquote()

from urllib.parse import unquote

url = 'https://www.baidu.com/s?wd=%E5%A3%81%E7%BA%B8'

print(unquote(url))

运行结果为:https://www.baidu.com/s?wd=壁纸

分析Robots协议

1. Robots协议

也称网络爬虫协议,机器人协议,它的全称叫做:网络爬虫排除标准,用来告诉爬虫和搜索引擎哪些页面可以爬取,哪些不可以爬取,它通常是一个叫robots.txt文本文件,一般放在网站的根目录下

2. robotparse()

from urllib.robotparser import RobotFileParser

rp = RobotFileParser()

# 或 rp = RobotFileParser('http://www.jianshu.com/robots.txt')

rp.set_url('http://www.jianshu.com/robots.txt')

rp.read()

print(rp.can_fetch('*', 'http://www.jianshu.com/p/b67554025d7d')) # 判断是否可以被爬取

print(rp.can_fetch('*', "http://www.jianshu.com/search?q=python&page=1&type=collections"))