【机器学习】机器学习入门系列(共七章)

这个由7部分组成的迷你课程将简要介绍数据科学和应用机器学习。如果您是一名开发人员,分析师,经理或有抱负的数据科学家,希望了解有关数据科学的更多信息,那么您就是在正确的位置。

让我们开始吧!

第1章:鸟瞰图

首先,让我们从数据科学的“80/20”开始......

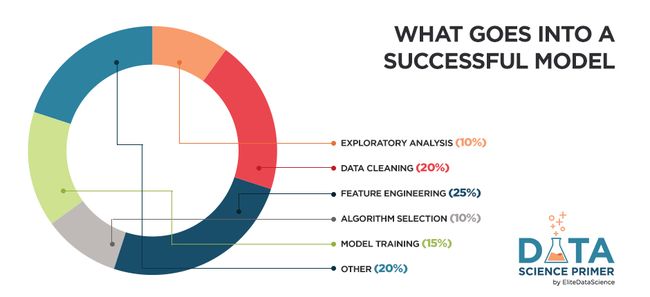

一般来说,我们可以将应用的机器学习分解为以下几个块:

该数据科学入门将涵盖探索性分析,数据清理,特征工程,算法选择和模型培训。如你所见,那些块占了馅饼的80%。他们还为更先进的技术奠定了基础。

在第一章中,您将看到这些移动部件如何组合在一起。因此,我们建议以下两个提示,以充分利用这个入门:

提示#1 - 不要担心细节(现在)。

我们已经看到学生通过首先了解所有部分如何组合在一起,然后深入潜水,快速掌握了这个主题。我们的培训都遵循这种“自上而下”的方法。

提示#2 - 不要担心编码。

再次,它很容易在开始时迷失在杂草中......所以我们的目标是看到森林而不是树木。别担心 - 我们稍后会看到这些代码。

链接:https://blog.csdn.net/chenvast/article/details/81280394

第2章:探索性分析

数据科学中存在一个名为“Tactical Hell”的巨大挑战。这实际上是来自创业公司的一个术语,当你有太多的策略可供选择时:

你应该更多地开发你的产品吗?投资营销?聘请会计师?等等。

在许多方面,培训ML模型就像培养创业公司一样。你也有太多的策略可供选择:

你应该更清洁你的数据吗?工程师功能?测试新算法?等等。

有很多试验和错误,所以你如何避免追逐死胡同?答案是“ 探索性分析”。“(这对于”了解“你的数据只是一种奇特的说法。)

提前做这件事可以帮助您节省时间并避免疯狂追逐......作为一名数据科学家,您是一名资源有限(即时间)的指挥官。 探索性分析就像派出侦察员来学习部署你的部队!

链接:https://blog.csdn.net/chenvast/article/details/81280689

第3章:数据清理

正确的数据清理是机器学习背后的“秘密”......好吧,它并不是真正的“秘密”......它只是有点无聊,所以没有人真正谈论它。但事实是:

更好的数据优于更高级的算法......

(即使你忘了这篇入门书中的其他内容,请记住这一点)

Garbage in = Garbage out ... 简单而简单!如果你有一个干净的数据集,即使是简单的算法也可以从中学到令人印象深刻的见解!

现在,正如您可能想象的那样,不同的问题将需要不同的方法......现在,让我们至少确保我们知道如何 解决最常见的问题。无论您的数据集如何,本章都将为您提供可靠的起点。

链接:https://blog.csdn.net/chenvast/article/details/81280793

第4章:特征工程

简而言之,“特征工程”正在从现有模型中创建新的模型输入功能。

这听起来并不多......但是,百度人工智能和谷歌大脑前负责人安德鲁·吴说:

“提供功能很困难,耗时,需要专业知识。

“应用机器学习”基本上是特征工程。”

哇!没有压力吧?

那为什么它如此困难又耗时?

首先,功能工程是非常开放的。创建新功能实际上有无限的选择。此外,您需要领域知识来添加信息功能而不是更多噪音。

这是一项随着时间和实践而发展的技能,但启发式技术将为您提供一个良好的开端。启发式技术可以帮助您了解从哪里开始寻找,激发想法并解开思路。

链接:https://blog.csdn.net/chenvast/article/details/81280940

第5章:算法选择

接下来,我们将介绍5种非常有效的ML算法用于回归。他们每个人都有分类对应物。

只是5?

是。而不是给你一长串算法......

...我们的目标是解释一些基本概念(例如正则化,集成,自动特征选择),它们将教会您为什么某些算法往往比其他算法表现更好。

在应用机器学习中,应根据哪个算法最适合问题和数据集来交换单个算法。

因此,我们将专注于直觉和实际利益而不是数学和理论。

我们有两个主要目标:

- 解释现代ML中的强大机制。

- 介绍几种使用这些机制的算法。

所以如果你准备好了,那我们就准备好了。我们走吧!

链接:https://blog.csdn.net/chenvast/article/details/81281011

第6章:模型培训

最后......是时候建立我们的模型了!

看起来好像花了一段时间才能到达这里,但数据科学家确实花了大部分时间在早期的步骤上:

- 探索数据。

- 清理数据。

- 工程新功能。

再次,这是因为更好的数据胜过更高级的算法。

现在,您将学习如何在防止过度拟合的同时最大化模型性能。另外,您将学习如何 自动为每种算法找到最佳参数。

我们将概述拆分数据集,决定超参数,设置交叉验证,拟合和调整模型,最后......选择胜利者!

链接:https://blog.csdn.net/chenvast/article/details/81281352

第7章:后续步骤

到目前为止一直很好的工作...我们真的涵盖了很多地方!

- 在第1章中,您看到了整个机器学习工作流程的鸟瞰图。

- 然后,在第2章中,您学习了快速,高效且具有决定性的探索性分析框架。

- 第3章是关于数据清理的,这可能是最重要的一步。

- 接下来,在第4章中,我们分享了我们最喜欢的特征工程启发式方法。

- 在第5章中,我们讨论了正则化和集合,并且您了解了5种 利用这些机制的算法。

- 在第6章中,我们通过一个经过验证的公式,在正确完成其他步骤后培训出色的模型。

链接:https://blog.csdn.net/chenvast/article/details/81281448

原文链接:https://elitedatascience.com/primer