CVPR 2017 论文集锦(目标检测与目标追踪相关)

CVPR 2017 有很多优秀的论文,但,学,是无止境的,正所谓“伤其十指,不如断其一指”,这么多内容我也不可能一一整理。未来,导师让我做目标检测与目标追踪等方向的研究。因此,以下,只整理了关于目标检测与目标追踪方向的论文。【持续更新与丰富内容】

我想说:是在是太难整理了!

CVPR 2017关于单目标追踪的论文总共11篇,相关滤波7篇,其中1篇是oral,3篇用到卷积特征,相关滤波占了64%,(非卷积特征的)CNN相关4篇,可以看出目标跟踪现在最火的是相关滤波和深度学习。

1、一篇oral滤波 paper :Context-Aware Correlation Filter Tracking

论文链接:https://ivul.kaust.edu.sa/Pages/pub-ca-cf-tracking.aspx

代码链接:https://github.com/thias15/Context-Aware-CF-Tracking

论文详解链接:

简要介绍:是这个组 Home - Publications MT+CF, AT+CF的后续工作,虽然不被很多人看好,但它竟然是tracking中唯一一个oral,但每篇都有代码还算良心,今年主打是基于Staple的Staple+CA,至少速度还算快,可以看看。

2、六篇相关滤波

1)跟踪算法 ECO: Efficient Convolution Operators for Tracking

论文链接:https://arxiv.org/pdf/1611.09224.pdf

Project :http://www.cvl.isy.liu.se/research/objrec/visualtracking/ecotrack/index.html

代码链接:https://github.com/martin-danelljan/ECO

论文详解链接:

简要介绍:作者是Martin Danelljan,视觉追踪领域的大牛。2016年,在ECCV 上发表了 E-CTO 的文章,去年他的C-COT是VOT2016的第一名,这次,又对该算法进行了改进,改进后,不管是从结果还是速度上都有提升,尤其是速度提升明显。用传统特征HOG+CN的版本速度有60+FPS,用CNN+HOG+CN的速度有8FPS,从跟踪效果来看,可以算一个出色的作品。

2)跟踪算法 CSR-DCF: Discriminative Correlation Filter with Channel and Spatial Reliability

论文链接:https://arxiv.org/pdf/1611.08461v1.pdf

代码链接:https://github.com/alanlukezic/csr-dcf

论文详解链接:

简要介绍:是Staple和CFLB的结合,没有深度特征但加入了颜色直方图,还考虑了边界效应,在VOT上超过C-COT,速度勉强实时13fps,代码也已经公开了, 颜色直方图的又一种用法,有趣,要看要看。

3)跟踪算法 LMCF: Large Margin Object Tracking with Circulant Feature Maps

论文链接:https://arxiv.org/pdf/1703.05020.pdf

Project :

代码链接:

论文详解链接:https://zhuanlan.zhihu.com/p/25761718

简要介绍:国人大作必须支持。这个可以看作者知乎,不用多说,速度很快80fps,其中的指标APCE我非常看好。

4)跟踪算法 MCPF: Multi-task Correlation Particle Filter for Robust Visual Tracking

论文链接:http://nlpr-web.ia.ac.cn/mmc/homepage/tzzhang/Project_Tianzhu/zhang_mcpf/CVPR2017/1758.pdf

Project :http://nlpr-web.ia.ac.cn/mmc/homepage/tzzhang/mcpf.html

代码链接:http://nlpr-web.ia.ac.cn/mmc/homepage/tzzhang/mcpf.html

论文详解链接:

简要介绍:国人大作必须支持。张天柱 Tianzhu Zhang老师也已经全面转向相关滤波了,还在做稀疏的同学快醒醒。粒子滤波结合相关滤波,速度和性能都非常接近C-COT,论文没跑VOT,不知道会不会参加VOT2017。

5)跟踪算法 CFNet: End-to-end representation learning for Correlation Filter based tracking

论文链接:http://link.zhihu.com/?target=https%3A//arxiv.org/pdf/1704.06036v1.pdf

Project :http://www.robots.ox.ac.uk/~luca/cfnet.html

代码链接:https://github.com/bertinetto/cfnet

论文详解链接:

简要介绍:Luca Bertinetto Luca Bertinetto - Personal page 去年的Staple和SiamFC都是VOT2016的两点,这是另一个每篇有代码,每篇都精品的大牛,CFNet是SiamFC的改进,CF进入CNN端到端训练了,研究热点,效果一般,有可能是边界效应问题没解决好。

6)跟踪算法 ACFN: Attentional Correlation Filter Network for Adaptive Visual Tracking

论文链接:http://link.zhihu.com/?target=https%3A//drive.google.com/file/d/0B0ZkG8zaRQoLUHdlTGNtUWFjd1E/view

训练代码链接:http://link.zhihu.com/?target=https%3A//drive.google.com/file/d/0B0ZkG8zaRQoLZVVranBnbHlydnM/view%3Fusp%3Ddrive_web

测试代码链接:http://link.zhihu.com/?target=https%3A//drive.google.com/file/d/0B0ZkG8zaRQoLQUswbW9qSWFaU0U/view%3Fusp%3Ddrive_web

简要介绍:另一篇CNN+相关滤波的方法,韩国这个组 Perception and Intelligence Lab 今年中了好多篇(下面的ADNet也是),论文还没看,感觉灌水居多兴趣不大,听说效果并不好,速度太慢的不感冒,不过做学术CNN之类的是热点,要跟进。

3、其它四篇

ADNet: Sangdoo Yun, Jongwon Choi, Youngjoon Yoo, Kimin Yun, Jin Young Choi. "Action-Decision Networks for Visual Tracking with Deep Reinforcement Learning ." CVPR (2017 Spotlight). [paper] [project]

BranchOut: Bohyung Han, Jack Sim, Hartwig Adam. "BranchOut: Regularization for Online Ensemble Tracking with Convolutional Neural Networks." CVPR (2017).

Donghun Yeo, Jeany Son, Bohyung Han, Joonhee Han. "Superpixel-based Tracking-by-Segmentation using Markov Chains." CVPR (2017).

相关说明:性能方面,ECO独领风骚,超出其他方法一大截,是唯一一个超过C-COT的;接下来是MCPF和ECO-HC几乎接近;之后Staple+CA略差一点了,但还是比SRDCF高一些;最后CFNet-conv2没有达到SRDCF的水准,CFNet-conv1就更是低的没谱了。速度方面:从下往上看,总体趋势越来越慢,比Staple好的方法中,ECO-HC比Staple+CA稍微快一点,其他的都很慢。另外,Qiang Wang 的DCFNet不论是速度还是性能都超过CFNet,注意这两个都在GPU上跑的。相信不用我说您也看出来了,ECO目前最好,而ECO-HC是又快又好的那个,非常尴尬,Staple+CA与ECO-HC相比,速度慢一点,性能差一截,这个oral真的非非非常尴尬,莫名其妙。。

分析总结:

要么又好又快,要么又好又新,要么又好又快又新。相关滤波的几篇论文代码基本都已公开,要跟进的可以排上日程表了。CNN的统治力太强大了,相关滤波要么结合深度特征,要么结合CNN训练,这可能是热点。

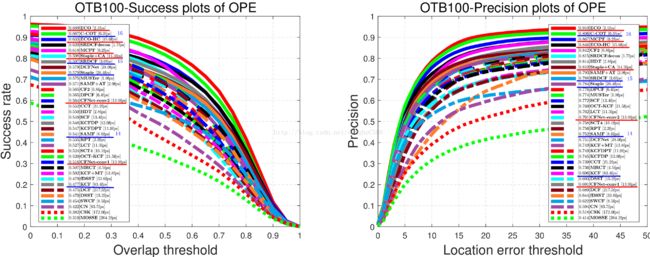

OTB100: 参考HakaseH/CF_benchmark_results 分析下这几个方法在OTB100上的表现:

这里包含了CA+CF, ECO, MCPF和CFNet,LMCF还没有公开代码,虽然我催过@H Hakase更新CSR-DCF和ACFN的结果,但暂时还没有更新,CSR-DCF是颜色直方图方法,在OTB100上不会很高,看论文接近SRDCF,而ACFN看论文在OTB2015上不如Staple+CA的,这两个就先不管了。

红线标出了今年CVPR的方法,包括ECO, ECO-HC, MCPF, Staple+CA, CFNet-conv2和CFNet-conv1,蓝线是几个BASELINE,性能方面分别是14年的SAMF,15年的SRDCF和16年的C-COT,速度方面是14年的KCF和16年的Staple。

性能方面,ECO独领风骚,超出其他方法一大截,是唯一一个超过C-COT的;接下来是MCPF和ECO-HC几乎接近;之后Staple+CA略差一点了,但还是比SRDCF高一些;最后CFNet-conv2没有达到SRDCF的水准,CFNet-conv1就更是低的没谱了。速度方面:从下往上看,总体趋势越来越慢,比Staple好的方法中,ECO-HC比Staple+CA稍微快一点,其他的都很慢。另外,Qiang Wang 的DCFNet不论是速度还是性能都超过CFNet,注意这两个都在GPU上跑的。相信不用我说您也看出来了,ECO目前最好,而ECO-HC是又快又好的那个,非常尴尬,Staple+CA与ECO-HC相比,速度慢一点,性能差一截,这个oral真的非非非常尴尬,莫名其妙。。

VOT2016: 我最公认的数据库是OTB100和VOT2016,而大多数论文都不跑VOT2016,说明这个数据库的难度还是非常高的,CVPR 2017只有ECO和CSR-DCF跑了VOT2016,下面这个表格简单比较一下:

EAO和A越高越好,R越低越好,可以看出ECO高出非常多,但也不能说其他方法不好,最终还是要看VOT2017上各算法的表现了。必须一提,CSR-DCF是CPU上勉强实时的方法13fps,而ECO是C-COT的加速版提升了20倍,CPU上也还能接受了。

更新结果:CSR-DCF和ACFN的结果已更新,同样结合了颜色直方图,CSR-DCF要比Staple好一点,但也慢很多,ACFN与CFNet-conv2基本相当。速度方面,CSR-DCF不算快,是ECO的三倍,再考虑VOT2016的表现,CSR-DCF还是不错的。

注意:上图仅是目前公开代码的相关滤波类方法在OTB100上的性能和速度比较。

一点废话:VOT2016已经难到调参都很难提高的地步,所以大量论文都不敢跑没法刷,关于VOT2017,又新增了10个序列,都非常非常难,而且今年严防死守过拟合,不让在OTB, VOT, ALOV, NUSPRO和相似目标的序列上训练,我比较期待MDNet和TCNN今年会是什么水准,而且也一直不看好tracking问题在跟踪数据库少量序列上end-to-end训练(过拟合刷库是非常非常没有意义的事,如果有大规模百万级跟踪数据库这种方法也许可行),最好fine-tune也不要有,就在大规模(非tracking)图像或(非tracking)视频库上end-to-end训练,模型拿过来直接用比较合理,比如ECO中的VGGNet卷积特征就非常成功,哪个库都很高完全没有过拟合问题。

分析总结参考链接:https://zhuanlan.zhihu.com/p/27335895