- 【TVM 教程】如何处理 TVM 报错

ApacheTVM是一个深度的深度学习编译框架,适用于CPU、GPU和各种机器学习加速芯片。更多TVM中文文档可访问→https://tvm.hyper.ai/运行TVM时,可能会遇到如下报错:---------------------------------------------------------------AnerroroccurredduringtheexecutionofTVM.F

- 多模态大模型的技术应用与未来展望:重构AI交互范式的新引擎

zhaoyi_he

重构人工智能

一、引言:为什么多模态是AI发展的下一场革命?过去十年,深度学习推动了计算机视觉和自然语言处理的飞跃,但两者的发展路径长期割裂。随着生成式AI和大模型时代的到来,**多模态大模型(MultimodalFoundationModels)**以统一的建模方式处理图像、文本、音频、视频等多源数据,重塑了“感知-认知-决策”链条,为AGI迈出关键一步。OpenAI的GPT-4o、Google的Gemini

- 【机器学习&深度学习】多分类评估策略

一叶千舟

深度学习【理论】深度学习【应用必备常识】大数据人工智能

目录前言一、多分类3大策略✅宏平均(MacroAverage)✅加权平均(WeightedAverage)✅微平均(MicroAverage)二、类比理解2.1宏平均(MacroAverage)2.1.1计算方式2.1.2适合场景2.1.3宏平均不适用的场景2.1.4宏平均一般用在哪些指标上?2.1.5怎么看macroavg指标?2.1.6宏平均值低说明了什么?2.1.7从宏平均指标中定位模型短板

- 大语言模型应用指南:ReAct 框架

AI大模型应用实战

javapythonjavascriptkotlingolang架构人工智能

大语言模型应用指南:ReAct框架关键词:大语言模型,ReAct框架,自然语言处理(NLP),模型融合,多模态学习,深度学习,深度学习框架1.背景介绍1.1问题由来近年来,深度学习技术在自然语言处理(NLP)领域取得了显著进展。尤其是大语言模型(LargeLanguageModels,LLMs),如BERT、GPT系列等,通过在大规模无标签数据上进行预训练,获得了强大的语言理解和生成能力。然而,预

- 大语言模型原理基础与前沿 基于语言反馈进行微调

AI天才研究院

计算AI大模型企业级应用开发实战AI人工智能与大数据计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

大语言模型原理基础与前沿基于语言反馈进行微调作者:禅与计算机程序设计艺术/ZenandtheArtofComputerProgramming1.背景介绍1.1问题的由来随着深度学习技术的飞速发展,自然语言处理(NLP)领域取得了显著的进展。大语言模型(LargeLanguageModels,LLMs)如GPT-3、BERT等在各项NLP任务上取得了令人瞩目的成绩。然而,如何进一步提高大语言模型的理

- 探索AI人工智能医疗NLP实体识别系统的架构设计

AI学长带你学AI

人工智能自然语言处理easyuiai

探索AI人工智能医疗NLP实体识别系统的架构设计关键词:人工智能、医疗NLP、实体识别、系统架构、深度学习、自然语言处理、医疗信息化摘要:本文将深入探讨医疗领域NLP实体识别系统的架构设计。我们将从基础概念出发,逐步解析医疗文本处理的特殊性,详细介绍实体识别技术的核心原理,并通过实际案例展示如何构建一个高效可靠的医疗实体识别系统。文章还将探讨当前技术面临的挑战和未来发展方向,为医疗AI领域的从业者

- 人工智能动画展示人类的特征

AGI大模型与大数据研究院

AI大模型应用开发实战javapythonjavascriptkotlingolang架构人工智能

人工智能,动画,人类特征,情感识别,行为模拟,机器学习,深度学习,自然语言处理1.背景介绍人工智能(AI)技术近年来发展迅速,已渗透到生活的方方面面。从智能语音助手到自动驾驶汽车,AI正在改变着我们的世界。然而,尽管AI技术取得了令人瞩目的成就,但它仍然难以完全模拟人类的复杂行为和特征。人类的特征是多方面的,包括情感、认知、社交和创造力等。这些特征是人类区别于其他生物的重要标志,也是人类社会文明发

- 深度学习篇---简单果实分类网络

下面我将提供一个使用Python从零实现果实分类模型的完整流程,包括数据准备、模型构建、训练和部署,不依赖任何深度学习框架,仅使用NumPy进行数值计算。1.数据准备与预处理首先需要准备果实图像数据集,将其分为好果和坏果两类,并进行预处理:importosimportnumpyasnpfromPILimportImagefromsklearn.model_selectionimporttrain_

- Python深度学习:3步实现AI人脸识别,效果堪比专业软件!

小筱在线

python人工智能python深度学习

引言:AI人脸识别的时代已经到来在当今数字化时代,人脸识别技术已经从科幻电影走进了我们的日常生活。从手机解锁到机场安检,从银行身份验证到智能门禁系统,这项技术正以前所未有的速度改变着我们的生活方式。而令人振奋的是,借助Python和深度学习技术,普通人也能构建出专业级的人脸识别系统。本文将带领您通过三个关键步骤,使用Python深度学习技术实现一个准确率高达99%的人脸识别系统。这个系统不仅原理简

- 【推荐算法课程二】推荐算法介绍-深度学习算法

盒子6910

运维视角下的广告业务算法推荐算法深度学习运维开发运维人工智能

三、深度学习在推荐系统中的应用3.1深度学习推荐模型的演化关系图3.2AutoRec——单隐层神经网络推荐模型3.2.1AutoRec模型的基本原理AutoRec模型是一个标准的自编码器,它的基本原理是利用协同过滤中的共现矩阵,完成物品向量或者用户向量的自编码。再利用自编码的结果得到用户对物品的预估评分,进而进行推荐排序。什么是自编码器?自编码器是指能够完成数据“自编码”的模型。无论是图像、音频,

- 【AI智能推荐系统】第二篇:深度学习在推荐系统中的架构设计与优化实践

DeepFaye

人工智能深度学习

第二篇:深度学习在推荐系统中的架构设计与优化实践提示语:“从Wide&Deep到Transformer,深度推荐模型如何突破性能瓶颈?本文将揭秘Netflix、淘宝都在用的深度学习推荐架构,手把手教你设计高精度推荐系统!”目录深度学习推荐系统的核心优势主流深度学习推荐架构解析2.1Wide&Deep模型2.2DeepFM与xDeepFM2.3神经协同过滤(NCF)2.4基于Transformer的

- 【深度学习】神经网络剪枝方法的分类

烟锁池塘柳0

机器学习与深度学习深度学习神经网络剪枝

神经网络剪枝方法的分类摘要随着深度学习模型,特别是大语言模型(LLM)的参数量爆炸式增长,模型的部署和推理成本变得异常高昂。如何在保持模型性能的同时,降低其计算和存储需求,成为了工业界和学术界的核心议题。神经网络剪枝(Pruning)作为模型压缩的关键技术之一,应运而生。本文将解析剪枝技术的不同分类,深入探讨其原理、优缺点。文章目录神经网络剪枝方法的分类摘要1为什么我们需要剪枝?2分类方法一:剪什

- Python 图像分类入门

超龄超能程序猿

机器学习python分类开发语言

一、介绍图像分类作为深度学习的基础任务,旨在将输入图像划分到预定义的类别集合中。在实际的业务中,图像分类技术是比较常用的一种技术技能。例如,在安防监控中,可通过图像分类识别异常行为;在智能交通系统中,实现对交通标志和车辆类型的快速识别等。本文将通过安装包已有数据带你逐步了解使用Python进行图像分类的全过程。二、环境搭建在开始图像分类项目前,需要确保Python环境中安装了必要的库。主要包括:T

- 初始CNN(卷积神经网络)

超龄超能程序猿

机器学习cnn人工智能神经网络

卷积神经网络(ConvolutionalNeuralNetwork,简称CNN)作为深度学习的重要分支,在图像识别、目标检测、语义分割等领域大放异彩。无论是手机上的人脸识别解锁,还是自动驾驶汽车对道路和行人的识别,背后都离不开CNN的强大能力一、CNN诞生的背景与意义在CNN出现之前,传统的图像识别方法主要依赖人工提取特征,例如使用SIFT(尺度不变特征变换)、HOG(方向梯度直方图)等算法。这些

- 深度学习实验:GPU加速,突破性能瓶颈

AI天才研究院

AgenticAI实战计算AI人工智能与大数据计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

深度学习实验:GPU加速,突破性能瓶颈1.背景介绍随着深度学习模型变得越来越复杂和庞大,传统的CPU已经无法满足训练和推理的计算需求。GPU凭借其强大的并行计算能力和专门为矩阵运算优化的架构,成为了深度学习领域的核心加速器。本文将探讨如何利用GPU加速深度学习实验,突破性能瓶颈,提高模型训练和推理的效率。2.核心概念与联系2.1GPU架构GPU(图形处理器)最初是为了加速图形渲染而设计的,但由于其

- 深度学习相关指标工作笔记

Victor Zhong

AI框架深度学习笔记人工智能

这里写目录标题检测指标iou/Gou/Diou/CiouMSE(MeanSquaredError)(均方误差)(回归问题)交叉熵损失函数(CrossEntropyErrorFunction)(分类问题)检测指标iou/Gou/Diou/CiouIntersectionoverUnion(IoU)是目标检测里一种重要的评价值交并比令人遗憾的是IoU无法优化无重叠的bboxes如果用IoU作为loss

- 【深度学习新浪潮】基于扩散模型的图像编辑加速方法

小米玄戒Andrew

深度学习新浪潮深度学习人工智能扩散模型TransformerDiT图像编辑模型加速

在基于扩散模型的图像编辑任务中,实现高质量与高效加速的平衡需要综合运用模型架构优化、采样策略创新、条件控制增强及硬件加速等多维度技术。一、一步反演与掩码引导的编辑框架通过一步反演框架将输入图像映射到可编辑的潜在空间,结合掩码引导的注意力重缩放机制,实现文本引导的局部编辑。例如,SwiftEdit通过一步反演和注意力重缩放,将编辑时间压缩至0.23秒,比传统多步方法快50倍。具体步骤包括:一步反演:

- 《从Backprop到Diffusion:深度学习的算法进化树全景图》

HeartException

学习人工智能

前言前些天发现了一个巨牛的人工智能免费学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击跳转到网站《从Backprop到Diffusion:深度学习的算法进化树全景图》**展开系统性解析。全文基于算法原理-技术突破-产业重塑的三层逻辑链,融合2025年最新研究成果与产业数据,呈现深度学习四十年的底层技术迁徙路径从Backprop到Diffusion:深度学习的算法进化树全景图副标题:一部算法

- 多模态大模型:技术原理与实战 看清GPT的进化史和创新点

AI天才研究院

AgenticAI实战计算AI人工智能与大数据计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

多模态大模型:技术原理与实战看清GPT的进化史和创新点1.背景介绍1.1人工智能的发展历程1.1.1早期人工智能1.1.2机器学习时代1.1.3深度学习的崛起1.2自然语言处理的演进1.2.1基于规则的方法1.2.2统计机器学习方法1.2.3深度学习方法1.3大语言模型的出现1.3.1Transformer架构的提出1.3.2GPT系列模型的发展1.3.3多模态大模型的兴起2.核心概念与联系2.1

- 结合创新idea:机器学习+运筹优化=CCF高端局

Ai多利

机器学习人工智能

2024深度学习发论文&模型涨点之——机器学习+运筹优化机器学习是人工智能的一个分支,它使计算机系统能够从数据中学习并改进其性能,而无需进行明确的编程。运筹优化,也称为运筹学或运营管理,是应用数学的一个分支,它使用数学模型和算法来支持复杂决策过程的制定。机器学习与运筹优化的结合是一个前沿且活跃的研究领域,它们相互补充,为解决复杂问题提供了新的思路和方法。小编整理了一些机器学习+运筹优化【论文+代码

- JuPyter(IPython) Notebooks中使用pip安装Python的模块

weixin_34218890

开发工具python人工智能

问题描述:没有带GPU的电脑,搞深度学习不是耍流氓嘛,我网上看到有个云平台,免费使用了一下,小姐姐很热情。使用过程如下:他们给的接口是Jupyter编辑平台,我就在上面跑了一个小例子。tensorflow和python环境是他们配置好的,不过我的例子中需要导入matplotlib.pylot模块。可是他们没有提供,怎么办呢?网上查了一下啊解决方法:采用如下方法:importpipdefMyPipi

- happy-llm 第一章 NLP 基础概念

weixin_38374194

自然语言处理人工智能学习

文章目录一、什么是NLP?二、NLP发展三大阶段三、NLP核心任务精要四、文本表示演进史1.传统方法:统计表征2.神经网络:语义向量化课程地址:happy-llmNLP基础概念一、什么是NLP?核心目标:让计算机理解、生成、处理人类语言,实现人机自然交互。现状与挑战:成就:深度学习推动文本分类、翻译等任务达到近人类水平。瓶颈:歧义性、隐喻理解、跨文化差异等。二、NLP发展三大阶段时期代表技术核心思

- 使用 C++/OpenCV 和 MFCC 构建双重认证智能门禁系统

使用C++/OpenCV和MFCC构建双重认证智能门禁系统引言随着物联网和人工智能技术的发展,智能门禁系统在安防领域的应用越来越广泛。相比于传统的钥匙、门禁卡或密码,生物识别技术(如人脸识别、指纹识别、虹膜识别等)提供了更高的安全性与便利性。然而,单一的生物识别方式在某些场景下可能存在安全隐患。例如,人脸识别可能被高清照片或视频欺骗(称为“欺骗攻击”),在光照、姿态变化剧烈时识别率也可能下降。为了

- 供应链风险管理:AI预测潜在风险

AI智能应用

AI大模型应用入门实战与进阶javapythonjavascriptkotlingolang架构人工智能

供应链风险管理,AI预测,机器学习,深度学习,自然语言处理,风险评估,供应链可视化1.背景介绍在当今全球化经济体系中,供应链的复杂性和脆弱性日益凸显。供应链风险是指任何可能对供应链正常运行造成负面影响的事件或因素。这些风险可能来自自然灾害、政治动荡、经济波动、技术故障、供应商违约等方面。一旦供应链风险爆发,可能会导致生产中断、产品短缺、成本飙升、品牌形象受损等严重后果。传统供应链风险管理方法主要依

- 供应链风险管理:AI如何预测供应链风险

AI大模型应用之禅

javapythonjavascriptkotlingolang架构人工智能

供应链风险管理,AI预测,机器学习,深度学习,自然语言处理,时间序列分析,风险评估1.背景介绍在当今全球化经济体系中,供应链风险已成为企业面临的重大挑战。供应链的复杂性和不可预测性使得企业更容易受到各种风险的影响,例如自然灾害、政治动荡、经济波动、疫情爆发等。这些风险可能导致供应中断、成本增加、交付延迟,甚至损害企业声誉。传统供应链风险管理方法主要依赖于经验和专家判断,缺乏数据驱动和预测能力。随着

- 【极光优化算法+分解对比】VMD-PLO-Transformer-LSTM多变量时间序列光伏功率预测Matlab代码

matlab科研助手

算法transformerlstm

✅作者简介:热爱数据处理、建模、算法设计的Matlab仿真开发者。更多Matlab代码及仿真咨询内容点击:Matlab科研工作室个人信条:格物致知。内容介绍光伏发电作为一种清洁能源,其功率预测对于电网稳定运行和电力系统调度至关重要。然而,光伏功率具有高度的非线性和波动性,传统的预测方法难以准确捕捉其动态特性。近年来,深度学习技术在时间序列预测领域取得了显著进展,为提高光伏功率预测精度提供了新的途径

- 【python深度学习】DAY 51 复习日

抽风的雨610

【打卡】Python训练营python深度学习开发语言

作业:day43的时候我们安排大家对自己找的数据集用简单cnn训练,现在可以尝试下借助这几天的知识来实现精度的进一步提高1.读取数据使用CIFAR-10图像数据importtorchfromtorchvisionimportdatasets,transforms#数据预处理transform=transforms.Compose([transforms.ToTensor(),transforms.

- 用Python解锁图像处理之力:从基础到智能应用的深度探索

熊猫钓鱼>_>

python图像处理开发语言

在像素构成的数字世界里,Python已成为解码图像奥秘的核心引擎。一、为何选择Python处理图像?超越工具的本质思考当人们谈论图像处理时,往往会陷入工具对比的漩涡(PythonvsMATLABvsC++)。但Python的真正价值在于其构建的完整生态闭环:科学计算基石:NumPy的ndarray结构完美对应图像的多维矩阵本质算法实现自由:从传统算子到深度学习模型的无缝衔接可视化即战力:Matpl

- 深度学习数据集加载

Ethan@LM

深度学习人工智能

数据集结构E:\Mytest\test20250622\pythonProject\dataset├──rose│├──rose1.jpg│├──rose2.jpg│└──...└──sunflower├──sunflower1.jpg├──sunflower2.jpg└──...主要只有的两个类fromtorch.utils.dataimportDatasetfromtorchvisionimp

- 使用TVM编译部署DarkNet模型:YOLO-V2和YOLO-V3实战指南

周情津Raymond

使用TVM编译部署DarkNet模型:YOLO-V2和YOLO-V3实战指南tvm-cnTVMDocumentationinChineseSimplified/TVM中文文档项目地址:https://gitcode.com/gh_mirrors/tv/tvm-cn前言在深度学习模型部署领域,TVM作为一个高效的深度学习编译器栈,能够将训练好的模型优化并部署到各种硬件平台上。本文将详细介绍如何使用T

- 枚举的构造函数中抛出异常会怎样

bylijinnan

javaenum单例

首先从使用enum实现单例说起。

为什么要用enum来实现单例?

这篇文章(

http://javarevisited.blogspot.sg/2012/07/why-enum-singleton-are-better-in-java.html)阐述了三个理由:

1.enum单例简单、容易,只需几行代码:

public enum Singleton {

INSTANCE;

- CMake 教程

aigo

C++

转自:http://xiang.lf.blog.163.com/blog/static/127733322201481114456136/

CMake是一个跨平台的程序构建工具,比如起自己编写Makefile方便很多。

介绍:http://baike.baidu.com/view/1126160.htm

本文件不介绍CMake的基本语法,下面是篇不错的入门教程:

http:

- cvc-complex-type.2.3: Element 'beans' cannot have character

Cb123456

springWebgis

cvc-complex-type.2.3: Element 'beans' cannot have character

Line 33 in XML document from ServletContext resource [/WEB-INF/backend-servlet.xml] is i

- jquery实例:随页面滚动条滚动而自动加载内容

120153216

jquery

<script language="javascript">

$(function (){

var i = 4;$(window).bind("scroll", function (event){

//滚动条到网页头部的 高度,兼容ie,ff,chrome

var top = document.documentElement.s

- 将数据库中的数据转换成dbs文件

何必如此

sqldbs

旗正规则引擎通过数据库配置器(DataBuilder)来管理数据库,无论是Oracle,还是其他主流的数据都支持,操作方式是一样的。旗正规则引擎的数据库配置器是用于编辑数据库结构信息以及管理数据库表数据,并且可以执行SQL 语句,主要功能如下。

1)数据库生成表结构信息:

主要生成数据库配置文件(.conf文

- 在IBATIS中配置SQL语句的IN方式

357029540

ibatis

在使用IBATIS进行SQL语句配置查询时,我们一定会遇到通过IN查询的地方,在使用IN查询时我们可以有两种方式进行配置参数:String和List。具体使用方式如下:

1.String:定义一个String的参数userIds,把这个参数传入IBATIS的sql配置文件,sql语句就可以这样写:

<select id="getForms" param

- Spring3 MVC 笔记(一)

7454103

springmvcbeanRESTJSF

自从 MVC 这个概念提出来之后 struts1.X struts2.X jsf 。。。。。

这个view 层的技术一个接一个! 都用过!不敢说哪个绝对的强悍!

要看业务,和整体的设计!

最近公司要求开发个新系统!

- Timer与Spring Quartz 定时执行程序

darkranger

springbean工作quartz

有时候需要定时触发某一项任务。其实在jdk1.3,java sdk就通过java.util.Timer提供相应的功能。一个简单的例子说明如何使用,很简单: 1、第一步,我们需要建立一项任务,我们的任务需要继承java.util.TimerTask package com.test; import java.text.SimpleDateFormat; import java.util.Date;

- 大端小端转换,le32_to_cpu 和cpu_to_le32

aijuans

C语言相关

大端小端转换,le32_to_cpu 和cpu_to_le32 字节序

http://oss.org.cn/kernel-book/ldd3/ch11s04.html

小心不要假设字节序. PC 存储多字节值是低字节为先(小端为先, 因此是小端), 一些高级的平台以另一种方式(大端)

- Nginx负载均衡配置实例详解

avords

[导读] 负载均衡是我们大流量网站要做的一个东西,下面我来给大家介绍在Nginx服务器上进行负载均衡配置方法,希望对有需要的同学有所帮助哦。负载均衡先来简单了解一下什么是负载均衡,单从字面上的意思来理解就可以解 负载均衡是我们大流量网站要做的一个东西,下面我来给大家介绍在Nginx服务器上进行负载均衡配置方法,希望对有需要的同学有所帮助哦。

负载均衡

先来简单了解一下什么是负载均衡

- 乱说的

houxinyou

框架敏捷开发软件测试

从很久以前,大家就研究框架,开发方法,软件工程,好多!反正我是搞不明白!

这两天看好多人研究敏捷模型,瀑布模型!也没太搞明白.

不过感觉和程序开发语言差不多,

瀑布就是顺序,敏捷就是循环.

瀑布就是需求、分析、设计、编码、测试一步一步走下来。而敏捷就是按摸块或者说迭代做个循环,第个循环中也一样是需求、分析、设计、编码、测试一步一步走下来。

也可以把软件开发理

- 欣赏的价值——一个小故事

bijian1013

有效辅导欣赏欣赏的价值

第一次参加家长会,幼儿园的老师说:"您的儿子有多动症,在板凳上连三分钟都坐不了,你最好带他去医院看一看。" 回家的路上,儿子问她老师都说了些什么,她鼻子一酸,差点流下泪来。因为全班30位小朋友,惟有他表现最差;惟有对他,老师表现出不屑,然而她还在告诉她的儿子:"老师表扬你了,说宝宝原来在板凳上坐不了一分钟,现在能坐三分钟。其他妈妈都非常羡慕妈妈,因为全班只有宝宝

- 包冲突问题的解决方法

bingyingao

eclipsemavenexclusions包冲突

包冲突是开发过程中很常见的问题:

其表现有:

1.明明在eclipse中能够索引到某个类,运行时却报出找不到类。

2.明明在eclipse中能够索引到某个类的方法,运行时却报出找不到方法。

3.类及方法都有,以正确编译成了.class文件,在本机跑的好好的,发到测试或者正式环境就

抛如下异常:

java.lang.NoClassDefFoundError: Could not in

- 【Spark七十五】Spark Streaming整合Flume-NG三之接入log4j

bit1129

Stream

先来一段废话:

实际工作中,业务系统的日志基本上是使用Log4j写入到日志文件中的,问题的关键之处在于业务日志的格式混乱,这给对日志文件中的日志进行统计分析带来了极大的困难,或者说,基本上无法进行分析,每个人写日志的习惯不同,导致日志行的格式五花八门,最后只能通过grep来查找特定的关键词缩小范围,但是在集群环境下,每个机器去grep一遍,分析一遍,这个效率如何可想之二,大好光阴都浪费在这上面了

- sudoku solver in Haskell

bookjovi

sudokuhaskell

这几天没太多的事做,想着用函数式语言来写点实用的程序,像fib和prime之类的就不想提了(就一行代码的事),写什么程序呢?在网上闲逛时发现sudoku游戏,sudoku十几年前就知道了,学生生涯时也想过用C/Java来实现个智能求解,但到最后往往没写成,主要是用C/Java写的话会很麻烦。

现在写程序,本人总是有一种思维惯性,总是想把程序写的更紧凑,更精致,代码行数最少,所以现

- java apache ftpClient

bro_feng

java

最近使用apache的ftpclient插件实现ftp下载,遇见几个问题,做如下总结。

1. 上传阻塞,一连串的上传,其中一个就阻塞了,或是用storeFile上传时返回false。查了点资料,说是FTP有主动模式和被动模式。将传出模式修改为被动模式ftp.enterLocalPassiveMode();然后就好了。

看了网上相关介绍,对主动模式和被动模式区别还是比较的模糊,不太了解被动模

- 读《研磨设计模式》-代码笔记-工厂方法模式

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

package design.pattern;

/*

* 工厂方法模式:使一个类的实例化延迟到子类

* 某次,我在工作不知不觉中就用到了工厂方法模式(称为模板方法模式更恰当。2012-10-29):

* 有很多不同的产品,它

- 面试记录语

chenyu19891124

招聘

或许真的在一个平台上成长成什么样,都必须靠自己去努力。有了好的平台让自己展示,就该好好努力。今天是自己单独一次去面试别人,感觉有点小紧张,说话有点打结。在面试完后写面试情况表,下笔真的好难,尤其是要对面试人的情况说明真的好难。

今天面试的是自己同事的同事,现在的这个同事要离职了,介绍了我现在这位同事以前的同事来面试。今天这位求职者面试的是配置管理,期初看了简历觉得应该很适合做配置管理,但是今天面

- Fire Workflow 1.0正式版终于发布了

comsci

工作workflowGoogle

Fire Workflow 是国内另外一款开源工作流,作者是著名的非也同志,哈哈....

官方网站是 http://www.fireflow.org

经过大家努力,Fire Workflow 1.0正式版终于发布了

正式版主要变化:

1、增加IWorkItem.jumpToEx(...)方法,取消了当前环节和目标环节必须在同一条执行线的限制,使得自由流更加自由

2、增加IT

- Python向脚本传参

daizj

python脚本传参

如果想对python脚本传参数,python中对应的argc, argv(c语言的命令行参数)是什么呢?

需要模块:sys

参数个数:len(sys.argv)

脚本名: sys.argv[0]

参数1: sys.argv[1]

参数2: sys.argv[

- 管理用户分组的命令gpasswd

dongwei_6688

passwd

NAME: gpasswd - administer the /etc/group file

SYNOPSIS:

gpasswd group

gpasswd -a user group

gpasswd -d user group

gpasswd -R group

gpasswd -r group

gpasswd [-A user,...] [-M user,...] g

- 郝斌老师数据结构课程笔记

dcj3sjt126com

数据结构与算法

<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<

- yii2 cgridview加上选择框进行操作

dcj3sjt126com

GridView

页面代码

<?=Html::beginForm(['controller/bulk'],'post');?>

<?=Html::dropDownList('action','',[''=>'Mark selected as: ','c'=>'Confirmed','nc'=>'No Confirmed'],['class'=>'dropdown',])

- linux mysql

fypop

linux

enquiry mysql version in centos linux

yum list installed | grep mysql

yum -y remove mysql-libs.x86_64

enquiry mysql version in yum repositoryyum list | grep mysql oryum -y list mysql*

install mysq

- Scramble String

hcx2013

String

Given a string s1, we may represent it as a binary tree by partitioning it to two non-empty substrings recursively.

Below is one possible representation of s1 = "great":

- 跟我学Shiro目录贴

jinnianshilongnian

跟我学shiro

历经三个月左右时间,《跟我学Shiro》系列教程已经完结,暂时没有需要补充的内容,因此生成PDF版供大家下载。最近项目比较紧,没有时间解答一些疑问,暂时无法回复一些问题,很抱歉,不过可以加群(334194438/348194195)一起讨论问题。

----广告-----------------------------------------------------

- nginx日志切割并使用flume-ng收集日志

liyonghui160com

nginx的日志文件没有rotate功能。如果你不处理,日志文件将变得越来越大,还好我们可以写一个nginx日志切割脚本来自动切割日志文件。第一步就是重命名日志文件,不用担心重命名后nginx找不到日志文件而丢失日志。在你未重新打开原名字的日志文件前,nginx还是会向你重命名的文件写日志,linux是靠文件描述符而不是文件名定位文件。第二步向nginx主

- Oracle死锁解决方法

pda158

oracle

select p.spid,c.object_name,b.session_id,b.oracle_username,b.os_user_name from v$process p,v$session a, v$locked_object b,all_objects c where p.addr=a.paddr and a.process=b.process and c.object_id=b.

- java之List排序

shiguanghui

list排序

在Java Collection Framework中定义的List实现有Vector,ArrayList和LinkedList。这些集合提供了对对象组的索引访问。他们提供了元素的添加与删除支持。然而,它们并没有内置的元素排序支持。 你能够使用java.util.Collections类中的sort()方法对List元素进行排序。你既可以给方法传递

- servlet单例多线程

utopialxw

单例多线程servlet

转自http://www.cnblogs.com/yjhrem/articles/3160864.html

和 http://blog.chinaunix.net/uid-7374279-id-3687149.html

Servlet 单例多线程

Servlet如何处理多个请求访问?Servlet容器默认是采用单实例多线程的方式处理多个请求的:1.当web服务器启动的

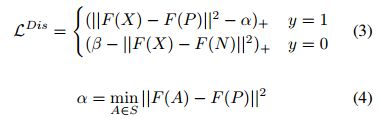

![]() 像素级别的mse距离

像素级别的mse距离 重建和原图间的feature map差异

重建和原图间的feature map差异